Harness Engineering才是智能体工程化落地关键!

随着 AI 智能体开发从实验走向工程化,相关方法论也在快速演进:从提示工程、MCP、上下文工程、Skills,到近期被频繁讨论的 Harness Engineering。本文聚焦 Harness Engineering(下文简称 Harness 工程)的核心概念与边界。

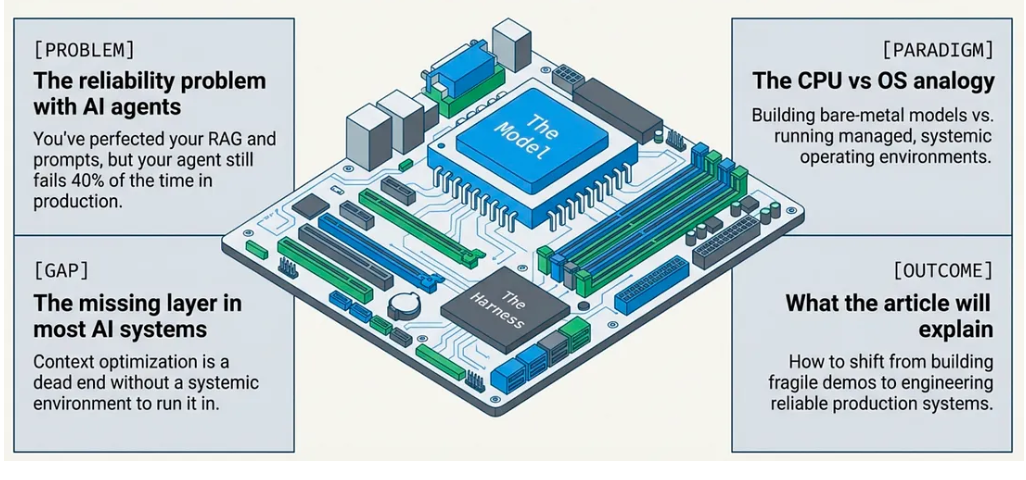

很多 AI 项目在 Demo 阶段表现不错:能对话、能调用工具、能完成简单任务。

一旦进入真实业务环境,问题会集中出现:行为不稳定、难排障、权限风险高、成本不可控。

这类问题的核心,通常不在模型本身,而在 Harness Engineering。

本文聚焦概念本身,回答三个问题:是什么、边界在哪、价值是什么。

先看结论

- 🧠 定位:不是提示词技巧,而是 AI 智能体的执行与治理工程。

- 🧰 关注对象:工具接口、执行循环、上下文与状态、权限边界、观测审计。

- 🧭 概念边界:既不等于模型训练,也不等于业务功能本身。

- 🛡 核心作用:把模型不确定性收敛成可控、可审计、可持续改进的系统行为。

- 📈 业务收益:稳定性更高、维护成本更低、上线风险更可控。

核心内容

什么是 AI 开发里的 Harness Engineering

在 AI 开发语境中,Harness Engineering 可以理解为:

围绕 AI 智能体的“行动能力”构建一套可执行、可观测、可治理的系统底座。

上下文工程可以视为相对独立的子工程,在生产实践中通常由 Harness 工程统一编排。

这套底座通常包含五类能力:

- 🛠 工具能力:定义工具输入输出 schema、超时、重试、幂等策略。

- 🔁 执行能力:承接“模型决策 -> 工具执行 -> 结果回填 -> 再决策”的循环。

- 📚 上下文能力:管理检索、裁剪、记忆写入与上下文预算。

- 👀 观测能力:记录 trace、日志、错误链路、关键指标。

- 🔐 治理能力:控制权限、审批、沙箱隔离、敏感动作审计。

如果说模型负责“思考”,Harness Engineering 负责“把思考安全地变成动作”。

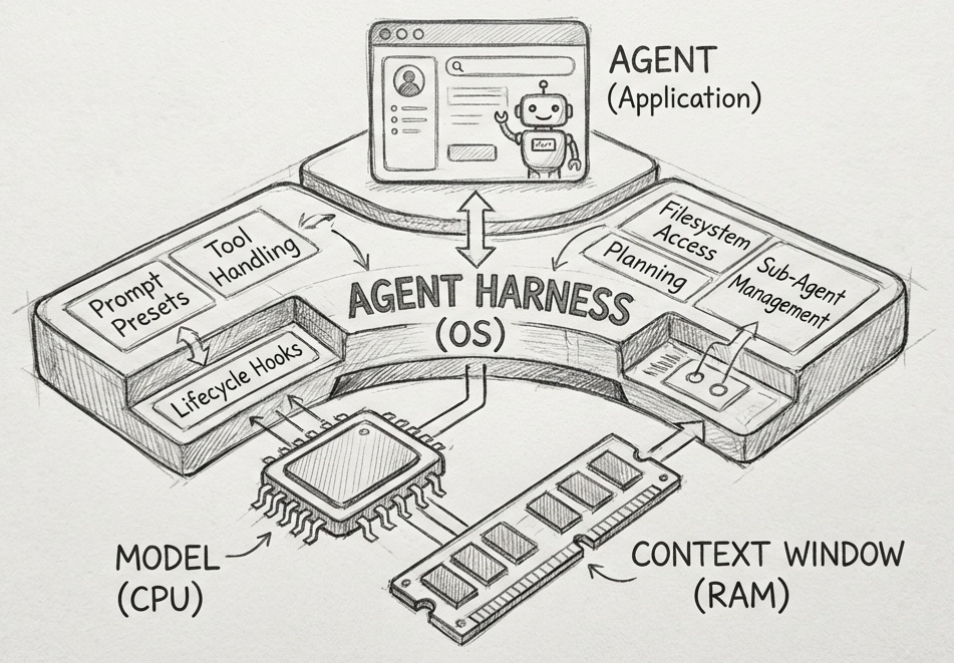

补充类比(来源:The importance of Agent Harness in 2026)

在 Agent Harness 的讨论里,有一个常被引用的类比:

模型像 CPU,上下文窗口像 RAM,而 Harness 更像“操作系统”。

这个类比主要用于理解模型运行机制;在工程实践中,Harness 也承担上下文管理工作,例如检索、裁剪、压缩和记忆读写。

- 🧠 模型(CPU):提供推理与生成能力。

- 📚 上下文窗口(RAM):提供有限、短期的工作记忆。

- 🧰 Harness(OS):负责启动流程、工具调用策略、生命周期管理、状态迁移与安全边界。

- 🧩 具体智能体应用(App):在 Harness 提供的运行环境上实现业务逻辑。

为避免歧义,可以把两层含义区分为:

- 🔎 狭义类比层:上下文窗口被单独类比为“RAM”。

- 🛠 工程职责层:Harness 负责管理和优化“如何使用这块 RAM”。

这个类比有两个好处:

第一,能区分“模型能力提升”和“系统能力提升”并不是同一件事;

第二,能解释为什么同一模型在不同工程环境下,最终可用性会出现明显差异。

概念边界:Harness Engineering 不是什么

为避免概念混淆,下面三点可以先划清:

- 🚫 不是模型训练:预训练、微调、蒸馏属于模型研发范畴。

- 🚫 不是业务功能本身:客服问答、报表生成、流程审批属于应用层功能。

- 🚫 不是单一框架名词:无论使用哪种 Agent SDK、编排框架或平台,都需要 Harness 工程能力。

Harness Engineering 站在中间层:向上连接模型决策,向下连接真实系统执行。

为什么它是生产分水岭

在真实业务里,AI 智能体失败往往不是“不会回答”,而是“不会稳定做事”。常见症状包括:

- ⚠️ 同一任务成功率波动大,回归后结果退化。

- 🧩 工具调用失败后缺少标准错误语义,模型难以恢复。

- 🔍 故障发生后日志碎片化,无法快速定位根因。

- 💸 上下文膨胀与无效重试导致成本持续上升。

- 🚫 高风险操作缺少权限分级与审批路径。

Harness Engineering 的目标,就是把这些隐患变成明确的工程控制点。

从工程视角看,它解决了哪三类不确定性

- 🎲 行为不确定性

模型输出可能波动。Harness 通过结构化工具接口、错误语义和重试策略,降低行为随机性。 - 🔍 状态不确定性

会话上下文、工具结果、外部依赖状态会持续变化。Harness 通过状态管理和观测链路保证可追踪、可回放。 - 🛡 风险不确定性

真正危险的是“模型能做什么动作”。Harness 通过权限边界、审批流与审计机制,把高风险动作纳入治理。

Harness Engineering 的常见误解

- ❗ 误解一:模型够强就行

模型能力决定上限,Harness 决定系统下限。没有 Harness,再强模型也难稳定落地。 - ❗ 误解二:Harness 只是“工具调用封装”

只做调用不做治理,系统仍然脆弱。Harness 的关键是执行、观测、权限和审计的整体设计。 - ❗ 误解三:这是后期优化项

实践中,越晚补 Harness,改造成本越高,历史问题越难清理。

Harness Engineering、提示工程、上下文工程有什么区别

这三个概念经常被混用,但关注层次并不相同:

| 维度 | Harness Engineering | 提示工程 | 上下文工程 |

|---|---|---|---|

| 🎯 主要目标 | 让 AI 智能体动作可执行、可控、可审计 | 让模型更准确理解任务并输出符合预期 | 让模型在有限窗口内拿到最有价值的信息 |

| 🧱 所在层次 | 执行与治理层 | 交互与指令层 | 信息供给层 |

| 🔍 关注问题 | 模型输出后如何调用工具、如何控风险、如何追踪 | 指令怎么写更清晰,约束如何表达更有效 | 检索什么内容、按什么顺序拼接、如何做裁剪 |

| 🛠 典型对象 | 工具协议、执行循环、权限策略、审计日志 | system prompt、任务模板、输出格式约束 | RAG 检索、记忆读写、上下文预算与压缩 |

| 📏 关键指标 | 任务成功率、失败可回放率、高风险动作拦截率 | 指令遵循率、输出格式正确率、首轮命中率 | 检索命中率、上下文利用率、信息冗余率 |

| ⚠️ 常见风险 | 只做工具封装,不做权限和观测治理 | 过度堆提示词,掩盖系统层问题 | 信息太多或排序不当,导致“看了也答不好” |

| 🧩 与其他两者关系 | 承接“想法”到“动作”的最后一公里 | 决定模型“怎么想、怎么说” | 决定模型“看到了什么再去想” |

三者是互补关系,不是替代关系。

只做提示工程,系统容易“会说不会做”;只做上下文工程,系统容易“信息很全但动作不稳”;只有三者协同,AI 智能体才更接近生产级能力。

用一句更直白的话总结:

上下文工程回答“给模型看什么”,Harness Engineering 回答“系统如何防错、纠错、持续变好”。

一个可记忆的定义公式

可以把这个概念压缩成一句工程化表达:

Harness Engineering = 执行接口标准化 + 运行过程可观测 + 动作权限可治理

这个公式的重点不在术语,而在顺序:

先有可执行,再有可观测,最后有可治理。

三者缺一,AI 智能体都很难在真实环境长期稳定运行。

来自 OpenAI 的一线实践启示

OpenAI 在 2026 年发布的工程文章《Harness engineering: leveraging Codex in an agent-first world》提供了一个很有代表性的实践样本。文章核心不是讨论提示词技巧,而是展示在高吞吐 AI 智能体研发中,Harness Engineering 如何成为主导变量。

- 🧭 工程师职责发生迁移

人的主要工作从“手写代码”转向“设计环境、定义目标、搭建反馈回路”。这与 Harness Engineering 的核心定位完全一致。

在这个模式下,工程产出不再只看功能代码本身,还要看工具链是否完备、约束是否清晰、反馈循环是否足够快。 - 👀 可读性对象从“给人看”扩展到“给智能体看”

UI、日志、指标、trace 都需要被 AI 智能体直接访问和理解。可观测性不再只是运维手段,而是智能体执行能力的一部分。

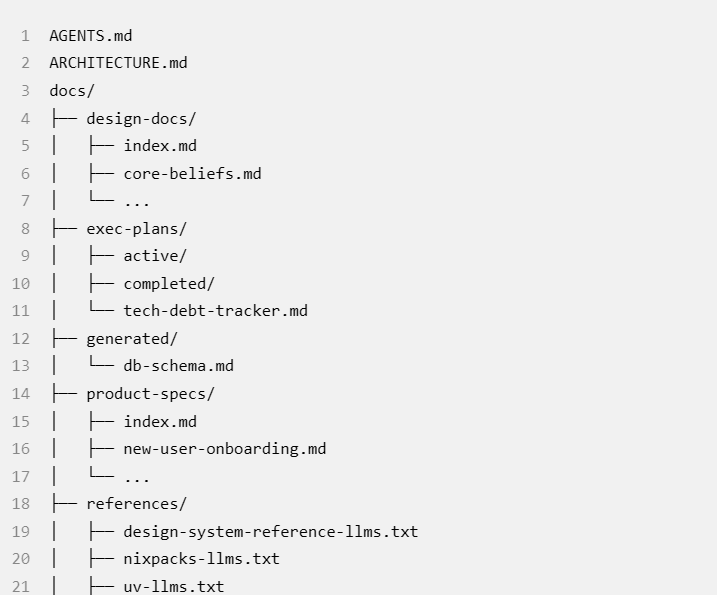

这意味着诊断信息要结构化、可查询,避免只存在于零散截图或口头描述中。 - 📚 仓库内知识成为系统事实源

OpenAI 在实践中强调,不再把AGENTS.md当成“百科全书”,而是把它当成“目录入口”。AGENTS.md保持短小稳定,只负责给出规则索引和导航路径;具体细节落在结构化的docs/中,并与代码一起版本化维护。

这背后的关键是“仓库即事实源(system of record)”:只要是希望 AI 智能体长期稳定遵循的知识(架构约束、产品规则、执行计划、质量标准),都应沉淀到仓库内、可检索、可校验、可追溯,而不是散落在聊天记录和口头共识里。

对 Harness Engineering 而言,这个做法直接提升了两件事:一是上下文供给的准确性,二是智能体执行行为的一致性。

- 🧱 把架构约束落到自动化硬约束

借助自定义 lint 和结构测试,约束依赖方向、日志规范、命名和边界规则,让智能体在可控框架内高速迭代。

重点不是“限制创造力”,而是把关键规则前置到机器可检查层,降低后期大规模返工风险。 - ♻️ 持续“垃圾回收”而非一次性治理

智能体会复制已有模式,坏模式会扩散。实践上需要把“黄金规则”编码并周期性清理,这本质是 Harness 层的长期维护机制。

与其季度集中重构,不如日常小步修正,把质量维护变成持续流程。

这组经验说明:

当团队进入 AI 智能体主导开发阶段,真正决定长期效率与质量的,往往不是单次生成效果,而是 Harness Engineering 的完整度。

从实践共识看,很多团队早期会把主要精力放在提示词和 RAG 优化上,这通常能明显改善首轮效果;但要把系统从“能跑”推进到“可持续可靠”,仍需要补齐约束、门禁、反馈回路和周期性清理机制。

换句话说,单轮质量更多取决于上下文设计,多轮稳定性更多取决于 Harness 设计。

小结

Harness Engineering 不是“附属工程”,而是 AI 智能体系统的主体工程之一。

当团队把它当成独立能力来建设时,AI 项目才会从“能演示”走向“能生产、能演进、能审计”。

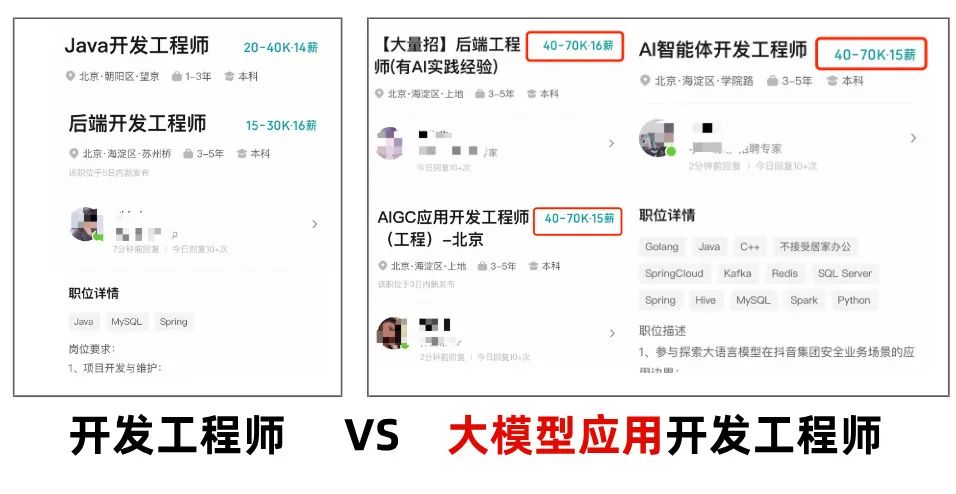

2026年AI行业最大的机会,毫无疑问就在应用层!

字节跳动已有7个团队全速布局Agent

大模型岗位暴增69%,年薪破百万!

腾讯、京东、百度开放招聘技术岗,80%与AI相关……

如今,超过60%的企业都在推进AI产品落地,而真正能交付项目的 大模型应用开发工程师 **,**却极度稀缺!

落地AI应用绝对不是写几个prompt,调几个API就能搞定的,企业真正需要的,是能搞定这三项核心能力的人:

✅RAG:融入外部信息,修正模型输出,给模型装靠谱大脑

✅Agent智能体:让AI自主干活,通过工具调用(Tools)环境交互,多步推理完成复杂任务。比如做智能客服等等……

✅微调:针对特定任务优化,让模型适配业务

目前,脉脉上有超过1000家企业发布大模型相关岗位,人工智能岗平均月薪7.8w!实习生日薪高达4000!远超其他行业收入水平!

技术的稀缺性,才是你「值钱」的关键!

具备AI能力的程序员,比传统开发高出不止一截!有的人早就转行AI方向,拿到百万年薪!👇🏻👇🏻

AI浪潮,正在重构程序员的核心竞争力!现在入场,仍是最佳时机!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

⭐️从大模型微调到AI Agent智能体搭建

剖析AI技术的应用场景,用实战经验落地AI技术。从GPT到最火的开源模型,让你从容面对AI技术革新!

大模型微调

-

掌握主流大模型(如DeepSeek、Qwen等)的微调技术,针对特定场景优化模型性能。

-

学习如何利用领域数据(如制造、医药、金融等)进行模型定制,提升任务准确性和效率。

RAG应用开发

- 深入理解检索增强生成(Retrieval-Augmented Generation, RAG)技术,构建高效的知识检索与生成系统。

- 应用于垂类场景(如法律文档分析、医疗诊断辅助、金融报告生成等),实现精准信息提取与内容生成。

AI Agent智能体搭建

- 学习如何设计和开发AI Agent,实现多任务协同、自主决策和复杂问题解决。

- 构建垂类场景下的智能助手(如制造业中的设备故障诊断Agent、金融领域的投资分析Agent等)。

如果你也有以下诉求:

快速链接产品/业务团队,参与前沿项目

构建技术壁垒,从竞争者中脱颖而出

避开35岁裁员危险期,顺利拿下高薪岗

迭代技术水平,延长未来20年的新职业发展!

……

那这节课你一定要来听!

因为,留给普通程序员的时间真的不多了!

立即扫码,即可免费预约

「AI技术原理 + 实战应用 + 职业发展」

「大模型应用开发实战公开课」

👇👇

👍🏻还有靠谱的内推机会+直聘权益!!

完课后赠送:大模型应用案例集、AI商业落地白皮书

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献135条内容

已为社区贡献135条内容

所有评论(0)