GPT-3参数量太大了?MIT清华团队新方法AWQ,让70B模型在移动端运行,推理速度提升3倍!

大语言模型的能力越强,参数量就越大 ——GPT-3 1750 亿参数占 350GB FP16 内存,笔记本、嵌入式设备这类边缘硬件装不下。量化作为大模型轻量化的核心手段,却一直面临精度丢得多、泛化能力差、硬件不友好的问题。

MIT、上交、清华团队提出的激活感知权重量化(AWQ),恰好解决了这些痛点:这是一种硬件友好的大模型低位仅权重量化方法,无需复杂训练,就能大幅降低量化误差,还能实现推理速度 3 倍以上提升,甚至让 70B 的 Llama-2 模型在移动端 GPU 上顺利运行。如今 AWQ 已经被 vLLM、FastChat、HuggingFace TGI 等主流开源框架采纳,成为大模型落地的必备技术之一。

论文名称: AWQ:Activation-aware Weight Quantization for LLMCompression and Acceleration

论文链接:https://arxiv.org/pdf/2306.00978

**核心思想:****大模型权重的重要性并非均等,仅 0.1%-1% 的显著权重起关键作用,通过激活值分布识别这些权重,**再用逐通道缩放的方式保护其量化精度,无需混合精度即可大幅降低量化损失,同时保留模型泛化能力。

一、 为什么要提出 AWQ?

在 AWQ 出现前,大模型低位量化始终难以落地,核心是传统方法无法兼顾精度和实用性,具体有 3 个痛点,用通俗的话讲就是:

1. 量化感知训练(QAT):“改完重练,成本太高”

QAT 需要对量化后的大模型重新训练,来弥补精度损失。但大模型动则数百亿参数,重新训练不仅要消耗大量 GPU 资源,还需要数天甚至数周时间,对于绝大多数开发者和企业来说,根本不切实际。

2. 传统训练后量化(PTQ):“精度丢得多,还容易‘学偏’”

主流的 GPTQ 虽能提升量化精度,但需要通过重构做误差补偿,很容易对校准集 “过拟合”—— 比如用新闻文本做校准集量化的模型,换到医疗、金融领域就性能暴跌;而简单的舍入量化(RTN),在 INT3/INT4 低位下精度损失更严重,比如 OPT-6.7B 用 RTN 量化到 INT3,困惑度会从 10.86 飙升到 23.54,模型基本没法用。

3. 混合精度方案:“性能保住了,硬件跑不动”

有研究发现,把 1% 的关键权重保留为 FP16 精度,能大幅提升量化性能,但这种 “一部分低位、一部分高位” 的混合精度,会让硬件推理的逻辑变得复杂,增加内存访问和计算开销,笔记本、移动端这类边缘硬件根本适配不了,失去了量化轻量化的意义。

除此之外,传统量化方法还特别 “挑数据”—— 需要大量校准集才能达到较好效果,换个领域的校准集,性能就大幅波动,实用性大打折扣。正是这些痛点,让研究团队推出了兼顾精度、泛化、硬件友好的 AWQ。

二、AWQ 是怎么做的?

AWQ 的实现逻辑非常简洁,全程围绕 “找关键权重 - 护关键权重 - 优量化效果 - 落地硬件” 展开,每一步都有明确的目标,还特别好理解,配合例子一看就懂:

1. 识别显著权重:不靠权重本身,靠 “激活值” 找核心

放弃传统 “看权重数值大小定重要性” 的方法,转而观察模型在校准集上的激活值分布—— 激活值幅值越大的权重通道,处理的是模型更核心的特征,就是需要保护的显著权重。

举个例子:把模型比作一家工厂,权重是各个生产车间,激活值是车间的生产任务量。任务量越大的车间(激活值幅值大),对工厂整体产出(模型性能)越重要,就是需要重点保护的 “核心车间”,只需找出 0.1%-1% 的这类车间即可。

2. 分析量化误差:用 “缩放” 代替混合精度,保护核心权重

研究团队通过数学分析发现:对显著权重通道乘以一个合适的缩放因子,再对输入做逆缩放,能大幅降低显著权重的相对量化误差,且缩放因子不太大时,其他权重的误差不会明显增加。(**简单来说就如:**所有的权重都用INI4了,但是对于显著权重,就先给它缩放,让它精度丢的比普通权重的少)

这就像给核心车间的生产设备做 “精度保护”,不是单独给核心设备配更高精度的零件(混合精度),而是调整设备的运行参数(缩放),让设备在常规生产条件下,也能保持高精度,既不增加设备复杂度,又能保证核心产出。

3. 搜索最优缩放:平衡核心与非核心,让量化效果最优

为了避免缩放因子太大导致非显著权重误差升高,AWQ 会以 “量化后模型输出与原始输出差异最小” 为目标,在 [0,1] 区间内通过网格搜索找最优超参数,**确定每个通道的缩放比例;**同时还会对权重做裁剪,进一步降低量化误差。

4. 硬件落地:打造专用推理框架,把量化收益变速度提升

光有量化方法还不够,还要让硬件能高效运行。研究团队基于 AWQ 打造了适配边缘端的推理框架,通过核融合技术减少推理时的中间内存访问、核启动等开销,还让 AWQ 的核函数能自适应在显卡的张量核和 CUDA 核上运行,兼容大模型推理的所有阶段。更重要的是,这个框架基于原生 PyTorch API 实现,能在桌面 GPU、笔记本 GPU、移动端 GPU 上复用,不用为不同硬件单独开发,比如 RTX 4070 笔记本、NVIDIA Jetson Orin 移动端显卡,都能直接运行。

三、举例分析

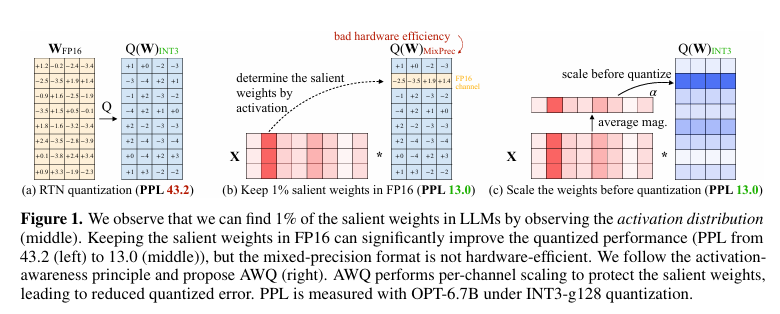

这张图直观展示了AWQ(激活感知权重量化)的核心创新思路,对比了三种量化方案的效果和效率:

-

直接舍入量化(RTN)

-

做法:直接将所有权重从 FP16 精度量化为 INT3 精度。

-

问题:所有权重 “一视同仁”,导致关键信息丢失,模型性能大幅下降,困惑度高达 43.2,模型基本不可用。

-

保留 1% 显著权重为 FP16(混合精度)

-

做法:通过观察激活值分布,找出对性能至关重要的 1%“显著权重”,将其保留为 FP16 精度,其余量化为 INT3。

-

效果:性能显著提升,困惑度降至 13.0,与 AWQ 效果相当。

-

问题:混合精度格式(同时存在 FP16 和 INT3)对硬件极不友好,推理效率低下,难以落地。

-

AWQ(激活感知缩放量化)

做法:同样通过激活值找到显著权重,但不采用混合精度。而是对所有权重进行逐通道缩放(显著通道缩放幅度更大),再统一量化为 INT3。

- 效果:在纯 INT3 量化的前提下,性能与混合精度方案相当(PPL 同样降至 13.0),同时保持了硬件友好性,推理效率更高。

四、实验结果

实验结果全面验证了 AWQ 的优越性,核心结论如下:

- 量化精度领先:在主流大模型上,低位量化性能显著优于 RTN 与 GPTQ 等现有基线方法。

- 泛化能力突出:在指令微调模型上表现优异,并首次成功将低位量化应用于多模态大语言模型。

- 数据效率极高:对校准集的数量需求极低,且在跨领域场景下保持了极强的鲁棒性。

- 推理速度倍增:配套的推理框架在各类硬件上均实现了数倍的推理加速,大幅提升了生成效率。

- 部署范围突破:成功实现了超大模型在边缘端移动 GPU 上的部署,显著降低了大模型的应用门槛。

五、总结

AWQ 用 “激活感知缩放” 这一简洁思路,完美平衡了大模型量化的精度与硬件效率,解决了传统方法易过拟合、部署难的痛点。它不仅让纯低位量化的性能媲美混合精度,更通过通用的推理框架,真正实现了大模型从云端到边缘端的低成本部署。

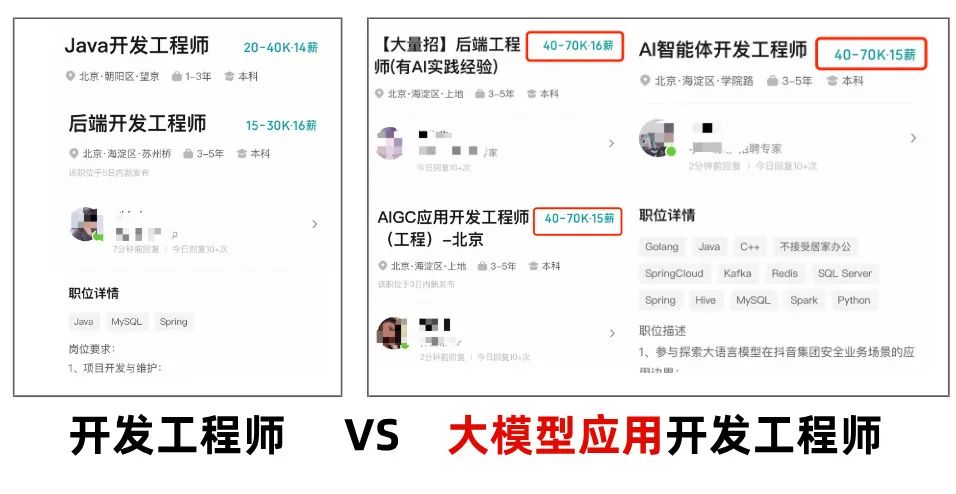

2026年AI行业最大的机会,毫无疑问就在应用层!

字节跳动已有7个团队全速布局Agent

大模型岗位暴增69%,年薪破百万!

腾讯、京东、百度开放招聘技术岗,80%与AI相关……

如今,超过60%的企业都在推进AI产品落地,而真正能交付项目的 大模型应用开发工程师 **,**却极度稀缺!

落地AI应用绝对不是写几个prompt,调几个API就能搞定的,企业真正需要的,是能搞定这三项核心能力的人:

✅RAG:融入外部信息,修正模型输出,给模型装靠谱大脑

✅Agent智能体:让AI自主干活,通过工具调用(Tools)环境交互,多步推理完成复杂任务。比如做智能客服等等……

✅微调:针对特定任务优化,让模型适配业务

目前,脉脉上有超过1000家企业发布大模型相关岗位,人工智能岗平均月薪7.8w!实习生日薪高达4000!远超其他行业收入水平!

技术的稀缺性,才是你「值钱」的关键!

具备AI能力的程序员,比传统开发高出不止一截!有的人早就转行AI方向,拿到百万年薪!👇🏻👇🏻

AI浪潮,正在重构程序员的核心竞争力!现在入场,仍是最佳时机!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

⭐️从大模型微调到AI Agent智能体搭建

剖析AI技术的应用场景,用实战经验落地AI技术。从GPT到最火的开源模型,让你从容面对AI技术革新!

大模型微调

-

掌握主流大模型(如DeepSeek、Qwen等)的微调技术,针对特定场景优化模型性能。

-

学习如何利用领域数据(如制造、医药、金融等)进行模型定制,提升任务准确性和效率。

RAG应用开发

- 深入理解检索增强生成(Retrieval-Augmented Generation, RAG)技术,构建高效的知识检索与生成系统。

- 应用于垂类场景(如法律文档分析、医疗诊断辅助、金融报告生成等),实现精准信息提取与内容生成。

AI Agent智能体搭建

- 学习如何设计和开发AI Agent,实现多任务协同、自主决策和复杂问题解决。

- 构建垂类场景下的智能助手(如制造业中的设备故障诊断Agent、金融领域的投资分析Agent等)。

如果你也有以下诉求:

快速链接产品/业务团队,参与前沿项目

构建技术壁垒,从竞争者中脱颖而出

避开35岁裁员危险期,顺利拿下高薪岗

迭代技术水平,延长未来20年的新职业发展!

……

那这节课你一定要来听!

因为,留给普通程序员的时间真的不多了!

立即扫码,即可免费预约

「AI技术原理 + 实战应用 + 职业发展」

「大模型应用开发实战公开课」

👇👇

👍🏻还有靠谱的内推机会+直聘权益!!

完课后赠送:大模型应用案例集、AI商业落地白皮书

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献41条内容

已为社区贡献41条内容

所有评论(0)