DOF-GS:支持后处理调焦的可调景深 3D Gaussian Splatting 技术解读

DOF-GS:支持后处理调焦的可调景深 3D Gaussian Splatting 技术解读

本文基于论文 DOF-GS: Adjustable Depth-of-Field 3D Gaussian Splatting for Post-Capture Refocusing, Defocus Rendering and Blur Removal 进行学习整理,结合论文方法与个人理解,对其研究背景、核心创新、方法公式和实验结果进行系统总结,适合用于论文笔记、课程汇报或 CSDN 技术博客发布。

目录

一、论文核心信息

- 论文题目:DOF-GS: Adjustable Depth-of-Field 3D Gaussian Splatting for Post-Capture Refocusing, Defocus Rendering and Blur Removal

- 作者:Yujie Wang、Praneeth Chakravarthula、Baoquan Chen

- 所属单位:

- 北京大学通用人工智能全国重点实验室

- 北京大学智能科学与技术学院

- 北卡罗来纳大学教堂山分校

二、论文摘要

3D Gaussian Splatting(3DGS)能够实现高质量的 3D 场景重建和实时新视角合成,但由于其通常基于针孔相机模型,难以有效描述真实摄影中的散焦模糊和景深变化。为了解决这一问题,论文提出 DOF-GS,将有限孔径相机模型引入 3DGS,并构建了显式、可微的景深渲染框架。

该方法能够从带有适度散焦模糊的多视角图像中学习相机的景深特性,恢复场景清晰细节,并在训练完成后支持调节焦距与光圈,实现捕获后的重对焦、散焦渲染和模糊去除。同时,论文还设计了 CoC 引导的细节增强模块,用于定位输入图像中的对焦区域,进一步提升全对焦渲染质量。

实验结果表明,DOF-GS 能够从未校准的散焦模糊多视角图像中实现高质量的 3D 重建,并支持灵活的景深后处理控制。

三、论文创新点

DOF-GS 在传统 3DGS 框架上主要实现了以下三点创新:

1. CoC 引导的景深渲染

将可微的散焦渲染流程融入 3DGS 光栅化器,使模型能够高效建模景深和散焦效果。

2. 可学习的相机参数

为每个输入视图引入可学习的焦距和光圈参数,使系统能够自动拟合不同视图的散焦状态,并支持后续灵活调焦。

3. CoC 引导的细节增强

设计轻量级网络预测对焦掩码,辅助模型在训练中更关注清晰区域,从而提升全对焦渲染图像的细节表现。

四、研究动机

1. 传统摄影存在先验设定限制

数字摄影通常需要在拍摄时预先设定焦距、光圈等参数,一旦拍摄完成,后期可调空间有限。虽然光场摄影、多孔径摄影等技术能够提供更强的后处理能力,但往往依赖专用硬件,不利于普及。

2. 现有 3D 重建技术缺乏景深建模能力

NeRF 和 3DGS 虽然在新视角合成中表现优秀,但通常采用针孔相机假设,因此很难模拟真实的散焦和景深变化,也无法支持拍摄后的焦点调整。

3. 现有改进方法仍存在不足

一些 NeRF 或 3DGS 的变体虽然尝试建模模糊,但大多属于黑箱式学习,缺乏显式的有限孔径相机模型,因此无法实现具有物理意义的焦距和光圈控制,同时很多方法计算代价较高、渲染效率较低。

基于以上问题,论文提出 DOF-GS,希望在保持 3DGS 实时渲染优势的同时,实现对景深效果的物理建模与可控调节。

五、核心方法

DOF-GS 的整体框架可以概括为三部分:

- 基于 3DGS 的显式场景表示

- 基于薄透镜模型的可微景深渲染

- 基于 CoC 的细节增强模块

一句话概括就是:

在 3DGS 中显式引入有限孔径相机模型,使 3D 场景不仅能被重建,还能在重建后自由调焦。

5.1 基础:3D Gaussian Splatting

3DGS 使用一组三维高斯点表示场景。单个高斯点可写为:

G_k(p) = exp(-1/2 * (p - u_k)^T Σ_k^(-1) (p - u_k))

其中:

p表示世界空间中的三维点u_k表示第 k 个高斯点的中心位置Σ_k表示该高斯点的协方差矩阵

公式解读

这个公式用于描述一个高斯点在三维空间中的分布情况。

直观来看:

- 离高斯中心越近,响应越大;

- 离中心越远,响应越小。

因此,每个高斯点都可以看成一个在空间中具有体积和形状的软分布单元,而不是一个没有大小的离散点。

高斯点投影到二维图像平面后,其协方差矩阵更新为:

Σ'_k = J W Σ_k W^T J^T

其中:

J为投影变换的雅可比矩阵W为从世界坐标到相机坐标的视图矩阵

公式解读

这一步描述了三维高斯如何投影到图像平面。

原本在三维空间里的一个椭球体,经过相机投影后,会变成图像上的二维椭圆区域,这个公式就是在计算投影后的形状参数。

二维屏幕空间中的高斯点写为:

G'_k(x) = exp(-1/2 * (x - u'_k)^T (Σ'_k)^(-1) (x - u'_k))

其中:

u'_k为投影后的二维中心位置x为图像像素位置

公式解读

该公式表示某个二维高斯点对像素 x 的影响程度。

本质上,3DGS 的渲染就是在图像上叠加大量二维高斯斑块,从而形成最终的颜色。

最终,像素颜色通过 alpha 混合方式计算:

I_tilde(x) = Σ(i=1~N_x) T_i α_i c_i

α_i = G'_i(x)

其中:

T_i = Π(j=1~i-1)(1 - α_j)表示透射率c_i表示颜色N_x表示与像素x相关联的高斯点数量

公式解读

这个公式描述了 3DGS 的核心渲染机制:

按深度顺序,将多个高斯点对同一像素的颜色贡献逐层叠加。前面的高斯先覆盖,后面的高斯只能通过剩余透明部分继续贡献颜色。

3DGS 的原始优化目标可写为:

min_S Σ(m=1~M) L_rec(I_tilde_m, I_m)

其中:

S表示场景参数M表示训练视图数量L_rec表示重建损失

公式解读

这表示通过最小化渲染图像与真实图像之间的误差来优化整个场景表示。

DOF-GS 正是在此基础上进一步加入景深建模与相机参数学习。

5.2 景深渲染的相机模型:薄透镜模型

论文采用简化的薄透镜模型来刻画景深效应。对于不在焦平面上的物点,其成像会形成弥散圆(Circle of Confusion,CoC),其半径可写为:

R_coc = 1/2 * F * A * |z_o - f| / (z_o * (f - F))

其中:

F为镜头焦距A为光圈直径f为对焦距离z_o为物点深度

公式解读

这个公式说明:

某个点如果不在对焦平面上,它在图像中就不会成像为清晰点,而会扩散成一个小圆斑,圆斑半径就是 CoC。

- 离焦越严重,CoC 越大;

- 光圈越大,模糊越明显;

- 对焦位置变化也会影响模糊程度。

由于镜头焦距通常远小于物距和对焦距离,公式可以进一步近似为:

R_coc = 1/2 * Q * |1 / z_o - 1 / f|

其中:

Q = F * A

公式解读

这里将焦距和光圈合并为一个更紧凑的参数 Q,既降低了优化难度,也保留了足够的物理意义。

这一步是 DOF-GS 能够高效训练的重要原因之一。

5.3 可微的景深渲染

为了将景深建模纳入训练流程,DOF-GS 设计了可微的散焦渲染过程。其核心思路是:

根据每个高斯点的 CoC 大小,为其附加一个与模糊程度对应的高斯核,并与原始二维高斯做卷积。

模糊核写为:

G_k_coc = 1/2 * exp(x^T Σ_k_coc x)

Σ_k_coc = aI

其中:

a为标量I为单位矩阵

公式解读

这里构造的是一个各向同性模糊核,也就是向四周均匀扩散的模糊分布。

它的作用是模拟真实相机中离焦产生的圆形散斑效果。

卷积后得到新的二维高斯表示:

G''_k = G'_k ⊛ G_k_coc

公式解读

这一步表示:

原本清晰的二维高斯先经过景深模糊核处理,再参与最终渲染。于是,模型生成的图像就能自然表现出不同程度的离焦模糊。

此时,优化目标也从只优化场景参数,变为同时优化场景和相机参数:

min_{S, {f_m, Q_m}} Σ(m=1~M) L_rec(I_tilde_tilde_m, I_m)

其中:

f_m表示第 m 个视图的焦距或对焦参数Q_m表示第 m 个视图的光圈相关参数I_tilde_tilde_m表示加入景深渲染后的结果

公式解读

这一步是 DOF-GS 与普通 3DGS 的本质区别之一。

传统 3DGS 只学习场景,而 DOF-GS 同时学习:

- 场景本身长什么样;

- 每张图像是以什么景深状态拍摄出来的。

因此,模型训练完成后就具备了“理解相机景深行为”的能力。

5.4 深度图与 CoC 图渲染

论文进一步渲染深度图和 CoC 图,用于后续细节增强模块。

深度图写为:

D_tilde(x) = Σ(i=1~N'_x) T'_i α'_i z_i

CoC 图写为:

M_coc(x) = Σ(i=1~N'_x) T'_i α'_i R_i_coc

其中:

z_i表示第 i 个高斯点的深度R_i_coc表示第 i 个高斯点的 CoC 半径

公式解读

这两个图分别反映:

- 场景中各位置的深度分布;

- 图像中各位置的模糊程度分布。

其中 CoC 图尤其重要,因为它和图像中哪些区域清晰、哪些区域模糊直接相关。

5.5 CoC 引导的细节增强

针对训练图像中大面积失焦导致细节缺失的问题,论文设计了一个轻量级对焦定位网络 ILN,用于预测对焦掩码。

其形式可写为:

M*_m = ILN(I_tilde_tilde_m, D_tilde_m, M_coc_m, PE(m), PE(x))

其中:

M*_m表示第 m 个视图的对焦掩码PE表示位置编码

公式解读

该网络的作用是判断:

- 哪些区域更可能是对焦清晰区域;

- 哪些区域更可能是离焦模糊区域。

因为论文没有真实对焦区域标签,所以采用弱监督方式,通过 CoC 图间接引导掩码学习。

对应的掩码相关损失写为:

L_mk = 1 - Cov(1 - M*_m, M_coc_m) / sqrt(Var(1 - M*_m) Var(M_coc_m))

公式解读

这个损失本质上使用相关性约束来引导掩码学习。

如果某个区域在 CoC 图中模糊程度较高,那么对应掩码就不应被预测为清晰区域;反之亦然。

随后,论文构造中间图像:

I_c_m = M*_m I*_m + (1 - M*_m) I_tilde_tilde_m

其中:

I*_m表示全对焦图像I_tilde_tilde_m表示散焦图像

公式解读

这一步表示把:

- 清晰区域从全对焦渲染图中取出;

- 模糊区域从散焦图中保留;

从而得到一张更适合监督细节恢复的中间图像。

细节损失写为:

L_detail = ||I_c_m - I_m|| + λ_dssim L_dssim(I_c_m, I_m)

掩码正则项写为:

L_reg = -M*_m log(M*_m)

公式解读

L_detail用于提升最终重建的清晰细节;L_reg用于约束掩码更稳定、更接近清晰的二值分布。

最终整体优化目标为:

min_{S, Ω, {f_m, Q_m}} L_rec + L_detail + λ_mk L_mk + λ_reg L_reg

其中:

Ω表示 ILN 网络参数

公式解读

最终训练中,系统需要联合优化三类变量:

- 3D 场景表示参数

- 相机景深参数

- 对焦掩码网络参数

正是这种联合优化,使 DOF-GS 既能完成 3D 场景重建,又能学习真实图像中的景深特征。

六、实验分析

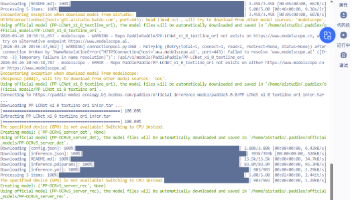

论文基于 3DGS 的 CUDA 光栅化器和 PyTorch 实现 DOF-GS,并在多视角散焦模糊的真实与合成数据集上进行了训练和评估。

6.1 相机模型有效性分析

实验表明,DOF-GS 学到的焦距参数与人工标注的焦距范围高度一致,这说明论文所采用的相机模型具有较强的物理合理性。

此外,CoC 图与图像中的真实模糊区域高度相关,而对焦掩码也能够较准确地定位清晰区域。这说明:

- CoC 图确实能反映离焦程度;

- ILN 网络能够有效提取对焦区域信息。

更重要的是,训练完成后用户还可以手动调整光圈和焦距,实现平滑连续的景深变化。这说明 DOF-GS 的景深控制不仅可学,而且可调。

6.2 全对焦新视角合成性能

论文将 DOF-GS 与 NeRF、Mip-Splatting、Deblur-NeRF、Deblur-GS 等方法进行比较。

结果表现

- 在真实数据集和合成数据集上,DOF-GS 都取得了具有竞争力甚至更优的 PSNR 和 SSIM;

- 在纹理细节、文字边缘、复杂局部结构等区域,DOF-GS 的恢复效果更清晰;

- 相比一些对比方法,DOF-GS 对高分辨率输入具有更好的适应性,显存占用也更低。

结果说明

这表明 DOF-GS 不只是“能模拟模糊”,更重要的是:

- 它能从带模糊的输入中恢复出更清晰的场景结构;

- 它兼顾了渲染质量、物理合理性和计算效率。

6.3 消融实验

论文进一步对多个关键模块进行了消融分析。

1. 去掉细节增强模块

性能明显下降,说明细节增强对恢复清晰图像非常关键。

2. 去掉掩码相关损失

PSNR 变化不大,但 SSIM 下降,说明这些约束对结构一致性和减少伪影很有帮助。

3. 完整模型效果最好

当场景参数、相机参数和掩码网络共同优化时,方法在定量指标和视觉质量上都达到最佳。

七、结论与展望

7.1 研究结论

DOF-GS 的核心贡献在于:

- 成功将有限孔径相机模型引入 3DGS,突破了传统针孔相机假设的限制;

- 实现了捕获后可调焦的 3D 重建与渲染,支持重对焦、散焦渲染和模糊去除;

- 通过 CoC 引导的细节增强模块,提高了全对焦新视角合成的清晰度与稳定性;

- 在保持较高渲染效率的同时,实现了更具物理意义的景深控制。

7.2 未来展望

论文也指出,DOF-GS 仍存在进一步改进空间,例如:

- 对于所有视图中都处于失焦状态的区域,仍然难以恢复理想细节;

- 未来可以将相机位姿优化进一步纳入训练过程,提升整体几何一致性;

- 可以探索其在高维成像、场景理解、AR/VR 等方向的应用潜力。

八、个人总结

我认为 DOF-GS 的价值不仅在于“给 3DGS 加上了模糊效果”,更重要的是它把真实摄影中的景深机制以较为自然的方式融入到了 3D 表示学习中。

从方法设计上看,它完成了三件很有意义的事情:

- 让 3DGS 学会了相机的景深行为;

- 让散焦不再只是干扰项,而是可利用的信息;

- 让后处理重对焦成为 3D 场景表示中的一个自然能力。

这使得 DOF-GS 不仅适合论文研究,也具备一定的实际应用潜力。

九、个人声明

个人声明:

本文为本人在学习论文 DOF-GS 过程中的阅读整理与总结,内容主要基于公开论文、个人理解以及方法分析完成,仅用于学术交流与技术学习,不作为任何商业用途。

文中若存在理解偏差、表述不准确或解释不够严谨之处,欢迎读者批评指正。

如涉及原论文作者的知识产权、图片版权或其他相关权益,请以原论文与官方资料为准。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)