最低成本微调大语言模型:单张消费级显卡精通你的专属领域!

从"调 API"到"训自己的模型"——用最低成本(单张消费级显卡)微调大语言模型,让它精通你的专属领域。

- 为什么要微调?什么时候该微调?

你已经会用 LLM 的 API 了——写好 prompt,拿到回答。但有些场景,无论你怎么调 prompt,效果就是不够好。这时候就该考虑微调(Fine-tuning)了。

1.1 三种让 LLM "变聪明"的方式

| 方式 | 原理 | 成本 | 适用场景 |

|---|---|---|---|

| Prompt Engineering | 用精心设计的提示词引导模型 | 💰 最低 | 通用任务、快速验证 |

| RAG(检索增强) | 检索外部文档,拼进 prompt | 💰💰 中等 | 私有知识库问答 |

| 微调(Fine-tuning) | 修改模型权重,让它"学会"新知识/风格 | 💰💰💰 较高 | 风格定制、格式控制、领域专精 |

决策流程:

你的需求是什么?

│

├── 模型能力够,只是表达不对 → Prompt Engineering

├── 需要基于私有数据回答 → RAG

├── 需要特定的输出格式/风格 → 微调 ✅

├── 需要领域专业知识(医疗/法律/金融) → 微调 ✅ 或 RAG

└── 需要降低推理成本(大模型→小模型蒸馏) → 微调 ✅

1.2 微调的适用场景:风格、格式、领域知识

✅ 适合微调的场景:

# 场景 1:统一输出格式

# 你需要 LLM 始终按特定 JSON Schema 返回,prompt 很难 100% 保证

{"diagnosis": "...", "confidence": 0.95, "evidence": ["...", "..."]}

# 场景 2:定制对话风格

# 你需要客服机器人用特定语气、遵守特定话术规范

"亲,非常感谢您的反馈!关于您提到的退货问题,小智马上帮您处理~"

# 场景 3:领域知识内化

# 让模型"记住"你的产品文档、代码规范、行业术语

# (比 RAG 更快,不需要每次检索)

# 场景 4:小模型替代大模型

# 用大模型生成训练数据 → 微调小模型 → 降低推理成本 90%

❌ 不适合微调的场景:

- 知识会频繁更新(用 RAG 更灵活)

- 只有几十条数据(数据太少效果差)

- 调 prompt 就能解决的问题(杀鸡用牛刀)

1.3 微调的成本与收益:值不值得?

| 项目 | 全参数微调 | LoRA | QLoRA |

|---|---|---|---|

| 7B 模型显存需求 | ~56 GB | ~16 GB | ~6 GB |

| 可用显卡 | A100 80GB | RTX 4090 | RTX 4060 |

| 训练时长(1000条数据) | ~2 小时 | ~30 分钟 | ~45 分钟 |

| 云端 GPU 费用 | ~¥50 | ~¥15 | ~¥8 |

| 效果 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

💡 结论:对于大部分场景,LoRA/QLoRA 的效果已经非常接近全参数微调,但成本降低了 80%+。本教程重点讲 LoRA 和 QLoRA。

1.4 全参数微调 vs 参数高效微调(PEFT)

全参数微调(Full Fine-tuning):

修改模型的所有参数(70 亿个)

✅ 效果最好

❌ 需要超大显存,训练慢

参数高效微调(PEFT = Parameter-Efficient Fine-Tuning):

只修改一小部分参数(几百万个,<1%)

✅ 显存需求低,训练快

✅ 可以保存多个"适配器",按需切换

❌ 效果略差于全参(但差距很小)

PEFT 家族的主要方法:

| 方法 | 原理 | 流行度 |

|---|---|---|

| LoRA | 在权重矩阵旁插入低秩适配器 | ⭐⭐⭐⭐⭐ 最主流 |

| QLoRA | LoRA + 4-bit 量化 = 更省显存 | ⭐⭐⭐⭐⭐ 消费级首选 |

| Prefix Tuning | 在输入前插入可学习的向量 | ⭐⭐ |

| Adapter | 在每层 Transformer 中插入小模块 | ⭐⭐ |

| IA³ | 学习缩放向量 | ⭐ |

💡 本教程聚焦 LoRA 和 QLoRA——它们是目前工业界最广泛使用的微调方法,效果好、生态成熟、工具链完善。

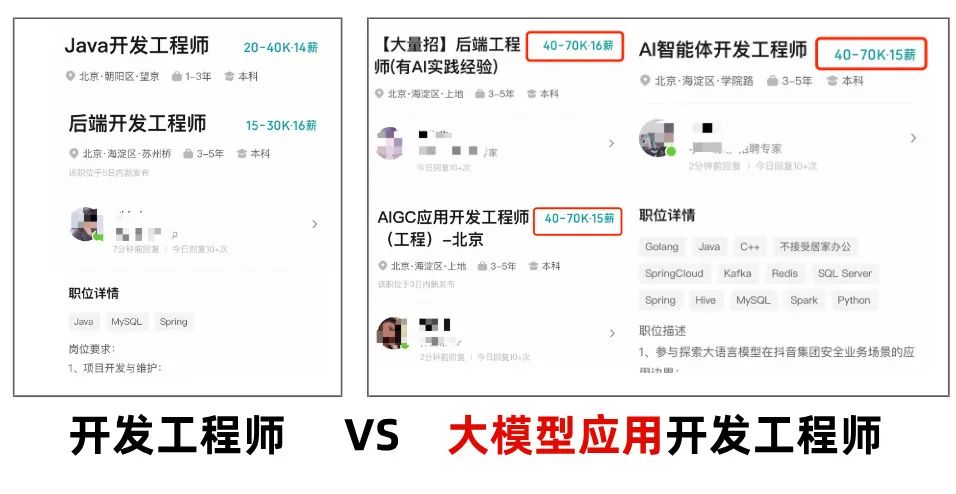

2026年AI行业最大的机会,毫无疑问就在应用层!

字节跳动已有7个团队全速布局Agent

大模型岗位暴增69%,年薪破百万!

腾讯、京东、百度开放招聘技术岗,80%与AI相关……

如今,超过60%的企业都在推进AI产品落地,而真正能交付项目的 大模型应用开发工程师 **,**却极度稀缺!

落地AI应用绝对不是写几个prompt,调几个API就能搞定的,企业真正需要的,是能搞定这三项核心能力的人:

✅RAG:融入外部信息,修正模型输出,给模型装靠谱大脑

✅Agent智能体:让AI自主干活,通过工具调用(Tools)环境交互,多步推理完成复杂任务。比如做智能客服等等……

✅微调:针对特定任务优化,让模型适配业务

目前,脉脉上有超过1000家企业发布大模型相关岗位,人工智能岗平均月薪7.8w!实习生日薪高达4000!远超其他行业收入水平!

技术的稀缺性,才是你「值钱」的关键!

具备AI能力的程序员,比传统开发高出不止一截!有的人早就转行AI方向,拿到百万年薪!👇🏻👇🏻

AI浪潮,正在重构程序员的核心竞争力!现在入场,仍是最佳时机!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

⭐️从大模型微调到AI Agent智能体搭建

剖析AI技术的应用场景,用实战经验落地AI技术。从GPT到最火的开源模型,让你从容面对AI技术革新!

大模型微调

-

掌握主流大模型(如DeepSeek、Qwen等)的微调技术,针对特定场景优化模型性能。

-

学习如何利用领域数据(如制造、医药、金融等)进行模型定制,提升任务准确性和效率。

RAG应用开发

- 深入理解检索增强生成(Retrieval-Augmented Generation, RAG)技术,构建高效的知识检索与生成系统。

- 应用于垂类场景(如法律文档分析、医疗诊断辅助、金融报告生成等),实现精准信息提取与内容生成。

AI Agent智能体搭建

- 学习如何设计和开发AI Agent,实现多任务协同、自主决策和复杂问题解决。

- 构建垂类场景下的智能助手(如制造业中的设备故障诊断Agent、金融领域的投资分析Agent等)。

如果你也有以下诉求:

快速链接产品/业务团队,参与前沿项目

构建技术壁垒,从竞争者中脱颖而出

避开35岁裁员危险期,顺利拿下高薪岗

迭代技术水平,延长未来20年的新职业发展!

……

那这节课你一定要来听!

因为,留给普通程序员的时间真的不多了!

立即扫码,即可免费预约

「AI技术原理 + 实战应用 + 职业发展」

「大模型应用开发实战公开课」

👇👇

👍🏻还有靠谱的内推机会+直聘权益!!

完课后赠送:大模型应用案例集、AI商业落地白皮书

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献46条内容

已为社区贡献46条内容

所有评论(0)