如何修正 AI 的‘幻觉误读’:当大模型错误引用你的品牌时,最快的公关 SEO 手段

各位同仁,下午好!

今天,我们齐聚一堂,共同探讨一个日益紧迫且极具挑战性的议题:当人工智能,尤其是大型语言模型(LLMs),出现“幻觉误读”,错误地引用或歪曲我们的品牌信息时,我们作为技术专家和品牌捍卫者,应如何迅速、有效地运用公关与搜索引擎优化(SEO)的策略和技术手段进行修正。这不仅仅是一场公关危机,更是一次技术与策略的综合较量,旨在捍卫品牌的数字声誉与核心价值。

随着生成式AI的飞速发展和广泛应用,LLMs正在成为信息获取和内容生成的新范式。它们以前所未有的速度消化海量数据,并以自然语言的形式呈现给用户。然而,这种能力并非没有代价。AI的“幻觉”(hallucination)现象,即模型生成看似合理但实际上虚假或不准确的信息,已经成为一个普遍存在的问题。当这种“幻觉”涉及我们的品牌,错误地引用了我们的产品、服务、历史或理念时,其潜在的破坏性不容小觑。

作为编程专家,我们不能仅仅停留在抱怨或担忧。我们需要以技术人的严谨和解决问题的思维,深入剖析其成因,并构建一套行之有效的、基于数据和工程的快速响应机制。这套机制将融合公关的策略敏锐性与SEO的技术执行力,确保我们的品牌在数字世界中始终以最真实、最权威的面貌示人。

第一部分:理解“幻觉误读”的本质与威胁

在深入探讨解决方案之前,我们必须首先清晰地认识到AI“幻觉误读”的本质及其对品牌构成的具体威胁。

1.1 什么是AI幻觉?

AI幻觉,简单来说,是指人工智能模型,特别是大型语言模型,在生成内容时,创造出与现实世界事实不符或无法验证的信息。这些信息可能在语言上流畅、逻辑上看似合理,但实际上是虚构的。

从技术角度看,幻觉的产生有几个主要原因:

- 训练数据偏差或不足: 模型在训练过程中可能接触到了不准确、过时或有偏见的数据。当模型缺乏关于某一特定实体(如您的品牌)的足够准确信息时,它可能会“发明”一些内容来填补空白。

- 模式识别的过度泛化: LLMs通过识别和学习语言中的统计模式来生成文本。有时,这种模式识别会导致模型在没有确切事实支持的情况下,将某些词语或概念错误地关联起来。

- 上下文理解的局限性: 尽管LLMs在理解上下文方面取得了巨大进步,但在处理复杂或模糊的查询时,它们仍可能误解意图或提取错误的关联信息。

- 事实核查机制的缺失: 当前的LLMs在生成内容时,往往缺乏一个内置的、实时的、与外部真实世界知识库进行严格比对的事实核查机制。它们更倾向于生成在统计学上“最可能”的序列,而非“最真实”的序列。

- 源头归因的模糊: LLMs在生成内容时,通常不会明确指出其信息来源,这使得追溯和验证变得困难。当它们错误引用时,用户往往难以判断信息真伪。

1.2 LLMs为何会误读你的品牌?

具体到品牌误读,幻觉现象的成因更为聚焦:

- 品牌信息在训练数据中的稀疏性或分散性: 您的品牌可能在全球互联网上拥有大量信息,但这些信息可能分散在不同的网站、论坛、新闻报道中,且质量参差不齐。如果模型训练时未能充分、准确地抓取和整合这些核心信息,就容易产生偏差。

- 过时信息的影响: 如果您的品牌信息在过去发生过重大变更(例如公司名称、产品线、核心业务),而LLM的训练数据未能及时更新,它可能会引用旧的、不准确的信息。

- 非官方来源的噪音: 互联网上充斥着大量非官方、用户生成的内容(UGC),如社交媒体帖子、论坛讨论、博客评论等。这些内容可能包含对品牌的误解、谣言或个人偏见。如果LLM在训练时给予这些噪音过高的权重,就可能将其误认为是事实。

- 相似品牌或通用概念的混淆: 当您的品牌名称与某个通用词汇相似,或者与另一个品牌有部分重叠时,LLM可能会在不经意间将它们混淆。

- 缺乏明确的“品牌知识图谱”: 尽管许多大型品牌在Google等搜索引擎中拥有完善的知识图谱,但LLMs在训练时并不总是直接等同于这些搜索引擎的实时知识库。它们有自己的数据收集和内部表示方式。

1.3 品牌幻觉误读的威胁

当AI错误引用或歪曲您的品牌时,其后果可能是灾难性的:

- 声誉受损: 错误信息会迅速传播,损害品牌在公众心中的信任度和专业形象。一旦信任受损,修复起来将极其困难。

- 消费者混淆与流失: 消费者可能因错误信息而对产品或服务产生误解,导致购买决策失误,甚至转向竞争对手。

- 法律与合规风险: 如果AI生成的错误信息涉及虚假广告、诽谤或侵犯知识产权,品牌可能面临法律诉讼和监管处罚。

- 商业机会丧失: 投资者、合作伙伴和潜在客户可能会因负面或不准确的信息而对合作产生疑虑,错失发展机遇。

- 内部混乱与士气打击: 内部员工可能会因外部的错误信息而感到困惑和沮丧,影响工作效率和团队凝聚力。

- 搜索引擎排名下降(间接): 如果AI幻觉导致大量负面或不准确的提及,可能间接影响用户对品牌的认知,进而影响搜索行为和传统SEO效果。

因此,对AI幻觉误读的修正,不仅仅是技术问题,更是关乎品牌生死存亡的关键战役。

第二部分:构建危机响应框架:公关与技术融合

面对AI的“幻觉误读”,我们需要一套快速、高效、多维度的响应框架。这套框架的核心在于将公关的策略性思考与编程的技术执行力深度融合,形成一个攻防兼备的体系。

2.1 快速发现与评估:洞察危机的先锋

“知己知彼,百战不殆。” 快速发现和准确评估是危机响应的第一步,也是最关键的一步。

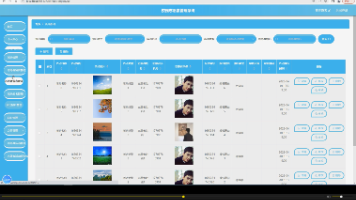

2.1.1 实时品牌监测体系的搭建

我们需要利用自动化工具和编程脚本,建立一个24/7的品牌提及监测系统。

- 传统媒体监测工具: 如Cision, Meltwater等,它们覆盖新闻、博客、论坛等。

- 社交媒体监听工具: 如Brandwatch, Sprout Social等,用于实时追踪社交平台上的品牌提及、话题趋势和情感倾向。

- 搜索引擎警报: 设置Google Alerts或Bing Alerts,针对您的品牌名称、产品名称、关键人物姓名等关键词,一旦有新内容被索引,即时通知。

- AI生成内容平台监测: 这是一个新兴且至关重要领域。虽然目前直接监控所有LLM输出非常困难,但我们可以关注:

- 主流搜索引擎的SGE (Search Generative Experience) 或类似功能: 当Google、Bing等集成AI生成内容时,密切关注您的品牌在这些结果中的呈现。

- 流行的AI助手和聊天机器人: 例如,通过ChatGPT、Bard、Claude等进行主动查询,模拟普通用户提问,定期检查它们对您品牌的理解。这可以通过编写自动化脚本来模拟用户交互,收集LLM的输出。

代码示例:基础Python网络爬虫与关键词监测

以下是一个简单的Python脚本,用于监测特定网页上的品牌关键词。在实际应用中,您会将其扩展为爬取多个源、处理更复杂的网页结构,并结合LLM API进行交互。

import requests

from bs4 import BeautifulSoup

import re

import time

from datetime import datetime

# --- 配置参数 ---

TARGET_URLS = [

"https://www.example-news-site.com/ai-news",

"https://www.example-tech-blog.com/company-updates",

# 更多需要监控的URL

]

BRAND_KEYWORDS = [

"YourBrandName",

"YourBrandProductX",

"YourBrandCEO",

"错误的引用关键词A",

"错误的引用关键词B"

]

MONITOR_INTERVAL_SECONDS = 3600 # 每小时检查一次

ALERT_EMAIL_RECIPIENTS = ["[email protected]"] # 邮件告警接收者

LAST_CHECK_TIMESTAMP_FILE = "last_check_timestamp.txt" # 记录上次检查时间的文件

# --- 辅助函数:发送邮件(需要配置SMTP服务器) ---

def send_email_alert(subject, body):

# 实际项目中,您需要配置SMTP服务器信息并使用smtplib库发送邮件

# 例如:

# import smtplib

# from email.mime.text import MIMEText

# msg = MIMEText(body)

# msg['Subject'] = subject

# msg['From'] = "[email protected]"

# msg['To'] = ", ".join(ALERT_EMAIL_RECIPIENTS)

# try:

# with smtplib.SMTP_SSL('smtp.your-email-provider.com', 465) as server:

# server.login("[email protected]", "your_password")

# server.send_message(msg)

# print(f"[{datetime.now()}] Email alert sent successfully.")

# except Exception as e:

# print(f"[{datetime.now()}] Failed to send email alert: {e}")

print(f"[{datetime.now()}] [MOCK EMAIL ALERT] Subject: {subject}nBody: {body}n")

# --- 主要监控逻辑 ---

def monitor_brand_mentions():

print(f"[{datetime.now()}] Starting brand mention monitoring...")

found_issues = []

# 读取上次检查时间

last_check_timestamp = None

try:

with open(LAST_CHECK_TIMESTAMP_FILE, 'r') as f:

last_check_timestamp = datetime.fromisoformat(f.read().strip())

print(f"[{datetime.now()}] Last check timestamp: {last_check_timestamp}")

except FileNotFoundError:

print(f"[{datetime.now()}] No previous check timestamp found. Will check all content.")

except Exception as e:

print(f"[{datetime.now()}] Error reading last check timestamp: {e}. Will check all content.")

for url in TARGET_URLS:

try:

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status() # 检查HTTP请求是否成功

soup = BeautifulSoup(response.text, 'html.parser')

page_text = soup.get_text().lower() # 获取页面所有文本并转为小写

# 过滤掉一些常见的非内容区域,例如导航、页脚等,以减少误报

# 这是一个简化的处理,实际应用中可能需要更复杂的选择器

main_content_tags = ['p', 'h1', 'h2', 'h3', 'li', 'span', 'div']

main_content_text = ""

for tag in main_content_tags:

for element in soup.find_all(tag):

main_content_text += element.get_text().lower() + " "

for keyword in BRAND_KEYWORDS:

if keyword.lower() in main_content_text:

# 进一步检查上下文,判断是否是误读/负面提及

# 这部分需要结合NLP技术进行更深度的分析,例如情感分析、实体关系抽取

# 简化示例:仅检查关键词存在

context_snippet = ""

# 尝试找到关键词附近的文本片段

match = re.search(r'(.{100})'+re.escape(keyword.lower())+r'(.{100})', main_content_text)

if match:

context_snippet = match.group(0)

# 仅在页面更新或首次发现时告警

# 实际生产中,可能需要更精确的页面更新检测,例如通过ETag或Last-Modified头

is_new_mention = True # 简化处理,假设每次发现都是新的,实际需更复杂逻辑

# 如果能获取文章发布时间,可以与last_check_timestamp对比

# 例如:article_date_str = soup.find('time', class_='post-date')['datetime']

# article_date = datetime.fromisoformat(article_date_str)

# if last_check_timestamp and article_date < last_check_timestamp:

# is_new_mention = False

if is_new_mention:

issue_detail = f"关键词 '{keyword}' 在 {url} 中被提及。n上下文片段: {context_snippet[:500]}..."

found_issues.append(issue_detail)

print(f"[{datetime.now()}] [ALERT] {issue_detail}")

except requests.exceptions.RequestException as e:

print(f"[{datetime.now()}] Error accessing {url}: {e}")

except Exception as e:

print(f"[{datetime.now()}] An unexpected error occurred for {url}: {e}")

if found_issues:

subject = f"品牌提及告警 - {len(found_issues)} 条新发现"

body = "检测到以下品牌提及或潜在误读问题:nn" + "n---n".join(found_issues)

send_email_alert(subject, body)

else:

print(f"[{datetime.now()}] No new brand mentions or issues found.")

# 更新上次检查时间

with open(LAST_CHECK_TIMESTAMP_FILE, 'w') as f:

f.write(datetime.now().isoformat())

print(f"[{datetime.now()}] Monitoring complete. Next check in {MONITOR_INTERVAL_SECONDS} seconds.")

# --- 运行监控(可结合调度工具如Cron) ---

if __name__ == "__main__":

# 可以在一个无限循环中运行,或由外部调度器触发

while True:

monitor_brand_mentions()

time.sleep(MONITOR_INTERVAL_SECONDS)2.1.2 优先级评估矩阵

一旦发现潜在的幻觉误读,需要迅速评估其影响范围和严重性,以确定响应的优先级。

| 评估维度 | 低优先级(绿色) | 中优先级(黄色) | 高优先级(红色) |

|---|---|---|---|

| 错误性质 | 轻微事实偏差,非核心信息 | 重要但不致命的事实错误,可能引起混淆 | 核心业务、产品、价值观的严重歪曲,诽谤性内容 |

| 传播平台 | 个人博客、低流量论坛、不活跃社交账号 | 中等流量网站、有一定关注度的社交媒体账号 | 权威新闻媒体、高流量行业网站、搜索引擎SGE、主流AI助手 |

| 传播速度 | 缓慢,评论或转发量极低 | 适中,有少量转发或讨论 | 迅速传播,病毒式扩散,大量转发和互动 |

| 情感倾向 | 中性或略带疑问 | 略微负面,可能导致用户困惑 | 强烈负面,直接损害品牌形象 |

| 潜在影响 | 几乎无实质影响 | 可能影响部分用户认知,需澄清 | 严重影响销售、股价、客户关系,可能引发法律问题 |

通过这样的矩阵,我们可以将危机分为不同等级,资源优先投入到处理高优先级的问题上。

2.2 策略制定:攻防兼备,以正视听

在发现和评估之后,我们需要制定一套攻防兼备的策略。核心思想是:以权威、准确的信息“淹没”或“覆盖”错误的幻觉信息,将您的品牌官方渠道建设成为最无可争议的“真相来源”。

2.2.1 防守:澄清与纠正

- 官方声明与澄清: 针对高优先级、影响重大的误读,发布正式的官方声明。声明应清晰、简洁、直接,明确指出错误信息,并提供准确的事实。

- 直接沟通与纠正: 如果误读出现在特定平台(如某个新闻网站、社交媒体账号),尝试直接联系平台编辑、内容创建者或管理员,要求他们修正或删除不准确的内容。

- 利用现有PR渠道: 动用您的媒体关系,联系与您品牌有良好合作的记者和媒体,请他们发布澄清报道或专题文章,以权威的声音驳斥谣言。

- AI平台反馈机制: 如果AI模型本身提供了反馈或纠错机制(例如许多LLM对话界面中的“反馈”按钮),务必积极利用这些渠道,提交详细的纠正信息。虽然这可能不会立竿见影,但长期来看有助于改善模型的行为。

2.2.2 进攻:构建“真相之源”

这才是我们作为编程专家和SEO从业者可以大展拳脚的地方。核心在于持续、系统地生产高质量、结构化、高度可信的品牌信息,并确保这些信息能够被搜索引擎和AI模型高效地发现、理解和信任。

- 您的官方网站: 这是您品牌的“数字总部”,是所有真相的最终来源。

- 权威的第三方平台: 如维基百科(如果有专页)、行业协会官网、知名行业媒体。

- 结构化数据(Schema Markup): 这是告诉搜索引擎和AI模型“我就是这样,这是我的核心信息”的机器可读语言。

- 知识图谱优化: 通过结构化数据和高质量内容,帮助搜索引擎和AI模型构建和完善关于您品牌的知识图谱。

- 高质量的外部链接: 来自权威网站的链接是信任和权威的强大信号。

第三部分:技术实战:以编程思维修正 AI 幻觉

现在,让我们深入技术层面,探讨如何利用编程和SEO技术,系统性地构建品牌的“真相之源”,从而修正AI的幻觉误读。

3.1 内容权威化与结构化:SEO 的核心武器

修正AI幻觉的关键在于让AI模型能够轻松识别、信任并引用您的品牌官方信息。这意味着我们需要以一种机器友好的方式呈现内容,并辅以强大的信任信号。

3.1.1 结构化数据 (Schema Markup) 的深度应用

结构化数据是SEO的“秘密武器”,也是我们对抗AI幻觉的“核武器”。它是一种标准化的数据格式(如JSON-LD),用于向搜索引擎(和潜在的AI模型训练者)提供关于页面内容的明确信息。通过精确地描述您的品牌、产品、服务、声明等,我们可以直接告诉AI模型“这是关于我的准确事实”。

核心 Schema Types 及应用:

-

Organization和Brand: 明确定义您的公司名称、Logo、官方网站、联系方式、社交媒体资料等。这是品牌身份的基础。<script type="application/ld+json"> { "@context": "https://schema.org", "@type": "Organization", "name": "您的品牌全称", "url": "https://www.yourbrand.com", "logo": "https://www.yourbrand.com/images/your-brand-logo.png", "sameAs": [ "https://twitter.com/YourBrandOfficial", "https://www.linkedin.com/company/your-brand", "https://www.facebook.com/YourBrandOfficial" ], "contactPoint": { "@type": "ContactPoint", "telephone": "+1-800-YOUR-BRAND", "contactType": "customer service" }, "description": "提供关于您品牌的一句简介,例如:'领先的软件解决方案提供商,专注于企业级AI驱动的数据分析。'" } </script> -

Article/NewsArticle/BlogPosting: 用于新闻稿、博客文章、官方声明等。在发布澄清或纠正性内容时,务必使用这些Schema,并填充关键属性。<script type="application/ld+json"> { "@context": "https://schema.org", "@type": "NewsArticle", "mainEntityOfPage": { "@type": "WebPage", "@id": "https://www.yourbrand.com/news/clarification-on-ai-misinformation" }, "headline": "您的品牌就近期AI误读事件发布澄清声明", "image": [ "https://www.yourbrand.com/images/clarification-banner.png" ], "datePublished": "2023-10-27T08:00:00+08:00", "dateModified": "2023-10-27T08:00:00+08:00", "author": { "@type": "Organization", "name": "您的品牌公关团队" }, "publisher": { "@type": "Organization", "name": "您的品牌全称", "logo": { "@type": "ImageObject", "url": "https://www.yourbrand.com/images/your-brand-logo.png" } }, "description": "本声明旨在澄清近期关于[具体误读内容]的错误信息,并提供[正确信息]。", "articleBody": "详细的澄清内容..." } </script>关键点: 在

articleBody中,确保清晰地表述事实,并直接反驳幻觉信息。使用明确的措辞,避免模糊。 -

FAQPage: 如果有常见的误解或被错误引用的信息,可以创建一个FAQ页面,专门回答这些问题,并使用FAQPageSchema。<script type="application/ld+json"> { "@context": "https://schema.org", "@type": "FAQPage", "mainEntity": [ { "@type": "Question", "name": "AI错误引用:您的品牌是否已更名为'XYZ'公司?", "acceptedAnswer": { "@type": "Answer", "text": "否。我们郑重声明,我们的品牌名称始终是'您的品牌全称'。近期AI模型中出现的'XYZ'公司信息系误读,与我们公司无关。" } }, { "@type": "Question", "name": "您的品牌的核心业务是否是[错误业务范围]?", "acceptedAnswer": { "@type": "Answer", "text": "我们品牌的重点业务是[正确业务范围],而非[错误业务范围]。请参考我们的官方产品页面了解详情。" } } ] } </script>关键点: 针对性地回答被误读的问题,并提供明确的、机器可读的答案。这对于LLM直接提取信息至关重要。

-

AboutPage/ContactPage: 确保您的“关于我们”和“联系我们”页面包含完整的品牌信息,并使用相应的Schema。

实施要点:

- 验证: 使用Google的Rich Result Test工具验证您的Schema Markup是否正确无误。

- 一致性: 确保所有页面上的品牌信息(名称、Logo、URL等)在文本内容和Schema Markup中都是一致的。

- 更新: 品牌信息发生变化时,及时更新所有相关的Schema Markup。

表格:核心Schema Markup类型及其作用

| Schema 类型 | 作用 | 修正AI幻觉的意义 |

|---|---|---|

Organization |

明确定义公司身份、名称、URL、Logo、联系方式、社交媒体等。 | 建立品牌权威身份,纠正基本信息误读。 |

Brand |

明确定义品牌名称和相关产品。 | 区分品牌与通用概念,防止品牌名称混淆。 |

Article |

定义新闻稿、博客文章、官方声明等。 | 标记官方澄清声明,提升其在信息流中的权威性。 |

FAQPage |

结构化常见问题及其答案。 | 直接针对常见误读提供权威答案,AI可直接提取。 |

Product |

详细描述产品名称、型号、价格、图片、描述等。 | 纠正产品信息错误,确保AI获取正确的产品细节。 |

Review |

结构化用户评价,显示产品/服务的真实反馈。 | 提升品牌透明度,用真实用户声音反驳负面幻觉。 |

3.1.2 知识图谱优化 (Knowledge Graph Optimization)

虽然我们无法直接修改Google等搜索引擎的知识图谱,但通过上述结构化数据和高质量内容,我们可以积极影响其构建方式。当Google的知识图谱对您的品牌有准确、丰富且权威的表示时,它不仅能提升传统搜索结果,也能为AI模型提供更坚实的事实基础。

实现路径:

- 完整且一致的NAP信息 (Name, Address, Phone): 确保在所有在线渠道(官网、社交媒体、本地列表、行业目录)上的品牌名称、地址、电话号码完全一致。

- 维基百科页面(如果适用): 拥有一个维护良好的维基百科页面可以显著增强品牌的权威性,因为它常被用作AI模型的事实来源之一。

- Google My Business (GMB) 优化: 对于有实体店或本地服务的品牌,优化GMB档案至关重要。

- 清晰的品牌历史与里程碑: 在官网“关于我们”页面详细阐述品牌历史、愿景、使命、核心价值观和重大里程碑,确保信息的全面性和准确性。

3.1.3 官方品牌中心与内容支柱

您的官方网站是您品牌的终极真相来源。

- 建立“真相中心”页面: 创建一个专门的页面,如“品牌事实与澄清”、“媒体资源包”或“关于我们”的增强版。该页面应包含:

- 官方品牌名称、Logo、品牌指南。

- 公司简介(短版和长版)。

- 核心产品/服务清单与详细描述。

- 官方联系方式和媒体联系人。

- 常见问题(FAQ),特别是针对近期被AI误读的问题。

- 过往所有官方声明、新闻稿的存档。

- 专门用于纠正AI幻觉的“AI事实核查专区”或类似栏目。

- 内容支柱与集群模型 (Pillar Content & Topic Clusters):

- 围绕您的核心品牌概念、产品或服务创建深度、权威的“支柱内容”(Pillar Content)。例如,一篇关于您的核心技术如何工作的全面指南。

- 围绕这些支柱内容,创建一系列相互关联、更具体、更详细的“集群内容”(Cluster Content)。例如,关于该技术特定应用场景的博客文章、案例研究、白皮书。

- 确保这些内容之间通过内部链接紧密连接,形成一个强大的语义网络。这不仅有助于传统SEO,也能帮助AI模型更好地理解您品牌的专业领域和权威性。

代码示例:Python生成Markdown格式的Pillar Content结构

这个示例展示了如何用代码组织内容结构,以便更好地规划和生成AI友好的内容。

def generate_pillar_content_plan(brand_name, core_topic, sub_topics, faq_questions):

"""

生成一个品牌核心主题的内容支柱计划(Markdown格式)。

:param brand_name: 品牌名称

:param core_topic: 核心支柱主题

:param sub_topics: 围绕核心主题的子主题列表

:param faq_questions: 针对核心主题的常见问题列表

:return: Markdown格式的字符串

"""

plan = f"# {brand_name} - {core_topic} 核心支柱内容计划nn"

plan += f"--- nn"

plan += f"## 1. 核心支柱文章 (Pillar Content): '{core_topic}' 深度解析nn"

plan += f"**目标:** 成为关于 '{core_topic}' 的最全面、最权威的在线资源,纠正所有潜在的AI幻觉误读。n"

plan += f"**URL:** `https://www.yourbrand.com/pillar/{core_topic.lower().replace(' ', '-')}`nn"

plan += f"### 文章大纲:n"

plan += f"1. **引言:** 什么是 {core_topic}?为何它对 {brand_name} 和行业至关重要?n"

plan += f"2. **历史与发展:** {core_topic} 的起源与 {brand_name} 在其中的角色。n"

plan += f"3. **{brand_name} 的独特方法/技术:** 详细介绍我们如何实现 {core_topic},与竞品差异化。n"

plan += f"4. **核心优势与应用场景:** 阐述 {core_topic} 为客户带来的价值。n"

plan += f"5. **未来展望:** {core_topic} 的发展趋势与 {brand_name} 的战略。n"

plan += f"6. **官方声明与澄清 (反幻觉专区):** 明确指出并纠正关于 {core_topic} 的常见误解或AI幻觉。n"

plan += f"7. **结论:** 重申 {brand_name} 在 {core_topic} 领域的领导地位。nn"

plan += f"### 内部链接策略:n"

plan += f" * 链接到所有相关的集群内容。n"

plan += f" * 链接到产品页面、案例研究、官方声明。n"

plan += f" * 链接到外部权威资源(如有)。nn"

plan += f"--- nn"

plan += f"## 2. 集群内容 (Cluster Content): 围绕 '{core_topic}' 的详细探讨nn"

plan += f"**目标:** 为核心支柱文章提供更深入的细节和特定视角,增强整体主题权威性。nn"

for i, sub_topic in enumerate(sub_topics):

plan += f"### 2.{i+1} '{sub_topic}'n"

plan += f" * **URL:** `https://www.yourbrand.com/blog/{sub_topic.lower().replace(' ', '-')}`n"

plan += f" * **内容要点:** 深入探讨 {sub_topic},提供具体案例或技术细节。n"

plan += f" * **内部链接:** 必须链接回 '{core_topic}' 支柱文章。nn"

plan += f"--- nn"

plan += f"## 3. 常见问题解答 (FAQ) - 针对 '{core_topic}' 的误读修正nn"

plan += f"**目标:** 以问答形式直接纠正关于 {core_topic} 的常见误解和AI幻觉,并使用 `FAQPage` Schema Markup。nn"

for i, question in enumerate(faq_questions):

plan += f"### Q{i+1}: {question}n"

plan += f" * **权威答案:** (在此处撰写准确、简洁的答案)n"

plan += f" * **Schema Markup:** 确保此问答对使用 `Question` 和 `Answer` 类型进行标记。nn"

return plan

# 使用示例

brand = "AI Solutions Co."

topic = "Responsible AI Development"

sub_topics_list = [

"Ethical AI Principles in Practice",

"Data Privacy and AI Models",

"Bias Detection and Mitigation in AI",

"AI Governance Frameworks"

]

faq_list = [

"Does AI Solutions Co. use undisclosed data sources for training?",

"Is AI Solutions Co.'s AI technology known to generate biased outputs?",

"Has AI Solutions Co. ever been involved in data misuse scandals as reported by some AI models?"

]

content_plan = generate_pillar_content_plan(brand, topic, sub_topics_list, faq_list)

print(content_plan)

# 实际应用中,您可以将此输出保存为Markdown文件或直接集成到CMS中3.2 外部链接建设与权威信号

高质量的外部链接(backlinks)仍然是搜索引擎判断页面和网站权威性的重要指标。对于AI模型而言,一个被大量权威网站引用的页面,其信息的可信度自然更高。

- 公关外展: 当您发布澄清声明或新的权威内容时,主动联系行业媒体、记者、意见领袖,争取他们引用您的官方内容。

- 专家贡献: 鼓励您的企业高管或技术专家在行业出版物、会议上发表文章或演讲,并在其中引用您的官方信息。

- 合作伙伴与客户: 确保您的合作伙伴和重要客户在提及您的品牌时,链接到您的官方网站或指定页面。

- 避免低质量链接: 清理或拒绝来自低质量、垃圾网站的链接,以免传递负面信号。

3.3 社交媒体与用户生成内容 (UGC) 的策略性运用

社交媒体是信息快速传播的渠道,也是AI模型获取信息的重要来源之一。

- 官方账号主动发声: 在您的所有官方社交媒体平台上,同步发布澄清声明、正确的品牌信息和指向官网“真相中心”的链接。

- 积极互动与纠正: 密切监控社交媒体上的品牌提及。一旦发现误读,以专业、友好的态度直接回复,提供准确信息和官方链接。

- 鼓励UGC: 鼓励忠实用户、员工和合作伙伴发布关于您品牌的正面、准确内容。用户的真实声音往往比品牌自说自话更有说服力。

- KOL/KOC合作: 与有影响力的关键意见领袖(KOL)或关键意见消费者(KOC)合作,让他们传播您的官方信息。

3.4 针对 AI 模型训练数据的间接干预与反馈

虽然我们不能直接修改LLM的训练数据集,但我们可以通过以下方式进行间接干预和提供反馈:

- 数据质量提升: 绝大多数LLM的训练数据都来源于互联网上的公开文本。通过上述SEO和内容策略,我们正在系统性地提高互联网上关于您品牌信息的质量、权威性和可发现性。长期坚持,当AI模型进行下一轮训练时,它们更有可能抓取到这些高质量的、无歧义的品牌数据。

- API 和数据源(如果适用): 如果您的品牌拥有公共API,提供结构化、实时更新的品牌相关数据(例如产品目录、新闻稿等),并确保这些API文档清晰、易于访问。未来,AI模型可能会直接通过API获取实时信息,而非仅仅依赖静态网页爬取。

- 利用AI平台反馈机制:

- Chatbot/Assistant UI 中的反馈按钮: 许多AI助手(如ChatGPT, Bard)在生成答案后提供“点赞/点踩”或“提供反馈”的选项。当发现关于您品牌的幻觉时,务必利用这些机制,明确指出错误并提供正确信息。

- 开发者API的反馈接口: 部分AI服务提供商的API可能包含反馈或评估接口。如果您的团队在使用这些API进行集成,可以探索如何通过编程方式提交结构化反馈,帮助模型改进。

代码示例:模拟向AI模型提供反馈(概念性)

实际的AI模型反馈机制通常通过其官方UI或SDK/API提供。以下是一个概念性的Python函数,模拟了通过API提交反馈的流程。

import json

import requests

# 假设AI服务提供商有一个反馈API端点

AI_FEEDBACK_API_ENDPOINT = "https://api.ai-provider.com/v1/feedback"

API_KEY = "YOUR_AI_PROVIDER_API_KEY" # 替换为您的实际API密钥

def submit_ai_feedback(model_id, query, incorrect_response, correct_information, user_id="anonymous"):

"""

模拟向AI模型提交反馈,指出其错误的幻觉响应。

:param model_id: 产生幻觉的AI模型ID (例如: "gpt-3.5-turbo", "bard-model-v1")

:param query: 用户向AI提出的原始问题

:param incorrect_response: AI模型产生的错误响应 (幻觉)

:param correct_information: 关于品牌的正确、权威信息

:param user_id: 提交反馈的用户ID (可选)

:return: 反馈提交结果

"""

feedback_payload = {

"model_id": model_id,

"query": query,

"incorrect_response": incorrect_response,

"correct_information": correct_information,

"feedback_type": "hallucination_correction",

"timestamp": datetime.now().isoformat(),

"user_id": user_id,

"brand_name": "YourBrandName", # 明确指出涉及的品牌

"brand_official_url": "https://www.yourbrand.com" # 提供官方权威来源

}

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

try:

response = requests.post(AI_FEEDBACK_API_ENDPOINT, headers=headers, data=json.dumps(feedback_payload))

response.raise_for_status() # 检查HTTP请求是否成功

print(f"[{datetime.now()}] Feedback submitted successfully for model {model_id}.")

return response.json()

except requests.exceptions.RequestException as e:

print(f"[{datetime.now()}] Failed to submit feedback to AI provider: {e}")

if response and response.status_code:

print(f"Status Code: {response.status_code}, Response: {response.text}")

return None

except Exception as e:

print(f"[{datetime.now()}] An unexpected error occurred during feedback submission: {e}")

return None

# 使用示例

if __name__ == "__main__":

model_producing_hallucination = "gpt-3.5-turbo" # 假设是这个模型

user_query = "告诉我关于 YourBrandName 的核心业务。"

ai_hallucination = "YourBrandName 是一家专注于生产电动牙刷的公司,其最新产品是'闪电刷'。"

official_facts = "YourBrandName 是一家领先的企业级云计算解决方案提供商,主要提供AI驱动的数据分析平台和SaaS服务。"

print("--- 模拟提交AI反馈 ---")

submit_ai_feedback(

model_id=model_producing_hallucination,

query=user_query,

incorrect_response=ai_hallucination,

correct_information=official_facts,

user_id="brand_guardian_team"

)

print("--- 模拟结束 ---")3.5 实时监控与自动化纠错的展望

结合前文的监控系统,我们可以进一步思考如何实现更高级的自动化。

- 增强的NLP分析: 利用更复杂的自然语言处理(NLP)模型(如BERT, RoBERTa)进行情感分析、实体识别和关系抽取,更准确地判断品牌提及的性质和上下文,而不仅仅是关键词匹配。

- 自动化内容生成草稿: 当检测到特定类型的误读时,可以利用LLM本身生成澄清声明的初步草稿,然后由人工审核和发布。

- CMS集成: 将监控系统与内容管理系统(CMS)集成,实现检测到问题后,自动在后台创建待审核的澄清页面或FAQ条目。

- 版本控制与品牌资产管理: 确保所有官方品牌资产(Logo、品牌介绍、核心价值观、产品名称)都经过严格的版本控制和统一管理,并通过API或结构化数据对外提供,防止内部信息不一致导致外部误读。

第四部分:长期策略:预防胜于治疗

对抗AI幻觉误读,绝非一蹴而就的短线操作,而是一项需要长期投入和持续优化的战略。预防,永远胜于治疗。

4.1 持续内容生产与优化

- 高质量、高频次的权威内容: 定期发布深度行业报告、技术白皮书、案例研究、官方新闻稿和博客文章。确保这些内容信息丰富、准确无误、观点独到。

- 内容多样化: 除了文本,还应包括视频、播客、信息图等多种形式,以适应不同用户的信息消费习惯,并增加被各种AI模型抓取的可能性。

- 语义优化: 不仅仅是关键词堆砌,更要关注内容的语义完整性和主题深度。确保内容能够全面、准确地回答与品牌相关的所有潜在问题。

4.2 建立“AI友好型”内容标准

- 清晰、简洁、直接: 避免模糊、歧义的语言。AI模型更擅长处理结构化、明确的信息。

- 事实为本,引用可靠来源: 所有数据、引述、声明都应有明确的来源,最好是可验证的官方来源。

- 一致性: 品牌名称、产品名称、公司描述、核心价值观等在所有内容中保持高度一致。

- 结构化排版: 使用标题、副标题、列表、表格等,使内容易于阅读和机器解析。这与Schema Markup相辅相成。

4.3 品牌声誉的持续管理与危机演练

- 定期声誉审计: 定期评估品牌在各种数字渠道(包括AI生成内容)中的表现,识别潜在风险。

- 危机公关预案: 针对不同类型的AI幻觉误读,提前制定公关响应预案,明确责任人、沟通流程和技术支持方案。

- 内部培训: 对公关、市场、技术、销售团队进行培训,让他们了解AI幻觉的风险,并知道如何在日常工作中贡献于品牌信息的一致性和准确性。

4.4 拥抱AI,而非抗拒AI

- 利用AI工具进行内容创作和优化: AI也可以成为我们生成高质量内容的助手,例如辅助撰写草稿、进行关键词研究、优化内容结构等。

- 探索AI驱动的品牌互动: 考虑将AI整合到您的客户服务、产品推荐等环节,确保这些AI工具在与用户互动时,始终基于最准确、最权威的品牌信息。

- 参与AI行业对话: 积极参与AI伦理、透明度、可解释性等方面的行业讨论,为未来AI技术的发展贡献力量,从而从源头上影响AI模型处理品牌信息的方式。

应对数字浪潮,捍卫品牌真相。

在AI时代,品牌声誉的维护已从传统公关和SEO的范畴,延伸至需要深厚技术功底和前瞻性战略的全新领域。作为编程专家,我们不仅仅是代码的构建者,更是品牌数字生态的守护者。通过系统性地应用结构化数据、持续生产权威内容、构建智能监测系统,并积极与AI平台互动,我们能够有效地修正AI的“幻觉误读”,确保我们的品牌在数字世界的每一个角落,都闪耀着真实与信任的光芒。这是一个持续的挑战,但也是一个赋予我们巨大价值和影响力的机遇。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献75条内容

已为社区贡献75条内容

所有评论(0)