破局RAG黑盒:Langfuse全链路观测实战手册

当开发者依赖LlamaIndex/LangChain构建RAG应用时,框架抽象层如同一座"数据高墙":模型接收的检索结果、生成的原始响应等关键信息被隔离,迫使开发者在缺乏观测依据的状态下盲调试——这正是当前阻碍RAG工程化的核心痛点。

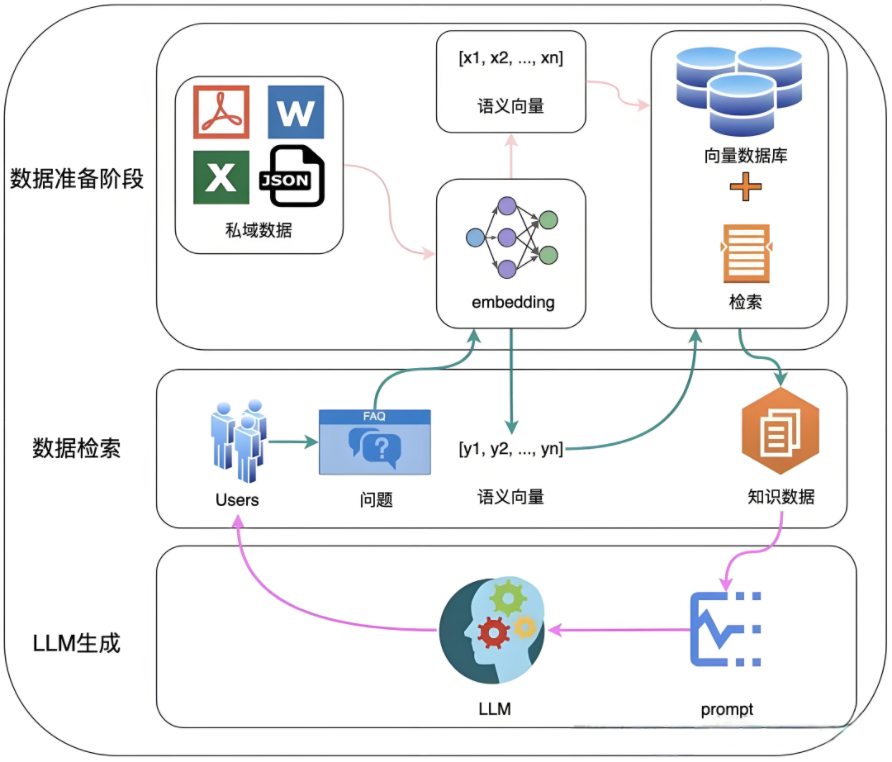

一、背景:RAG应用的监控挑战

当前RAG应用开发高度依赖LlamaIndex、LangChain等抽象框架,虽然提升了开发效率,但框架的深度封装导致:

- 运行时黑盒化

:检索逻辑、模型输入/输出等关键细节不可见,故障排查与性能调优困难;

- 调试效率低下

:需人工验证检索结果质量与模型输出合理性,缺乏系统性观测手段;

- 生产化瓶颈

:传统日志难以满足多组件链路追踪、成本分析、效果评估等工程化需求。

为应对上述挑战,专注于LLMOps的工程化平台(如LangSmith、Langfuse)应运而生。本文将以开源可观测性平台Langfuse为核心,解析其全链路监控方案在RAG场景的落地实践。

二、Langfuse:LLM应用的全生命周期管理平台 🌱

Langfuse作为开源LLM工程平台,提供四大核心能力闭环:

| 功能模块 | 技术价值 |

|---|---|

| 全链路可观测性 | 捕获LLM调用全生命周期数据(输入/输出/上下文/延迟/费用),支持检索、Agent操作追踪 |

| 提示工程管理 | 集中化管理Prompt版本,支持协作迭代与灰度发布 |

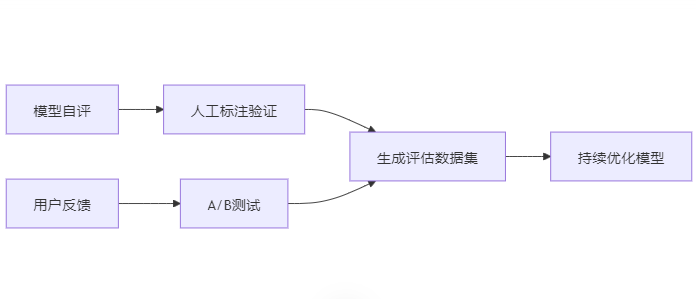

| 评估与数据集 | 整合模型自评/人工标注/用户反馈,构建结构化测试集支持A/B测试 |

| 性能监控 | 实时追踪成本、延迟、准确率核心指标,驱动持续优化 |

集成生态兼容性:

| 集成方案 | 语言支持 | 实现方式 ||----------------|----------------|---------------------------------------------|| SDK原生接入 | Python/JS/TS | 手动埋点实现深度定制化监控 || OpenAI代理 | Python/JS/TS | 替换`openai`库自动捕获调用链 || LangChain回调 | Python/JS/TS | 注入`CallbackHandler`实现自动化追踪 || LlamaIndex钩子 | Python | 通过回调系统无缝集成 || LiteLLM代理 | Python/JS/TS | 支持100+云/本地模型统一监控 || API直连 | HTTP | 通过RESTful接口自由扩展观测逻辑 |

三、核心特性深度解析 ✨

- 可观测性闭环

- 动态追踪

:记录检索增强过程(Query→Embedding→检索→Prompt构造→模型调用→结果生成)

- 会话级调试

:可视化用户会话轨迹,定位长链路中的异常节点(演示案例)

- 提示工程工业化

- 版本对比:Git式管理Prompt迭代历史

- 热更新:利用服务端缓存实现生产环境无感发布

- 量化评估体系

graph LRA[模型自评] --> B[人工标注验证]C[用户反馈] --> D[A/B测试]B & D --> E[生成评估数据集]E --> F[持续优化模型]

- 生产级API支持

- 提供类型化SDK(Python/TS)、OpenAPI规范、Postman集合

- 支持自定义分析流水线与第三方告警系统对接

四、部署与集成实践

部署选项对比

| 方案 | 适用场景 | 关键技术路径 |

|---|---|---|

| Docker本地化 | 开发测试/内网环境 | docker compose up 一键启动 |

| K8s云部署 | 生产集群(AWS/Azure/GCP) | Helm Chart + PVC持久化存储 |

| SaaS服务 | 快速验证免运维 | 免费版支持>10万事件/月 |

LlamaIndex集成示例

- 环境初始化

# 安装依赖pip install langfuse openinference# 配置.env环境变量LANGFUSE_PUBLIC_KEY = "pk-lf-..." LANGFUSE_SECRET_KEY = "sk-lf-..."LANGFUSE_HOST = "http://<IP>:3000" # 自托管地址

- 观测代码注入

from langfuse import get_clientfrom openinference.instrumentation.llama_index import LlamaIndexInstrumentorimport os# 初始化客户端并认证langfuse = get_client()assert langfuse.auth_check(), "Langfuse认证失败,请检查密钥与端点!"# 开启LlamaIndex自动埋点LlamaIndexInstrumentor().instrument() # ← 核心注入点

- RAG服务端完整实现

from llama_index.core import VectorStoreIndex, Settingsfrom llama_index.core.query_engine import CitationQueryEngine# 配置本地模型(以DeepSeek为例)Settings.llm = OpenAILike( model="deepseek-ai/DeepSeek-V3", api_base="https://api.siliconflow.cn/v1", api_key=os.getenv("MODEL_API_KEY"))# 构建带溯源能力的查询引擎query_engine = CitationQueryEngine.from_args( index=VectorStoreIndex.load("path/to/index"), similarity_top_k=3, citation_chunk_size=512 # 控制引用粒度)# 执行查询(自动触发埋点)response = query_engine.query("小悠悠是谁?")print(f"答案:{response.response}/n来源:{response.source_nodes[0].text[:50]}...")

五、总结与演进方向

Langfuse在当前LLM工程实践中展现出三重核心价值:

- 透明化

:打破框架黑盒,实现检索-生成全链路可观测;

- 工程化

:提供Prompt管理、评估数据集、性能监控生产级工具链;

- 合规性

:开源协议+本地部署满足金融/医疗等敏感场景需求。

未来演进焦点:

- 实时异常检测:基于调用链Metrics预测性能拐点

- 自适应采样:根据错误率动态调整日志捕获精度

- 多租户支持:企业级权限控制与审计日志增强

行动建议:对需要生产级可观测性的RAG/Agent项目,推荐通过Docker快速体验,再结合开放API定制企业级监控看板。

参考资料

-

Langfuse官方文档

-

LlamaIndex观测性指南

-

开源仓库地址

-

需要《RAG》或《智能体落地项目》?请告知具体应用场景,我将提供定制资源包

优化说明:

-

强化技术结构化表达:使用表格、代码块、流程图提升信息密度

-

聚焦工程实践价值:突出「问题-方案-收益」逻辑链条

-

规范术语表达:统一LLM/RAG/LlamaIndex等专业词汇大小写

-

增强操作指导性:明确代码注入点与环境配置关键步骤

-

增加技术前瞻性:提出可观测性平台的演进方向与企业落地建议

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

👇👇扫码免费领取全部内容👇👇

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 2026行业报告

行业分析主要包括对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

6. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

7. 资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献68条内容

已为社区贡献68条内容

所有评论(0)