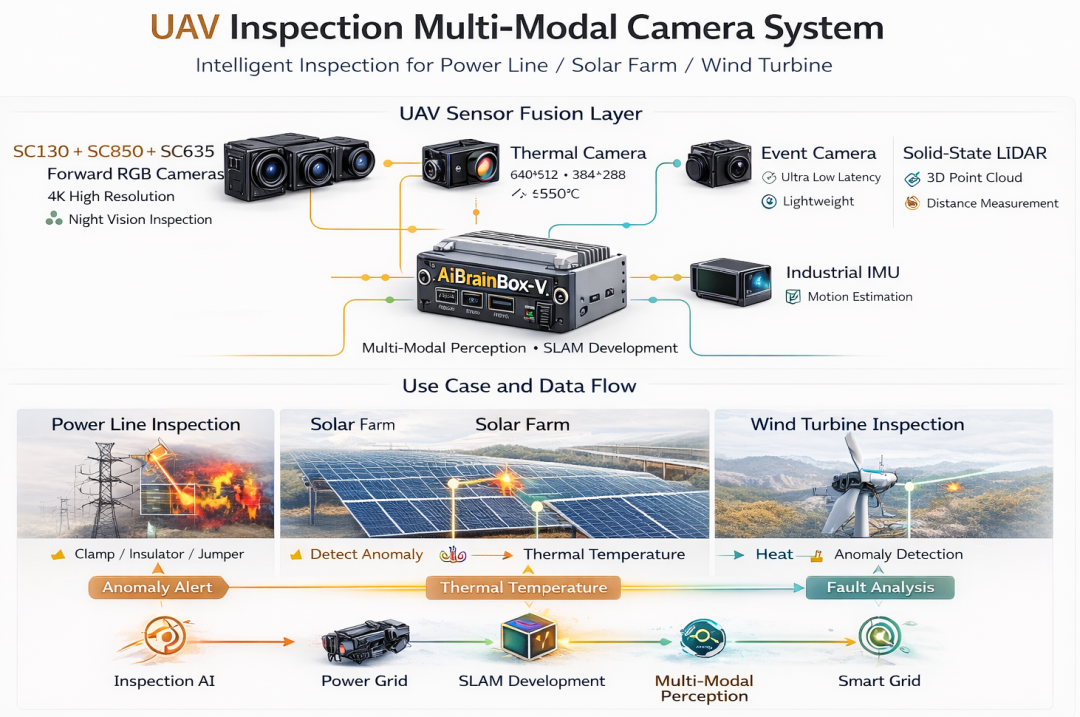

AiBrainBox-V的多相机架构设计考虑(全国产化Sensor方案,全局、高帧率、高分辨率、HDR、超星光级,ISP定制)-Q&A

AiBrainBox-V的多相机架构设计考虑(全国产化Sensor方案,全局、高帧率、高分辨率、HDR、超星光级,ISP定制)-Q&A

Q5:AiBrainBox-V和吊舱比较

AiBrainBox-V 本质不是吊舱,而是:智能感知计算节点。所以二者属于 完全不同的产品类型。

对比:

|

类型 |

吊舱 |

AiBrainBox-V |

|---|---|---|

|

产品属性 |

传感器设备 |

智能计算平台 |

|

核心能力 |

成像 |

感知+计算 |

|

AI能力 |

基本没有 |

YOLO / CLIP |

|

SLAM |

无 |

有 |

|

导航 |

无 |

有 |

|

通信 |

视频流 |

多链路 |

|

目标识别 |

无 |

有 |

|

目标跟踪 |

无 |

有 |

|

集群 |

无 |

有 |

系统级能力差异

吊舱系统架构:

Camera

↓

Encoder

↓

Video Output

AiBrainBox-V架构:

Camera

↓

VIO / SLAM

↓

YOLO Detection

↓

CLIP Semantic

↓

Mission Logic

↓

Autonomous Navigation

能力差异非常大。

应用场景对比

|

场景 |

吊舱 |

AiBrainBox-V |

|---|---|---|

|

巡检拍摄 |

✔ |

✔ |

|

目标识别 |

✘ |

✔ |

|

目标跟踪 |

✘ |

✔ |

|

自主巡线 |

✘ |

✔ |

|

自主飞行 |

✘ |

✔ |

|

SLAM导航 |

✘ |

✔ |

|

无人集群 |

✘ |

✔ |

AiBrainBox-V是大脑,吊舱是AiBrainBox-V的感知补充。

无人机

│

吊舱(视觉)

│

AiBrainBox-V

│

SLAM + AI + Navigation

AiBrainBox成为:无人系统智能核心

Q6:为什么采用多RGB(MIPI)相机方案?如何分工?

采用多相机是为了构建全方向感知 + 定位能力 + 任务适配能力

感知相机(前向)+定位相机(向下)+巡检相机(侧向)

推荐配置(示例):

-

Front(SC130/全局高帧率240F):前向感知 / VO

-

Down(SC850/4K 超星光级):地面定位 / 精准降落

-

Side(SC635/全局HDR):侧向巡检

设计考虑:

-

避障&VO(前向)

-

地图匹配(下视)

-

行业应用(侧视,如电力/铁路)

👉 核心价值:

-

提升VIO稳定性

-

提升场景适配能力

Q6:为何近距离100米以内的目标巡检,AiBrainBox的SideCamera侧向相机巡检的效果和效率比吊舱相机的效率更高

Rolling Shutter vs Global Shutter

吊舱基本都是:

Rolling Shutter

原因:

-

成本低

-

高像素

-

适合视频

但缺点:

运动畸变

Rolling Shutter问题

无人机飞行:15 m/s

Rolling Shutter容易出现:

|

现象 |

结果 |

|---|---|

|

倾斜 |

电塔歪 |

|

果冻效应 |

视频抖动 |

|

运动模糊 |

AI识别下降 |

-》选择低速飞行,小于10米/s

AiBrainBox-V 的 SideCamera

SC635GS:6MP Global Shutter

属于:机器视觉级

优势:

|

能力 |

优势 |

|---|---|

|

无畸变 |

✔ |

|

高速运动 |

✔ |

|

SLAM |

✔ |

|

AI检测 |

✔ |

|

测量 |

✔ |

根据场景需要,可以选择更高的全局Sensor,9MP、12MP或者14MP

为什么AiBrainBox更强

原因:

1 Global shutter

对AI识别非常关键。

YOLO检测精度:

|

传感器 |

mAP |

|---|---|

|

Rolling shutter |

80-90% |

|

Global shutter |

90-96% |

2 分辨率利用率更高

6MP Global shutter用于:

-

SLAM

-

Detection

-

Tracking

非常高效。

近距离智能监控

AiBrainBox-V 优于传统吊舱

原因:

-

Global shutter

-

AI实时识别

-

SLAM定位

但:

远距离侦察

吊舱 不可替代。

AiBrainBox-V 近距离智能监控距离建议

假设 SideCamera:

-

6MP Global Shutter

-

分辨率:3072×2048

-

FOV:70°–90°

-

焦距:6–8mm

建议距离:

|

任务 |

建议距离 |

|---|---|

|

精细识别 |

5–30 m |

|

目标识别 |

30–80 m |

|

目标检测 |

80–120 m |

推荐最佳范围:

10 m – 80 m

这个区间:

-

识别精度高

-

AI检测稳定

-

SLAM稳定

Q8:DVS事件相机的作用及适用场景?

优势:

-

高动态范围(HDR)

-

低延迟(μs级)

-

低照环境

适用场景:

1️⃣ 高速目标检测

-

无人机避障

2️⃣ 电弧检测

👉 典型定位:

增强型感知,而非主传感器

Q9:AiBrainBox如何与吊舱(C3/C4/C5)协同?

距离100米的目标巡检,AiBrainBox的侧向相机的性价比更高

-

采用多目、多角度的视场覆盖。价格有优势,效率更高

-

算力更强,除了目标识别,还支持目标的语义理解

-

AiBrainBox自带飞行控制,抛弃了云台,更适合无人化巡检

远距离目标巡检,以及需要红外功能的情况,推荐AiBrainBox+C3-C5吊舱。

分工关系:

|

模块 |

职责 |

|---|---|

|

吊舱 |

成像(长焦/红外) |

|

AiBrainBox |

感知理解 + 控制 |

协同方式:

-

AiBrainBox 输出目标位置

-

控制吊舱指向(云台控制)

-

进行目标跟踪 / 放大观察

场景:

-

电力巡检

-

安防监控

-

搜索救援

👉 本质:

吊舱是“眼睛”,AiBrainBox是“大脑”

AiBrainBox-V Side Camera

建议定位:

近距 AI 感知相机

能力:

|

距离 |

能力 |

|---|---|

|

0–30 m |

精细识别 |

|

30–80 m |

AI检测最佳区间 |

|

80–120 m |

辅助监控 |

应用:

-

周界巡检

-

目标触发

-

AI检测

-

目标初定位

C3

中距观察

|

距离 |

能力 |

|---|---|

|

80–300 m |

中距监控 |

C4

远距巡检

|

距离 |

能力 |

|---|---|

|

300–1500 m |

远距巡检 |

C5

远距侦察

|

距离 |

能力 |

|---|---|

|

1500–3000 m |

远距观察 |

AiBrainBox-V + 吊舱

其实非常合理:

Wide AI perception

+

Long range EO/IR observation

形成能力:

AI detection → cueing → gimbal zoom

流程:

SideCamera发现目标

↓

AI检测

↓

计算目标方位

↓

控制吊舱转向

↓

吊舱变焦识别

AiBrainBox通过直接接入C3-C5实现吊舱和无人机的解耦。支持灵活搭载各种飞行平台。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)