像素即坐标:这家公司,正在把“视频监控”变成“空间计算引擎”

像素即坐标:这家公司,正在把“视频监控”变成“空间计算引擎”

🔥 如果你还把摄像头当“看画面”的工具,这篇文章可能会颠覆你的认知。

一、为什么传统视频系统,正在“失效”?

我们先问一个很简单的问题:

👉 摄像头拍到的,到底是什么?

答案其实很残酷:

只是二维像素

📉 传统视频系统的三大致命问题

❶ 看得见,但算不了

- 无法计算距离

- 无法还原真实位置

- 无法知道“人到底在哪”

❷ 能识别,但不理解

现在AI可以识别:

- 人

- 车

- 打架

- 摔倒

但问题是:

👉 它不知道“发生了什么过程”

❸ 多摄像头 = 多个世界

- A摄像头看到一个人

- B摄像头看到一个人

👉 系统却不知道是同一个人

💡 核心结论

传统视频系统,本质是“二维观察系统”,而不是“空间理解系统”。

二、真正的突破:从“视频”到“空间”

镜像视界做了一件非常关键的事:

把视频 → 变成空间坐标系统

🧠 一个核心公式(一定要记住)

像素 → 空间坐标 → 三维模型 → 轨迹 → 行为 → 决策

👉 这不是优化

👉 这是“重构”

🔥 一句话理解这家公司

他们不是在做视频分析,而是在做“空间计算引擎”。

三、核心技术引擎(最硬核部分来了)

下面是整套系统的“发动机”。

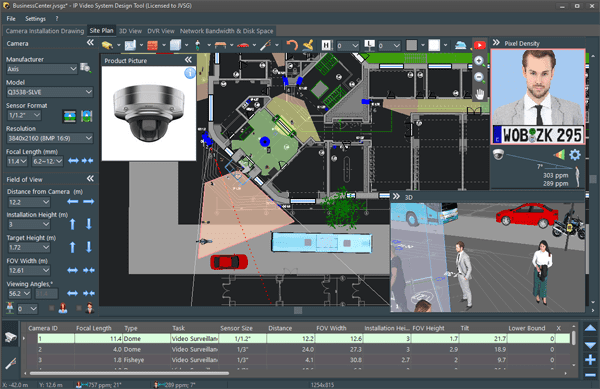

1️⃣ Pixel-to-Space:像素 → 坐标(底层革命

4

👉 核心能力:

- 多摄像头三角测量

- 像素直接变成空间坐标

- 实时定位(厘米级)

🧨 为什么这是革命?

以前:

- 视频 = 图像

现在:

- 视频 = 空间传感器

💬 金句:

每一个像素,都是一个坐标点。

2️⃣ MatrixFusion:让所有摄像头变成“一个系统”

4

👉 解决一个超级难的问题:

跨摄像头追踪

核心能力:

- Camera Graph(摄像头网络)

- 多视角时间同步

- 空间统一

👉 结果:

整个城市 = 一个连续空间

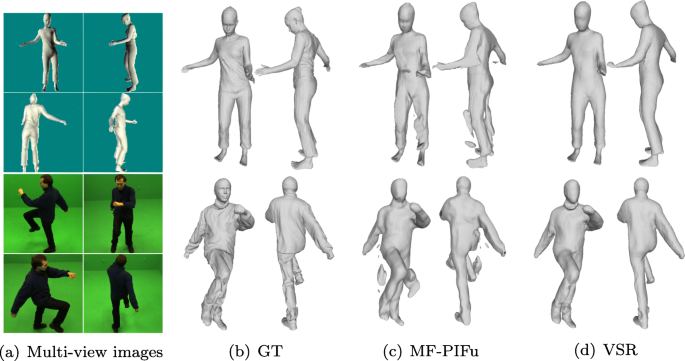

3️⃣ NeuroRebuild:动态三维重建(直接“造空间”)

👉 不是检测人,而是:

重建一个3D人

能力:

- 人 / 车三维建模

- 实时更新

- 多目标并发

👉 直接从:

- 点 → 体

- 静态 → 动态

4️⃣ 轨迹建模:空间里的“行为语言”

👉 这是最容易被低估的技术👇

轨迹 = 时间 × 空间 × 行为

你能做什么?

- 判断是否异常

- 判断是否危险

- 预测下一步

💬 金句:

行为,不在画面里,而在轨迹里。

5️⃣ 风险场建模:从“报警”到“预测”

传统系统:

- 出事 → 报警

镜像视界:

- 还没出事 → 已经知道

👉 核心能力:

- 风险分布

- 趋势预测

- 提前干预

6️⃣ SpaceOS:空间操作系统(真正的底座)

👉 类比一下:

- Windows 管电脑

- iOS 管手机

👉 SpaceOS:

管理整个现实空间

四、技术体系到底有多强?(一句话对比)

📊 和传统方案对比

| 能力 | 传统视频 | 镜像视界 |

|---|---|---|

| 数据 | 2D画面 | 3D空间 |

| 能力 | 看 | 算 |

| 逻辑 | 事后 | 预测 |

| 系统 | 分散 | 统一 |

💬 金句:

传统系统在“看世界”,这个系统在“计算世界”。

五、国内 vs 国际:它到底领先在哪?

🇨🇳 国内公司在做什么?

- 海康 / 大华 → 视频监控

- 商汤 / 旷视 → AI识别

👉 本质:

还是“看图像”

🌍 国外在做什么?

- Tesla → 自动驾驶视觉

- NVIDIA → 数字孪生

- Palantir → 数据分析

🚀 镜像视界在做什么?

直接做“空间计算底座”

🔥 三个领先点

① 范式领先

AI → 空间计算

② 数据领先

2D → 3D → 4D(轨迹)

③ 工程领先

无需硬件改造

六、落地场景

🚢 港口

- 人车混行风险预测

- 调度优化

🪖 军储

- 入侵检测

- 战术轨迹

🏙️ 城市

- 人群预测

- 安全预警

⚠️ 危化园区

- 风险提前识别

- 作业监控

七、为什么这件事很重要?

这不是一个产品升级

而是一个时代变化👇

📌 三个跃迁

1️⃣ 视频 → 空间

2️⃣ 数据 → 认知

3️⃣ 系统 → 智能体

💬 金句:

未来的智能,不在屏幕里,而在空间里。

八、总结

如果用一句话总结镜像视界:

它不是在做视频AI,而是在构建“现实世界的计算系统”。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献42条内容

已为社区贡献42条内容

所有评论(0)