大语言模型微调数据集构建秘籍:从零到一打造高性能AI!

随着大型语言模型(LLM)在自然语言处理、智能问答和生成任务中的广泛应用,微调(Fine-tuning)成为提升模型性能、适配特定场景的关键技术。

微调的核心在于数据集的质量与设计合理性。

本文系统探讨了大语言模型微调数据集的构建方法,包括数据来源、格式设计、数据清洗与增强策略,以及先进的生成与优化技术。

同时,结合实践工具和开源案例,提出构建高效、可控微调数据集的策略,为研究者和开发者提供参考。

1

微调的重要性与挑战

大型语言模型如GPT、LLaMA、ChatGPT等在通用任务上表现出色,但在特定行业或应用场景中,往往需要模型具备专业知识或个性化表达能力。这时,微调成为不可或缺的手段。

微调的效果直接依赖于数据集的质量和结构。研究显示,微调不仅仅是“数据越多越好”,而是“质量优先、针对性强”。

例如,LIMA实验中,仅使用72.8KB高质量数据,模型便能在指令跟随任务中表现优异。

因此,构建一个科学、可控、覆盖充分的微调数据集,是提升LLM能力的根基。

微调数据集面临几个核心挑战:

数据来源复杂:需要结合公开数据、行业数据和自定义数据。

格式多样:指令-响应、多轮对话、摘要或API调用等形式。

处理复杂:需去噪、去重、增强,并保证标注一致性。

质量控制难:高质量数据生成成本高,低质量数据会影响模型性能。

本文将从宏观到微观,系统解析微调数据集的构建方法与技术实践。

2

微调数据集的基本构成

- 数据格式

微调数据集的组织形式直接影响模型的学习效果,常见格式包括:

指令跟随(Instruction-following):如Alpaca-52k数据集,采用instruction + output结构,有时可包含可选的input字段,适合单轮任务训练。

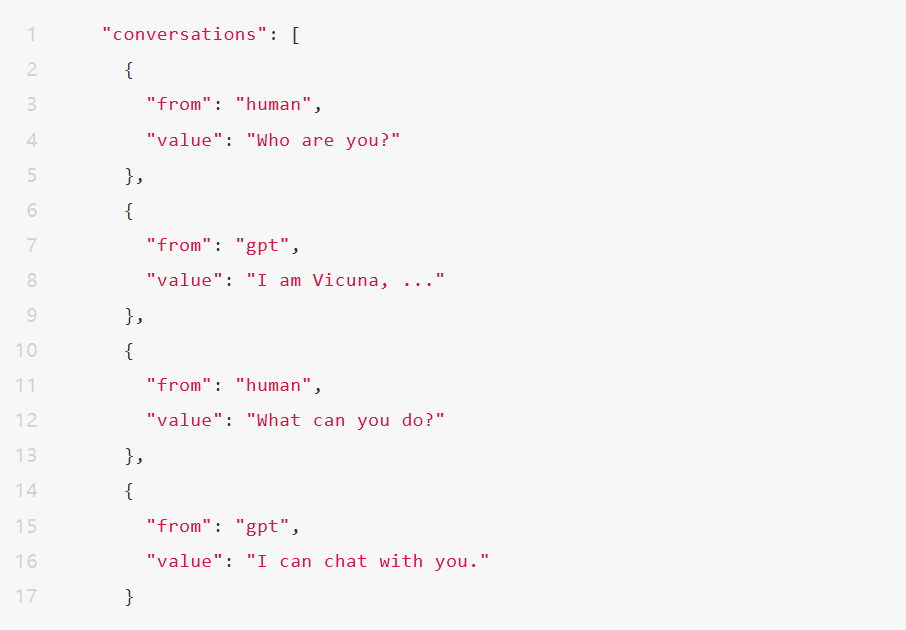

多轮对话(Conversational):如ShareGPT数据集,通常用于训练对话模型(如Vicuna),强调对话自然性与上下文连续性。格式如下:

文本摘要与知识调用:部分数据集包含摘要、API调用示例或数据库查询语言,适用于增强模型的工具调用和信息检索能力。

- 数据来源

数据来源可分为三类:

公开数据(Public Data):开源数据集、论坛问答、维基百科等。

行业数据(Industry Data):企业内部文档、知识库、客户支持记录。

自定义数据(Custom Data):由人工或模型生成的高价值数据,通常用于补充专业领域知识。

- 数据处理流程

在数据进入模型训练前,需进行系统处理:

清洗(Cleaning):去除重复、无效、噪声信息,确保标注一致性。

增强(Augmentation):包括翻译、同义词替换、随机插入,以扩充样本覆盖度。

标注与格式统一:统一字段命名、对齐输入输出格式,便于训练程序解析。

现代工具如H2O LLM Data Studio、OpenAI Fine-tune API可辅助数据处理和批量格式化,提高效率。

3

构建高质量微调数据集的方法

- 模型生成数据(Self-instruct)

Self-instruct方法利用已有模型生成大量指令-响应数据,降低人工标注成本。

但生成数据的质量需严格把控,否则可能引入偏差或低质量内容。通常需要人工抽样验证、去重和优化。

- 数据质量优先

高质量数据优先策略强调“少量高质胜过大量低质”。

例如LIMA和Based模型实验表明,通过精选数据和启发式指令,即便数据量远小于传统大规模数据,也能显著提升模型性能。

质量控制可通过几种方式实现:多轮人工审查、自动一致性检查,和参考标准化评分体系(如BLEU、ROUGE或人工打分)。

- 知识注入与演化

知识注入技术通过解释轨迹(Chain-of-Thought, CoT)或迭代进化方法增强模型推理能力。

例如Orca方法利用多轮推理示例训练模型,提高复杂任务的理解能力;WizardLM则通过逐步优化指令生成策略,使模型在任务执行上更精准。

- 分词器(Tokenizer)对微调的影响

分词策略直接影响模型对输入的理解能力。中文文本尤其敏感,需注意:

中文长文本可能被切分成过多token,增加训练成本。

分词方式需与预训练模型保持一致,否则微调效果下降。

4

工具与实践建议

在构建微调数据集的过程中,使用合适的工具和实践策略至关重要:

数据管理工具:如H2O LLM Data Studio、LangChain Dataset Manager,用于整理、清洗和增强数据。

混合训练策略:结合开源数据集与自定义高质量数据,可在保证覆盖面的同时,提升模型专业性。

持续迭代:微调数据集不是一次性工作,应根据模型性能和实际反馈不断优化。

5

总结与展望

构建高质量的微调数据集是大语言模型定制化能力的核心。

本文从宏观到微观分析了微调数据集的格式、来源、处理流程及优化方法,并结合实践工具和开源案例提出了可行策略。

未来,随着数据自动生成、质量评估和工具支持的发展,微调数据集构建将更加高效和智能。

开发者可以通过混合训练、自适应增强和知识演化等手段,让模型在专业领域和复杂任务中表现出更高的可靠性和灵活性。

微调不仅是模型能力提升的手段,更是实现模型个性化和高效应用的关键桥梁。

掌握科学的微调数据集构建方法,将直接决定大语言模型在实际场景中的成功应用。

2026年AI行业最大的机会,毫无疑问就在应用层!

字节跳动已有7个团队全速布局Agent

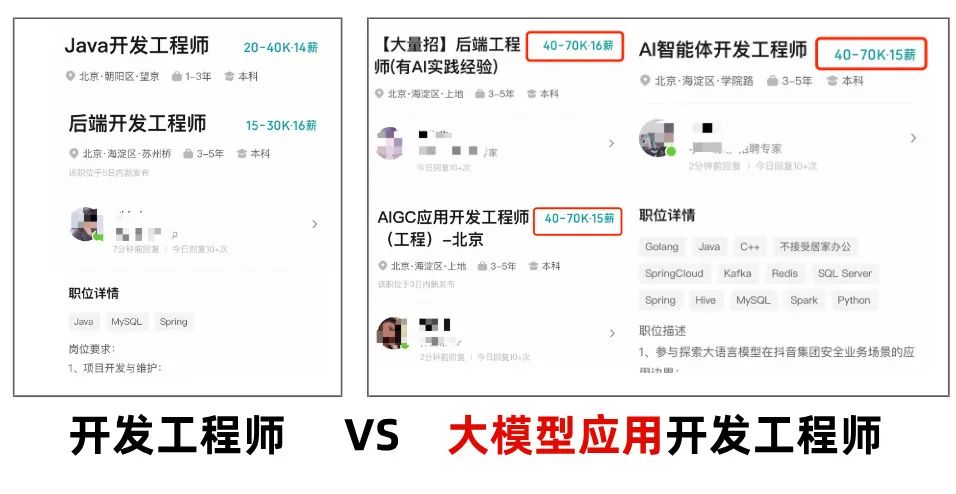

大模型岗位暴增69%,年薪破百万!

腾讯、京东、百度开放招聘技术岗,80%与AI相关……

如今,超过60%的企业都在推进AI产品落地,而真正能交付项目的 大模型应用开发工程师 **,**却极度稀缺!

落地AI应用绝对不是写几个prompt,调几个API就能搞定的,企业真正需要的,是能搞定这三项核心能力的人:

✅RAG:融入外部信息,修正模型输出,给模型装靠谱大脑

✅Agent智能体:让AI自主干活,通过工具调用(Tools)环境交互,多步推理完成复杂任务。比如做智能客服等等……

✅微调:针对特定任务优化,让模型适配业务

目前,脉脉上有超过1000家企业发布大模型相关岗位,人工智能岗平均月薪7.8w!实习生日薪高达4000!远超其他行业收入水平!

技术的稀缺性,才是你「值钱」的关键!

具备AI能力的程序员,比传统开发高出不止一截!有的人早就转行AI方向,拿到百万年薪!👇🏻👇🏻

AI浪潮,正在重构程序员的核心竞争力!现在入场,仍是最佳时机!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

⭐️从大模型微调到AI Agent智能体搭建

剖析AI技术的应用场景,用实战经验落地AI技术。从GPT到最火的开源模型,让你从容面对AI技术革新!

大模型微调

-

掌握主流大模型(如DeepSeek、Qwen等)的微调技术,针对特定场景优化模型性能。

-

学习如何利用领域数据(如制造、医药、金融等)进行模型定制,提升任务准确性和效率。

RAG应用开发

- 深入理解检索增强生成(Retrieval-Augmented Generation, RAG)技术,构建高效的知识检索与生成系统。

- 应用于垂类场景(如法律文档分析、医疗诊断辅助、金融报告生成等),实现精准信息提取与内容生成。

AI Agent智能体搭建

- 学习如何设计和开发AI Agent,实现多任务协同、自主决策和复杂问题解决。

- 构建垂类场景下的智能助手(如制造业中的设备故障诊断Agent、金融领域的投资分析Agent等)。

如果你也有以下诉求:

快速链接产品/业务团队,参与前沿项目

构建技术壁垒,从竞争者中脱颖而出

避开35岁裁员危险期,顺利拿下高薪岗

迭代技术水平,延长未来20年的新职业发展!

……

那这节课你一定要来听!

因为,留给普通程序员的时间真的不多了!

立即扫码,即可免费预约

「AI技术原理 + 实战应用 + 职业发展」

「大模型应用开发实战公开课」

👇👇

👍🏻还有靠谱的内推机会+直聘权益!!

完课后赠送:大模型应用案例集、AI商业落地白皮书

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献43条内容

已为社区贡献43条内容

所有评论(0)