GEWDiff: Geometric Enhanced Wavelet-based Diffusion Model for Hyperspectral Image Super-resolution

GEWDiff (AAAI 2026)

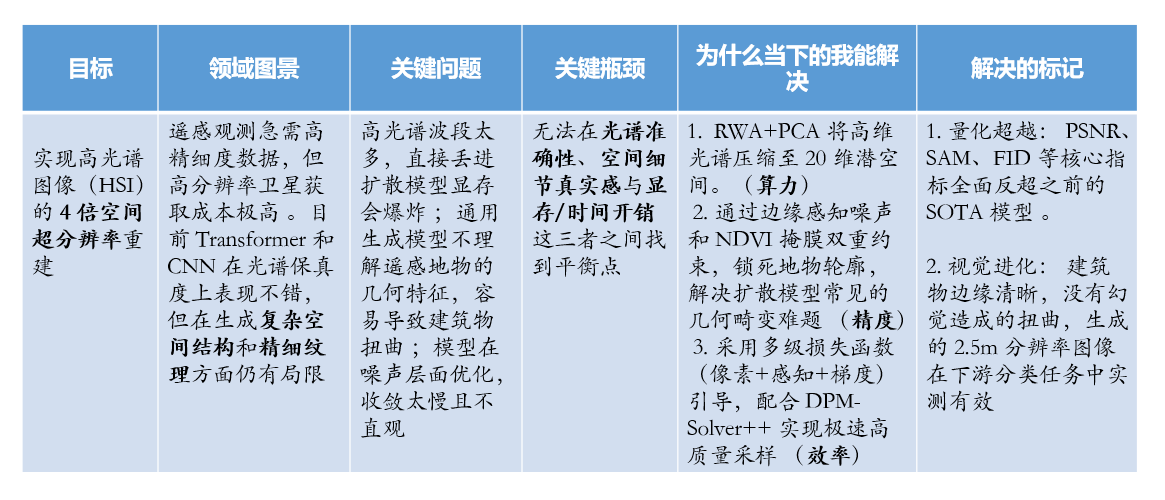

一、背景与挑战

-

背景:高光谱图像超分辨率(SR)能显著提升对地面物体观测能力。

-

现有方法局限性:

- 传统方法:插值,如近邻接或双线性内插,但无法捕捉多维的光谱数据中存在的复杂非线性关系。

- 现有深度学习模型:CNN,transformer, GAN 等,难生成丰富的纹理和复杂的空间结构。

-

扩散模型面临问题:

- 算力瓶颈:HSI的高光谱维度过多无法直接输入传统扩散模型,会导致扩散模型显存爆炸。

- 几何失真:传统模型对遥感图像中地面物体拓扑结构理解不足。

- 收敛不稳定:很多扩散模型在优化损失函数时,只关注噪声本身,对于复杂数据收敛过程不够直观,生成质量不够高。

-

目标: 实现高光谱图像的4倍超分辨率,在保证光谱保真度的同时,恢复清晰的几何结构。

二、模型结构

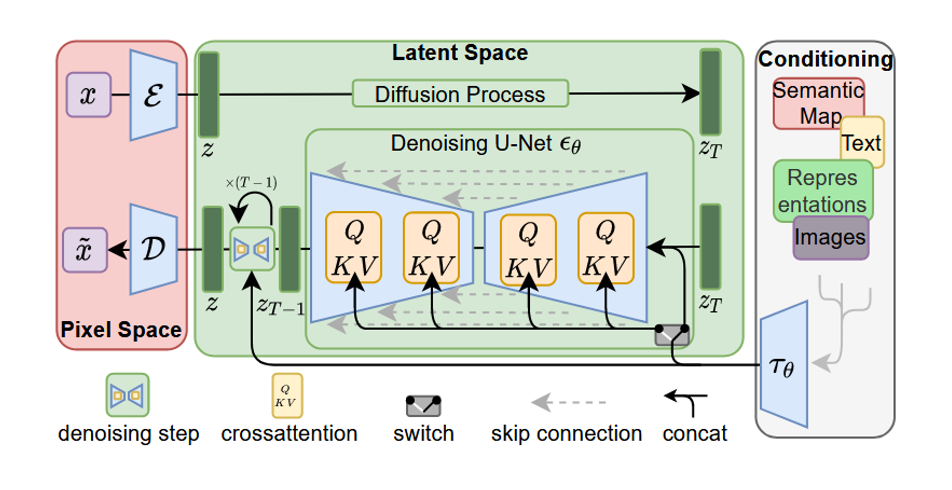

LDM

本论文的基础模型架构为LDM,也就是所谓的潜在扩散模型:大体思路为把特征压缩进入潜在空间中再释放

这是LDM(Latent Diffusion Model)基础架构图 (2022年CVPR)

- 最左侧像素空间负责压缩与还原 (编码器和解码器)

- Encoder: 把原始图片压缩成一个小得多的特征图z

- Decoder: 把生成的特征图还原 这样是为了让中间的扩散模型,不用处理庞大的像素数据,减少算力压力

- 中间:潜空间 Diffusion Process 是扩散模型 加噪为 Z t Z_t Zt, Z t − > Z Z_t->Z Zt−>Z则是去噪过程 (用于生成)

- Denosing U-net:去噪网络,他接收带噪声的 Z t Z_t Zt,预测噪声是多少,然后减去噪声生成更清晰的 Z t − 1 Z_{t-1} Zt−1

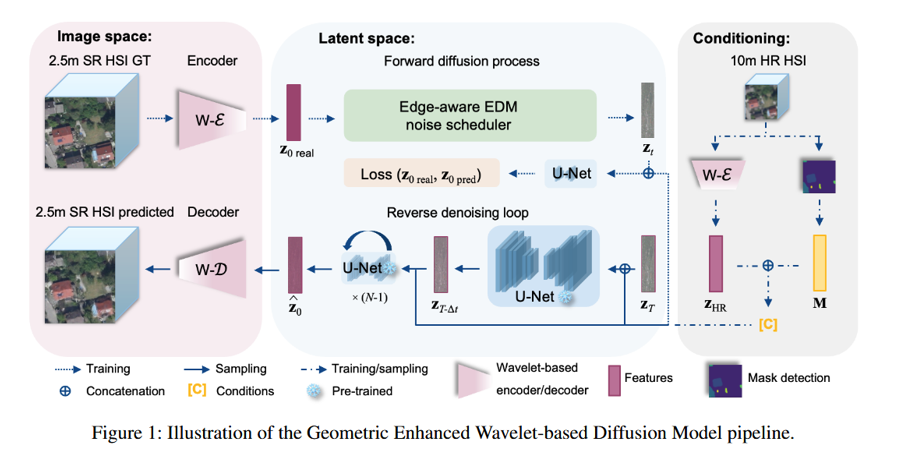

GEWDiff(Geometric Enhanced Wavelet-based Diffusion Model)

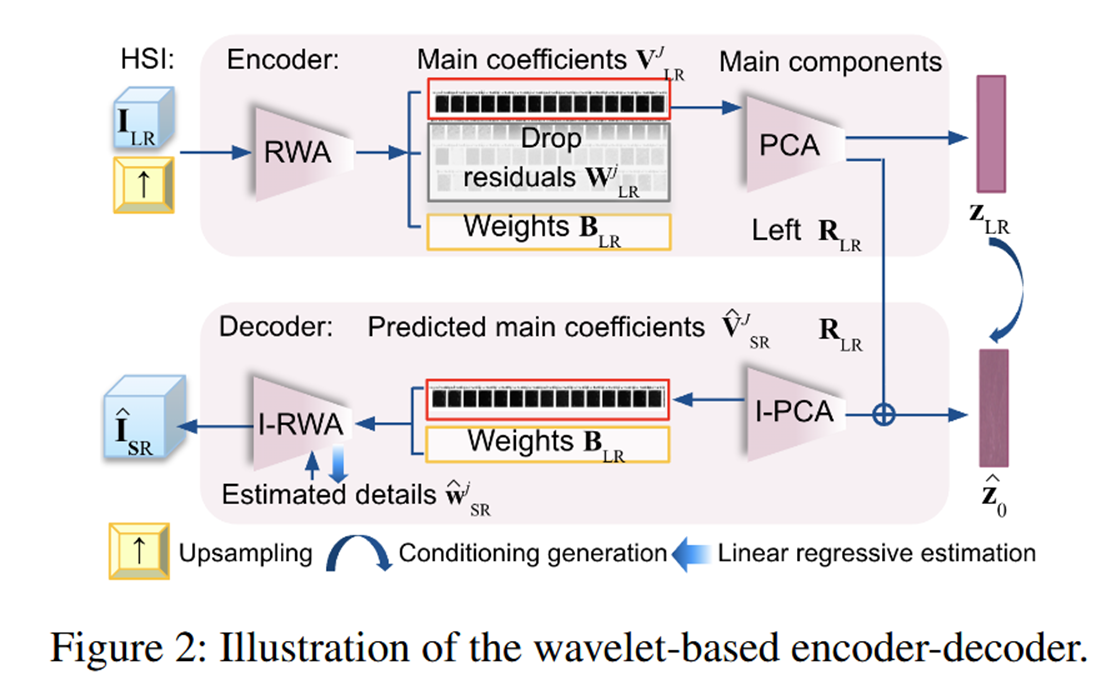

1、基于小波的编码-解码器

- 输入: 低分辨率的高光谱图像块如(6464242波段)

- ①RWA(回归小波分析):首先利用回归小波分析对数据进行分解,这一步利用波段间的冗余性,将数据分解为主要系数和细节系数

- ②PCA(主成成分分析) :对主要系数进行主成分分析 目的是为了将原本巨大的高维数据压缩在一个紧凑的潜空间中 这一步解决了扩散模型显存占用过大的问题,同时保留关键的光谱-空间信息。

2、几何增强的扩散生成过程

- 输入:压缩后的特征

- 输出:去噪后的高分辨率潜在特征

3、Decoding and Reconstruction

- 操作: 逆向执行第一步执行的操作

- 逆RWA:利用之前保存的逆PCA:将生成的潜在特征还原为主要系数,回归系数,预测并恢复细节系数,最终重组出完整的高光谱数据立方体

- 输出:高分辨率的高光谱图像如(256256242)

完整数据流图

| 步骤 | 阶段 | 输入数据 | 变换操作 | 输出数据 | 维度变化 | 关键说明 |

|---|---|---|---|---|---|---|

| 1 | 输入 | 原始低分辨率高光谱图像 | 数据预处理/归一化 | I L R I_{LR} ILR | 64×64×242 | 原始输入,242个光谱波段 |

| 2 | 编码器-RWA | I L R I_{LR} ILR | J级Haar小波分解 | V L R J V_{LR}^J VLRJ , w L R j w_{LR}^j wLRj | 242→121波段 | 分解为主系数和细节系数 |

| 3 | 编码器-RWA | V L R J V_{LR}^J VLRJ , w L R j w_{LR}^j wLRj | 线性回归建模 | w ^ L R j \hat{w}_{LR}^j w^LRj , B L R B_{LR} BLR | - | 学习主系数与细节系数的关系 |

| 4 | 编码器-RWA | w L R j w_{LR}^j wLRj , w ^ L R j \hat{w}_{LR}^j w^LRj | 残差计算 | W L R j = w L R j − w ^ L R j W_{LR}^j = w_{LR}^j - \hat{w}_{LR}^j WLRj=wLRj−w^LRj | - | 残差被丢弃(Drop),不传递 |

| 5 | 编码器-PCA | V L R J V_{LR}^J VLRJ | 主成分分析变换 | z L R z_{LR} zLR , R L R R_{LR} RLR | 121→20波段 | 进一步压缩至潜在空间 |

| 6 | 扩散输入 | z L R z_{LR} zLR | 添加噪声 | z t z_t zt | 64×64×20 | 前向扩散过程,t=1…T |

| 7 | 扩散生成 | z t z_t zt , t t t , 条件 C C C | 3D U-Net去噪预测 | ϵ θ ( z t , t , C ) \epsilon_\theta(z_t, t, C) ϵθ(zt,t,C) | 64×64×20 | 噪声预测网络核心 |

| 8 | 扩散生成 | z t z_t zt , ϵ θ \epsilon_\theta ϵθ | 采样器去噪迭代 | z ^ 0 \hat{z}_0 z^0 | 64×64×20 | 50步迭代,生成干净特征 |

| 9 | 解码器-I-PCA | z ^ 0 \hat{z}_0 z^0 , R L R R_{LR} RLR | 逆PCA变换 | V ^ S R J \hat{V}_{SR}^J V^SRJ | 20→121波段 | 恢复小波域主系数 |

| 10 | 解码器-I-RWA | V ^ S R J \hat{V}_{SR}^J V^SRJ , B L R B_{LR} BLR | 线性回归预测细节 | w ^ S R j \hat{w}_{SR}^j w^SRj | - | 利用编码器权重预测高频 |

| 11 | 解码器-I-RWA | V ^ S R J \hat{V}_{SR}^J V^SRJ , w ^ S R j \hat{w}_{SR}^j w^SRj | 逆小波重建 | I ^ S R \hat{I}_{SR} I^SR | 121→242波段 | 合成完整光谱波段 |

| 12 | 输出 | I ^ S R \hat{I}_{SR} I^SR | 后处理/反归一化 | I S R I_{SR} ISR | 256×256×242 | 最终超分辨率输出 |

三、创新点

Wavelet-based Encoder-Decoder

RWA(回归小波分析)与PCA(主成成分分析)

- 首先输入低分辨率的HSI ,RWA操作: 对输入的图像J进行小波分解,输出分为三个部分- 主系数V 低频信息, 残差W, 高频细节的预测误差(丢弃), 权重B, 线性回归模型的参数 PCA(主成分分析) 输入 RWA输出的主系数

- 操作:进一步压缩光谱维度 输出:低维潜特征,输入扩散模型 R L R R_{LR} RLR PCA的剩余分量,确保PCA变换可逆,减少信息损失

- 解码器部分: 将高维的光谱信息分解。然后,它聪明地只保留了最关键的低频主成分,并用一个线性回归模型来“记住”如何从主成分预测出高频细节。接着,再用我们熟悉的主成分分析(Principal Component Analysis, PCA)对这些主成分进行二次压缩,最终得到一个非常紧凑的潜在表示(latent space)。

Geometric enhanced diffusion process

A. 边缘感知噪声调度器 (Edge-aware noise scheduler)

在遥感场景中,我们希望澄清建筑物和其他地面物体的轮廓,因此设计这个模块,边缘在正向扩散过程中被保留,边缘周围的噪声比一般噪声小。 这里引入了二值边缘图 E E E。如果一个像素在边缘上( E = 1 E=1 E=1),后面的乘子就会减小注入的噪声。从而避免了建筑物轮廓在极度噪声下被完全破坏。 z t = z 0 + σ t ϵ ⊙ ( 1 − E ( 1 − σ n o r m 2 ) η ) z_t = z_0 + \sigma_t\epsilon \odot (1 - E(1 - \sigma_{norm}^2)^\eta) zt=z0+σtϵ⊙(1−E(1−σnorm2)η)

B. 掩码可控的训练与采样 (Mask controllable training and sampling)

处理流程:LG RGB → \rightarrow → SAM分割 → \rightarrow → 结合NDVI(植被指数) → \rightarrow → 计算Mask。 M s = 1 − 1 ∣ S s ∣ ∑ ( x , y ) ∈ S s NDVI n o r m ( x , y ) , NDVI n o r m ∈ [ 0 , 1 ] M_s = 1 - \frac{1}{|S_s|} \sum_{(x,y) \in S_s} \text{NDVI}_{norm}(x, y), \text{NDVI}_{norm} \in [0, 1] Ms=1−∣Ss∣1(x,y)∈Ss∑NDVInorm(x,y),NDVInorm∈[0,1]几何形状保护:将Mask注入U-Net模型(通过条件 C \mathbf{C} C 注意建筑物轮廓)。 z ^ 0 = f θ ( z t , C , σ t ) , C = [ z L R , M ] \hat{\mathbf{z}}_0 = f_\theta(\mathbf{z}_t, \mathbf{C}, \sigma_t), \mathbf{C} = [\mathbf{z}_{LR}, \mathbf{M}] z^0=fθ(zt,C,σt),C=[zLR,M]Mask与低分辨率的隐空间特征拼接在一起组成完整的条件向量,并进行归一化处理。 采样过程:作者采用DPM-Solver++来加速采样时间步,首先将时间步离散化为 N N N 个离散步,在每个去噪步过程中条件 C \mathbf{C} C 会参与每一次评估。

C. DPM-Solver++ 极速采样

从纯噪声起步,利用非线性时间表控制步调,通过融合当前步和上一步的梯度方向,实现大跨步的去噪更新,从而将采样步数降到 50 步。 非线性噪声调度公式: σ n = ( σ m a x 1 / ρ + n N − 1 ( σ m i n 1 / ρ − σ m a x 1 / ρ ) ) ρ \sigma_n = \left(\sigma_{max}^{1/\rho} + \frac{n}{N-1}(\sigma_{min}^{1/\rho} - \sigma_{max}^{1/\rho})\right)^\rho σn=(σmax1/ρ+N−1n(σmin1/ρ−σmax1/ρ))ρ二阶去噪方向修正公式: f ~ θ = ( 1 − γ ) f θ ( z ^ n , C , σ n ) + γ f θ ( z ^ n − 1 , C , σ n − 1 ) \tilde{f}_\theta = (1 - \gamma)f_\theta(\hat{z}_n, C, \sigma_n) + \gamma f_\theta(\hat{z}_{n-1}, C, \sigma_{n-1}) f~θ=(1−γ)fθ(z^n,C,σn)+γfθ(z^n−1,C,σn−1)隐变量极速更新公式: z n + 1 = σ n + 1 σ n z ^ n − σ n + 1 ( e − Δ t − 1 ) ⋅ f ~ θ z_{n+1} = \frac{\sigma_{n+1}}{\sigma_n}\hat{z}_n - \sigma_{n+1}(e^{-\Delta t} - 1) \cdot \tilde{f}_\theta zn+1=σnσn+1z^n−σn+1(e−Δt−1)⋅f~θ

多尺度损失函数 (Multi-level loss function)

总损失函数: L = λ ( t ) ⋅ ( λ 1 L p i x e l + λ 2 L p e r c + λ 3 L g r a d ) \mathcal{L} = \lambda(t) \cdot (\lambda_1\mathcal{L}_{pixel} + \lambda_2\mathcal{L}_{perc} + \lambda_3\mathcal{L}_{grad}) L=λ(t)⋅(λ1Lpixel+λ2Lperc+λ3Lgrad)像素级损失函数: L p i x e l = ( ∣ ∣ z 0 − z ^ 0 ∣ ∣ 2 + S A M ( z 0 , z ^ 0 ) ) / 2 \mathcal{L}_{pixel} = (||\mathbf{z}_0 - \hat{\mathbf{z}}_0||^2 + SAM(\mathbf{z}_0, \hat{\mathbf{z}}_0)) / 2 Lpixel=(∣∣z0−z^0∣∣2+SAM(z0,z^0))/2HSI有上百个通道,光谱曲线代表了地面物体的材质,SAM约束,保证光谱曲线不扭曲。 感知损失: L p e r c = ∣ ∣ ϕ V G G ( z ^ 0 ) − ϕ V G G ( z 0 ) ∣ ∣ 2 2 \mathcal{L}_{perc} = ||\phi_{VGG}(\hat{\mathbf{z}}_0) - \phi_{VGG}(\mathbf{z}_0)||_2^2 Lperc=∣∣ϕVGG(z^0)−ϕVGG(z0)∣∣22将预测图和真实图送入预训练的 VGG 网络,在特征层级算误差,保证高级语义特征的相似性。 梯度损失: L g r a d = 1 2 ( ∣ ∣ ∇ x z ^ 0 − ∇ x z 0 ∣ ∣ 1 + ∣ ∣ ∇ y z ^ 0 − ∇ y z 0 ∣ ∣ 1 ) \mathcal{L}_{grad} = \frac{1}{2}(||\nabla_x\hat{z}_0 - \nabla_xz_0||^1 + ||\nabla_y\hat{z}_0 - \nabla_yz_0||^1) Lgrad=21(∣∣∇xz^0−∇xz0∣∣1+∣∣∇yz^0−∇yz0∣∣1)强制模型生成的图像在水平和垂直方向上的梯度与真实图像对齐。 因为 DPM-Solver++ 生成的图像往往具有高对比度特征,梯度损失能有效消除模糊,保证细节锐利。

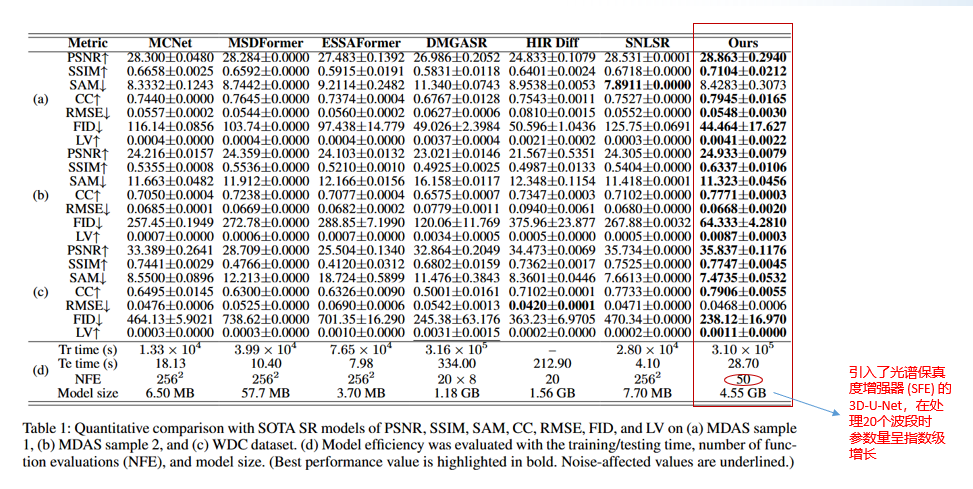

四、实验结果

数据集与评价指标

- 使用数据集:使用了 EeteS 模拟的 EnMap Campaign 数据集(空间分辨率 2.5-4m,242个波段)以及 MDAS 数据集进行训练和验证, WDC数据集进行泛化测试。

- 评价指标:

- 空间保真度:PSNR, SSIM, RMSE

- 光谱准确度:SAM (光谱角映射), CC(互相关)

- 视觉真实度与清晰度:FID, LV

实验

空间换时间的思想 其实普通扩散模型在处理高光谱时,每通道甚至需要 1.3 GB 显存 ; 作者通过小波压缩 (RWA+PCA) 降维,加上对 3D U-Net 的显存优化,已经将训练时的单通道显存需求压低到了 1.0 GB , 并且通过 DPM-Solver++ 极大地缩短了推理时间(仅需 50 步)。这是以“空间换时间/质量”的工程权衡。 附录中作者提供了一个基于 2D U-Net 的轻量级备选版本,它可以在单张 RTX 3090 上以 batch size 16 轻松训练

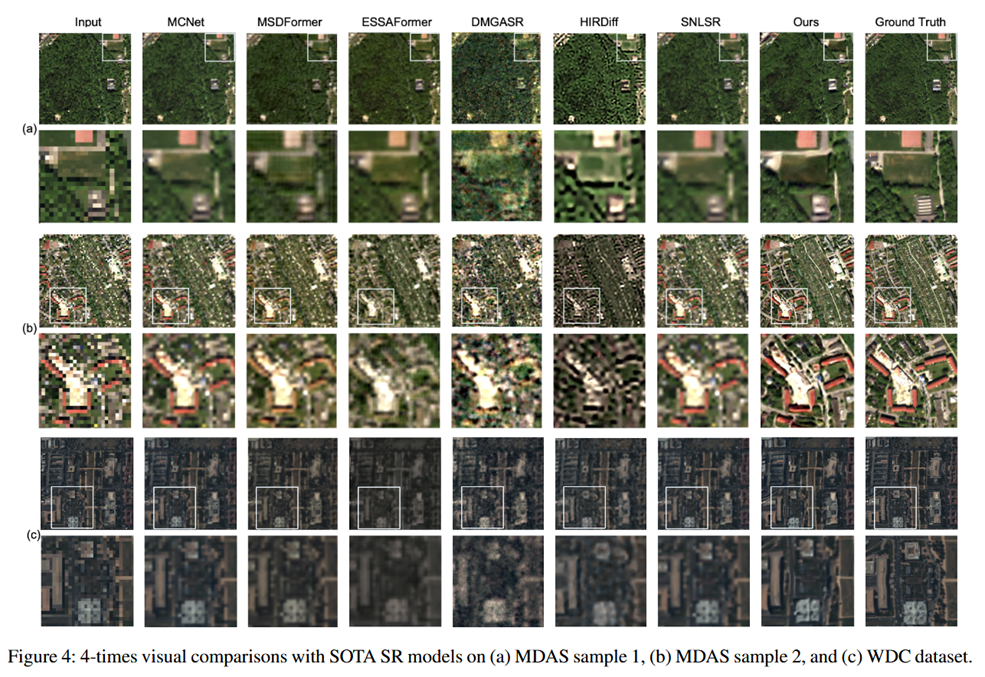

Figure4: GEWDiff 生成的建筑物轮廓极其清晰锐利

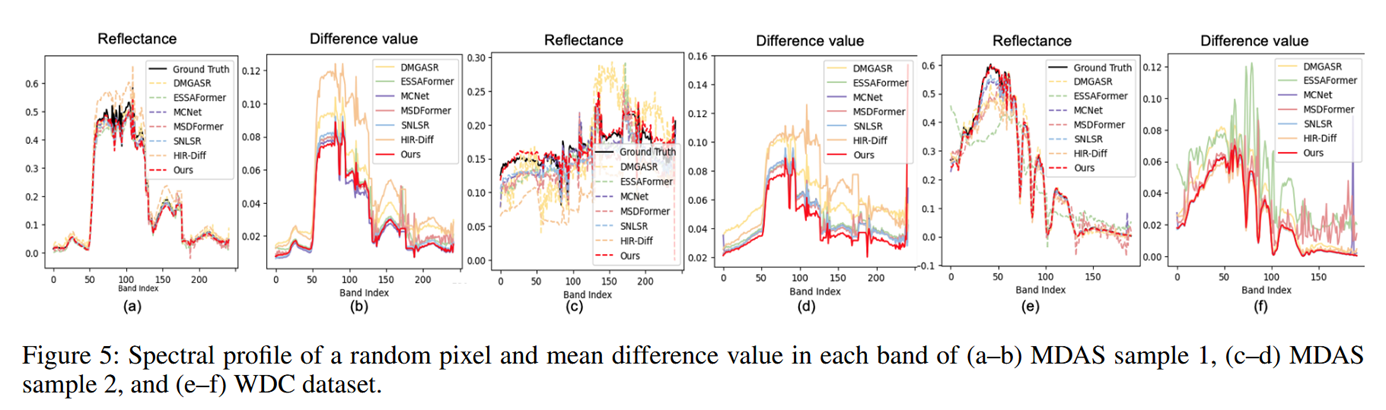

Figure5:展示某个随机像素在 242 个波段上的反射率曲线。 强调深红色的线(GEWDiff)与黑色的线(Ground Truth)贴合得最紧密,误差波动(Difference value)极小 。

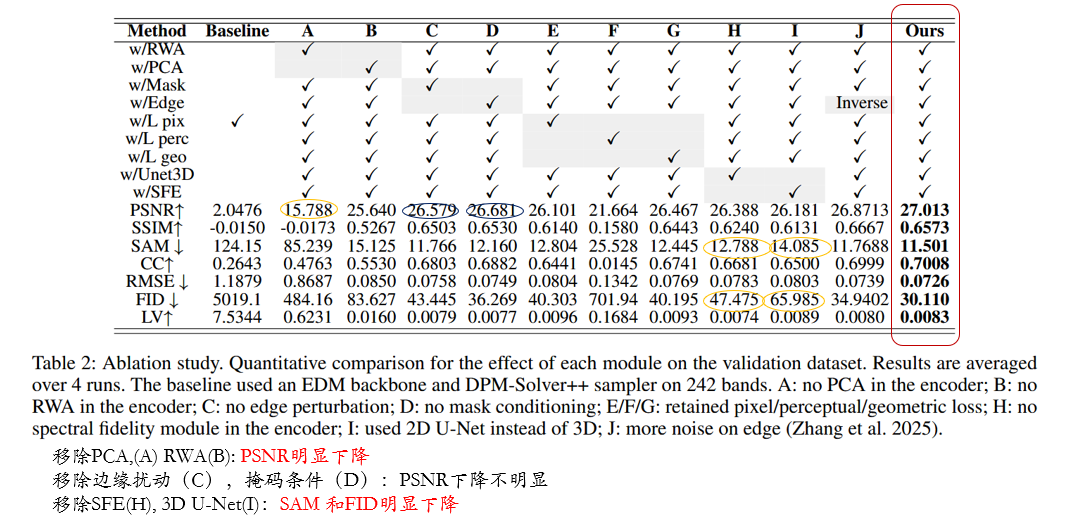

消融实验

- 编解码器的必要性 (A, B): 移除 PCA (A) 导致 PSNR 断崖式下跌至 15.788,移除 RWA (B) 虽然 PSNR 有 25.640,但远不及完整版的 27.013 。这证明了两者结合 (RWA+PCA) 的强大压缩重建能力。

- 几何先验的有效性 (C, D): 移除边缘扰动 © 或掩膜条件 (D),全局指标(如 PSNR)下降不明显(26.579, 26.681) ,但在实际视觉效果上,这两者对保持建筑物边缘不失真起到了决定性作用 。

- 3D U-Net 与 SFE 的威力 (H, I): 将 3D U-Net 降级为 2D U-Net (I) 或移除光谱保真度增强器 SFE (H),会导致光谱角 SAM 和 FID 显著变差 ,证明了 3D 卷积和光谱注意力机制对 HSI 的不可替代性。

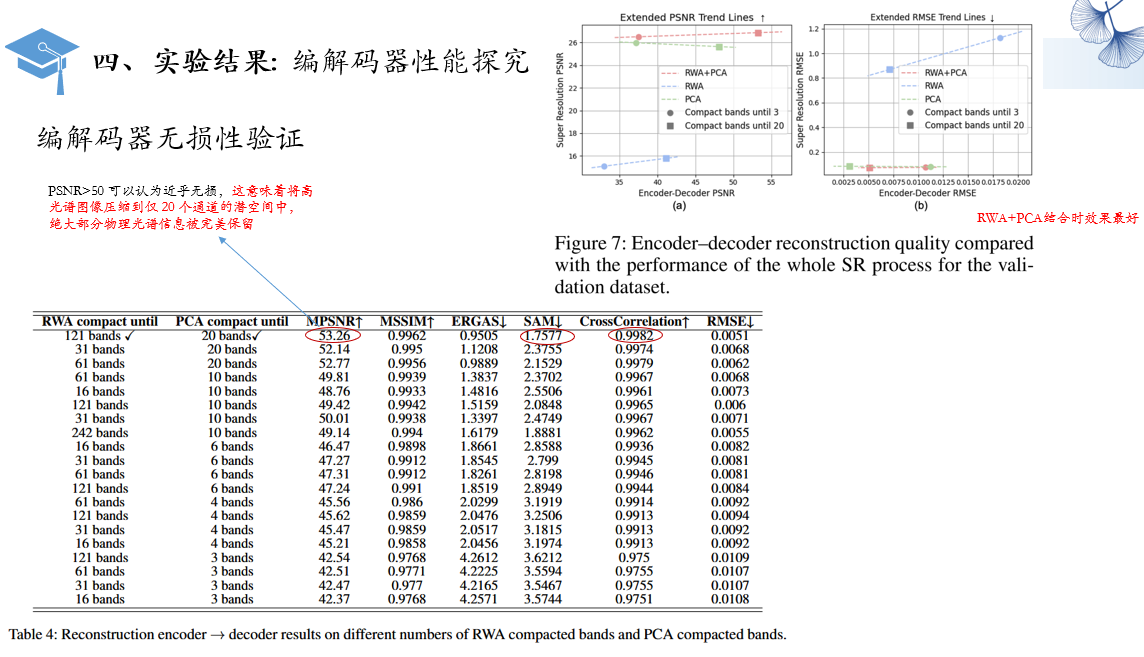

编解码器性能探究

模型鲁棒性实验

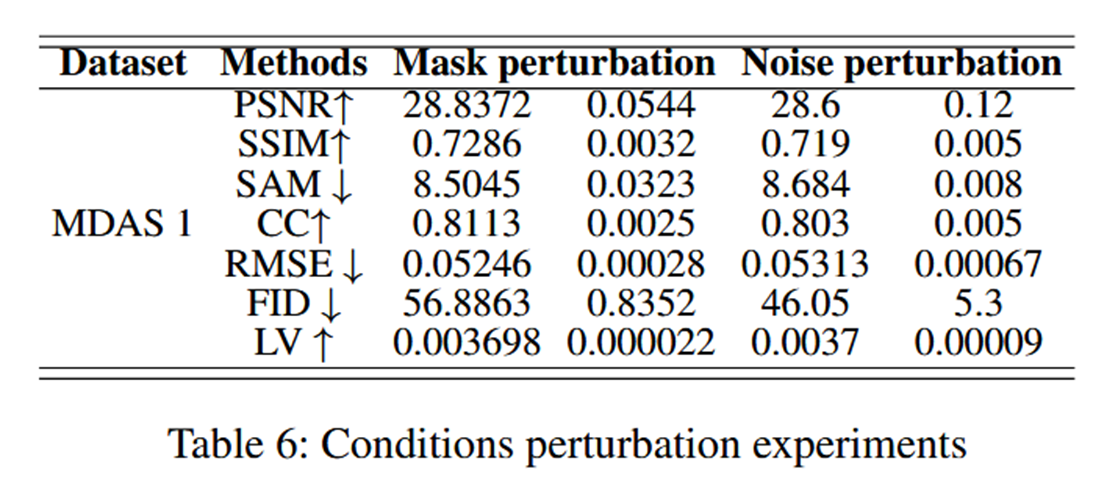

条件扰动实验

- 分割模型误差:随机掩码侵蚀/膨胀 (1-3像素) + 随机空间平移 (±1-2像素)

- 传感器噪声:低分辨率输入添加 1% 高斯噪声

- SSIM, SAM变换很少,PSNR下降在可接受范围内

- 模型可以泛化到理想掩码条件之外,在真实噪声和边界偏差下保持稳定性能

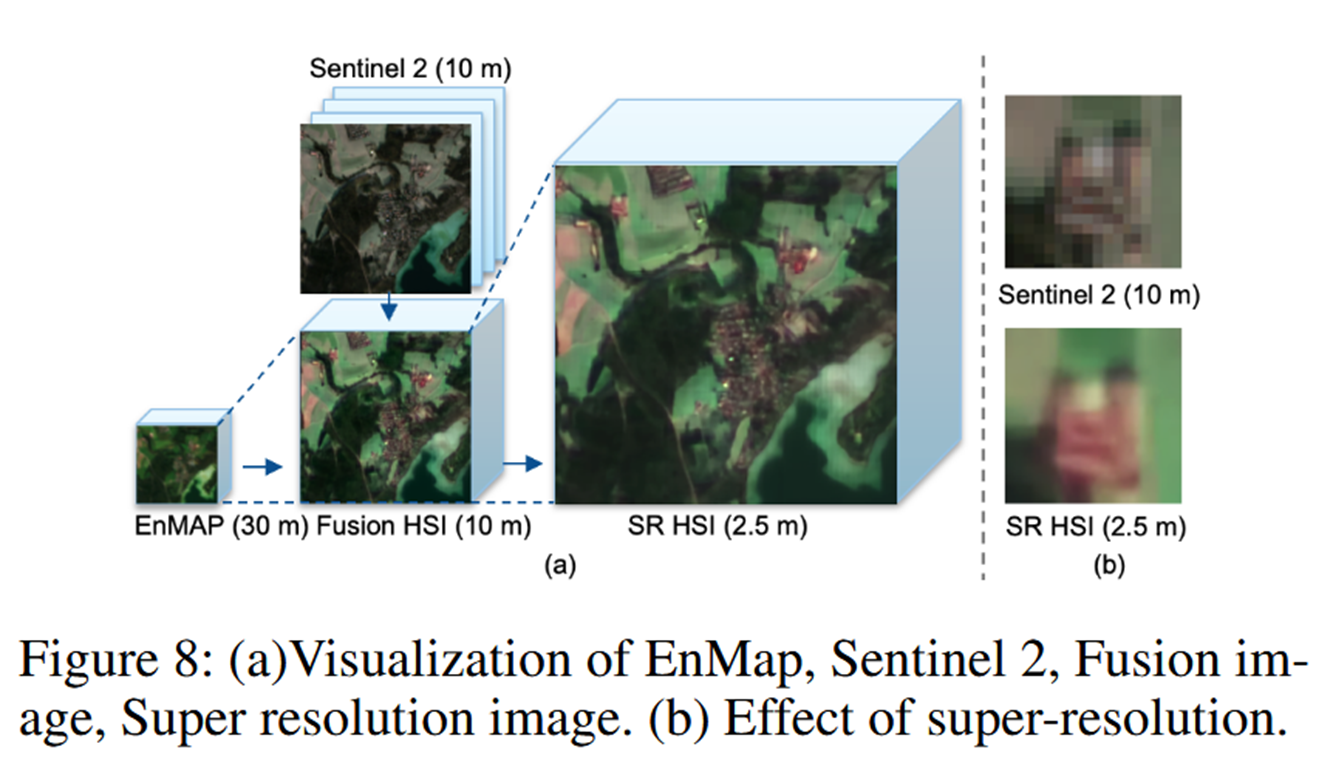

真实卫星图像超分

评价一个遥感基础模型的最终落脚点是其工程实用价值。 GEWDiff 不仅能无缝衔接现有的 EnMAP 与 Sentinel 卫星工作流,更在实际的下游土地覆盖分类任务中,显著提升了总体精度。 展示模型如何将低分辨率的 EnMAP (30m) 与 Sentinel-2 (10m) 融合后,进一步利用 GEWDiff 生成了高达 2.5m 分辨率的超高质高光谱图像 。

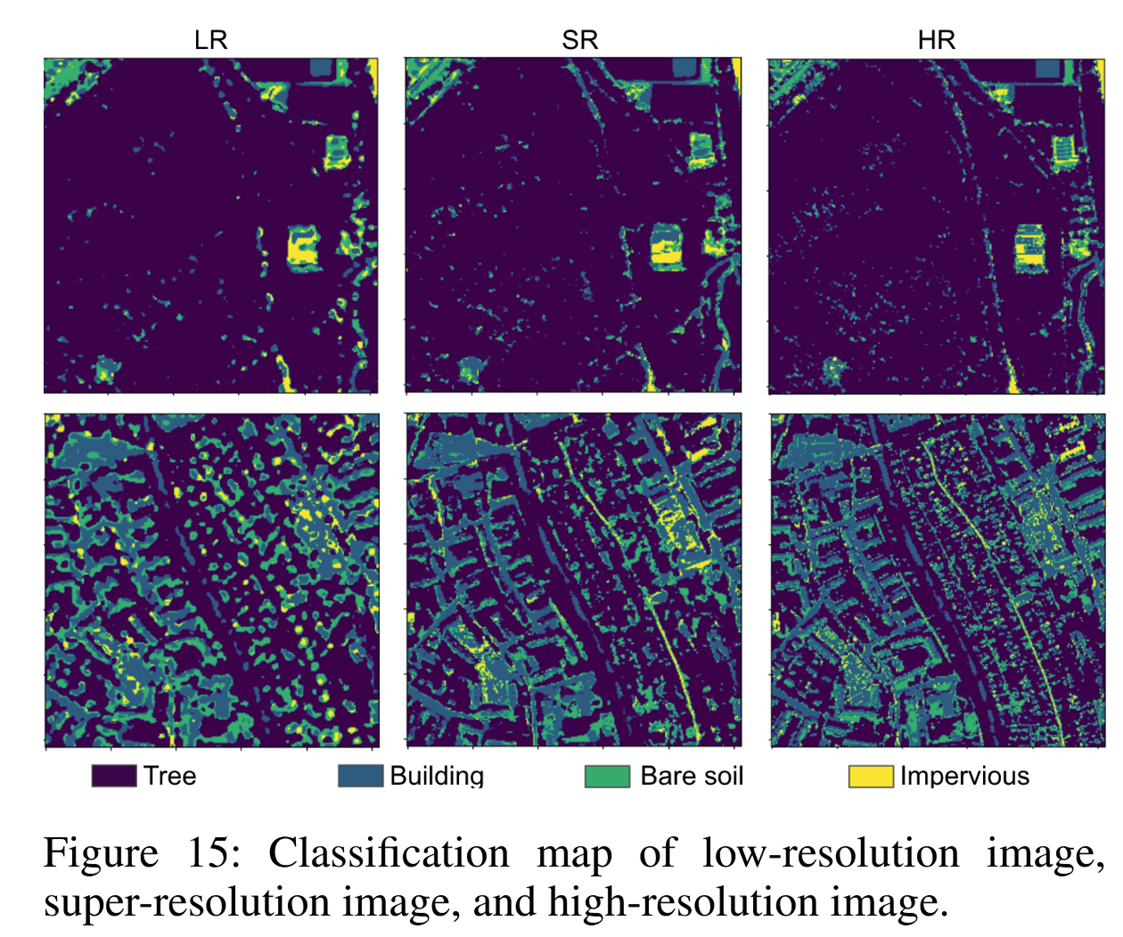

下游地物分类任务

视觉比较揭示了建筑区和植被之间更清晰的区分,以及对不透水结构的更精确的检测。 这些结果表明,GEWDiff不仅对光谱数据进行上采样,而且生成能够区分更多类别特征并提高下游辨别能力的表示 。因此,即使监管信息有限和训练样本数量较少,该模型也可以为实际的遥感应用带来切实的好处。

总结

参考

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)