(Arxiv-2026)Kiwi-Edit:通过指令与参考引导实现通用视频编辑

Kiwi-Edit:通过指令与参考引导实现通用视频编辑

paper title:Kiwi-Edit: Versatile Video Editing via Instruction and Reference Guidance

paper是NUS发布在Arxiv 2026的工作

Code:链接

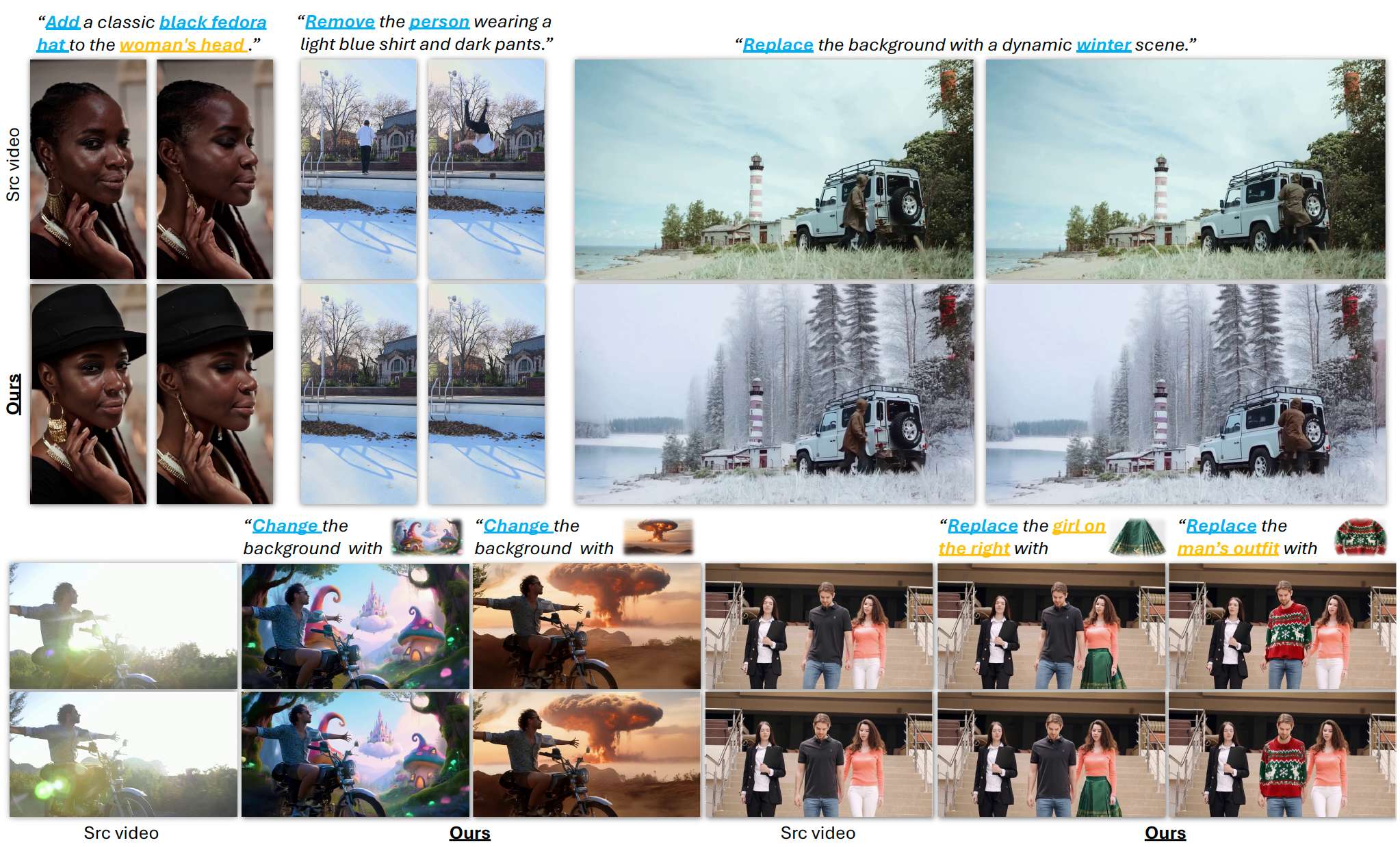

图1。本预览图展示了一组选定的视频编辑任务,包括仅使用指令的场景以及同时使用指令和参考的场景,突出了 RefVIE 卓越的视频编辑能力。

Abstract

基于指令的视频编辑近年来取得了快速进展,但现有方法在精确视觉控制方面仍面临困难,因为自然语言在描述复杂视觉细节时存在先天局限性。尽管基于参考的编辑提供了一种更稳健的解决方案,但其潜力目前受限于高质量成对训练数据的稀缺。为弥补这一不足,我们提出了一种可扩展的数据生成流程,将现有的视频编辑数据对转换为高保真的训练四元组,并利用图像生成模型构建合成的参考支架。基于该流程,我们构建了 RefVIE,这是一个面向指令-参考跟随任务的大规模数据集,并建立了 RefVIE-Bench 用于全面评估。此外,我们提出了一种统一的视频编辑架构 Kiwi-Edit,该架构通过结合可学习查询与潜在视觉特征,实现基于参考的语义引导。通过渐进式多阶段训练策略,我们的模型在指令遵循能力和参考一致性方面均取得了显著提升。大量实验表明,我们的数据与模型架构在可控视频编辑任务上达到了新的最优水平。

1. Introduction

随着社交媒体、娱乐和广告领域对视频内容定制化需求的不断增长,人们对易用视频编辑工具的需求达到了前所未有的水平。近年来,基于指令的视频编辑(Cheng et al., 2023;Bai et al., 2025a;Zi et al., 2025;Wu et al., 2025b;He et al., 2025)取得了显著进展,使用户能够通过自然语言指令修改视频内容。这些方法依托强大的视频扩散模型(Wan et al., 2025;Kong et al., 2024),可以执行多种编辑操作,从局部物体修改到全局风格迁移,同时保持内容一致性和跨帧的时间连贯性。

尽管取得了这些进展,一个关键限制依然存在:对纯文本指令的依赖。自然语言在描述精确视觉细节(例如特定纹理、精确物体身份或细腻风格特征)时本质上具有模糊性。用户通常希望通过视觉示例来表达编辑意图,例如“把这辆车换成这辆跑车”或“应用这幅画的风格”,然而纯文本模型在本质上难以完成这类任务。基于参考的视频编辑通过同时利用文本指令和视觉参考来进行条件生成,为这一问题提供了自然的解决方案。

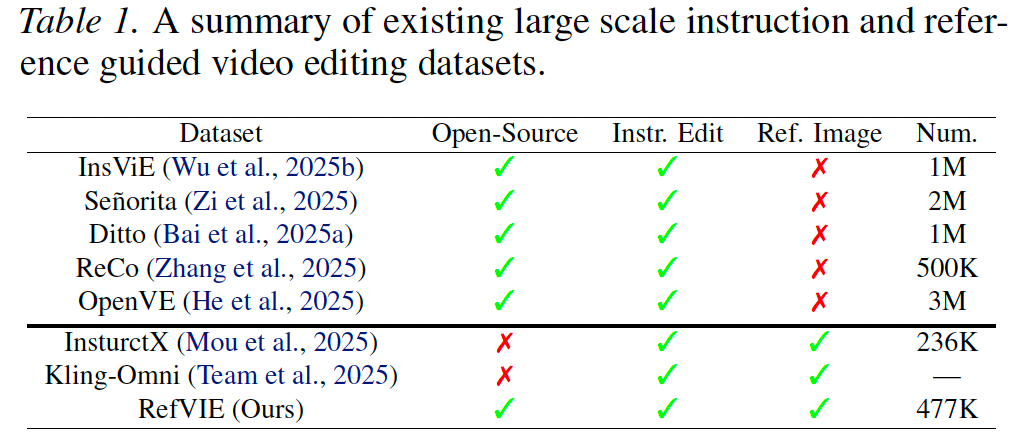

然而,参考引导视频编辑的发展受到数据稀缺的严重制约。训练此类模型需要包含源视频、编辑指令、参考图像和目标视频的高质量四元组,而现有数据集并未以大规模提供这种格式。如表1所示,尽管已有若干大规模基于指令的视频编辑数据集(Wu et al., 2025b;Zi et al., 2025;Bai et al., 2025a;Zhang et al., 2025;He et al., 2025),但均未提供参考图像。少数探索参考引导编辑的工作(Mou et al., 2025;Team et al., 2025)依赖专有数据,无法被更广泛的研究社区获取。这一瓶颈从根本上阻碍了该领域的发展。

为了解决这一问题,我们构建了 RefVIE,这是一个面向指令-参考引导视频编辑的大规模数据集。我们的核心洞察是,强大的预训练图像生成模型可以作为高保真的参考合成器,从而在无需昂贵人工标注的情况下实现可扩展的数据构建。基于现有提供源视频-目标视频对的指令式视频编辑数据集(Bai et al., 2025a;Zhang et al., 2025;He et al., 2025),我们设计了一条自动化流程来合成缺失的参考图像。具体而言,我们利用视觉-语言模型在视频帧中定位编辑区域,随后使用最先进的图像编辑模型生成能够表达目标编辑视觉特征的参考图像。通过严格的质量筛选和去重,我们从初始的370万样本中构建了一个包含47.7万个高质量四元组的数据集。据我们所知,RefVIE 是首个大规模开源的指令-参考引导视频编辑数据资源。

在此数据基础上,我们提出了 Kiwi-Edit,这是一个能够有效融合多模态条件的统一视频编辑框架。该架构将冻结的多模态大语言模型(MLLM)与扩散 Transformer(DiT)相结合,其中 MLLM 处理由源视频帧、文本指令和参考图像交错组成的序列。我们设计了双连接器机制:Query Connector 将可学习查询 token 投影为编辑意图表示,Latent Connector 从参考图像中提取视觉特征。这些连接器生成统一的上下文 token,并通过交叉注意力引导 DiT。为了在保持源视频结构的同时实现灵活的参考引导编辑,我们引入了一种混合潜变量注入策略:源视频特征通过一个随时间步变化的可学习标量进行逐元素相加以保持结构,而参考图像特征则拼接到输入序列中以实现细粒度纹理迁移。三阶段课程式训练策略(MLLM-DiT 对齐、指令调优以及参考引导微调)确保模型稳定收敛。

此外,为了实现严格评估,我们构建了 RefVIE-Bench,这是一个包含100个经过人工验证样本的基准,用于评估参考一致性、指令遵循程度以及时间一致性。

总而言之,我们的贡献包括三个方面:第一,我们构建了 RefVIE,一个包含47.7万个高质量四元组的大规模数据集,覆盖局部编辑和背景替换任务;第二,我们提出了 RefVIE-Bench,这是一个专门用于评估参考相似性、指令准确性和时间一致性的综合基准;第三,我们提出了一种统一的视频编辑模型,通过新颖的 MLLM-DiT 架构设计和多阶段训练策略,在仅指令和指令-参考任务上均实现了当前最优性能。

2. Related Work

2.1. Instruction-based Video Editing

鉴于从零开始训练稳健的文生视频模型存在诸多挑战,早期主流方法(Wu et al., 2023;Cong et al., 2023;Geyer et al., 2023;Kara et al., 2024;Ku et al., 2024;Qi et al., 2023)通常利用预训练文生图(T2I)模型所具备的丰富生成先验。这些方法通常通过微调或反演技术(Song et al., 2020)来实现基于指令的编辑。然而,基于 T2I 的方法在时间一致性方面往往存在不足,并且容易出现反演伪影,尤其是在复杂运动或遮挡情况下更为明显。因此,随着开源视频扩散模型(Hong et al., 2022;Kong et al., 2024;Wan et al., 2025)的出现,近期研究逐渐转向使用原生视频模型作为骨干,以获得更好的运动保真度。为支持基于指令的训练,InsV2V(Cheng et al., 2023)通过利用 InstructPix2Pix(Brooks et al., 2023)合成配对训练数据,开创了该方向。为解决数据稀缺这一核心问题,后续工作(Bai et al., 2025a;Zi et al., 2025;Wu et al., 2025b)致力于构建大规模合成数据集。例如,Senorita-2M(Zi et al., 2025)通过专家混合流水线收集编辑对,而 Ditto(Bai et al., 2025a)利用编辑后的关键帧和深度图生成编辑视频。近年来,为进一步提升指令理解能力和语义建模能力,Omni-Video(Tan et al., 2025)和 OpenVEEdit(He et al., 2025)将视觉-语言模型(VLM)引入视频编辑框架中。

2.2. Reference-Guided Video Editing and Dataset

仅依赖自然语言提示往往无法充分表达视觉想象中的细微差别。文本在描述精确的空间关系、具体的视觉参照以及时间动态方面本质上存在局限,这在用户意图与模型输出之间造成了鸿沟。为了解决这一问题,近期工作(Mou et al., 2025;Wei et al., 2025;Team et al., 2025)引入参考图像与文本指令相结合,以实现更精确的视频编辑。具体而言,InstructX(Mou et al., 2025)和 Kling-Omni(Team et al., 2025)等方法将多模态输入送入多模态大语言模型(MLLM),以提取统一表示供生成模块使用。然而,尽管这些方法表现出色,它们在数据生成上高度依赖专有的内部模型,并且需要大量人工验证以构建高质量参考数据。相关视频编辑数据集的总结见表 1。在本工作中,我们通过提出 RefVIE,旨在将这一能力普及化。RefVIE 是首个面向指令-参考引导视频编辑的大规模开源数据集。通过提供经过严格筛选和精心构建的数据资源,我们为研究社区提供了关键支撑,使得能够开发出超越纯文本控制局限的综合视频编辑模型。

3. RefVIE Dataset and Benchmark

3.1. Scalable Data Generation Pipeline

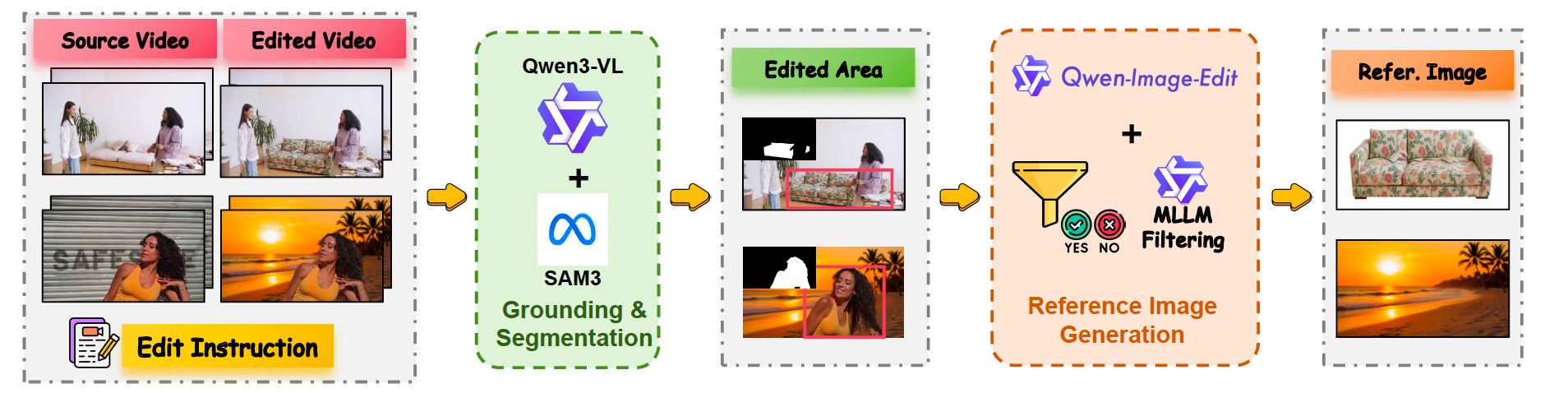

图2。参考图像合成流程。我们首先使用专门的定位与分割模型,在目标视频帧中定位编辑区域。随后,我们利用专门的图像编辑模型合成高质量参考图像,使其在身份特征上与编辑指令保持一致。

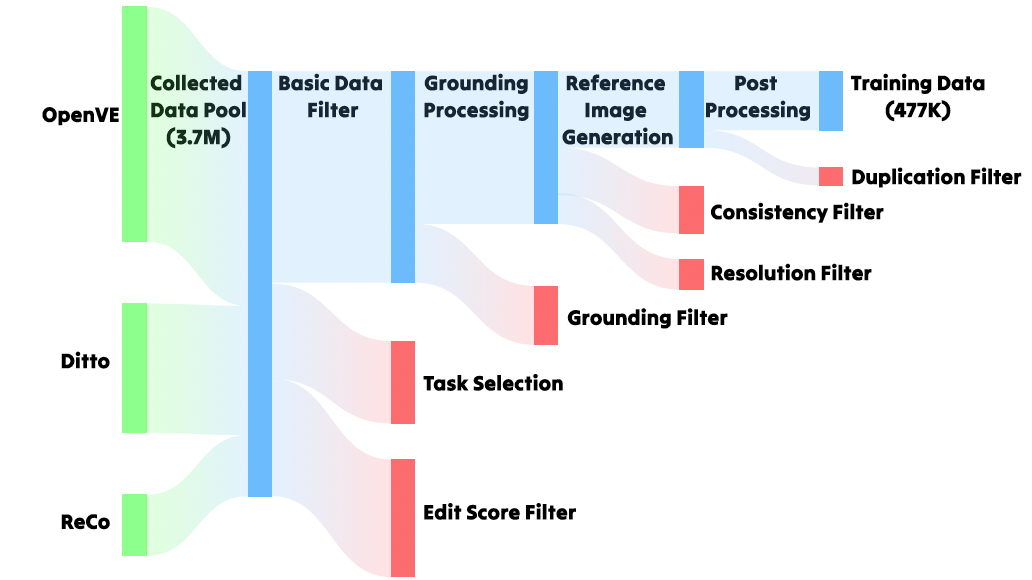

在推动参考引导视频编辑的发展过程中,一个主要瓶颈在于高质量训练四元组 ( V s r c , T i n s t , I r e f , V t g t ) (V_{src}, T_{inst}, I_{ref}, V_{tgt}) (Vsrc,Tinst,Iref,Vtgt) 的稀缺性。对此类四元组数据进行人工整理成本极高。为了解决这一问题,我们提出了一种可扩展的自动化流程,从现有的基于指令的视频编辑三元组 ( V s r c , T i n s t , V t g t ) (V_{src}, T_{inst}, V_{tgt}) (Vsrc,Tinst,Vtgt) 中合成参考图像,从而将其扩展为所需的四元组。如图 3 所示,我们的流程通过四个阶段处理来自公开数据集的大规模 370 万原始样本池。

图3。RefVIE 数据构建流程。我们将 370 万原始样本经过四个阶段处理:数据源聚合与筛选、定位与分割、参考图像合成以及质量控制,最终得到 47.7 万个高质量四元组。

阶段 1:数据源聚合与筛选。我们通过聚合三个开源的指令视频编辑数据集来初始化数据池:Ditto-1M(Bai et al., 2025a)、ReCo(Zhang et al., 2025)和 OpenVE-3M(He et al., 2025)。为确保训练质量,我们使用 EditScore(Luo et al., 2025)对样本进行筛选。基于以人为中心的初步研究,我们在文本引导指令微调中丢弃 EditScore 低于 6 的样本。对于参考引导生成任务,我们采用更严格的阈值(EditScore > 8),并明确选择被归类为局部修改(Local Modification)或背景替换(Background Replacement)的任务,因为这些任务最能从视觉参考中受益。

阶段 2:定位与分割。精确的空间定位对于生成一致的参考至关重要。我们使用 Qwen3-VL-32B(Bai et al., 2025b)来解析编辑指令,并在目标视频的第一帧中定位感兴趣区域,因为目标视频包含所需的编辑结果,我们从中提取参考。对于背景变化任务,模型定位前景对象,以便在下一阶段将其移除,从而仅保留新的背景作为参考。对于局部编辑任务,模型定位被编辑对象,以便将其提取为参考。这些粗略的边界框坐标随后通过 SAM3(Carion et al., 2025)进行细化,以生成像素级精确的分割掩码。未通过定位或分割检查的样本对将被丢弃。

阶段 3:参考图像合成。基于分割得到的区域,我们使用 Qwen-Image-Edit-2511(Wu et al., 2025a)合成参考图像,如图 2 所示。对于背景任务,我们提取并移除前景对象,然后对该区域进行修复(inpaint),生成干净的背景图像作为参考。对于局部编辑任务,我们提取目标对象,并将其放置在一个干净背景上,周围留有最小空间,从而生成一个紧凑裁剪的参考图像,突出编辑对象的外观。为保证数据的鲁棒性,我们还会过滤掉具有极端长宽比或分辨率的生成图像。

阶段 4:质量控制与后处理。在最后阶段,我们通过使用多模态大语言模型(MLLM)进行语义对齐验证,确保合成的参考图像与目标视频中的编辑内容一致,从而过滤掉低质量生成结果。此外,为防止数据泄漏和冗余,我们从参考图像中提取 CLIP(Radford et al., 2021)特征并执行全局去重。通过这一严格流程,我们将初始的 370 万样本池精炼为一个包含 47.7 万高质量指令-参考-视频四元组的子集。各筛选阶段的详细划分如图 3 所示。

3.2. Dataset Statistics

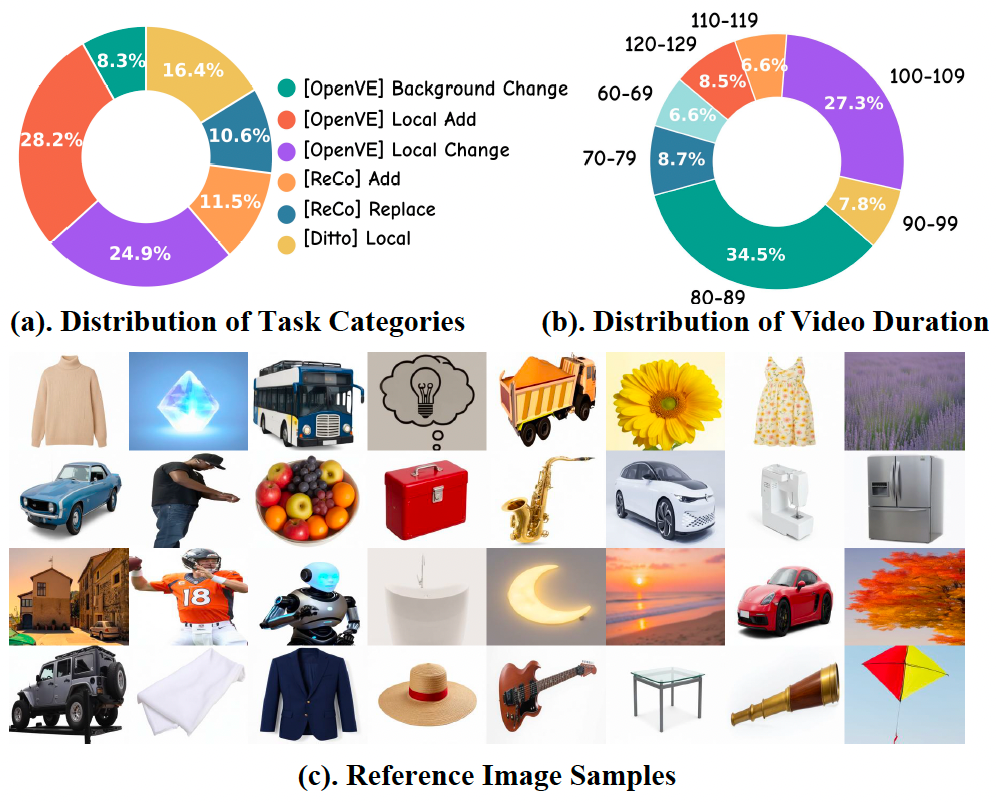

我们最终构建的数据集 RefVIE 是目前规模最大的开源参考引导视频编辑数据集,弥合了学术资源与工业能力之间的差距。图 4 总结了该数据集的统计信息。如图 4(a) 所示,任务分布在局部对象添加、替换以及背景变化之间保持良好平衡,从而确保训练得到的模型能够泛化到不同编辑场景,而不是对单一任务类型过拟合。图 4(b) 展示了视频时长分布。大多数片段包含 80 到 110 帧,为模型学习长时序运动一致性以及处理复杂物体运动提供了充足的时间上下文。图 4© 展示了参考图像示例,体现了视觉内容的多样性,包括不同的对象、纹理和背景。更多可视化案例见补充材料。

图4。RefVIE 的统计信息与样例可视化。(a) 编辑任务类型的分布。(b) 视频时长的分布。© 不同编辑类别下的参考图像示例。

3.3. Benchmark and Evaluation

RefVIE-Bench。现有基准主要聚焦于文本-视频对齐,忽视了视觉参考一致性这一关键维度。为严格评估这一能力,我们构建了 RefVIE-Bench,其中包含 110 个经过人工验证的三元组 ( V s r c , I r e f , T i n s ) (V_{src}, I_{ref}, T_{ins}) (Vsrc,Iref,Tins)。不同于我们可扩展的合成训练数据,这些基准样本经过严格的三阶段人工验证流程,以确保高质量和多样性。该基准评估两类特定能力:主体参考(Subject Reference,70 个样本)和背景替换(Background Replacement,40 个样本)。对目标修改任务分配更多样本,反映了其更广泛的应用范围,涵盖车辆、动物、服装和家具等多种对象类别,每类都具有不同的视觉属性。相比之下,背景替换是一类更统一的任务,主要关注在保持前景动态的同时改变环境。

评估指标。传统指标如 CLIP 分数仅能捕捉高层语义相似性,而 FID 衡量的是分布层面的统计特性,而非单样本质量。两者都无法评估特定纹理是否被保留,或编辑指令是否被正确执行。为此,我们采用最先进的多模态大语言模型(MLLM)(Gemini3(Comanici et al., 2025))作为自动评审器,在三个维度上对每个结果进行 1 到 5 分的评分。对于主体参考任务,我们评估身份一致性(Identity Consistency)、时间一致性(Temporal Fidelity)以及物理融合(Physical Integration,例如跟踪、阴影);而对于背景替换任务,我们评估参考一致性(Reference Fidelity)、抠图质量(Matting Quality)以及视觉协调性(Visual Harmony,例如透视、光照)。为确保逻辑上的鲁棒性,我们引入分层约束,使时间和物理相关评分受主要身份评分的上限约束,从而避免模型对时间稳定但语义错误的编辑给予高分。

4. Methodology

4.1. Architecture Design

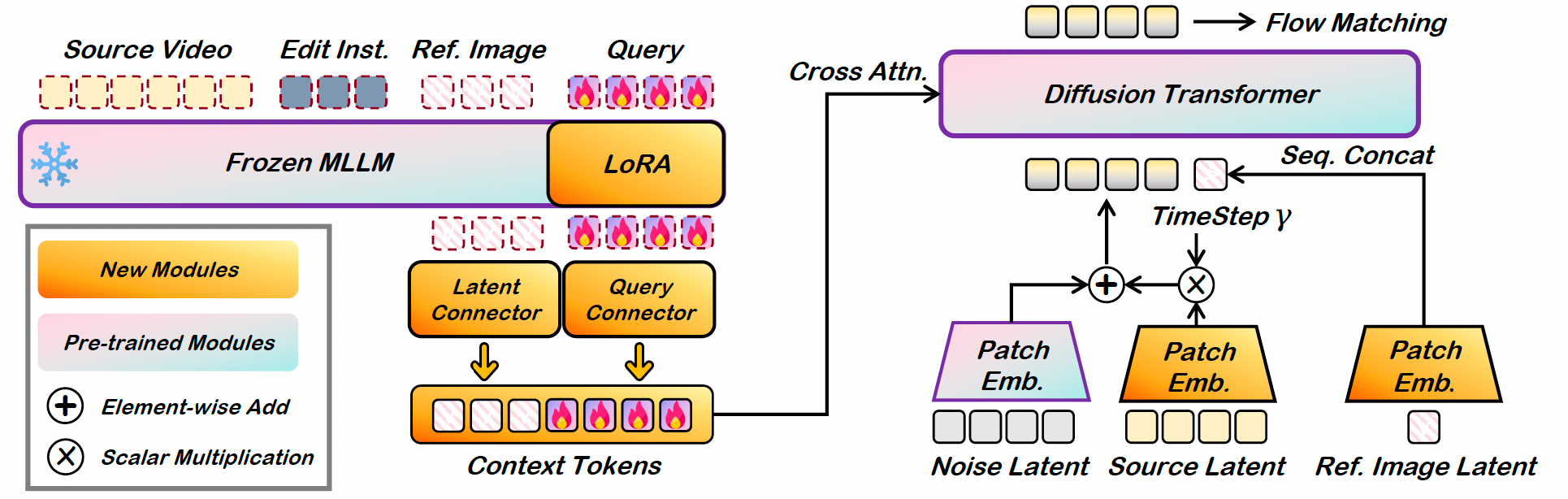

图 5。我们统一编辑框架的概览。我们集成了一个冻结的 MLLM(Qwen2.5-VL-3B)来编码多模态指令,并通过用于查询和参考潜变量的双可学习投影器,将语义条件注入到预训练的扩散 Transformer(Wan2.2-TI2V-5B)中。为了保持源视频的一致性,我们在 DiT 内采用了一种混合注入策略:源视频特征以逐元素相加的方式注入,而参考图像特征则拼接到输入序列中。

如图 5 所示,我们的框架由两个主要组件构成:用于语义理解的多模态大语言模型(MLLM)以及用于视频生成的扩散 Transformer(DiT)。MLLM 将多模态输入(源视频、指令以及可选的参考图像)编码为条件信号,从而引导 DiT 生成编辑后的视频。

通过 MLLM 进行语义条件建模。我们采用 Qwen2.5-VL-3B(Bai et al., 2025c)作为 MLLM 主干。基础模型权重保持冻结,并引入轻量级低秩适配(Low-Rank Adaptation,Hu et al., 2022)(LoRA)模块,使其适配视频编辑任务,同时不破坏其预训练知识。MLLM 处理由源视频帧、文本编辑指令以及可选参考图像组成的交错序列。

从其输出中,我们通过两条专门路径提取条件特征:

指令查询(Instructional Queries):我们使用一组可学习的查询 token(图像任务为 256,视频编辑为 512,参考任务为 768)来提取编辑意图(例如“将天空变成红色”)。这些查询通过一个查询连接器(Query Connector,MLP)进行投影,以匹配 DiT 的特征维度。

参考潜变量(Reference Latents):对于需要特定视觉引导的任务,我们提取与参考图像对应的视觉 token,并通过一个独立的潜变量连接器(Latent Connector)进行投影。

这两个连接器的输出被拼接,形成统一的上下文 token 序列(Context Tokens),作为 DiT 交叉注意力层中的 key/value,对生成过程的语义内容进行引导。

通过潜变量注入进行结构条件建模。虽然 MLLM 提供了语义层面的引导,但要精确保留源视频的结构布局,还需要更直接的信号。我们发现标准的交叉注意力机制不足以实现细粒度的空间结构保持。因此,我们引入了一种混合注入策略。

源视频控制(逐元素注入)。为了保留时空结构,我们使用 VAE 将源视频帧编码到潜空间中。这些潜变量通过一个零初始化的 PatchEmbed 层进行处理。如图 5 所示,我们不采用将这些特征拼接的方式(实验表明这会导致训练不稳定),而是将其逐元素加到噪声潜变量 z t z_t zt 上。关键在于,这一加法由一个可学习的、依赖时间步的标量 γ ( t ) \gamma(t) γ(t) 进行调制:

z t ′ = PatchEmbed ( z t ) + γ ( t ) ⋅ PatchEmbed s r c ( VAE ( x s r c ) ) z'_t = \text{PatchEmbed}(z_t) + \gamma(t) \cdot \text{PatchEmbed}_{src}(\text{VAE}(x_{src})) zt′=PatchEmbed(zt)+γ(t)⋅PatchEmbedsrc(VAE(xsrc))

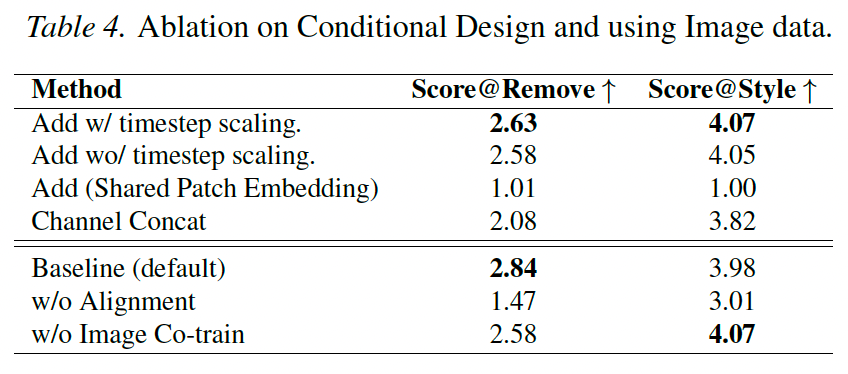

我们的消融实验表明,这种时间步缩放至关重要;移除它会导致模型忽略源结构细节,而将逐元素相加替换为通道拼接会降低可编辑性(见表 4)。

参考图像控制(序列拼接)。相反地,为了增强对参考对象的高保真度,我们将参考图像视为视觉上下文的扩展。参考图像 x r e f x_{ref} xref 经过 patch 嵌入后,被拼接到 DiT 的输入序列中。这有效扩展了时空注意力窗口,使模型能够直接从参考中“复制”纹理细节。

训练目标。我们采用流匹配(Flow Matching)(Lipman et al., 2022)作为训练目标,通过最小化预测速度场 v θ v_\theta vθ 与真实漂移之间的均方误差:

L f l o w = E t , z 0 , z 1 , c [ ∥ v θ ( z t , t , c ) − ( z 1 − z 0 ) ∥ 2 ] \mathcal{L}_{flow} = \mathbb{E}_{t, z_0, z_1, c} \left[ \left\| v_\theta(z_t, t, c) - (z_1 - z_0) \right\|^2 \right] Lflow=Et,z0,z1,c[∥vθ(zt,t,c)−(z1−z0)∥2]

其中 z 1 z_1 z1 表示目标视频的潜变量, z 0 z_0 z0 为标准高斯噪声, c c c 表示多模态条件信号。

4.2. Training Curriculum

训练一个具有数十亿参数并带有多模态条件的视频生成模型在计算上开销巨大,并且容易遇到优化困难。为了确保稳定收敛和有效对齐,我们采用如下多阶段渐进式训练策略:

阶段 1:MLLM-DiT 对齐。在初始阶段,我们冻结 MLLM 的基础权重和 DiT 主干,仅训练桥接组件:LoRA 适配器、Query/Latent 连接器以及可学习的查询 token。该阶段使用基于文本的编辑三元组 ( V s r c , T i n s t , V t g t ) (V_{src}, T_{inst}, V_{tgt}) (Vsrc,Tinst,Vtgt),重点在于建立语义映射,确保连接器能够将 MLLM 表示转换为 DiT 交叉注意力模块可理解的形式。在这一阶段,训练数据完全由高质量图像编辑任务组成,来源于 GPT-Image-Edit(Wang et al., 2025)和 NHR-Edit(Kuprashevich et al., 2025),它们为语义空间对齐提供了高效途径(Pan et al., 2025)。

阶段 2:指令微调。随后我们解冻 DiT 层以进行联合优化。模型继续在大规模指令图像与视频编辑数据集上的文本编辑三元组 ( V s r c , T i n s t , V t g t ) (V_{src}, T_{inst}, V_{tgt}) (Vsrc,Tinst,Vtgt) 上训练。本阶段的训练数据将阶段 1 的图像数据与我们整理的指令视频编辑子集(使用 EditScore ≥ 6 \geq 6 ≥6 筛选,详见第 3.1 节)结合起来。该阶段对于学习通用编辑能力(例如对象移除、风格迁移)至关重要。为提高效率,我们采用分辨率课程学习策略,从低分辨率视频片段(480p)开始训练,并逐步提升到更高分辨率(720p)。

阶段 3:参考引导微调。在最终阶段,我们引入构建的 RefVIE 数据集,以实现精确的视觉控制。训练数据由阶段 2 的指令编辑数据与新的参考引导四元组 ( V s r c , T i n s t , I r e f , V t g t ) (V_{src}, T_{inst}, I_{ref}, V_{tgt}) (Vsrc,Tinst,Iref,Vtgt) 混合组成。该阶段提升模型利用参考 token 进行细粒度纹理迁移的能力,确保生成结果与用户提供的视觉示例一致。在所有训练阶段中,我们将从视频中采样的最大帧数设为 81。

5. Experiments

5.1. Implementation Details

对于图像数据,我们使用来自 NHR-Edit(Kuprashevich et al., 2025)和 GPT-Image-Edit(Wang et al., 2025)的三元组数据集(指令、源图像、编辑后图像)。我们采用预训练的 Wan-TI2V-5B 作为 DiT 主干,并在开源数据集以及我们提出的参考数据上进行微调,共训练 12K 步。学习率设置为 2 × 10 − 5 2 \times 10^{-5} 2×10−5,全局 batch size 为 128,并使用梯度累积。

在阶段 2 中,我们以 1:1 的比例采样图像数据和指令视频数据,先在 360K 像素分辨率下训练,然后在 960K 像素分辨率下训练,共计 10K 步。

在阶段 3 中,我们以 2:1:1 的比例采样图像数据、指令视频数据以及带参考图像的视频数据,训练 10K 步。更多细节请参见补充材料。

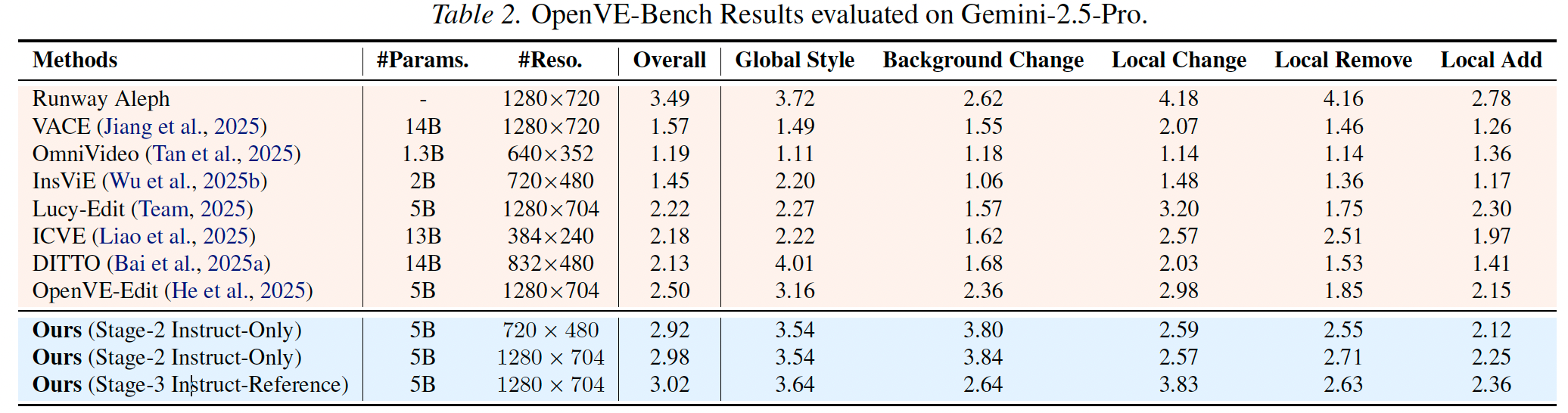

5.2. Main Results

指令编辑。我们在 OpenVEBenchmark(He et al., 2025)上将我们的模型与现有最先进的开源模型进行比较,包括 VACE(Jiang et al., 2025)、OmniVideo(Tan et al., 2025)、InsViE(Wu et al., 2025b)、ICVE(Liao et al., 2025)、Lucy-Edit(Team, 2025)和 DITTO(Bai et al., 2025a),以及闭源模型 Runway Aleph。评估设置遵循原论文中的标准设置。如表 1 所示,我们的方法在所有开源基线上取得最佳表现,总体得分为 3.02,显著超过此前最优的 OpenVE-Edit(2.50)。值得注意的是,我们的模型在背景变化任务中表现尤为突出,取得了 3.84 的得分,甚至超过了专有模型 Runway Aleph(2.62)。此外,将推理分辨率提升至 1280 × 704 1280 \times 704 1280×704 并应用训练课程策略后,在所有指标上均获得了稳定的性能提升。有趣的是,第 3 阶段提升了局部编辑能力,但降低了背景编辑性能,我们将其归因于数据集对局部编辑的偏置较强。

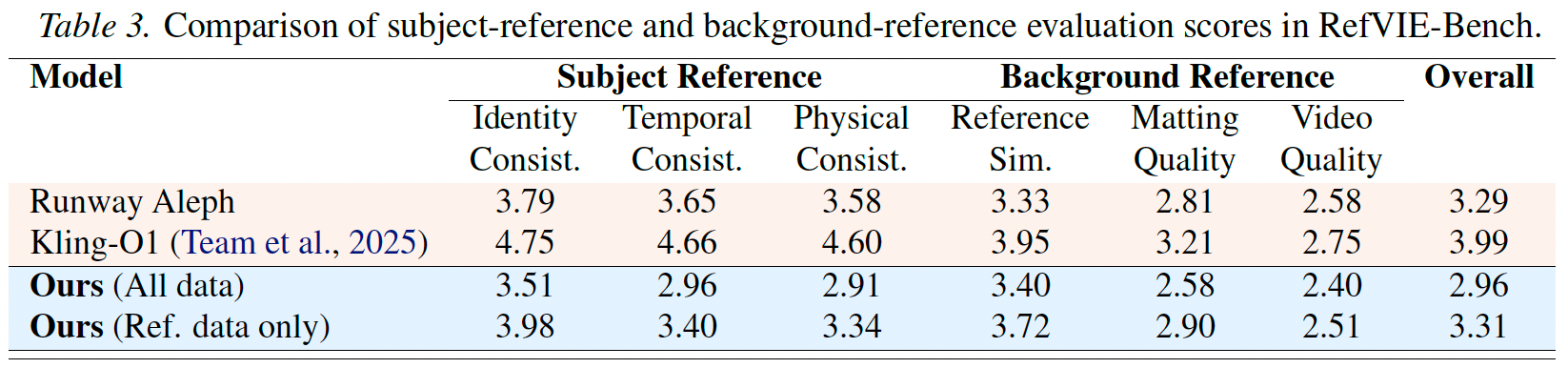

指令与参考引导编辑。我们将方法与领先的商业视频生成模型进行比较,具体包括 Runway Aleph 和 Kling-O1(Team et al., 2025)。如表 3 所示,在使用精心构建的 RefVIE 数据集训练后,我们的模型取得了 3.31 的总体得分,略高于 Runway Aleph(3.29)。值得注意的是,我们的模型在身份一致性(3.98)和参考相似性(3.72)方面表现出竞争力。尽管闭源的 Kling-O1 模型取得了更高的绝对分数,这很可能归因于其显著更大的参数规模以及专有训练数据,我们的方法仍然建立了开源参考引导视频编辑领域的最新最优基线。

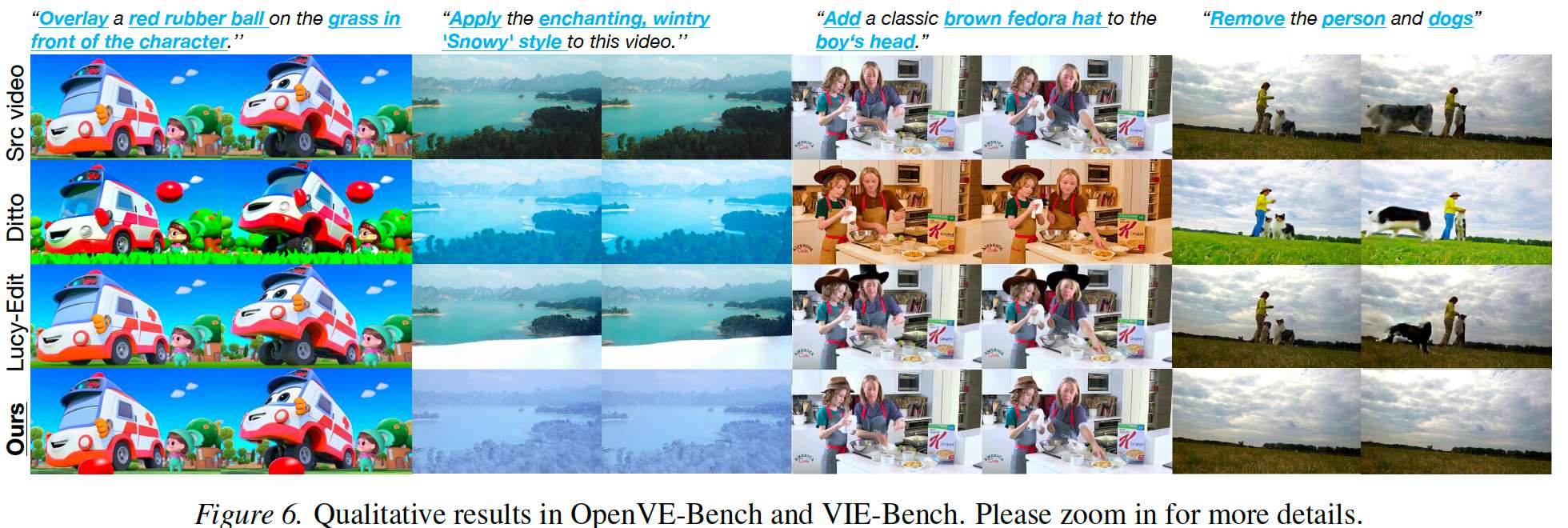

5.3. Qualitative Results

图 7. 我们提出的 RefVIE-Bench 上的定性结果。请放大查看以获取更多细节。

图 6 和图 7 展示了在多种编辑任务上的可视化对比。我们的模型在指令遵循和参考保持方面表现更优。指令遵循:我们的模型能够准确捕捉来自源视频和参考图像的视觉语义。例如,它能够正确定位帽子(图 6,第 3 列)以及桌子(图 7,第 2 行)。参考一致性:如图 7 第 3 行中红色边界框所示,我们的方法即使在背景风格发生剧烈变化时,仍然能够保持较高的主体一致性。更多定性结果见附录和补充材料。

5.4. Ablation Studies

条件设计。我们针对源视频输入的条件建模结构进行了消融实验,对比了通道拼接(channel concatenation)与特征相加(feature addition)两种策略。如表 4 所示,通道拼接表现较差,而共享 patch embedding 会显著降低性能(降至 1.01),验证了独立特征提取的必要性。“带时间步缩放的相加”(Add w/ timestep scaling)配置效果最佳,在包括移除(2.63)和添加(2.01)在内的指令任务上均优于基线。

训练课程。我们通过消融实验验证了渐进式训练阶段的必要性,结果见表 4。首先,跳过对齐阶段会导致性能灾难性下降,这表明在 MLLM 与 DiT 之间建立粗粒度语义映射是实现有效指令跟随的前提。其次,移除图像协同训练会降低结构性任务的表现(Removal 从 2.84 降至 2.58)。这说明仅使用视频数据训练虽然可以获得较高的风格得分(4.07),但缺乏图像编辑数据提供的细粒度空间监督,而这对于复杂的局部编辑至关重要。

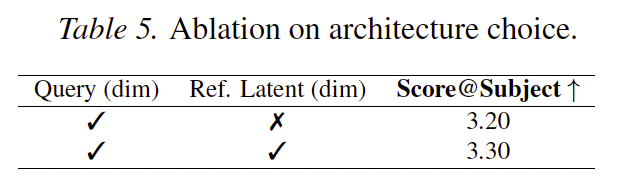

参考条件设计。为了验证双连接器设计的有效性,我们分析了 MLLM 中不同条件注入路径的影响。如表 5 所示,仅依赖可学习的指令查询可以得到 3.20 的基线得分。虽然查询能够有效捕捉高层编辑意图,但在保留细粒度视觉细节方面存在不足。通过引入参考潜变量特征(Reference Latent),并通过 Latent Connector 将其注入,我们能够显式地将参考图像中的稠密语义先验融入上下文。这一改进将得分提升至 3.30,表明将稀疏的指令查询与稠密的视觉潜变量相结合,对于实现高保真的参考一致性至关重要。

6. Conclusion

本工作旨在解决参考引导视频编辑中高质量数据严重稀缺这一关键问题。我们提出了一条可扩展的数据合成流程,用于构建 RefVIE,将现有视频对转换为丰富的指令-参考四元组,并建立了 RefVIE-Bench,以标准化该领域的评测。基于这些数据,我们提出的统一编辑模型 Kiwi-Edit 实现了当前最优性能,有效弥合了用户意图与视频生成结果之间的差距。我们相信,这种以数据为中心的方法为实现更可控、更易用的视频内容创作奠定了坚实基础。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)