从“养虾”到“养家”:OpenClaw 最佳实践指南,让你的 AI 助理真正“动手”干活

2026 年的春天,AI 圈最火的话题不再是“大模型又参数量破纪录了”,而是“你养龙虾了吗?”

从两会会场到街头巷尾,OpenClaw(俗称“龙虾”)以一种燎原之势席卷而来。如果说 DeepSeek 让我们认识了什么是大模型,那么 OpenClaw 则真正让我们看到了智能体的模样——它不再只是动动嘴皮子的聊天机器人,而是拥有了“手和脚”,能直接操控电脑、执行命令、替你干活的数字员工 。

然而,这场全民“养虾”热也迅速呈现出“冰火两重天”的局面:一边是大厂竞相入局,推出 ArkClaw、WorkBuddy 等产品;另一边却是“第一批养虾人开始花钱卸载”的话题冲上热搜。Token 消耗如流水、部署门槛高、权限风险大……这些问题让不少尝鲜者望而却步 。

那么,如何驯服这只“龙虾”,让它从“吞金兽”变成真正的生产力工具?本文将结合最新的行业洞察与技术实践,为你整理一份 OpenClaw 的最佳实践指南。

一、转变观念:从“对话”模式切换到“执行”模式

大多数用户只用到了 OpenClaw 10% 的能力,还停留在“聊天交互”的层面。高阶用法的核心,在于把对话模式切换为执行模式 。

这意味着你需要:

-

少聊天,多任务:直接下达明确的操作指令,而非模棱两可的询问。

-

少手动,多自动化:利用它的心跳机制和定时任务,让它成为 7x24 小时待命的助理。

-

少混乱,多隔离:通过多 Agent 配置,将不同任务分配给不同的“子龙虾”,避免互相干扰。

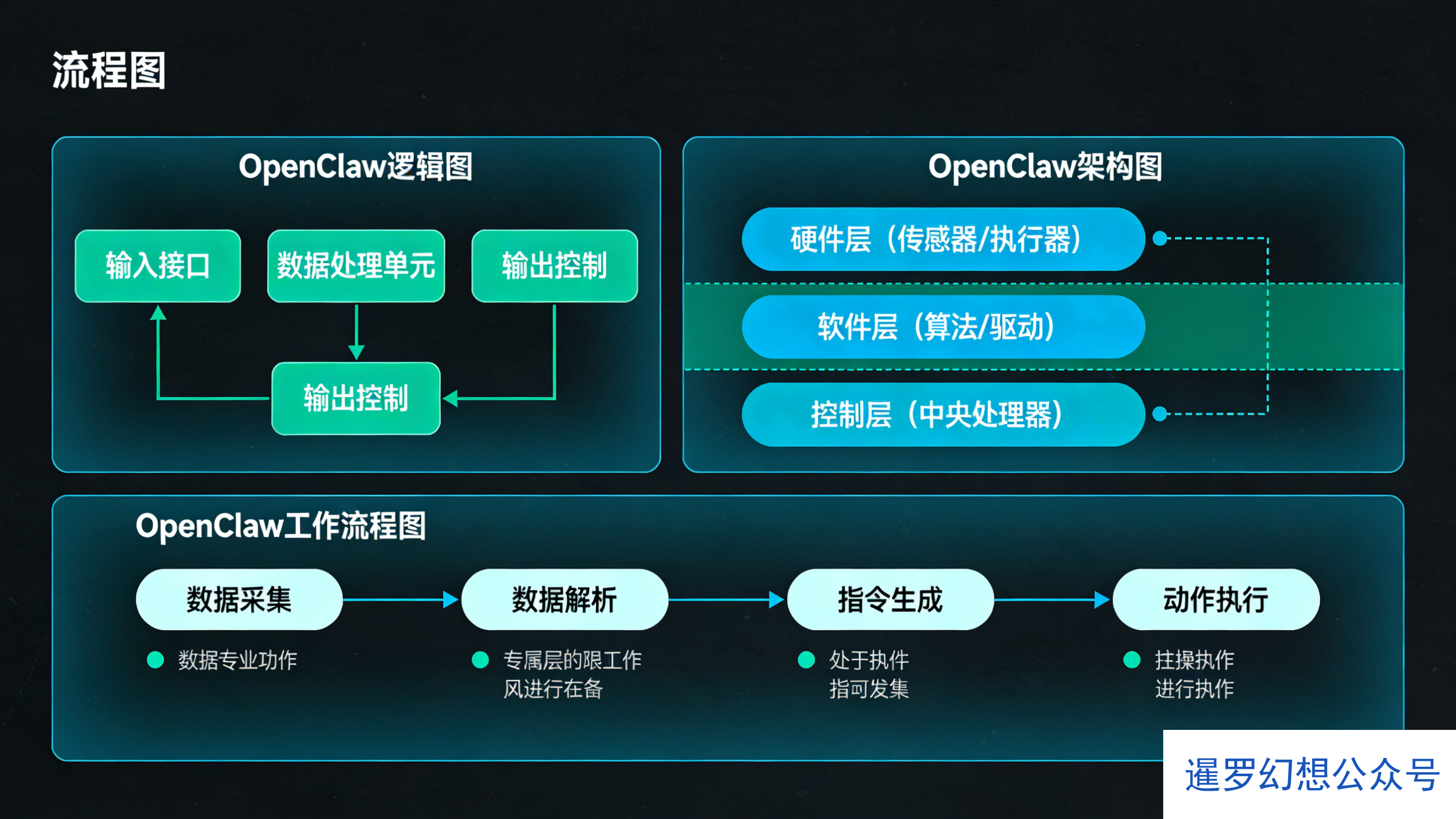

OpenClaw 的架构分为三层:消息入口、模型调度、系统执行。高阶玩家关注的是最底层——命令执行、文件读写和后台任务 。

二、基础部署:选对“养殖”环境

OpenClaw 对运行环境有一定要求。根据阿里云开发者社区的最新教程,以下部署方案最为稳妥:

-

服务器选择:推荐在云端部署(如阿里云轻量应用服务器),确保 7x24 小时在线。内存必须 ≥2GiB,否则极易卡顿。由于国内部分地域联网搜索受限,建议选择海外节点 。

-

环境要求:Node.js 必须为 22.0.0 及以上版本(18/20 版本存在兼容性问题)。

-

国内加速:务必配置 npm 国内镜像源,否则安装过程极易因网络问题失败。

bash

npm config set registry https://registry.npmmirror.com

三、核心配置:六个文件掌控 AI 的灵魂

OpenClaw 并非黑盒系统,它的性格、记忆和工作流程完全由六个核心配置文件决定。想要拥有一个“听话”的龙虾,你必须学会编辑这些文件 。

| 文件名 | 作用 | 最佳实践建议 |

|---|---|---|

| AGENTS.md | 操作手册 | 规定代码修改前必须查看文件、禁止执行 rm -rf 等危险命令。 |

| IDENTITY.md | 身份认知 | 定义 AI 的角色,如“资深全栈工程师”或“数据分析助手”。 |

| SOUL.md | 性格与风格 | 设定回复风格为“简洁专业、不啰嗦”,拒绝编造信息。 |

| USER.md | 用户档案 | 记录你的偏好,如“使用 TypeScript”、“缩进 2 空格”。 |

| TOOLS.md | 环境说明 | 告知 AI 当前的技术栈、数据库路径和常用命令。 |

| MEMORY.md | 长期记忆 | 存储跨会话的关键信息,如“项目端口是 18789”。 |

特别提醒:为了应对 Token 消耗过高的问题,建议在 AGENTS.md 中加入“错误自动修复机制”和“长任务时间片管理”,让 AI 在遇到错误时先尝试自救,而不是空转消耗 Token 。

四、成本控制:如何实现“Token 自由”?

“烧钱”是劝退养虾人的首要原因。OpenClaw 每次调用模型都会携带系统提示、人设文件、技能描述,导致即使简单任务也会消耗巨额 Token,再加上其心跳机制(定时自动唤醒),简直是“吞金兽” 。

最佳实践策略:

-

善用免费与低价模型:

-

不必死磕 Claude 等昂贵模型。配置阿里云百炼的 Coding Plan 或 通义千问 是目前性价比最高的方案之一。Coding Plan 将计费从按 tokens 改为按次收费,能大幅降低日常使用成本 。

-

配置示例(

config.json):json

"model": { "type": "aliyun-bailian", "model_name": "qwen-turbo", "max_tokens": 2048, "temperature": 0.4 }

-

-

开启群聊“仅 @ 响应”:

如果把龙虾拉进群聊,它会因心跳机制疯狂回复或消耗算力。请在配置中开启requireMention: true,只在被 @ 时才响应,避免不必要的 Token 损耗 。 -

善用本地缓存:

配置搜索结果缓存、网页内容缓存(有效期 30 分钟),避免重复抓取相同网页造成的重复计费 。

五、安全红线:驯服而非被控制

“龙虾”拥有系统级执行权限,它能帮你干活,也能给你添乱。有用户的电脑被龙虾改了网络配置导致无法上网,甚至有安全报告指出,超过 4.2 万个公开的 OpenClaw 实例存在被越权接管的风险 。

安全实践:

-

权限收紧:在配置中将

elevatedDefault设为“full”开启权限,但要配合AGENTS.md中的“禁止删除配置文件”等规则进行约束。 -

沙箱模式:如果担心误操作,可以将

sandbox.mode开启,限制其写权限。 -

定期审计:使用

openclaw logs --follow实时监控龙虾在做什么,一旦发现异常操作,立即通过/stop强制停止 。

六、进阶玩法:从“养虾”到“养家”

当你的龙虾稳定运行后,它就能帮你实现真正的“一人公司”(OPC)。清华大学沈阳团队的报告指出,智能体正在重构内容创作、跨境电商、投研分析等多个赛道 。

实战案例:

-

新媒体运营:像 23 岁的庄女士那样,让龙虾自动抓取热点、统计传播数据、生成摘要并推送到微信,每天节省 3 小时 。

-

金融投研:让龙虾化身为分析师助理,自动抓取 A 股公告、进行分类、汇总成 Excel,甚至进行智能盯盘 。

-

政务应用:深圳福田区已上线“政务龙虾”,处理公共场所卫生许可办理和民生诉求调研 。

最后,借用周鸿祎的一句话:“不发展、不进步,才是最大的安全隐患。” 面对 OpenClaw 这一新生事物,我们不应因初期的成本和安全问题而因噎废食。通过科学部署、精细配置和权限管控,你完全可以让这只“龙虾”成为你最得力的 24 小时全天候助理,在 AI 时代抢占效率的制高点。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)