测试工程师必备 Skills 合集:从需求→用例→报告全流程提效

哈喽,我是 Raina~

在开发领域,OpenSpec 早已成为协作对齐、先约定再生成的标准,而测试领域却一直缺少这样一套能锚定需求、固化流程的标准化体系。所以我基于 OpenSpec 的设计思路,在测试方面原创了一套规范与配套流程 ——OpenTest

测试工作常遇这些问题:直接从需求出用例易缺漏、多工具切换操作低效、报告撰写统计繁琐。

OpenTest 将测试流程标准化为「需求文档→分析→测试点→用例→报告→归档」的闭环,让测试从零散执行变为规范驱动,今天就为大家拆解其核心价值与实操方法。

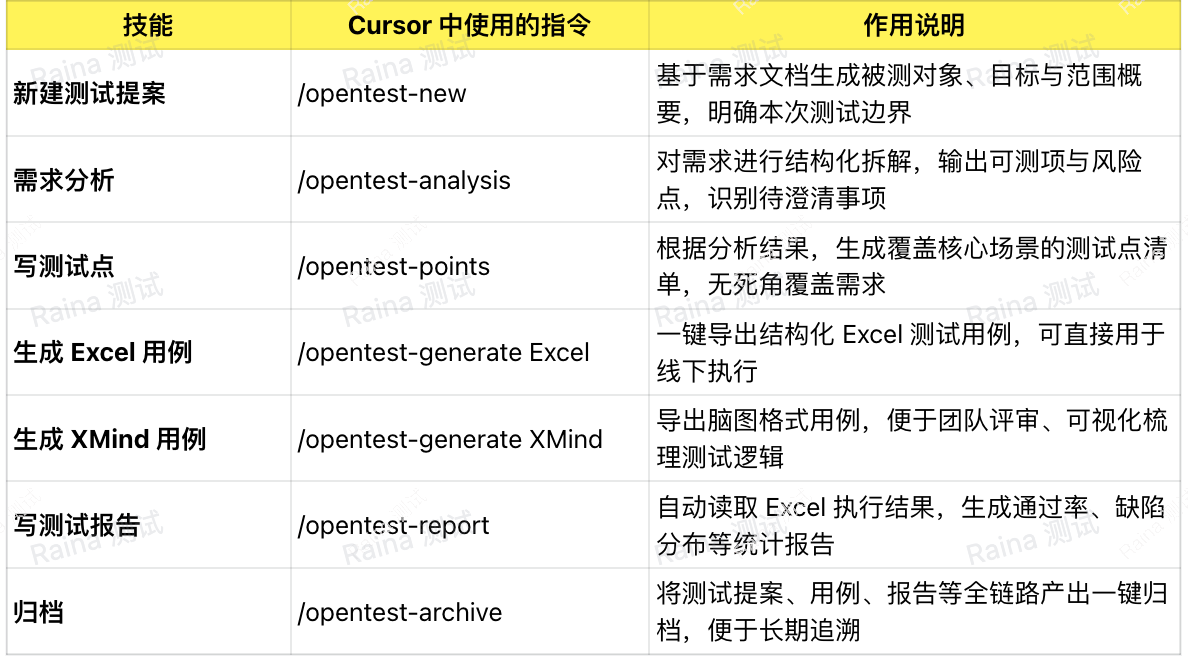

OpenTest 核心技能清单

OpenTest包含以下 Skills:

Skills 合集包都更新在 Raina 的 AI&测试实战圈了,圈内还有更多AI测试落地案例以及 Raina积累的学习笔记等干货,感兴趣的可以加入了解哦~

OpenTest 实操全流程

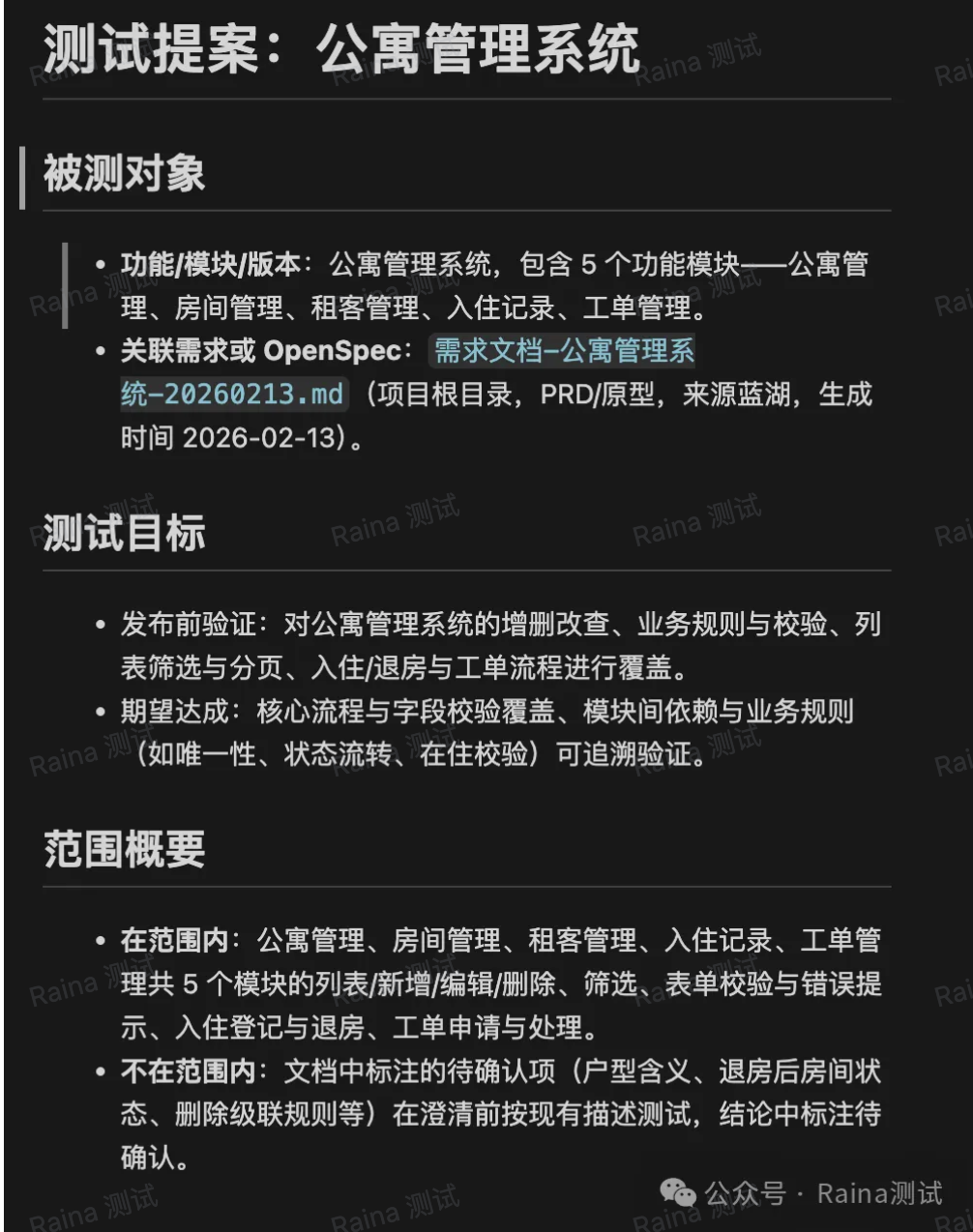

1、 测试提案生成

输入指令/opentest-new+ 需求文档,即可自动生成测试提案,明确被测对象、测试目标与范围,区分 “测试范围内” 和 “待澄清项”,避免测试漏项或超出边界

输出:被测对象、目标和范围概要

2、 需求分析

输入指令/opentest-analysis,AI 会对需求进行结构化拆解,输出各模块的功能可测项,同时自动识别需求中的不明确事项,生成待澄清项清单。

输出:

对需求进行拆解和分析

针对不明确事项,则需要进行对话澄清

这一步的作用很关键,AI会识别不确定事项,让我们进行补充

例如:下边我进行对话补充

结果:

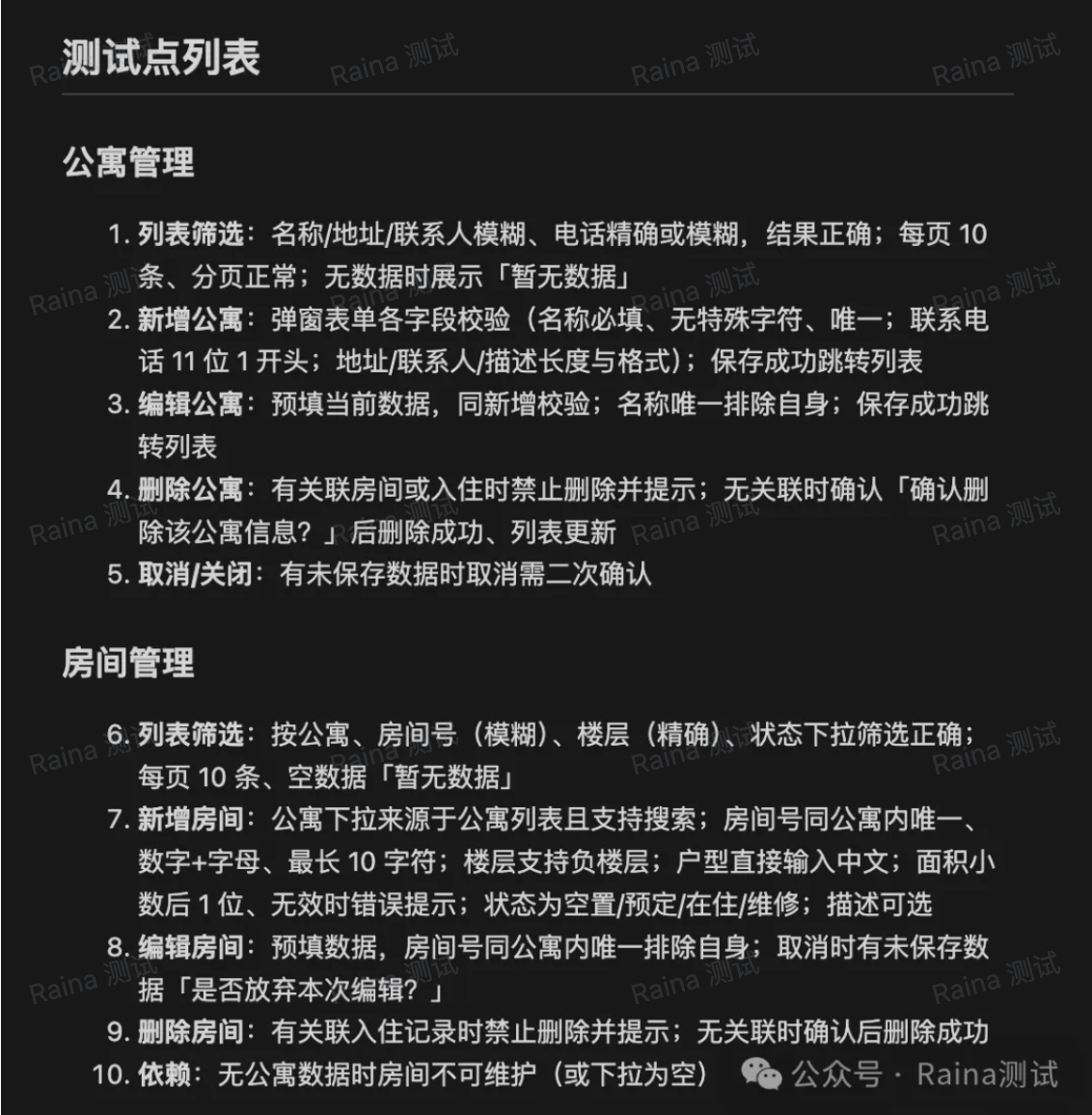

3、测试点生成

输入指令/opentest-points,基于已澄清的需求分析结果,自动生成覆盖核心场景的测试点清单,每个模块的正向、负向、边界场景都逐一拆解

输出:

4、用例生成

根据测试点一键生成用例,支持 Excel 和 XMind 两种格式,满足不同使用场景:

- 输入

/opentest-generate Excel,生成含用例编号、名称、模块、类型、前置条件、测试步骤、预期结果、优先级的结构化 Excel 用例,可直接填写执行结果; - 输入

/opentest-generate XMind,生成脑图格式用例,按模块、用例类型分类梳理,逻辑清晰,适合团队评审和测试思路可视化。

生成excel格式的用例

结果:

生成xmind格式的用例

输入:

输出:

5、报告生成

完成用例执行并在 Excel 中填写结果后,输入指令/opentest-report,OpenTest 会自动读取 Excel 中的执行结果,生成测试报告,包含总用例数、通过 / 失败 / 阻塞数、全量通过率,以及按模块的通过率分布、需求覆盖情况

输入:

输出:

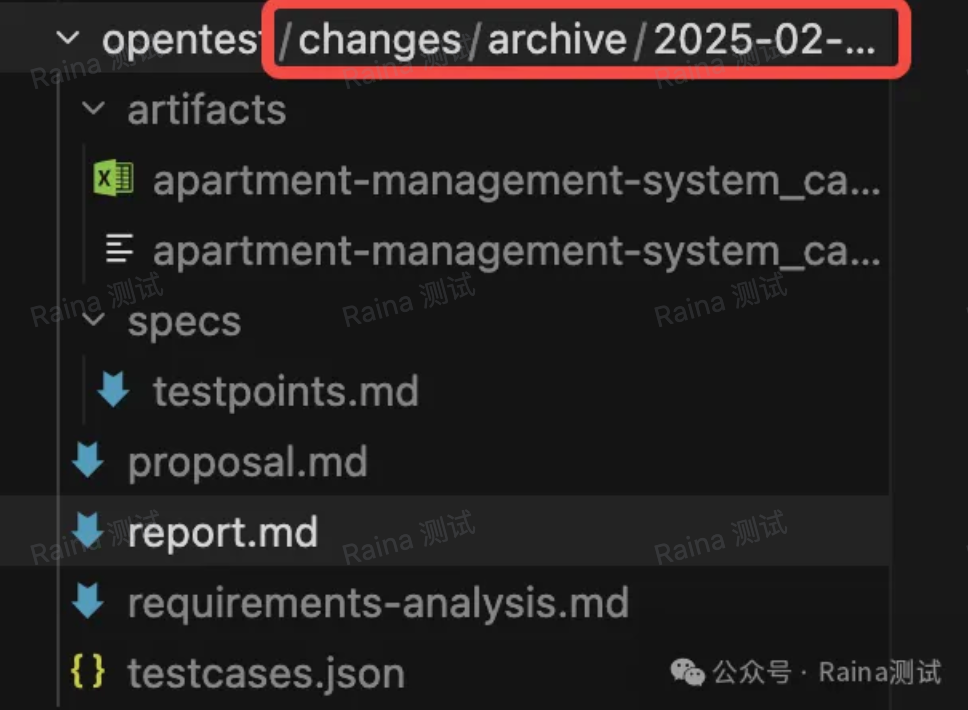

6、归档

输入指令/opentest-archive,即可将本次测试的提案、需求分析、测试点、用例、报告等所有产出,一键归档到专属文件夹,按规范命名存储,后续项目复盘、需求迭代时,可快速检索调

输出:

会将本次的输出,都归档到一个文件夹中,方便管理~

以上是今天的分享,后续会根据测试实战中的新场景,不断更新Opentest的功能,也会持续开发更多适用于测试工程师的Skills包。 至于完整的 Skills 包、详细使用教程和配套示例,我都整理在星球里了,感兴趣的小伙伴可以了解看看~

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)