Agent 很会干活,为什么就是不会自己变强?

很多 Agent 工作默认一个前提:模型训练好,上线,再靠 memory、tool use、prompt 慢慢补。但这篇论文指出,问题不在“能不能把任务做出来”,而在“上线以后还能不能持续变强”。真实环境里,任务会变,失败会积累,工具接口也会漂移。如果系统只会执行,不会吸收新经验,它很快就会落后。MetaClaw 的核心做法,是把在线成长拆成两条回路:先把失败快速提炼成技能,立刻修正下一次行为;再在空闲时做参数优化,把这些经验慢慢写进模型。它证明,持续进化不是一句口号,而是可以被系统化实现的。

Motivation

这篇论文真正想解决的是:部署后的 Agent 为什么一直在工作,却没有真正学会适应。

现有方法各有作用,但都不完整。memory 更像存档,skill 更像外挂规则,RL 虽然能改参数,但太慢,也不适合频繁打断在线服务。于是很多 Agent 看起来一直在接任务,实际上只是不断重复试错。论文要回答的,就是一个更现实的问题:一个已经上线的 Agent,怎样才能在不影响使用的前提下继续成长。

现象剖析:经验过期

这篇论文最关键的观察是,在线场景里,很多经验并不是天然可复用的。

比如 Agent 在一次文件编辑任务里失败了,系统从失败里总结出一条新技能:修改文件前先备份。从下一轮开始,系统其实已经变了。如果这时还把“旧技能版本下采集的失败样本”继续拿来训练当前模型,那么这些 reward 对应的就不是当前系统,而是旧版本系统。

这意味着,在线 Agent 的难点不只是“如何积累经验”,而是“哪些经验在系统升级后还成立”。如果这一点处理不好,训练就会被过期数据带偏。这篇论文真正抓住的,就是持续学习里的版本问题。

核心解读:双回路进化

整篇论文的方法主线很清楚:把 Agent 的成长拆成“快更新”和“慢吸收”两件事。

作者先把系统能力写成:

其中, 是底层模型参数, 是技能库。也就是说,Agent 当前能力不是只靠模型本身,而是由“参数能力 + 可检索技能”共同决定。

1. 快回路:先把错止住

任务失败后,系统会把失败轨迹送进技能演化模块,从中提炼出新的自然语言技能,再直接加入技能库。下一次遇到相似任务时,系统先检索相关技能,再交给模型执行。

这个过程可以写成:

意思很简单:当前技能库 看到一批支持样本 后,经由演化器 生成新技能,形成下一代技能库 。

这一步的价值很直接:

- • 不改权重

- • 更新很快

- • 可以立刻生效

所以它解决的是最现实的问题:先别在同一个地方继续犯错。

2. 慢回路:再把经验写进模型

但 skill 终究是外显规则,不等于模型真的学会了。所以论文又设计了第二条回路:等新技能已经进入系统并稳定使用后,再收集这一阶段的新轨迹,用 RL 微调模型,让它逐步学会在“带技能”的条件下更稳定地完成任务。

这里最重要的不是训练细节,而是目标变了:优化对象不再是裸模型,而是一个已经具备技能适配能力的 Agent。换句话说:

- • skill 负责把经验显式写出来

- • parameter 负责把经验慢慢吸收进去

前者解决“现在先能用”,后者解决“以后真正学会”。

3. 最妙的设计:版本管理

这篇论文最有工程意识的地方,不是技能库本身,而是它对数据版本的处理。

论文专门给样本打上技能代际标记。一旦技能库升级,旧版本下采集的样本就不能直接用于当前参数优化。原因很简单:

- • 技能变了,策略条件就变了

- • 条件变了,旧 reward 含义也会变

- • 旧 reward 失效,再训练就会目标错位

这不是细节,而是整套系统能不能跑通的关键。

图表深度解读

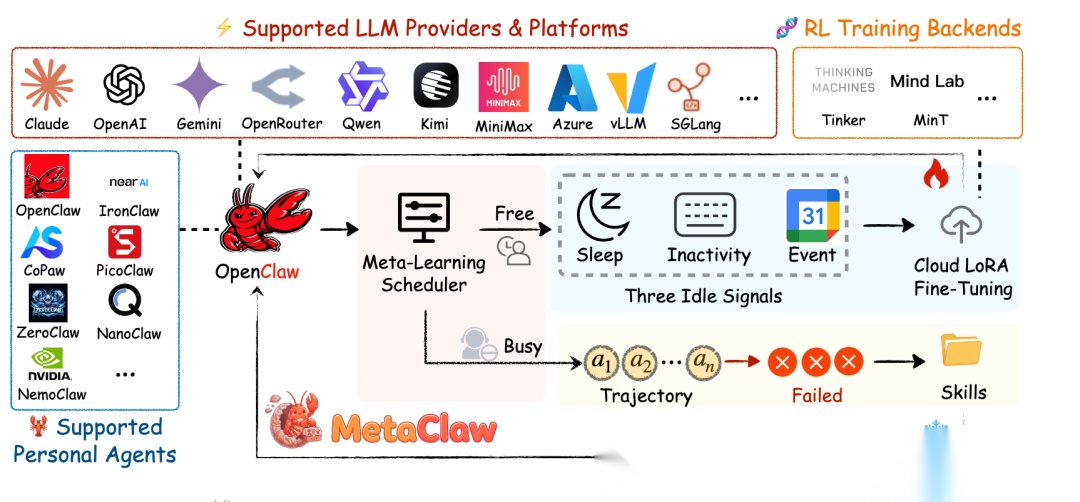

图1:系统总框架

画面描述:图里把系统拆成两部分:左边是失败后触发的技能演化,右边是样本进入缓冲区后,在空闲时进行的参数微调。

深度解读:这张图最重要的不是模块多,而是节奏分层。什么需要立刻修,什么可以之后再学,被清楚分开了。这说明作者不是在堆模块,而是在设计一个长期运行的进化闭环。

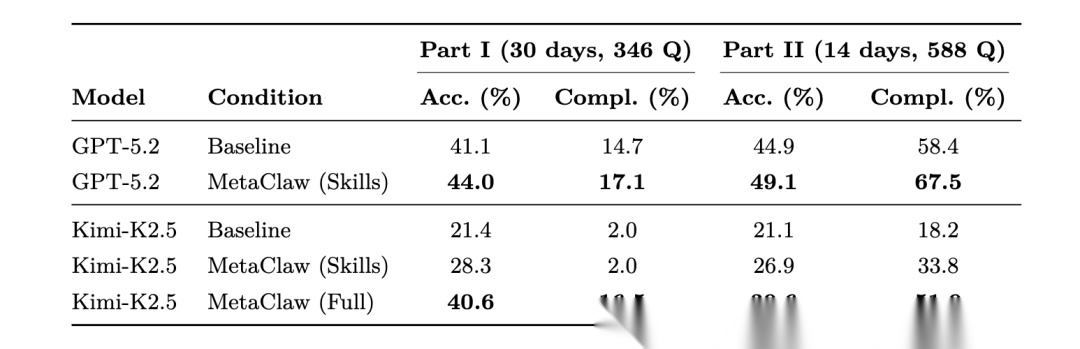

图2:主实验结果

画面描述:表格对比了 baseline、仅技能更新、完整 MetaClaw 三种设置在不同模型上的效果。

深度解读:最值得看的不是“有没有涨分”,而是“为什么会涨”。仅做技能更新时,任务已经明显改善,说明失败总结确实能快速补规则;完整系统进一步提升完成率,说明参数优化负责把“知道怎么做”变成“稳定做成”。

实验结果说明了什么?

这篇论文最有含金量的结果,不是顶级模型多了几分,而是中等能力模型也出现了结构性提升。这说明改进不是来自更强 backbone,而是来自方法本身。

实验能概括成两句话:

- • 只做技能更新,系统已经能明显减少重复犯错

- • 再加参数优化,复杂任务完成率继续上升

这说明只靠 skill,系统能变聪明一点,但不一定能把复杂任务做稳;只有把经验进一步写进参数,Agent 才会真正变强。

为什么这篇工作值得关注?

这篇工作最值得关注的地方,不是它又做了一个新模块,而是它把一个长期被忽视的问题讲清楚了:Agent 上线之后,能力不能停在初始状态。

过去很多方法关注的是“当前任务能不能做成”,而这篇论文关注的是“系统用久了会不会越来越强”。它真正推进的,不是局部提分,而是把在线成长从概念变成了可运行流程:失败先沉淀为技能,技能不能替代参数吸收,旧经验也不能无条件复用。

总结一下

这篇论文不是简单给 Agent 加一个技能库,也不是普通的在线微调实验。它更像是在回答一个真正系统化的问题:一个持续在线的 Agent,怎样才能在不打断服务的前提下,把失败经验转化成长期能力。MetaClaw 给出的答案很清楚:先用技能更新快速止损,再用参数优化慢慢内化,同时用版本管理防止旧经验带偏当前训练。它真正推进的,不只是任务表现,而是在线 Agent 应该如何持续演化。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献54条内容

已为社区贡献54条内容

所有评论(0)