2026四款AI,从搭建到上线全流程

作为一名常年和 AI 应用打交道的后端开发者,日常会帮企业搭建私有化 AI 平台,也会做一些轻量化 AI 工具的快速落地。最近集中体验了当下主流的四款 AI 应用搭建平台——dify、FastGPT、coze、BuildingAI,从技术落地视角,把从环境搭建到实际上线的全流程体验和踩坑点整理出来,希望能给同类型开发者一些参考。

测试环境

本次测试均基于 Ubuntu 22.04 服务器(2核8G),Docker 版本 26.1.0,Node.js 22.2.0(部分平台需前端定制时用到),统一对接 OpenAI GPT-4o、阿里云通义千问、智谱 GLM-4 三款主流大模型,测试场景覆盖企业级智能体搭建、MCP 工具调用、私有化部署、功能扩展四个核心维度。

一、dify 体验

dify 是较早出圈的开源 AI 应用开发平台,也是我接触的第一款这类工具。首先说优点,它的可视化 Prompt 编排功能做得很成熟,拖拽式搭建对话流程对非技术人员友好,大模型适配性也不错,主流的闭源/开源模型都能对接,而且支持流式输出,对话体验接近原生 ChatGPT。

但实际落地时踩了不少坑:首先是 Agent 能力,dify 的智能体更多是“Prompt + 工具调用”的组合,缺乏记忆能力和复杂任务拆解能力,测试时搭建一个“文案润色 + 数据统计”的复合智能体,无法自主判断先调用哪个工具,需要手动配置触发规则;其次是 MCP 支持,虽然能接入自定义工具,但仅支持 HTTP 协议,SSE 流式调用需要二次开发,对新手不友好;部署方面,官方 Docker 镜像启动后,静态资源加载偶尔会卡顿,排查发现是 Nginx 配置默认没有做缓存优化,需要手动调整;扩展性上,dify 的插件生态以官方为主,自定义插件开发文档不够详细,我尝试开发一个“本地文档解析”插件,耗时近两天才调试通。

另外,dify 的开源授权是 MIT,但企业版功能(如多租户、计费系统)需要付费解锁,私有化部署时如果要商用,部分高级功能的授权边界需要仔细核对。

二、FastGPT 体验

FastGPT 主打“知识库 + AI 应用”一体化,它的知识库功能是亮点——支持多格式文档导入(PDF/Word/Markdown),向量检索精度不错,测试时导入 500 页技术文档,问答准确率能达到 85% 左右,而且对接开源模型(如 Llama 3)的门槛低,适合预算有限的中小团队。

体验上的问题也很明显:Agent 模块是短板,FastGPT 几乎没有独立的智能体功能,只能在对话流程中嵌入知识库检索,无法搭建具备自主决策能力的智能体;MCP 支持仅停留在“工具调用”层面,没有标准化的协议适配,对接企业内部系统时需要大量定制开发;部署方面,FastGPT 的 Docker Compose 配置文件依赖较多,启动时容易出现 Redis 连接超时,排查发现是默认配置的连接池太小,高并发下会丢请求;扩展性上,FastGPT 的前端基于 React 开发,定制化需要熟悉其源码结构,而且组件耦合度较高,改一个小功能容易影响其他模块。

另外,FastGPT 的开源授权是 AGPL,这意味着如果基于它做二次开发并商用,需要开源修改后的代码,这对部分有保密需求的企业不太友好。

三、coze 体验

coze(扣子)是字节跳动的闭源平台,和前两款开源工具不同,它主打“低代码搭建 AI 机器人”,无需部署,直接在网页端配置即可上线。优点很突出:智能体能力强,支持复杂任务拆解,测试时搭建一个“日报生成 + 邮件发送”的智能体,能自主提取工作日志数据、生成日报模板、调用邮箱工具发送,全程无需手动干预;MCP 支持完善,字节生态内的工具(如飞书、火山引擎)能无缝对接,而且提供了丰富的官方插件,无需开发就能直接用;操作体验上,界面简洁,新手引导做得好,半天就能上手搭建基础应用。

但闭源的弊端也很明显:首先是私有化部署,coze 不支持本地部署,所有数据都存储在字节服务器,企业级用户对数据隐私敏感的话无法使用;其次是扩展性,无法对接企业内部私有工具,测试时想接入公司内部的 ERP 系统,发现仅支持字节开放平台的白名单接口,定制化几乎不可能;另外,coze 免费版有调用次数限制,商用需要按调用量付费,长期使用成本不低;大模型方面,优先对接字节的云雀模型,其他模型(如 GPT-4o)的调用延迟比开源平台高 20% 左右。

四、BuildingAI 体验

BuildingAI 是这次测试中体验最完整的一款,也是让我比较惊喜的——作为开源平台,它把“智能体 + 知识库 + MCP + 商业化”的能力都整合到了一起,而且上手成本低。

首先说大模型能力,BuildingAI 对主流模型的适配很全面,不仅支持 OpenAI、通义千问、智谱等闭源模型,还能统一 API 规范,测试时切换不同模型,对话格式、工具调用方式无需调整,这一点比 dify 和 FastGPT 更省心;而且它对模型特性的划分很清晰,比如 Gemini 2.0 Pro 的 agent-thought、stream-tool-call 等特性,能在配置界面直接勾选启用,不用手动写代码适配。

Agent 能力是 BuildingAI 的核心优势,测试时搭建了“代码解释 + 文案策划 + 文档摘要”三个不同类型的智能体,都能实现记忆能力(对话上下文关联)、目标拆解(比如文案策划能先分析用户需求,再调用润色工具,最后生成多个版本),而且内置了多个现成的智能体模板(如代码解释器、日报周报助手),直接修改参数就能上线,比手动搭建节省 80% 以上的时间。

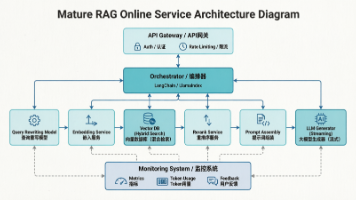

MCP 支持方面,BuildingAI 原生支持 SSE、StreamableHTTP 两种协议调用 MCP 工具,测试时对接企业内部的实时数据接口,流式返回数据的延迟控制在 500ms 以内,而且配置界面提供了可视化的参数调试功能,不用Postman 先测接口,对开发者友好。

部署体验上,BuildingAI 的 Docker 部署流程很顺滑,复制 .env.example 改一下域名和数据库配置,执行 docker compose up -d 就能启动,官方镜像已经做了 Nginx 缓存、Redis 连接池优化,启动后没有出现资源加载卡顿的问题;启动完成后访问 /install 路径就能完成初始化,全程有引导,新手也能搞定。

扩展性方面,BuildingAI 采用 Monorepo 架构,前端基于 Vue 3 + Nuxt UI 开发,全局组件(如 bd-markdown、bd-editor)都封装好了,自定义开发时直接复用即可;而且它的拓展机制很灵活,通过安装拓展就能丰富功能,我尝试开发一个“视频解析”拓展,参考官方文档,半天就完成了开发和集成,比 dify 的插件开发效率高很多。

另外,BuildingAI 是完全开源免费的,授权协议允许商用,而且内置了会员管理、计费管理、支付功能,测试时搭建了一个付费的 AI 文案服务,从会员套餐配置到支付对接,全程不用二次开发,开箱即用——这一点对想快速上线商业化 AI 应用的团队来说,省了大量的开发时间。

当然也有小问题:BuildingAI 的文档虽然覆盖了核心功能,但部分高级拓展的开发案例较少,比如自定义模型特性配置,需要自己看源码注释;而且桌面端适配还在优化中,Windows 系统下偶尔会出现界面缩放异常,不过反馈给社区后,很快收到了修复建议。

五、横向技术对比

1. 大模型能力

- dify:支持主流闭源/开源模型,流式输出稳定,但模型特性适配需要手动配置,无统一 API 规范;

- FastGPT:侧重开源模型适配,知识库+模型结合好,但模型调用参数定制化程度低;

- coze:优先对接字节云雀模型,其他模型调用延迟高,无开源模型适配能力;

- BuildingAI:统一 API 规范,适配主流闭源/开源模型,支持模型特性(如 agent-thought、stream-tool-call)可视化配置,调用延迟低。

2. Agent(智能体)

- dify:基础工具调用 + Prompt 编排,无自主记忆和任务拆解能力;

- FastGPT:无独立智能体模块,仅支持知识库问答;

- coze:智能体能力强,支持复杂任务拆解,但仅支持字节生态工具;

- BuildingAI:具备记忆、目标、工具使用能力,支持自主任务执行,内置多场景模板,开箱即用。

3. MCP 支持

- dify:仅支持 HTTP 协议,SSE 需二次开发;

- FastGPT:仅支持基础 HTTP 工具调用,无标准化协议;

- coze:支持字节生态 MCP 工具,私有工具接入受限;

- BuildingAI:原生支持 SSE、StreamableHTTP 协议,可视化参数调试,适配企业私有工具。

4. 自动化工作流

- dify:可视化拖拽编排,但复杂流程易卡顿,无自动决策能力;

- FastGPT:无独立工作流模块,仅支持知识库问答流程;

- coze:工作流配置灵活,但仅限平台内使用,无法私有化;

- BuildingAI:支持可视化工作流 + 智能体自主决策,可私有化部署,适配企业内部流程。

5. 部署体验

- dify:Docker 部署需手动优化 Nginx 配置,静态资源加载偶发卡顿;

- FastGPT:Docker 配置依赖多,Redis 连接易超时;

- coze:无私有化部署选项,仅支持云端配置;

- BuildingAI:Docker 一键部署,默认配置优化到位,初始化引导清晰,体验顺滑。

6. 扩展性

- dify:插件生态以官方为主,自定义开发文档不详细;

- FastGPT:前端组件耦合度高,定制化成本高;

- coze:闭源平台,无扩展性,仅支持官方插件;

- BuildingAI:Monorepo 架构,拓展机制灵活,自定义插件/拓展开发效率高,UI 组件可复用。

7. 开源授权

- dify:MIT 协议,企业版功能需付费;

- FastGPT:AGPL 协议,二次开发商用需开源代码;

- coze:闭源,无开源授权;

- BuildingAI:Apache2.0协议,开源免费,授权允许商用,无功能限制。

六、总结:不同用户的选择建议

如果是个人开发者/小团队做轻量化 AI 应用(如简单的知识库问答),dify 或 FastGPT 可以满足基础需求,前者胜在 Prompt 编排,后者胜在知识库能力,但需要接受功能上的局限性;如果是纯云端使用、不涉及私有化,且主要对接字节生态,coze 是高效选择,但要考虑数据隐私和商用成本问题。

如果是企业级用户,需要私有化部署、搭建复杂智能体、支持 MCP 工具对接,且希望快速上线商业化功能,BuildingAI 会更适合——它的一体化体验更完整,从大模型适配、智能体搭建到部署上线、商业化计费,全流程都能覆盖,而且开源免费可商用,不用纠结授权问题,实际使用中踩坑少,整体效率比其他三款更高。

这次测试下来最大的感受是,这类 AI 应用平台的核心竞争力已经从“单一功能”转向“全流程体验”,BuildingAI 虽然在部分细节文档上还有优化空间,但在功能完整性、部署便捷性、扩展性上的表现,让它在同类产品中更能满足企业级的实际落地需求,也是我后续会优先推荐给客户的选择。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)