Open-SWE:异步架构如何彻底改变AI编程助手的性能瓶颈

引言:AI编程助手的性能困境

最近在使用各种AI编程工具时,开发者们普遍遇到了相似的问题:当AI助手处理大型项目重构或复杂代码分析时,那个让人烦躁的"思考中…"提示符似乎永远不会消失。

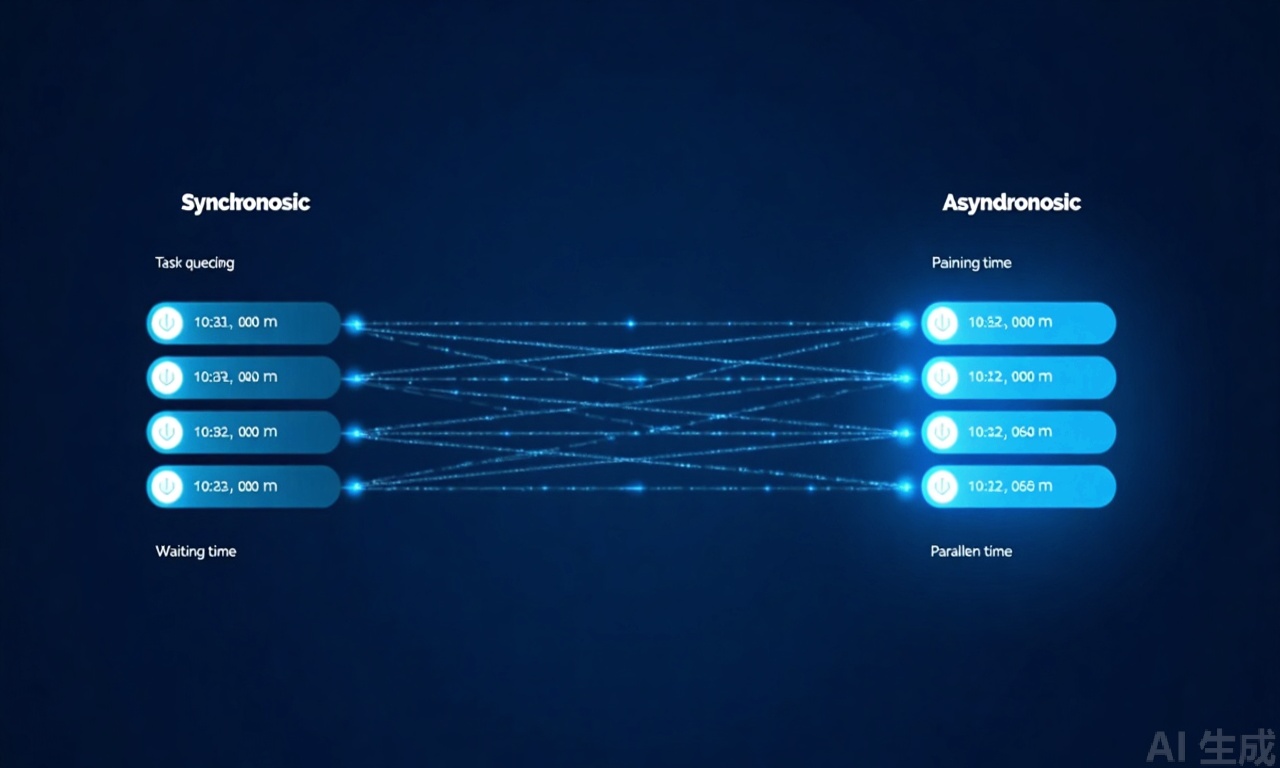

传统同步执行模型让AI助手像一位需要排队等待的办事员,一次只能处理一个任务,即使很多操作本质上可以并行处理。

如果你关注LangChain生态,可能已经注意到了他们最新发布的Open-SWE项目。这个开源项目的核心创新,是通过异步架构彻底改变AI编程助手的工作模式。

技术背景:同步模型的三大性能瓶颈

问题一:CPU等待的代价

当AI助手执行编译、代码分析等计算密集型任务时,整个系统必须等待任务完成才能继续下一步,即使其他模块完全可以并行工作。

问题二:IO阻塞的困境

文件读写、数据库查询、网络请求等操作在传统模型中都是阻塞式的。一个简单的git status命令就可能导致整个助手"卡住"几秒钟。

问题三:任务依赖的死锁

在复杂的软件工程工作流中,很多任务之间存在依赖关系。同步模型很难优雅地处理这种依赖,常常导致整个系统陷入等待状态。

核心技术解析:Open-SWE的异步架构设计

异步任务调度引擎

Open-SWE的核心是它的异步任务调度引擎,这个引擎采用了工作窃取(work-stealing)算法来优化任务分配。

设计优势:

- 减少上下文切换:线程在等待IO时可以处理其他任务

- 提高CPU利用率:计算密集型任务和IO密集型任务可以交错执行

- 更好的可预测性:系统吞吐量对任务类型的敏感性降低

非阻塞IO操作实现

Open-SWE将文件系统操作、网络请求、子进程调用等传统阻塞操作全部重构为非阻塞实现。

代码对比示例:

# 传统同步模型

def read_and_analyze(file_path):

content = file.read() # 阻塞操作

analysis_result = analyze(content)

return analysis_result

# Open-SWE异步模型

async def read_and_analyze_async(file_path):

content_future = file.read_async() # 非阻塞,立即返回Future

other_tasks = await process_other_tasks() # 并行处理其他任务

content = await content_future # 只在需要结果时等待

analysis_result = analyze(content)

return analysis_result

软件工程任务专业化处理

Open-SWE为不同类型的软件工程任务创建了专门的处理模块:

编译任务模块: 理解编译器的工作模式,将编译任务分解为预处理、编译、链接等子阶段,允许不同阶段的并行处理。

测试任务模块: 智能分析测试用例的依赖关系,识别可以并行执行的测试集,同时监控测试资源使用,避免内存溢出。

代码分析模块: 采用增量分析技术,只重新分析变更的文件,而不是每次都扫描整个代码库。

与LangChain生态集成

作为LangChain生态系统的一部分,Open-SWE提供了标准的异步API接口,允许上层应用以统一的方式调用其能力。

集成架构的核心思想:

- LangChain负责对话理解、意图识别、自然语言生成

- Open-SWE专注于软件工程任务的高效执行

- 两者通过异步消息队列通信

工具与项目技术栈

核心项目分析

Open-SWE (GitHub: langchain-ai/open-swe):

- 采用Python/TypeScript双语言栈

- 核心调度引擎用Rust编写以获得极致性能

- 提供完整的异步任务管理框架

LangChain生态系统:

- 提供对话理解、工具调用、记忆管理等基础能力

- 与Open-SWE深度集成

传统SWE-agent实现:

- 作为对比基准

- 展示了从同步到异步的架构演进路径

技术栈选择背后的工程考量

Rust用于调度引擎:

- 需要零成本抽象的并发控制

- 内存安全要求

- 极致性能需求

Python/TypeScript用于上层API:

- 保持对AI生态的友好性

- 开发者熟悉度考虑

异步运行时选择:

- Python使用asyncio

- TypeScript使用Node.js的Event Loop

实际应用场景与价值

适用场景分析

大规模代码重构场景:

如果你的项目需要跨多个模块进行系统重构,Open-SWE可以并行分析不同模块的依赖关系、生成修改建议、执行测试验证,将原本数小时的工作压缩到几十分钟。

持续集成/持续部署流水线:

在CI/CD环境中集成Open-SWE,可以让AI助手在代码提交后立即执行代码审查、安全检查、性能分析等任务,而不阻塞构建流程。

多项目并发开发:

经常需要在多个项目间切换的开发者,可以利用Open-SWE同时维护不同项目的上下文,快速响应各项目的问题和需求。

迁移建议

性能收益评估:

建议先对当前工作流进行性能分析,识别出主要的性能瓶颈点。如果瓶颈主要在IO等待或任务依赖上,迁移到异步架构的收益会比较明显。

代码修改量评估:

现有的工具函数需要从同步版本重写为异步版本。Open-SWE提供了自动转换工具,但复杂逻辑可能仍需要手动调整。

团队技能储备:

异步编程对开发者的思维模式有一定要求,团队需要花时间理解async/await编程模型、Future/Promise概念、任务调度策略等。

定制化开发建议

自定义任务类型:

除了内置的编译、测试、代码分析任务,开发者可以创建针对特定技术栈的专用任务模块。

优先级调度策略:

Open-SWE的调度器支持自定义优先级算法。你可以根据团队的工作习惯,实现不同的调度策略。

资源感知调度:

通过扩展调度器,可以实现对CPU、内存、GPU、网络带宽等资源的感知和智能分配。

性能优化实践指南

异步编程最佳实践

避免阻塞操作:

在异步函数中,尽量避免使用同步的阻塞操作。如果必须使用,应该使用run_in_executor等方法将其转换为异步操作。

正确处理异常:

异步编程中的异常处理比同步编程更复杂。确保使用try...except正确捕获异常,并正确处理取消操作。

资源管理:

异步编程中资源泄漏的风险更高。确保正确关闭文件句柄、数据库连接等资源。

调试与监控

性能监控工具:

Open-SWE内置了性能监控功能,可以跟踪任务的执行时间、资源使用情况等指标。

调试技巧:

使用异步调试工具,如Python的asyncio.debug()模式,可以帮助识别异步编程中的常见问题。

日志记录:

合理的日志记录策略对于调试异步程序至关重要。建议使用结构化日志,包含任务ID、执行时间等关键信息。

总结

Open-SWE的异步架构代表了AI编程助手性能优化的重要方向。它通过工作窃取算法、非阻塞IO、专业化任务处理等技术,有效解决了传统同步模型的性能瓶颈。

对于开发者的实用建议:

-

评估现有工作流: 分析当前AI助手工作流中的性能瓶颈点,确定异步架构的潜在收益。

-

渐进式迁移: 从非关键模块开始,逐步将工作流迁移到异步模型,积累经验后再全面推广。

-

团队培训: 安排专门的学习时间,系统掌握异步编程的核心概念和最佳实践。

技术趋势展望:

异步架构将成为AI编程助手的标准配置。随着项目复杂度的增加和开发者对效率要求的提高,同步模型的性能天花板会越来越明显。

Open-SWE的技术路线为整个行业指出了明确的发展方向。对于关注AI编程助手技术的开发者来说,现在正是深入了解这一领域的最佳时机。

最后提醒:

在采用新技术时,保持谨慎和务实的态度。先小范围试点,验证效果后再全面推广,确保技术变革为团队带来真正的价值提升。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献53条内容

已为社区贡献53条内容

所有评论(0)