大模型生态的 “通用接口”:MCP 协议到底是什么?

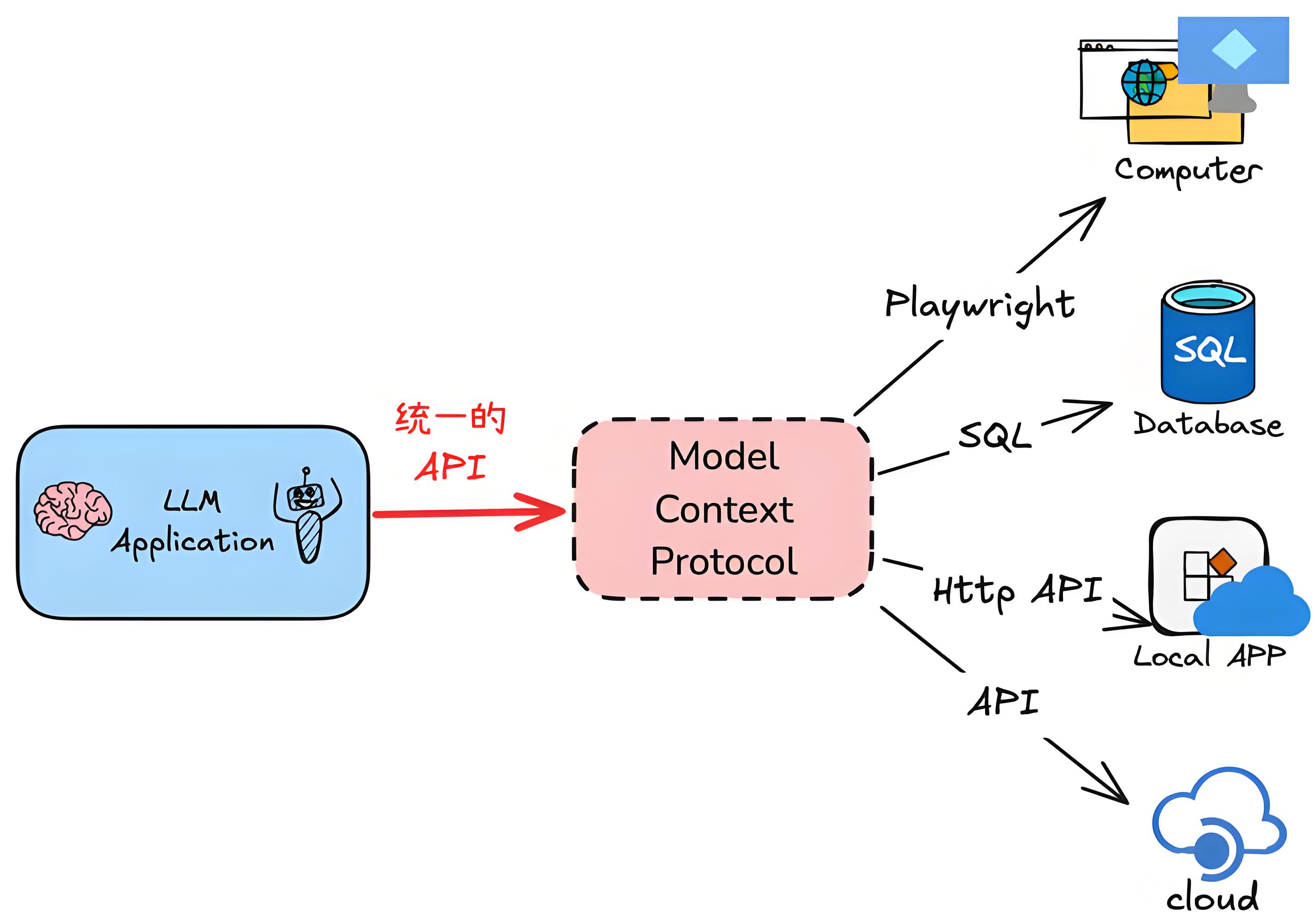

当大模型从文本生成走向工具调用、多模态交互的实用化阶段,模型与外部工具的兼容难题、上下文管理的效率瓶颈,成了制约 AI 落地的关键痛点。而 Anthropic 在 2024 年推出的 MCP(Model Context Protocol,模型上下文协议),正是为解决这一行业痛点而生的标准化方案。它被业内称为大模型领域的 “USB-C 通用接口”,重构了大模型与外部资源的交互逻辑,让不同大模型、各类工具实现 “即插即用”,为大模型的工程化落地和生态协同打开了新空间。本文将从核心定义、核心价值、落地架构三个维度,带你读懂 MCP 协议的核心逻辑。

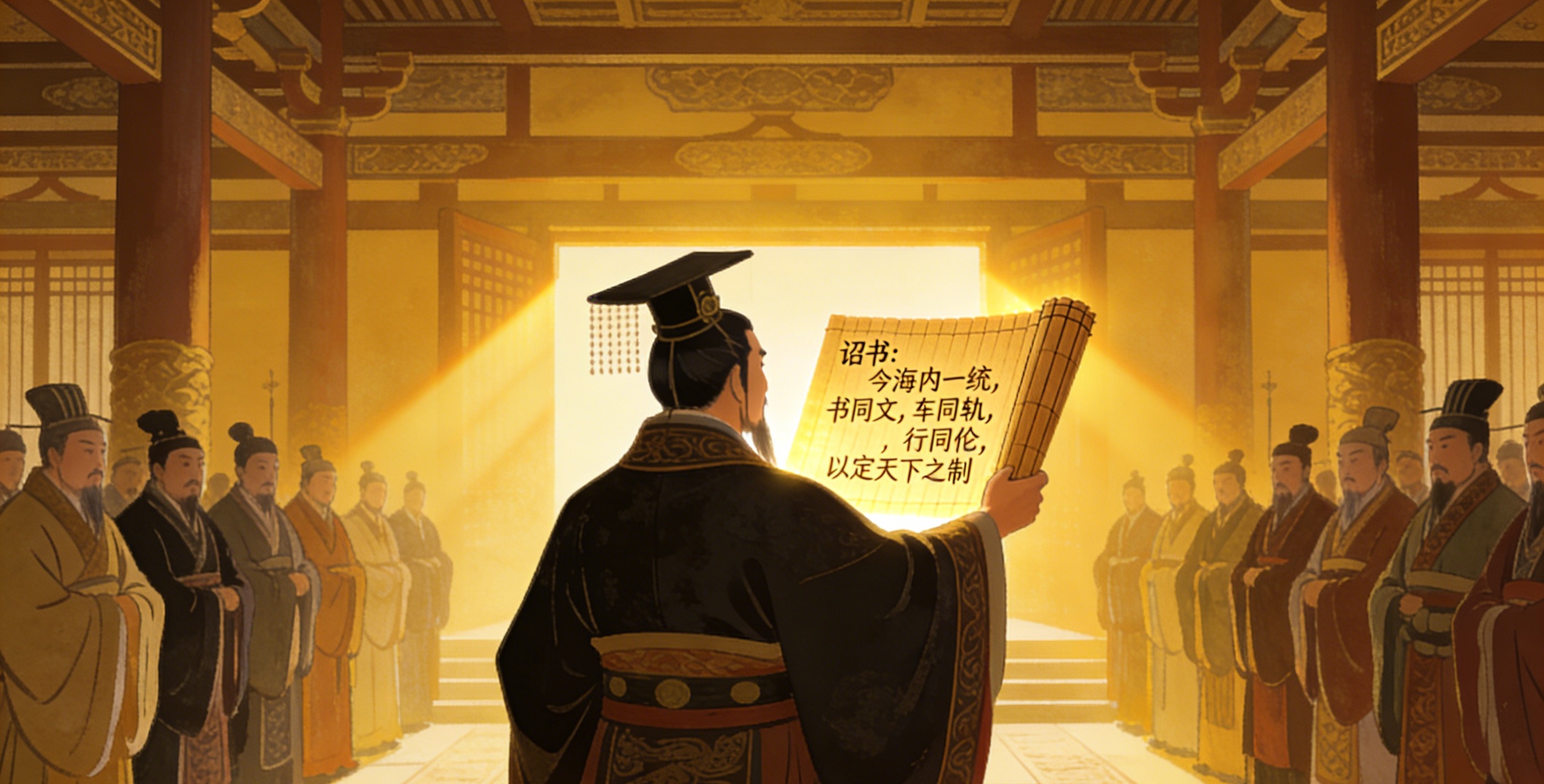

一、MCP 协议:解决大模型生态的 “碎片化” 痛点

在 MCP 协议出现之前,大模型的工具集成和上下文管理一直存在两大行业难题:

一是生态碎片化,GPT、Claude、开源大模型等各有专属的工具交互接口,开发者对接不同模型时,需要重复开发适配代码,效率极低。

二是上下文管理低效,传统大模型的上下文窗口固定,长文本处理时易出现信息丢失,且外部工具调用的上下文无法与模型原生上下文高效协同。

MCP 协议的核心定义,是为大模型设计的开放式、标准化上下文管理与工具交互协议,它通过统一的接口规范,实现了 “大模型 - 上下文 - 外部工具” 的全链路标准化协同。简单来说,只要遵循 MCP 协议,任何大模型都能直接对接任何符合标准的外部工具(数据库、云服务、本地应用等),同时实现上下文的高效压缩、动态调度和分布式管理,让大模型的上下文能力不再受限于硬件,实测可支持 1M tokens 以上的有效上下文长度,大幅提升长文本处理和复杂任务执行能力。

二、三大核心价值:让大模型从 “单打独斗” 到 “生态协同”

MCP 协议的推出,不仅解决了行业痛点,更从开发者、企业、大模型生态三个维度,带来了实质性价值,让大模型的实用化落地迈出关键一步。

- 降低开发者集成成本:无需为不同大模型、不同工具单独开发适配代码,一套基于 MCP 的接口即可实现全场景兼容,大幅减少重复开发工作,提升大模型应用的开发效率;

- 释放大模型工具调用能力:标准化的交互逻辑,让大模型能更高效地调用外部工具,从单纯的 “文本生成器” 升级为能完成数据分析、业务处理、多工具协同的 “AI Agent”,适配更多企业级复杂场景;

- 推动大模型生态标准化:打破不同大模型、不同工具平台之间的 “数据壁垒” 和 “接口壁垒”,让大模型生态从 “各自为战” 走向 “协同发展”,为通用人工智能的落地奠定标准化基础。

三、极简架构:客户端 - 服务器分层,实现高效协同

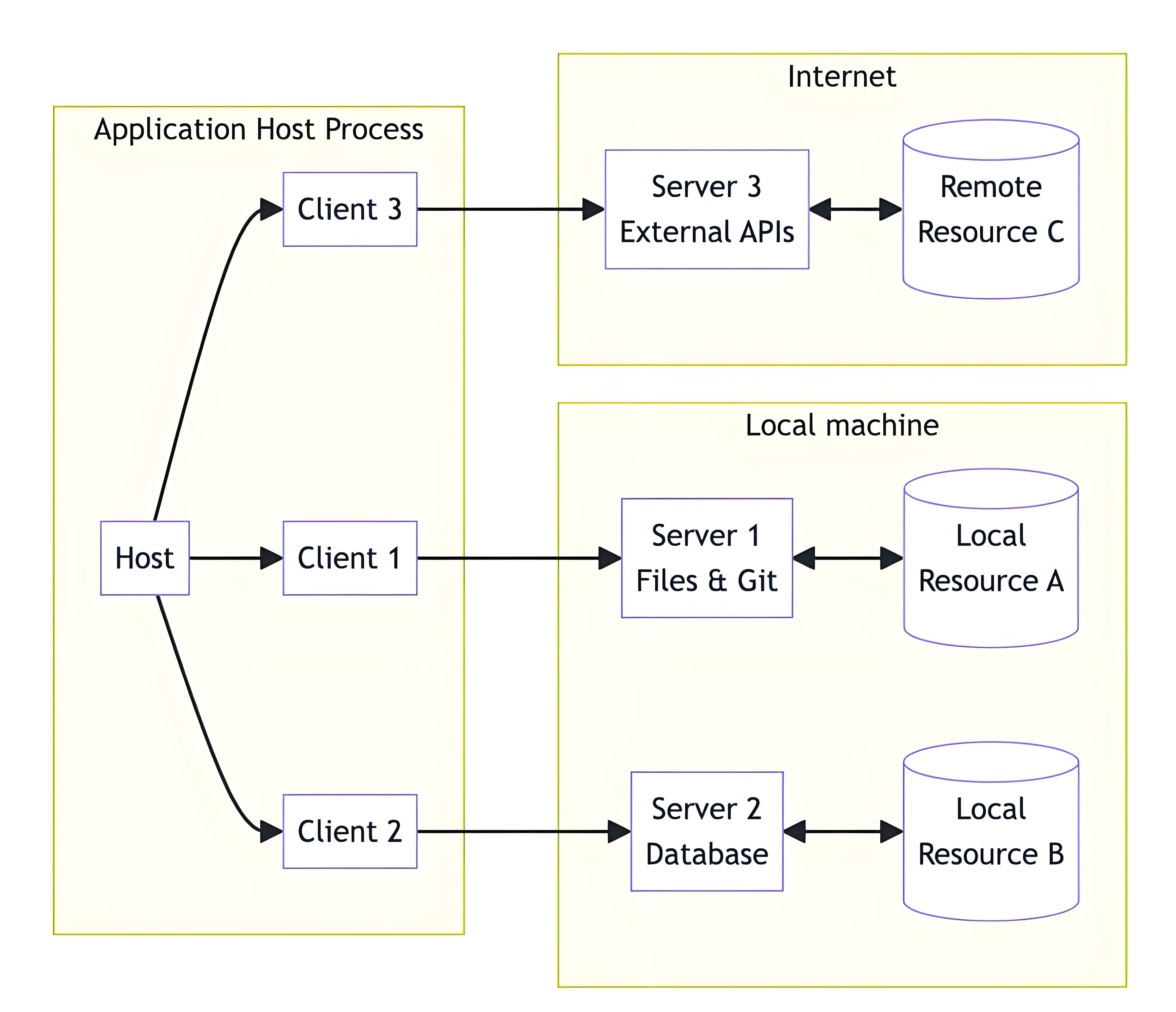

MCP 协议的落地架构并不复杂,采用轻量化的客户端 - 服务器分层设计,兼顾了兼容性和执行效率,无需对大模型本身进行深度改造,即可快速集成,这也是其能快速落地的核心原因。

- 客户端层:运行在大模型本地环境,核心负责转发大模型的工具调用请求、上下文管理请求,同时接收服务器端的返回结果,反馈给大模型,是大模型与 MCP 协议的 “连接入口”;

- 服务器层:封装各类外部工具的能力,提供标准化的接口服务,同时负责上下文的分级存储、动态调度和语义管理,支持 JSON-RPC 2.0 等通用通信协议,兼容绝大多数工具和开发环境;

- 交互层:作为客户端与服务器的桥梁,实现请求的高效传输、数据的标准化解析,确保大模型与外部工具的交互低延迟、高可靠。

整个架构的核心优势在于解耦,将大模型的能力与外部工具的能力、上下文的管理能力拆分开,各自独立迭代,同时通过标准化协议实现协同,既保证了灵活性,又提升了整体效率。

写在最后

MCP 协议的出现,是大模型从 “技术探索” 走向 “工程化落地” 的重要标志。它以标准化的思路,解决了大模型生态的碎片化问题,让大模型的工具调用和上下文管理有了统一的 “游戏规则”。未来,随着更多大模型厂商、工具平台接入 MCP 协议,大模型将真正实现与外部生态的无缝协同,在金融、政务、企业服务等更多领域发挥价值。而 MCP 协议作为大模型生态的 “通用接口”,也将成为通用人工智能落地过程中不可或缺的核心标准之一。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)