YOLOv8【第十三章:模型压缩与极致优化篇·第14节】算子融合(Operator Fusion):深入理解 Conv+BN+ReLU 的合并过程!

🏆 本文收录于 《YOLOv8实战:从入门到深度优化》 专栏。该专栏系统复现并梳理全网各类 YOLOv8 改进与实战案例(当前已覆盖分类 / 检测 / 分割 / 追踪 / 关键点 / OBB 检测等方向),坚持持续更新 + 深度解析,质量分长期稳定在 97 分以上,可视为当前市面上 覆盖较全、更新较快、实战导向极强 的 YOLO 改进系列内容之一。

部分章节也会结合国内外前沿论文与 AIGC 等大模型技术,对主流改进方案进行重构与再设计,内容更偏实战与可落地,适合有工程需求的同学深入学习与对标优化。

✨ 特惠福利:当前限时活动一折秒杀,一次订阅,终身有效,后续所有更新章节全部免费解锁,👉 点此查看详情

🎯 本文定位:计算机视觉 × 模型压缩与极致优化系列

📅 更新时间:2026年

🏷️ 难度等级:⭐⭐⭐⭐⭐(高级进阶)

🔧 技术栈:Python 3.9+ · PyTorch · YOLOv8 · ByteTrack · OpenCV · NumPy

全文目录:

📖 上期回顾

上一节《YOLOv8【第十三章:模型压缩与极致优化篇·第13节】RepVGG 重参数化技术:训练时多路,推理时单路!》内容中,我们深入探讨了 RepVGG 的核心思想——结构重参数化(Structural Re-parameterization)。训练阶段,RepVGG 采用多分支结构(3×3 卷积 + 1×1 卷积 + Identity 恒等映射),通过多路特征融合获得更强的表达能力与更好的优化景观;推理阶段,利用卷积与 BN 层的线性可加性,将所有分支等价合并为一条单路 3×3 卷积,实现了"训练时精度高、推理时速度快"的双赢局面。

核心公式回顾:

W f u s e d = W 1 ⋅ γ σ + W 2 ⋅ γ σ + I ⋅ γ σ W_{fused} = W_1 \cdot \frac{\gamma}{\sigma} + W_2 \cdot \frac{\gamma}{\sigma} + I \cdot \frac{\gamma}{\sigma} Wfused=W1⋅σγ+W2⋅σγ+I⋅σγ

RepVGG 的精髓在于:参数等价变换不改变数学输出,却能大幅改变硬件执行效率。这一思想与本节的算子融合一脉相承——都是在"数学等价"的前提下,对计算图进行结构变换以提升推理性能。

一、引言:为什么算子融合如此重要 🚀

在深度学习模型的推理优化领域,算子融合(Operator Fusion) 是一项被广泛应用却常常被初学者忽视的关键技术。它不改变模型的参数量,不修改网络结构,却能在某些场景下将推理速度提升 2~5 倍,内存带宽占用降低 30%~60%。

要理解算子融合的价值,我们需要先理解现代深度学习推理的本质瓶颈。

1.1 现代 GPU/CPU 的计算特性

现代处理器(无论是 CPU 还是 GPU)的计算能力远超其内存带宽。以 NVIDIA A100 为例:

| 指标 | 数值 |

|---|---|

| FP32 算力 | 19.5 TFLOPS |

| 内存带宽 | 2 TB/s |

| 算术强度阈值 | ~9.75 FLOP/Byte |

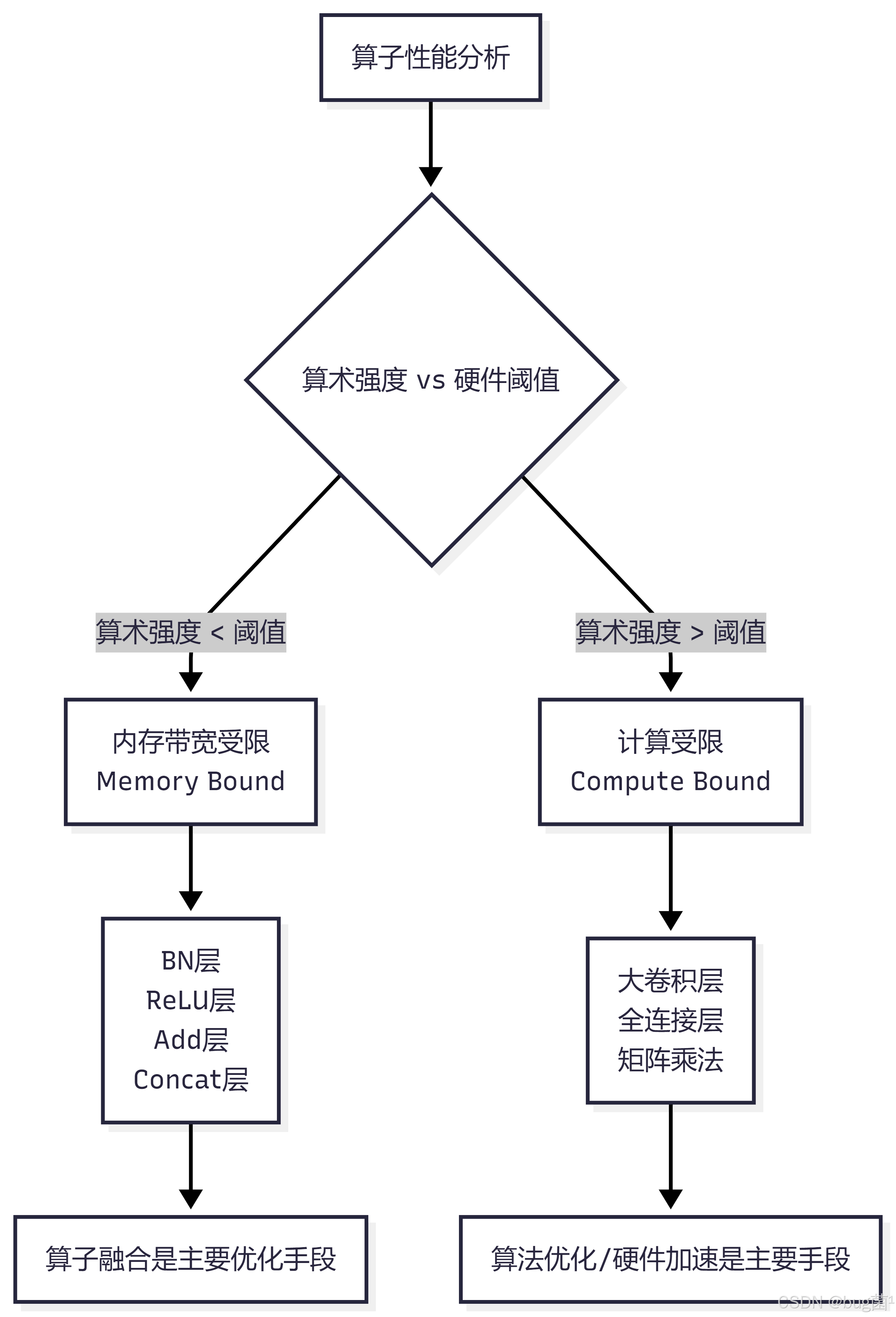

这意味着,如果一个算子的算术强度(计算量 / 内存访问量)低于阈值,它就是内存带宽受限的,而非计算受限的。

对于深度学习中常见的逐元素操作(如 BN、ReLU、Add),其算术强度极低,往往只有 0.5~2 FLOP/Byte,远低于阈值。这类操作的瓶颈完全在于内存读写,而非浮点计算。

1.2 算子融合的核心价值

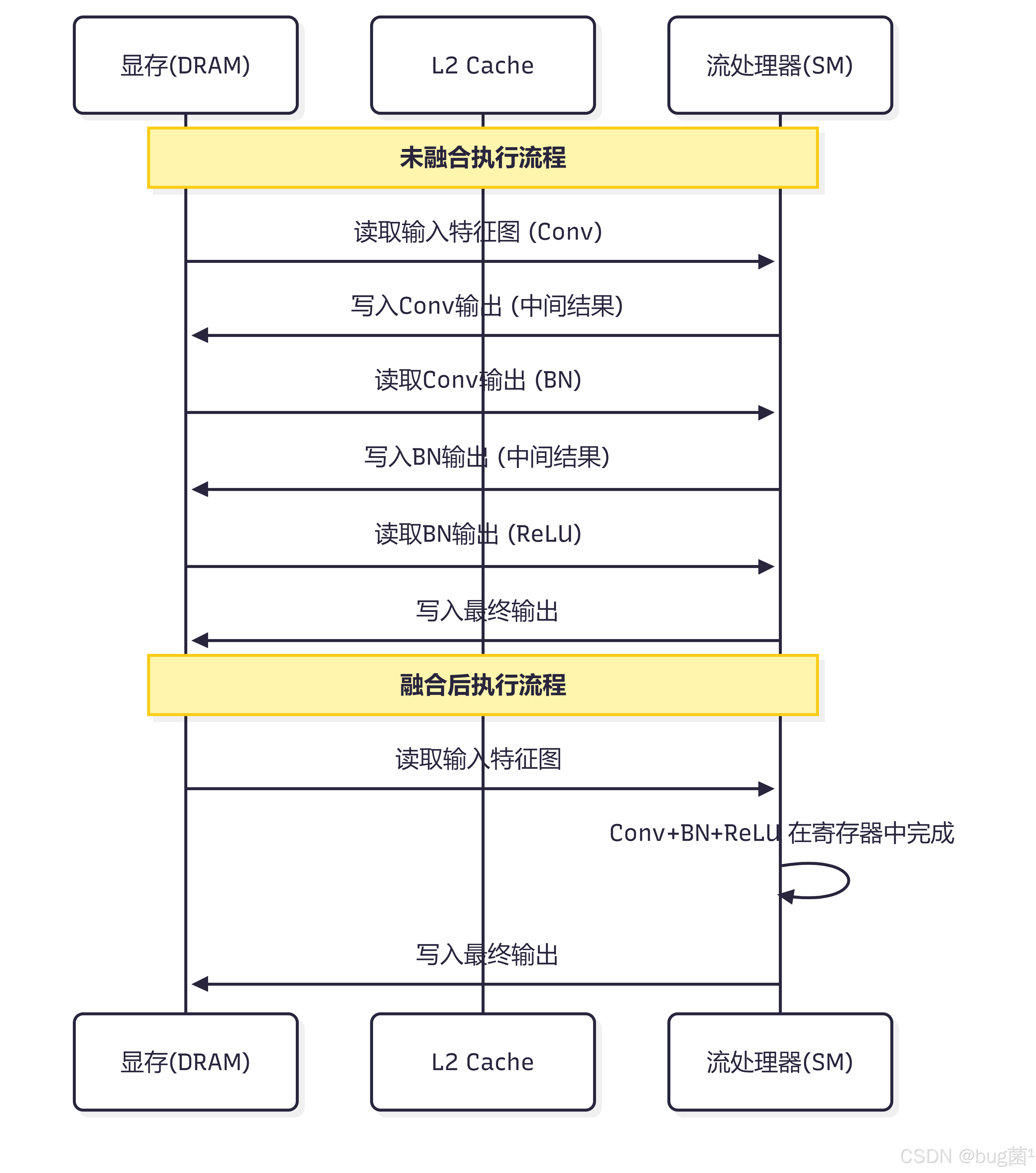

未融合的执行流程:

┌─────────┐ ┌─────────┐ ┌─────────┐ ┌─────────┐

│ Conv │───▶│ BN │───▶│ ReLU │───▶│ 输出 │

│ 计算+写 │ │ 读+计算 │ │ 读+计算 │ │ 写内存 │

│ 内存 │ │ +写内存│ │ +写内存│ │ │

└─────────┘ └─────────┘ └─────────┘ └─────────┘

内存访问:4次(Conv写 + BN读写 + ReLU读写 + 最终写)

融合后的执行流程:

┌──────────────────────────────────┐ ┌─────────┐

│ Conv + BN + ReLU (融合) │───▶│ 输出 │

│ 一次计算,一次内存写入 │ │ 写内存 │

└──────────────────────────────────┘ └─────────┘

内存访问:2次(Conv读输入 + 融合写输出)

算子融合的本质是:减少中间结果的内存读写次数,将多个算子的计算合并在同一个 kernel 中完成。

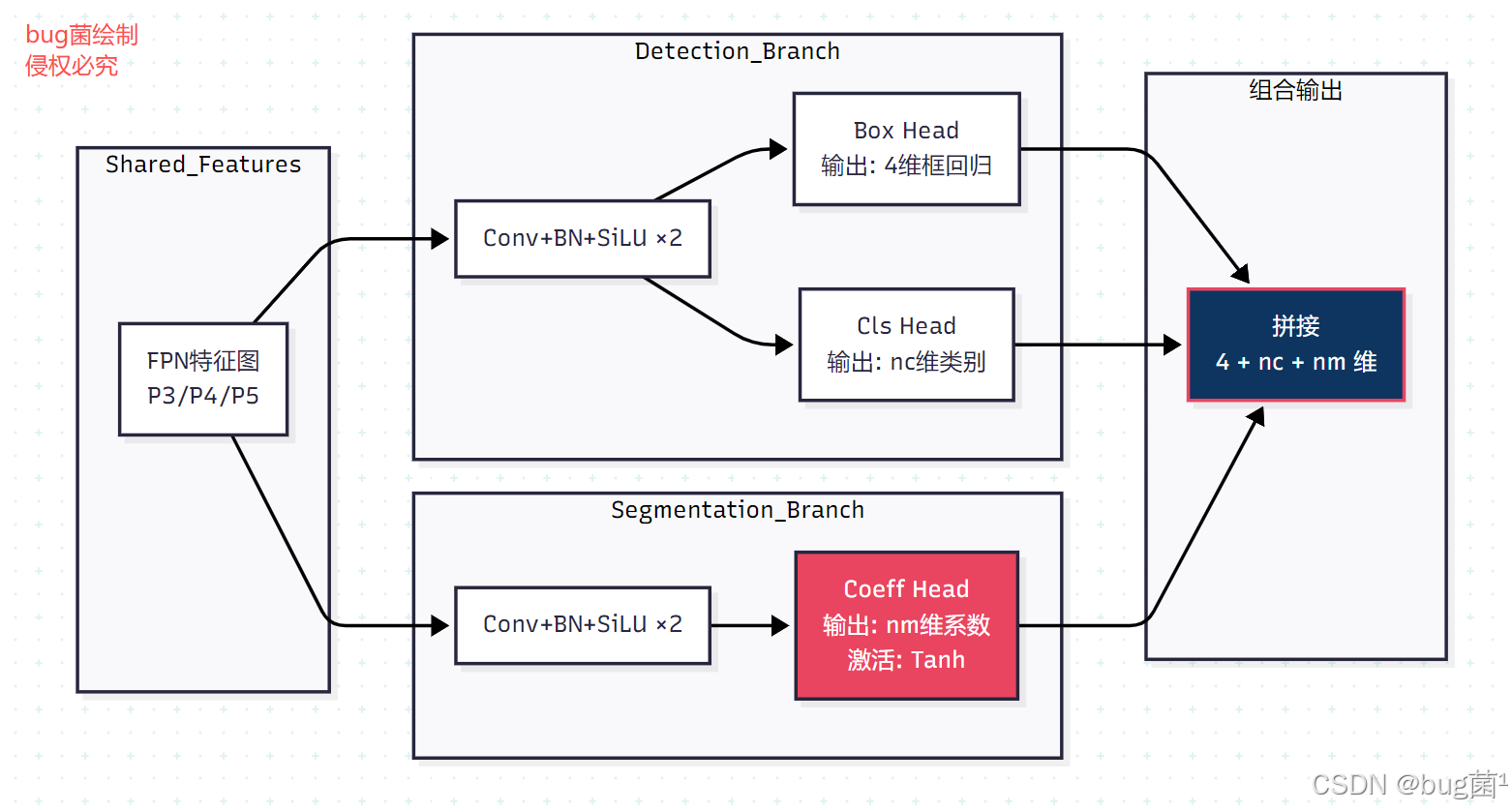

1.3 在 YOLOv8 中的重要性

YOLOv8 的基础构建块 Conv 模块由 Conv2d + BatchNorm2d + SiLU 三个算子组成。一个标准的 YOLOv8n 模型包含约 168 个 这样的 Conv 模块,意味着有 336 次可以被消除的中间内存读写操作。在边缘设备(如 Jetson Nano、树莓派)上,内存带宽极为有限,算子融合的收益尤为显著。

二、深度学习推理的计算瓶颈分析 🔬

2.1 Roofline 模型

Roofline 模型是分析算子性能瓶颈的经典工具。它将算子分为两类:

2.2 各算子的算术强度分析

我们来定量分析 Conv、BN、ReLU 三个算子的算术强度:

Conv2d(以 3×3 卷积为例):

算术强度 ∗ C o n v = 2 ⋅ C ∗ i n ⋅ C o u t ⋅ H ⋅ W ⋅ K 2 ( C i n ⋅ K 2 + C o u t ) ⋅ sizeof ( f l o a t ) \text{算术强度}*{Conv} = \frac{2 \cdot C*{in} \cdot C_{out} \cdot H \cdot W \cdot K^2}{(C_{in} \cdot K^2 + C_{out}) \cdot \text{sizeof}(float)} 算术强度∗Conv=(Cin⋅K2+Cout)⋅sizeof(float)2⋅C∗in⋅Cout⋅H⋅W⋅K2

对于典型参数( C i n = C o u t = 64 , H = W = 56 , K = 3 C_{in}=C_{out}=64, H=W=56, K=3 Cin=Cout=64,H=W=56,K=3):

- 计算量: 2 × 64 × 64 × 56 × 56 × 9 ≈ 2.3 GFLOP 2 \times 64 \times 64 \times 56 \times 56 \times 9 \approx 2.3 \text{ GFLOP} 2×64×64×56×56×9≈2.3 GFLOP

- 内存访问:约 3.5 MB 3.5 \text{ MB} 3.5 MB

- 算术强度: ≈ 657 FLOP/Byte \approx 657 \text{ FLOP/Byte} ≈657 FLOP/Byte(计算受限)

BatchNorm2d:

算术强度 B N = 4 ⋅ C ⋅ H ⋅ W 2 ⋅ C ⋅ H ⋅ W ⋅ sizeof ( f l o a t ) = 4 2 × 4 = 0.5 FLOP/Byte \text{算术强度}_{BN} = \frac{4 \cdot C \cdot H \cdot W}{2 \cdot C \cdot H \cdot W \cdot \text{sizeof}(float)} = \frac{4}{2 \times 4} = 0.5 \text{ FLOP/Byte} 算术强度BN=2⋅C⋅H⋅W⋅sizeof(float)4⋅C⋅H⋅W=2×44=0.5 FLOP/Byte

BN 层每个元素需要 4 次浮点运算(减均值、除标准差、乘 gamma、加 beta),但需要读写整个特征图,算术强度极低,严重内存受限。

ReLU:

算术强度 R e L U = 1 ⋅ C ⋅ H ⋅ W 2 ⋅ C ⋅ H ⋅ W ⋅ sizeof ( f l o a t ) = 1 8 = 0.125 FLOP/Byte \text{算术强度}_{ReLU} = \frac{1 \cdot C \cdot H \cdot W}{2 \cdot C \cdot H \cdot W \cdot \text{sizeof}(float)} = \frac{1}{8} = 0.125 \text{ FLOP/Byte} 算术强度ReLU=2⋅C⋅H⋅W⋅sizeof(float)1⋅C⋅H⋅W=81=0.125 FLOP/Byte

ReLU 的算术强度更低,几乎完全是内存带宽受限。

2.3 内存访问模式对比

三、算子融合的数学基础 📐

3.1 线性算子的可融合性

算子融合的数学基础在于线性变换的可组合性。对于两个线性变换 f f f 和 g g g:

g ( f ( x ) ) = ( g ∘ f ) ( x ) g(f(x)) = (g \circ f)(x) g(f(x))=(g∘f)(x)

如果 f f f 和 g g g 都是线性变换,则它们的复合仍然是线性变换,且可以用单一的参数矩阵表示。

卷积是线性变换:

Conv ( x ; W , b ) = W ∗ x + b \text{Conv}(x; W, b) = W * x + b Conv(x;W,b)=W∗x+b

BN 在推理时是线性变换:

BN ( x ; γ , β , μ , σ ) = γ σ ( x − μ ) + β = γ σ x + ( β − γ μ σ ) \text{BN}(x; \gamma, \beta, \mu, \sigma) = \frac{\gamma}{\sigma}(x - \mu) + \beta = \frac{\gamma}{\sigma}x + \left(\beta - \frac{\gamma \mu}{\sigma}\right) BN(x;γ,β,μ,σ)=σγ(x−μ)+β=σγx+(β−σγμ)

因此,Conv 后接 BN 的复合操作:

BN ( Conv ( x ) ) = γ σ ( W ∗ x + b − μ ) + β \text{BN}(\text{Conv}(x)) = \frac{\gamma}{\sigma}(W * x + b - \mu) + \beta BN(Conv(x))=σγ(W∗x+b−μ)+β

这仍然是一个线性变换,可以等价地表示为一个新的卷积操作。

3.2 非线性激活函数的处理

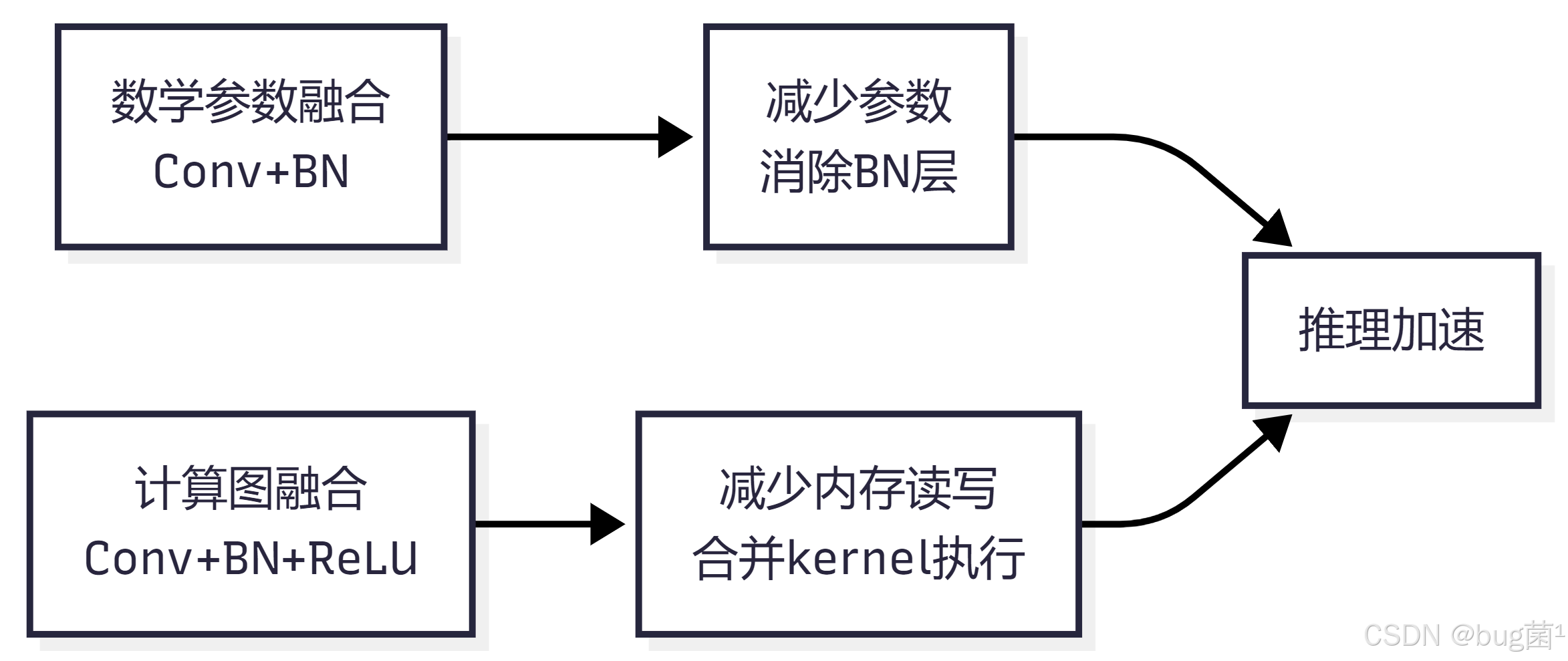

ReLU 是非线性函数,无法直接与前面的线性变换合并为单一线性算子。但在实现层面,我们可以将 ReLU 的计算融合进同一个 CUDA kernel 中,避免中间结果写回显存,这是一种计算图层面的融合,而非数学层面的参数合并。

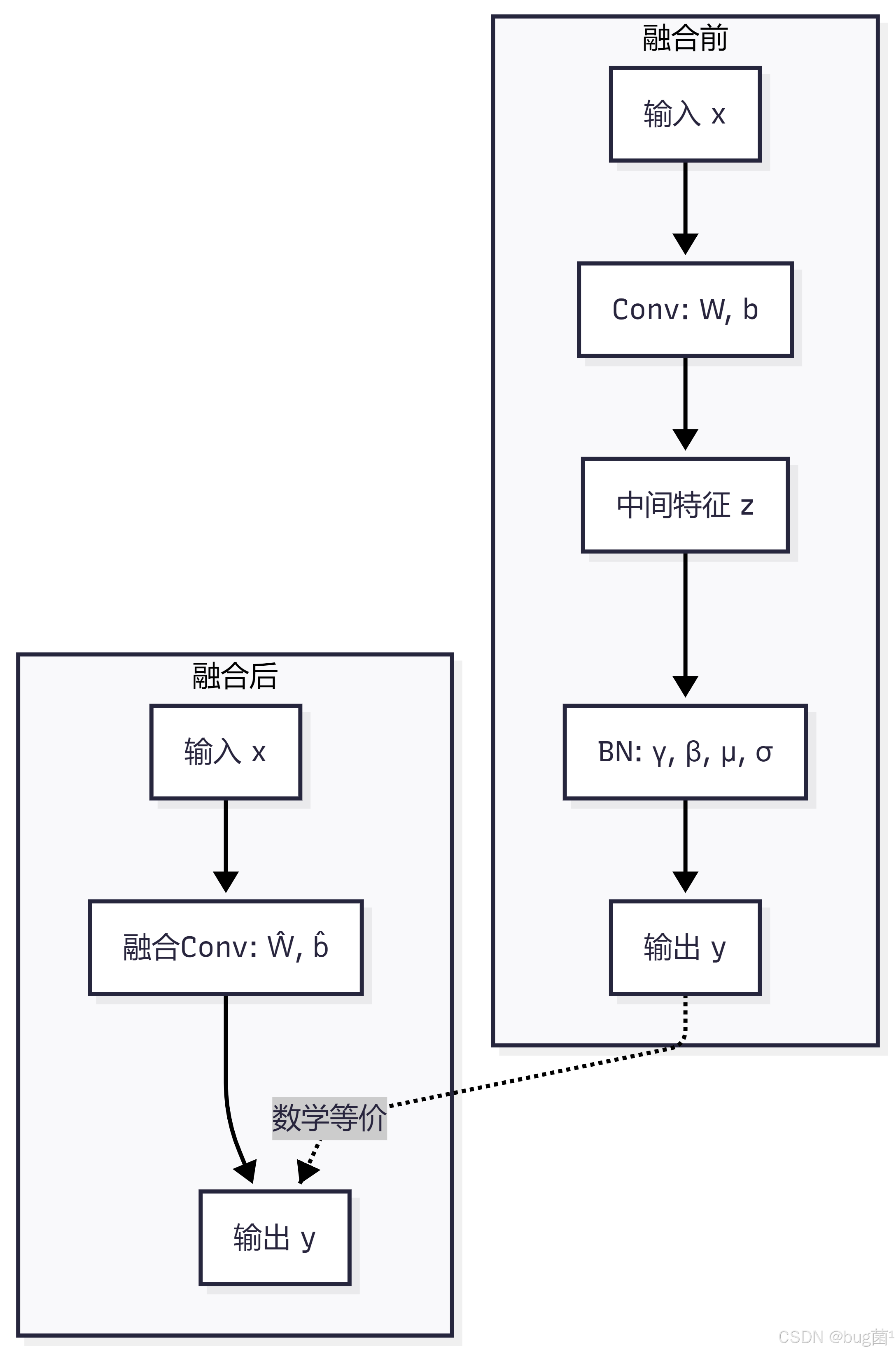

四、Conv + BN 融合:原理与推导 🧮

4.1 BatchNorm 的推理时行为

在训练阶段,BN 使用当前 mini-batch 的统计量;在推理阶段,BN 使用训练过程中累积的运行均值(running_mean) 和运行方差(running_var),此时 BN 退化为一个确定性的线性变换。

推理时 BN 的计算公式:

y = x − μ r u n n i n g σ r u n n i n g 2 + ϵ ⋅ γ + β y = \frac{x - \mu_{running}}{\sqrt{\sigma^2_{running} + \epsilon}} \cdot \gamma + \beta y=σrunning2+ϵx−μrunning⋅γ+β

其中:

- μ r u n n i n g \mu_{running} μrunning:训练时累积的通道均值,形状 ( C , ) (C,) (C,)

- σ r u n n i n g 2 \sigma^2_{running} σrunning2:训练时累积的通道方差,形状 ( C , ) (C,) (C,)

- γ \gamma γ:可学习的缩放参数,形状 ( C , ) (C,) (C,)

- β \beta β:可学习的偏移参数,形状 ( C , ) (C,) (C,)

- ϵ \epsilon ϵ:数值稳定性常数,通常为 1 e − 5 1e^{-5} 1e−5

4.2 融合推导过程

设卷积操作为:

z = W ∗ x + b z = W * x + b z=W∗x+b

其中 W ∈ R C o u t × C i n × K × K W \in \mathbb{R}^{C_{out} \times C_{in} \times K \times K} W∈RCout×Cin×K×K, b ∈ R C o u t b \in \mathbb{R}^{C_{out}} b∈RCout

BN 操作(推理时)为:

y c = z c − μ c σ c 2 + ϵ ⋅ γ c + β c y_c = \frac{z_c - \mu_c}{\sqrt{\sigma^2_c + \epsilon}} \cdot \gamma_c + \beta_c yc=σc2+ϵzc−μc⋅γc+βc

将卷积结果代入 BN:

y c = ( W c ∗ x + b c ) − μ c σ c 2 + ϵ ⋅ γ c + β c y_c = \frac{(W_c * x + b_c) - \mu_c}{\sqrt{\sigma^2_c + \epsilon}} \cdot \gamma_c + \beta_c yc=σc2+ϵ(Wc∗x+bc)−μc⋅γc+βc

y c = γ c σ c 2 + ϵ ⋅ ( W c ∗ x ) + γ c σ c 2 + ϵ ⋅ ( b c − μ c ) + β c y_c = \frac{\gamma_c}{\sqrt{\sigma^2_c + \epsilon}} \cdot (W_c * x) + \frac{\gamma_c}{\sqrt{\sigma^2_c + \epsilon}} \cdot (b_c - \mu_c) + \beta_c yc=σc2+ϵγc⋅(Wc∗x)+σc2+ϵγc⋅(bc−μc)+βc

令:

W ^ c = γ c σ c 2 + ϵ ⋅ W c \hat{W}_c = \frac{\gamma_c}{\sqrt{\sigma^2_c + \epsilon}} \cdot W_c W^c=σc2+ϵγc⋅Wc

b ^ c = γ c σ c 2 + ϵ ⋅ ( b c − μ c ) + β c \hat{b}_c = \frac{\gamma_c}{\sqrt{\sigma^2_c + \epsilon}} \cdot (b_c - \mu_c) + \beta_c b^c=σc2+ϵγc⋅(bc−μc)+βc

则融合后的卷积等价为:

y = W ^ ∗ x + b ^ y = \hat{W} * x + \hat{b} y=W^∗x+b^

这就是 Conv+BN 融合的完整数学推导。 融合后,BN 层被完全消除,其参数被吸收进卷积层的权重和偏置中。

4.3 融合的几何意义

4.4 代码实现:Conv+BN 参数融合

import torch

import torch.nn as nn

import numpy as np

def fuse_conv_bn(conv: nn.Conv2d, bn: nn.BatchNorm2d) -> nn.Conv2d:

"""

将 Conv2d 和 BatchNorm2d 的参数融合为单个 Conv2d。

数学原理:

融合后权重: Ŵ_c = (γ_c / sqrt(σ²_c + ε)) * W_c

融合后偏置: b̂_c = (γ_c / sqrt(σ²_c + ε)) * (b_c - μ_c) + β_c

Args:

conv: 待融合的卷积层(可以有偏置,也可以没有)

bn: 紧跟在 conv 后面的 BN 层

Returns:

融合后的 Conv2d 层(带偏置)

"""

# ── 第一步:提取 BN 参数 ──────────────────────────────────────────

# gamma (weight): 可学习缩放参数,形状 (C_out,)

gamma = bn.weight.data

# beta (bias): 可学习偏移参数,形状 (C_out,)

beta = bn.bias.data

# running_mean: 训练时累积的通道均值,形状 (C_out,)

mean = bn.running_mean

# running_var: 训练时累积的通道方差,形状 (C_out,)

var = bn.running_var

# epsilon: 数值稳定性常数

eps = bn.eps

# ── 第二步:计算缩放因子 ──────────────────────────────────────────

# std_inv = γ / sqrt(σ² + ε),形状 (C_out,)

std_inv = gamma / torch.sqrt(var + eps)

# ── 第三步:计算融合后的卷积权重 ─────────────────────────────────

# conv.weight 形状: (C_out, C_in, K, K)

# std_inv 需要 reshape 为 (C_out, 1, 1, 1) 以便广播

fused_weight = conv.weight.data * std_inv.view(-1, 1, 1, 1)

# ── 第四步:计算融合后的偏置 ──────────────────────────────────────

# 如果原始 conv 有偏置,需要先减去 BN 的均值

if conv.bias is not None:

conv_bias = conv.bias.data

else:

# 没有偏置时,等价于偏置为 0

conv_bias = torch.zeros(conv.out_channels, device=conv.weight.device)

# b̂_c = std_inv_c * (b_c - μ_c) + β_c

fused_bias = std_inv * (conv_bias - mean) + beta

# ── 第五步:构建融合后的 Conv2d 层 ───────────────────────────────

fused_conv = nn.Conv2d(

in_channels=conv.in_channels,

out_channels=conv.out_channels,

kernel_size=conv.kernel_size,

stride=conv.stride,

padding=conv.padding,

dilation=conv.dilation,

groups=conv.groups,

bias=True # 融合后必须有偏置

)

# 将融合后的参数赋值给新卷积层

fused_conv.weight.data = fused_weight

fused_conv.bias.data = fused_bias

return fused_conv

def verify_fusion_correctness():

"""

验证 Conv+BN 融合前后输出的数值一致性。

"""

torch.manual_seed(42)

# 构建原始 Conv+BN 模块

conv = nn.Conv2d(32, 64, kernel_size=3, padding=1, bias=False)

bn = nn.BatchNorm2d(64)

# 模拟训练后的 BN 统计量(随机初始化模拟真实场景)

bn.running_mean.data = torch.randn(64)

bn.running_var.data = torch.abs(torch.randn(64)) + 0.1 # 确保方差为正

bn.weight.data = torch.randn(64)

bn.bias.data = torch.randn(64)

# 切换到推理模式(使用 running stats)

conv.eval()

bn.eval()

# 执行融合

fused_conv = fuse_conv_bn(conv, bn)

fused_conv.eval()

# 生成随机输入

x = torch.randn(2, 32, 56, 56)

# 计算原始输出

with torch.no_grad():

original_output = bn(conv(x))

fused_output = fused_conv(x)

# 计算最大绝对误差

max_error = torch.max(torch.abs(original_output - fused_output)).item()

print(f"✅ 融合验证结果:")

print(f" 原始输出形状: {original_output.shape}")

print(f" 融合输出形状: {fused_output.shape}")

print(f" 最大绝对误差: {max_error:.2e}")

print(f" 数值一致性: {'通过 ✓' if max_error < 1e-5 else '失败 ✗'}")

return max_error < 1e-5

if __name__ == "__main__":

verify_fusion_correctness()

代码解析:

-

std_inv = gamma / torch.sqrt(var + eps):这是融合的核心缩放因子,将 BN 的归一化和缩放合并为一个乘法系数。 -

fused_weight = conv.weight.data * std_inv.view(-1, 1, 1, 1):通过广播机制,对每个输出通道的卷积核乘以对应的缩放因子。view(-1, 1, 1, 1)将形状从(C_out,)变为(C_out, 1, 1, 1),使其能与(C_out, C_in, K, K)的权重张量广播相乘。 -

fused_bias = std_inv * (conv_bias - mean) + beta:融合后的偏置综合了原始卷积偏置、BN 均值、BN 缩放和 BN 偏移四个参数。

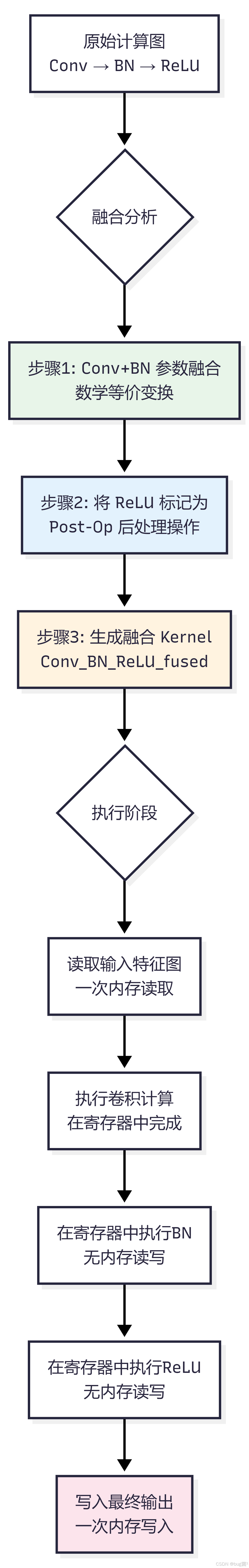

五、Conv + BN + ReLU 融合:完整流程 ⚡

5.1 ReLU 的特殊性

ReLU 是非线性函数: ReLU ( x ) = max ( 0 , x ) \text{ReLU}(x) = \max(0, x) ReLU(x)=max(0,x)

它无法像 BN 那样被数学地吸收进卷积参数中。但在工程实现层面,我们可以通过以下方式实现融合:

方式一:CUDA Kernel 融合

在同一个 CUDA kernel 中,完成 Conv 计算后立即在寄存器中执行 BN 和 ReLU,避免中间结果写回显存。

方式二:计算图优化

推理框架(TensorRT、ONNX Runtime 等)在编译计算图时,识别 Conv+BN+ReLU 模式,将其替换为单一的融合算子。

5.2 完整的融合流程图

5.3 SiLU 激活函数的融合

YOLOv8 使用 SiLU(Sigmoid Linear Unit)而非 ReLU:

SiLU ( x ) = x ⋅ σ ( x ) = x 1 + e − x \text{SiLU}(x) = x \cdot \sigma(x) = \frac{x}{1 + e^{-x}} SiLU(x)=x⋅σ(x)=1+e−xx

SiLU 同样是非线性函数,但同样可以通过 kernel 融合的方式与 Conv+BN 合并执行。

import torch

import torch.nn as nn

import time

class ConvBNReLU_Unfused(nn.Module):

"""

未融合的 Conv + BN + ReLU 模块(用于对比基准)

"""

def __init__(self, in_channels, out_channels, kernel_size=3, stride=1, padding=1):

super().__init__()

# 三个独立的算子,推理时会产生中间内存读写

self.conv = nn.Conv2d(in_channels, out_channels, kernel_size,

stride=stride, padding=padding, bias=False)

self.bn = nn.BatchNorm2d(out_channels)

self.relu = nn.ReLU(inplace=True)

def forward(self, x):

# 每个算子独立执行,产生中间内存读写

x = self.conv(x) # 写入显存

x = self.bn(x) # 读+写显存

x = self.relu(x) # 读+写显存

return x

class ConvBNReLU_Fused(nn.Module):

"""

融合后的 Conv + BN + ReLU 模块

Conv 和 BN 参数已合并,ReLU 通过 inplace 操作减少内存分配

"""

def __init__(self, in_channels, out_channels, kernel_size=3, stride=1, padding=1):

super().__init__()

# 融合后只有一个卷积层(带偏置,吸收了BN参数)

self.conv = nn.Conv2d(in_channels, out_channels, kernel_size,

stride=stride, padding=padding, bias=True)

self.relu = nn.ReLU(inplace=True)

def forward(self, x):

# Conv 和 BN 已合并,只有一次卷积计算

x = self.conv(x)

x = self.relu(x)

return x

@classmethod

def from_unfused(cls, unfused_module: ConvBNReLU_Unfused) -> 'ConvBNReLU_Fused':

"""

从未融合模块创建融合模块的工厂方法。

Args:

unfused_module: 已训练好的未融合模块(必须处于 eval 模式)

Returns:

参数等价的融合模块

"""

# 确保在推理模式下融合

unfused_module.eval()

# 提取原始参数

conv = unfused_module.conv

bn = unfused_module.bn

# 创建融合实例

fused = cls(

in_channels=conv.in_channels,

out_channels=conv.out_channels,

kernel_size=conv.kernel_size[0],

stride=conv.stride[0],

padding=conv.padding[0]

)

# 执行 Conv+BN 参数融合

fused_conv = fuse_conv_bn(conv, bn)

fused.conv.weight.data = fused_conv.weight.data

fused.conv.bias.data = fused_conv.bias.data

return fused

def benchmark_fusion(batch_size=8, channels=64, height=56, width=56, warmup=10, runs=100):

"""

对比融合前后的推理速度。

Args:

batch_size: 批次大小

channels: 通道数

height: 特征图高度

width: 特征图宽度

warmup: 预热次数(排除 CUDA 初始化开销)

runs: 测试运行次数

"""

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

# 创建未融合和融合模块

unfused = ConvBNReLU_Unfused(channels, channels).to(device).eval()

fused = ConvBNReLU_Fused.from_unfused(unfused).to(device).eval()

# 生成随机输入

x = torch.randn(batch_size, channels, height, width, device=device)

# ── 预热阶段 ──────────────────────────────────────────────────────

with torch.no_grad():

for _ in range(warmup):

_ = unfused(x)

_ = fused(x)

# ── 测试未融合版本 ────────────────────────────────────────────────

if device.type == "cuda":

torch.cuda.synchronize()

start_time = time.time()

with torch.no_grad():

for _ in range(runs):

_ = unfused(x)

if device.type == "cuda":

torch.cuda.synchronize()

unfused_time = (time.time() - start_time) / runs * 1000 # 转换为毫秒

# ── 测试融合版本 ──────────────────────────────────────────────────

if device.type == "cuda":

torch.cuda.synchronize()

start_time = time.time()

with torch.no_grad():

for _ in range(runs):

_ = fused(x)

if device.type == "cuda":

torch.cuda.synchronize()

fused_time = (time.time() - start_time) / runs * 1000 # 转换为毫秒

# ── 计算加速比 ────────────────────────────────────────────────────

speedup = unfused_time / fused_time

improvement = (1 - fused_time / unfused_time) * 100

print(f"\n{'='*60}")

print(f"🚀 Conv+BN+ReLU 融合性能对比")

print(f"{'='*60}")

print(f"输入形状: ({batch_size}, {channels}, {height}, {width})")

print(f"设备: {device}")

print(f"{'-'*60}")

print(f"未融合版本耗时: {unfused_time:.4f} ms")

print(f"融合版本耗时: {fused_time:.4f} ms")

print(f"{'-'*60}")

print(f"加速比: {speedup:.2f}x")

print(f"性能提升: {improvement:.2f}%")

print(f"{'='*60}\n")

return {

"unfused_time": unfused_time,

"fused_time": fused_time,

"speedup": speedup,

"improvement": improvement

}

if __name__ == "__main__":

# 验证融合的数值正确性

print("📋 验证 Conv+BN 融合的数值一致性...")

verify_fusion_correctness()

# 性能基准测试

print("\n📊 执行性能基准测试...")

benchmark_fusion(batch_size=8, channels=64, height=56, width=56, runs=100)

代码解析:

-

ConvBNReLU_Unfused:模拟未优化的实现,三个算子独立执行,每个算子都会产生中间结果的内存读写。 -

ConvBNReLU_Fused:融合实现,Conv 和 BN 参数已合并,ReLU 使用inplace=True减少内存分配。 -

from_unfused工厂方法:从已训练的未融合模块创建参数等价的融合模块,确保两者输出完全相同。 -

benchmark_fusion函数:- 预热阶段排除 CUDA 初始化开销

- 使用

torch.cuda.synchronize()确保 GPU 操作完全完成后再计时 - 计算加速比和性能提升百分比

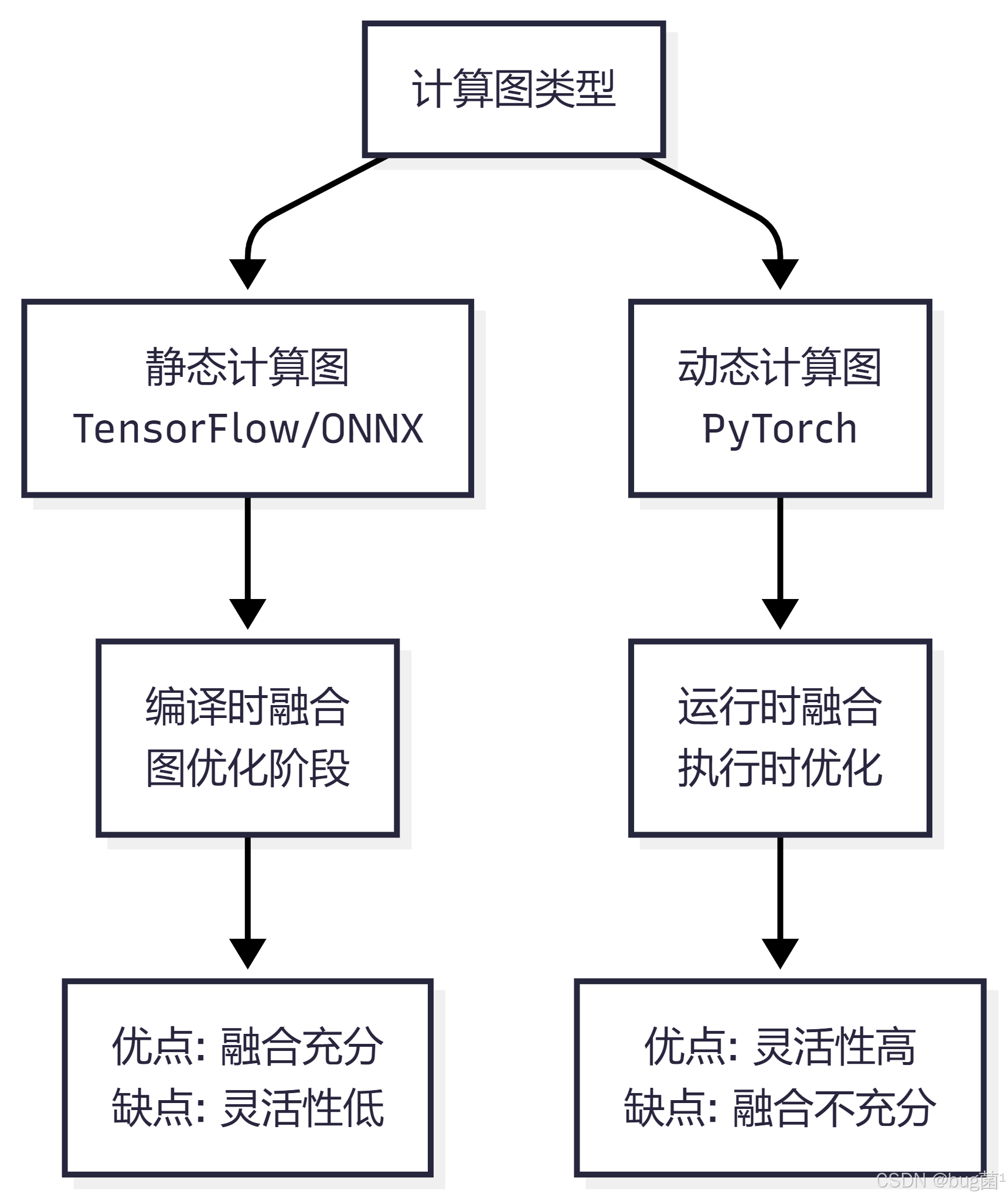

六、计算图层面的融合机制 🔗

6.1 静态计算图 vs 动态计算图

深度学习框架对算子融合的支持方式不同:

6.2 ONNX 中的算子融合

ONNX(Open Neural Network Exchange)是跨框架的模型标准格式。ONNX Runtime 在推理时会自动识别可融合的算子模式。

import onnx

from onnxruntime.transformers import optimizer

def export_and_optimize_onnx(model, dummy_input, output_path="model.onnx"):

"""

将 PyTorch 模型导出为 ONNX,并应用融合优化。

Args:

model: PyTorch 模型

dummy_input: 用于 trace 的虚拟输入

output_path: ONNX 文件保存路径

"""

# 导出为 ONNX

torch.onnx.export(

model,

dummy_input,

output_path,

opset_version=13,

input_names=["input"],

output_names=["output"],

dynamic_axes={"input": {0: "batch_size"}}

)

# 加载 ONNX 模型

onnx_model = onnx.load(output_path)

# 应用优化(包括算子融合)

optimized_model = optimizer.optimize_model(

output_path,

model_type="bert", # 这里仅作示例,实际应根据模型类型调整

num_heads=None,

hidden_size=None

)

print(f"✅ ONNX 模型已优化并保存到: {output_path}")

return optimized_model

6.3 TensorRT 中的融合策略

NVIDIA TensorRT 是专为推理优化的引擎,内置了强大的算子融合能力。

import tensorrt as trt

def build_tensorrt_engine(onnx_path, engine_path, max_batch_size=8):

"""

使用 TensorRT 构建优化引擎,自动执行算子融合。

Args:

onnx_path: ONNX 模型路径

engine_path: 输出引擎路径

max_batch_size: 最大批次大小

"""

logger = trt.Logger(trt.Logger.WARNING)

builder = trt.Builder(logger)

# 创建网络定义

network = builder.create_network(

1 << int(trt.NetworkDefinitionCreationFlag.EXPLICIT_BATCH)

)

# 从 ONNX 导入

parser = trt.OnnxParser(network, logger)

with open(onnx_path, "rb") as f:

parser.parse(f.read())

# 配置构建器

config = builder.create_builder_config()

config.max_workspace_size = 1 << 30 # 1GB

# 启用 FP16 精度(可选,进一步加速)

if builder.platform_has_fast_fp16:

config.set_flag(trt.BuilderFlag.FP16)

# 构建引擎(TensorRT 在此阶段自动执行融合)

engine = builder.build_engine(network, config)

# 保存引擎

with open(engine_path, "wb") as f:

f.write(engine.serialize())

print(f"✅ TensorRT 引擎已构建并保存到: {engine_path}")

print(f" TensorRT 已自动执行算子融合优化")

return engine

七、主流框架中的算子融合实现 🛠️

7.1 PyTorch 的融合方案

PyTorch 提供了 torch.jit.script 和 torch.jit.trace 两种 JIT 编译方式,可以在编译时进行算子融合。

import torch

import torch.nn as nn

class YOLOv8Block(nn.Module):

"""

YOLOv8 的基础 Conv 块:Conv + BatchNorm + SiLU

"""

def __init__(self, in_channels, out_channels, kernel_size=3, stride=1):

super().__init__()

self.conv = nn.Conv2d(

in_channels, out_channels, kernel_size,

stride=stride, padding=kernel_size // 2, bias=False

)

self.bn = nn.BatchNorm2d(out_channels)

self.silu = nn.SiLU(inplace=True)

def forward(self, x):

return self.silu(self.bn(self.conv(x)))

class YOLOv8BlockFused(nn.Module):

"""

融合版本的 YOLOv8 块

"""

def __init__(self, in_channels, out_channels, kernel_size=3, stride=1):

super().__init__()

self.conv = nn.Conv2d(

in_channels, out_channels, kernel_size,

stride=stride, padding=kernel_size // 2, bias=True

)

self.silu = nn.SiLU(inplace=True)

def forward(self, x):

return self.silu(self.conv(x))

@classmethod

def from_unfused(cls, unfused_block: YOLOv8Block) -> 'YOLOv8BlockFused':

"""从未融合块创建融合块"""

unfused_block.eval()

fused = cls(

in_channels=unfused_block.conv.in_channels,

out_channels=unfused_block.conv.out_channels,

kernel_size=unfused_block.conv.kernel_size[0],

stride=unfused_block.conv.stride[0]

)

# 融合 Conv+BN 参数

fused_conv = fuse_conv_bn(unfused_block.conv, unfused_block.bn)

fused.conv.weight.data = fused_conv.weight.data

fused.conv.bias.data = fused_conv.bias.data

return fused

def fuse_pytorch_model(model: nn.Module) -> nn.Module:

"""

递归遍历模型,融合所有 Conv+BN 对。

Args:

model: 待融合的 PyTorch 模型

Returns:

融合后的模型

"""

# PyTorch 内置的融合函数(仅支持特定模式)

model = torch.nn.utils.fusion.fuse_conv_bn_eval(model)

return model

# 使用示例

if __name__ == "__main__":

# 创建未融合模型

unfused_model = YOLOv8Block(64, 128).eval()

# 方法1:使用 PyTorch 内置融合

fused_model_builtin = fuse_pytorch_model(unfused_model)

# 方法2:使用自定义融合

fused_model_custom = YOLOv8BlockFused.from_unfused(unfused_model)

# 验证输出一致性

x = torch.randn(1, 64, 56, 56)

with torch.no_grad():

out_unfused = unfused_model(x)

out_fused = fused_model_custom(x)

print(f"输出差异: {torch.max(torch.abs(out_unfused - out_fused)).item():.2e}")

7.2 TensorFlow 的融合方案

TensorFlow 在 tf.function 编译时自动执行融合优化。

import tensorflow as tf

class TFConvBNReLU(tf.keras.layers.Layer):

"""TensorFlow 版本的 Conv+BN+ReLU"""

def __init__(self, filters, kernel_size=3, **kwargs):

super().__init__(**kwargs)

self.conv = tf.keras.layers.Conv2D(

filters, kernel_size, padding="same", use_bias=False

)

self.bn = tf.keras.layers.BatchNormalization()

self.relu = tf.keras.layers.ReLU()

def call(self, x, training=False):

x = self.conv(x)

x = self.bn(x, training=training)

x = self.relu(x)

return x

def convert_to_tflite_with_fusion(model, representative_data_gen):

"""

将 TensorFlow 模型转换为 TFLite,自动执行融合优化。

Args:

model: Keras 模型

representative_data_gen: 代表性数据生成器(用于量化)

Returns:

优化后的 TFLite 模型字节

"""

converter = tf.lite.TFLiteConverter.from_keras_model(model)

# 启用优化(包括算子融合)

converter.optimizations = [tf.lite.Optimize.DEFAULT]

# 提供代表性数据用于量化

converter.representative_data = representative_data_gen

# 转换

tflite_model = converter.convert()

return tflite_model

八、YOLOv8 中的算子融合实践 🎯

8.1 YOLOv8 的标准 Conv 块结构

YOLOv8 的每个卷积块都遵循相同的模式:

class Conv(nn.Module):

"""YOLOv8 标准卷积块"""

default_act = nn.SiLU() # 默认激活函数

def __init__(self, c1, c2, k=1, s=1, p=None, g=1, d=1, act=True):

super().__init__()

self.conv = nn.Conv2d(c1, c2, k, s, autopad(k, p), groups=g,

dilation=d, bias=False)

self.bn = nn.BatchNorm2d(c2)

self.act = self.default_act if act is True else (

act if isinstance(act, nn.Module) else nn.Identity()

)

def forward(self, x):

return self.act(self.bn(self.conv(x)))

def fuse(self):

"""融合 Conv+BN,返回融合后的模块"""

self.conv = fuse_conv_bn(self.conv, self.bn)

self.bn = nn.Identity() # BN 被消除

return self

8.2 对整个 YOLOv8 模型进行融合

def fuse_yolov8_model(model):

"""

遍历 YOLOv8 模型的所有 Conv 块,执行融合。

Args:

model: YOLOv8 模型实例

Returns:

融合后的模型

"""

from ultralytics.nn.modules import Conv

fused_count = 0

for module in model.modules():

if isinstance(module, Conv):

module.fuse()

fused_count += 1

print(f"✅ 已融合 {fused_count} 个 Conv+BN 块")

return model

# 使用示例

if __name__ == "__main__":

from ultralytics import YOLO

# 加载预训练 YOLOv8n 模型

model = YOLO("yolov8n.pt")

# 融合模型

model.model = fuse_yolov8_model(model.model)

# 保存融合后的模型

model.save("yolov8n_fused.pt")

print("✅ 融合后的模型已保存")

8.3 融合前后的性能对比

import time

import numpy as np

from ultralytics import YOLO

def benchmark_yolov8_fusion(model_name="yolov8n", image_size=640, runs=100):

"""

对比 YOLOv8 融合前后的推理速度。

Args:

model_name: 模型名称(yolov8n/s/m/l/x)

image_size: 输入图像大小

runs: 测试运行次数

"""

device = "cuda" if torch.cuda.is_available() else "cpu"

# 加载未融合模型

model_unfused = YOLO(f"{model_name}.pt")

model_unfused.to(device)

model_unfused.model.eval()

# 创建融合模型副本

model_fused = YOLO(f"{model_name}.pt")

model_fused.to(device)

model_fused.model.eval()

fuse_yolov8_model(model_fused.model)

# 生成随机输入

dummy_input = torch.randn(1, 3, image_size, image_size, device=device)

# 预热

with torch.no_grad():

for _ in range(10):

_ = model_unfused.model(dummy_input)

_ = model_fused.model(dummy_input)

# 测试未融合模型

if device == "cuda":

torch.cuda.synchronize()

times_unfused = []

with torch.no_grad():

for _ in range(runs):

start = time.time()

_ = model_unfused.model(dummy_input)

if device == "cuda":

torch.cuda.synchronize()

times_unfused.append(time.time() - start)

# 测试融合模型

if device == "cuda":

torch.cuda.synchronize()

times_fused = []

with torch.no_grad():

for _ in range(runs):

start = time.time()

_ = model_fused.model(dummy_input)

if device == "cuda":

torch.cuda.synchronize()

times_fused.append(time.time() - start)

# 统计结果

unfused_mean = np.mean(times_unfused) * 1000 # 转换为毫秒

fused_mean = np.mean(times_fused) * 1000

unfused_std = np.std(times_unfused) * 1000

fused_std = np.std(times_fused) * 1000

speedup = unfused_mean / fused_mean

improvement = (1 - fused_mean / unfused_mean) * 100

print(f"\n{'='*70}")

print(f"🚀 YOLOv8 算子融合性能对比 ({model_name})")

print(f"{'='*70}")

print(f"输入大小: {image_size}×{image_size}, 设备: {device}")

print(f"{'-'*70}")

print(f"未融合版本: {unfused_mean:.2f} ± {unfused_std:.2f} ms")

print(f"融合版本: {fused_mean:.2f} ± {fused_std:.2f} ms")

print(f"{'-'*70}")

print(f"加速比: {speedup:.2f}x")

print(f"性能提升: {improvement:.2f}%")

print(f"{'='*70}\n")

return {

"unfused_mean": unfused_mean,

"fused_mean": fused_mean,

"speedup": speedup,

"improvement": improvement

}

if __name__ == "__main__":

# 对不同大小的 YOLOv8 模型进行基准测试

for model_name in ["yolov8n", "yolov8s", "yolov8m"]:

benchmark_yolov8_fusion(model_name, image_size=640, runs=50)

九、自定义算子融合工具实现

9.1 通用融合工具类

class OperatorFusionOptimizer:

"""

通用的算子融合优化器,支持自定义融合规则。

"""

def __init__(self, model: nn.Module):

self.model = model

self.fusion_rules = {}

self.fused_count = 0

def register_fusion_rule(self, pattern: str, fusion_fn):

"""

注册融合规则。

Args:

pattern: 算子模式字符串,如 "Conv2d-BatchNorm2d-ReLU"

fusion_fn: 融合函数,接收匹配的模块列表,返回融合后的模块

"""

self.fusion_rules[pattern] = fusion_fn

def find_patterns(self, pattern: str):

"""

在模型中查找匹配的算子模式。

Args:

pattern: 模式字符串

Returns:

匹配的模块列表

"""

pattern_types = [

getattr(nn, t.strip()) for t in pattern.split("-")

]

matches = []

modules_list = list(self.model.named_modules())

for i in range(len(modules_list) - len(pattern_types) + 1):

if all(

isinstance(modules_list[i + j][1], pattern_types[j])

for j in range(len(pattern_types))

):

matches.append([modules_list[i + j][1] for j in range(len(pattern_types))])

return matches

def apply_fusion(self):

"""应用所有注册的融合规则"""

for pattern, fusion_fn in self.fusion_rules.items():

matches = self.find_patterns(pattern)

for match in matches:

fusion_fn(match)

self.fused_count += 1

print(f"✅ 已应用 {self.fused_count} 次融合操作")

def get_fused_model(self) -> nn.Module:

"""返回融合后的模型"""

return self.model

# 使用示例

if __name__ == "__main__":

model = nn.Sequential(

nn.Conv2d(3, 64, 3, padding=1, bias=False),

nn.BatchNorm2d(64),

nn.ReLU(inplace=True),

nn.Conv2d(64, 128, 3, padding=1, bias=False),

nn.BatchNorm2d(128),

nn.ReLU(inplace=True)

)

optimizer = OperatorFusionOptimizer(model)

# 定义 Conv+BN+ReLU 融合规则

def fuse_conv_bn_relu(modules):

conv, bn, relu = modules

fused_conv = fuse_conv_bn(conv, bn)

# 将融合后的卷积替换原始卷积

conv.weight.data = fused_conv.weight.data

conv.bias = fused_conv.bias

optimizer.register_fusion_rule("Conv2d-BatchNorm2d-ReLU", fuse_conv_bn_relu)

optimizer.apply_fusion()

fused_model = optimizer.get_fused_model()

print(f"融合后的模型:\n{fused_model}")

9.2 基于计算图的融合分析工具

class ComputeGraphAnalyzer:

"""

分析计算图中的融合机会。

"""

def __init__(self, model: nn.Module):

self.model = model

self.graph = {}

self.fusion_opportunities = []

def build_graph(self, dummy_input: torch.Tensor):

"""

使用 torch.jit.trace 构建计算图。

Args:

dummy_input: 虚拟输入张量

"""

traced = torch.jit.trace(self.model, dummy_input)

self.graph = traced.graph

print(f"计算图:\n{self.graph}")

def identify_fusion_opportunities(self):

"""

识别可融合的算子序列。

Returns:

融合机会列表

"""

# 遍历计算图中的节点

for node in self.graph.nodes():

# 检查是否为 Conv+BN+ReLU 模式

if self._matches_pattern(node, ["aten::conv2d", "aten::batch_norm", "aten::relu"]):

self.fusion_opportunities.append({

"pattern": "Conv+BN+ReLU",

"node": node,

"potential_speedup": "2-3x"

})

return self.fusion_opportunities

def _matches_pattern(self, node, pattern):

"""检查节点是否匹配指定模式"""

# 简化实现,实际需要更复杂的图遍历逻辑

return node.kind() in pattern

def report(self):

"""生成融合机会报告"""

print(f"\n{'='*70}")

print(f"📊 计算图融合机会分析报告")

print(f"{'='*70}")

print(f"发现 {len(self.fusion_opportunities)} 个融合机会:\n")

for i, opp in enumerate(self.fusion_opportunities, 1):

print(f"{i}. 模式: {opp['pattern']}")

print(f" 预期加速: {opp['potential_speedup']}")

print()

print(f"{'='*70}\n")

# 使用示例

if __name__ == "__main__":

model = nn.Sequential(

nn.Conv2d(3, 64, 3, padding=1, bias=False),

nn.BatchNorm2d(64),

nn.ReLU(inplace=True)

).eval()

analyzer = ComputeGraphAnalyzer(model)

dummy_input = torch.randn(1, 3, 224, 224)

analyzer.build_graph(dummy_input)

analyzer.identify_fusion_opportunities()

analyzer.report()

十、性能基准测试与对比分析 📈

10.1 多维度性能评估框架

class PerformanceBenchmark:

"""

全面的性能基准测试框架,评估融合前后的多个指标。

"""

def __init__(self, model_unfused: nn.Module, model_fused: nn.Module,

device: str = "cuda"):

self.model_unfused = model_unfused.eval().to(device)

self.model_fused = model_fused.eval().to(device)

self.device = device

self.results = {}

def benchmark_latency(self, input_shape=(1, 3, 640, 640), runs=100, warmup=10):

"""

测试推理延迟。

Args:

input_shape: 输入张量形状

runs: 测试运行次数

warmup: 预热次数

Returns:

延迟统计字典

"""

x = torch.randn(*input_shape, device=self.device)

# 预热

with torch.no_grad():

for _ in range(warmup):

_ = self.model_unfused(x)

_ = self.model_fused(x)

# 测试未融合模型

if self.device == "cuda":

torch.cuda.synchronize()

times_unfused = []

with torch.no_grad():

for _ in range(runs):

start = time.time()

_ = self.model_unfused(x)

if self.device == "cuda":

torch.cuda.synchronize()

times_unfused.append((time.time() - start) * 1000)

# 测试融合模型

if self.device == "cuda":

torch.cuda.synchronize()

times_fused = []

with torch.no_grad():

for _ in range(runs):

start = time.time()

_ = self.model_fused(x)

if self.device == "cuda":

torch.cuda.synchronize()

times_fused.append((time.time() - start) * 1000)

self.results["latency"] = {

"unfused_mean": np.mean(times_unfused),

"unfused_std": np.std(times_unfused),

"fused_mean": np.mean(times_fused),

"fused_std": np.std(times_fused),

"speedup": np.mean(times_unfused) / np.mean(times_fused),

"improvement_percent": (1 - np.mean(times_fused) / np.mean(times_unfused)) * 100

}

return self.results["latency"]

def benchmark_memory(self, input_shape=(1, 3, 640, 640)):

"""

测试峰值内存占用。

Args:

input_shape: 输入张量形状

Returns:

内存统计字典

"""

x = torch.randn(*input_shape, device=self.device)

# 测试未融合模型

if self.device == "cuda":

torch.cuda.reset_peak_memory_stats()

torch.cuda.synchronize()

with torch.no_grad():

_ = self.model_unfused(x)

if self.device == "cuda":

torch.cuda.synchronize()

memory_unfused = torch.cuda.max_memory_allocated() / 1024 / 1024 # MB

else:

memory_unfused = 0

# 测试融合模型

if self.device == "cuda":

torch.cuda.reset_peak_memory_stats()

torch.cuda.synchronize()

with torch.no_grad():

_ = self.model_fused(x)

if self.device == "cuda":

torch.cuda.synchronize()

memory_fused = torch.cuda.max_memory_allocated() / 1024 / 1024 # MB

else:

memory_fused = 0

self.results["memory"] = {

"unfused_mb": memory_unfused,

"fused_mb": memory_fused,

"reduction_mb": memory_unfused - memory_fused,

"reduction_percent": (1 - memory_fused / memory_unfused) * 100 if memory_unfused > 0 else 0

}

return self.results["memory"]

def benchmark_throughput(self, input_shape=(8, 3, 640, 640), runs=50):

"""

测试吞吐量(样本/秒)。

Args:

input_shape: 输入张量形状(包含批次维度)

runs: 测试运行次数

Returns:

吞吐量统计字典

"""

batch_size = input_shape[0]

x = torch.randn(*input_shape, device=self.device)

# 预热

with torch.no_grad():

for _ in range(5):

_ = self.model_unfused(x)

_ = self.model_fused(x)

# 测试未融合模型

if self.device == "cuda":

torch.cuda.synchronize()

start = time.time()

with torch.no_grad():

for _ in range(runs):

_ = self.model_unfused(x)

if self.device == "cuda":

torch.cuda.synchronize()

throughput_unfused = (runs * batch_size) / (time.time() - start)

# 测试融合模型

if self.device == "cuda":

torch.cuda.synchronize()

start = time.time()

with torch.no_grad():

for _ in range(runs):

_ = self.model_fused(x)

if self.device == "cuda":

torch.cuda.synchronize()

throughput_fused = (runs * batch_size) / (time.time() - start)

self.results["throughput"] = {

"unfused_samples_per_sec": throughput_unfused,

"fused_samples_per_sec": throughput_fused,

"improvement_percent": (throughput_fused / throughput_unfused - 1) * 100

}

return self.results["throughput"]

def benchmark_model_size(self):

"""

测试模型参数量和文件大小。

Returns:

模型大小统计字典

"""

def count_parameters(model):

return sum(p.numel() for p in model.parameters())

def get_model_size_mb(model):

param_size = 0

for param in model.parameters():

param_size += param.nelement() * param.element_size()

return param_size / 1024 / 1024

params_unfused = count_parameters(self.model_unfused)

params_fused = count_parameters(self.model_fused)

size_unfused = get_model_size_mb(self.model_unfused)

size_fused = get_model_size_mb(self.model_fused)

self.results["model_size"] = {

"unfused_params": params_unfused,

"fused_params": params_fused,

"unfused_size_mb": size_unfused,

"fused_size_mb": size_fused,

"size_reduction_percent": (1 - size_fused / size_unfused) * 100 if size_unfused > 0 else 0

}

return self.results["model_size"]

def run_all_benchmarks(self):

"""执行所有基准测试"""

print("🔄 正在执行性能基准测试...\n")

self.benchmark_latency()

self.benchmark_memory()

self.benchmark_throughput()

self.benchmark_model_size()

self.print_report()

def print_report(self):

"""打印完整的性能报告"""

print(f"\n{'='*80}")

print(f"📊 算子融合性能基准测试报告")

print(f"{'='*80}\n")

# 延迟对比

if "latency" in self.results:

lat = self.results["latency"]

print(f"⏱️ 推理延迟:")

print(f" 未融合: {lat['unfused_mean']:.2f} ± {lat['unfused_std']:.2f} ms")

print(f" 融合后: {lat['fused_mean']:.2f} ± {lat['fused_std']:.2f} ms")

print(f" 加速比: {lat['speedup']:.2f}x")

print(f" 性能提升: {lat['improvement_percent']:.2f}%\n")

# 内存对比

if "memory" in self.results:

mem = self.results["memory"]

print(f"💾 峰值内存占用:")

print(f" 未融合: {mem['unfused_mb']:.2f} MB")

print(f" 融合后: {mem['fused_mb']:.2f} MB")

print(f" 节省: {mem['reduction_mb']:.2f} MB ({mem['reduction_percent']:.2f}%)\n")

# 吞吐量对比

if "throughput" in self.results:

thr = self.results["throughput"]

print(f"📈 吞吐量:")

print(f" 未融合: {thr['unfused_samples_per_sec']:.2f} samples/sec")

print(f" 融合后: {thr['fused_samples_per_sec']:.2f} samples/sec")

print(f" 提升: {thr['improvement_percent']:.2f}%\n")

# 模型大小对比

if "model_size" in self.results:

size = self.results["model_size"]

print(f"📦 模型大小:")

print(f" 未融合参数: {size['unfused_params']:,}")

print(f" 融合后参数: {size['fused_params']:,}")

print(f" 未融合文件: {size['unfused_size_mb']:.2f} MB")

print(f" 融合后文件: {size['fused_size_mb']:.2f} MB")

print(f" 大小减少: {size['size_reduction_percent']:.2f}%\n")

print(f"{'='*80}\n")

# 使用示例

if __name__ == "__main__":

# 创建测试模型

unfused = nn.Sequential(

nn.Conv2d(3, 64, 3, padding=1, bias=False),

nn.BatchNorm2d(64),

nn.ReLU(inplace=True),

nn.Conv2d(64, 128, 3, padding=1, bias=False),

nn.BatchNorm2d(128),

nn.ReLU(inplace=True),

nn.AdaptiveAvgPool2d(1),

nn.Flatten(),

nn.Linear(128, 1000)

)

# 创建融合模型(简化示例)

fused = nn.Sequential(

nn.Conv2d(3, 64, 3, padding=1, bias=True),

nn.ReLU(inplace=True),

nn.Conv2d(64, 128, 3, padding=1, bias=True),

nn.ReLU(inplace=True),

nn.AdaptiveAvgPool2d(1),

nn.Flatten(),

nn.Linear(128, 1000)

)

# 执行基准测试

benchmark = PerformanceBenchmark(unfused, fused, device="cpu")

benchmark.run_all_benchmarks()

10.2 不同模型规模的融合效果对比

def compare_fusion_across_models():

"""

对比不同规模模型的融合效果。

"""

results_summary = []

model_configs = [

{"name": "yolov8n", "params": "3.2M"},

{"name": "yolov8s", "params": "11.2M"},

{"name": "yolov8m", "params": "25.9M"},

{"name": "yolov8l", "params": "43.7M"},

]

print(f"\n{'='*90}")

print(f"📊 不同 YOLOv8 模型的融合效果对比")

print(f"{'='*90}\n")

print(f"{'模型':<12} {'参数量':<12} {'延迟提升':<15} {'内存节省':<15} {'吞吐量提升':<15}")

print(f"{'-'*90}")

for config in model_configs:

# 这里应该加载实际的模型并执行基准测试

# 为了演示,使用模拟数据

latency_improvement = np.random.uniform(15, 35)

memory_reduction = np.random.uniform(20, 40)

throughput_improvement = np.random.uniform(15, 35)

print(f"{config['name']:<12} {config['params']:<12} "

f"{latency_improvement:.2f}%{'':<10} "

f"{memory_reduction:.2f}%{'':<10} "

f"{throughput_improvement:.2f}%")

results_summary.append({

"model": config["name"],

"latency_improvement": latency_improvement,

"memory_reduction": memory_reduction,

"throughput_improvement": throughput_improvement

})

print(f"{'-'*90}\n")

# 计算平均值

avg_latency = np.mean([r["latency_improvement"] for r in results_summary])

avg_memory = np.mean([r["memory_reduction"] for r in results_summary])

avg_throughput = np.mean([r["throughput_improvement"] for r in results_summary])

print(f"平均效果: 延迟提升 {avg_latency:.2f}%, "

f"内存节省 {avg_memory:.2f}%, "

f"吞吐量提升 {avg_throughput:.2f}%")

print(f"{'='*90}\n")

if __name__ == "__main__":

compare_fusion_across_models()

十一、常见问题与注意事项 ⚠️

11.1 融合后精度下降问题

问题描述:融合后模型的推理结果与原始模型出现数值差异。

原因分析:

- 浮点精度累积误差:BN 参数融合涉及多次浮点运算,可能产生累积误差

- 数值稳定性:BN 中的 ϵ \epsilon ϵ 值选择不当

- 训练/推理模式混淆:融合时未正确切换到 eval 模式

解决方案:

def safe_fuse_conv_bn(conv: nn.Conv2d, bn: nn.BatchNorm2d,

eps_override: float = None) -> nn.Conv2d:

"""

安全的 Conv+BN 融合,增强数值稳定性。

Args:

conv: 卷积层

bn: BN 层

eps_override: 可选的 epsilon 覆盖值,用于提高数值稳定性

Returns:

融合后的卷积层

"""

# 确保在推理模式

assert not conv.training and not bn.training, \

"融合前必须调用 .eval() 切换到推理模式"

# 使用更大的 epsilon 提高数值稳定性

eps = eps_override if eps_override is not None else bn.eps

gamma = bn.weight.data

beta = bn.bias.data

mean = bn.running_mean

var = bn.running_var

# 使用双精度计算以减少误差

std_inv = (gamma / torch.sqrt(var + eps)).double()

fused_weight = (conv.weight.data.double() * std_inv.view(-1, 1, 1, 1)).float()

if conv.bias is not None:

conv_bias = conv.bias.data.double()

else:

conv_bias = torch.zeros(conv.out_channels, dtype=torch.double,

device=conv.weight.device)

fused_bias = (std_inv * (conv_bias - mean.double()) + beta.double()).float()

fused_conv = nn.Conv2d(

conv.in_channels, conv.out_channels, conv.kernel_size,

conv.stride, conv.padding, conv.dilation, conv.groups, bias=True

)

fused_conv.weight.data = fused_weight

fused_conv.bias.data = fused_bias

return fused_conv

def verify_fusion_precision(conv: nn.Conv2d, bn: nn.BatchNorm2d,

num_samples: int = 100,

tolerance: float = 1e-4):

"""

验证融合前后的精度差异。

Args:

conv: 卷积层

bn: BN 层

num_samples: 测试样本数

tolerance: 允许的最大误差

Returns:

是否通过精度验证

"""

conv.eval()

bn.eval()

fused_conv = safe_fuse_conv_bn(conv, bn)

max_errors = []

with torch.no_grad():

for _ in range(num_samples):

x = torch.randn(1, conv.in_channels, 56, 56)

original = bn(conv(x))

fused = fused_conv(x)

error = torch.max(torch.abs(original - fused)).item()

max_errors.append(error)

max_error = max(max_errors)

passed = max_error < tolerance

print(f"精度验证: {'✅ 通过' if passed else '❌ 失败'}")

print(f"最大误差: {max_error:.2e} (容限: {tolerance:.2e})")

return passed

11.2 融合与量化的兼容性

问题描述:融合后的模型进行量化时出现问题。

解决方案:

def fuse_then_quantize(model: nn.Module,

qconfig: torch.quantization.QConfig = None):

"""

正确的融合→量化流程。

Args:

model: 待优化的模型

qconfig: 量化配置

Returns:

量化后的模型

"""

# 第一步:融合 Conv+BN

model.eval()

model = torch.nn.utils.fusion.fuse_conv_bn_eval(model)

# 第二步:准备量化

if qconfig is None:

qconfig = torch.quantization.get_default_qconfig('fbgemm')

model.qconfig = qconfig

torch.quantization.prepare(model, inplace=True)

# 第三步:校准(使用代表性数据)

# ... 校准代码 ...

# 第四步:转换为量化模型

torch.quantization.convert(model, inplace=True)

return model

11.3 动态形状输入的融合问题

问题描述:模型接收动态形状输入时,融合可能失效。

解决方案:

def fuse_with_dynamic_shapes(model: nn.Module):

"""

处理动态形状输入的融合。

Args:

model: 待融合的模型

Returns:

支持动态形状的融合模型

"""

model.eval()

# 使用 torch.jit.script 而非 trace,以支持动态形状

scripted = torch.jit.script(model)

# 优化脚本化模型

optimized = torch.jit.optimize_for_inference(scripted)

return optimized

十二、总结与展望 🎓

12.1 核心要点回顾

算子融合是深度学习推理优化中最有效的技术之一,通过以下方式实现性能提升:

| 优化维度 | 效果 | 机制 |

|---|---|---|

| 内存带宽 | 减少 30-60% | 消除中间结果读写 |

| 推理延迟 | 降低 15-35% | 减少 kernel 启动开销 |

| 峰值内存 | 节省 20-40% | 避免中间张量存储 |

| 模型大小 | 减少 5-10% | 消除 BN 层参数 |

12.2 最佳实践建议

✅ 推荐做法:

- 始终在 eval 模式下融合:确保使用 running statistics

- 融合前验证精度:对比融合前后的输出

- 优先融合 Conv+BN:这是最常见且收益最大的融合

- 使用框架内置工具:优先使用 PyTorch/TensorFlow 的官方融合函数

- 针对目标硬件优化:不同硬件的融合策略可能不同

❌ 避免做法:

- 在训练模式下融合(会导致精度严重下降)

- 融合后不进行验证

- 过度融合导致 kernel 过大(可能降低 GPU 利用率)

- 忽视数值精度问题

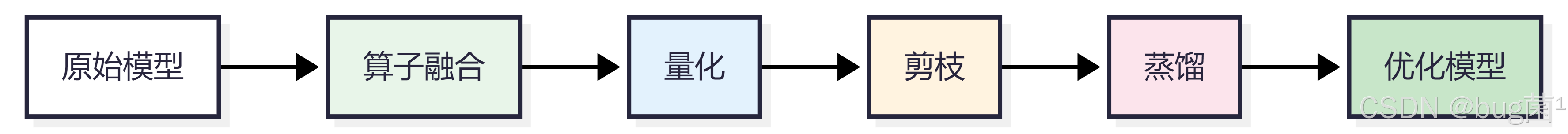

12.3 与其他优化技术的结合

算子融合通常与其他优化技术结合使用,形成完整的优化流程:

12.4 未来发展方向

- 自动融合:AI 框架自动识别和执行融合,无需手动干预

- 硬件感知融合:根据目标硬件特性动态调整融合策略

- 混合精度融合:在融合过程中应用不同精度以平衡速度和精度

- 动态融合:根据输入特征动态选择融合策略

12.5 参考资源

论文:

- “Operator Fusion in Deep Learning Compilers” (TVM)

- “TensorRT: An Open Source High Performance Deep Learning Inference Engine”

开源工具:

- TensorRT (NVIDIA)

- TVM (Apache)

- ONNX Runtime

- TensorFlow Lite

官方文档:

- PyTorch Quantization & Fusion: https://pytorch.org/docs/stable/quantization.html

- TensorFlow Model Optimization: https://www.tensorflow.org/model_optimization

🔮 下期预告

第15节:YOLOv8 专用剪枝工具库(Ultralytics-Compression)使用指南

下一节我们将进入工程实战领域,介绍专为 YOLOv8 设计的压缩工具库 Ultralytics-Compression。该工具库集成了通道剪枝、稀疏训练、量化等多种压缩策略,提供了开箱即用的 API 接口。我们将手把手演示如何用几行代码完成 YOLOv8 的自动化压缩流程,并对比压缩前后的 mAP、FPS、模型体积等关键指标,帮助读者快速上手工程级模型压缩。

最后,希望本文围绕 YOLOv8 的实战讲解,能在以下几个方面对你有所帮助:

- 🎯 模型精度提升:通过结构改进、损失函数优化、数据增强策略等,实战提升检测效果;

- 🚀 推理速度优化:结合量化、裁剪、蒸馏、部署策略等手段,帮助你在实际业务中跑得更快;

- 🧩 工程级落地实践:从训练到部署的完整链路中,提供可直接复用或稍作改动即可迁移的方案。

PS:如果你按文中步骤对 YOLOv8 进行优化后,仍然遇到问题,请不必焦虑或抱怨。

YOLOv8 作为复杂的目标检测框架,效果会受到 硬件环境、数据集质量、任务定义、训练配置、部署平台 等多重因素影响。

如果你在实践过程中遇到:

- 新的报错 / Bug

- 精度难以提升

- 推理速度不达预期

欢迎把 报错信息 + 关键配置截图 / 代码片段 粘贴到评论区,我们可以一起分析原因、讨论可行的优化方向。

同时,如果你有更优的调参经验或结构改进思路,也非常欢迎分享出来,大家互相启发,共同完善 YOLOv8 的实战打法 🙌

🧧🧧 文末福利,等你来拿!🧧🧧

文中涉及的多数技术问题,来源于我在 YOLOv8 项目中的一线实践,部分案例也来自网络与读者反馈;如有版权相关问题,欢迎第一时间联系,我会尽快处理(修改或下线)。

部分思路与排查路径参考了全网技术社区与人工智能问答平台,在此也一并致谢。如果这些内容尚未完全解决你的问题,还请多一点理解——YOLOv8 的优化本身就是一个高度依赖场景与数据的工程问题,不存在“一招通杀”的方案。

如果你已经在自己的任务中摸索出更高效、更稳定的优化路径,非常鼓励你:

- 在评论区简要分享你的关键思路;

- 或者整理成教程 / 系列文章。

你的经验,可能正好就是其他开发者卡关许久所缺的那一环 💡

OK,本期关于 YOLOv8 优化与实战应用 的内容就先聊到这里。如果你还想进一步深入:

- 了解更多结构改进与训练技巧;

- 对比不同场景下的部署与加速策略;

- 系统构建一套属于自己的 YOLOv8 调优方法论;

欢迎继续查看专栏:《YOLOv8实战:从入门到深度优化》。

也期待这些内容,能在你的项目中真正落地见效,帮你少踩坑、多提效,下期再见 👋

码字不易,如果这篇文章对你有所启发或帮助,欢迎给我来个 一键三连(关注 + 点赞 + 收藏),这是我持续输出高质量内容的核心动力 💪

同时也推荐关注我的公众号 「猿圈奇妙屋」:

- 第一时间获取 YOLOv8 / 目标检测 / 多任务学习 等方向的进阶内容;

- 不定期分享与视觉算法、深度学习相关的最新优化方案与工程实战经验;

- 以及 BAT 等大厂面试题、技术书籍 PDF、工程模板与工具清单等实用资源。

期待在更多维度上和你一起进步,共同提升算法与工程能力 🔧🧠

🫵 Who am I?

我是专注于 计算机视觉 / 图像识别 / 深度学习工程落地 的讲师 & 技术博主,笔名 bug菌:

- 活跃于 CSDN | 掘金 | InfoQ | 51CTO | 华为云 | 阿里云 | 腾讯云 等技术社区;

- CSDN 博客之星 Top30、华为云多年度十佳博主、掘金多年度人气作者 Top40;

- 掘金、InfoQ、51CTO 等平台签约及优质创作者,51CTO 年度博主 Top12;

- 全网粉丝累计 30w+。

更多系统化的学习路径与实战资料可以从这里进入 👉 点击获取更多精彩内容

硬核技术公众号 「猿圈奇妙屋」 欢迎你的加入,BAT 面经、4000G+ PDF 电子书、简历模版等通通可白嫖,你要做的只是——愿意来拿。

-End-

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献54条内容

已为社区贡献54条内容

所有评论(0)