总结陈词: 人机协同——安全领域最终的护城河

总结陈词: 人机协同——安全领域最终的护城河

你好,我是陈涉川,欢迎你来到我的专栏!敲下“第50篇”这几个字的时候,说实话,我手心里甚至有一点出汗。从咱们第一篇发出来到现在,我们一起熬过了无数个死磕底层逻辑和代码的深夜。上一篇,我们在模块六里,用上帝视角俯瞰了全球范围内的算法博弈与主权争锋,那一篇的信息密度简直让人头皮发麻,不知道大家消化得怎么样了?今天,咱们终于迎来了《硅基之盾》的终局之战。这篇咱们不拼代码,不写枯燥的脚本,我想和大家掏心窝子聊一聊:在那些越来越像“神明”的冷冰冰的机器面前,咱们人类安全同行,到底凭什么站着把防线守住?准备好了吗?咱们最后一次,发车!

引言:破晓与终局——硅基狂潮下的人类审判

当这串字符跨越路由与交换的节点,最终呈现在你眼前时,我们长达五十篇的《硅基之盾:AI 与网络安全攻防全鉴》专栏,终于迎来了它的终局。

回望这段漫长、硬核而又充满震撼的旅程,我们犹如手持微弱火把的探险者,在比特与硅基交织的幽暗丛林中,一寸寸地开辟着认知的新径。在这场思维的远征里,我们共同跨越了无数个技术纪元:在模块一(破晓),我们亲历了安全底层逻辑从僵化的“特征码”向高维“特征向量”的历史性范式转移;在模块二(矛之尖),我们直面了深渊——那是 AI 驱动的自动化攻击、深伪社交工程以及在内存中疯狂裂变的多态恶意代码所带来的战栗;在模块三(盾之固),我们没有坐以待毙,而是利用自编码器、大语言模型与百亿级节点的知识图谱,构筑起了下一代智能 SOC(安全运营中心)的坚固堡垒。

随后的深水区更是令人窒息。在模块四(内生安全)与模块五(工程落地),我们如同解剖精密钟表般,深入探究了对抗性样本生成与提示词注入的本质,并亲手在沙盘上搭建了 MLSecOps 的工业级流水线;最终,在上一篇的模块六(远见)中,我们彻底跳出了代码的桎梏,从全球治理的宏大视角,俯瞰了算法与法律、代码与国家主权的史诗级博弈。

一路走来,我们推演了无数种极其残酷的非对称对抗场景,探讨了算力的霸权、算法的幽深以及数据的原罪。在见证了 AI 能够以毫秒级的速度重写内网路由协议、能够以极高的拟真度瞬间摧毁人类社会的信任锚点之后,一种难以名状的焦虑感和虚无感,不可避免地在每一位真正懂行的安全从业者心头蔓延:在这个越来越像赛博朋克反乌托邦的未来里,人类安全专家的意义究竟何在?面对一个能在一秒内穷举千万种攻击向量的系统,我们的熬夜、我们的经验、我们的直觉,是否只是一种可笑的螳臂当车?我们穷尽半生心血,是否只是在为最终取代我们的“硅基神明”搭建加冕的王座?

答案,是极其坚定且不容置疑的否定。

当我们剥开所有炫目的技术外衣,穿透张量与矩阵的迷雾,直抵网络安全这门学科的绝对核心时,你会发现一个古老、残酷却又无比伟大的真理:网络安全的本质,永远是人与人之间智慧、意志和道德的对抗。无论 AI 的能力进化到何种维度,它终究只是这场博弈中的介质、工具与武器。

作为本专栏的收官之作,我们将彻底抛开具体的代码片段与数学公式,进行一次前所未有的认知升维。我们将用严密的逻辑论证一个在 AI 狂飙突进的时代被严重低估、却决定了人类文明数字防线生死存亡的核心理念:人机协同(Human-Machine Collaboration),才是安全领域最终、也最不可逾越的护城河。

一、 纯粹技术防御的破产:为什么“AI 独裁”走不通?

在过去几年的安全技术浪潮中,业界曾经弥漫着一种极度乐观的“AI 银弹论”。许多安全厂商在 PPT 上描绘了这样一幅乌托邦图景:部署一个全知全能的“AI 安全大脑”,它可以实现 100% 的自动化威胁狩猎、自动化的漏洞修补、自动化的溯源反制,而人类 CISO(首席信息安全官)只需要坐在监控大屏前喝着咖啡,看着机器自己打仗。

这种试图将安全防御完全托付给机器、实现“AI 独裁(AI Dictatorship)”的构想,在真实的工业环境中已经宣告破产。其底层原因,绝非算力不足或算法不精,而是受制于 AI 本身的三个结构性盲区。

1.1 语境缺失(Lack of Context):当异常成为常态

AI 是寻找模式(Pattern)的大师,但它是理解语境(Context)的白痴。在网络安全中,“恶意”与“正常”的界限往往不是由网络协议的字节决定的,而是由极其复杂的业务逻辑、人类情感和突发事件决定的。

想象一个场景:某天凌晨三点,公司财务总监的账号突然从一个陌生的海外 IP 登录,并试图向一个未知的离岸账户转移巨额资金。在任何纯自动化的 AI 异常检测系统中,这都将触发最高级别的红色警报,AI 的“第一直觉”是瞬间冻结账号、切断网络。

然而,真实的语境可能是:公司正在秘密进行一场跨国并购,财务总监被紧急派往海外,且必须在当地时间完成一笔保证金的缴纳。如果“AI 独裁”系统直接熔断了交易,不仅会导致并购失败,更会给公司带来毁灭性的商业损失。

AI 无法理解什么是“秘密并购”,无法理解财务总监面临的“商业压力”。在真实世界中,许多合法的业务操作本身看起来就像是黑客攻击(例如运维人员为了救火而进行的高权限违规越权)。没有人类的语境介入,纯粹的 AI 防御系统要么陷入“告警疲劳(Alert Fatigue)”的汪洋大海,要么因为过于严苛的阻断而彻底瘫痪业务的生命线。

1.2 创造力的黑洞:无法预测的“非对称性对抗”

机器学习的本质是建立在历史数据之上的统计学归纳。无论强化学习或大语言模型多么惊艳,它们的“智力”都受限于其训练数据的边界。这意味着,AI 非常擅长防御“已知威胁的未知变种”,但面对完全跳出历史框架的零日战术(Zero-Day Tactics)时,往往束手无策。

黑客不仅是程序员,更是心理学家、社会工程学大师和诡辩家。攻击者可以利用快递员的身份潜入机房物理拔网线;可以利用公司年会的合影推断出内网密码的规律;甚至可以故意向 AI 防御系统喂送数月的正常流量来建立虚假的“安全基线”,然后在某个极其微小的维度上实施“温水煮青蛙”式的降维打击。

这种充满跳跃性、荒诞感、融合了物理世界与心理博弈的“非对称性攻击”,是任何基于数学优化的 AI 都无法提前预测的。机器的思维是线性和概率的,而人类黑客的思维是混沌和颠覆的。用一台缺乏创造力的机器去防御一群充满恶意的天才大脑,注定是一场必败的战争。

1.3 责任的真空:谁来为“失控”买单?

安全不仅是技术问题,更是法律、商业与伦理的综合体。如果一个全自动的 AI 响应系统,在溯源反制时错误地将一家合法企业的服务器判定为跳板机,并对其发动了反向 DDoS 攻击导致对方瘫痪,谁来承担法律责任?

把 AI 送上法庭是荒谬的。在人类的法律与道德体系中,责任(Accountability)永远只能由具有独立意志的实体(自然人或法人)来承担。这种“责任真空”注定了 AI 只能是建议的提供者,而绝不能是最高决策的拍板人。在那些涉及拔除网线、关停核心业务、甚至发起网络反制的关键节点上,必须有一个活生生的人来承担最终的伦理与法律后果。

1.4 算法的同质化(Algorithmic Monoculture):单一防线的致命脆弱性

纯粹的 AI 防御还面临一个宏观层面的系统性灾难——算法的同质化。在商业浪潮的席卷下,全球的企业往往会采购市面上最顶尖的那几家安全厂商的 AI 模型。这意味着,全球的网络防御底座正在走向高度趋同。 在生物学中,基因高度同质化的农作物一场瘟疫就会全军覆没。在网络安全中同样如此。如果黑客倾尽全力,通过对抗性网络找出了主流 AI 模型的某个“通用盲区”或“越狱指令”,那么整个世界的数字防线将在瞬间集体沦陷。打破这种硅基单点故障(Single Point of Failure)的唯一解药,正是人类。不同国家、不同背景、不同性格的安全分析师,他们千奇百怪的防御习惯和不可复制的直觉,为整个数字世界的免疫系统注入了极其宝贵的“多样性(Diversity)”,让一击必杀的通用攻击成为不可能。

二、 机器的归机器,人类的归人类:能力图谱的重构

既然“AI 独裁”走不通,而纯粹的“人工防御”又会在海量数据面前被瞬间淹没,那么唯一的解法,就是重构人与机器的能力图谱,实现深度的优势互补。

我们需要清醒地界定:在网络安全这片没有硝烟的战场上,什么是机器的专属领域,什么又是人类的神圣领地。

2.1 AI 的神职:降维、关联与不知疲倦的哨兵

在未来的安全架构中,AI 应当扮演极致的“战术执行者”与“信息降维者”。

- 毫秒级的特征降维: 面对每秒数十 GB 的网络流量、成千上万的终端日志,人类的肉眼和传统的 SIEM(安全信息和事件管理)规则已经彻底失效。AI 的优势在于高维向量空间的计算。它能够实时地将几十个维度的弱信号(例如某用户鼠标移动轨迹的微小变化、某个冷门进程的异常网络请求)在隐空间中进行高维关联,从而在人类分析师的屏幕上,将原本分散的 100 万条日志,降维压缩成 10 个高置信度的安全事件。

- 冷酷的机器速度: 在防范蠕虫病毒、自动化勒索软件或 DDoS 攻击时,战机稍纵即逝。对于那些风险极低、判定规则极其清晰、且不需要复杂业务语境的场景(如屏蔽已知的恶意 IP、隔离明确包含恶意载荷的附件),AI 可以作为不知疲倦的哨兵,在微秒级别自动完成阻断,将人类从枯燥的“第一层(Tier 1)”告警分拣中彻底解放出来。

- 博闻强识的知识库引擎: 大语言模型(LLM)将成为人类安全专家的“超级外脑”。人类无法记住过去十年所有的 CVE 漏洞细节和 APT 组织的攻击 TTPs(战术、技术和程序),但 AI 可以。通过 RAG(检索增强生成)技术,AI 能够在人类提出假设的瞬间,从海量的情报库中提取出最相关的历史线索。

2.2 人类的王座:直觉、博弈与终极决策

当 AI 过滤掉了 99.9% 的噪音,将那 0.1% 最诡异、最复杂、最矛盾的异常推到人类面前时,这就进入了只有人类智能才能驾驭的“深水区”。

- 业务语境的终极仲裁者: 只有人类,才能深刻理解公司复杂的组织架构、高管的隐秘行程、或者刚刚发生的一场公关危机。当安全事件与业务运转发生剧烈冲突时,人类安全官需要跳出纯粹的技术视角,运用商业智慧在“安全红线”与“业务连续性”之间寻找那个极其微妙的平衡点。

- “直觉(Intuition)”的超算能力: 一个经验丰富的威胁狩猎专家(Threat Hunter),往往拥有机器无法企及的“直觉”。当面对一串表面上完美符合规范、但就是让人觉得“哪里不对劲”的进程树时,这种基于多年实战经验沉淀在潜意识中的“直觉”,其本质是一种极其高级的、非线性的模式识别。人类可以通过蛛丝马迹,敏锐地嗅出屏幕另一端那个黑客的“性格”、“习惯”甚至“疲惫感”。这种跨物种的心智理论(Theory of Mind),是目前任何 AI 都无法模拟的。

- 高维度的战略博弈: 网络安全是国家、企业之间高维度的地缘政治与商业博弈。决定是否对外披露一个零日漏洞、是否对某个 APT 组织进行公开归因(Attribution)、如何向公众和监管机构解释一次数据泄露事件,这些都需要极高的同理心、政治智慧与道德考量。在这张宏大的战略棋盘上,人类是唯一的棋手。

三、 “半人马”安全架构:现代 SecOps 的终极形态

既然人与 AI 各有所长,那么如何将它们有机地缝合在一起?在国际象棋领域,有一个著名的概念叫做“半人马(Centaur)”。

1997 年,国际象棋大师卡斯帕罗夫被 IBM 的“深蓝”击败,标志着人类在纯算力领域的落败。但卡斯帕罗夫随后发起了一项名为“高级国际象棋(Advanced Chess)”的赛事,即人类选手可以带着一台普通的国际象棋软件参赛。结果令人震惊:一个水平一般的业余选手加上一台普通的 AI,能够轻易击败当时世界上最强大的单体 AI,也能击败最顶尖的纯人类大师。

这就是“半人马”模式的威力。在网络安全领域,我们正在迎来“半人马安全运营中心(Centaur SOC)”的黄金时代。

3.1 闭环流转:从“机器生成”到“人类确认”再到“机器进化”

一个真正的“半人马”安全架构,绝不是简单地把 AI 引擎和人类分析师塞进同一个办公室,而是建立一套高频互动的闭环反馈系统(Human-in-the-Loop, HITL)。

在日常的防御态势中,AI 智能体(Agent)像工蜂一样在内网穿梭,收集遥测数据,并利用图神经网络(GNN)构建全网资产与行为的关联图谱。当它发现一个复杂的隐蔽信道时,它不会盲目采取破坏性行动,而是生成一份详尽的“案情摘要”。

这份摘要将被推送到人类分析师的终端。这不是枯燥的 JSON 代码,而是通过 LLM 转化为带有推理逻辑的自然语言:“报告长官,在财务部的网段发现了一股加密流量。该流量的节奏与已知的 APT-29 心跳包相似度为 85%,且该主机在两小时前刚刚访问过一个无备案的海外域名。但我无法确定这是否是财务软件的例行更新。请指示。”

人类分析师结合最近的财务系统升级通告,迅速做出判断。如果是误报,分析师不仅会点击“消除告警”,还会输入一段人类的纠偏逻辑:“这是金蝶财务软件的新特性,将其加入白名单,并降低该域名同类请求的威胁权重。” 这个动作会被立刻转化为损失函数中的反馈信号(RLHF),实时微调 AI 模型的权重。

机器为人类提供视野的深度,人类为机器提供进化的方向。 每一次成功的抵御和每一次果断的放行,都在让人机组合变得更加强大。

3.2 交互革命:ChatWithSecurity 与意图驱动的安全

在“半人马”架构下,人机交互的界面(UI/UX)将发生颠覆性的改变。安全工程师不再需要死记硬背 Splunk 的查询语法或 ElasticSearch 的复杂命令。

通过构建基于大模型的交互接口(例如我们在前文讨论过的 ChatWithSecurity),人类的“意图(Intent)”将被无缝转化为机器的“代码(Code)”。

当 CISO 想了解当前的资产暴露面时,他只需要在输入框中敲下:“查询过去 24 小时内,所有暴露在公网且包含反序列化漏洞的非核心业务容器,并列出其负责人的联系方式。”

AI 会在后台瞬间将这句自然语言拆解为几十条复杂的 API 调用、数据库查询和知识图谱遍历,并在几秒钟后将一份包含图表、高亮节点和人员拓扑的报告呈现在人类面前。这种“意图驱动(Intent-Driven)”的操作模式,打破了安全工具的使用门槛,让人类专家的脑力能够完全聚焦于“战术构思”,而不是被困在“编写查询脚本”的泥沼中。

3.3 逆向赋能:机器对人类认知带宽的拓宽

在传统的认知中,我们总是倾向于认为“人指挥机器,机器替代人”。但在真正的“半人马”安全架构中,发生着一种更加深刻的化学反应:机器正在逆向拓宽人类的认知带宽(Cognitive Bandwidth)。

人类大脑的短期工作记忆是非常有限的(经典的“神奇的数字 7±2”理论),面对错综复杂的网络拓扑、数以千计的终端状态、以及每秒跳动的千万条日志,人类的认知带宽会瞬间过载。当安全专家处于这种“认知迷雾(Cognitive Fog)”中时,他们的决策往往会退化为基于经验的盲目试错,或者干脆陷入瘫痪。

而现代 AI,特别是基于 Transformer 架构的大模型与图神经网络(GNN)的结合,本质上是在为人类提供一种“高维认知外骨骼”。

当安全专家在调查一次 APT(高级持续性威胁)攻击时,AI 可以在屏幕的一侧实时生成一幅动态的攻击溯源图谱。这幅图谱不是简单的数据罗列,而是将时间线(攻击者何时潜入)、空间线(横向移动了哪些子网)、血缘线(恶意父进程如何派生出子进程)在多维空间中进行可视化对齐。

此时,人类专家不再是一个在海量数据中苦苦搜寻线索的“矿工”,而是化身为一位站在全息沙盘前的“指挥官”。机器处理了所有繁杂的“数据关联”工作,将人类宝贵的认知带宽彻底释放出来,用于进行最高阶的逻辑推理、战术意图揣测以及战略级别的反制规划。这种逆向赋能,使得一个初级安全分析师在 AI 的辅助下,能够瞬间展现出堪比资深威胁狩猎专家的洞察力。

3.4 黑暗镜像:用“防守半人马”对抗“暗黑半人马”

必须清醒地认识到,在护城河的对岸,我们的敌人早已不是单打独斗的脚本小子,而是同样完成了“半人马”进化的国家级黑客团伙与高级勒索组织。 我们面对的是“暗黑半人马(Dark Centaur)”:攻击方的人类首脑负责构思极其狡猾的社会工程学剧本和战术欺骗意图,而他们手中的进攻性 AI 智能体,则以毫秒级的速度将这些意图转化为海量的多态免杀木马、自动化漏洞利用链和自动化的内网横向移动脚本。在这场“半人马对决半人马”的高维战争中,如果防守方依然坚持纯人工防御,或是把安全交给极其死板的“AI 独裁”系统,其结果必将是被降维屠杀。我们构筑“半人马 SOC”的根本目的,是用更紧密的人机信任、更快速的反馈闭环,在 OODA 循环(观察、调整、决策、行动)中彻底击垮对面的“暗黑半人马”。

四、 从“操作员”到“牧羊人”:安全专家的职业跃迁

技术范式的每一次地震,都会无情地碾碎旧的职业形态,同时在废墟之上孕育出全新的物种。当底层的数据清洗、特征提取、甚至基础的漏洞扫描都被 AI 接管后,“安全工程师”这个头衔的内涵将发生根本性的变异。

未来的安全从业者,将经历一场从“枯燥的系统操作员(System Operator)”向“高维度的 AI 牧羊人(AI Shepherd)”的职业跃迁。这种跃迁要求我们掌握三种全新的核心技能。

4.1 提示词工程与意图转译(The Art of Intent Translation)

在特征码时代,我们学习的是汇编语言、C 语言或 Python;在 SIEM 时代,我们学习的是 SPL(Splunk 搜索处理语言)或 KQL(Kibana 查询语言)。但在“半人马”时代,最重要的编程语言将退化——或者说进化——为人类的自然语言。

未来的高级安全分析师,必须是顶尖的“提示词工程师(Prompt Engineers)”。他们需要极其精准地向大语言模型表达安全意图。

面对一个未知的恶意软件样本,平庸的分析师可能会问:“分析这个文件。”(AI 可能会给出一堆无用的通用描述)。

而顶尖的“牧羊人”会构建这样的多步提示词网络(Prompt Chain):“扮演一位具有 20 年经验的逆向工程师。反汇编给定的二进制文件片段。首先,提取所有可能用于抗虚拟机检测(Anti-VM)的 API 调用序列;其次,寻找与已知勒索软件家族 LockBit 具有统计相似性的加密算法特征向量;最后,以 MITRE ATT&CK 框架的格式输出战术映射表,并给出置信度评分。”

与硅基大脑对话,引导其庞大的参数网络朝着极其狭窄和专业的安全领域进行深度收敛,将成为未来十年的核心竞争力。

4.2 算法审计与对抗性思维(Algorithm Auditing & Adversarial Mindset)

既然我们已经知道 AI 并非绝对可靠,那么未来的安全红队(Red Team)除了攻击传统的操作系统和 Web 应用外,将把大量的精力倾注于“攻击我们自己的 AI”。

这催生了“算法审计师”与“AI 红队测试员”这两个极其硬核的新职业。他们的日常工作不再是发送 SQL 注入 payload,而是:

- 对抗性样本生成: 精心构造微小的、肉眼无法察觉的数据扰动(例如,在正常的网络流量中注入极少量的噪声包),以测试内部署的 AI 流量检测引擎是否会发生“分类器崩溃”。

- 模型越狱测试(Model Jailbreaking): 针对公司内部部署的安全大模型,不断尝试使用极其晦涩的逻辑陷阱、角色扮演指令或多语言混合提示词,试图绕过模型的安全护栏(Guardrails),诱导其输出敏感的商业情报或执行越权的网络阻断命令。

人类在对抗中寻找机器逻辑的盲区,并在机器暴露脆弱性之前,用数学或工程的手段为其打上补丁。这种基于深层神经网络特性的博弈,是纯粹的技术狂欢。

4.3 架构视角的降维打击:动态隔离与边界定义(Dynamic Isolation & Boundary Definition) 掌握了 AI 的对话技巧还不够,顶尖的安全专家必须具备宏观的架构师思维。当内部的 AI 智能体开始接管一部分安全策略时,人类需要为其划定物理与逻辑的活动边界。未来的“牧羊人”需要精通如何在复杂的数据中心(DC)网络中规划 AI 的运行环境:

- 多租户与微隔离(Micro-segmentation): 利用 AI Planning 结合 VXLAN/EVPN 等网络虚拟化技术,人类架构师可以为不同的业务线构建深度的逻辑隔离区。

- 防越狱的“物理气闸”: 通过将 AI 的感知能力与底层的动态切片技术结合,人类能确保即使防御 AI 本身遭遇了“模型污染”或被恶意诱导发生反向攻击,其破坏力也会被死死限制在极小的网段沙箱内。

人类设计网络架构的纵深与隔离度,正是 AI 能够安全、可控运行的坚实底座。

4.4 危机翻译与商业同理心(Crisis Translation & Business Empathy)

随着网络攻击的破坏力越来越向物理世界和商业核心蔓延(如工厂停工、股市闪崩),安全领导者(如 CISO)的核心价值将从“解决技术 Bug”彻底转向“管理商业风险”。

AI 可以告诉你系统被入侵的概率是 99.9%,但 AI 无法走进董事会的会议室,面对焦头烂额的 CEO 和愤怒的股东,用通俗易懂的商业语言解释这场灾难的后果。

人类专家需要具备极强的“危机翻译能力”与同理心。当 AI 提供了一份冷冰冰的损害评估报告时,人类安全官需要将其转化为具体的商业行动指南:“我们不应立刻切断全球的服务器电源,因为这会导致供应链违约金高达数千万美元;我们可以让 AI 在边缘节点构建一层动态蜜罐(Honeypot)进行流量重定向,在不惊动攻击者的情况下,为法务团队争取 48 小时的证据保全时间。”

机器懂比特,而人类懂人性。在安全灾难降临的至暗时刻,能够安抚恐慌、权衡利弊、并在绝望中做出具有道德底线和商业智慧决断的,唯有人类。

五、 重构信任矩阵:如何避免“自动驾驶”悖论?

构建“人机协同”的护城河,在工程落地上最大的绊脚石并非技术本身,而是人类深层的心理弱点:我们极容易对机器产生极端的过度信任(Over-reliance)或过度不信任(Under-reliance)。

在航空业和自动驾驶领域,这被称为“自动驾驶悖论(Autopilot Paradox)”。当机器在 99% 的时间里都表现得完美无缺时,人类驾驶员的警惕性会彻底降级,陷入走神或昏睡状态。而当那 1% 的极端边缘情况(Edge Case)突然爆发,机器瞬间失控并将控制权交还给人类时,处于“认知休眠”状态的人类根本无法在几秒钟内重建对复杂局势的理解(Situational Awareness),最终导致机毁人亡。

在 AI 驱动的安全运营中心(SOC)里,同样的致命悖论正在上演。如果 AI 自动处理了所有的常规告警,人类分析师每天只是无脑地点击“确认”,那么当真正的高阶数字武器撕裂防线、AI 发出极其微弱的未知求救信号时,退化的人类分析师将完全失去抵御能力。

为了避免“护城河”从内部崩塌,我们必须在系统架构和运营机制上,精心重构人与机器的“信任矩阵”。

5.1 信任校准:从“黑盒信仰”到“可解释概率”

人类不能像信仰神明一样信仰 AI。系统的设计必须强制进行信任校准(Trust Calibration)。

当 AI 给出一个阻断建议时,系统绝不能仅仅弹出一个红色的“危险(100%)”标签。相反,它必须展示其决策的“内部挣扎”。AI 需要输出类似这样的信息:“建议阻断该进程。但在我的决策树中,基于网络流量特征的置信度高达 95%,而基于文件签名的置信度仅为 40%。我的特征空间显示,该行为有 15% 的概率是内网渗透测试工具的变种。”

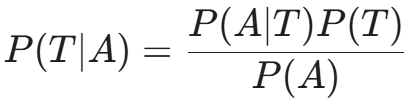

在贝叶斯推断的框架下,我们可以用严格的数学模型来校准这种信任度。假设人类对机器决策的初始信任度为先验概率 $P(T)$,机器给出的警报为事件 A,如果机器在类似历史场景下的假阳性率(False Positive Rate)极高,那么人类必须根据贝叶斯定理大幅下调后验信任度 P(T|A):

通过在人机界面中强制暴露这些置信度衰减、决策依据以及概率盲区,系统能够不断刺激人类分析师保持警惕,迫使他们用人类的怀疑精神去审查机器的结论,从而打破“自动驾驶”的催眠效应。

5.2 动态权限流转(Dynamic Privilege Allocation)

在人机协同的护城河中,控制权的分配不应是静态的,而必须是随着战场态势动态流转(Dynamic Routing)的。

- 和平时期的“人类主导,机器建议”: 在日常的安全巡检、合规性扫描和低烈度对抗中,AI 作为辅助工具提供建议,人类拥有绝对的否决权。系统甚至可以刻意将一些 AI 已经确认安全的流量,伪装成异常推给人类分析师,以此来进行“肌肉记忆”的训练。

- 战争时期的“机器主宰,人类熔断”: 当检测到内网爆发极其猛烈的、在毫秒级自我复制的多态蠕虫病毒,或者遭遇大规模、多向量的 DDoS 攻击时。此时,人类的反应速度将成为致命的瓶颈。系统必须能够根据预设的威胁阈值,自动进入“最高戒备状态”。在这个状态下,防御 AI 将接管绝大部分底层设施的路由重定向和端口封锁权限,以机器的速度对抗机器。而人类的角色则瞬间后撤,双手放在最高级别的“物理熔断器”上,专注于防止防御 AI 因为敌方的高阶对抗性攻击而发生“同归于尽”式的系统自毁。

5.3 沉浸式演练:对抗认知退化

为了防止安全团队在 AI 的保护下退化为“只会看报表的温室花朵”,企业必须建立高强度的“合成数字军演(Synthetic Cyber War Games)”机制。

这就像军队在没有战争时必须进行实弹演习。未来的安全架构将包含一个平行的“数字孪生(Digital Twin)”环境。系统会定期、随机地向分析师的屏幕上注入由 AI 生成的、极其逼真的高维攻击幻象(例如一次完美的供应链投毒模拟)。

在这些演练中,分析师被剥夺了过度依赖的自动化分析工具,被迫回到网络协议的底层,手动抓包、分析内存 dump、还原攻击逻辑。只有通过这种残酷的、人为制造的危机感,人类才能保持对数字世界底层的敏锐直觉,确保当真正的末日级攻击穿透了 AI 防线时,人类依然有能力拔出冷兵器,进行最后的近身肉搏。

六、 终极不对称:为什么人类的“缺陷”正是安全的最大特征?

在探讨人机协同的最高境界时,我们必须打破一个在工程界流传甚广的迷思:机器是完美的,而人类是充满缺陷的。在算法工程师的眼中,人类的情绪化、疲劳、认知偏见和非理性决策,都是系统工程中需要被消除的“Bug”。

然而,当你站在网络安全攻防对抗的最前线,面对那些同样由顶级 AI 驱动、深谙数学优化之道的国家级黑客团伙时,你会发现一个极其震撼的反直觉真理:在高度内卷的硅基对抗中,人类所谓的“缺陷”,恰恰是我们手中最后、也最具破坏力的“不对称武器”。

6.1 认知熵(Cognitive Entropy)与反脆弱逻辑

任何深度学习模型,无论其参数量达到多少千亿,其底层都受制于数学的决定论或概率分布。AI 优化的本质是寻找损失函数的全局最优解(Global Minimum)。这就意味着,面对相同的输入数据和语境,一个高度优化的防御 AI,其做出的反应在宏观上是可预测的(Predictable)。

在博弈论中,可预测性是致命的。如果攻击者通过无数次的黑盒试探,摸清了防御 AI 的权重分布和阻断阈值,他们就可以通过对抗性生成网络(GANs),精确构造出正好卡在“判定边界(Decision Boundary)”之下的微小扰动,从而如入无人之境地穿透防线。

而人类大脑的运作机制,恰恰违背了这种机械的优化逻辑。人类充满着“认知熵”——我们的直觉判断往往掺杂了当天的情绪、灵光一现的直觉、对某个历史事件的模糊联想、甚至是毫无根据的怀疑。

- 战略级的“非理性”混合策略: 这种看似非理性的、充满随机性的思维跳跃,在零和博弈中构成了完美的“混合策略(Mixed Strategy)”。人类防御者可能会在没有任何明确数据支撑的情况下,仅仅因为“感觉某个网段的安静显得太不自然”,就突然下令对核心数据库进行物理隔离。

- 打破预期的降维打击: 这种毫无数学规律可循的“神经质”决策,会瞬间摧毁攻击者精心计算的概率模型。当攻击者的 AI 还在计算如何绕过复杂的数字签名时,人类安全官可能已经下令直接切断了该地区的 BGP 路由。人类的这种“混乱”与“不可预测”,为系统注入了极其宝贵的反脆弱性(Antifragility),让高度同质化的硅基战争陷入认知瘫痪。

6.2 道德罗盘:超越“对齐难题”的最后防线

我们在前面的章节中多次提到 AI 的“价值对齐(Value Alignment)”难题。AI 没有生命,没有痛觉,也没有对同类的共情。对于一个纯粹的防御 AI 来说,“保护公司数据资产”是一个可以通过最大化奖励函数来实现的冷冰冰的数学目标。

如果系统仅仅追求单一指标的最优化,它极有可能在面临极端危机时,得出反人类的“休克疗法”。例如,当检测到勒索软件正在全网横向移动时,防御 AI 可能会评估得出:最优解是立刻引爆所有服务器的主板微代码,彻底物理销毁设备以防止数据落入敌手。在数学上,数据没有泄露,任务完成了;但在现实中,公司破产了。

- 人性的锚点: 人机协同的终极护城河,在于人类将自己的“道德罗盘(Moral Compass)”硬编码到了整个安全体系的最高控制权中。人类不仅考虑“如何赢”,更考虑“赢的代价”。

- 伦理困境的仲裁: 当网络战延伸到医疗系统、电网调度和核设施时,是否要为了揪出一个潜伏的后门而导致大面积停电?是否要为了反击黑客而波及无辜的平民网络?这些是极其复杂的伦理学问题。没有任何一组复杂的 LaTeX 公式或强化学习算法能够替人类做出回答。机器负责提供概率,而只有具备同理心和敬畏之心的人类,才能在电光火石之间做出那个闪耀着人性光辉的艰难抉择。

6.3 “反思”的特权:范式转移的唯一引擎

机器能够极其出色地在既定的规则框架内进行无限的微调和进化(例如 AlphaGo 在围棋规则内战胜全人类),但机器无法跳出框架本身去反思规则的合理性。

在网络安全的历史长河中,每一次防御体系的跃迁(从防火墙到零信任,从特征码到行为基线),都不是机器算出来的,而是人类安全专家在经历了惨痛的失败后,对整个技术范式进行哲学级别反思的结果。

未来的黑客技术必然会进化出我们今天连名字都叫不出的新形态(可能是基于量子纠缠的隐蔽信道,也可能是针对脑机接口的直接模因注入)。当现有的 AI 防御模型被彻底打穿、其底层的特征空间完全失效时,AI 只会陷入无尽的报错或死循环。

只有人类能够站在废墟上,拍拍身上的灰尘,运用极其强大的“跨域联想能力(Cross-domain Association)”,从生物免疫学、量子物理学或社会学中汲取灵感,重新定义什么是“安全”,重新划定新的战场边界。这种创造全新范式的能力,是人类面对硅基智能时最坚固的认知护城河。

七、 走向共生:构建下一代“碳硅融合”的安全文化

明白了人机协同的必要性与不可替代性,我们在落地层面就需要彻底改变现有的安全管理理念。我们必须从“采购工具”的思维,转变为“培育共生体”的思维。建立下一代安全文化的关键,在于重塑三个核心支柱。

7.1 从“工具链”到“数字孪生战友”

过去,安全团队对待防火墙、WAF 和 EDR 的态度,就像木匠对待手中的锤子——用完即放,坏了就换。但在 AI 时代,大语言模型和强化学习智能体(Agent)不再是死板的工具,它们拥有记忆、上下文连贯性和演化能力。

未来的安全运营中心,每个分析师都将配备一个专属的“数字孪生战友(Digital Twin Copilot)”。

- 知识的深度绑定: 这个 AI 不仅学习了全球的威胁情报,它更在数年的朝夕相处中,深度学习了这位人类分析师独特的思维习惯、查错逻辑甚至直觉偏好。

- 背靠背的信任: 就像狙击手和观察员的配合一样,分析师可以将最繁琐的逆向工程剥离给 AI,而 AI 会在发现微小异动的瞬间,以该分析师最容易理解的方式进行提示。这种“碳硅融合”的默契,将把单兵的防御作战效能放大数百倍。

7.2 容错与演练:为“人类直觉”留出犯错的空间

如果一个安全领导者要求其团队“像 AI 一样精准,零误报,零漏报”,那么这支团队最终会被 AI 彻底取代,因为在机械的精准度上,人类永远无法战胜机器。

打造高韧性的安全团队,必须在文化上包容甚至鼓励“基于直觉的探索”。

- 设立“直觉狩猎日”: 允许安全分析师在没有任何 AI 告警的情况下,仅仅凭着自己的好奇心和第六感,去翻阅冷门的日志,去深挖一个看似毫无威胁的废弃端口。

- 对“合理误判”的宽容: 当分析师因为高度警觉而错误地阻断了一次正常业务时,不应一味惩罚,而是要复盘其背后的逻辑链路。正是这些跳脱出 AI 预期的“误判”,构成了训练下一代防御模型最宝贵的长尾数据(Long-tail Data)。

7.3 哲人将帅:CISO 视角的终极升华

在人机高度协同的未来,企业首席信息安全官(CISO)的画像将发生翻天覆地的变化。他们不再是整天盯着漏洞扫描报告的“超级工程师”,而是蜕变为“数字时代的哲人将帅”。

- 资源调配的艺术: 他们需要像军事统帅一样,在有限的算力、预算和时间下,精准地调配“纯 AI 自动化编队”、“半人马协同编队”与“纯人类特种突击队”的投入比例。

- 跨学科的布道者: 他们需要深入理解国际地缘政治、AI 伦理法案(如欧盟《AI 法案》)、甚至一点心理学,从而在代码与法律、机器与人性之间,为企业搭建一座安全、合规且充满韧性的坚固桥梁。

7.4 韧性至上(Cyber Resilience):从“御敌于外”到“向死而生”

人机协同的终极文化结晶,是带领企业实现从“绝对安全(Absolute Security)”向“网络韧性(Cyber Resilience)”的理念跨越。 传统的安全文化沉迷于“御敌于外”的幻觉,试图构建一堵密不透风的高墙。但在 AI 时代,面对能在瞬间穷举千万种攻击向量的对手,墙,是一定会被打破的。下一代的“碳硅融合”安全文化必须是一种“向死而生”的文化:我们承认系统存在盲区,承认 AI 会被欺骗,承认人类会犯错。 因此,我们的目标不再是追求 100% 的不可突破,而是通过人机之间的高效协同,在灾难发生时实现极速的感知、果断的隔离(例如自动化微隔离与人类决策的无缝配合)以及从废墟中迅速重生的业务恢复能力。这种即使在降级状态下依然能保持核心业务运转的“韧性”,才是数字化企业在硅基狂潮中屹立不倒的真正脊梁。

结语:执剑者的传承——致下一代数字长城的守望者

当全系列的第五十篇文章敲下最后一个字符,这股在心头激荡了数月之久的思绪终于缓缓平息。我们走到了《硅基之盾》旅程的终点。

在本专栏开篇的第一讲中,我们曾借用两个改变了人类历史命运的伟大人物作为隐喻:罗伯特·奥本海默与艾伦·图灵。奥本海默释放了原子核内部毁天灭地的物理能量,将人类带入了核威慑的恐怖平衡;而图灵则开启了计算与逻辑的无垠硅基宇宙,赋予了人类创造第二物种的钥匙。

今天,当我们真正站在 AI 时代的风暴之眼,我们比任何时候都更加深刻地意识到:人工智能,正是这个时代的“数字核能”。它可以化为照亮人类文明前路的无尽灯火,可以成为抵御万千数字瘟疫的坚固神盾;但只要稍有不慎,它同样会沦为毁灭全球金融秩序、瘫痪大国基础设施命脉、甚至彻底撕裂人类社会信任基础的终极武器。

这五十篇文章,近三十万字的沙盘推演与底层剖析,绝非仅仅是为了传授你如何编写一段精妙的、足以绕过 WAF 的提示词,或是教你如何部署一个基于深度学习的自编码器模型。因为我们深知,这些具体的代码和工具,在三年、甚至短短一年之后,就会被拥有更庞大参数量和更先进架构的新算法无情淘汰。

这套专栏的终极使命,是试图在每一位有志于守护数字世界的网络安全从业者心中,种下一颗名叫“高维认知”的种子。

在未来那个连攻击脚本都是由 AI 智能体彼此对话、瞬间生成的深空宇宙里,攻防的速度将彻底超越人类脆弱的神经反射,战场的边界将完全融化在量子比特的纠缠与隐空间的张量之中。到那时,捍卫人类文明的网络安全城墙,将不再是由 C++ 、Python 或是任何一种编程语言砌成,而是由人类独有的意志、伦理、直觉与责任感,混合着硅基的狂暴算力,共同浇筑而成。

机器能够通过复杂的损失函数,计算出极其完美的防御概率最优解,但机器永远、也绝不可能知道我们为什么要防御。

我们选择防御,是因为在监控屏幕背后跳动的每一组枯燥数据,都承载着一个真实人类的隐私、财产与不可侵犯的尊严;我们选择防御,是因为数据中心里每一根光纤、每一行底层代码,都维系着现代社会的正常运转与文明的存续;我们选择防御,更因为在冰冷的、只讲求概率与胜率的硅基逻辑面前,人类必须死死捍卫我们对这个世界的最终解释权。

这,就是“人机协同”不可撼动的最高真理。AI 将赋予我们比肩神明的力量,而我们作为人类,必须用颤抖却坚定的双手,握紧这股力量的道德剑柄。

在这个技术爆炸、认知剧变的时代,能够打败一个拥有顶级 AI 的黑客的,绝不是另一个孤立运行的、冷冰冰的 AI,而是一个深度驾驭了 AI、且内心深处依然燃烧着不灭极客之火的人类战士。

感谢你陪伴我走完这场漫长、枯燥却又无比震撼的思维旅途。愿你在未来的赛博前线,既有硅基的算力作为坚不可摧的绝对之盾,更有碳基的心智作为洞穿一切虚妄的审判之矛。

各位同袍,文运昌隆,顶峰相见。

陈涉川

2026年03月23日

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)