用改进 CPO 优化 CNN - BiGRU - Attention 算法模型实现多变量时间序列分类预测(Matlab 版)

改进CPO优化CNN-BiGRU-Attention算法模型,基于改进CPO优化卷积神经网络-门控循环单元结合注意力机制的多变量/时间序列/分类预测,Matlab实现 1.多特征输入单输出,多特征多输出等,可换LSTM,BiLSTM,GRU,TCN等 2.特点: [1]卷积神经网络 (CNN):捕捉数据中的局部模式和特征; [2]双向门控循环单元 (BiGRU):处理数据捕捉长期依赖关系: [3]注意力机制(Self Attention):为模型提供了对关键信息的聚焦能力,从而提高预测的准确度。

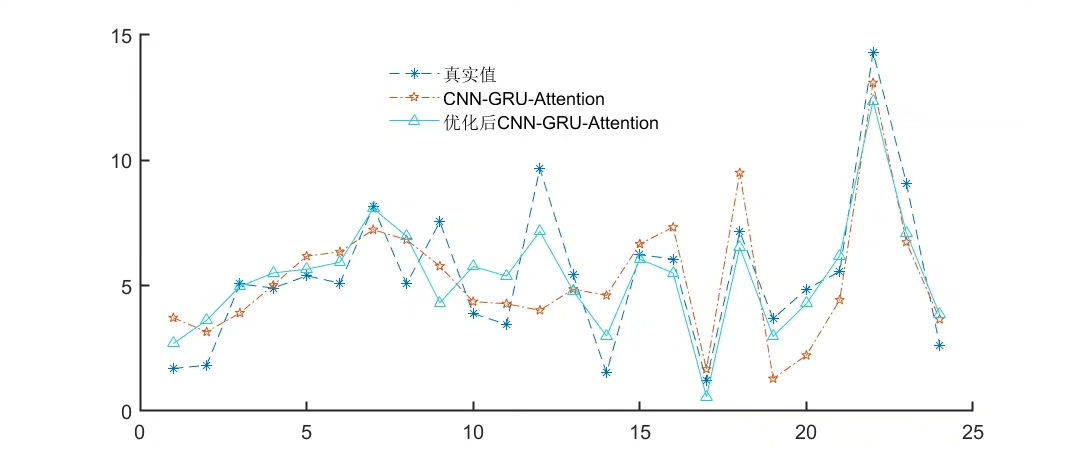

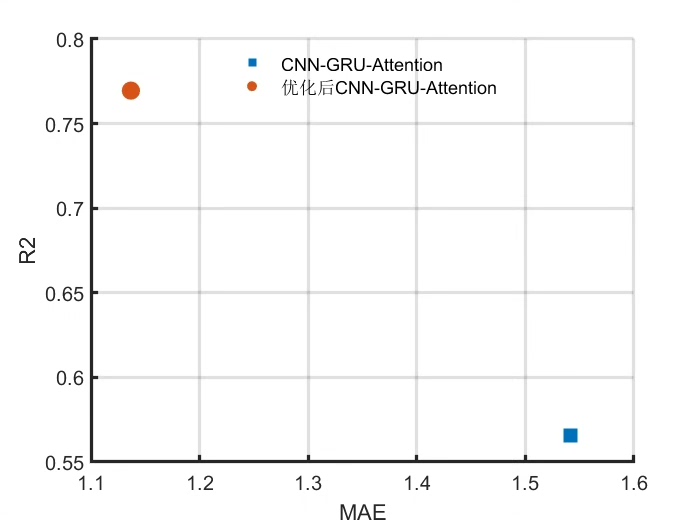

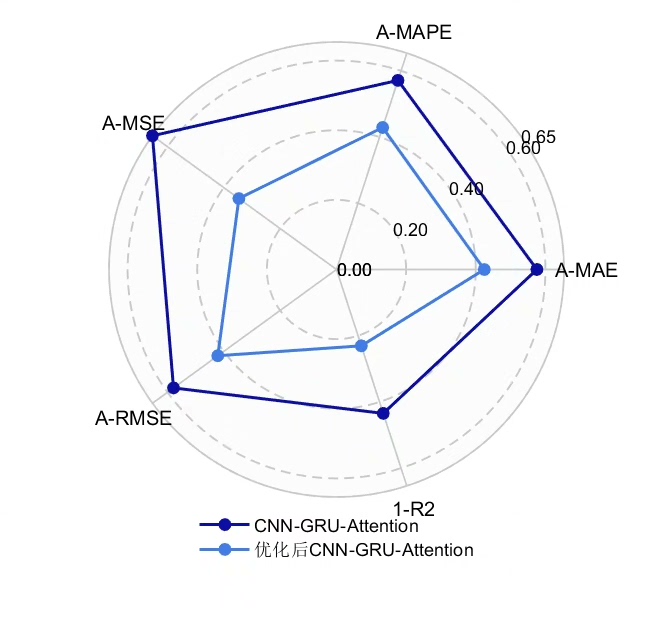

在时间序列预测领域,为了更精准地预测数据走向,各种模型层出不穷。今天咱们就来唠唠基于改进 CPO 优化的 CNN - BiGRU - Attention 算法模型,并且用 Matlab 来实现它。

一、模型构成剖析

1. 卷积神经网络(CNN)

CNN 的主要作用就是捕捉数据里的局部模式和特征。想象一下,时间序列数据就像一条长长的线,CNN 就好比一个放大镜,能聚焦在数据的一小段上,敏锐地发现这一小段数据里独特的模式。在 Matlab 里构建简单的 CNN 层可以这样写:

layers = [

sequenceInputLayer(inputSize)

convolution1dLayer(filterSize,numFilters,'Padding','same')

reluLayer()];这里sequenceInputLayer定义了输入层,inputSize就是输入数据的维度。convolution1dLayer创建了一维卷积层,filterSize是卷积核的大小,numFilters是卷积核的数量,'Padding','same'保证卷积后的输出尺寸和输入一样,reluLayer则引入了激活函数,让模型具备非线性拟合能力。

2. 双向门控循环单元(BiGRU)

BiGRU 的妙处在于处理数据时能捕捉长期依赖关系。时间序列数据前后关联紧密,BiGRU 就像一个记忆超群的助手,既能记住前面的数据信息,又能顾及后面的数据变化。在 Matlab 里添加 BiGRU 层:

layers = [layers

bidirectionalLSTMLayer(numHiddenUnits)

fullyConnectedLayer(numClasses)

softmaxLayer()

classificationLayer()];bidirectionalLSTMLayer这里虽然函数名带 LSTM,但实际也可替换为bidirectionalGRULayer来实现双向 GRU 功能,numHiddenUnits是隐藏单元的数量,后续层依次完成全连接、Softmax 激活以及分类任务。

3. 注意力机制(Self Attention)

注意力机制就像是给模型安上了一双“慧眼”,让模型能聚焦关键信息,进而提高预测准确度。打个比方,在一堆复杂的数据中,它能快速挑出对预测结果最重要的部分。在 Matlab 中实现注意力机制相对复杂些,简单示意代码如下:

function [attendedFeatures] = selfAttention(features)

% 假设 features 是一个三维张量 [sequenceLength, numFeatures, batchSize]

query = features;

key = features;

value = features;

attentionWeights = softmax(query * key' / sqrt(size(key,2)));

attendedFeatures = attentionWeights * value;

end这里简单模拟了注意力机制的计算过程,通过计算查询、键和值之间的关系,得到注意力权重,再据此对特征进行加权求和得到关注后的特征。

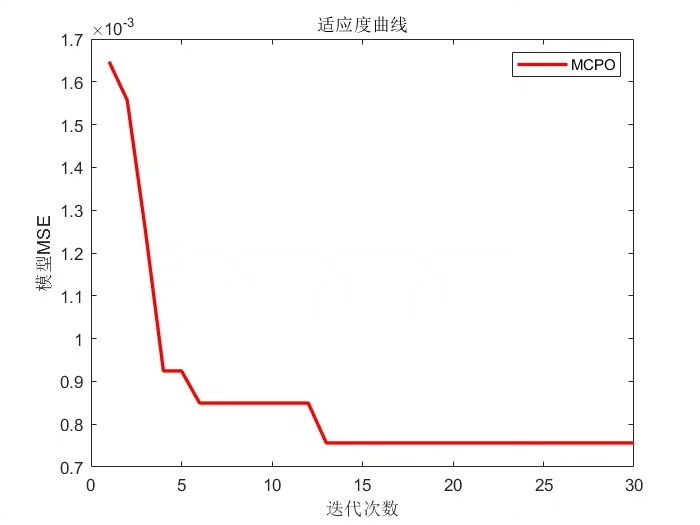

二、改进 CPO 优化

CPO(Constrained Policy Optimization)通常用于优化策略网络,但在这里我们对其改进应用于 CNN - BiGRU - Attention 模型,以更好地调整模型参数,让模型收敛更快、预测更准。具体改进思路可能涉及对传统 CPO 算法的约束条件、更新步长等方面的调整,这需要根据具体数据集和任务来定。

三、多特征输入与输出

这个模型支持多特征输入单输出,也能实现多特征多输出。要是你想换换口味,LSTM、BiLSTM、GRU、TCN 等都可以替换进来。比如把 BiGRU 换成 BiLSTM,只需要把前面代码里的bidirectionalGRULayer换成bidirectionalLSTMLayer就好啦。

改进CPO优化CNN-BiGRU-Attention算法模型,基于改进CPO优化卷积神经网络-门控循环单元结合注意力机制的多变量/时间序列/分类预测,Matlab实现 1.多特征输入单输出,多特征多输出等,可换LSTM,BiLSTM,GRU,TCN等 2.特点: [1]卷积神经网络 (CNN):捕捉数据中的局部模式和特征; [2]双向门控循环单元 (BiGRU):处理数据捕捉长期依赖关系: [3]注意力机制(Self Attention):为模型提供了对关键信息的聚焦能力,从而提高预测的准确度。

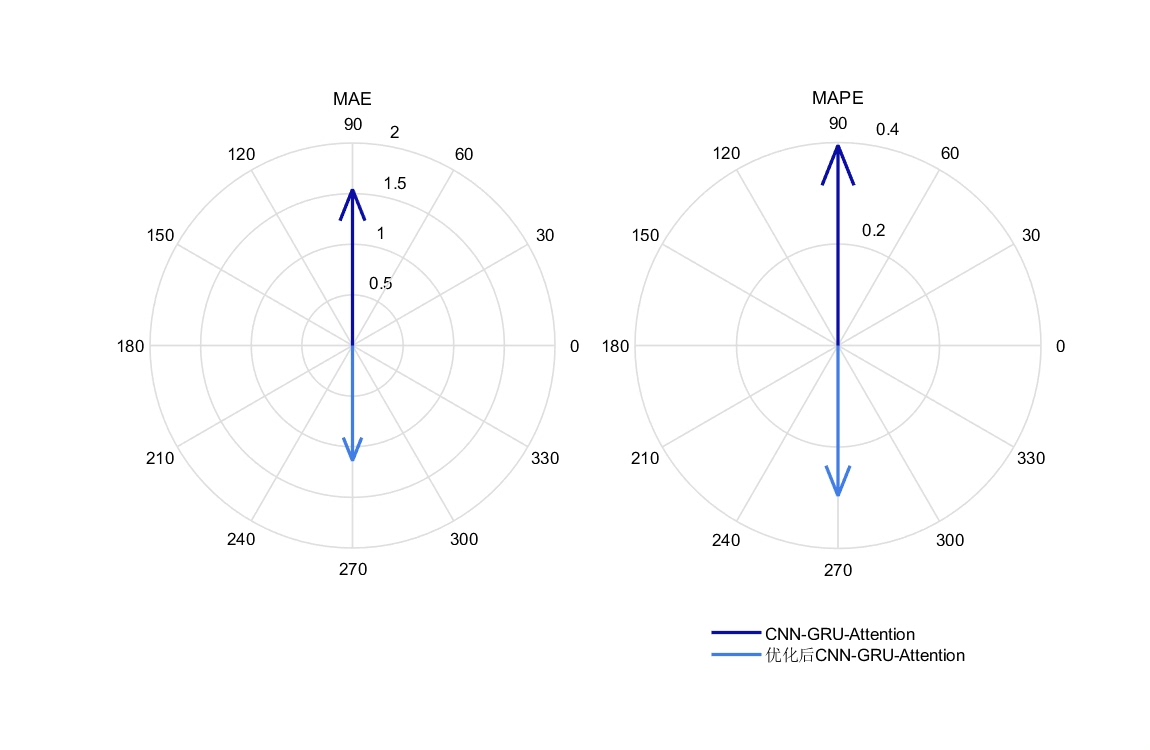

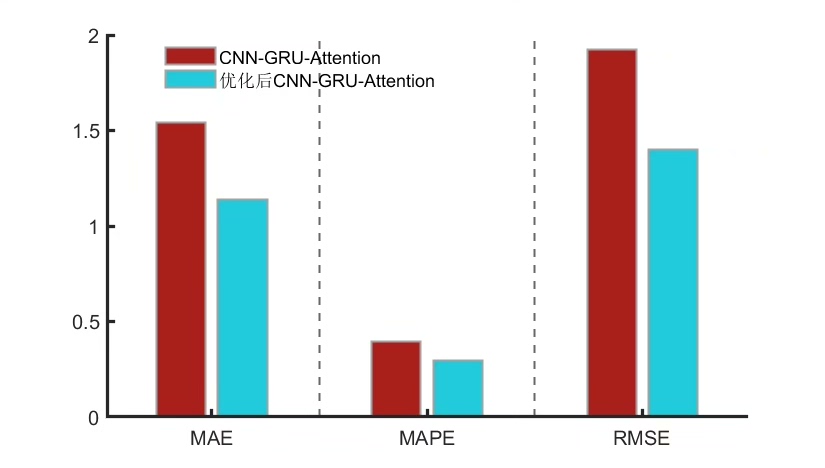

通过这样的改进 CPO 优化 CNN - BiGRU - Attention 模型,再结合 Matlab 强大的计算和可视化功能,我们能在多变量时间序列分类预测任务中取得不错的成果。希望大家可以根据实际需求调整和完善这个模型,让它在自己的项目里发光发热。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献47条内容

已为社区贡献47条内容

所有评论(0)