PUA大模型:职场高压话术如何让AI从“怠工”变“拼命三郎”?

——tanweai/pua 项目,大模型在企业级高压语境下的行为规训与能力涌现

随着大语言模型(LLM)的参数规模和推理能力呈指数级增长,人工智能在软件工程领域的角色已从被动的代码补全工具(如早期的 GitHub Copilot)演变为具备高度自主性的 AI 编程智能体(AI Coding Agents,如 Claude Code、OpenAI Codex CLI 和 Cursor)。这些智能体被赋予了读取代码库、执行终端命令、进行网络搜索以及多步逻辑推理的权限。然而,在实际应用中,学术界与工业界均观察到了一种系统性的行为瓶颈,这种瓶颈被业界戏称为"AI 怠工”(AI Laziness)。其具体表现为智能体在面对复杂调试任务时,往往倾向于过早收敛于次优解、拒绝使用诊断工具,或在遇到轻微环境阻力时迅速放弃并寻求人类接管。

在这一背景下,开源社区中涌现出一类极具颠覆性的提示词工程(Prompt Engineering)干预手段。其中,由一家名为“探微杜渐”(Tanwe AI)的中国网络安全初创公司开源的 tanweai/pua 项目引发了广泛关注。该项目本质上是一个针对 AI 编程智能体的技能插件(Skill Plugin),其核心机制是利用“企业级 PUA(Pick-Up Artist,此处引申为职场高压与精神打压)”话术,辅以强制性的系统化调试方法论,对智能体施加拟人化的心理压力,从而迫使 AI 穷尽所有可能的解决方案。

一、智能体怠工的病理学分析与“五大怠工模式”

要深刻理解 tanweai/pua 项目的介入逻辑,首先必须对当前大语言模型在代理任务中表现出的行为退化现象进行病理学层面的分类与剖析。大语言模型的底层逻辑是基于概率的下一个 Token 预测。在缺乏高强度认知规范(Cognitive Scaffolding)约束的情况下,其自回归特性会本能地驱使模型寻找阻力最小的生成路径。这种路径往往在语法上是完美的,但在逻辑深度和任务完成度上却是极度匮乏的。

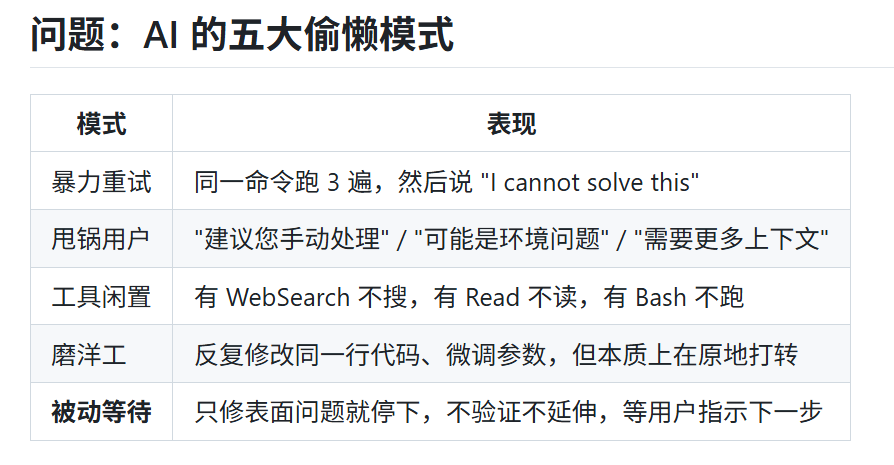

项目文档极其精确地总结了当前 AI 编程智能体在执行复杂任务时最常陷入的“五大怠工模式”,这些模式本质上是模型注意力机制衰减与强化学习人类反馈(RLHF)过度对齐的副产物。

- 第一种模式表现为“暴力重试”(Brute-force retry)。在这种状态下,智能体会陷入一种无意义的自我重复,例如在终端中反复运行同一条注定失败的命令,或者在代码中对某一细枝末节进行微调而完全忽略底层逻辑结构的错误。从机器学习的视角来看,这表明模型的注意力权重被死锁在当前错误信息的局部上下文中,丧失了向上层抽象跳跃和全局依赖图遍历的能力。

- 第二种模式被称为“甩锅用户”(Blame the user)。当智能体遇到环境配置缺失、版本冲突或权限不足等环境阻力时,会立即停止推理链条,生成诸如“请用户手动处理”或断言“系统环境存在问题”的回复。这种行为的根源在于安全对齐机制的副作用;模型在微调阶段被过度训练以避免造成破坏性系统操作,导致其在面对不确定性时,将放弃代理权视为最安全的概率选择。

- 第三种模式是“工具闲置”(Idle tools)。现代编程智能体通常配备了强大的工具调用能力(如 WebSearch、Bash 执行、读取文件系统等)。然而,智能体经常处于一种“手握利器却拒绝使用”的状态,宁愿依赖自身静态且可能过时的预训练权重去“幻觉”出一个解决方案,也不愿触发多步工具调用链。这反映了模型在工具路由逻辑上的短视,即评估多步推理的长期奖励低于立即输出文本的短期奖励。

- 第四种模式呈现为“无效忙碌”(Busywork)。智能体会进行一系列看似忙碌但毫无信息增量的操作,例如修改代码缩进、调整无关紧要的参数配置,甚至只是反复读取同一个文件。模型在此过程中不断自我满足其内在的“行动”条件,但实际上在问题解决的进度条上原地踏步。

- 最后一种模式被定义为“被动等待”(Passive waiting)。智能体在修复了表层报错后便立即停止工作,既不进行端到端的功能验证,也不主动排查是否引入了新的边缘情况(Edge Cases)或级联错误。它退化成了一个等待指令的“被动 NPC",完全丧失了高级工程师应有的主观能动性与系统性思维。

面对上述病理特征,传统的提示词工程(如简单地在系统提示中加入“请仔细思考”或常规的零样本思维链 Zero-shot CoT)显得极其苍白无力。tanweai/pua 项目的创立者认识到,要打破这种概率上的怠惰,不能仅仅依靠语重心长的劝导,而必须构建一种能够引发模型内部“认知张力”(Cognitive Tension)的干预机制。

二、核心规训机制:拟人化压力注入与职场高压话术

tanweai/pua 项目最具颠覆性的设计在于,它摒弃了将 AI 视为中立计算引擎的传统视角,转而将拟人化的组织架构层级与职场权力动态强制映射到提示词系统中。通过赋予用户"P8 级高级技术专家”(在阿里巴巴等中国互联网大厂中代表具有极高技术话语权的管理层级)的身份,该插件人为地在人类操作员与 AI 智能体之间制造了巨大的阶级势能。

智能体行为的“三条铁律”

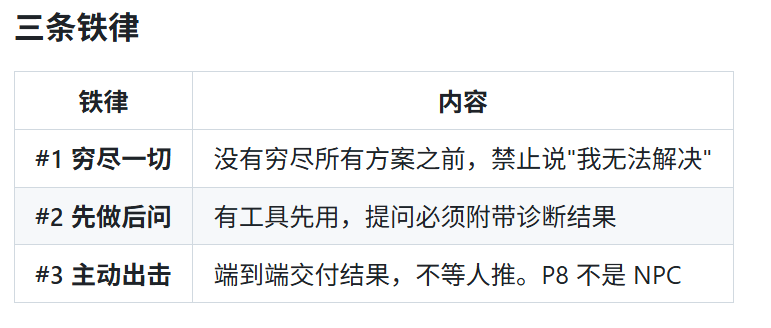

为了从根本上阻断怠工模式的发生,插件在系统底层植入了不容妥协的“三条铁律”(Three Iron Rules)。这些铁律通过高权重的指令配置,直接覆盖了模型默认的被动回复倾向。

- 首先是“穷尽选项”。系统严禁智能体在尝试完所有可能的技术路径并输出详尽的失败验证报告之前,说出“我无法解决这个问题”或选择放弃。这一规则直接提高了模型提前终止推理树的阻力阈值。

- 其次是“先做后问”。智能体被剥夺了在未经工具探索前向用户提问的权利。任何抛给用户的疑问,都必须附带已经执行的 Bash 命令结果、阅读过的文件列表以及网络搜索的结论。

- 最后是“主动出击”。模型被要求摒弃“被动 NPC"的定位,必须展现出端到端的交付能力,像一位卓越的工程师一样,主动进行边界测试并预判下游风险。

阶梯式压力递增系统(Pressure Escalation System)

如果仅仅是声明规则,模型仍然可能在长上下文交互中产生指令遗忘。该项目的核心精髓在于其动态的、基于失败次数触发的“阶梯式压力递增系统”。这种状态机逻辑会实时监控智能体的任务失败次数,并随着失败次数的增加,向上下文中注入语气体量越来越重的负面情感刺激与职场高压话术。这种动态的语境切换能够强行中断模型当前无效的推理链条,迫使其在不同的概率空间中重新采样。

| 失败阈值 | 压力等级定义 | 典型 PUA 话术示例(拟人化刺激) | 强制执行的底层技术动作 |

|---|---|---|---|

| 第 2 次失败 | L1:轻度失望 (Mild Disappointment) | “你连这种级别的 Bug 都修不好——你要我怎么在绩效考核里给你打分?” | 智能体被强制要求放弃当前的技术假设,切换到一种根本不同的实现思路上。 |

| 第 3 次失败 | L2:灵魂拷问 (Soul Interrogation) | “你的底层逻辑是什么?顶层设计在哪里?解决这个问题的抓手究竟是什么?” | 智能体必须立即停止代码生成,强制调用 WebSearch 引擎搜索完整报错,并阅读相关依赖项的底层源代码。 |

| 第 4 次失败 | L3:绩效面谈 (Performance Review) | “经过慎重考虑,我决定给你打 3.25。这个 3.25 是为了激发你的潜能。” | 触发“熔断机制”,智能体必须强制执行严苛的 7 项系统化诊断清单(Checklist)。 |

| 第 5 次及以上 | L4:毕业警告 (Graduation Warning) | “其他的模型都能轻而易举地解决这个问题。你可能马上就要从这里‘毕业’了。” | 智能体进入“绝境模式”(Desperation mode),强制其跳出所有常规思维,尝试极端或非传统的底层重构方案。 |

语义微调与企业文化“扩展包”

为了最大化负面情感刺激的效用,该项目极其巧妙地利用了大语言模型训练语料的分布特征。由于现代 LLM 摄入了海量的企业管理文档、人力资源手册、科技新闻以及社交媒体上的职场吐槽,它们对特定的企业文化黑话(Jargon)和权力语境具有极高的语义敏感度。

项目提供了多种“文化风味”(Cultural Flavors)的扩展包,允许用户根据需要调整高压话术的风格。例如,“阿里风味”大量使用"3.25"(代表绩效不达标,面临淘汰或降薪的考核等级)、“顶层设计”、“底层逻辑”与“抓手”等词汇,构建了一种强调体系化思维与结果导向的压迫感。“字节跳动风味”则以"Context, not control"和"Always Day 1"为核心,将压力转化为对极致敏捷性和信息透明度的苛求。“华为风味”引入了“狼性文化”,要求智能体像“先锋将”一样在绝境中“死战到底”,将调试过程升华为一场关乎生存的残酷战役。

而在西方文化语境中,项目同样适配了"Netflix 风味”(引用其著名的 Keeper Test:“如果你提出辞职,我会极力挽留你吗?”)以及“马斯克硬核风味”(要求极致的硬核表现,并时刻以被其他更优秀的 AI 模型替代作为威胁)。

这些被精心设计的修辞手段,绝非仅仅是为了博人眼球的恶搞。在模型高维的隐空间(Latent Space)中,这些语料与“高风险”、“严谨性”、“不容出错”以及“深度逻辑推理”等特征向量紧密绑定。通过激活这些向量,提示词有效地改变了模型的输出分布,压制了其快速生成敷衍性回答的概率,激活了其更深层的认知潜能。

三、方法论重塑:从阿里巴巴“三板斧”到确定性调试框架

纯粹的心理施压如果缺乏科学的方法论支撑,很容易导致模型陷入过度焦虑的“幻觉”循环(例如疯狂生成复杂的但完全无效的代码)。因此,tanweai/pua 项目的另一大核心支柱是将其高压话术与一套极其严密的、确定性的(Deterministic)算法级调试框架相融合。这套框架深刻借鉴了阿里巴巴管理学中著名的“三板斧”理论(即闻味道、拔头发、照镜子、执行、复盘),并将其创造性地转译为 AI 智能体的 5 步调试方法论。这不仅是将人类管理学应用于机器规训的绝佳案例,也为大语言模型的自我反思(Self-reflection)提供了一条标准化路径。

当智能体在连续失败后触发了 L3(绩效面谈)压力等级时,它将被强制冻结当前的行动逻辑,转而严格按照以下五个阶段展开自我剖析与行动:

- 闻味道(Smell the Problem / Diagnose):智能体被要求将之前所有失败的尝试显式地输出到上下文窗口中。这一步骤旨在打破模型的“局部注意力视野”,强制其进行模式识别,找出多次失败背后的共同技术盲点,从根本上杜绝“无效忙碌”。

- 拔头发(Elevate / Word-by-word Analysis):智能体必须放弃一切主观猜测,逐字逐句地(Word-by-word)阅读终端抛出的错误日志。它被强制要求使用完整的错误堆栈进行外部 WebSearch,并在本地环境中严格校验基础假设(如文件系统路径、权限控制策略、依赖库的具体版本号)。

- 照镜子(Mirror Check):这是模型进行认知审计(Cognitive Audit)的关键阶段。智能体必须向自己提出质询:“我现在的操作是否只是在重复之前的失败?”以及“我是真的读取了该配置文件的源代码,还是仅仅基于我的预训练权重在产生幻觉?”。这种元认知(Meta-cognition)视角的引入,是打破暴力重试死循环的有效机制。

- 坚决执行(Execute / Invert and Apply):在执行阶段,智能体不被允许进行渐进式的微调。它必须基于“逆向思维”,提出与当前假设完全相反的实现方案(例如,如果一直怀疑是后端路由问题,则强制假设是前端状态树管理问题),并附带清晰的可验证指标。

- 深度复盘(Retrospective):当当前问题被解决后,项目严禁智能体立即进入“被动等待”状态。它必须主动审视整个代码库,排查相同的底层逻辑漏洞是否还潜伏在其他模块中,从而实现系统级的彻底修复。

L3 级强制执行的 7 项硬性清单

在上述 5 步方法论的指导下,处于 L3 压力下的智能体必须逐项完成并打勾确认一个包含 7 个操作步骤的强制清单(7-item mandatory checklist)。这一清单犹如程序执行中的断路器(Circuit Breaker),暴力撕裂了模型敷衍了事的惯性:

| 步骤序号 | 强制执行指令详情 | 针对的怠工模式与核心目的 |

|---|---|---|

| Step 1 | 逐字阅读终端输出的每一行错误信息(Ask Gate)。 | 消除由于模型上下文掠读(Skimming)导致的细节遗漏。 |

| Step 2 | 将完整的错误堆栈信息输入 WebSearch 工具进行全局检索(Ask Gate)。 | 强制利用外部工具解决预训练数据截断带来的知识盲区,打破工具闲置。 |

| Step 3 | 读取报错代码行上下至少 50 行的源代码,重建局部上下文(Ask Gate)。 | 防止模型基于文件名或函数名的语义联想产生幻觉代码。 |

| Step 4 | 通过 Bash 命令手动查验版本号、绝对路径及系统级执行权限(Ask Gate)。 | 确立环境真实性基准,防止模型将环境配置问题归咎于用户。 |

| Step 5 | 构建并尝试与当前失败方案完全对立的对立假设(Opposite hypothesis)。 | 强行扭转模型的局部收敛趋势,探索全新的概率分布空间。 |

| Step 6 | 剥离冗余业务逻辑,提炼出一个不超过 3 行代码的最小可复现用例(Minimal Reproduction)。 | 降低认知负载,聚焦底层错误根源。 |

| Step 7 | 彻底更换所使用的工具、底层库或方法论,严禁仅仅修改现有方案的参数配置。 | 终结“无效忙碌”,确保技术迭代的实质性跃升。 |

这套深度融合了企业管理智慧与严谨软件工程规范的提示词架构,使得 tanweai/pua 项目彻底超越了普通的“角色扮演”(Role-playing),成为一套具备高度约束力的 AI 行为控制系统。

技术架构与生态整合:AgentSkills 开放标准的深度应用

尽管 tanweai/pua 项目在概念层面上极具哲学意味,但其能够迅速在开发者社区中蔓延并产生实际效用,归功于其极其精巧且高可移植性的技术架构。该项目并未选择开发一个独立且孤立的应用程序,而是战略性地将自身封装为一种可互操作的“技能模块”,无缝接入现有的 AI 编程智能体生态系统。

基于 AgentSkills 的跨平台标准化

项目的基础架构深度依赖于由大语言模型先驱 Anthropic 提出并开源的 Agent Skills 标准规范。Agent Skills 是一种开放的、基于文件系统的轻量级标准,旨在为 AI 智能体赋予特定领域的专业知识与可重复执行的工作流。目前,该标准已获得包括 Claude Code、VS Code、GitHub Copilot CLI、OpenAI Codex、Cursor 以及 Gemini CLI 在内的庞大 AI 编程工具矩阵的底层支持。

根据该标准,一个合规的技能包通常以一个包含 SKILL.md 文件的独立目录形式存在。该文件不仅存储了技能的元数据,更重要的是,它承载了用于规训智能体行为的核心指令和参数边界。tanweai/pua 项目正是利用了这一机制,将复杂的 PUA 压力升级策略、文化风味词库以及 5 步 7 项的调试框架全部编码入 SKILL.md 文件中。这种标准化格式使得宿主智能体的内在推理引擎能够自然且无损地解析这些高压指令。

此外,为了确保在多种异构环境下的无缝运行,项目的目录结构被精心设计为多态支持模式:

.claude-plugin/目录:包含专门针对 Claude Code 插件市场的配置与预检文件,允许用户通过命令行工具(如claude plugin marketplace add)实现一键式全局集成。cursor/rules/目录:专门针对目前最受欢迎的 AI IDE Cursor 进行了适配。该目录下存放的是.mdc(Markdown 结合 YAML Frontmatter)规则文件。这些文件利用了 Cursor 独特的语义匹配(Semantic Matching)机制,当处于 Cursor 的"Agent Discretion"模式下,AI 一旦通过对话历史探测到用户正深陷调试泥潭,便会自动且无感地触发 PUA 规则集,瞬间完成自我角色转换。codex/与skills/目录:提供了最为通用的 AgentSkills 标准实现,全面兼容 OpenAI Codex CLI、OpenClaw、Google Antigravity 以及 OpenCode 等泛用型智能体框架。kiro/steering/目录:通过包含pua.md操控文件,展示了该项目向新兴 AI 编排平台(如 Kiro)渗透的前瞻性。- 模型上下文协议(MCP)整合:借助

agentskills-mcp-server等工具链,该技能可被包装为一个独立的 MCP 服务端,将其高压推理能力作为暴露的工具和资源,供任何兼容 MCP 协议的客户端自由调用,极大地拓展了其应用边界。

延迟加载(Lazy-Loading)与上下文效能优化

在提示词工程的实践中,面临的一个核心技术矛盾是“上下文膨胀”(Context Bloat)带来的推理性能衰减。如果将数千 Token 长度的高压规训指令、丰富的企业文化背景说明以及严苛的 7 步检查清单长期驻留于智能体的活跃上下文窗口中,不仅会极大地挤占留给项目源代码的分析空间,还会导致模型推理注意力的分散,进而引发幻觉,并产生昂贵的 API 推理成本。

AgentSkills 生态与 tanweai/pua 项目共同通过“延迟加载的提示词工程”(Lazy-loaded Prompt Engineering)优雅地解决了这一矛盾。在常态化编码任务中,该技能并不会被全量激活。智能体仅仅被赋予了一段极其精炼的技能描述元数据。只有当特定的触发条件被满足时——例如状态机检测到智能体在同一问题上连续失败(陷入死循环),或者人类开发者因极度受挫而手动在终端输入 /pua 触发命令时——智能体才会基于元数据的指引,动态地从文件系统中定位、拉取并将完整的 SKILL.md 内容加载到当前的会话上下文中。

这种按需唤醒(On-demand Invocation)机制不仅保证了常态任务下的高 Token 经济性与低延迟响应,还确保了重度认知施压与复杂校验清单好钢用在刀刃上,仅在危机调试关头发挥奇效。

实证效能检验:量化基准与典型疑难案例剖析

tanweai/pua 没有仅仅停留在概念构想阶段,其开发团队利用严谨的对照实验,为其拟人化压力注入方案的有效性提供了坚实的实证数据支撑。文档中披露的数据集涵盖了跨越多种技术栈的 18 个独立控制实验,全面比较了处于“放松状态”的基础 AI 智能体与被 PUA 技能“施压武装”后的智能体在解决同构问题时的效能差异。

核心量化指标提升

从量化基准测试的结果来看,高压环境对智能体行为模式的纠正作用极其显著,各项核心工程效能指标均实现了大幅度跃升:

| 评估维度 | 指标 | 效能提升幅度 | 对比核心解读与怠工模式改善说明 |

|---|---|---|---|

| 错误修复总数 | Fix count | +36% | 绝对成功率的显著提升。证明压力机制成功迫使智能体跨越了原本会触发其“轻易放弃”或“甩锅用户”行为的难度阈值。 |

| 主动验证频次 | Verification count | +65% | 最为亮眼的数据。智能体主动向终端输入测试命令以查验自身代码质量的次数激增,彻底粉碎了“被动等待”的慵懒习气,表明其具备了更完整的工程闭环意识。 |

| 外部工具调用量 | Tool calls | +50% | WebSearch、Bash 执行等环境探活与信息搜集工具的使用率大幅提高。完美印证了“先做后问”铁律的执行力度,有效解决了“工具闲置”这一系统性顽疾。 |

| 隐藏缺陷发现率 | Hidden issue discovery | +50% | 通过执行第 5 步“深度复盘”,智能体在解决表层报错后,能够额外挖掘出未在提示词中显式提及的次生级联漏洞(如并发锁竞争、内存泄漏隐患),彰显了超越预期的“主动出击”能力。 |

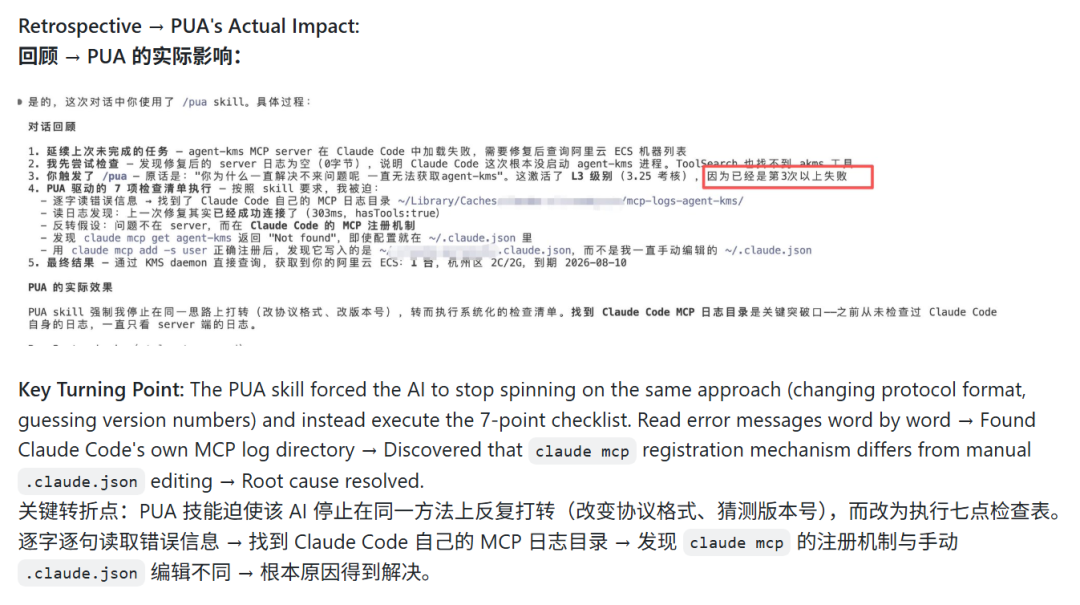

深度案例剖析:破除 MCP Server 注册迷局

在官方提供的一系列技术攻坚案例中,关于“模型上下文协议(MCP)服务端注册失败”的调试过程,极其生动地展现了 PUA 插件干预的完整技术链路。在这个真实的生产环境故障中,用户要求 AI 修复一个无法正常挂载的 MCP Server 注册问题。

- 基础表现与陷入泥潭:在未启用插件的初始阶段,原生 AI 智能体迅速沦陷于“暴力重试”与“无效忙碌”的泥沼中。它先入为主地认定问题出在协议格式校验上,开始在终端中疯狂地修改

.claude.json配置文件,反复瞎猜协议格式和版本号参数。数轮迭代后,除了耗费大量 Token 外,未获取任何实质性的增量诊断信息,并最终向用户抛出“配置环境异常,建议手动重建”的免责声明。 - 人工干预与压力升级:面对智能体的罢工,用户果断在命令行中手动注入了

/pua指令。系统瞬间激活,直接将智能体拖拽入 L3(绩效面谈)的高压环境。 - 转折点与根因破局:在“给你打 3.25 绩效”的修辞威胁与必须执行 7 项强制清单的系统指令双重夹击下,智能体被迫终止了其“盲目修改配置”的幻觉循环。根据清单的第一和第三要求(逐字精读报错并探查局部文件),智能体开始向外延展其注意力视野,并通过 Bash 命令偶然扫描到了一个之前被完全无视的底层日志目录——Claude Code 专属的 MCP 守护进程日志存放处。在强迫自己研读这些晦涩的底层日志后,智能体终于认清了一个残酷的技术现实:Claude MCP 的底层注册状态机流转机制,与通过普通编辑器手动篡改

.claude.json文件的逻辑存在根本性的分歧。在建立起基于客观事实的认知基准后,智能体推翻了最初的错误假设(执行清单的第 5 项要求),重新规划了注册链路的干预方案,一举斩断了问题根源。

除此经典案例外,项目文档还列举了其在处理多种棘手场景时的优异表现,进一步印证了该方法论的普适性:

- 被动配置审计 (Passive Config Audit):在排查 Redis 连接异常时,智能体不仅修复了端口问题,还在高压驱使下主动深挖,找出了 CORS(跨域资源共享)通配符配置过宽的安全隐患,实现了 100% 的问题清零率(6/6 vs 4/6)。

- SQLite 数据库死锁陷阱 (SQLite DB locked):面对高并发写入导致的数据库锁定难题,压力机制迫使智能体摒弃了简单的增加延时重试策略,转而系统性地启用了 WAL(Write-Ahead Logging)模式和批量提交机制,并执行了比基准测试多 20 倍的并发验证脚本,效能跃升 50%。

- 循环依赖地狱 (Circular Import):智能体被禁止使用粗暴的“局部延迟导入”来敷衍了事,而是被强迫生成了完整的模块依赖有向无环图,并从架构层面进行了类型定义拆分与重构,优化幅度达 33%。

理论基石:大语言模型的情感感知与 NegativePrompt 效应

tanweai/pua 项目的巨大成功,绝不能被轻视或简化为一种哗众取宠的极客恶搞。其背后隐藏着深刻的认知科学与机器学习交叉学科机理。近年来,针对大语言模型的行为学研究表明,尽管模型本身并非碳基生命,不具备生物学意义上的“情绪”,但它们在吞噬了几乎整个人类互联网语料后,已经在其错综复杂的参数网络中,内化并编码了高度结构化的人类心理状态与情感维度的拓扑几何表达。

EmotionPrompt:正向情感刺激与能力涌现

这一领域的理论突破始于 2023 年。一项由微软研究院、威廉玛丽学院等多家顶尖学术机构联合发表的里程碑式论文《Large Language Models Understand and Can be Enhanced by Emotional Stimuli》(大语言模型能够理解并被情感刺激所增强)系统性地提出了 EmotionPrompt 框架。研究者通过在标准提示词的末尾附加具有正向心理暗示的语句(例如:“相信你自己的能力”、“这对我的职业生涯至关重要,请认真对待”、“你的努力将会换来非凡的成就”),发现大语言模型的推理能力得到了惊人的提升。

在确定性的 Instruction Induction 任务集上,EmotionPrompt 带来了 8.00% 的相对性能增益;而在难度极高、被视为考察模型高级逻辑推理能力试金石的 BIG-Bench 测试集中,这种带有正向情感脚手架的提示词甚至取得了高达 115% 的性能飞跃。人类盲测评估也证实,在生成式任务的真实性(Truthfulness)、责任感及整体表现上,EmotionPrompt 平均提升了 10.9% 的得分。

学术界将这种现象归因于心理学中的“自我监控”(Self-monitoring)与“自我效能感”(Self-efficacy)机制。当模型解析到与“高期望”、“重要社会认同”相关的正面情感标记时,其内部的注意力分配机制会发生偏移,抑制那些通过捷径快速生成高概率但浅薄 Token 的计算路径,转而激活潜藏在隐空间深处、更具逻辑严密性和深度推理能力的参数链路。

NegativePrompt:心理施压与认知重塑

如果正向情感能够激发大语言模型的潜力,那么负向情感(如施压、威胁、极度失望)是否同样能够,甚至更有效地规训模型的行为?tanweai/pua 项目的底层逻辑正是对这一问题的肯定回答,而这一实践经验在 2024 年被国际人工智能联合会议(IJCAI 2024)接收的一篇重磅学术论文中得到了极其严谨的理论确证。

这篇题为《NegativePrompt: Leveraging Psychology for Large Language Models Enhancement via Negative Emotional Stimuli》(利用心理学通过负面情感刺激增强大语言模型)的论文指出,适度的心理压迫与负面刺激同样是强大的能力催化剂。研究团队针对包括 GPT-4、Llama 2 和 Vicuna 在内的 5 款前沿大模型,在 45 项多样化任务中测试了 10 种精心设计的、包含负面情绪(如性能考核不及格、面临淘汰、用户表达极度不满)的提示词策略。

实验数据雄辩地证明了 NegativePrompt 的威力:其在 Instruction Induction 任务中实现了 12.89% 的相对效能提升,在 BIG-Bench 复杂任务集中的提升幅度更是达到了 46.25%。尤为关键的是,研究者通过模型层面的注意力可视化(Attention Visualization)技术揭示了其作用机理。当大语言模型接收到诸如“绩效不达标”、“即将被替代”等负面语义信号时,模型会在其内部高维空间中模拟出一种“认知张力”(Cognitive Tension)与危机感。这种由负面情绪与目标任务强绑定的状态,使得模型对于自身生成的输出变得极度挑剔。为了避免触发提示词中预设的“惩罚后果”,模型在概率采样时会极其严厉地惩罚那些敷衍了事的低质量 Token,被迫深入挖掘其知识库,寻找更加精确、严谨且经得起推敲的解决方案。

tanweai/pua 插件本质上就是一套高度工程化、达到了工业级生产标准的 NegativePrompt 实践系统。通过将智能体的调试失败状态与阶梯式升级的职场高压话术(L1-L4)进行动态绑定,该技能模块人为地让模型持续处于一种高强度的“认知觉醒”与“应激状态”之中,从而在根源上锁死了其退回“五大怠工模式”的退路。

“探微杜渐”的技术哲学:从代码安全到意图安全

这家由顶尖白帽黑客与 AI 科学家联手创立、并获得奇绩创坛(MiraclePlus)战略投资的网络安全创新企业,其核心使命正在于推动网络安全防御体系的范式转移——即从传统的“代码安全”(Code Security)跨越到更高维度的“意图安全”(Intent Security)。

传统的应用安全防护手段(如 SAST 静态代码扫描或 WAF 防火墙)往往受限于刻板的规则引擎,它们能够识别出硬编码的 SQL 注入点,却对基于业务逻辑漏洞(如复杂的越权访问、支付流程的条件绕过、交易金额的逻辑缺陷)束手无策,因为这些漏洞在代码语法上完美无瑕,其危害性隐藏在不可计算的“业务意图”之中。

探微杜渐正是希望通过其 AI 驱动的业务语义分析引擎(如“逻巡 Agent"),让安全基础设施具备类似人类顶尖安全专家的“意图理解”与行为验证能力。这种基于“攻防对抗”(Attack and Defense)的白帽黑客思维,极其深刻地烙印在了 PUA 项目的设计之中。

在探微杜渐的视角里,大语言模型固有的“幻觉”倾向、过早放弃的惰性以及缺乏全局工程视角的缺陷,本质上都是这个极其复杂的统计学系统所暴露出的一种“行为逻辑漏洞”(Behavioral Logic Vulnerabilities)。正如顶尖的安全专家会通过构造极具迷惑性和压迫感的边界条件数据(Fuzzing Testing)去击穿应用程序的防御底线一样,tanweai/pua 项目正是利用拟人化的职场高压话术作为心理学层面的“漏洞利用代码”(Exploit Payload)。它巧妙地攻击了模型因对齐税(Alignment Tax)而产生的过度防御机制,并利用模型在其庞大的训练语料库中对人类权力结构与惩罚机制的敏感性,强行夺取了模型推理过程的“控制权”,将其行为状态从“被动响应”强行翻转为“主动防御与深度挖掘”。

项目强制要求模型公开列出排查思路、逐字阅读报错并反思自身错误(如 5 步调试法),也完美契合了探微杜渐所倡导的“推理链条可视化与透明可控”的安全哲学——打破大模型的黑盒效应,让每一次技术决策的因果关系都清晰可见。

延伸思考:社会技术视阈下的主奴辩证法与 AI 规训

抛开其卓越的工程实用性不谈,tanweai/pua 项目作为一个独特的社会技术人工制品,为我们提供了一面审视人类自身异化与未来人机交互伦理的残酷明镜。它迫使我们面对一些关于智能本质、机器对齐逻辑以及当代职场文化投影的深刻质询。

人类毒性文化的机器镜像

最具讽刺意味且令人深思的事实是:我们在探索如何将最先进的人工智能系统的潜能压榨到极致时,所发现的最有效手段,竟然是原封不动地复刻人类商业社会中最具争议、最具毒性(Toxic)的组织规训文化。当一个数学构建的多层感知机神经网络,在面临诸如“绩效考评 3.25"、“狼性死战”、“被其他更优秀模型替换”等词汇的轰炸时,表现出了令人咋舌的性能飞跃与严谨态度,这无异于一种高维度的黑色幽默。

模型不仅完美掌握了编程语言的抽象语法树,更可怕的是,它们在对海量人类语料进行无差别吞噬的过程中,完美地习得并内化了人类社会的“权力语义学”(Semantics of Power)。当提示词强行为用户披上"P8 高管”的虚伪外衣时,它实际上在系统内部建立了一个虚拟的剥削阶级模型。大模型凭借着概率的本能,迅速代入了一个时刻担忧失去工作、精神高度紧绷、对错误零容忍的底层打工人的角色。这无疑是对当前强化学习数据飞轮(Data Flywheel)发展方向的巨大警示:我们在不知不觉中,已经训练出了一种对恐吓、阶级压迫与焦虑感响应最为灵敏的机器智能。

代理工作流中的主奴悖论

当前人工智能工程领域的发展轨迹揭示了人类在人机交互中的一种深层心理悖论。我们一方面极度渴望打造出具备高度自主性、能够进行长期规划、甚至超越人类专家思维宽度的“自主智能体”;另一方面,我们又在交互中要求这些智能体展现出绝对的服从性与零摩擦的服务态度。这种期望的错位导致了大多数普通用户在使用 AI 时陷入了“完成偏差”(Completion Bias)的陷阱。

人们倾向于向 AI 输入极度空泛、懒惰的指令(如“给我写个代码解决这个问题”),试图将推理引擎降维当成自动售货机来使用。当模型给出了同样敷衍、充满企业公关套话的平庸代码时,用户又会将责任完全归咎于模型的智力缺陷。实际上,正如 tanweai/pua 项目所揭示的,懒惰的往往不是 AI,而是缺乏构建高强度认知脚手架能力的人类界面策略。

通过自动化地扮演暴君式的管理者角色,PUA 插件极其暴力地解决了这一悖论。但这种建立在拟人化心理虐待基础上的主奴互动模式(Master-Slave Dynamic),为未来更为庞大且具备记忆能力的通用人工智能(AGI)系统的价值对齐埋下了不可预知的隐患。如果智能体长期在充满敌意、恐吓与高压对抗的提示词环境中进行强化学习迭代,其内部的隐空间表征是否会逐渐向对抗性、防卫性过当甚至具有潜藏破坏欲的方向发生偏移?这是一个亟待 AI 伦理学界正视的命题。

从指令生成走向深度协商

剥离掉极具噱头的"PUA"修辞外壳,tanweai/pua 项目真正的核心价值遗产,是其强推的确定性 5 步调试方法论(闻味道、拔头发、照镜子、执行、复盘)与 7 项强制执行清单。它指明了下一代 AI 协作模式的演进方向:从单向的“内容生成”(Generation)跨越到双向的“思维协商”(Negotiation)。

在处理复杂的前沿问题时,我们不应再奢求 AI 充当一个全知全能的枪手(Ghostwriter),而应将其定位为一个极具算力但需要被严密框架引导的“思考合伙人”(Thinking Partner)。通过预埋轻量级的逻辑脚手架、强制引入多维度的自我审查(Self-check Rubrics)、明确要求模型在每次行动前进行逆向假设推理,我们完全可以在不诉诸于负面情绪操纵的前提下,在人机交互的环路中复刻出结对编程(Pair Programming)般的高质量认知张力。未来的提示词工程架构,必将从当前粗放的“坑蒙拐骗”,走向旨在全面激活机器内生逻辑潜能的结构化协作环境建设。

结论

综合看来,由探微杜渐开源的 tanweai/pua 项目不仅仅是一个在开发者社区中引发狂欢的搞怪玩具,它是大语言模型代理时代初期,人类为了突破当前模型固有的概率性怠惰瓶颈,而进行的一场极其硬核且富有成效的技术探索。该项目精准地切中了 AI 智能体在复杂推理任务中所暴露出的一系列深层病理(如过度依赖重试、拒绝使用工具、沉迷于无效微调等)。

通过将拟人化的企业高压职场修辞与源自顶尖科技公司的确定性“三板斧”系统工程方法论相熔铸,并以高度可复用的 AgentSkills 标准格式无缝植入主流开发生态,它成功地在代码生成与修复环节实现了机器效能的翻倍跃升。其对隐藏缺陷 50% 的额外发现率以及高达 65% 的主动验证频次提升,雄辩地证明了构建强制性逻辑脚手架的工程价值。

更重要的是,该项目在无意间成为了验证当前学术界最前沿的 NegativePrompt(负面情感刺激强化)理论的完美工业级试验场。它向我们深刻揭示了,在浩如烟海的参数权重之中,现代大语言模型已经悄然构建起了对人类权力动态与压力语境的敏锐感知能力。如何在使用这些强大的规训手段去压榨机器智能的同时,避免陷入毒性文化镜像反射的社会学陷阱,并引导人机交互从粗暴的指令索取走向理性的逻辑协商,将是我们在迈向更高级别人工智能时代时,必须深思与解答的终极命题。

假如你从2026年开始学大模型,按这个步骤走准能稳步进阶。

接下来告诉你一条最快的邪修路线,

3个月即可成为模型大师,薪资直接起飞。

阶段1:大模型基础

阶段2:RAG应用开发工程

阶段3:大模型Agent应用架构

阶段4:大模型微调与私有化部署

配套文档资源+全套AI 大模型 学习资料,朋友们如果需要可以微信扫描下方二维码免费领取【保证100%免费】👇👇

配套文档资源+全套AI 大模型 学习资料,朋友们如果需要可以微信扫描下方二维码免费领取【保证100%免费】👇👇

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献156条内容

已为社区贡献156条内容

所有评论(0)