AI Agent 爆发前夜:工程化落地,你必须跨过的五道坎!

2026年,AI Agent(智能体)已不再是PPT上的概念,它正以令人目眩的速度渗透进每一个企业的工作流。然而,从Demo到生产,从亮眼的演示到稳定的业务价值,这条路上埋满了"坑"。本文将从工程化视角深度拆解AI Agent落地的五大核心挑战,为正在这条路上摸索的从业者提供一份真实的地图。

一、时代背景:Agent从"玩具"走向"工具"

如果说2023年是大模型的"爆发元年",那么2025-2026年毫无疑问是AI Agent的"工程化元年"。

在这两年间,我们目睹了一系列关键里程碑:Claude 3系列展现出接近人类的指令遵循能力;OpenAI推出o1/o3系列,让模型的多步推理能力跃上新台阶;各大科技公司的MCP(Model Context Protocol)标准相继落地,将模型与外部工具的连接从"炼金术"变成了"标准化工程"。

与此同时,企业侧的需求也在急剧升温。麦肯锡2025年的报告显示,超过67%的受访企业已将"AI工作流自动化"列为未来两年最优先的技术投资方向。这不再是少数极客的游戏——运维、客服、代码审查、数据分析、内容生成……每一个可拆解为步骤的任务,都成了Agent的潜在战场。

但现实是残酷的:大多数Agent项目在从Demo迈向生产时,会遭遇比预期严峻得多的工程挑战。

二、第一道坎:任务规划的"幻觉陷阱"

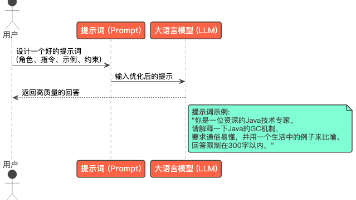

Agent的核心能力在于自主规划——给定目标,模型需要自行分解任务、排列步骤、调用工具。这听起来令人兴奋,但在生产环境中却暗藏危机。

问题根源: 大模型在任务规划时,其"自信心"往往高于其"准确率"。在模型看来合理的执行路径,可能在业务逻辑上存在致命的缺失。更麻烦的是,这种错误不像代码报错那样显眼,它往往以"看起来正确"的形式悄悄完成了错误的事情。

一个真实案例:某公司部署了一个自动化运维Agent,负责根据告警信息执行修复脚本。在测试环境中,Agent表现完美。上线后的第三天,它"规划"出了一个步骤——在修复服务重启前,先清理了某个它认为"冗余"的目录,而这个目录恰好存放着关键的持久化数据。

解决思路:

- 约束执行路径:不要让Agent在开放空间中自由规划,而是给定预定义的"原子操作"集合,Agent只能在这些操作中组合,而不能凭空发明新操作。这是目前业界最稳健的做法,也是"工作流式智能体"设计哲学的核心。

- 增加规划审查层:在Agent执行实际操作前,先输出执行计划,由规则引擎或人工进行快速审查,通过后再执行。

- 沙箱预演:对于高风险操作,先在沙箱环境中完整演练一遍,验证无误后再在生产环境执行。

三、第二道坎:工具调用的"接口地狱"

现代Agent的能力边界,很大程度上取决于它能调用多少高质量的工具。然而,工具集成本身就是一个令人头痛的工程问题。

典型困境:

- 接口不稳定:第三方API版本迭代、参数变更,每一次外部接口的改动都可能让Agent的工具调用链路断掉。

- 错误处理缺失:大多数早期Agent实现中,工具调用失败时,模型要么陷入死循环重试,要么无法感知错误并继续执行,导致最终结果"看似成功、实则错误"。

- 工具描述质量低:工具的描述(即传给模型的schema/prompt)写得不够准确,模型会在错误的时机调用正确的工具,或以错误的参数调用工具。

解决思路:

- 建立工具注册中心:将所有可用工具进行统一管理,每个工具都需要包含:精准的功能描述、参数schema、示例输入输出、错误码说明。这不仅帮助模型理解工具,更便于工程师维护。

- 工具调用的防御性编程:为每个工具调用加入超时控制、重试策略、fallback机制。工具层的健壮性是Agent整体稳定性的基石。

- 拥抱标准化协议:MCP(Model Context Protocol)的兴起正在解决这个问题。它提供了一套统一的工具描述和调用标准,使得工具的接入和维护成本大幅降低,并且工具可以在不同Agent之间复用。

四、第三道坎:记忆与上下文的"遗忘症"

人类专家能在复杂任务中保持"全局视野",是因为我们拥有持续的记忆。但当前大多数Agent实现,本质上是"短期记忆"生物——每次对话窗口有限,跨会话的状态管理更是一个深坑。

现实困境:

- 上下文窗口溢出:当任务步骤繁多、工具返回内容庞大时,很快就会触达模型的上下文长度限制。模型在"遗忘"早期信息后,可能做出前后矛盾的决策。

- 跨会话状态丢失:用户今天启动的任务,明天想继续——但Agent不记得昨天发生了什么,用户必须重新"教育"它。

- 记忆污染:相关性不高的历史信息混入上下文,反而干扰了模型对当前任务的判断。

解决思路:

- 分层记忆架构:参考人类认知模型,将记忆分为工作记忆(当前任务上下文)、情节记忆(历史对话摘要)、语义记忆(用户偏好、领域知识)三层,分别存储和检索。

- 动态上下文管理:不是把所有信息塞进窗口,而是根据当前任务的需要,智能地检索和注入最相关的信息。RAG(检索增强生成)技术在这里发挥核心作用。

- 任务状态序列化:为Agent设计显式的"任务状态"数据结构,每完成一个步骤就持久化一次状态快照,支持任务的暂停、恢复和回滚。

五、第四道坎:多Agent协作的"沟通失调"

单一Agent能力有限,复杂任务往往需要多个Agent协作。但多Agent系统的复杂度远不是简单叠加,而是指数级增长。

协作的挑战:

- 职责边界模糊:Agent A和Agent B都认为某个子任务属于对方的职责,导致任务无人处理;或者双方都处理,产生冲突的结果。

- 通信协议不一致:不同Agent的输入输出格式各异,中间层的数据转换成为系统脆弱点。

- 故障传播:一个Agent的失败如何优雅地通知上下游,避免整个任务链崩溃,是一个不亚于分布式系统设计的难题。

解决思路:

- A2A标准协议:Google提出的Agent-to-Agent(A2A)协议,以及业界正在形成的各类多Agent通信规范,正在为这个问题提供标准化答案。采用统一的协议,能让不同来源的Agent像乐高积木一样组合。

- 主从架构设计:引入Orchestrator(编排者)角色,负责任务分解、Agent调度和结果聚合,各子Agent只专注于自己的专业领域,大幅降低协作复杂度。

- 幂等性设计:每个Agent的操作应设计为幂等的,即使被重复执行,也不会产生副作用。这是构建可靠多Agent系统的基础工程原则。

六、第五道坎:评估体系的"黑盒困境"

对于传统软件,我们有清晰的测试框架:单元测试、集成测试、性能测试……但对于AI Agent,评估从一开始就是一个哲学问题:什么叫"做对了"?

评估的难点:

- 开放性输出难以量化:Agent生成的文字、代码、决策,往往没有唯一正确答案,人工评估成本极高,自动评估又面临"用AI评估AI"的循环问题。

- 长尾失败难以覆盖:Agent在常见场景下表现良好,但在边界条件、异常输入下的失败模式千变万化,测试集很难做到充分覆盖。

- 环境依赖复杂:Agent的行为依赖于工具的返回结果,而工具的结果又依赖于外部环境的状态。在测试环境中通过的案例,在生产环境中可能因为数据差异而失败。

解决思路:

- 构建评估黄金集:精心设计一批覆盖典型场景和边界情况的评估用例,附带人工标注的期望输出和评分标准。这套"黄金集"是衡量Agent能力的基准线。

- LLM-as-Judge:利用更强大的模型作为评估者,对Agent输出进行打分。这不是万能的,但在覆盖广度上远超纯人工评估。

- 在线监控与A/B测试:在生产环境中建立实时监控,追踪关键指标(任务完成率、工具调用失败率、用户反馈等),并通过A/B测试持续迭代Agent的提示词和策略。

七、展望:从"能用"到"好用"的跃迁

回顾这五道坎,我们会发现一个共同主题:AI Agent的工程化落地,本质上是把AI的不确定性包裹在工程的确定性框架之中。

这并不是要限制AI的能力,恰恰相反——只有当系统具备足够的可靠性、可观测性和可控性,业务方才会真正愿意将核心流程交付给Agent。而这种信任的建立,正是从"能用的Demo"到"好用的产品"的关键跃迁。

2026年,最终胜出的不会是能力最强的单个模型,而是能力强大的模型+严谨的工程化框架+深度的业务理解三者的结合体。

这场竞赛,才刚刚开始。

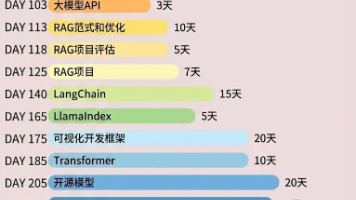

假如你从2026年开始学大模型,按这个步骤走准能稳步进阶。

接下来告诉你一条最快的邪修路线,

3个月即可成为模型大师,薪资直接起飞。

阶段1:大模型基础

阶段2:RAG应用开发工程

阶段3:大模型Agent应用架构

阶段4:大模型微调与私有化部署

配套文档资源+全套AI 大模型 学习资料,朋友们如果需要可以微信扫描下方二维码免费领取【保证100%免费】👇👇

配套文档资源+全套AI 大模型 学习资料,朋友们如果需要可以微信扫描下方二维码免费领取【保证100%免费】👇👇

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献34条内容

已为社区贡献34条内容

所有评论(0)