把推理放进索引:IndexRAG一个让效率翻倍的疯狂想法

你还在为多跳问答中的跨文档推理头疼吗?这篇论文提出了一个全新的思路,把推理从在线环节挪到了离线环节,让模型回答问题时只需要一次检索和一次调用。

推理前置,索引即思考

这篇论文提出的 IndexRAG 带来一个根本性的思路转变:将跨文档推理从在线推理阶段转移到离线索引阶段。它的核心思想是,文档之间的连接关系主要取决于内容本身,而不是具体的查询问题。因此,这些推理连接可以提前计算好,变成独立的、可直接检索的单元。

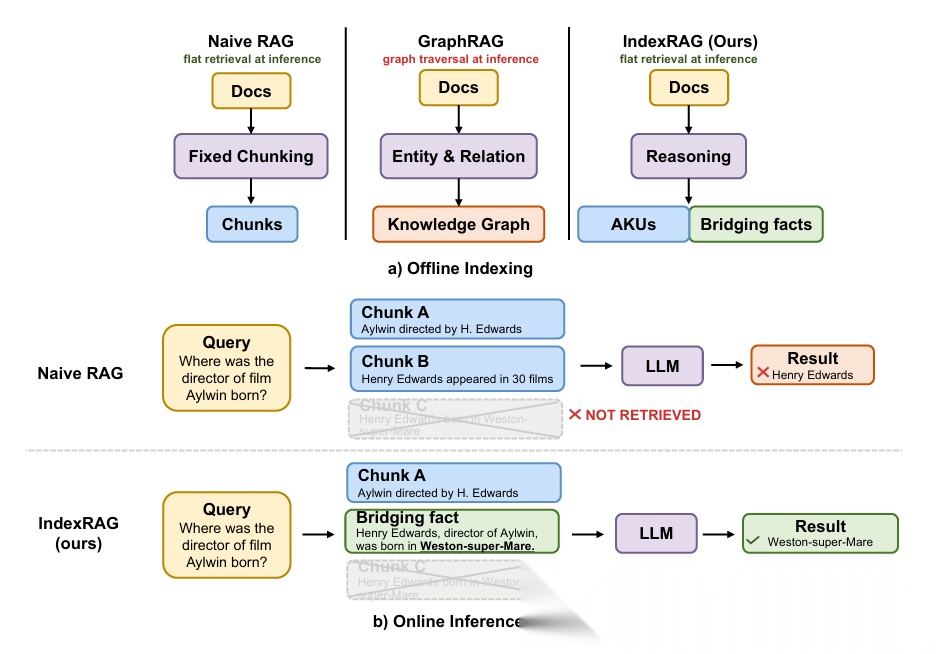

图1 直观对比了不同方法的差异。传统RAG在在线阶段进行扁平检索,图RAG则需要在线进行图遍历。而IndexRAG在在线阶段同样只需要扁平检索,但其索引内容经过了离线的推理处理。

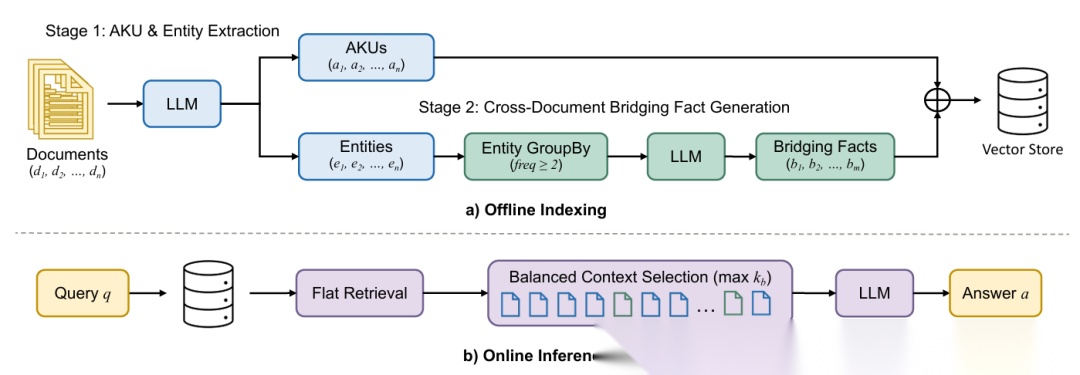

图2 展示了IndexRAG的完整工作流程。它主要分为两个阶段:

- 离线索引阶段:从文档中提取原子知识单元(AKU)和实体,然后识别跨文档的“桥接实体”,并生成“桥接事实”。

- 在线推理阶段:用户查询经过编码,从统一的向量库中检索相关上下文(包括AKU和桥接事实),经过平衡上下文选择后,由LLM生成答案。

这种方法的优势非常明显:它仅需单次检索和单次LLM调用,就能实现跨文档推理,大大提升了效率。

方法论详解

1. 离线索引阶段:生成“桥接事实”

这是IndexRAG的创新核心,它分为两个子步骤:

步骤一:提取原子知识单元(AKU)与实体

- 对于语料库中的每一份文档,使用LLM提取出一系列“原子事实”,这些事实被组织成“问题-答案”对。

- 同时,LLM会从文档中提取相关实体。

- 将每个文档的AKU合并为一个文本单元,与提取的实体一起编码,并存入扁平的向量库。这部分被称为AKU。

步骤二:生成桥接事实

- 识别桥接实体:聚合所有实体,找出那些在多个文档中出现(出现频率在2到某个阈值之间)的实体。这些实体就是连接不同文档的“桥梁”。

- 生成桥接事实:对于每个桥接实体,收集所有提及它的文档中的相关AKU片段,然后让LLM基于这些信息生成新的“桥接事实”。

- 例如,文档A说“《艾尔温》由亨利·爱德华兹执导”,文档B说“亨利·爱德华兹出生在韦斯顿-超级-马雷”。IndexRAG会生成一个新的桥接事实:“《艾尔温》的导演出生在韦斯顿-超级-马雷”。

- 这些桥接事实与原始的AKU一起,被编码后存入同一个向量库。它们不是简单的摘要,而是专门为了回答隐式跨文档问题而构建的、可直接检索的新单元。

当新增文档时,只需要为新文档执行步骤一,并为受影响的桥接实体(新文档中出现的已有桥接实体,以及新形成的桥接实体)执行步骤二即可,无需重建整个索引。

2. 在线推理阶段:检索与平衡选择

在线推理过程非常简洁:

- 单次检索:将用户查询编码,从包含AKU和桥接事实的统一向量库中,通过余弦相似度检索出最相关的Top-k个条目。

- 平衡上下文选择:由于桥接事实通常比AKU短得多,直接取Top-k可能导致桥接事实过多,挤占了信息更密集的AKU。因此,IndexRAG采用一种平衡上下文选择策略,在保证总条目数(k=10)的前提下,限制桥接事实的数量(例如最多3个),确保上下文信息的平衡。

- 生成答案:将选中的上下文(AKU和桥接事实的混合)提供给LLM,要求其生成简洁、精确的答案,无需额外的推理步骤。

📊 实验结果

论文在三个主流的多跳问答数据集(HotpotQA, 2WikiMultiHopQA, MuSiQue)上进行了实验,结果非常有说服力。

表1:IndexRAG与各方法定性对比

| 方法 | 单次检索 | 跨文档推理 | 单次LLM调用 | 无需训练 | 在线推理 |

|---|---|---|---|---|---|

| Naive RAG | ✅ | ❌ | ✅ | ✅ | ❌ |

| HippoRAG | ❌ | ✅ | ❌ | ✅ | ❌ |

| IRCoT | ❌ | ✅ | ❌ | ✅ | ❌ |

| IndexRAG | ✅ | ✅ | ✅ | ✅ | ✅ |

表2:主要性能对比(F1分数)

| 方法 | HotpotQA | 2WikiMultiHopQA | MuSiQue | 平均 |

|---|---|---|---|---|

| Naive RAG | 63.6 | 47.7 | 29.9 | 47.1 |

| FastGraphRAG | 63.5 | 57.4 | 27.2 | 49.4 |

| IndexRAG | 68.9 | 51.7 | 34.4 | 51.7 |

| HippoRAG | 70.5 | 57.2 | 34.7 | 54.1 |

| IRCoT + IndexRAG | 68.7 | 61.2 | 35.0 | 55.0 |

从表2可以看出:

- 在单次LLM调用的方法中,IndexRAG平均F1分数最高(51.7),相比Naive RAG提升了4.6点,在最难的MuSiQue数据集上优势尤为明显。

- 当与迭代方法IRCoT结合时,IRCoT + IndexRAG达到了所有方法中的最佳平均性能(55.0),甚至超越了需要两次LLM调用的HippoRAG。

- 效率方面,IndexRAG的在线推理延迟(约0.3秒)与Naive RAG几乎相同,但远低于FastGraphRAG(2.55秒)和HippoRAG(3.13秒),真正实现了“又快又好”。

💡 总结

IndexRAG的核心创新在于其“索引即推理”的范式。它将跨文档推理这一原本在线阶段的重担,巧妙地转移到了离线索引阶段,通过预生成的“桥接事实”让模型在回答时能“一步到位”。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献155条内容

已为社区贡献155条内容

所有评论(0)