YOLO26 改进、魔改|小波变换卷积层(WTConv)以小波变换实现对数级参数增长的超大感受野,同步提取多频带特征,提升 CNN 的形状偏向性、鲁棒性与多任务性能,即插即用替换深度卷积

近年来视觉 Transformer 凭借自注意力实现全局感受野,在多项视觉任务上超越传统 CNN,而 CNN 单纯放大卷积核会快速陷入过参数化与性能饱和,难以高效获得全局感受野;同时传统卷积偏向高频纹理特征,对低频形状信息捕捉不足,小波变换作为经典时频分析工具,可在保留空间分辨率的同时实现多频带分解,为突破 CNN 感受野与参数效率瓶颈提供了信号处理层面的可行路径,WTConv 正是在此背景下提出的轻量化大感受野卷积方案。

1.WTConv原理

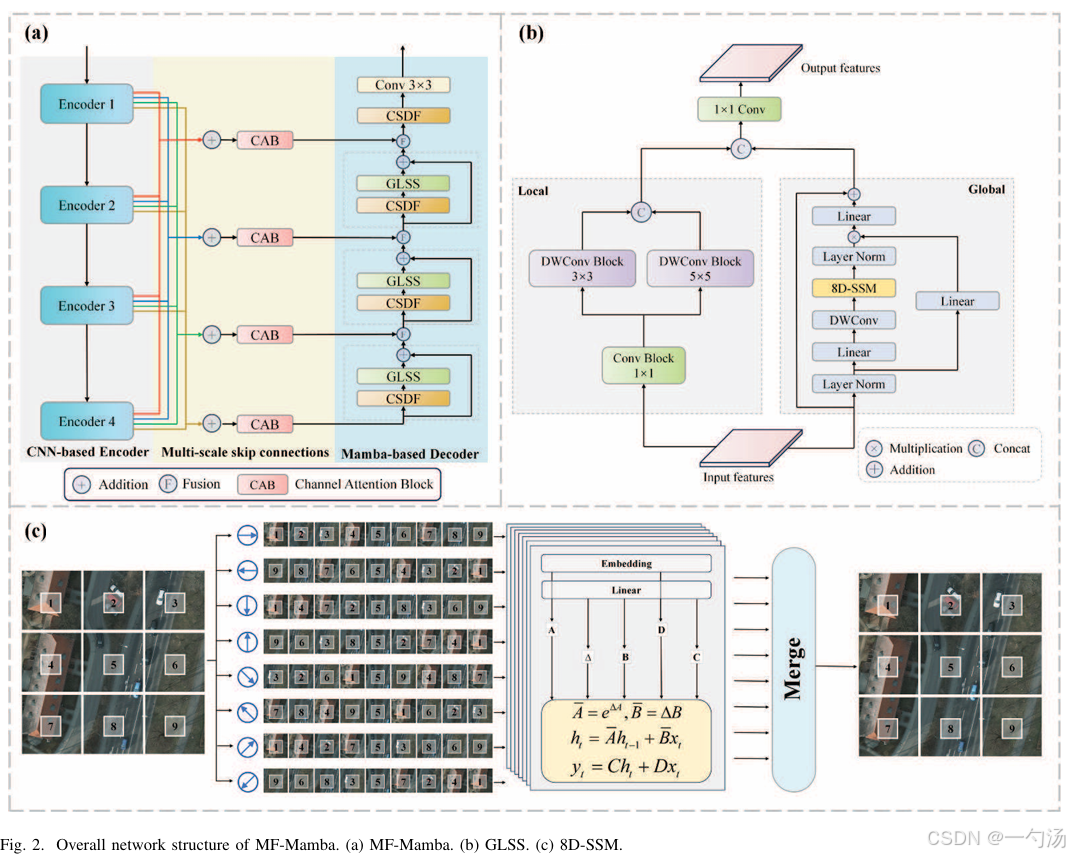

WTConv 以小波变换为核心,将输入特征经级联小波分解为低频与多方向高频分量,在各频带特征上采用小核深度卷积进行处理,再通过逆小波变换重建输出;其关键优势在于感受野随分解层级指数级扩大,而参数量仅随层级线性增长,实现超大感受野且无过参数化,同时强化低频形状特征提取,兼顾空间局部性与频域多尺度特性,可直接替换现有 CNN 中的深度卷积层。

-

多级小波分解:以 Haar 小波为基础,对输入特征递归分解,每级输出 1 个低频子带与 3 个高频子带,逐级下采样并拓宽感受野。

-

频域小核卷积:在各级高低频子带分别采用 3×3/5×5 小核深度卷积,独立学习各频带特征,计算量低且参数可控。

-

逆小波重建:利用线性叠加特性,自底向上融合各级频域卷积结果,经逆小波变换恢复原尺度特征图,输出多频带增强的大感受野特征。

-

通道加权:对不同频带输出做通道维度缩放,自适应平衡高低频贡献,提升特征表达稳定性。

2. YOLO与WTConv的结合

将 WTConv 嵌入 YOLO,可在保持轻量化与实时性的前提下,大幅拓宽网络感受野,兼顾多尺度目标的细节与全局特征,提升小目标、密集目标与复杂背景下的检测精度。其高低频分离特性增强模型对形状的判别能力,降低纹理干扰,同时参数量与计算量增幅极小,不影响端侧部署与推理速度。

3.WTConv代码部分

YOLO26 杀疯了:性能 Double + 无 NMS/DFL,更快更强更轻量的检测「新爹」_哔哩哔哩_bilibili

YOLO26 杀疯了:性能 Double + 无 NMS/DFL+小目标标签分配策略,更快更强更轻量的小目标检测_哔哩哔哩_bilibili

用一篇论文教您如何使用YOLOv11改进模块写一篇1、2区论文_哔哩哔哩_bilibili

代码获取:YOLOv8_improve/YOLOV12.md at master · tgf123/YOLOv8_improve · GitHub

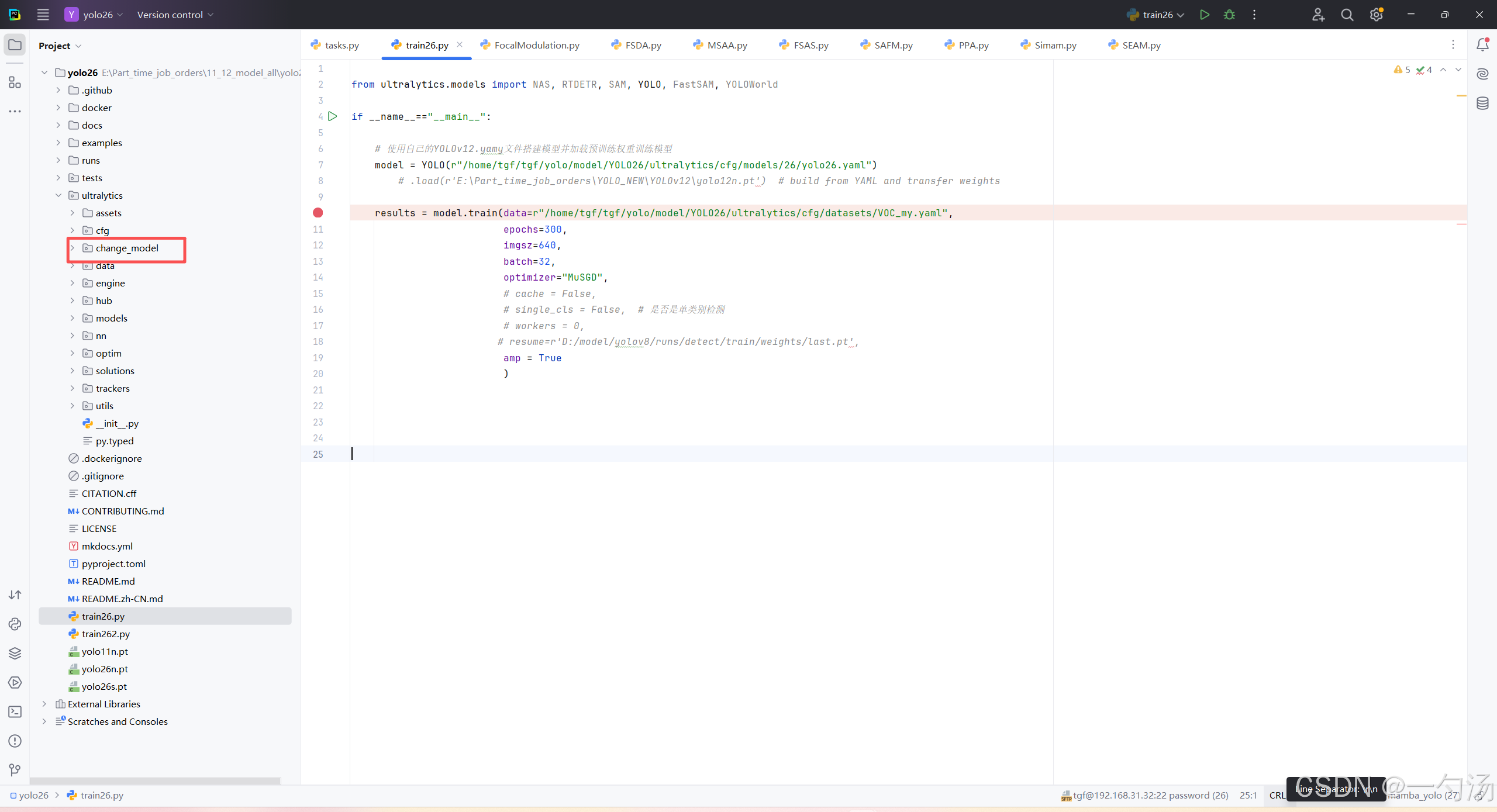

4. WTConv引入到YOLO26中

第一: 先新建一个change_model,如下图如所示。

将代码复制到change_model里面

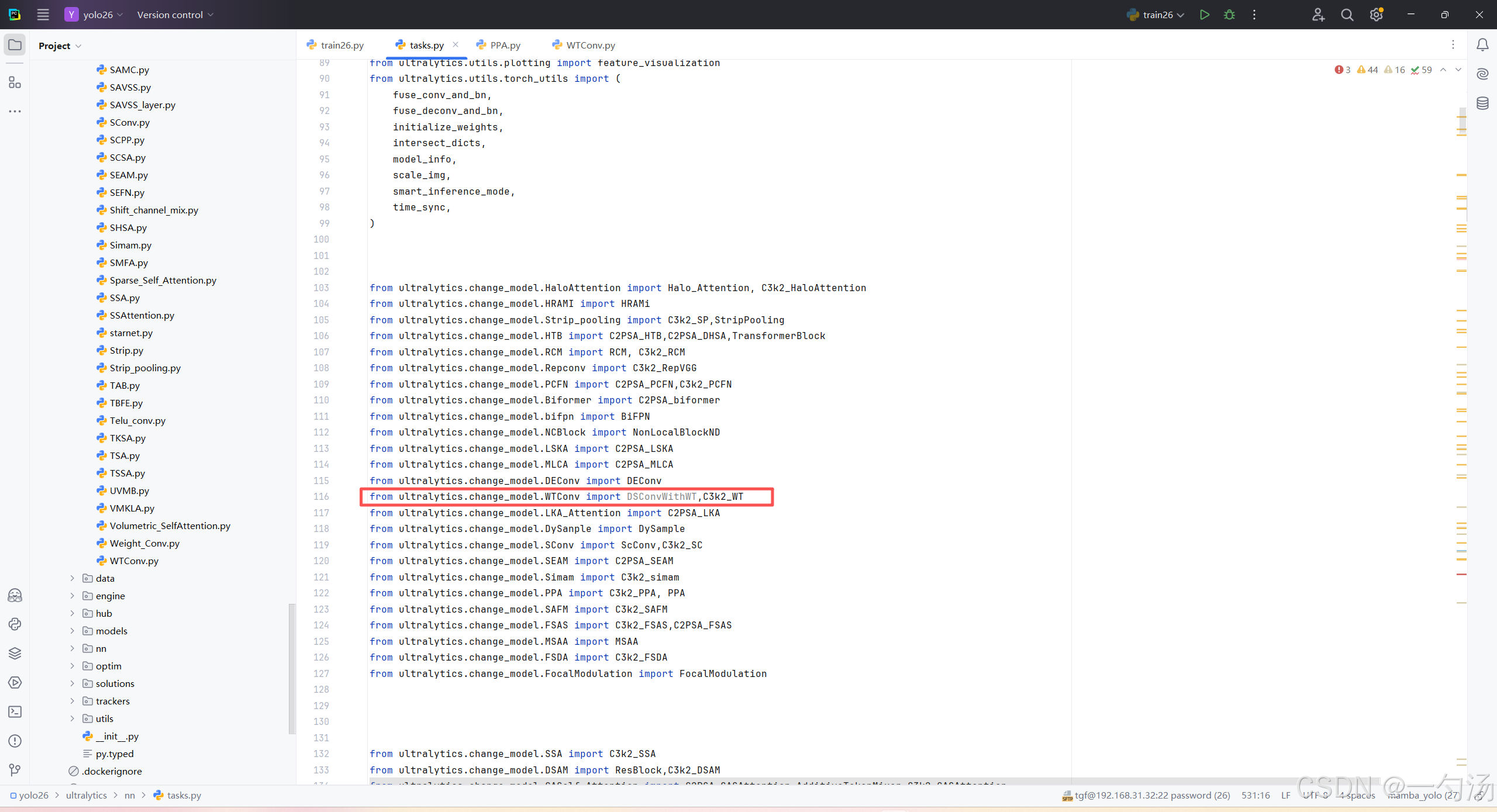

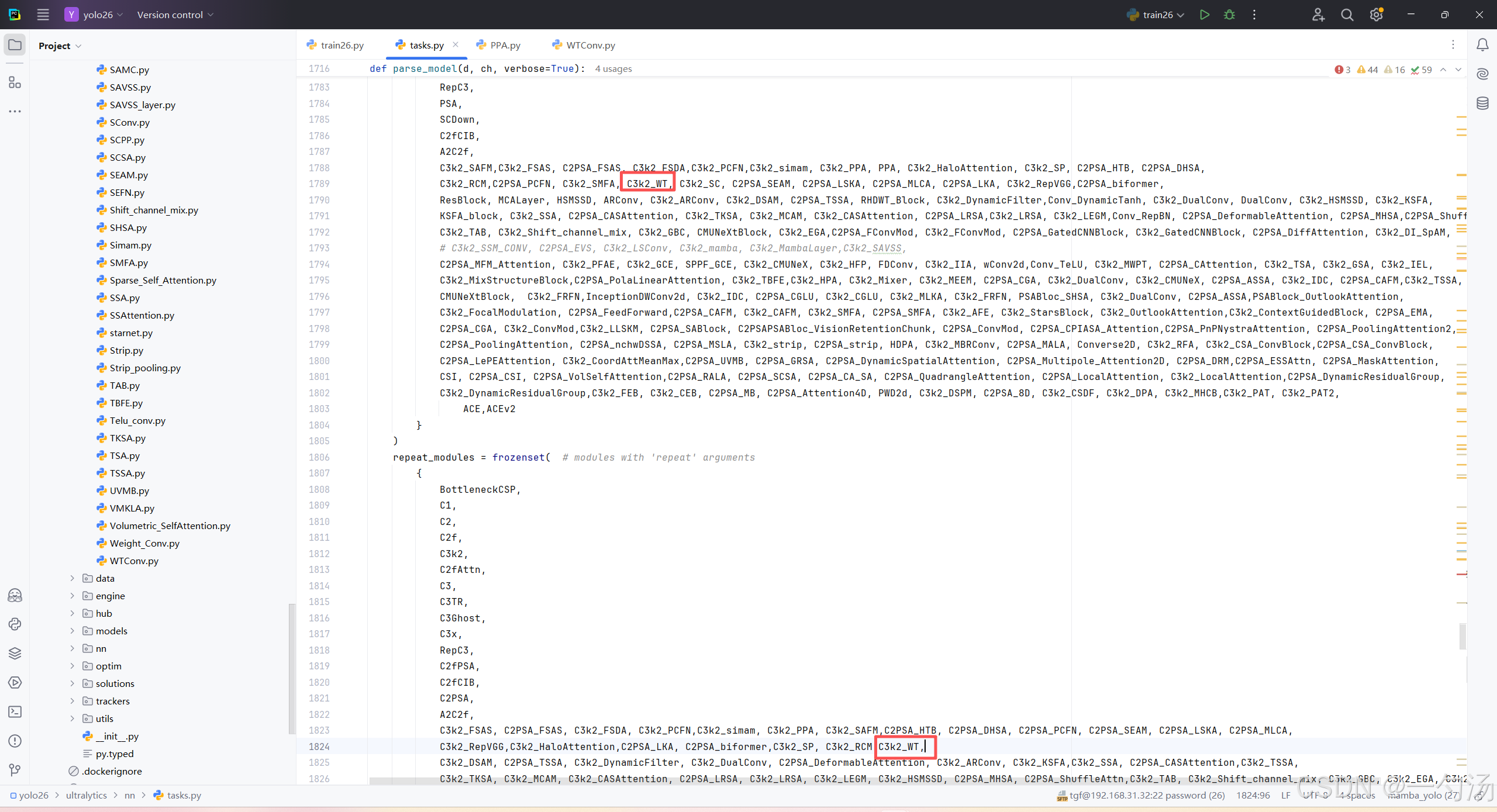

第二:在task.py中导入包

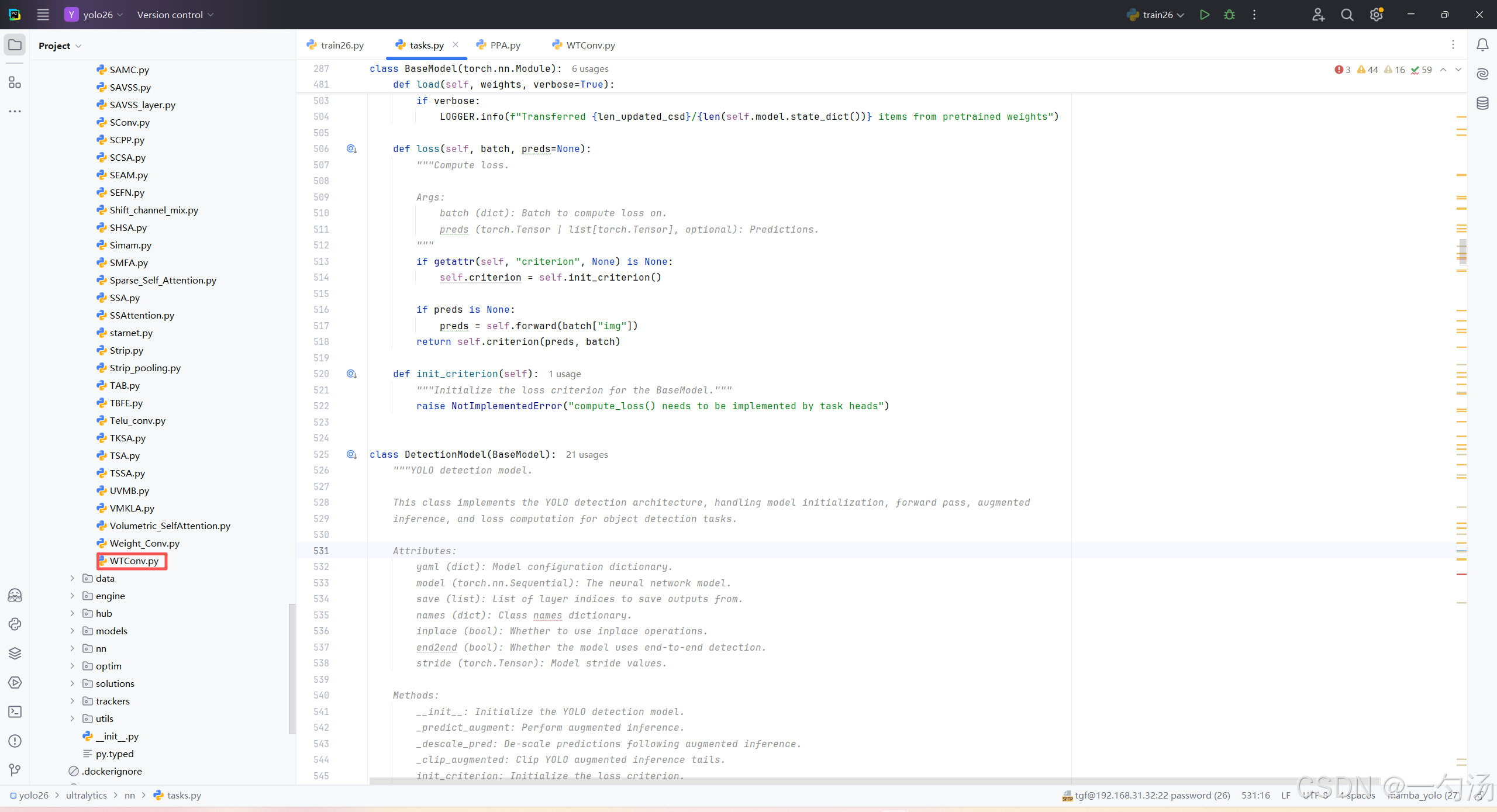

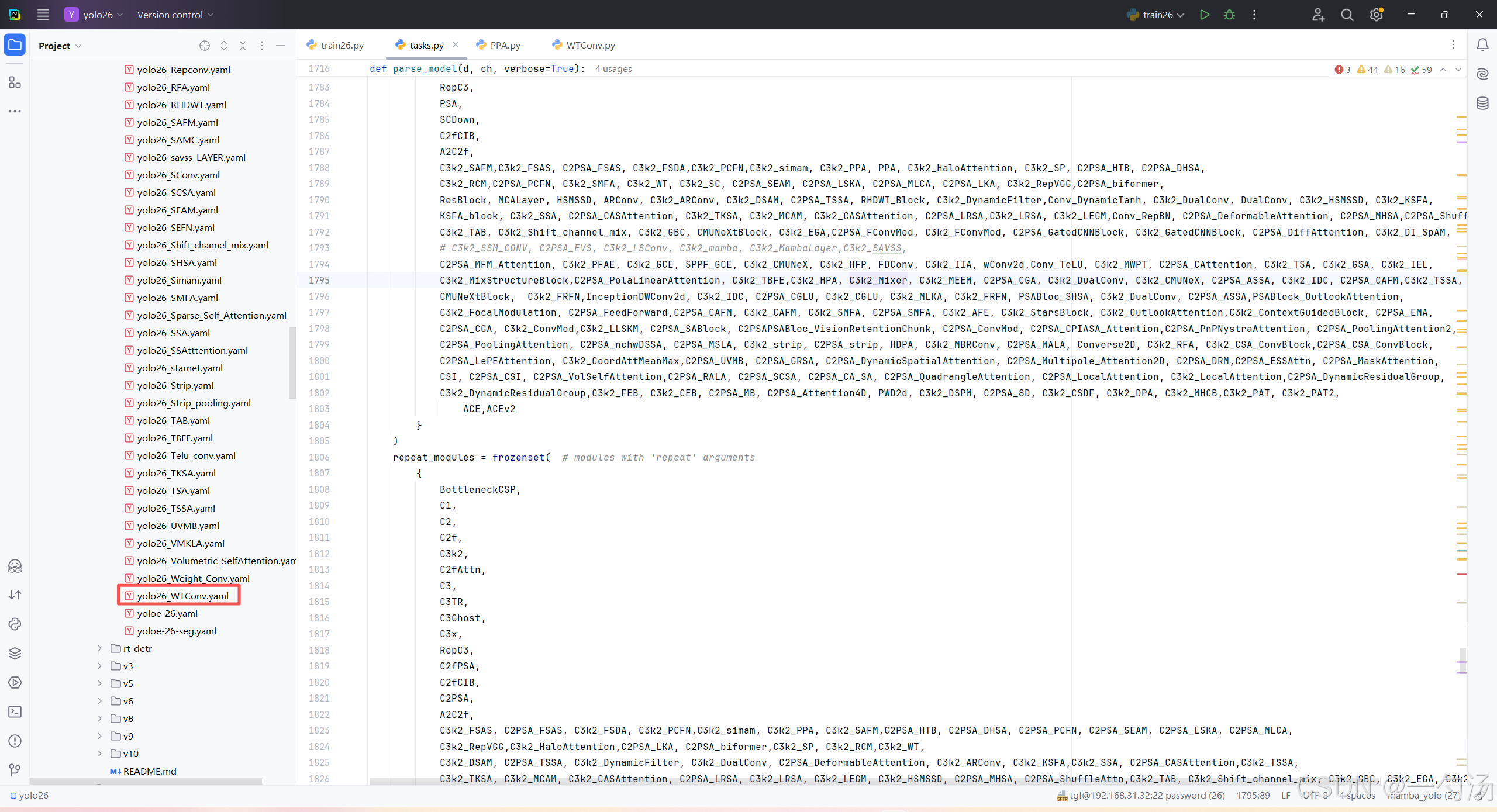

第三:在task.py中的模型配置部分下面代码

第四:将模型配置文件复制到YOLOV11.YAMY文件中

第五:运行代码

from ultralytics.models import NAS, RTDETR, SAM, YOLO, FastSAM, YOLOWorld

if __name__=="__main__":

# 使用自己的YOLOv12.yamy文件搭建模型并加载预训练权重训练模型

model = YOLO(r"/home/tgf/tgf/yolo/model/YOLO26/ultralytics/cfg/models/26/yolo26_WTConv.yaml")

# .load(r'E:\Part_time_job_orders\YOLO_NEW\YOLOv12\yolo12n.pt') # build from YAML and transfer weights

results = model.train(data=r"/home/tgf/tgf/yolo/model/YOLO26/ultralytics/cfg/datasets/VOC_my.yaml",

epochs=300,

imgsz=640,

batch=32,

optimizer="MuSGD",

# cache = False,

# single_cls = False, # 是否是单类别检测

# workers = 0,

# resume=r'D:/model/yolov8/runs/detect/train/weights/last.pt',

amp = True

)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)