23、【Agent】【OpenCode】模型配置(免费模型)

【声明】本博客所有内容均为个人业余时间创作,所述技术案例均来自公开开源项目(如Github,Apache基金会),不涉及任何企业机密或未公开技术,如有侵权请联系删除

背景

上篇 blog

【Agent】【OpenCode】源码构建(平台目标属性)

分析了平台目标剩余的三个属性,其中 arch 属性表示 CPU 指令集架构,常见有 x86 和 arm64,然后是 abi,应用二进制接口,Linux 特有的概念,主要指 C 标准库的实现方式,两个主流的 C 标准库为 glibc 和 musl,其中 glibc 功能全,兼容性好,但体积大,而 musl 轻量,静态链接友好,更纯净,两者不兼容,运行的应用程序之间,还有操作系统的 C 标准库要保持一致,最后是 avx2 属性,AVX2 是 Intel/AMD CPU 的 SIMD 指令集,用于加速计算,现代 CPU基本都支持 AVX2,但一些老旧机器,虚拟机或低功耗设备可能不支持,下面继续分析

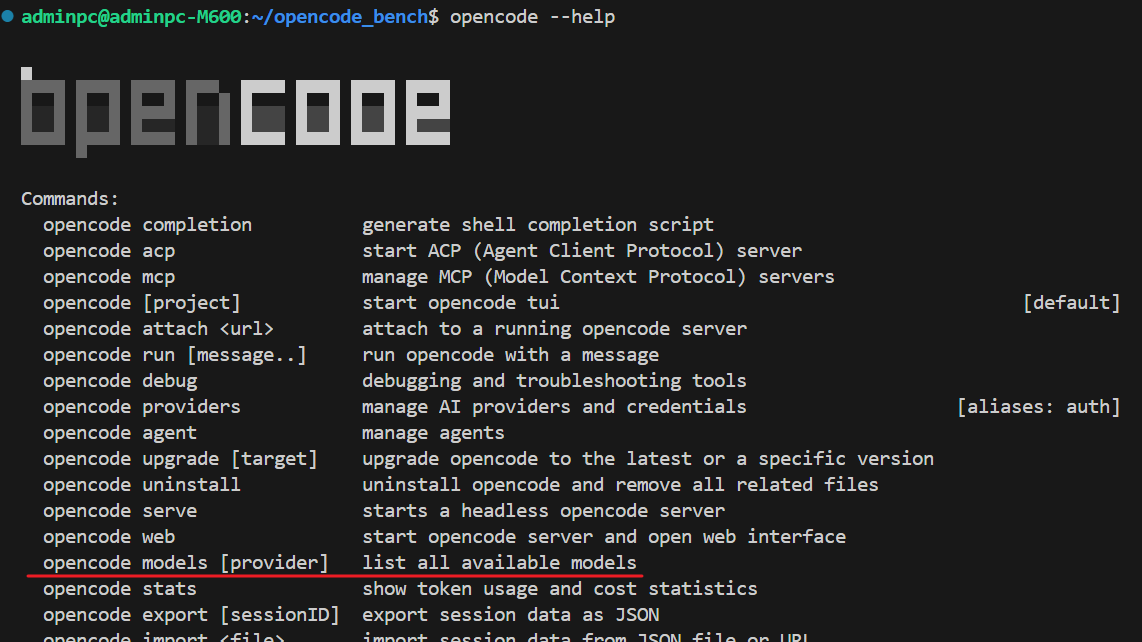

OpenCode

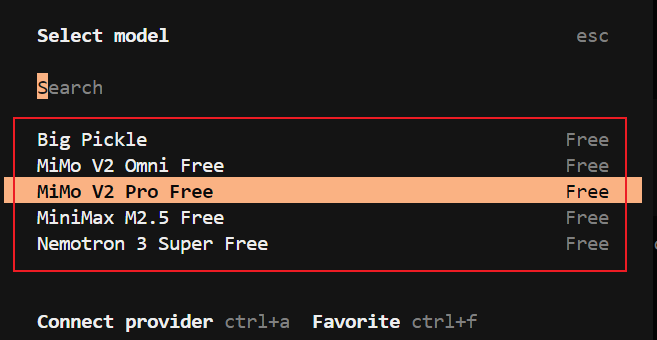

打开 OpenCode,输入 /models,可对模型进行配置

首先可用的免费模型有 5 个(Free),这些免费的模型不需要 API Key 也能使用(注意,这些模型都是限时免费,用于收集反馈)

下面简单分析下这 5 个模型特点

首先是 Big Pickle,基于开源模型(比如 Llama,Mistral 等)微调而成,专为代码生成和理解优化,支持多语言编程,适用场景

- 快速补全代码

- 解释复杂函数逻辑

- 修复错误提示

Big Pickle 的代码分析能力还是不错的,下面测试下连接速度,终端输入

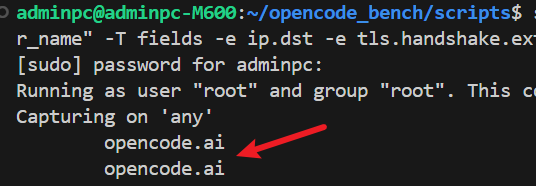

sudo tshark -i any -f "tcp port 443" -Y "tls.handshake.extensions_server_name" -T fields -e ip.dst -e tls.handshake.extensions_server_name

启用流量监控,抓取所有 HTTPS 流量,并提取 SNI 域名(明文)

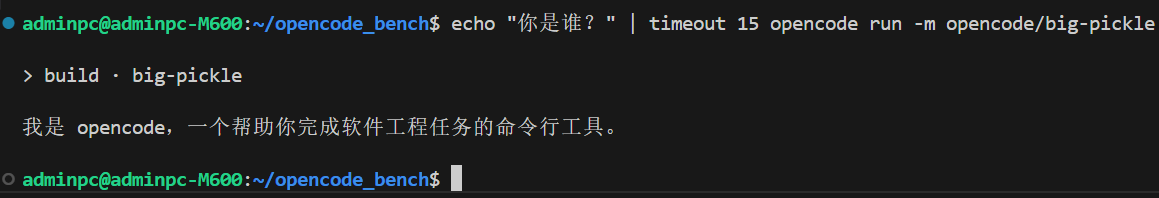

在终端输入

echo "你是谁?" | timeout 15 opencode run -m opencode/big-pickle

指定使用 big-pickle 模型,可以看到

其访问的域名为 opencode.ai

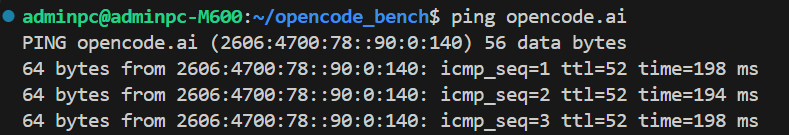

终端输入

ping opencode.ai

可以看到速度还可以,访问延时 190ms+,足够用了

上面使用的命令

opencode run -m opencode/big-pickle

这里指定了模型和模型供应商,在终端输入

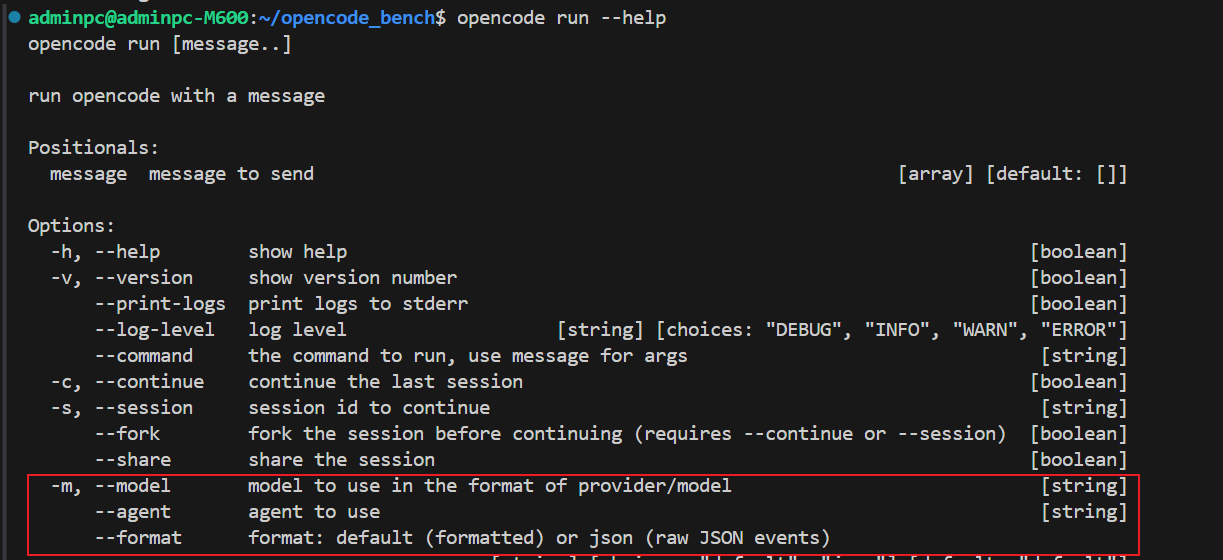

opencode run --help

可以查看 -m 选项描述如下

这里可以看到 -m 和 --model 可以指定要使用的 AI 模型,格式为 provider/model,其中

provider:模型供应商,模型服务商model:具体的模型名称

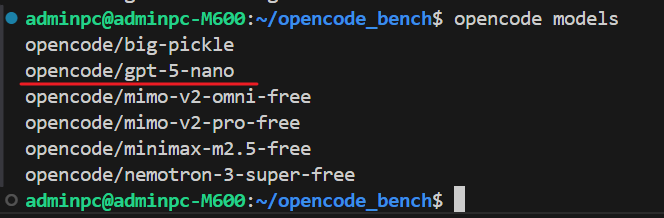

可以用 opencode models 命令查看所有可用的模型

比如终端输入

opencode models

可以看到目前可用的模型有 6 个(比上面通过在 opencode CLI 输入 /models 还多一个 gpt-5-nano)

这些模型在当前环境下都是免费可用的,不需要配置任何 API Key,因为它们都属于 opencode/xxx 这个 provider,也就是 provider = "opencode",而 OpenCode 内置了一个官方代理服务 OpenCode Zen(后面介绍),该代理服务会

- 统一托管多个免费模型的访问通道

- 由 OpenCode 官方承担 API 调用成本(或使用开源模型)

- 隐藏底层 API Key 和网络细节

- 通过

opencode这个官方虚拟 provider 暴露给用户

也就是说,比如这里的 opencode/minimax-m2.5-free 并不是直接调用 MinMax 官方 API,而是通过 OpenCode 的中转服务器免费提供给用户使用

OK,本篇先到这里,如有疑问,欢迎评论区留言讨论,祝各位功力大涨,技术更上一层楼!!!更多内容见下篇 blog

【Agent】【OpenCode】模型配置(opencode/xxx 分析)(一)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)