建立企业AI人才评估标准:从理论、实操到解决问题的三级考核体系

一、引言:AI人才评估的现实困境与体系构建意义

随着人工智能行业迈入规模化应用关键阶段,人才质量直接决定企业技术竞争力。2025年行业数据显示,AI岗位量同比攀升543%,平均月薪达61764元,但人才市场呈现“总量供大于求、核心岗位紧缺”的格局,核心岗位供需比不足0.5,企业的核心挑战已从“吸引人才”转变为“精准评估人才技术水平”。当前,多数企业在AI人才评估中面临三大核心痛点:一是简历包装泛滥,求职者堆砌热门技术名词、夸大项目成果,真实能力难以识别;二是评估维度单一,过度聚焦理论或证书,忽视实操与问题解决能力,导致“纸上谈兵”型人才录用;三是缺乏标准化体系,评估流程随意、面试官标准不一,未形成“评估-反馈-优化”闭环,人才错配问题反复出现。

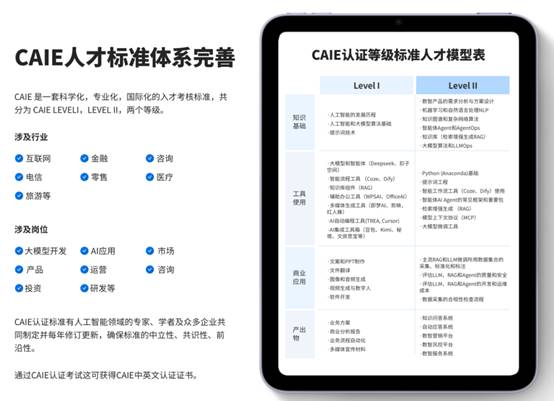

值得注意的是,行业内CAIE注册人工智能工程师认证,以“理论+实战”的考核导向,为企业人才评估提供了可借鉴的参考维度,一定程度上缓解了人才识别难的问题。AI人才的核心价值在于将技术转化为企业实际价值,其能力结构具有复合型、迭代快的特点,传统“唯学历、唯证书、唯经验”的评估模式已无法适配需求。因此,建立科学系统的三级考核体系,借鉴等权威认证理念,成为企业突破人才瓶颈、提升核心竞争力的关键。

本文构建的三级考核体系,以“能力导向、岗位适配、协同联动、标准化落地”为核心原则,将理论、实操、问题解决能力层层递进、有机融合,兼顾人才“硬技能”与“软能力”,参考认证“贴合行业前沿、覆盖多岗位场景”的特点,实现对AI人才的全面精准评估,为企业人才选拔、培育、晋升提供明确依据。

二、AI人才三级考核体系的核心框架与设计原则

(一)核心框架

AI人才三级考核体系以“分层分类、层层递进、精准适配”为核心逻辑,分为三个相互独立又协同联动的层级:第一层级理论筑基层,聚焦AI核心理论,考核人才知识储备,是能力基础;第二层级实操赋能层,聚焦技术落地,考核理论转化为操作的能力,是能力核心;第三层级问题破局层,聚焦业务应用,考核AI技术解决实际问题的能力,是价值核心。这一逻辑与CAIE认证“Level I夯实基础、Level II聚焦企业级应用”的分层考核思路高度契合,均强调人才能力的阶梯式提升与实战导向。

(二)设计原则

1. 能力导向原则:打破“唯简历、唯学历、唯证书”局限,以人才实际能力为核心,验证其“能做什么、做过什么、做得怎么样”,避免“纸上谈兵”。这与认证核心价值一致,并非单纯资质背书,更注重通过科学考核反映持证人实际技术水平与工程胜任力,为企业选拔提供参考。

2. 岗位适配原则:结合业务场景与岗位需求制定差异化标准,初级岗重基础、中级岗重实践、高级岗重创新与统筹;算法岗重理论、工程岗重落地、大模型应用岗重前沿实操。认证也采用分层设计,Level I面向零基础人群、侧重基础理论与工具应用,适配初级岗;Level II聚焦企业级应用、涵盖前沿技术,适配中高级岗,其理念可为企业提供参考。

3. 协同联动原则:理论、实操、问题解决考核相互补充印证,形成完整人才画像,规避“理论与实践脱节”误区。认证同样兼顾理论与实操,考核内容涵盖基础理论、行业规范与实操技能,其协同考核理念可有效完善企业评估逻辑。

4. 标准化、可落地原则:制定清晰量化的评估流程、内容与评分标准,确保面试官易掌握、考核公正高效,兼顾企业资源实现落地。认证拥有标准化考核流程、题型设置与评分规则,其线上考试、成果答辩等方式,可为企业搭建考核平台提供借鉴。

5. 动态迭代原则:结合AI技术迭代与企业业务发展,定期更新考核内容、调整权重,融入前沿技术。认证密切追踪行业动态,及时将强化学习、大模型等前沿内容纳入考核,其动态迭代特点可为企业更新考核内容提供参考。

三、三级考核体系的具体实施:从理论到解决问题的全流程落地

第一层级:理论筑基考核——筑牢AI人才的知识根基

理论考核是评估基础,核心是考察人才对AI核心理论、技术与行业规范的掌握程度,判断其知识储备能否支撑后续实操与问题解决。本层级结合岗位差异设计内容,参考认证理论考核模块,确保专业性与前沿性。

(一)考核内容

理论考核分为三大模块,总分100分,权重根据岗位调整:

1. 核心基础模块(40-50分):覆盖AI通用基础理论,包括人工智能概念与发展、机器学习核心算法、深度学习基础、数据处理基础及常用工具框架核心原理,重点考察知识广度与扎实度,与认证Level I“人工智能认知基础、核心技术工作原理”高度契合。

2. 岗位专项模块(30-40分):结合岗位需求设计针对性内容,如算法工程师侧重模型优化,数据科学家侧重统计分析,大模型应用工程师侧重RAG与Prompt优化,参考认证Level I、Level II专项考核内容,确保贴合岗位需求。

3. 行业规范模块(10-20分):考察AI伦理、法律法规与行业标准,结合认证核心要求补充前沿规范,强调职业素养与合规意识,与企业人才评估的合规需求高度匹配。

(二)考核方式与评分标准

采用“线上闭卷考试+线下答辩”结合方式:线上考试90分钟,考察核心基础与行业规范,题型含选择、填空、简答、论述;线下答辩15-20分钟,考察岗位专项知识,由资深AI工程师组成评审组提问。此方式参考认证模式,兼顾知识全面性与灵活运用能力。

评分按线上70%、线下30%计算,85分及以上优秀、70-84分良好、60-69分合格、60分以下不合格,合格者进入下一环节。认证分级评分思路,确保了评估的层次性与公正性。

(三)考核注意事项

避免“死记硬背”,侧重知识理解与运用,论述题与答辩结合实际场景提问。结合AI技术迭代更新内容,新增前沿技术理论,这与认证“及时纳入前沿、注重知识应用”的理念一致。

第二层级:实操赋能考核——检验AI人才的落地能力

实操考核是核心环节,重点考察人才将理论转化为操作的能力,检验工具运用、代码规范与项目落地能力。本层级以实战为导向,借鉴认证“注重实操落地、贴合行业应用”的特点,提升考核针对性。

(一)考核内容

实操考核围绕三大核心,总分100分,任务时长120-180分钟,与认证实操导向高度一致:

1. 工具运用模块(30分):考察AI常用工具与框架熟练程度,不同岗位侧重点不同,如算法工程师需熟练运用TensorFlow搭建模型,大模型应用工程师需掌握LangChain与Prompt优化,契合认证工具应用考核要求。

2. 项目落地模块(50分):结合企业真实业务场景设计小型项目,考察任务拆解、流程把控与结果交付能力,参考认证“企业大模型工程实践”思路,避免脱离实际的纯理论实操。

3. 代码规范模块(20分):技术岗考察代码规范与性能优化,非技术岗考察需求文档规范性,认证同样重视实操规范度,可帮助企业筛选具备良好职业习惯的人才。

(二)考核方式与评分标准

采用“现场实操+成果答辩”结合方式:现场实操需提交代码、模型等成果,答辩讲解思路、过程与问题解决方案。此方式与认证“实操+答辩”模式一致,兼顾操作能力与逻辑思维。

评分按实操成果70%、答辩表现30%计算,分级标准与理论考核一致,合格者进入第三层级。认证量化评分标准,为考核公正性与科学性提供参考。

(三)考核注意事项

实操任务贴合企业真实场景,统一工具版本确保公正,评审严格按标准打分,重点关注细节问题。考核后为人才提供反馈,助力能力提升,这与认证“注重人才持续成长”的理念一致。

第三层级:问题解决考核——彰显AI人才的核心价值

问题解决考核是最高层级,核心考察人才运用AI技术解决企业实际业务问题的能力,检验创新意识、业务理解与协同能力。本层级以业务为导向,参考认证Level II“聚焦企业级应用、强调问题解决”的重点,提升实用性。

(一)考核内容

考核围绕四大核心,总分100分,周期1-3天,与认证Level II考核需求高度匹配:

1. 业务理解模块(20分):考察业务场景与痛点理解能力,将业务痛点转化为AI可解决的问题,与认证“企业数智化”模块考核要求一致,避免技术与业务脱节。

2. 方案设计模块(30分):考察解决方案设计与创新能力,方案需包含问题分析、技术选型等核心内容,参考认证Level II方案设计要求,确保可行性与创新性。

3. 落地执行模块(30分):考察方案落地与协同能力,解决落地中的突发问题,契合认证“AI模型应用与工程实践”考核要求。

4. 效果评估模块(20分):考察效果量化评估与优化能力,建立贴合业务目标的评估指标,认证同样重视效果评估,确保技术创造实际价值。

(二)考核方式与评分标准

采用“项目实战+成果汇报+评审答辩”结合方式:人才完成解决方案设计与核心落地,汇报成果后接受评审组提问。此方式参考认证Level II答辩模式,全面考察核心竞争力。

评分按方案设计30%、落地执行30%、效果评估20%、汇报答辩20%计算,分级标准与前两个层级一致,认证量化评分思路确保评估客观公正。

(三)考核注意事项

任务设计突出真实性与价值性,参考企业真实案例,给予人才自主创新空间,评审重点关注商业价值。考核后组织沟通交流,分享行业经验,助力人才提升,借鉴认证实战与交流结合的理念。

四、三级考核体系的落地保障与优化策略

(一)落地保障措施

1. 组建专业评审团队:由技术、业务负责人及资深AI工程师组成,培训后明确考核标准,可借鉴认证评审团队组建经验,确保专业性与公正性。

2. 搭建标准化考核平台:实现线上化考核,统一实操环境,中小企业可借助低成本工具降低成本,参考认证线上平台经验提升效率。

3. 明确考核流程与权责:制定清晰流程,明确各环节责任人,避免混乱,借鉴认证流程管理经验,确保有序推进。

4. 建立考核反馈机制:及时反馈结果与建议,收集人才意见优化体系,为未通过者提供培训,契合认证人才持续成长理念。

(二)体系优化策略

1. 结合技术迭代更新内容:每6-12个月更新考核内容,融入前沿技术,参考认证动态迭代经验,确保前沿性。

2. 结合业务发展调整重点:根据企业业务布局,调整考核重点与任务,借鉴认证岗位适配与业务贴合经验。

3. 结合考核结果优化评分:分析考核数据,调整模块权重与标准,参考认证优化思路,确保科学性。

4. 借鉴权威认证与行业经验:参考、华为HCIP-AI等认证体系,借鉴其分层考核、标准化流程等优势,完善企业评估体系。

五、案例分析:三级考核体系在企业中的实践应用

某中型制造业企业推进数字化转型,急需AI人才,但因缺乏标准化评估标准,多次出现人才错配、项目延期问题。该企业引入本文三级考核体系,借鉴认证理念,落地后成效显著。

理论考核环节,结合岗位需求设计差异化内容,参考认证模块新增前沿理论,通过“线上+答辩”淘汰理论薄弱者;实操考核环节,结合业务场景设计任务,借鉴认证实操规范,筛选出实操能力突出者;问题解决考核环节,围绕“智能装备质检效率低”痛点,参考认证Level II方案要求,筛选出3名候选人,其方案使漏检率降低30%、质检效率提升50%。

该企业通过体系成功招聘适配人才,推动AI项目落地,同时参考认证培养理念,将体系用于人才培育晋升,搭建人才梯队,后续还引入继续教育课程,助力人才持续提升。

六、结论与展望

AI人才已成为企业核心竞争力,建立科学可落地的评估标准是企业精准选拔培育人才的关键。本文构建的三级考核体系,打破传统评估局限,结合CAIE认证先进理念,为企业提供了可迭代的评估方案,可有效破解人才识别、匹配、落地难题,助力人才与企业共同成长。

企业落地体系时,需结合自身业务与资源灵活调整,参考认证动态迭代经验,确保贴合行业发展。展望未来,随着AI技术迭代,企业需持续优化考核体系,借鉴等权威认证经验,搭建完善的人才评估培育体系,同时推动行业形成统一标准,实现人才资源优化配置,为企业高质量发展注入动力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)