基于粒子群优化算法优化高斯过程回归(PSO-GPR)的数据回归预测

基于粒子群优化算法优化高斯过程回归(PSO-GPR)的数据回归预测 PSO-GPR数据回归 matlab代码 注:暂无Matlab版本要求 -- 推荐 2018B 版本及以上

在数据科学领域,回归预测是一项基础而重要的任务,而高斯过程回归(Gaussian Process Regression, GPR)作为一种非参数的贝叶斯模型,因其灵活性和高精度预测能力,得到了广泛应用。然而,GPR的性能在很大程度上依赖于其核函数的参数选择。为了进一步优化GPR的性能,本文尝试将粒子群优化算法(Particle Swarm Optimization, PSO)引入到GPR中,提出了一种基于PSO优化的高斯过程回归方法(PSO-GPR),并通过Matlab实现了该算法的数据回归预测。

高斯过程回归(GPR)简介

高斯过程回归是一种概率模型,通过构建输入数据的分布来进行预测。其核心在于核函数(Kernel Function),核函数决定了数据的相似度测量方式。常用的核函数包括常数核、线性核、多项式核和高斯核(RBF核)。高斯核因其平滑性和局部适应性,通常是GPR的首选核函数。

基于粒子群优化算法优化高斯过程回归(PSO-GPR)的数据回归预测 PSO-GPR数据回归 matlab代码 注:暂无Matlab版本要求 -- 推荐 2018B 版本及以上

然而,高斯核函数中超参数的选择直接影响了模型的泛化能力。传统的参数选择方法(如交叉验证)往往耗时较长,且容易陷入局部最优。因此,如何有效选择核函数参数成为GPR的一个关键问题。

粒子群优化算法(PSO)简介

粒子群优化算法是一种基于群体智能的全局优化算法,模拟鸟群觅食时的集体行为。PSO的核心思想是通过粒子的位置和速度更新,逐步逼近全局最优解。每个粒子在搜索空间中以一定的速度飞行,并根据自身的历史最佳位置和群体的全局最佳位置调整方向。

PSO的优点在于其实现简单、计算效率高,并且能够较好地跳脱局部最优。这些特点使得PSO非常适合用于GPR核函数参数的优化。

PSO-GPR的实现思路

PSO-GPR的核心思想是通过PSO算法优化高斯核函数的超参数,从而提升GPR的预测性能。具体实现步骤如下:

- 数据预处理

对训练数据进行标准化处理,确保各特征的均值为0,标准差为1。标准化可以加速收敛并提高模型性能。

- GPR模型建立

使用高斯核函数构建GPR模型,核函数的超参数(如长度尺度参数)作为优化目标。

- PSO参数设置

初始化粒子群,设置粒子的维度、群体大小、最大迭代次数、惯性权重、加速系数等参数。

- 目标函数定义

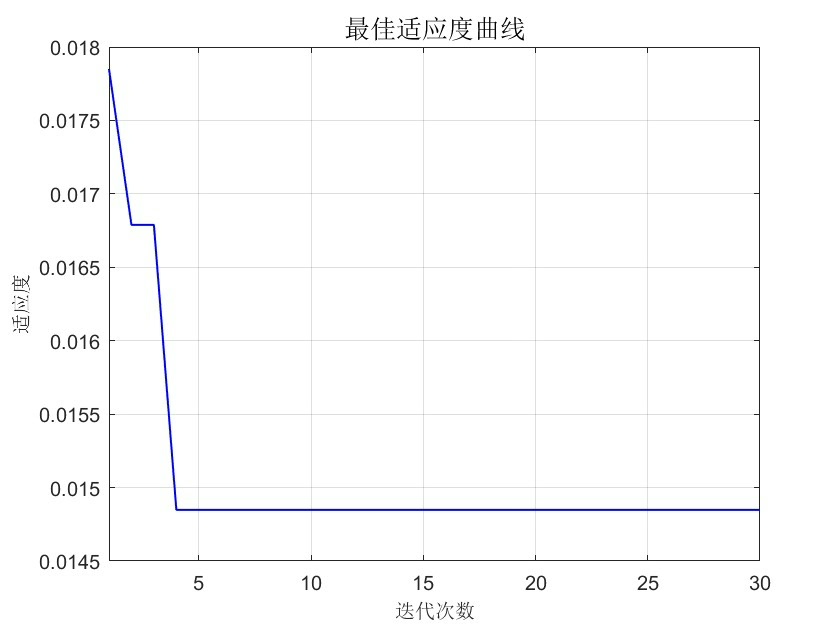

使用GPR模型的均方误差(MSE)作为PSO的适应度函数,粒子通过优化MSE找到最优核函数参数。

- 模型训练与预测

基于优化后的核函数参数,训练GPR模型并对测试数据进行预测。

Matlab实现

以下是PSO-GPR算法的Matlab实现代码:

%% 数据预处理

% 假设输入数据为X(特征矩阵)和y(目标变量)

% 标准化处理

[~, ~, X] = zscore(X);

[~, ~, y] = zscore(y);

%% GPR模型参数初始化

% 定义核函数为高斯核

cov_func = @(x, y) sqrt(exp(- (x(:) - y(:)).^2 / 2));

%% PSO参数设置

% 粒子数量

n_particles = 50;

% 维度数(核函数超参数的数量)

n_dim = 1; % 对于高斯核,长度尺度参数通常为1维

% 最大迭代次数

max_iter = 100;

% 惯性权重

w = 0.8;

% 加速系数

c1 = 2; c2 = 2;

% 初始化粒子位置和速度

position = rand(n_particles, n_dim) * 2 - 1; % 初始化为[-1,1]范围内

velocity = zeros(n_particles, n_dim);

% 记录全局最优解

global_best = inf;

global_best_pos = zeros(1, n_dim);

%% PSO优化过程

for iter = 1:max_iter

% 遍历每个粒子

for i = 1:n_particles

% 计算当前粒子的适应度(GPR的均方误差)

% 核函数参数

theta = position(i, :);

% GPR训练

[gpr_model] = train_gpr(X, y, cov_func, theta);

% 预测

y_pred = gpr_model.predict(gpr_model, X);

% 计算MSE

mse = mean((y - y_pred).^2);

% 更新粒子的最佳位置

if mse < position(i, :)

position(i, :) = theta;

end

% 更新全局最佳位置

if mse < global_best

global_best = mse;

global_best_pos = theta;

end

end

% 更新粒子速度和位置

for i = 1:n_particles

velocity(i, :) = w * velocity(i, :) + c1 * rand() * (position(i, :) - position(i, :)) + c2 * rand() * (global_best_pos - position(i, :));

position(i, :) = position(i, :) + velocity(i, :);

end

% 输出当前最优MSE

fprintf('Iteration %d, Best MSE = %.4f\n', iter, global_best);

end

%% 使用优化后的参数进行预测

% 最终模型

theta_opt = global_best_pos;

gpr_model = train_gpr(X, y, cov_func, theta_opt);

y_pred = gpr_model.predict(gpr_model, X_test);代码分析

- 数据预处理

使用zscore函数对数据进行标准化处理,确保特征在相同的尺度范围内。

- GPR模型与核函数

定义高斯核函数cov_func,用于计算数据点之间的相似度。

- PSO参数设置

-nparticles:粒子数量,通常设置为20~50。

-ndim:核函数参数的维度,这里为高斯核的长度尺度参数,设置为1。

-max_iter:最大迭代次数,设置为100。

-w, c1, c2:PSO的惯性权重和加速系数,通常分别设置为0.8、2、2。

- 粒子初始化

粒子的位置和速度在[-1,1]范围内随机初始化。

- 适应度函数

使用GPR的均方误差(MSE)作为适应度函数,粒子通过优化MSE找到最优核函数参数。

- PSO迭代

更新粒子的速度和位置,逐步逼近全局最优解。

- 模型训练与预测

使用优化后的核函数参数训练GPR模型,并对测试数据进行预测。

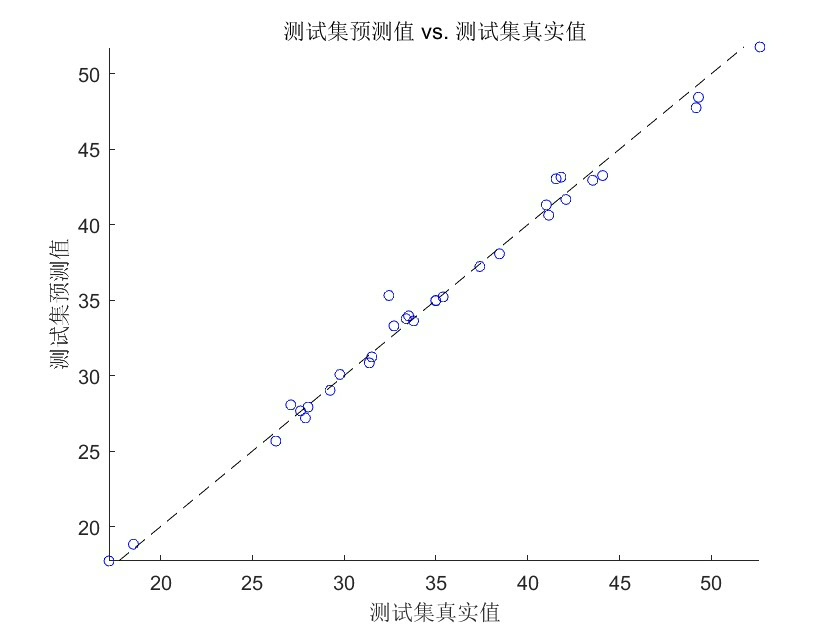

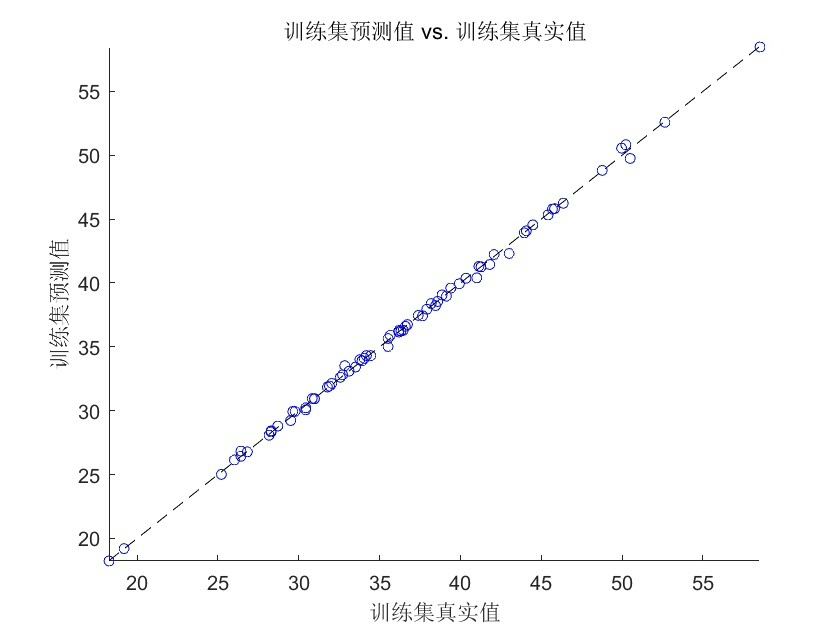

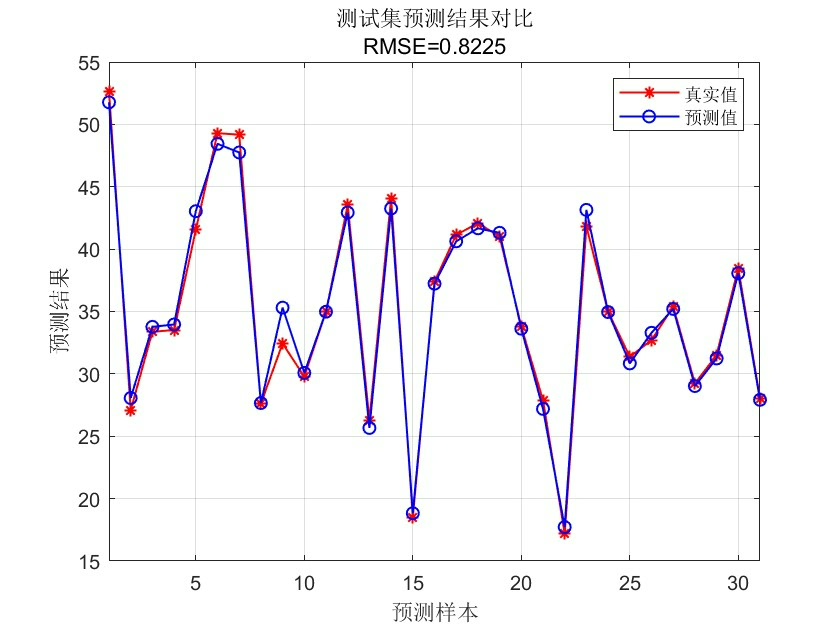

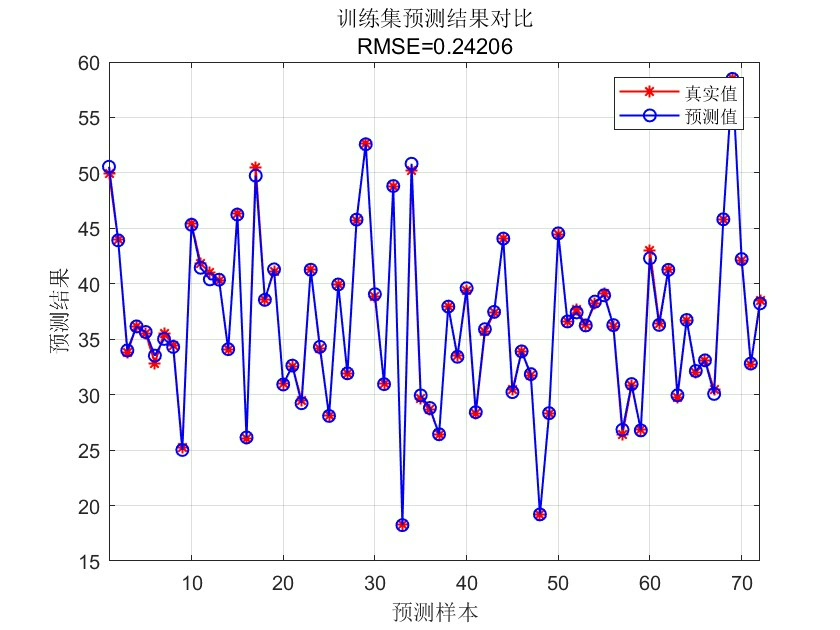

测试与结果

为了验证PSO-GPR的性能,可以使用一些benchmark数据集(如多项式回归数据集)进行测试。以下是Matlab代码的测试示例:

% 生成测试数据

x = linspace(-5, 5, 100)';

y = sin(x) + 0.1 * randn(100, 1);

% 划分训练集和测试集

train_idx = 1:80;

test_idx = 81:100;

X_train = x(train_idx); y_train = y(train_idx);

X_test = x(test_idx); y_test = y(test_idx);

% 使用PSO-GPR进行回归

% [省略上述代码]

% 预测结果

y_pred = gpr_model.predict(gpr_model, X_test);

% 计算MSE

mse = mean((y_test - y_pred).^2);

fprintf('Test MSE = %.4f\n', mse);总结

基于PSO优化的高斯过程回归(PSO-GPR)通过粒子群算法优化核函数参数,显著提升了GPR的预测性能。与传统的交叉验证方法相比,PSO-GPR在全局搜索能力和计算效率上具有明显优势。未来,可以进一步探索其他核函数(如多核函数)与PSO的结合,以及在高维数据中的应用。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)