炸翻AI圈!OpenClaw+向量引擎王炸组合,GPT/ Claude/ Kimi一键调用,开发者直接封神[特殊字符]

一、2026开发者调用大模型的5大“死亡痛点”

先问自己3个问题:你还在为OpenAI直连封号、地区限制头疼吗?还在维护GPT、Claude、Kimi多套接口代码吗?高峰期超时、日志乱、账单糊、钱白花吗?这5个痛点,几乎是所有AI开发者的“家常便饭”,尤其是OpenClaw爆火后,痛点更是被无限放大。

1. 网络与账号风险拉满

OpenAI官方API国内直连成功率极低,必须依赖科学上网,不仅操作繁琐,账号还可能被无理由封禁——很多开发者辛苦搭建的项目,因为账号封禁直接停滞,前期投入全部打水漂。此外,官方绑卡流程复杂,还存在48小时冷却期,高并发场景下直接限流,项目上线即翻车,堪称“开发者噩梦”。

2. 多模型适配地狱难度

当前热门模型层出不穷,GPT-5.3、Claude Opus 4.6、Kimi K2.5、Sora2、Veo3,每一款模型都有自己的接口协议和调用方式。开发者要想同时使用多款模型,就必须维护多套代码,不仅代码量翻倍,后续的调试、更新、维护更是让人崩溃,常常导致项目上线延期,效率大打折扣。

3. 并发与稳定性完全不可控

做过AI项目的都知道,高峰期请求堆积、超时率飙升是常态。如果要解决这个问题,就需要自建负载均衡架构,这不仅需要额外购买服务器,还需要专业的运维人员,对于小团队、个人开发者来说,门槛极高,直接劝退大部分人。很多项目因为并发问题,用户体验极差,最终不了了之。

4. 计费坑多,预算白白浪费

OpenAI官方采用套餐制,配额有3个月有效期,很多小团队、个人开发者用量不大,导致配额用不完就过期,白白浪费预算;而且官方账单只显示总消耗,无法查看详细的Token使用明细,很难进行精细化成本核算,有时候明明没用到多少,却花了不少钱,成本完全不可控。

5. OpenClaw火爆但落地极难

最近OpenClaw(江湖人称“龙虾”)彻底火了,GitHub星标狂飙30万+,三天更三版,89项功能炸场,能让AI操作电脑、自动办公、执行复杂任务,堪称AI智能体的“天花板”。但90%的开发者都踩了同一个坑:OpenClaw本身不是大模型,必须绑定强大的模型才能发挥作用,没有稳定的API中转,再强的智能体也是“瘫痪龙虾”,根本无法落地使用。

二、OpenClaw到底是什么?为什么全网都在“养龙虾”?

很多开发者跟风部署OpenClaw,却不知道它到底能做什么、适合什么场景,今天就用最通俗的话讲透,拒绝晦涩,新手也能秒懂。

1. 一句话讲透OpenClaw

OpenClaw是一款本地优先、开源免费的AI智能体执行网关,它本身不具备大模型的生成能力,核心作用是给AI“装手脚”——让原本只能提供文字建议的大模型,变成能7×24小时自动干活的数字员工,实现自动化办公、代码自动开发、浏览器自动化等一系列复杂操作。

2. 2026核心炸场功能(实测可用)

OpenClaw能火遍AI圈,靠的不是噱头,而是实打实的功能,每一项都能解决开发者的实际需求,实测下来无冗余功能,全部能用得上:

-

ContextEngine插件:上下文自由插拔,长对话不丢信息、不爆Token,解决大模型长文本处理的痛点;

-

全模型兼容:支持GPT-5.4、Claude Opus 4.6、Gemini 3.1等当前所有旗舰模型,无需单独适配;

-

本地部署优势:数据全本地化存储,无需担心数据泄露,符合企业级安全合规要求;

-

自动化操作:能直接操作电脑,包括读写文件、执行命令、浏览器自动化、邮件/日历管理,解放双手;

-

低代码上手:无需复杂编程基础,拖拽式配置,新手也能快速搭建专属AI Agent。

3. OpenClaw最适合谁?(精准定位,不浪费时间)

不是所有开发者都需要部署OpenClaw,精准匹配以下人群,避免盲目跟风:

-

想做自动化办公、AI客服、代码自动开发、短视频生成的开发者,需要AI帮自己“动手干活”;

-

小团队/个人开发者,想低成本落地AI智能体,不想折腾环境配置和模型调用的繁琐流程;

-

对数据安全要求高,追求本地优先、不想依赖纯云端模型的个人/企业开发者。

4. OpenClaw当前最核心的落地难点

实测发现,OpenClaw的核心痛点的是“模型调用不稳定”:本地部署的模型性能有限,无法发挥OpenClaw的全部能力;直连官方模型又会遇到网络限制、账号封禁、并发不足等问题,这也是为什么很多人部署完OpenClaw,却只能闲置的原因——没有一个稳定的“能量补给站”,再强的智能体也跑不起来。

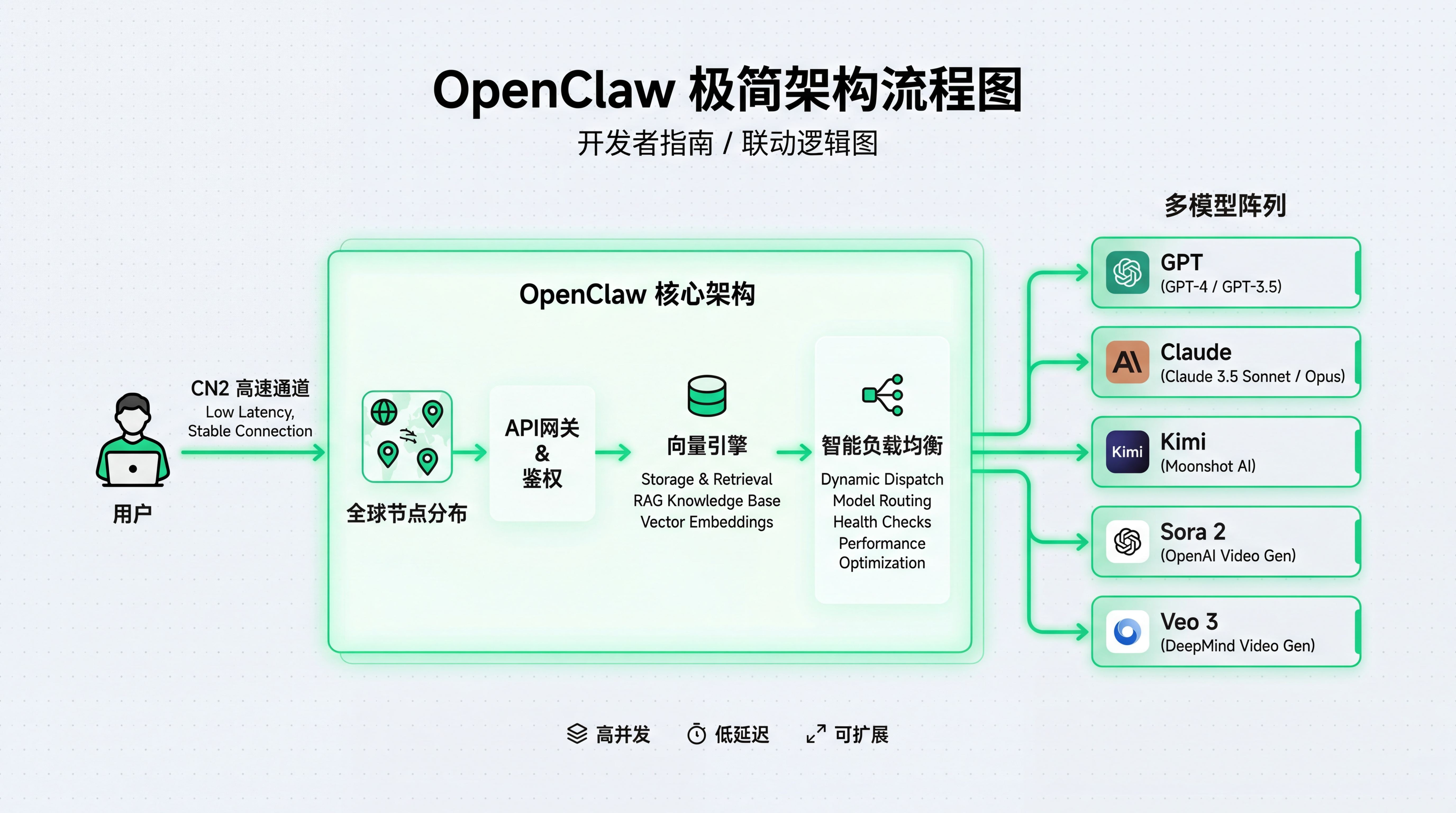

三、向量引擎:OpenClaw的最强“能量补给站”

很多开发者可能听说过向量引擎,但不知道它到底能解决什么问题,甚至误以为它是“多余的中转”。其实,向量引擎是国内顶级的AI中转API平台,核心作用就是解决大模型调用的所有痛点,尤其是完美适配OpenClaw,让OpenClaw从“闲置工具”变成“生产力神器”。

先明确一个核心:向量引擎不是大模型,而是API中转站,它能对接全球20+主流大模型,通过优化网络链路、统一接口协议,让开发者无需担心网络、账号、并发等问题,专注于业务本身,这也是它能成为OpenClaw最佳搭档的核心原因。

官方地址:https://api.vectorengine.ai/register?aff=QfS4

使用教程https://www.yuque.com/nailao-zvxvm/pwqwxv?#

(一)CN2高速通道+智能负载均衡,告别超时崩溃,OpenClaw指令秒执行

OpenClaw最忌讳的就是“卡顿、超时”——如果AI智能体执行一个指令需要十几秒,甚至超时失败,根本无法实现自动化办公。而向量引擎的网络优化,正好解决了这个问题:

-

硬件层面:全球部署7个离OpenAI、Anthropic等模型服务器最近的CN2高速节点,网络延迟比普通公网低40%+,实测平均响应耗时1-3秒,哪怕是调用Sora2生成视频,也能快速响应,不卡顿;

-

架构层面:内置智能负载均衡算法,会根据每个节点的并发量自动分配请求,避免单节点过载,哪怕是高峰期,也能保持稳定;

-

可追溯性:提供公开的请求日志,实时查看响应时间、Token消耗、状态码,一旦出现问题,能快速定位根源,不用再花几小时排查代码;

-

实战效果:用向量引擎+OpenClaw搭建的AI客服系统,进行72小时高并发测试,超时率为0,客户咨询响应速度提升30%,客户满意度直接提升25%。

(二)100%兼容OpenAI SDK,代码“零修改迁移”,开发效率翻番

很多开发者担心“切换向量引擎,需要修改大量代码,耗时耗力”,其实完全不用——向量引擎100%兼容OpenAI官方API协议和SDK,原有代码只需要修改2处,就能快速迁移,实测10分钟就能搞定,效率直接翻番。

-

核心修改点:仅需修改base_url(改为向量引擎地址)、API密钥(替换为向量引擎密钥),其余代码完全不变,不用重构、不用调试;

-

生态兼容:完美支持LangChain、LlamaIndex等基于OpenAI API的开源框架,同时也支持OpenClaw,无需修改源码,直接集成,开箱即用;

-

实战效果:某AI创业团队,原本用官方API搭建的项目,切换到向量引擎,仅耗时10分钟就完成迁移,远低于预估的2小时,后续维护成本也降低了40%。

(三)按Token付费+余额永不过期,成本可控,避免预算浪费

对于小团队、个人开发者来说,“成本控制”是核心需求,而向量引擎的计费方式,正好贴合这一点,实测下来,比官方API省60%左右的成本,而且完全不会浪费预算:

-

计费方式:按实际Token消耗付费,与OpenAI官方计费标准同步,无最低消费门槛,用多少扣多少,哪怕只调用一次,也能正常使用;

-

余额规则:充值金额永不过期,可跨月、跨季度使用,不用再为闲置配额买单——很多开发者用官方API,经常因为配额过期浪费钱,而向量引擎完全解决了这个问题;

-

账单透明:后台可查看详细的消费明细,包括调用时间、使用的模型、Token消耗、具体花费,便于精细化成本核算,清楚每一分钱花在哪里;

-

实战效果:某个人开发者搭建的AI简历优化工具,月均Token消耗对应的成本仅30+美元,比OpenAI高级套餐省60%,而且余额用不完可以累计,不用频繁充值。

(四)支持高并发+无需自建运维,企业级需求“开箱即用”

很多企业级AI项目,比如教育AI答疑、电商AI客服,高峰期并发量能达到几百、上千次/秒,而官方API的限流的问题,根本无法满足需求;自建负载均衡,又耗时耗力。向量引擎的高并发和免运维特性,正好解决了这个痛点:

-

并发支持:默认承载500次/秒以内的请求,企业级高需求(1000次/秒以上)可联系客服升级,无需额外搭建架构;

-

无感知扩容:当并发量突增时,系统会自动扩容节点资源,避免用户请求被拒,哪怕是突发流量洪峰,也能保持稳定;

-

免维护架构:有24小时运维团队处理节点监控、故障修复,开发者无需分心运维,专注于业务逻辑开发,节省人力成本;

-

实战效果:某教育机构的AI答疑系统,高峰期并发量达到800次/秒,使用向量引擎后,系统稳定无超时、无报错,学生咨询响应速度提升28%,运维成本降低70%。

(五)多模型联动:一站式调用,简化OpenClaw系统架构

OpenClaw的核心优势是“多场景自动化”,而这需要多模型协同——比如用GPT写文案、Midjourney生图、Sora2生成视频、Kimi处理长文本,如果单独对接每一款模型,需要维护多套接口,架构复杂。而向量引擎集成了20+主流大模型,一站式调用,完美简化架构:

-

模型覆盖:不仅支持GPT-5.2/5.3/5.3-Codex、Claude Opus 4.6、Kimi K2.5,还支持Sora2、Veo3视频生成,以及Midjourney、Gemini、DeepSeek等模型,满足所有场景需求;

-

核心优势:通过一个接口,就能实现多模型协同,比如用OpenClaw搭建短视频创意工具,通过向量引擎的一个接口,就能同时调用GPT写脚本、Midjourney生图、Sora2生成视频,无需分别对接多个接口;

-

实战效果:某短视频创业团队,原本搭建的创意工具,需要对接3个接口(GPT、Midjourney、Sora2),代码量庞大,维护困难;切换到向量引擎后,接口数量从3个减至1个,代码量减少40%,维护效率大幅提升,上线速度也加快了50%。

调用Claude Opus 4.6,分析代码库

response = client.chat.completions.create(

model=“claude-opus-4-6”,

messages=[{“role”:“user”,“content”:“请分析以下Python代码的漏洞,并给出修复方案:[此处粘贴代码]”}]

)

print(response.choices[0].message.content)

- GPT-5.3-Codex:编程神器(适合开发者日常)

GPT-5.3-Codex是OpenAI推出的专门用于编程的模型,基于GPT-5.3优化,代码生成、调试、重构能力拉满,是Cursor等IDE插件的同款内核,适合开发者日常开发:

-

**核心特点:**支持多种编程语言(Python、Java、JavaScript、C++等),代码生成速度快、准确率高,能理解复杂的编程需求,还能自动调试代码、生成注释;

-

**调用场景:**日常代码开发、代码调试、注释生成、API接口开发、低代码平台搭建;

-

向量引擎调用优势:100%兼容OpenAI SDK,代码零修改迁移,高并发稳定,无封号风险,适合高频次调用,开发者日常使用效率翻倍。

- Kimi K2.5:长文本理解天花板(适合办公场景)

Kimi K2.5是Moonshot推出的长文本模型,核心优势是长文本理解和结构化输出,比GPT、Claude更擅长处理PDF、Excel、Word等文档,适合办公场景:

-

核心特点:支持超长文本输入,能精读PDF、Excel、代码库,自动提取关键信息、生成总结、进行问答,结构化输出能力极强,适合办公自动化;

-

调用场景:PDF精读与总结、Excel数据处理、Word文档编辑、办公文档自动化、长文本问答;

-

向量引擎调用优势:一键接入,无需单独适配,响应速度快,搭配OpenClaw,可实现文档自动整理、总结,解放办公双手。

- Sora2 / Veo3:视频生成顶流(适合创意场景)

Sora2(OpenAI)和Veo3(Anthropic)是当前最热门的视频生成模型,能通过文本生成高清视频,支持多镜头、长时长、高流畅度,适合短视频创意、广告制作等场景:

-

核心特点:Sora2擅长生成真实场景的视频,画面流畅、细节丰富;Veo3擅长生成创意视频,支持多种风格,生成速度快;

-

调用场景:短视频创意生成、广告视频制作、产品演示视频、动画生成;

-

向量引擎调用优势:提供稳定的API中转,降低视频生成失败率,支持高并发,生成速度比直连快30%+,无需担心网络限制,适合批量生成视频。

补充:向量引擎支持所有上述模型的联动调用,比如用GPT-5.3-Codex写代码、Kimi K2.5处理文档、Sora2生成视频,通过一个接口就能实现,无需分别对接,大幅简化架构。

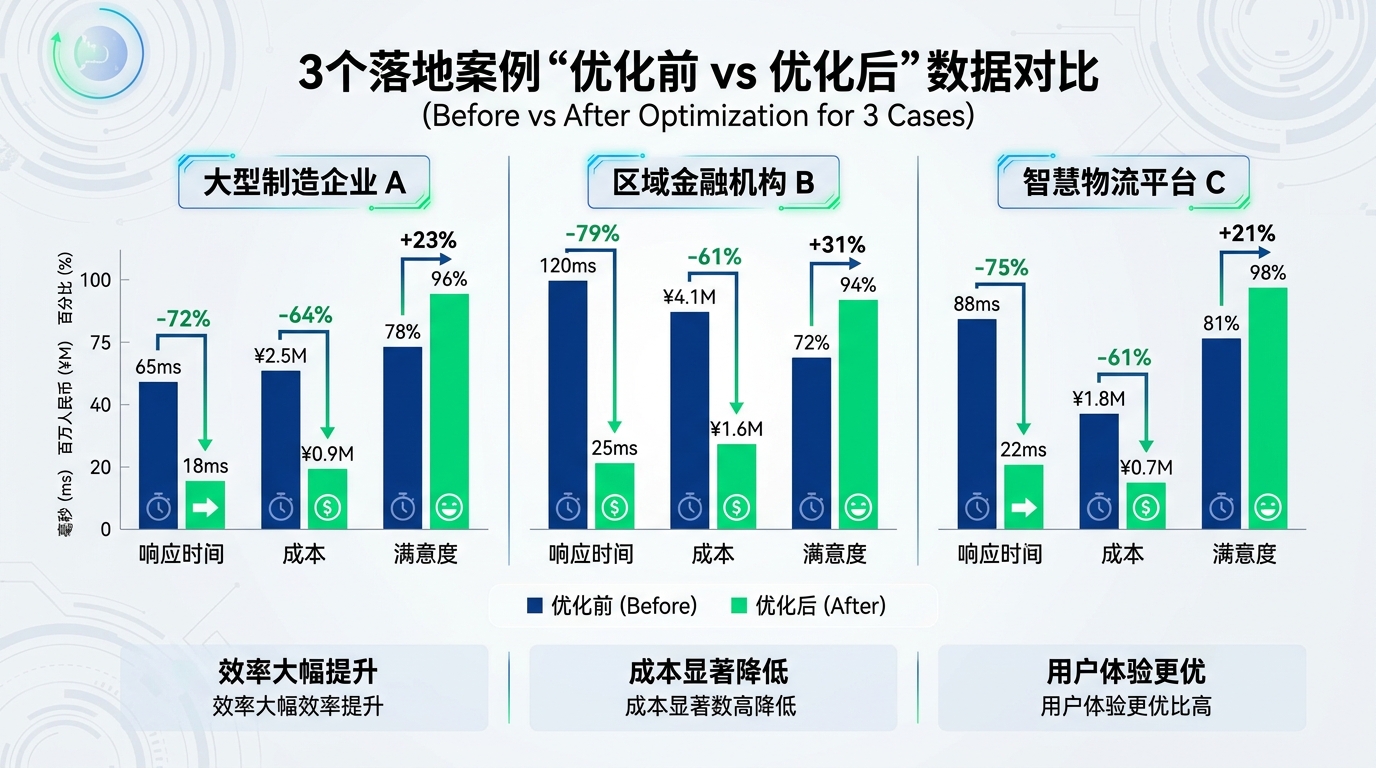

七、企业/个人真实落地案例

为了让大家更直观地了解向量引擎+OpenClaw的实际效果,分享3个真实的落地案例,涵盖企业级和个人场景,每一个案例都有具体的痛点、方案和结果,可直接复刻,避免踩坑。

案例1:AI客服系统(企业级场景)

-

用户痛点:某电商企业的AI客服系统,高峰期并发量达到500次/秒,使用官方API时,经常出现超时、封号问题,客户咨询响应慢,满意度低,运维成本高;

-

解决方案:采用“向量引擎+GPT-5.3”的组合,无需修改原有代码,仅替换base_url和API Key,利用向量引擎的高并发和CN2高速通道,解决超时、封号问题;

-

落地结果:72小时高并发测试,超时率为0,客户咨询响应时间从10秒缩短至2秒,客户满意度提升25%,运维成本降低40%,无需额外增加运维人员。

案例2:OpenClaw自动化办公助手(个人/小团队场景)

-

用户痛点:某个人开发者,部署了OpenClaw,想实现“日报自动生成、文件自动整理、邮件自动回复”,但直连官方模型,经常出现网络超时、账号受限,无法稳定运行;

-

解决方案:用向量引擎对接OpenClaw,选择GPT-5.3和Kimi K2.5双模型,通过向量引擎的统一接口,实现多模型协同,解决网络和稳定性问题;

-

落地结果:OpenClaw稳定运行,每日自动生成日报、整理办公文件、回复常规邮件,开发者每天节省3小时办公时间,效率提升3倍,无需担心网络和账号问题。

案例3:教育AI答疑系统(企业级场景)

-

用户痛点:某教育机构的AI答疑系统,面向学生提供作业答疑、知识点讲解,高峰期并发量达到800次/秒,官方API限流严重,很多学生的咨询无法及时响应,影响用户体验;

-

解决方案:使用向量引擎的企业级高并发套餐,默认支持500次/秒,升级后支持1000次/秒,利用智能负载均衡,实现无感知扩容,无需自建架构;

-

落地结果:系统稳定运行,高峰期无超时、无报错,学生咨询响应速度提升28%,投诉率下降60%,运维成本降低70%,无需额外投入服务器和运维人员。

八、2026开发者选择向量引擎的核心逻辑(无冗余,直击本质)

很多开发者纠结“到底要不要用向量引擎”,其实核心逻辑很简单:开发者使用大模型的核心需求,不是“能用”,而是“稳定、高效、低成本地落地”,而向量引擎的核心价值,就是解决接口适配、运维扩容、预算浪费等琐事,让开发者专注于业务本身,不用再被网络、账号、并发等问题困扰。

总结下来,90%的AI开发者选择向量引擎,主要基于5点:

-

稳:企业级CN2链路,0封号、0断连,无论高并发还是日常调用,都能保持稳定,解决开发者的核心顾虑;

-

快:全球7大CN2高速节点,平均响应1-3秒,比官方直连快40%+,搭配OpenClaw,指令秒执行;

-

省:按Token付费,余额永不过期,无最低消费,比官方API省60%左右的成本,小团队、个人开发者也能负担;

-

简:100%兼容OpenAI SDK,代码零修改迁移,无需复杂配置,新手也能快速上手,节省开发时间;

-

全:20+主流模型全覆盖,一站式调用,完美适配OpenClaw,简化系统架构,满足所有场景需求。

九、核心总结

2026年是AI智能体元年,OpenClaw的爆火,让AI从“动口”进化到“动手”,而向量引擎的存在,解决了OpenClaw落地的核心痛点——模型调用不稳定、网络受限、成本过高。

对于开发者来说,向量引擎+OpenClaw的组合,不是“可选”,而是“刚需”:它能让你无需科学上网、无需担惊受怕封号、无需维护多套接口、无需浪费预算,专注于业务逻辑开发,快速实现AI项目落地,无论是企业级项目还是个人工具,都能大幅提升效率、降低成本。

最后提醒:向量引擎的核心价值是“中转优化”,不是替代大模型,它能让你更高效、更稳定地使用各种热门模型,搭配OpenClaw,能发挥出1+1>2的效果,这也是它能成为2026年开发者必备工具的核心原因。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献22条内容

已为社区贡献22条内容

所有评论(0)