Nature Communications 训练触觉传感器,使其能够相互学习力感应能力

能够感知环境并与环境交互的机器人正在彻底改变医疗保健、服务和制造业。虽然这些机器人依赖于各种传感方式,但触觉传感对于实现灵巧操作和确保安全的人机交互至关重要。然而,在机器人系统中复制人类的触觉仍然是一个根本性的挑战,尤其对于需要精确手部力反馈的任务而言。

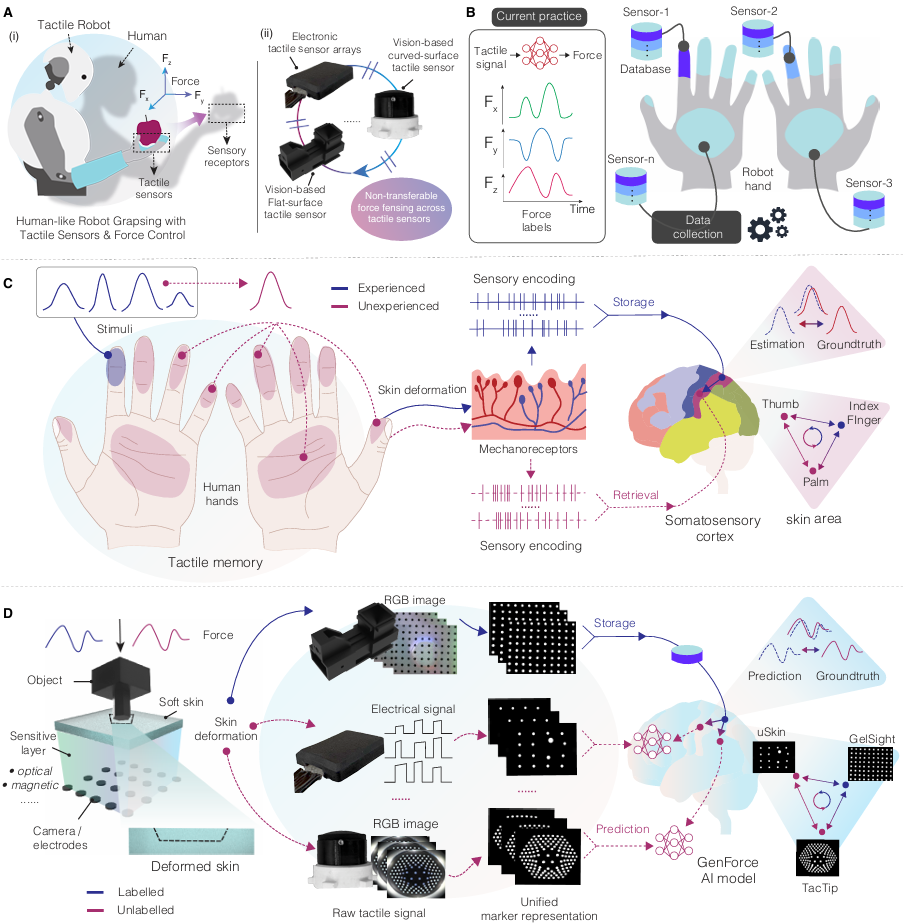

人类皮肤配备了多种感觉感受器,可以检测机械刺激并提供丰富的接触信息。受此启发,触觉机器人技术旨在模仿人类机械感受器的功能,通过开发各种仿生触觉传感系统来增强灵巧性和智能性(图 1A-i)。这些触觉传感器基于各种传感原理,例如压阻式、电容式、磁式和光学式转换,在检测静态或动态接触信息方面具有独特的优势。例如(图 1A-ii),GelSight使用相机捕捉详细的纹理和几何形状,提供高分辨率的触觉图像,使其非常适合需要精细触觉反馈的任务,例如物体识别或3D重建。uSkin使用霍尔效应传感器测量嵌入式磁体的位移,对多轴力具有高灵敏度,并且结构紧凑,适用于精确操作任务。TacTip的特点是使用相机跟踪仿生针的运动,在动态环境中提供强大的力、形状和滑动检测能力。

然而,传感原理、结构设计和材料特性的多样性导致触觉传感器之间存在显著的领域差异,阻碍了已学习触觉经验的迁移,并需要重复收集数据。例如,为配备多个触觉传感器的机器人手训练力预测模型(图 1B)需要为每个传感器收集大量的成对触觉信号-力标签数据集,由于昂贵的力/扭矩传感器(例如ATI Nano)和耗时的数据收集过程,这带来了实际障碍。软弹性体因磨损而不可避免地会发生性能下降,需要频繁更换和重新校准,这使得这一挑战更加严峻。因此,目前的做法要求每次部署新的传感器时都重复收集成对的触觉信号-力标签并重新训练力预测模型。

跨皮肤区域统一和传递感觉信息的能力是人类控制抓握力的关键,确保物体操作过程中的稳定性和灵活性。对于配备触觉传感器的机器人来说,这种能力同样至关重要,使其能够在非结构化环境中执行手内物体操作任务。在人类中,触觉记忆系统(图 1C)能够存储和检索跨手部皮肤区域的触觉信息,例如触觉刺激。皮肤中的机械感受器检测变形,并将变形转化为统一的感觉编码,并通过周围神经传输到体感皮层进行存储和处理。人类这种适应、统一和传递触觉的能力为开发机器人可迁移触觉感知提供了宝贵的灵感。模仿这种统一的表征和可迁移的触觉感知可以使触觉传感器相互学习,重用收集到的触觉经验,并将触觉感知能力迁移到不同的机械手上,从而增强机器人的灵活性和适应性。迁移学习和表征学习的最新进展在统一潜在触觉表征和实现触觉经验迁移方面取得了显著进展。然而,与人类的触觉记忆能力相比,现有方法仍然存在明显的局限性。例如,传统的迁移学习技术仍然需要从新传感器收集标记数据进行微调。

最近报道的表征学习方法仅关注基于视觉的触觉传感器,并在特征空间中对齐传感器表征,这需要来自不同传感器的大规模数据集,并且通常依赖于使用标记数据训练的特定任务解码器来提高准确性。一些旨在直接转换传感器之间触觉信号的方法同样无法实现一对一的转换,因为它们忽略了传感器之间统一触觉表征的重要性,并且缺乏对具有力预测能力的各种触觉传感器的泛化能力。至关重要的是,上述方法未能考虑传感器之间基本的材料差异,而这些差异对于需要高精度(例如力预测)的任务至关重要。

本文亮点

1. 本工作受生物能力的启发,提出了GenForce,这是首个能够实现机器人手部不同触觉传感器之间力感知迁移的框架。

2. GenForce将触觉信号统一编码为共享的标记表示,类似于皮层感觉编码,使得在一个传感器上训练的力预测模型可以迁移到其他传感器,而无需收集大量的力数据。证明了GenForce能够泛化到配置不同的同质传感器以及传感模式和材料特性不同的异质传感器。

3. 还在机器人操作任务中展示了这种可迁移的力感知能力,包括日常物品抓取、滑动检测以及基于多传感器力协调的滑动补偿。

图文解析

图1. 可迁移力感知。

(A) 机器人利用触觉传感器和力控制抓取物体,模仿人类利用感觉受体进行动作。由于传感原理、结构设计和材料特性的差异,这些仿生触觉传感器无法相互传输力数据。(B) 目前训练力预测模型的方法需要重复且耗时的数据收集过程来获取力标签。(C) 人类利用触觉记忆系统,通过检索存储在体感皮层中的触觉记忆,来估计未接触区域的刺激。(D) GenForce 模型概述。由于传感原理、结构设计和材料特性的差异,触觉传感器在相同的形变下会产生不同的触觉信号。GenForce 将触觉信号统一为标记表示,实现不同传感器之间的标记到标记转换,并利用来自已校准传感器的数据,在未校准传感器上实现高精度力预测。

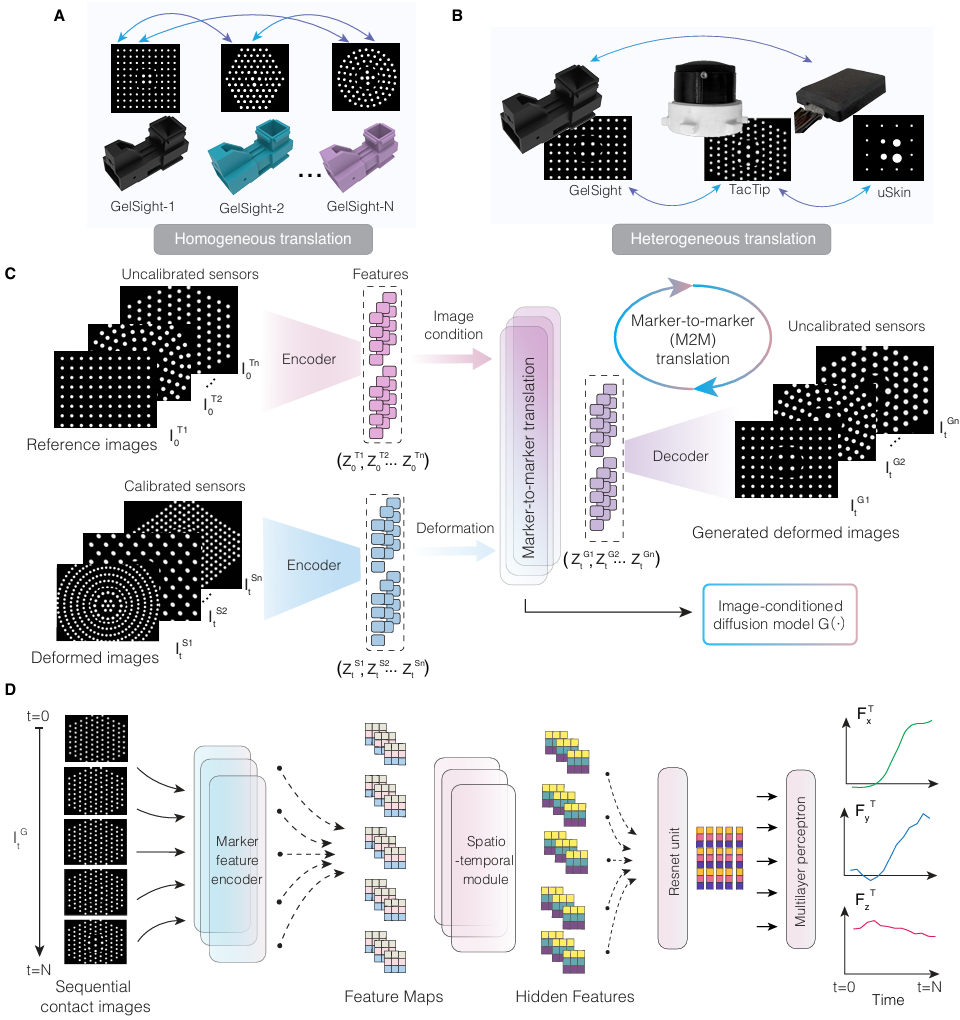

图2. 标记到标记转换和时空力预测。

(A) 使用具有不同标记图案的 GelSight 传感器演示同质转换。(B) 使用 GelSight、TacTip 和 uSkin 传感器演示异质转换。(C) 标记到标记转换 (M2M) 模型。该模型以来自已校准传感器的变形图像作为输入,并以来自未校准传感器的参考图像为条件,合成模拟未校准传感器响应的变形图像。(D) 时空力预测模型。该网络处理连续接触图像以预测三轴力,并利用时空模块提高精度。

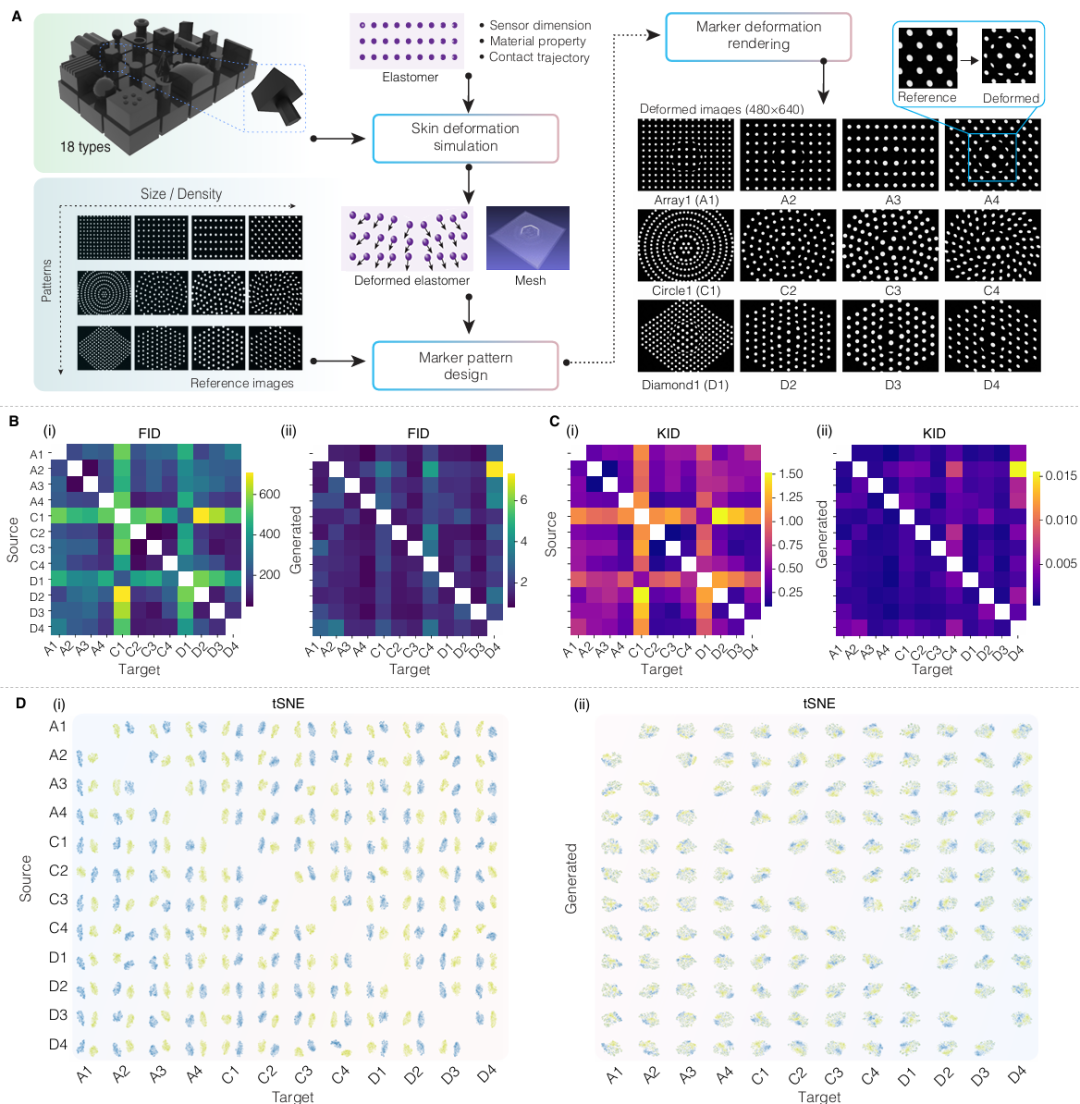

图3. 仿真中的标记到标记转换。

(A) 标记变形仿真流程。(B-C) 通过 (B) FID 和 (C) KID 热图对标记到标记转换进行定量评估,比较在所有 132 种传感器组合中应用 M2M 模型之前 (i) 和之后 (ii) 的性能。(D) t-SNE 特征空间可视化,展示在所有传感器组合中应用 M2M 模型之前 (i) 和之后 (ii) 目标图像和生成图像之间的对齐情况。

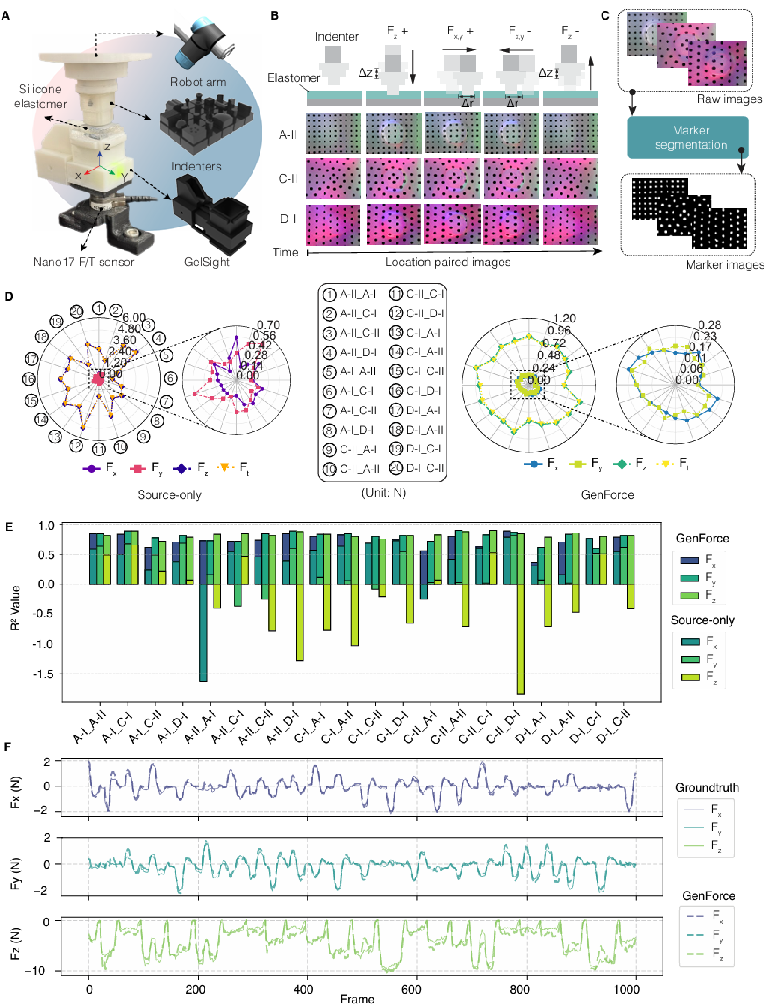

图4. 同质触觉力转换。

(A) 数据采集装置。(B) 用于在法向力和剪切力作用下获取连续触觉图像的数据采集轨迹。(C) RGB 触觉图像的标记分割过程。 (D) 雷达图比较了仅使用源数据的方法和 GenForce 模型之间的力预测误差。𝐹𝑡 表示总力。所有单位均为牛顿 (N)。(E) 使用仅源数据方法和 GenForce 模型预测力的决定系数 (𝑅2) 值直方图。(F) 使用 GenForce 模型对 A-II_D-I 组进行 1000 帧的实时力预测轨迹。

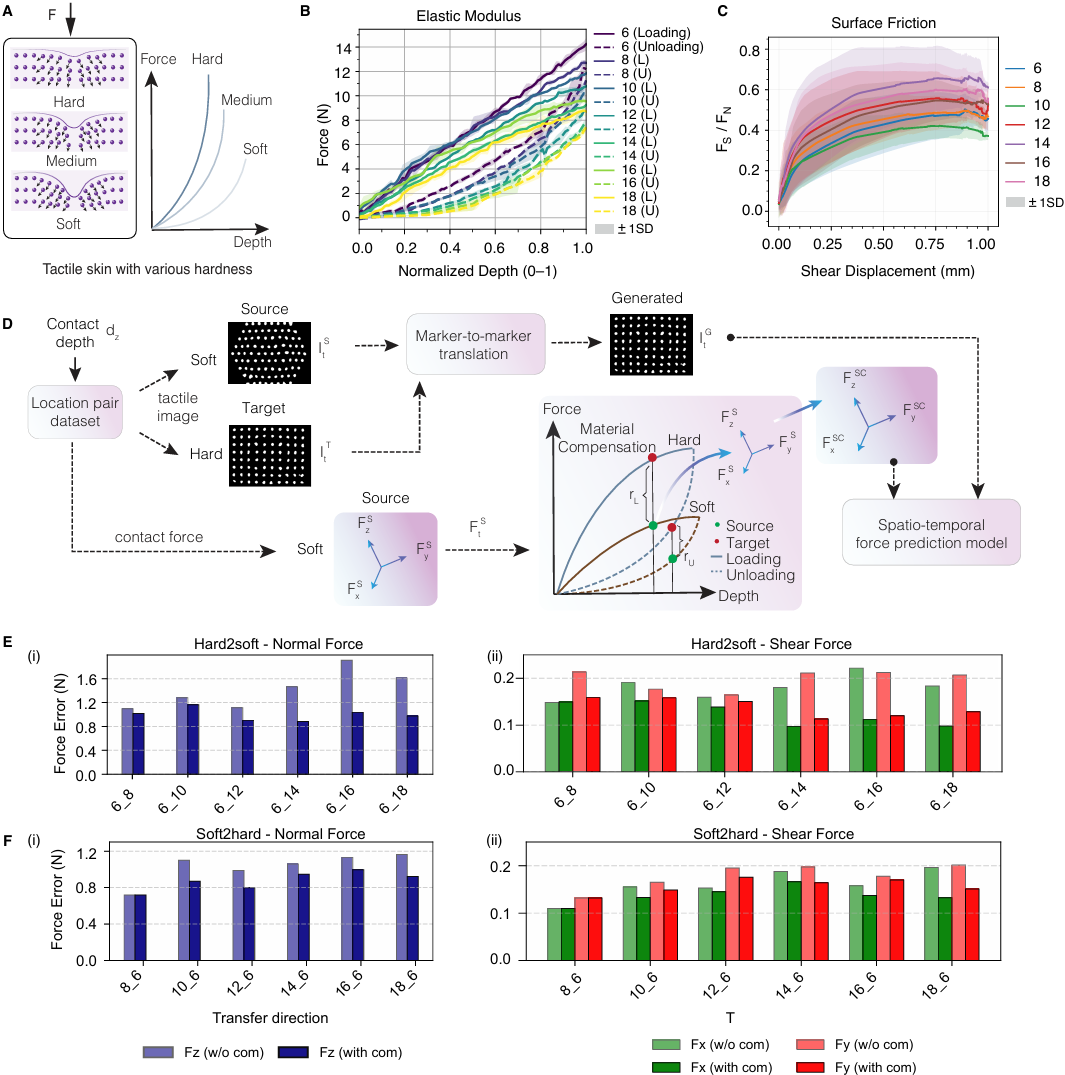

图5. 材料硬度效应和补偿。

(A) 具有不同硬度水平的触觉皮肤及其相应的力-深度关系的示意图。(B) 七种弹性体在加载和卸载阶段的力归一化深度曲线(平均值 ±1 标准差),展示了它们独特的硬度和滞后特性。(C) 七种弹性体的剪切力与法向力之比 𝐹𝑆/𝐹𝑁 与剪切位移之间的关系(平均值 ±1 标准差),在各种接触点处测量。(D) 材料补偿过程,该过程利用材料先验知识在加载和卸载阶段校正力标签。(E-F) 在硬到软组 (E) 和软到硬组 (F) 中,GenForce 模型在没有(w/o)和有材料补偿情况下的力预测误差 (i-ii)。

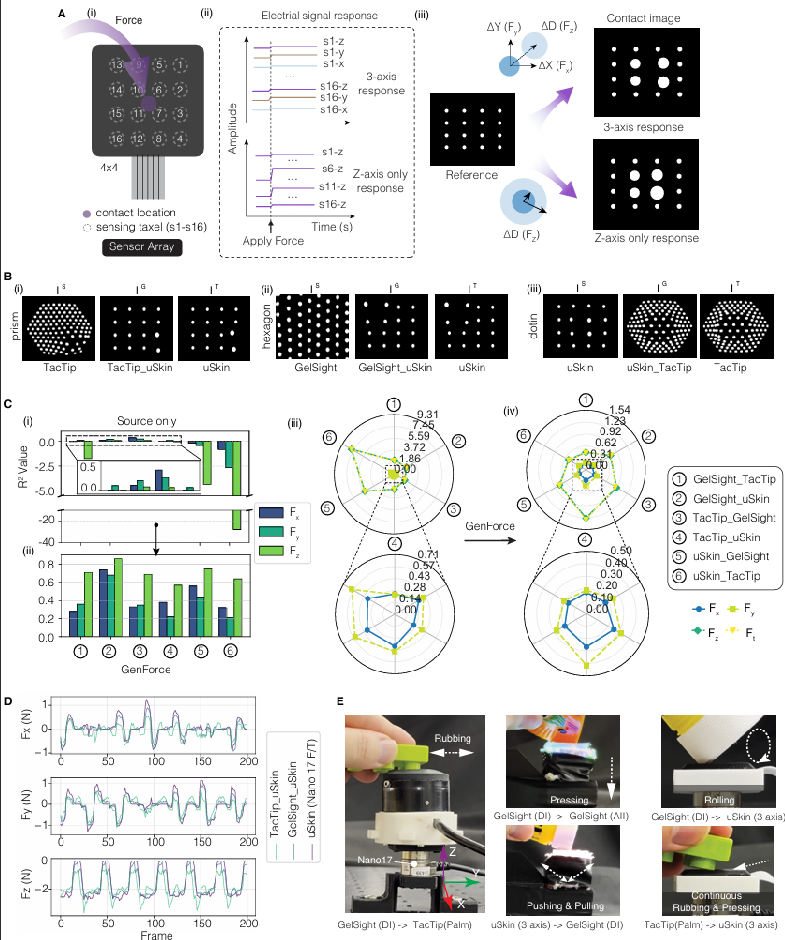

图6. 异构触觉力转换。

(A) 信号到标记转换过程。来自传感器阵列 (i) 的多通道电信号 (ii) 被统一转换为标记图像 (iii),以适应具有 3 轴传感能力或仅 z 轴传感能力的传感器。(B) M2M 转换后生成的触觉图像的代表性示例。(C) 𝑅2 值直方图 (i-ii) 和力 MAE 雷达图 (iii-iv),比较了仅源数据方法与具有材料补偿的 GenForce 模型。(D) 以 uSkin(3 轴)作为目标域,使用具有材料补偿的 GenForce 模型进行力预测的实时演示。(E) 使用 GenForce 模型在动态接触事件期间进行力预测,并与 ATI nano 17 F/T 传感器进行定性比较。

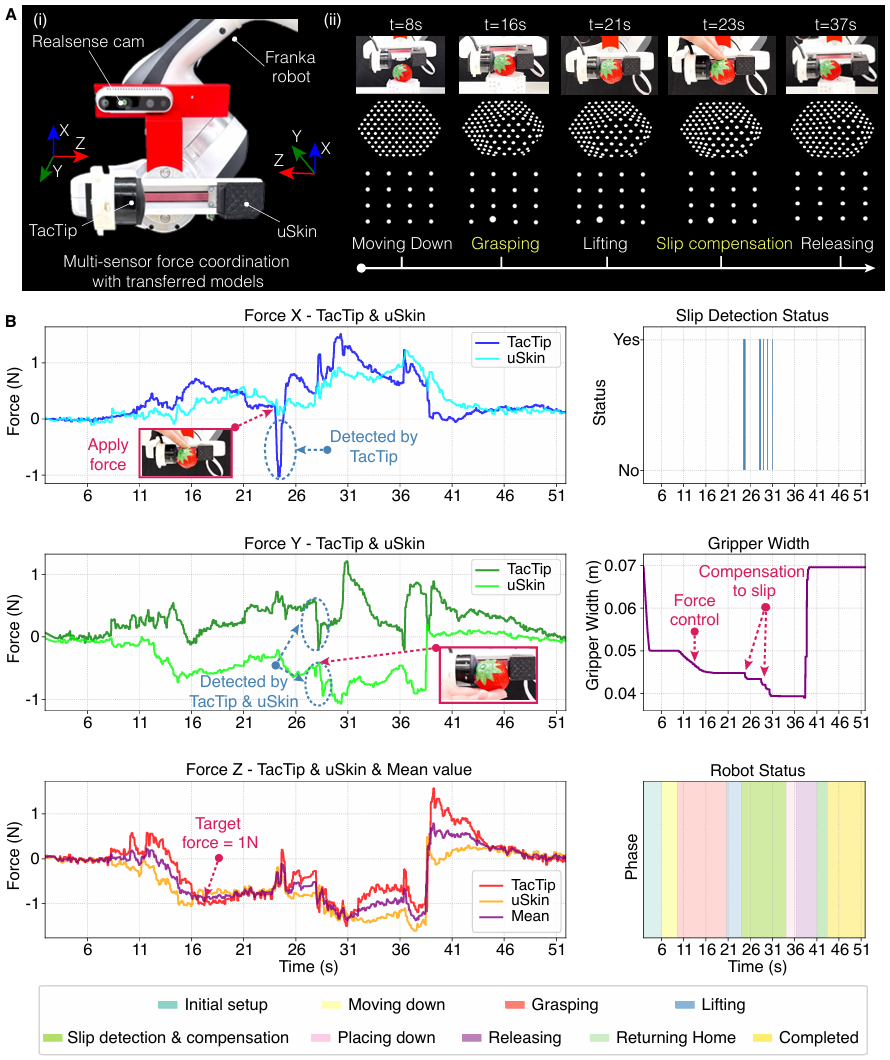

图7. 基于可迁移力传感的机器人抓取和滑移补偿。

(A)基于迁移力模型实现的多传感器力协调。(i)Franka机械手,左手指配备TacTip传感器,右手指配备uSkin传感器。(ii)图像序列展示了机器人使用力控制、滑移检测和滑移补偿抓取草莓的过程。(B)图 (A-ii) 所示抓取任务过程中力、滑移检测状态、夹爪宽度和机器人状态的实时测量数据。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)