GTC 2026拆解:NVLink 6.0——铜缆互联的终极进化

「智算X互联 AI-X OpenLab」专注智算互联产业和技术观察。最近几期里我们将从智算互联角度对NVIDIA GTC2 2026进行拆解。如感兴趣,请搜索关注「智算X互联 」公众号。

一、核心定位:让72个GPU像1个GPU那样工作

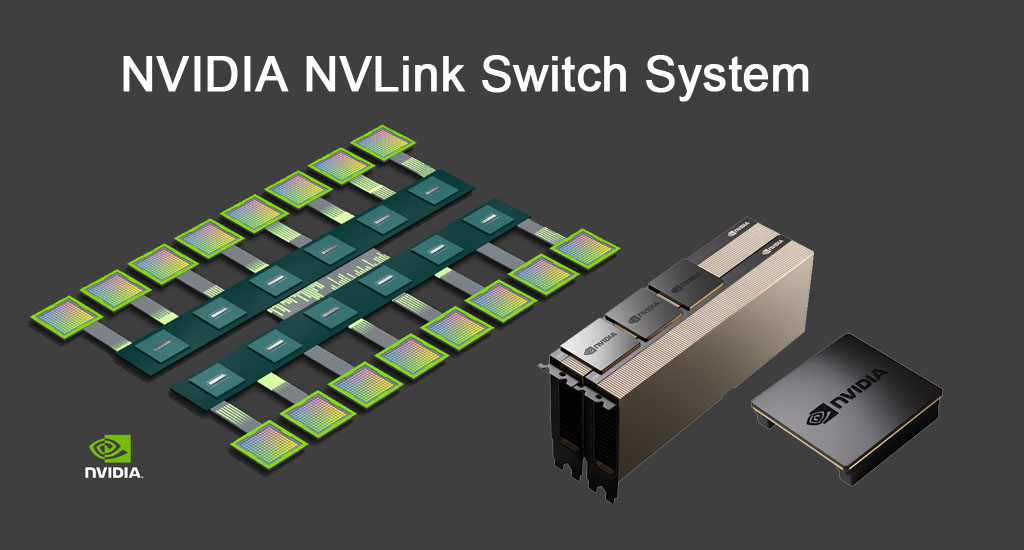

在GTC 2026发布的Vera Rubin平台中,NVLink 6.0扮演着关键角色——它不是简单的带宽升级,而是实现“机柜即计算机”愿景的核心技术。

为什么这个定位如此重要?

- 传统多GPU系统的瓶颈在于通信开销

- 72个GPU协同工作时,数据传输延迟严重影响效率

- NVLink 6.0通过全对等拓扑,让所有GPU如同一个巨型GPU内部的不同核心

二、技术参数:3.6TB/s的极致带宽

| 参数 | 规格 | 对比前代 |

|---|---|---|

| 单GPU双向带宽 | 3.6TB/s | 是NVLink 5.0(1.8TB/s)的2倍 |

| 机柜聚合带宽 | 260TB/s | 比整个互联网带宽还高 |

| 拓扑结构 | 全对等铜缆互联 | 零跳数通信 |

| 链路数量 | 36条/GPU | 比前代18条翻倍 |

关键突破:

- 带宽翻倍:采用更高阶SerDes和先进信号完整性技术

- 拓扑优化:全对等设计消除通信瓶颈

- 规模扩展:支持72GPU+36CPU的统一逻辑域

三、架构创新:不只是更快,而是更智能

3.1 全对等铜缆拓扑

- 直接点对点连接:每个GPU都能直接访问其他GPU

- 零跳数通信:数据无需经过中间节点转发

- 确定性延迟:通信时间可预测,适合实时应用

3.2 NVLink-C2C芯片间互联

- GPU与CPU统一内存池:HBM4(GPU)+ LPDDR5X(CPU)逻辑共享

- 1.8TB/s相干互联:CPU可直接为GPU提供海量内存扩展

- 突破显存限制:单卡可处理100万+ tokens的长上下文

3.3 NVLink 6 Switch内置计算

- SHARP引擎集成:每switch tray提供14.4 TFLOPS FP8计算能力

- 网络内计算:All-Reduce、Broadcast等操作直接在交换机完成

- 性能提升:网络拥塞降低50%,集合通信吞吐提升数倍

四、可靠性设计:工业级可用性

4.1 控制平面弹性

- 部分故障不影响整体:即使部分switch故障,机柜仍可运行

- 热插拔支持:switch tray支持在线更换,最大化系统uptime

- 逐步扩展:机柜可从32GPU逐步扩展到72GPU,无需停机重构

4.2 安装与维护简化

- 铜缆短距设计:相比光缆成本更低,安装更简单

- 安装时间从2天缩短到2小时:大幅降低部署成本

- 能效优势:整体功耗较传统多层PCIe方案显著降低

五、实际性能:不只是数字游戏

5.1 训练效率暴增

- MoE模型训练:只需Blackwell平台1/4的GPU数量

- 训练时间大幅缩短:相同模型完成时间减少60%以上

- 专家路由优化:MoE模型的expert routing像单GPU一样高效

5.2 推理性能突破

- 推理性能功耗比提升10倍:单位功耗下处理能力大幅提升

- 单token成本降为1/10:大规模部署的经济性显著改善

- 长上下文支持:百万token上下文在全机柜内零拷贝共享

5.3 Agentic AI友好

- 多智能体同步:智能体间状态同步延迟极低

- 实时工具调用:支持复杂的工具调用链

- RL反馈闭环:强化学习训练效率大幅提升

六、技术演进:从管道到计算底座

6.1 历史对比

NVLink 1.0 (2016): 160GB/s, Hybrid Mesh

NVLink 2.0 (2018): 300GB/s, NVSwitch引入

NVLink 3.0 (2020): 600GB/s, Ampere架构

NVLink 4.0 (2022): 900GB/s, Hopper架构

NVLink 5.0 (2024): 1.8TB/s, Blackwell架构

NVLink 6.0 (2026): 3.6TB/s, Vera Rubin平台

6.2 架构演进

- 从带宽竞争到全域coherency Fabric转型

- 从单纯高速链路升级为scale-up Fabric操作系统组件

- 从刚性拓扑进化成可在线演进的动态神经网络

七、系统集成:三层互联架构

7.1 Rubin平台三层互联

- NVLink 6:72卡统一域,3.6TB/s双向带宽

- NVLink-C2C:CPU-GPU一致性互联,1.8TB/s

- PCIe Gen6:生态兼容,提升I/O利用率

7.2 为什么是72卡?

- 物理限制:42U机柜+散热+布线的平衡点

- 软件效率:超过72卡需跨机架通信,引入网络延迟

- 带宽利用:小于72卡无法充分发挥NVLink 6优势

八、对开发者的意义

8.1 编程模型简化

- 统一内存视图:无需关心数据在哪个GPU

- 零拷贝tensor共享:数据移动开销几乎为零

- 硬件级集合通信:AllReduce等操作由硬件加速

8.2 应用场景扩展

- 大规模MoE训练:专家模型分布式训练效率大幅提升

- 长序列推理:支持100万+ tokens的上下文处理

- 多智能体系统:智能体间通信延迟降低到微秒级

8.3 性能透明提升

- 现有代码无需修改:硬件自动优化通信路径

- 确定性性能:通信延迟可预测,适合实时应用

- 弹性扩展:支持从32GPU到72GPU的平滑扩展

九、产业影响:重新定义服务器

9.1 服务器概念的演变

- 传统服务器:CPU为中心,GPU为加速卡

- Rubin平台:“超级芯片+机架级加速器”

- 根本变化:硬件-软件-生态层面的底层逻辑重构

9.2 性能对比

- 单机架性能:达传统方案10倍

- 能效比:提升5%以上

- TCO优势:总体拥有成本显著降低

9.3 技术趋势

- 系统思维取代服务器思维:关注整体效率而非单点性能

- 算力无限扩展:通过NVLink实现近乎线性的扩展

- 软件零改造:现有应用无需修改即可获得性能提升

十、总结:铜缆互联的终极形态

NVLink 6.0代表了铜缆互联技术的巅峰:

- 性能极致:3.6TB/s的单GPU带宽,260TB/s的机柜聚合带宽

- 可靠性工业级:热插拔、部分填充、控制平面弹性

- 经济性突破:安装时间从2天缩短到2小时,单token成本降至1/10

- 编程友好:统一内存视图,硬件加速集合通信

技术本质:NVLink 6.0不是简单的“更快”,而是通过全对等拓扑、网络内计算、韧性特性,让72GPU+36CPU真正成为一个逻辑上统一的巨型加速器。

产业意义:这标志着智算互联从“带宽竞争”向“全域coherency Fabric”转型的关键节点,为Agentic AI提供了最极致的scale-up底座。

展望:随着Rubin平台的推出,NVLink 6.0将重新定义高性能计算集群的构建方式,推动AI基础设施向更高效率、更低成本的方向发展。

注:本文基于GTC 2026公开资料及技术文档分析,实际产品规格以英伟达官方发布为准。NVLink 6.0随Vera Rubin平台于2026年上市。

「智算X互联 AI-X OpenLab」专注智算互联产业和技术观察。最近几期里我们将从智算互联角度对NVIDIA GTC2 2026进行拆解。如感兴趣,请搜索关注「智算X互联 」公众号。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)