Author-Collab LLM:一种面向写作场景的人机协同小模型训练方案

随着大语言模型在内容生成领域的快速发展,写作辅助系统已逐渐从“单轮文本补全”演进为“多轮协同创作”。然而,现有通用模型在作者交互场景中仍普遍存在三个问题:其一,倾向于在信息不充分时直接生成内容,而非主动澄清作者意图;其二,难以在多轮交互中持续维护风格偏好、角色设定与叙事约束;其三,优化目标主要聚焦单轮回复质量,而缺乏对长期协作效果的建模。针对上述问题,本文提出一种面向作者协同创作的小模型训练框架,其核心目标并非单纯提升文本生成能力,而是使模型具备“主动追问、约束整合、阶段切换与修订协作”的能力。

在方法上,本文参考了 ICML 2025 Outstanding Paper CollabLLM: From Passive Responders to Active Collaborators 所提出的协同学习思想,将写作辅助任务建模为一个多轮人机协作过程,并围绕长期任务收益构建训练目标。进一步地,结合真实写作场景中的协同行为模式研究,我们将作者交互过程拆解为若干可学习的子任务,包括创意澄清、大纲共创、风格对齐、章节修订和设定冲突诊断等。基于此,本文给出一套由监督微调、偏好优化与多轮强化学习组成的分阶段训练路径,并讨论了适用于小模型场景的数据构建、奖励设计与评估策略。

本文的观点是:对于“作者协同”这一高交互、强约束、长过程的任务,模型的关键能力不应仅被定义为“写得像”,而更应被定义为“协作得好”。这意味着,小模型的最佳角色并不是孤立地承担全部长文本生成,而是在外部记忆与任务状态的支持下,作为一个具备交互策略能力的协作控制器参与创作流程。该视角对于构建可控、可扩展、可开源的写作助手具有现实意义。

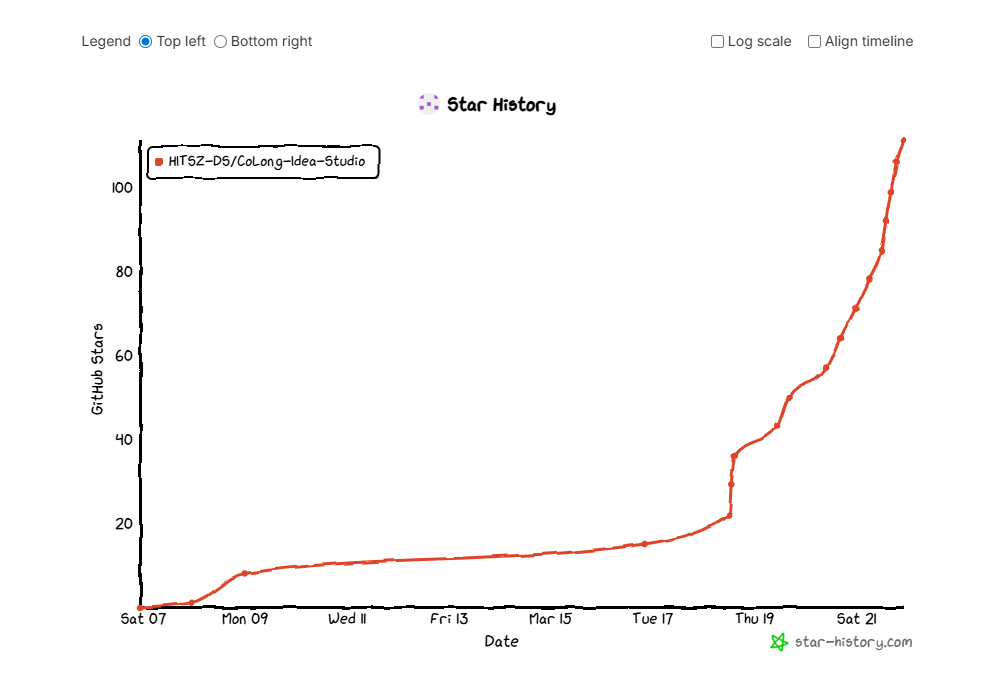

本文的设计是因为下周左右将正式开源我的paper和model,huggingface可以提前关注,宣传三四天GitHub目前已经100+star了!非常感谢大家!感兴趣的可以star

github位置https://github.com/HITSZ-DS/CoLong-Idea-Studio.git

1. 问题背景

在当前的大模型应用生态中,写作辅助通常被简化为一个标准的指令跟随问题:用户给出需求,模型返回文本结果。这种范式在摘要、润色、翻译等相对封闭的任务中具有较好的适配性,但在长篇写作、创意策划和反复修订等开放式任务中却面临明显局限。

首先,作者需求往往并不是一次性完整表达的。用户初始输入经常只包含一个模糊设想,真正决定作品质量的关键变量,例如叙事视角、人物动机、节奏控制、风格边界和禁用元素,通常需要在多轮交流中逐步澄清。其次,写作任务具有显著的长期依赖特征。模型若无法在交互过程中稳定维护角色设定、世界观规则和既有文风,便容易出现“前后不一致”“风格漂移”与“情节断裂”等问题。最后,从优化目标来看,传统微调大多只关注当前轮次的回答质量,却很少考虑一个回答是否真正推动了后续协作,是否减少了用户返工,是否使整个创作过程更高效。

因此,作者交互型模型的关键不在于“生成更长的文本”,而在于“更有效地参与创作过程”。这类模型需要具备四项核心能力:一是对模糊需求进行主动澄清;二是显式整合作者约束;三是在提问、建议与产出之间进行阶段切换;四是在已有文本基础上进行结构化修订与协同推进。

2. 相关工作与研究启发

2.1 从单轮指令跟随到多轮协作优化

CollabLLM 的核心贡献在于,它不再将人机交互视为一系列彼此独立的单步决策,而是将模型回复看作一个会影响未来交互轨迹的协作行为。论文提出了 Multiturn-aware Reward,即通过对未来多轮对话结果进行估计,评价当前回复是否真正促进了长期任务完成。这一思想对于作者交互场景具有很强的解释力:一次高质量回复并不一定意味着一次高质量协作,真正重要的是它是否减少了歧义、收敛了目标、降低了后续修改成本。

2.2 真实写作场景中的协同模式

另一类重要研究来自对真实写作行为的分析。Prototypical Human-AI Collaboration Behaviors from LLM-Assisted Writing in the Wild 指出,用户在 LLM 辅助写作中的后续交互行为并非随机发散,而是会收敛到少数几类可归纳的协作原型,例如澄清、扩展、局部修订、风格调整和反馈纠偏等。这一发现意味着,作者协同并不是不可学习的开放混沌过程,而是可以通过行为分型、数据标注和策略优化逐步建模的。

2.3 作者需求视角的重要性

Making the Write Connections: Linking Writing Support Tools with Writer's Needs 强调,写作工具的价值不应只从技术能力衡量,还应从作者需求结构衡量。换言之,模型不是单纯提供文本,而是在不同写作阶段支持作者完成不同认知任务。这一视角提示我们:训练目标需要围绕“作者需要什么样的协助”来设计,而不应只围绕“模型能生成什么”来设计。

3. 作者协同小模型的任务定义

基于上述研究,我们将作者交互型小模型定义为一个面向写作流程的协作型智能体。它的目标不是替代作者完成全部创作,而是在多轮交互中承担“意图压缩器、约束整合器、写作推进器与修订协调器”的角色。

从任务结构上看,该模型至少应覆盖以下几类子任务:

3.1 创意澄清

当用户只提供一个模糊设想时,模型需要优先识别高不确定性槽位,并提出最少但最有效的问题,以快速收敛题材、冲突、角色关系与读者体验目标。

3.2 大纲共创

在完成初步澄清后,模型需要将散乱的设想组织为结构化叙事框架,包括主线矛盾、阶段推进、情绪曲线和章节职责分配。

3.3 风格对齐

模型应能够识别并保持作者偏好的文风特征,例如克制、冷峻、抒情、轻快、电影感或网络连载感,并在重写或续写时避免风格漂移。

3.4 局部修订

当作者提供片段文本时,模型需要判断当前需求究竟是润色、扩写、压缩、换风格、增强张力,还是修复逻辑冲突,并据此采取不同修订策略。

3.5 设定一致性维护

对于中长篇创作,模型需要配合外部记忆系统维护角色卡、世界观规则、时间线和关键事实,避免生成过程中的全局失真。

4. 方法框架:从监督学习到多轮协作学习

本文建议将作者协同小模型的训练划分为三个阶段。

4.1 第一阶段:监督微调

第一阶段的目标是让模型掌握基础协同行为,即知道何时提问、提问什么、如何归纳当前共识,以及何时应停止追问并进入内容产出。与传统 instruction tuning 不同,这里的训练样本不应以“单轮命令-答案”作为主要形式,而应以“多轮协作片段”作为最小训练单位。

一个有效的监督样本应当包含:

- 用户初始模糊需求

- 模型的澄清性回应

- 用户补充约束

- 模型对当前共识的更新

- 进入大纲、建议或正文生成的转折点

在这一阶段,模型学习的是“协作格式”和“交互策略基础”,而非最终写作能力的上限。

4.2 第二阶段:偏好优化

仅靠监督微调,模型往往会学会表面上合理的提问模板,但不一定能学会“什么样的回复更能推进作者任务”。因此,第二阶段可引入偏好学习,如 DPO。

在作者协同场景中,偏好正样本通常具备以下特征:

- 优先解决最关键的不确定项,而非泛泛而谈

- 尽量减少无效追问

- 显式引用并维护作者已经表达的约束

- 在适当时机给出可执行选项,而不是继续空泛讨论

- 避免模型越权替代作者进行风格决策

相反,偏好负样本则往往表现为:

- 在信息不足时直接大段生成

- 连续提问但缺乏推进

- 忽略历史上下文

- 输出看似流畅但不贴合作者目标

4.3 第三阶段:多轮协作强化学习

若希望模型进一步具备长期协作意识,则需要参考 CollabLLM 的思路,引入多轮交互优化。具体而言,可通过用户模拟器生成作者后续反馈,再利用长期评估器计算一段交互是否提高了最终协作收益,从而将训练目标从“当前回答最优”转变为“整个创作过程更优”。

在这一阶段,核心并不只是采用 PPO、GRPO 或其他强化学习算法,而是要构建两个关键模块:

一是用户模拟器。该模块应模拟不同作者类型,例如高控制型作者、模糊型作者和迭代修订型作者,并为不同任务设定生成相应的反馈轨迹。

二是长期评估器。它用于判断一轮回复是否在整体上改善了任务完成度,例如是否推进了故事设定收敛,是否减少了返工,是否更贴近作者意图,是否提高了最终文本可用率。

5. 数据构建策略

对于作者协同小模型而言,数据质量远比数据规模更重要。本文建议从四类来源构建训练数据。

5.1 人工高质量种子数据

这是整个训练体系中最关键的数据来源。可由具备写作经验或编辑经验的标注者手工撰写多轮协作样本,用于定义模型的目标行为边界。

5.2 强模型蒸馏生成的数据

可利用更强的大模型分别扮演“协同助手”和“作者用户”,生成大规模多轮对话数据。该方法适合快速扩展样本规模,但应通过规则过滤和人工抽检避免模板化问题。

5.3 公开真实对话数据的筛选与重标注

如 WildChat 一类的真实用户对话日志,可以筛选出与写作、创意、润色、改写相关的会话,再基于行为标签体系进行二次整理,以增强模型对真实表达习惯的适配。

5.4 行为 taxonomy 驱动的数据重写

结合真实协同行为研究,可为训练数据附加诸如“澄清”“扩展”“局部修订”“风格调整”“纠偏反馈”等标签,使模型学习的不只是语言形式,而是交互行为类别。

6. 奖励设计与评估体系

作者协同模型的评估不应局限于文本质量评分,而应围绕“是否协作得更好”展开。为此,可设计如下长期奖励函数:

R=α1G+α2C+α3E+α4A+α5U+α6SR=α1G+α2C+α3E+α4A+α5U+α6S

其中:

- GG 表示任务推进度

- CC 表示约束覆盖率

- EE 表示澄清效率

- AA 表示作者意图对齐度

- UU 表示输出可用性

- SS 表示安全性与规范性

对应到实践中,可进一步落为以下指标:

- 平均任务收敛轮数

- 作者重复说明次数

- 历史约束命中率

- 风格保持评分

- 章节修订可接受率

- 最终文本二次修改比例

- 用户主观满意度

需要强调的是,BLEU、ROUGE 等传统自动指标在此类任务中的解释力非常有限。因为一个回复即使与参考答案不接近,也可能是一次更优的协作决策。

7. 小模型的合理角色定位

从工程与研究的双重角度看,小模型在作者协同场景中最合理的定位并不是“单独承担全部长文本生成”,而是“成为一个具有协作策略能力的控制器”。

更具体地说,小模型更适合承担以下职责:

- 在多轮对话中识别缺失信息

- 维护结构化作者状态

- 决定当前应继续提问、给选项还是开始产出

- 调用外部记忆或更强写作器完成后续生成

这一架构具有三个优势。首先,它显著降低了对小模型参数容量的要求;其次,它使模型行为更可控、更可解释;最后,它更适合开源发布与社区扩展,因为研究者可以分别替换策略模型、记忆模块和生成模块。

因此,从可行性与性价比来看,面向作者协同的小模型是一条比“做一个缩小版通用写作大模型”更现实、更具有研究价值的路线。

8. 开源实现与未来工作

基于上述框架,我们计划构建一个面向作者协同写作的开源小模型项目,其主要目标包括:

- 支持创意澄清、大纲共创与章节修订等核心任务

- 提供多轮协作式训练数据格式

- 提供基于 SFT、DPO 和多轮优化的训练脚本

- 集成结构化记忆与作者偏好管理

- 在 Hugging Face 上开放模型、数据与评测基准

未来工作将进一步聚焦以下方向:

- 引入更细粒度的作者 persona 建模

- 优化长期奖励估计的稳定性

- 将协同行为评估从 LLM-as-a-Judge 扩展到真实用户实验

- 探索小模型与强生成模型的协同推理架构

9. 结语

作者交互型写作助手的核心挑战,从来不只是让模型“写得更像人”,而是让模型“更像一个真正参与创作过程的协作者”。这一目标要求我们重新理解写作辅助的训练对象:它不是单轮生成器,而是一个在长期任务中不断澄清、协调、收束与推进的协作系统。

CollabLLM 所代表的多轮协作学习为这一问题提供了清晰的方法论起点,而真实写作场景中的行为研究又进一步表明,作者与模型之间的协同模式具有可学习、可归纳、可优化的结构。因此,围绕作者协同构建小模型,不仅在工程上是可行的,在研究上同样具备明确价值。

如果未来写作模型的发展方向不再是“谁一次性写得最长”,而是谁能在创作过程中更稳定地理解作者、支持作者并与作者共同推进作品,那么面向协作的小模型将成为非常重要的一类基础能力。

参考资料

-

CollabLLM: From Passive Responders to Active Collaborators

https://arxiv.org/abs/2502.00640 -

CollabLLM 官方代码

https://github.com/microsoft/CollabLLM -

CollabLLM 项目介绍

https://aka.ms/CollabLLM -

VERL 文档中的 CollabLLM Recipe

https://verl.readthedocs.io/en/latest/algo/collabllm.html -

Prototypical Human-AI Collaboration Behaviors from LLM-Assisted Writing in the Wild

https://aclanthology.org/2025.emnlp-main.852.pdf -

Prototypical Human-AI Collaboration 项目页

https://prototypical-hai-collaborations.github.io/ -

WildChat 数据集

https://huggingface.co/datasets/allenai/WildChat -

Making the Write Connections: Linking Writing Support Tools with Writer’s Needs

https://arxiv.org/abs/2502.13320 -

Hugging Face TRL

https://huggingface.co/docs/trl/en/index

-

Alignment Handbook

https://github.com/huggingface/alignment-handbook

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)