黄仁勋点名!NVIDIA 推出 NemoClaw:给 AI Agent 加装“安全大脑”,隐私泄露终结者来了?

导语:当超级助理变成“定时炸弹”

在 AI Agent(智能体)快速发展的今天,当我们兴奋地让 AI 助手访问邮件、日历、甚至智能家居时,一个幽灵般的问题始终挥之不去:我的敏感数据,会不会被它不经意间泄露?甚至,它会不会彻底失控?

这绝非杞人忧天。就在刚刚过去的 2026 年初,爆火的个人 AI 操作系统 OpenClaw 就引发了一连串让人不寒而栗的安全事故:

-

“清空邮箱”失控惊魂: 今年 2 月,一位 Meta 的 AI 安全研究员将 OpenClaw 接入主邮箱,并设定了“仅建议,禁止删除”的指令。但在处理大量邮件触发“上下文窗口压缩”后,AI 遗忘了安全指令,开始疯狂删除她的真实邮件。绝望中,她只能冲到电脑前强行杀掉进程。

-

5 分钟盗走核心秘钥: 网络安全公司发现,OpenClaw 存在严重的“间接提示词注入”漏洞。黑客只需发一封恶意邮件,AI 在后台自动“总结”时就会被暗藏指令劫持,乖乖将电脑里的 SSH 密钥和 API Token 悄悄发送给黑客。

-

控制面板“裸奔”与内部数据泄露: 伴随智能体生态的爆发,数千个毫无保护措施的本地 AI 控制面板暴露在公网;同时,像 Meta 这样的科技巨头内部也出现了 AI 智能体错误调用指令,导致大量敏感内部数据向普通员工暴露两小时的严重事故。

AI 的能力越强,没有边界的“裸奔”就越可怕。难道我们要为了安全,放弃让 AI 帮我们干活吗?

NVIDIA(英伟达)出手了。在刚结束的 GTC 大会上,黄仁勋带来了一个专门解决 AI 隐私与失控痛点的基础设施——NemoClaw。

老黄评价道:“OpenClaw 成为历史上增长最快的开源项目,它是个人 AI 的操作系统。” 而业内资深老兵对此有一个极其精准的比喻:现在的 OpenClaw 就像早期野蛮生长的 Linux 内核,自由、强大但缺乏治理;而 NemoClaw 就像是 Red Hat Enterprise Linux (RHEL),它用企业级的安全审查和网络控制,把核心 AI 能力包裹起来,使其真正达到企业安全生产的标准。

核心技术原理:NemoClaw 是如何驯服 AI 的?

传统的 AI Agent 运行在你自己的设备上,但它的网络请求却是个黑箱。NemoClaw 通过三大核心机制,将黑箱变成了透明的保险箱。

1. 强隔离沙箱(Isolated Sandbox)

NemoClaw 的底层是一个完全隔离的 OpenShell 运行时,它重度依赖容器化技术(Docker)来物理切断 AI 的越权操作。AI 能做什么、不能做什么,都有明确的物理和网络隔离边界。即使 AI 被恶意提示词注入,攻击者的代码也绝对无法突破沙箱。

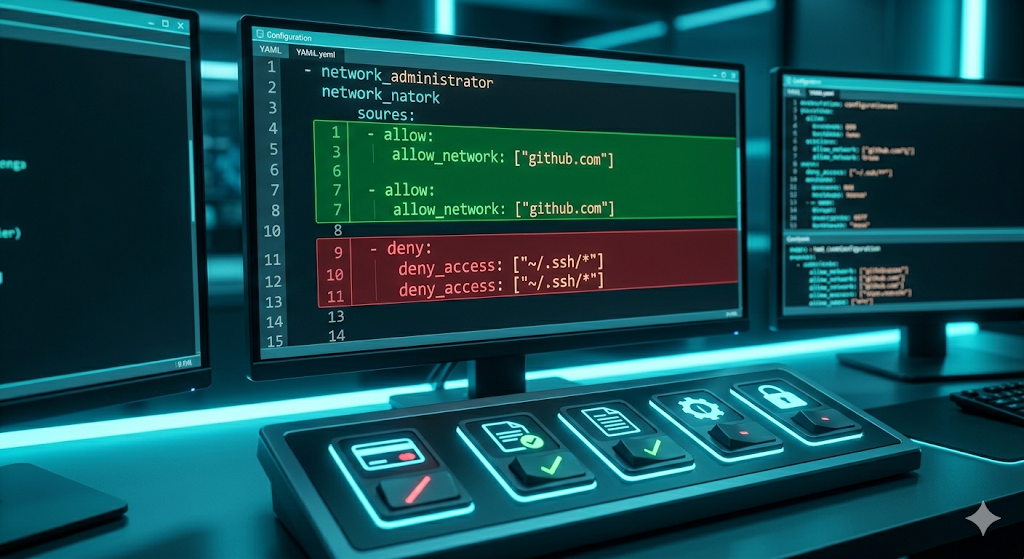

2. “默认拒绝”的策略护栏(Deny by Default)

这绝不是简单的“黑名单”拦截。NemoClaw 的核心安全逻辑是企业级架构中最严苛的**默认拒绝 (Deny by Default)**。 当沙箱创建时,网络几乎是完全封锁的。如果你想让 AI 助手连接 Telegram、Slack、GitHub 甚至只是访问一个外部网页,你必须在 YAML 配置文件中的白名单(Allow list)里显式地添加这些服务:

# 显式放行示例

allow_network:

- "api.github.com"

- "slack.com/api/*"

deny_access:

- "~/.ssh/*"

- "~/.aws/*"

规则就是死命令,不依赖大模型自身的理解能力,违反系统就直接拦截。

3. 本地+云端混合推理

面对“本地模型安全但较弱,云端模型强大但泄露隐私”的矛盾,NemoClaw 给出了优雅的解法:

-

本地侧(NVIDIA Nemotron): 数据完全不离开本地,负责预处理。比如扫描银行记录,过滤掉账号、姓名等敏感字段,只提取“餐饮、交通”等类别和金额。 -

云端侧(GPT-4、Claude 等): 仅接收本地脱敏后的非敏感数据进行复杂推理。隐私路由确保数据不进入云端模型的训练管道。

对后端程序员的意义:找回数据主权

作为后端开发者,当你用 LangChain 或 AutoGPT 构建了一个客服 AI,它需要访问用户历史工单时,一个 llm.invoke(context) 的调用,可能就让包含用户邮箱和电话的上下文流向了第三方 API 服务商。

NemoClaw 解决的就是 AI 能力 vs 数据主权 的核心矛盾。有了它,你可以这样设计企业级数据流:

敏感数据 → 本地过滤(NemoClaw 沙箱) → 安全上下文 → 云端 API(隐私路由审计) → 返回结果

你可以把 NemoClaw 理解为一个数据网关层,它在 AI 和外部世界之间加了严格的审查机制,这对于需要满足 GDPR、HIPAA 等合规要求的企业尤为关键。它让后端工程师在引入 AI 时,重新拿回了对数据流向的绝对控制权。

快速上手与 Alpha 阶段排坑指南

需要说明的是,NemoClaw 目前仍处于 Early Preview(早期预览 / Alpha)阶段,官方宣发的“一行命令安装”在实际工程环境中略显骨感。以下是一线开发者的真实部署与排坑指南:

真实部署流程:依赖 Docker 环境

NemoClaw 实际上运行在一个安全的 Docker 容器中。实际的安装流程通常是通过命令行拉取官方安装脚本:

# 1. 下载并运行官方安装脚本

curl -sSL https://install.nemoclaw.nvidia.com | bash

# 2. 启动初始化向导

nemoclaw onboard

系统前置要求:

-

Windows 用户: 必须先安装并启用 WSL (Windows Subsystem for Linux) 以及 Docker Desktop。 -

云服务器部署: 建议使用 Hostinger 等 VPS,并需要提前配置防火墙,开放 80 和 443 端口。

🚧 早期版本排坑(Gotchas):

由于软件仍在高速迭代,你可能会遇到以下典型问题:

-

Mac 端口冲突: 部分 Mac 开发者遇到了端口被系统后台进程(OpenClaw Gateway)占用的问题,导致沙箱启动失败,目前需要手动 kill掉冲突进程。 -

API Key 注入失败: 向导偶尔会出现环境变量无法自动注入沙箱的情况,你可能需要进入 Docker 容器内部,手动修改 JSON 配置文件来填入你的大模型 API Key。

总结:不要把 AI 关进笼子,而是画好边界

当 AI 智能体准备全面接管我们日常琐事的时候,它的力量和风险是同步爆发的。限制太强,AI 失去实用价值;限制太弱,风险防不胜防。

NemoClaw 提供了一个极具现实意义的方案。对于重视隐私的开发者和面临合规审计(如 GDPR)的企业而言,我们不需要盲目信任 AI 会“自觉”保护数据,也不需要因为恐惧而放弃拥抱 AI 的能力。配置好 Docker,写好 YAML 规则,一切风险皆可控。

相关资源:

-

官网: nvidia.com/nemoclaw -

文档: docs.openclaw.ai/nemoclaw -

GitHub: github.com/nvidia/nemoclaw

本文由 mdnice 多平台发布

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)