Microsoft开源BitNet.cpp:单CPU跑千亿大模型的工程实践指南

·

项目背景:为什么需要CPU推理框架?

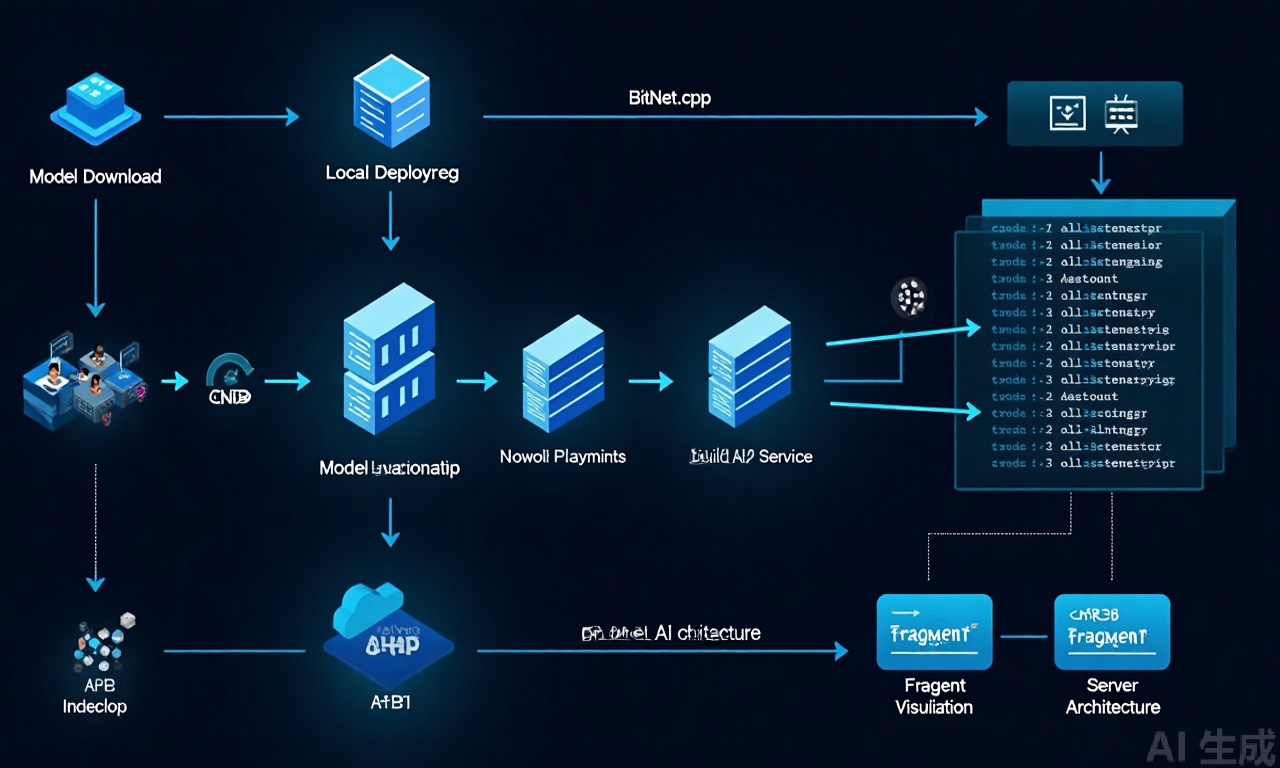

最近GitHub上有一个项目引发了热议:Microsoft开源的BitNet.cpp。短短几周内获得27k+ stars,这个项目实现了在普通CPU上运行千亿参数大模型的技术突破。

传统的AI推理依赖高端GPU,成本高且部署复杂。BitNet.cpp通过1-bit量化技术,让CPU推理成为现实,为开发者提供了新的部署选择。

技术架构:1-bit量化实现原理

1-bit量化核心原理

BitNet.cpp的核心技术是1-bit三元权重量化:

- 传统权重:32位浮点数(FP32)或16位浮点数(FP16)

- 1-bit量化:每个参数只有3种可能值:-1、0、+1

- 内存减少:90%以上的内存占用减少

内存压缩算法实现

BitNet.cpp实现了高效的内存压缩和解压缩算法:

- 压缩存储:权重矩阵被压缩为密集的位表示

- 实时解压:推理时动态还原计算精度

- CPU优化:AVX-512、SSE等指令集优化

性能对比数据

| 指标 | 传统FP16推理 | BitNet.cpp | 提升比例 |

|---|---|---|---|

| 内存占用 | 200GB | 20GB | 90%减少 |

| 百亿模型 | 需要多张A100 | 单台CPU服务器 | 成本大幅降低 |

| 延迟表现 | 受GPU内存影响 | 无数据传输开销 | 部分场景更优 |

支持模型与部署环境

支持的模型架构

- Llama系列:Llama 2/3(7B-70B参数)

- Mistral系列:多种参数规模

- Qwen系列:通义千问模型

- 多模态模型:部分开源版本

硬件要求与建议

- 最低配置:16GB内存,4核CPU

- 推荐配置:64GB内存,16核CPU

- 百亿模型:建议128GB+内存,高端CPU

详细部署步骤

安装与环境配置

步骤1:克隆仓库

git clone https://github.com/microsoft/BitNet.cpp.git

cd BitNet.cpp

步骤2:安装依赖

pip install -r requirements.txt

步骤3:编译项目

make -j$(nproc)

步骤4:下载模型

./download.sh llama2-7b

模型量化转换

自定义模型转换

python convert.py \

--model_path ./my_model \

--output_path ./my_model_bitnet \

--quantization_type ternary

转换参数说明

--quantization_type:量化类型(ternary/1.58-bit)--batch_size:转换批处理大小--precision:输出精度控制

API服务配置

启动HTTP API服务

./server -m ./models/llama2-7b -t 16 --api

服务参数详解

-m:模型路径-t:线程数(建议设置为CPU核心数)--api:启用HTTP API接口--port:服务端口(默认8000)

测试API接口

curl http://localhost:8000/v1/completions \

-H "Content-Type: application/json" \

-d '{

"model": "llama2-7b",

"prompt": "Explain quantum computing",

"max_tokens": 100

}'

企业级部署方案

容器化部署

Docker配置示例

FROM ubuntu:22.04

# 安装依赖

RUN apt-get update && apt-get install -y \

build-essential \

cmake \

python3-pip

# 复制项目文件

COPY BitNet.cpp /app/BitNet.cpp

# 编译

WORKDIR /app/BitNet.cpp

RUN make -j$(nproc)

# 启动命令

CMD ["./server", "-m", "/models/llama2-7b", "--api"]

Kubernetes部署配置

apiVersion: apps/v1

kind: Deployment

metadata:

name: bitnet-inference

spec:

replicas: 3

selector:

matchLabels:

app: bitnet

template:

metadata:

labels:

app: bitnet

spec:

containers:

- name: bitnet

image: bitnet-inference:latest

resources:

requests:

memory: "64Gi"

cpu: "8"

limits:

memory: "128Gi"

cpu: "16"

ports:

- containerPort: 8000

负载均衡配置

Nginx配置示例

upstream bitnet_servers {

least_conn;

server bitnet-1:8000;

server bitnet-2:8000;

server bitnet-3:8000;

}

server {

listen 80;

server_name api.example.com;

location / {

proxy_pass http://bitnet_servers;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

}

}

监控与日志

Prometheus监控指标

bitnet_memory_usage_bytes:内存使用量bitnet_inference_latency_seconds:推理延迟bitnet_tokens_per_second:生成速度bitnet_cpu_utilization:CPU利用率

日志配置示例

{

"log_level": "info",

"log_format": "json",

"log_file": "/var/log/bitnet/server.log",

"rotate_size": "100M",

"retain_days": 30

}

性能优化技巧

内存优化策略

交换空间配置

# 创建交换文件

sudo fallocate -l 64G /swapfile

sudo chmod 600 /swapfile

sudo mkswap /swapfile

sudo swapon /swapfile

# 永久生效

echo '/swapfile none swap sw 0 0' | sudo tee -a /etc/fstab

内存分配优化

- 调整

ulimit设置,增加文件描述符限制 - 配置透明大页(THP)优化内存访问

- 使用

numactl控制内存和CPU亲和性

CPU性能调优

多线程配置建议

- 线程数 = CPU物理核心数 × 2

- 避免超线程争用,合理分配计算任务

- 使用线程池管理,减少创建销毁开销

指令集优化

- 启用AVX-512指令集加速矩阵运算

- 使用SIMD优化向量化计算

- 内存对齐优化,提升缓存命中率

网络优化

API响应优化

- 启用HTTP/2协议,减少连接开销

- 配置合理的超时时间

- 启用压缩传输,减少网络负载

连接池管理

- 数据库连接池优化

- Redis连接复用

- 外部API调用批处理

应用场景与案例

实时对话系统

客服机器人部署

import requests

import json

class CustomerServiceBot:

def __init__(self, api_url="http://localhost:8000"):

self.api_url = api_url

def get_response(self, user_input):

payload = {

"model": "llama2-7b",

"prompt": f"作为客服机器人,回答用户问题:{user_input}",

"max_tokens": 200,

"temperature": 0.7

}

response = requests.post(

f"{self.api_url}/v1/completions",

json=payload

)

return response.json()["choices"][0]["text"]

文档处理系统

批量文档分析

from concurrent.futures import ThreadPoolExecutor

import os

class DocumentProcessor:

def __init__(self, model_path, num_workers=4):

self.num_workers = num_workers

def process_documents(self, document_paths):

with ThreadPoolExecutor(max_workers=self.num_workers) as executor:

results = list(executor.map(self.analyze_document, document_paths))

return results

def analyze_document(self, document_path):

# 读取文档内容

with open(document_path, 'r') as f:

content = f.read()

# 调用推理API

# ... 具体实现

return analysis_result

代码生成工具

IDE插件集成

// VS Code扩展配置

const vscode = require('vscode');

class BitNetCodeGen {

constructor() {

this.apiEndpoint = 'http://localhost:8000';

}

async generateCode(prompt, language) {

const requestBody = {

model: 'codellama-7b',

prompt: `用${language}语言实现:${prompt}`,

max_tokens: 500

};

const response = await fetch(`${this.apiEndpoint}/v1/completions`, {

method: 'POST',

headers: {'Content-Type': 'application/json'},

body: JSON.stringify(requestBody)

});

return await response.json();

}

}

故障排查与调试

常见问题解决

内存不足错误

# 检查内存使用

free -h

# 查看进程内存

top -o %MEM

# 调整内存限制

export OMP_NUM_THREADS=4 # 减少线程数

性能瓶颈分析

# 使用perf进行性能分析

perf record -g ./server -m model.gguf

perf report

# 火焰图生成

perf script | FlameGraph/stackcollapse-perf.pl | FlameGraph/flamegraph.pl > flame.svg

API连接问题

- 检查端口是否被占用:

netstat -tlnp | grep 8000 - 验证防火墙设置:

sudo ufw status - 测试网络连通性:

curl http://localhost:8000/health

调试日志分析

启用详细日志

./server -m ./model.gguf --log-level debug > debug.log 2>&1

日志分析要点

- 检查模型加载时间

- 分析推理延迟分布

- 监控内存分配模式

- 跟踪线程调度情况

总结与最佳实践

BitNet.cpp为CPU推理提供了实用的工程解决方案。通过1-bit量化技术,大幅降低了AI模型部署的门槛。

部署建议

- 根据模型大小合理配置硬件资源

- 使用容器化部署确保环境一致性

- 实施监控告警,及时发现性能问题

- 定期优化配置,适应业务增长

性能调优要点

- 内存配置是关键,确保足够的物理内存

- 多线程优化可以显著提升吞吐量

- 网络优化减少API调用延迟

- 监控分析指导持续优化

随着技术的不断成熟,CPU推理将在更多场景中发挥重要作用。开发者应该掌握这些工程实践,为未来的AI应用部署做好准备。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)