TPAMI 2025 | SHIP : 基于协同高阶交互的多模态图像融合方法

[IEEE TPAMI 2025] | Probing Synergistic High-Order Interaction for Multi-Modal Image Fusion:基于协同高阶交互的多模态图像融合方法

01 论文信息

- 论文题目: Probing Synergistic High-Order Interaction for Multi-Modal Image Fusion

- 论文作者: Man Zhou, Naishan Zheng, Xuanhua He, Danfeng Hong (Senior Member, IEEE), Jocelyn Chanussot (Fellow, IEEE)

- 发表单位: Man Zhou(中国科学院空天信息创新研究院);Naishan Zheng、Xuanhua He(中国科学技术大学);Danfeng Hong(中国科学院空天信息创新研究院、中国科学院大学);Jocelyn Chanussot(法国Inria、CNRS、格勒诺布尔理工学院)

- 发表会议: https://ieeexplore.ieee.org/document/10706703

- 代码链接: https://github.com/zheng980629/SHIP

02 论文主要贡献

- 该研究首次在多模态图像融合领域探索高阶交互建模,提出了协同高阶交互范式(Synergistic High-order Interaction Paradigm, SHIP),通过融合空间和通道双维度的高阶交互,系统性探究多模态图像间的协同关联,突破了现有方法仅捕捉二阶空间交互的局限。

- SHIP范式深入挖掘了空间细粒度和全局统计层面的高阶交互,能够协同聚合多源模态的互补信息,同时有效区分不同模态间的相互依赖关系,充分发挥多模态数据的协同效应。

- 在SHIP基础上提出增强版模型SHIP++,通过跨阶注意力演化、跨阶信息融合、残差信息记忆三大机制提升跨模态信息交互表征能力,大幅优化融合效果。

- 在**红外与可见光图像融合(VIF)和全色锐化(pan-sharpening)**两大核心多模态图像融合任务的多个公开基准数据集上开展了全面的定量和定性实验,验证了SHIP/SHIP++相较于当前SOTA方法的优越性,同时通过消融实验明确了各模块的有效性和作用机制。

- 基于CVPR 2024的会议版工作进行了大幅扩展,新增了跨阶信息整合、残差信息记忆等核心模块,补充了更多实验验证和特征可视化分析,深入阐释了高阶交互的内在机理。

03 论文创新点

- 双维度高阶交互建模:首次在多模态图像融合中同时实现空间维度和通道维度的高阶交互建模,解决了现有Transformer类方法仅捕捉二阶空间交互、忽略通道高阶交互的问题,充分挖掘多模态数据的协同潜力。

- 高效空间高阶交互实现:利用卷积定理将自注意力中计算昂贵的矩阵乘法转化为频域的逐元素乘法,在保证计算效率的前提下,通过迭代聚合互补信息实现任意阶的空间细粒度高阶交互,平衡了模型性能与计算成本。

- 高阶通道交互扩展:在SE块基于**一阶统计(均值)**的通道交互基础上,将其扩展为高阶通道交互形式,基于全局统计探究多模态间的深层依赖,提升了模型对通道维度模态关联的辨别能力。

- SHIP++三大增强机制:设计残差信息记忆、跨阶信息融合、跨阶注意力演化机制,分别实现了主模态关键信息的保留、不同阶数互补特征的整合、各层注意力图的知识共享与精准引导,进一步强化跨模态信息交互。

- 任务专属损失函数设计:针对红外与可见光图像融合设计了显著性感知的强度损失和最大梯度聚合的纹理损失,针对全色锐化设计了L1损失,贴合不同融合任务的特性,引导模型学习更有效的融合特征。

04 方法

4.1 整体框架

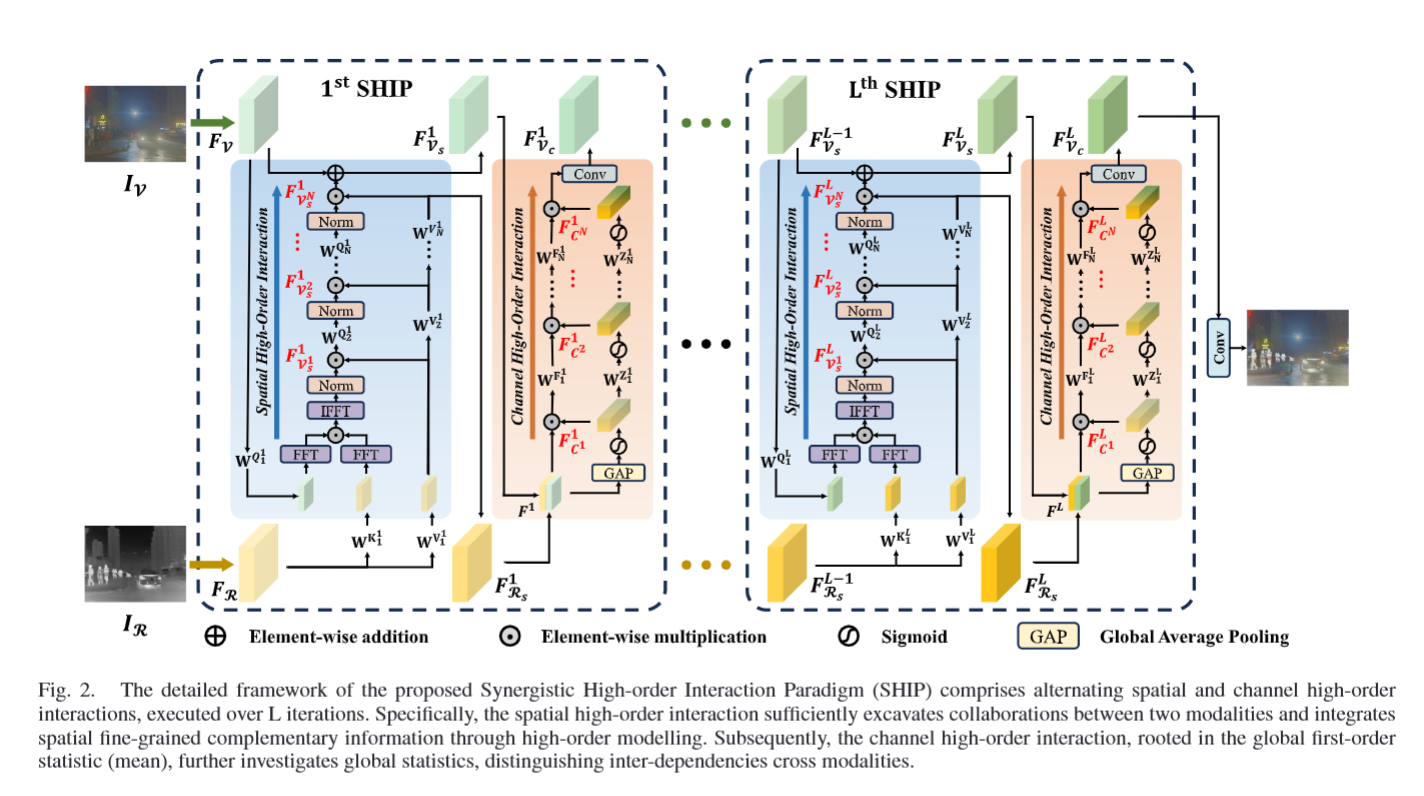

SHIP的整体框架以交替执行空间和通道高阶交互为核心,通过L次迭代完成多模态特征的协同聚合与依赖区分,整体流程适用于红外与可见光图像融合、全色锐化两大任务,仅在输入模态和最终输出层存在细微差异。

- 特征提取:对不同模态的输入图像分别通过独立的卷积层提取浅层模态感知特征 F R F_R FR和 F V F_V FV;

- 高阶交互迭代:将提取的特征输入SHIP核心模块,交替执行N阶空间高阶交互和N阶通道高阶交互,共进行L次迭代,充分挖掘多模态间的空间细粒度关联和全局统计关联;

- 图像重建:将完成高阶交互的融合特征投影回图像空间,生成最终的融合图像。

整体范式的数学表达为:

- 红外与可见光图像融合: I F = S H I P L ( ψ ( I R ) , ϕ ( I V ) ) I_{\mathcal{F}}=SHIP_{L}\left(\psi\left(I_{\mathcal{R}}\right), \phi\left(I_{\mathcal{V}}\right)\right) IF=SHIPL(ψ(IR),ϕ(IV))

- 全色锐化: I F = S H I P L ( ψ ( I P ) , ϕ ( I M ) ) + I M I_{F}=SHIP_{L}(\psi(I_{P}), \phi(I_{M}))+I_{M} IF=SHIPL(ψ(IP),ϕ(IM))+IM

其中 ψ ( ⋅ ) \psi(\cdot) ψ(⋅)和 ϕ ( ⋅ ) \phi(\cdot) ϕ(⋅)为特征提取器,L为SHIP迭代次数, I R / I V I_R/I_V IR/IV为红外/可见光图像, I P / I M I_P/I_M IP/IM为全色/多光谱图像。

4.2 高阶空间交互

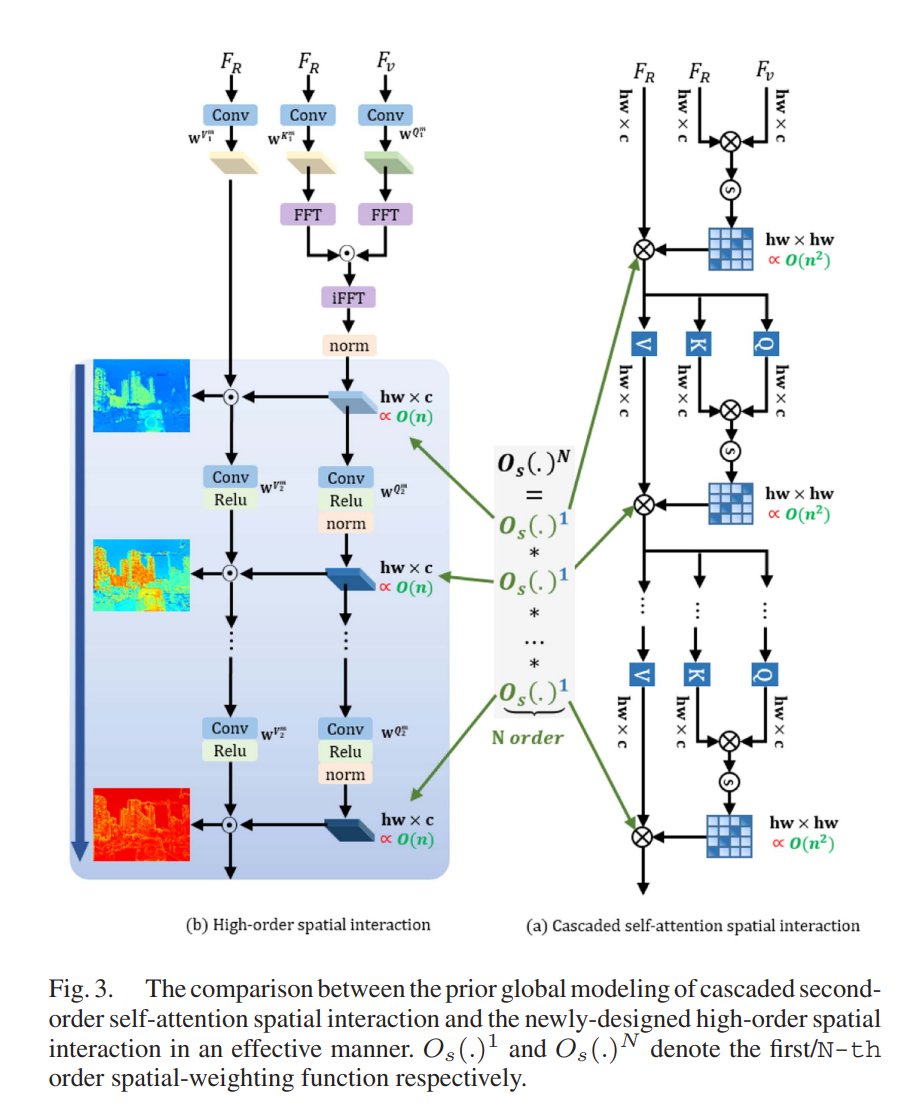

高阶空间交互的设计核心是将传统Transformer的二阶空间交互扩展为任意阶(N阶),同时通过频域变换降低计算复杂度,解决传统级联自注意力仅生成多二阶交互、计算开销大的问题,分为重新审视自注意力、等效高效形式、高阶形式探究三部分。

4.2.1 重新审视自注意力(传统二阶交互的局限)

Transformer的自注意力机制是二阶空间交互的典型实现,其通过查询(Q)、键(K)、值(V)的矩阵乘法捕捉特征间的空间关联,对于VIF任务,Q/K/V的生成公式为:

Q = F V W Q , K = F R W K , V = F R W V Q=F_{\mathcal{V}} W^{Q}, K=F_{\mathcal{R}} W^{K}, V=F_{\mathcal{R}} W^{V} Q=FVWQ,K=FRWK,V=FRWV

其中, W Q 、 W K 、 W V W^Q、W^K、W^V WQ、WK、WV为线性变换矩阵,分别将可见光特征 F V F_V FV、红外特征 F R F_R FR投影到查询、键、值空间。

自注意力的二阶空间交互实现公式为:

O S ( ( F V ) 2 ) = F V S 1 = s o f t m a x ( Q ⊗ K T d k ) ⊗ V = A ⊗ V \mathcal{O}_{S}\left(\left(F_{\mathcal{V}}\right)^{2}\right)=F_{\mathcal{V}_{S}}^{1}=softmax\left(\frac{Q \otimes K^{T}}{\sqrt{d_{k}}}\right) \otimes V=A \otimes V OS((FV)2)=FVS1=softmax(dkQ⊗KT)⊗V=A⊗V

其中, d k d_k dk为键K的维度, ⊗ \otimes ⊗为点积操作, A ∈ R H W × H W A \in \mathbb{R}^{HW ×HW} A∈RHW×HW为空间相关矩阵, O S ( ( F V ) 2 ) \mathcal{O}_{S}\left(\left(F_{\mathcal{V}}\right)^{2}\right) OS((FV)2)表示捕捉到 F V F_V FV二阶空间交互的输出特征。

核心局限:①矩阵乘法为二次时间复杂度,直接级联会带来巨大计算开销;②级联自注意力仅能生成多个二阶交互,无法实现真正的高阶建模(公式6),难以挖掘深层空间关联。

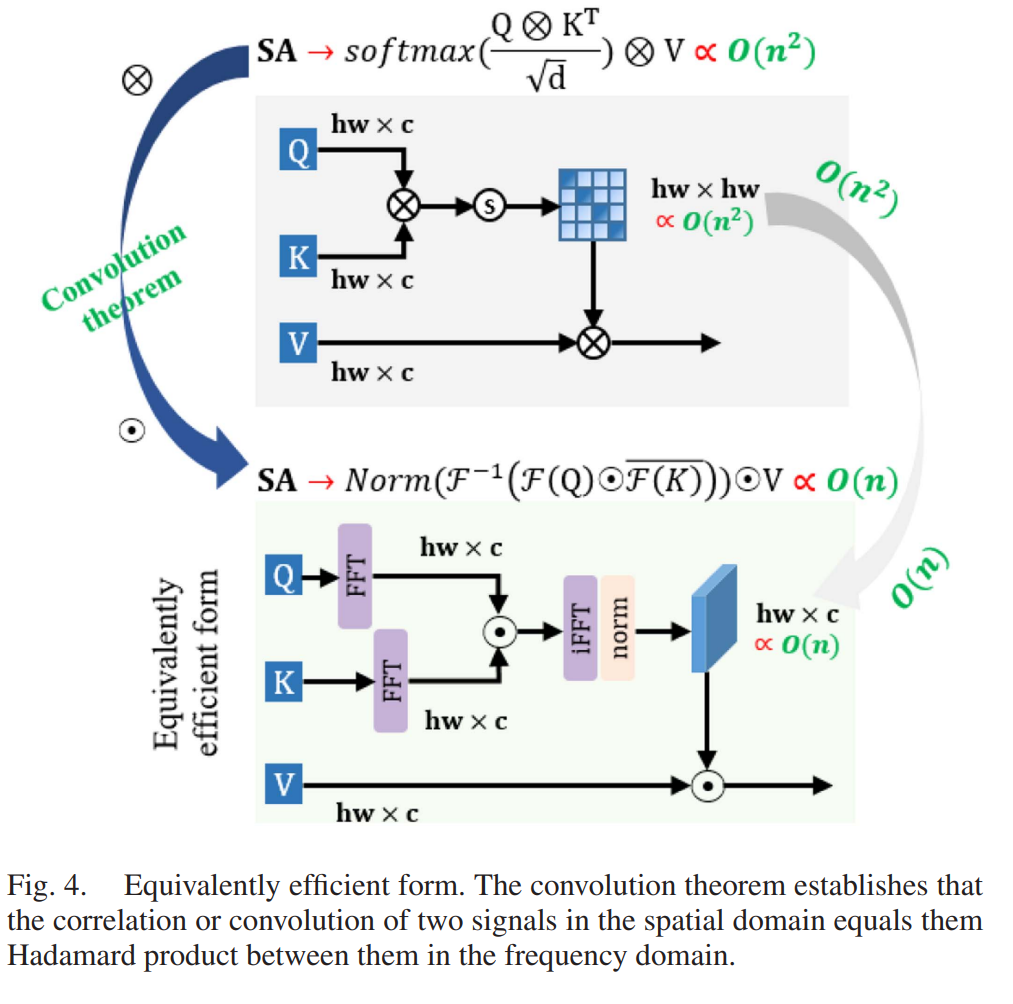

4.2.2 等效高效形式(频域变换降低计算复杂度)

利用卷积定理(空间域的相关/卷积操作 ≡ 频域的哈达玛积操作),将自注意力中的矩阵点积转化为频域逐元素乘法,大幅降低计算复杂度,同时保持空间关联捕捉的有效性。

第一步:将模态特征 F V 、 F R F_V、F_R FV、FR通过快速傅里叶变换(FFT)映射到频域,计算频域相关矩阵 A A A:

A = F − 1 ( F ( F V W Q ) ⊙ F ( F R W K ) ‾ ) A=\mathcal{F}^{-1}\left(\mathcal{F}\left(F_{\mathcal{V}} W^{Q}\right) \odot \overline{\mathcal{F}\left(F_{\mathcal{R}} W^{K}\right)}\right) A=F−1(F(FVWQ)⊙F(FRWK))

其中, F ( ⋅ ) \mathcal{F}(\cdot) F(⋅)为FFT变换, F − 1 ( ⋅ ) \mathcal{F}^{-1}(\cdot) F−1(⋅)为逆FFT变换, ⊙ \odot ⊙为哈达玛积(逐元素乘法), F ( ⋅ ) ‾ \overline{\mathcal{F}(\cdot)} F(⋅)为频域特征的共轭转置。

第二步:通过层归一化(Norm)和哈达玛积得到二阶空间交互的等效高效特征:

O S ( ( F V ) 2 ) = F V S 1 = N o r m ( A ) ⊙ ( F R W V ) \mathcal {O}_{S}\left( (F_{\mathcal {V}})^{2}\right) =F_{\mathcal {V}_{S}}^{1}=Norm(A)\odot \left( F_{\mathcal {R}}W^{V}\right) OS((FV)2)=FVS1=Norm(A)⊙(FRWV)

该形式将矩阵乘法的二次复杂度转化为FFT的 O ( H W l o g ( H W ) ) O(HWlog(HW)) O(HWlog(HW))复杂度,在高分辨率特征处理中计算效率提升显著。

4.2.3 高阶形式探究(N阶空间交互的实现)

在频域等效形式的基础上,通过迭代聚合互补信息将二阶空间交互扩展为任意N阶,实现真正的高阶空间建模,核心公式为:

O S ( ( F V i − 1 ) j ) = F V S j i = N o r m ( F V S j − 1 i W Q j i ) ⊙ ( F R S j − 1 i W V j i ) \mathcal{O}_{S}\left(\left(F_{\mathcal{V}}^{i-1}\right)^{j}\right)=F_{\mathcal{V}_{S}^{j}}^{i}=Norm\left(F_{\mathcal{V}_{S}^{j-1}}^{i} W^{Q_{j}^{i}}\right) \odot\left(F_{\mathcal{R}_{S}^{j-1}}^{i} W^{V_{j}^{i}}\right) OS((FVi−1)j)=FVSji=Norm(FVSj−1iWQji)⊙(FRSj−1iWVji)

F V S j − 1 i = N o r m ( F V S j − 2 i W Q j − 1 i ) , F R S j − 1 i = F R S j − 2 i W V j − 1 i F_{\mathcal{V}_{S}^{j-1}}^{i}=Norm\left(F_{\mathcal{V}_{S}^{j-2}}^{i} W^{Q_{j-1}^{i}}\right), F_{\mathcal{R}_{S}^{j-1}}^{i}=F_{\mathcal{R}_{S}^{j-2}}^{i} W^{V_{j-1}^{i}} FVSj−1i=Norm(FVSj−2iWQj−1i),FRSj−1i=FRSj−2iWVj−1i

其中, 2 ≤ j ≤ N 2 ≤j ≤N 2≤j≤N(j为当前阶数), 1 ≤ i ≤ L 1 ≤i ≤L 1≤i≤L(i为当前迭代次数), W Q j i 、 W V j i W^{Q_{j}^{i}}、W^{V_{j}^{i}} WQji、WVji为第i次迭代、第j阶的线性变换矩阵。

传统级联自注意力的特征演化仅为多二阶交互:

F V → O S ( ( F V ) 2 ) → F V S 1 → O S ( ( F V S 1 ) 2 ) → . . . → O S ( ( F V S L − 1 ) 2 ) → F V S L F_{\mathcal{V}} \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}}\right)^{2}\right) \to F_{\mathcal{V}_{S}}^{1} \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}_{\mathcal{S}}}^{1}\right)^{2}\right) \to ... \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}_{S}}^{L-1}\right)^{2}\right) \to F_{\mathcal{V}_{S}}^{L} FV→OS((FV)2)→FVS1→OS((FVS1)2)→...→OS((FVSL−1)2)→FVSL

而SHIP的高阶空间交互为每次迭代均实现N阶交互:

F V → O S ( ( F V ) N ) → F V S 1 → O S ( ( F V S 1 ) N ) → . . . → O S ( ( F V S L − 1 ) N ) → F V S L F_{\mathcal{V}} \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}}\right)^{N}\right) \to F_{\mathcal{V}_{\mathcal{S}}}^{1} \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}_{\mathcal{S}}}^{1}\right)^{N}\right) \to ... \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}_{S}}^{L-1}\right)^{N}\right) \to F_{\mathcal{V}_{\mathcal{S}}}^{L} FV→OS((FV)N)→FVS1→OS((FVS1)N)→...→OS((FVSL−1)N)→FVSL

核心优势:不同阶数的空间交互能捕捉不同粒度的互补特征模式,高阶特征能更精准地突出显著目标,提升特征表示的多样性。

4.3 高阶通道交互

高阶通道交互以Squeeze-and-Excitation (SE)块为基础,将SE块基于一阶全局统计(均值)的一阶通道交互扩展为N阶高阶形式,实现对多模态全局统计层面深层依赖的挖掘,分为重新审视SE块、高阶形式探究两部分。

4.3.1 重新审视SE块(传统一阶通道交互的局限)

SE块是一阶通道交互的典型实现,其通过全局均值池化提取一阶统计特征,实现通道响应的自适应校准,对于VIF任务的第i次空间高阶交互输出特征,SE块的实现公式为:

Z i = 1 H × W ∑ x = 1 H ∑ y = 1 W F i ( x , y ) Z^{i}=\frac{1}{H × W} \sum_{x=1}^{H} \sum_{y=1}^{W} F^{i}(x, y) Zi=H×W1x=1∑Hy=1∑WFi(x,y)

O C ( ( F i ) 1 ) = F C i = σ ( W Z 1 i Z i ) ⋅ F i \mathcal {O}_{C}\left( \left( F^{i}\right) ^{1}\right) =F_{C}^{i}=\sigma \left( W^{Z_{1}^{i}}Z^{i}\right) \cdot F^{i} OC((Fi)1)=FCi=σ(WZ1iZi)⋅Fi

其中, F i = c o n c a t [ F V S i , F R S i ] F^{i}=concat[F_{V_{S}}^{i}, F_{R_{S}}^{i}] Fi=concat[FVSi,FRSi]为第i次空间交互后的双模态特征拼接结果, Z i Z^i Zi为一阶全局统计特征(均值), σ ( ⋅ ) \sigma(\cdot) σ(⋅)为Sigmoid激活函数, W Z 1 i W^{Z_{1}^{i}} WZ1i包含两层线性变换+ReLU激活, ⋅ \cdot ⋅为逐元素乘法, O C ( ( F i ) 1 ) \mathcal {O}_{C}\left( \left( F^{i}\right) ^{1}\right) OC((Fi)1)为一阶通道交互的输出特征。

核心局限:仅基于一阶统计(均值)捕捉通道浅层依赖,无法挖掘多模态间基于高阶全局统计的深层通道关联,对模态间依赖的辨别能力不足。

4.3.2 高阶形式探究(N阶通道交互的实现)

在SE块的基础上,通过迭代计算高阶统计特征和通道校准,将一阶通道交互扩展为N阶高阶形式,实现对多模态深层通道依赖的捕捉,核心公式为:

O C ( ( F i ) j ) = F C j i = σ ( W Z j i Z j − 1 i ) ⋅ ( W F j i F j − 1 i ) \mathcal {O}_{C}\left( \left( F^{i}\right) ^{j}\right) =F_{C^{j}}^{i}=\sigma \left( W^{Z_{j}^{i}}Z_{j-1}^{i}\right) \cdot \left( W^{F_{j}^{i}}F_{j-1}^{i}\right) OC((Fi)j)=FCji=σ(WZjiZj−1i)⋅(WFjiFj−1i)

Z j − 1 i = σ ( W F j − 1 i Z j − 2 i ) , F j − 1 i = W F j − 1 i F j − 2 i Z_{j-1}^{i}=\sigma\left(W^{F_{j-1}^{i}} Z_{j-2}^{i}\right), F_{j-1}^{i}=W^{F_{j-1}^{i}} F_{j-2}^{i} Zj−1i=σ(WFj−1iZj−2i),Fj−1i=WFj−1iFj−2i

其中, 2 ≤ j ≤ N 2 ≤j ≤N 2≤j≤N(j为当前阶数), 1 ≤ i ≤ L 1 ≤i ≤L 1≤i≤L(i为当前迭代次数), W Z j i 、 W F j i W^{Z_{j}^{i}}、W^{F_{j}^{i}} WZji、WFji为第i次迭代、第j阶的线性变换矩阵, Z j − 1 i Z_{j-1}^{i} Zj−1i为第j-1阶全局统计特征, F j − 1 i F_{j-1}^{i} Fj−1i为第j-1阶通道校准特征。

最终,通过卷积层将N阶通道交互的输出特征 F C i F_{C}^{i} FCi整合为融合模态特征 F v c i F_{v_{c}}^{i} Fvci,进入下一次迭代的空间高阶交互。

4.3.3 空间-通道高阶交互链

通过L次迭代的N阶空间+通道高阶交互,形成完整的双维度高阶交互链,实现多模态特征的逐层优化,核心公式为:

F V → O S ( ( F V ) N ) → O C ( ( F V S 1 ) N ) → O S ( ( F V S 1 ) N ) → O C ( ( F V S 2 ) N ) → . . . → O S ( ( F V C L − 1 ) N ) → O C ( ( F V S L ) N ) F_{\mathcal{V}} \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}}\right)^{N}\right) \to \mathcal{O}_{C}\left(\left(F_{\mathcal{V}_{S}}^{1}\right)^{N}\right) \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}_{\mathcal{S}}}^{1}\right)^{N}\right) \to \mathcal{O}_{C}\left(\left(F_{\mathcal{V}_{S}}^{2}\right)^{N}\right) \to ... \to \mathcal{O}_{S}\left(\left(F_{\mathcal{V}_{C}}^{L-1}\right)^{N}\right) \to \mathcal{O}_{C}\left(\left(F_{\mathcal{V}_{S}}^{L}\right)^{N}\right) FV→OS((FV)N)→OC((FVS1)N)→OS((FVS1)N)→OC((FVS2)N)→...→OS((FVCL−1)N)→OC((FVSL)N)

4.4 SHIP++的核心改进模块

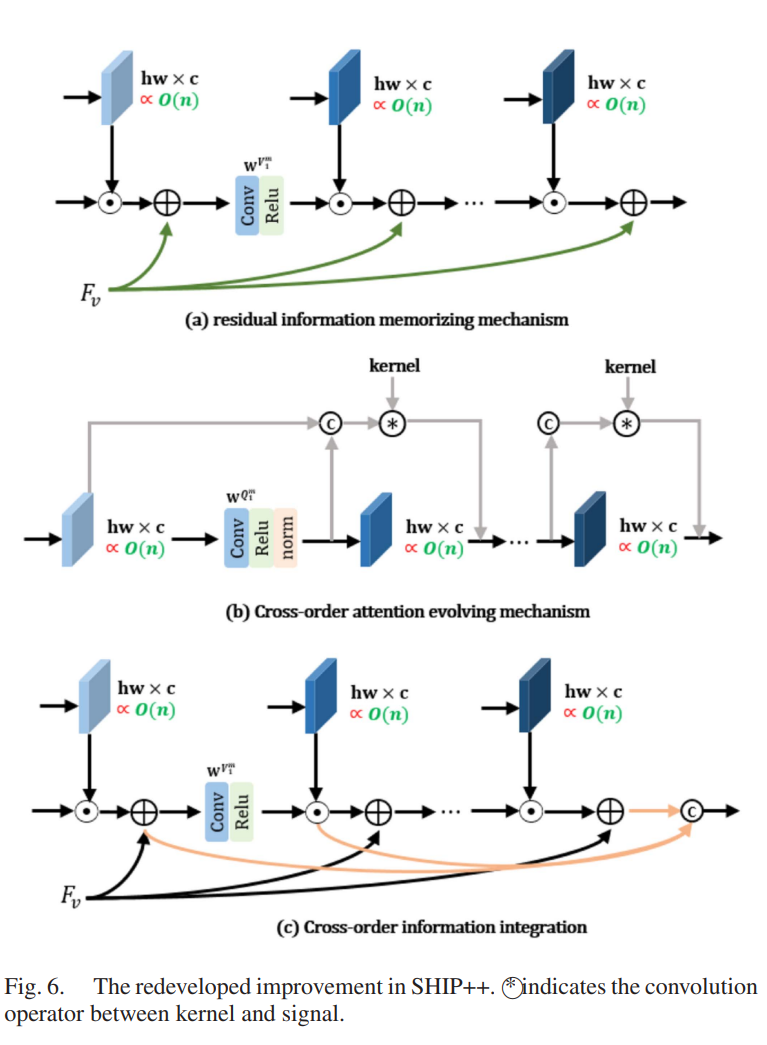

SHIP++在SHIP基础上,针对主模态信息丢失、不同阶数特征互补、注意力图精准性不足三大问题,设计**残差信息记忆(RIM)、跨阶信息整合(COII)、跨阶注意力演化(COAE)**三大核心机制,进一步提升跨模态信息交互能力,所有机制均适配VIF和全色锐化两大任务。

4.4.1 残差信息记忆(Residual Information Memorizing, RIM)

设计背景:VIF中的可见光图像、全色锐化中的多光谱图像为主模态,包含任务所需的核心信息,但传统迭代过程中主模态特征易被覆盖,导致细节丢失。

核心思路:通过残差连接将主模态原始特征与迭代过程中的特征融合,在每次迭代中保留主模态关键信息。

数学公式:

F V s j i − 1 ← C o n v ( F V s j i − 1 + F V ) F_{\mathcal{V}_{s}^{j}}^{i-1} \leftarrow Conv\left(F_{\mathcal{V}_{s}^{j}}^{i-1}+F_{\mathcal{V}}\right) FVsji−1←Conv(FVsji−1+FV)

其中, F V s j i − 1 F_{\mathcal{V}_{s}^{j}}^{i-1} FVsji−1为第i-1次迭代、第j阶的主模态特征, F V F_V FV为主模态原始特征,Conv为卷积层(用于特征融合与维度匹配)。

4.4.2 跨阶信息整合(Cross-Order Information Integration, COII)

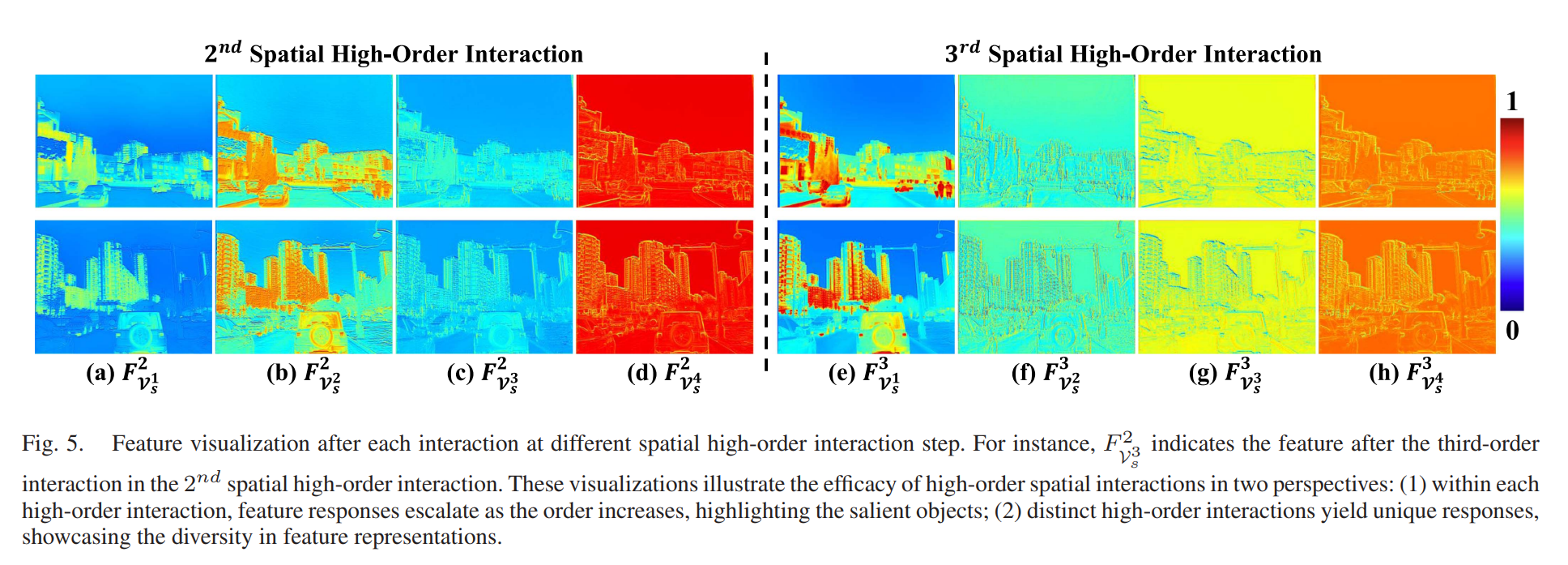

设计背景:不同阶数的空间高阶交互能捕捉多样化的互补特征模式(Fig.5),单独使用某一阶特征会损失信息丰富度。

核心思路:将同一迭代中所有阶数的空间高阶特征进行拼接与卷积融合,整合多样化互补特征,生成更具信息量的融合特征。

数学公式:

F V s N i ← C o n v ( c o n c a t [ F V s 1 i , . . . , F V s N i ] ) F_{\mathcal{V}_{s}^{N}}^{i} \leftarrow Conv\left(concat\left[F_{\mathcal{V}_{s}^{1}}^{i}, ..., F_{\mathcal{V}_{s}^{N}}^{i}\right]\right) FVsNi←Conv(concat[FVs1i,...,FVsNi])

其中, F V s 1 i ∼ F V s N i F_{\mathcal{V}_{s}^{1}}^{i} \sim F_{\mathcal{V}_{s}^{N}}^{i} FVs1i∼FVsNi为第i次迭代中1~N阶的空间高阶特征,concat为通道维度拼接,Conv为卷积层(用于特征整合)。

4.4.3 跨阶注意力演化(Cross-Order Attention Evolving, COAE)

设计背景:传统注意力图各层独立学习,无知识共享,浅层注意力无法引导深层注意力,导致深层注意力对关键特征的捕捉精度不足。

核心思路:借鉴注意力演化机制,通过残差连接实现不同阶数/层注意力图的知识共享,让浅层注意力引导深层注意力的学习,提升注意力图的精准性。

数学公式:

A j i = C o n v ( c o n c a t [ A j − 1 i , F V S j − 1 i W Q j i ] ) A_{j}^{i}=Conv\left(concat\left[A_{j-1}^{i}, F_{\mathcal{V}_{S}^{j-1}}^{i} W^{Q_{j}^{i}}\right]\right) Aji=Conv(concat[Aj−1i,FVSj−1iWQji])

A j i ← N o r m ( A j i + F V S j − 1 i W Q j i ) A_{j}^{i} \leftarrow Norm\left(A_{j}^{i}+F_{\mathcal{V}_{S}^{j-1}}^{i} W^{Q_{j}^{i}}\right) Aji←Norm(Aji+FVSj−1iWQji)

其中, A j i A_{j}^{i} Aji为第i次迭代、第j阶的注意力图, A j − 1 i A_{j-1}^{i} Aj−1i为第j-1阶的注意力图, F V S j − 1 i W Q j i F_{\mathcal{V}_{S}^{j-1}}^{i} W^{Q_{j}^{i}} FVSj−1iWQji为当前阶的查询特征,concat为通道拼接,Norm为层归一化。

核心效果:注意力图从浅层到深层逐步精准,能更清晰地突出多模态的关键特征(如VIF中的行人/车辆、全色锐化中的地物纹理)。

4.5 损失函数设计

针对VIF和全色锐化两大任务的核心需求,设计任务专属的损失函数,引导模型学习贴合任务特性的融合特征,避免通用损失函数的局限性。

4.5.1 全色锐化任务:L1损失

任务需求:提升融合图像的空间分辨率和光谱保真度,让融合图像尽可能接近真实高分辨率多光谱图像(GT)。

损失公式:

L s p a = ∥ I F − G T ∥ 1 \mathcal{L}_{spa }=\left\| I_{F}-G T\right\| _{1} Lspa=∥IF−GT∥1

其中, I F I_F IF为网络输出的融合图像,GT为真实高分辨率多光谱图像, ∥ ⋅ ∥ 1 \|\cdot\|_1 ∥⋅∥1为L1范数(像素级误差)。

4.5.2 红外与可见光融合(VIF)任务:强度损失+梯度损失

任务需求:同时保留红外图像的显著目标和可见光图像的精细纹理,融合图像符合人类视觉感知。

整体损失: L = L i n t + λ L g r a L=L_{int }+\lambda L_{gra } L=Lint+λLgra,其中 λ \lambda λ为权衡参数,平衡强度损失和梯度损失的权重。

(1)显著性感知的强度损失( L i n t L_{int} Lint)

核心思路:基于红外/可见光图像的显著性图设计加权系数,让融合图像更贴合双模态的显著区域,突出红外目标的同时保留可见光的亮度特征。

损失公式:

L i n t = ∥ ( ω V ∘ I V + ω R ∘ I R ) − I F ∥ 1 \mathcal{L}_{int }=\left\| \left(\omega_{\mathcal{V}} \circ I_{\mathcal{V}}+\omega_{\mathcal{R}} \circ I_{\mathcal{R}}\right)-I_{\mathcal{F}}\right\| _{1} Lint=∥(ωV∘IV+ωR∘IR)−IF∥1

其中, ω V 、 ω R \omega_V、\omega_R ωV、ωR为可见光/红外图像的加权图, ∘ \circ ∘为逐元素乘法, ∥ ⋅ ∥ 1 \|\cdot\|_1 ∥⋅∥1为L1范数;加权图由显著性矩阵S计算: ω V = S V / ( S V + S R ) \omega_{V}=S_{V} /(S_{V}+S_{R}) ωV=SV/(SV+SR), ω R = 1 − ω V \omega_{R}=1-\omega_{V} ωR=1−ωV,S由[72]的显著性算法生成。

(2)最大梯度纹理损失( L g r a L_{gra} Lgra)

核心思路:图像梯度代表纹理细节,通过Sobel算子计算双模态的梯度图,让融合图像的梯度图聚合双模态的最大梯度信息,保留最丰富的纹理细节。

损失公式:

L g r a = 1 H W ∥ ∇ I F − m a x ( ∇ I V , ∇ I R ) ∥ 1 \mathcal{L}_{gra }=\frac{1}{HW}\left\| \nabla I_{F}-max \left(\nabla I_{V}, \nabla I_{R}\right)\right\| _{1} Lgra=HW1∥∇IF−max(∇IV,∇IR)∥1

| 其中, ∇ \nabla ∇为Sobel算子的梯度计算操作, m a x ( ⋅ ) max(\cdot) max(⋅)为逐元素取最大值,HW为图像像素总数, ∣ ⋅ ∣ 1 |\cdot|_1 ∣⋅∣1为L1范数。 |

|---|

05 实验分析

论文在红外与可见光图像融合(VIF)和全色锐化(pan-sharpening)两大任务上开展了全面的实验验证,包括SOTA方法对比、超参数消融实验、模块消融实验,采用定量指标+定性可视化+下游任务验证的方式,全方位验证SHIP/SHIP++的性能,并深入分析各模块/超参数的作用机理。

5.1 红外与可见光图像融合(VIF)实验

5.1.1 实验设置

- 数据集:

- 训练集:M3FD(4200对配对图像,3900对训练,300对官方测试);

- 跨数据集测试集:RoadScene、TNO(各随机选取25对,验证模型泛化性);

- 评价指标(所有指标值越高,融合效果越好):

空间频率(SF)、互信息(MI)、视觉信息保真度(VIF)、平均梯度(AG)、 Q a b f Q_{abf} Qabf(边缘保持)、特征互信息(FMI)、SCD(显著目标保持); - 实现细节:

PyTorch框架、NVIDIA GTX 3090 GPU、Adam优化器( β 1 = 0.9 , β 2 = 0.99 \beta_{1}=0.9,\beta_{2}=0.99 β1=0.9,β2=0.99)、30K迭代、批次大小8、初始学习率 1 × 10 − 4 1×10^{-4} 1×10−4(每5K迭代衰减0.5)、特征补丁大小128×128。

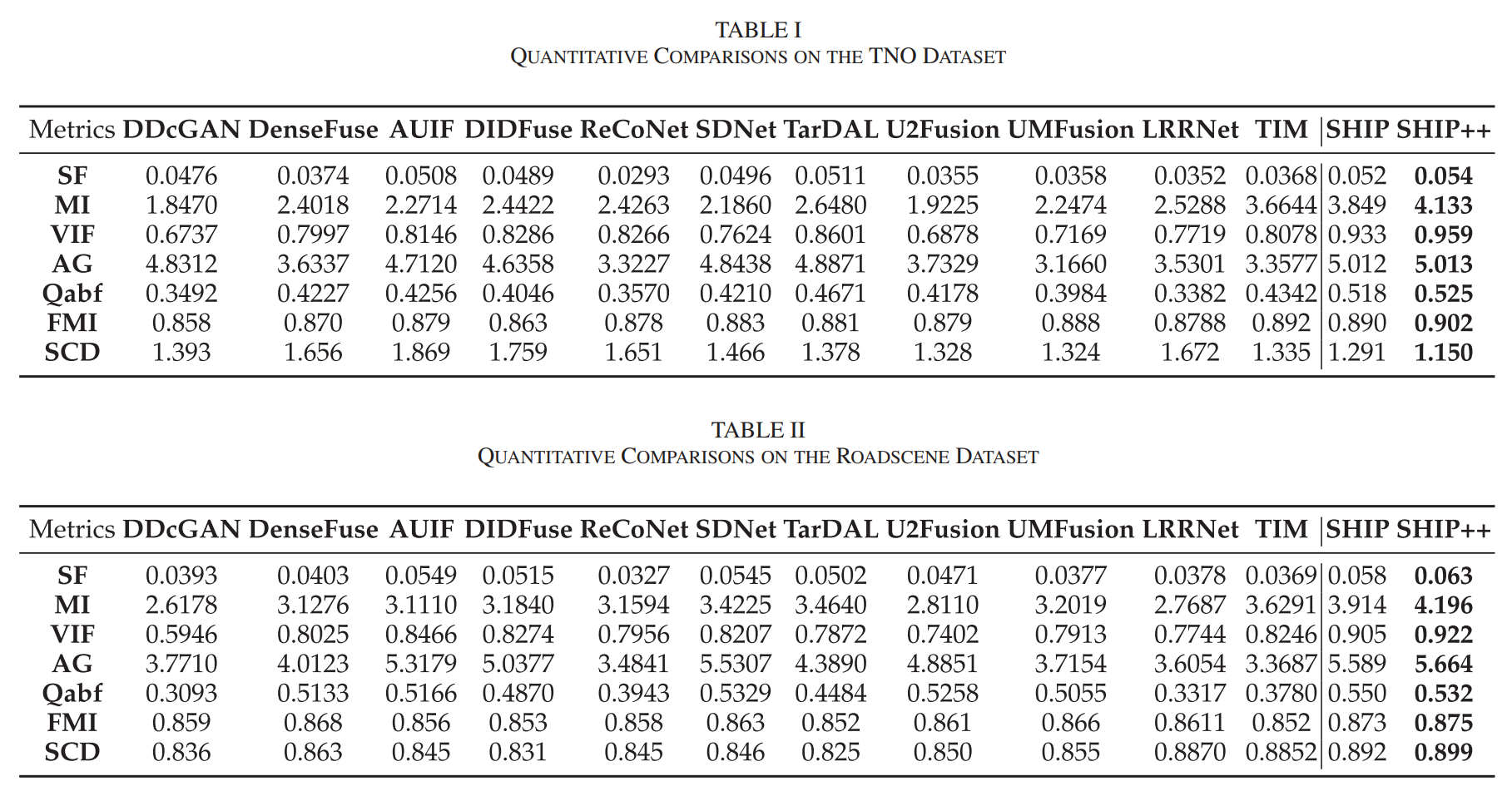

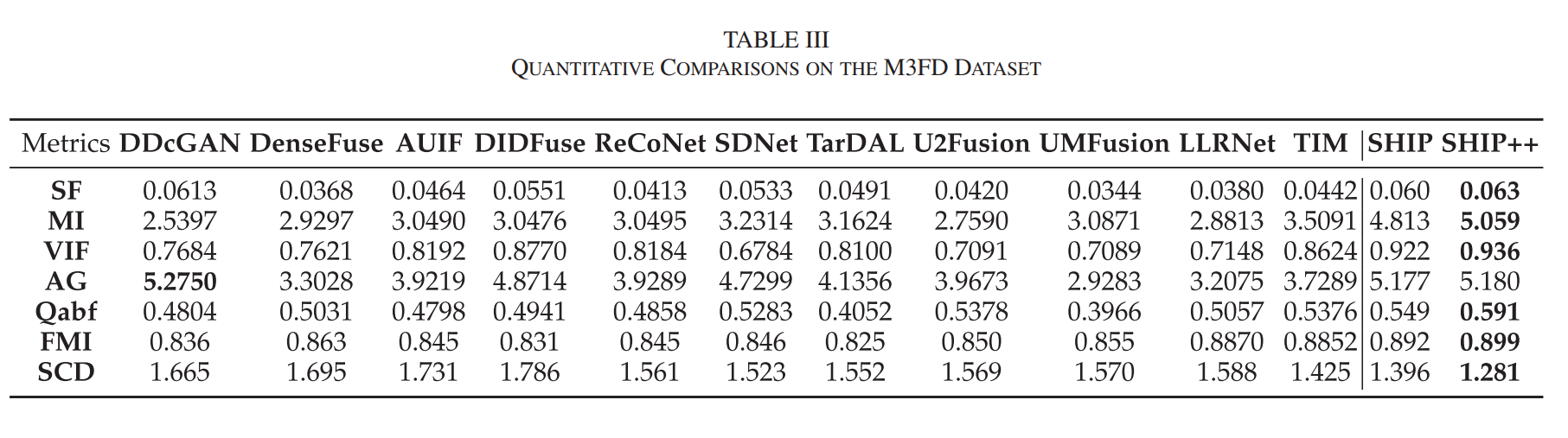

5.1.2 SOTA对比分析

将SHIP/SHIP++与11种SOTA方法对比:DDcGAN、DenseFuse、AUIF、DIDFuse、ReCoNet、SDNet、TarDAL、U2Fusion、UMFusion、LRRNet、TIM,从定量指标、定性可视化、下游任务三方面验证性能优势。

(1)定量结果

SHIP++在M3FD、RoadScene、TNO三个数据集的所有7项评价指标上均取得最优结果,核心优势体现在:

- MI/FMI指标显著高于其他方法:说明SHIP++能更充分地整合红外/可见光的互补信息,融合图像包含更丰富的多模态特征;

- SF/AG/ Q a b f Q_{abf} Qabf指标最优:证明SHIP++能更好地保留可见光的精细纹理和边缘特征,融合图像的空间细节更丰富;

- VIF指标最高:表明融合图像的视觉质量更优、失真更小,更符合人类视觉感知;

- SCD指标最低(最优):说明SHIP++能更精准地保留红外图像的显著目标(如车辆、行人)。

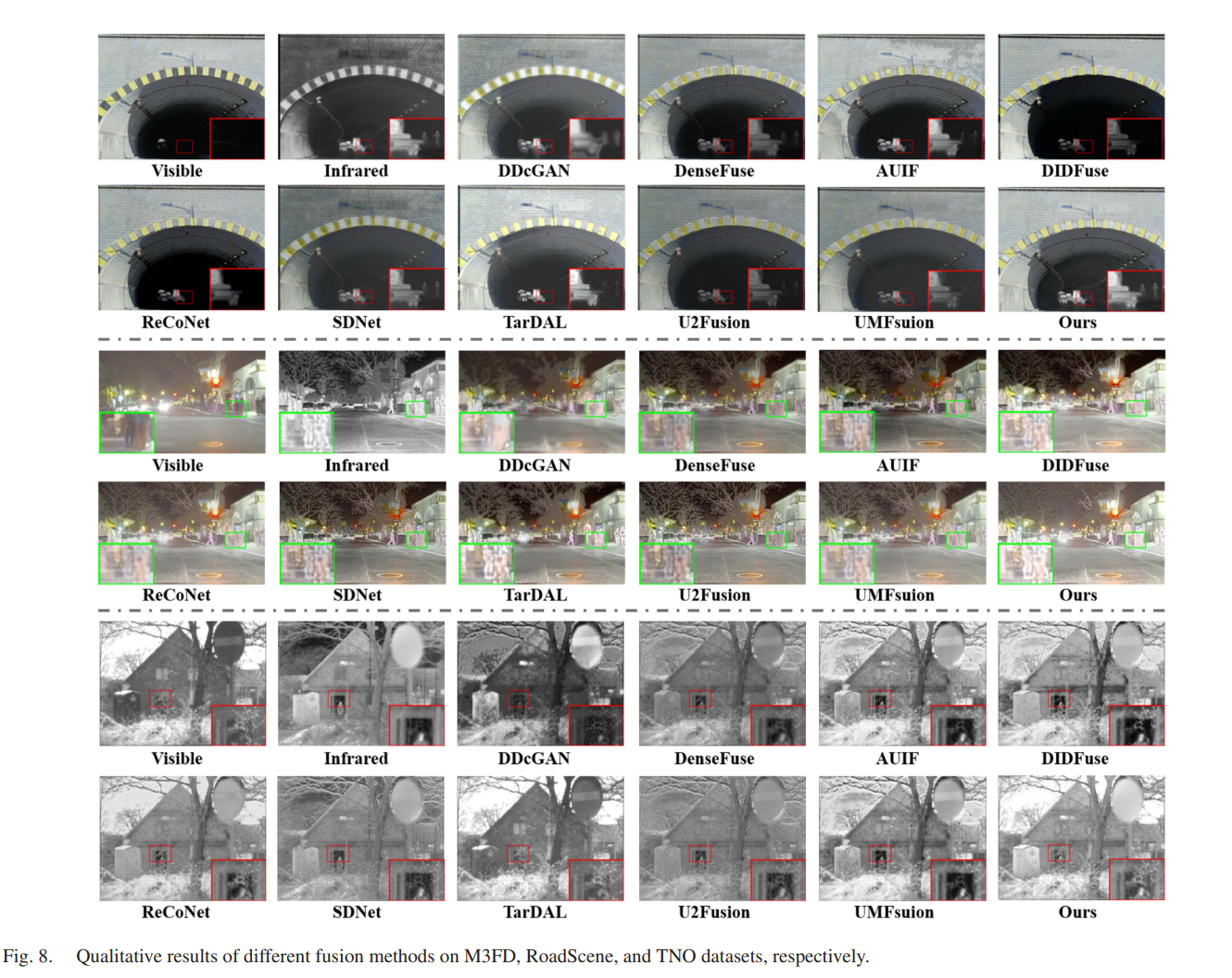

(2)定性结果

SHIP++的融合图像实现了「红外显著目标+可见光精细纹理」的完美平衡,核心优势:

- 显著目标突出:红外图像中的车辆、行人对比度高、轮廓清晰;

- 纹理细节丰富:可见光图像中的树叶、建筑、路面纹理保留完整;

- 视觉效果自然:无亮度失衡、模糊、伪影等问题。

对比其他方法的不足:

- DenseFuse/SDNet/U2Fusion:无法有效突出红外显著目标,融合图像对比度低;

- DDcGAN/ReCoNet:可见光纹理捕捉不足,融合图像模糊,存在伪影;

- DIDFuse:能捕捉红外热特征,但亮度偏低,视觉效果差。

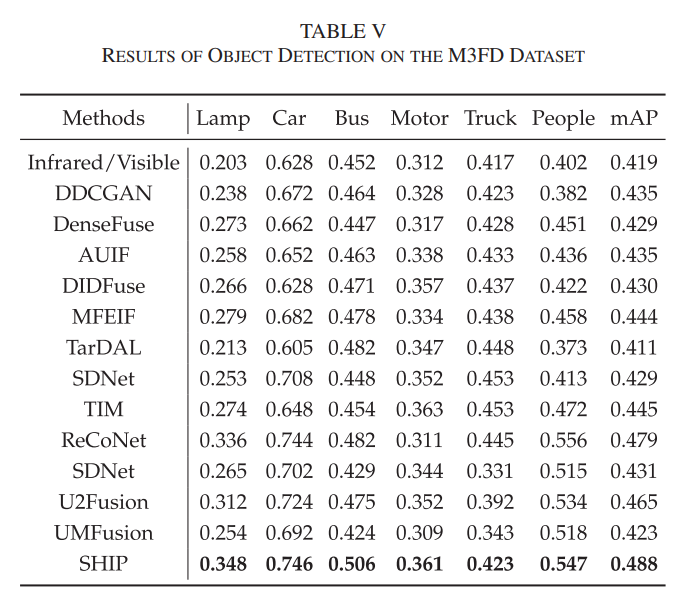

(3)下游任务验证(目标检测)

以FCOS为目标检测模型,在M3FD融合结果上进行目标检测(检测类别:灯、汽车、公交车、摩托车、卡车、行人),SHIP++的mAP指标达0.488,显著高于所有SOTA方法,证明其融合图像能为下游计算机视觉任务提供更有效的特征信息,具有实际应用价值。

5.1.3 消融实验

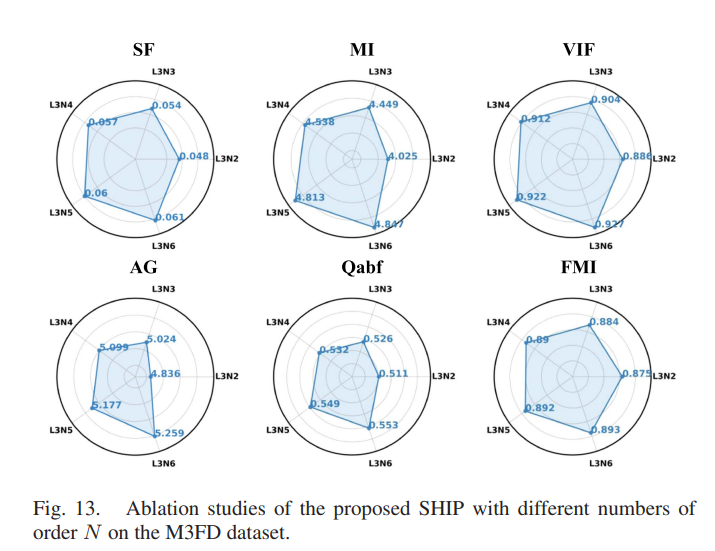

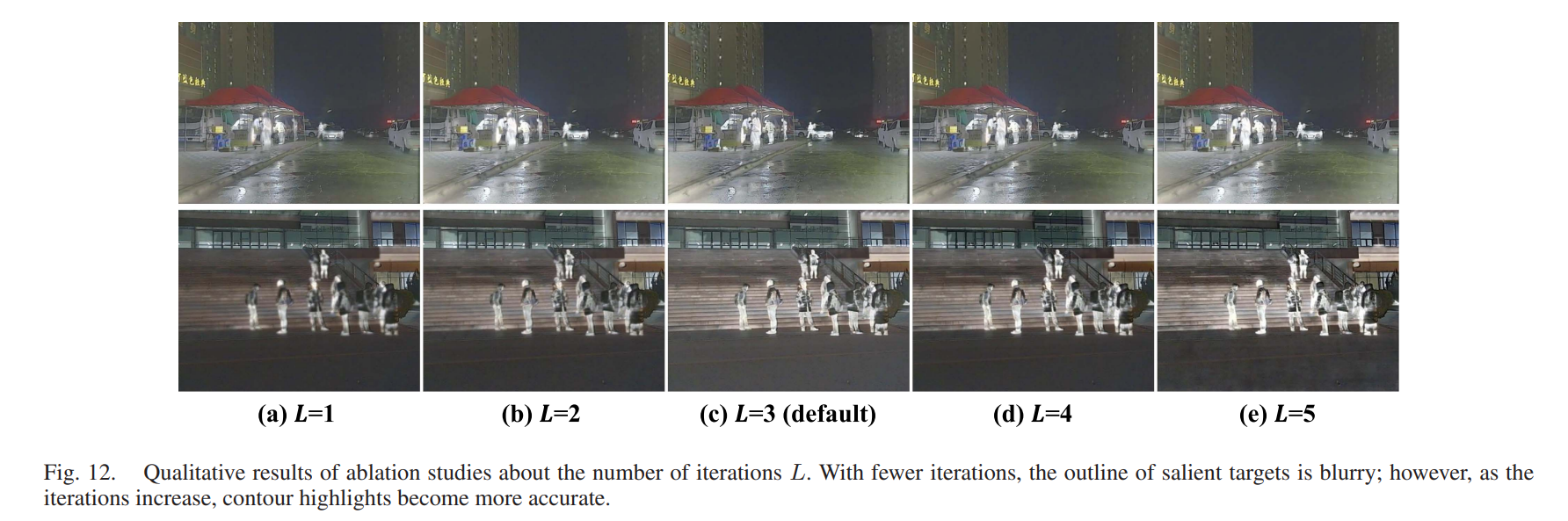

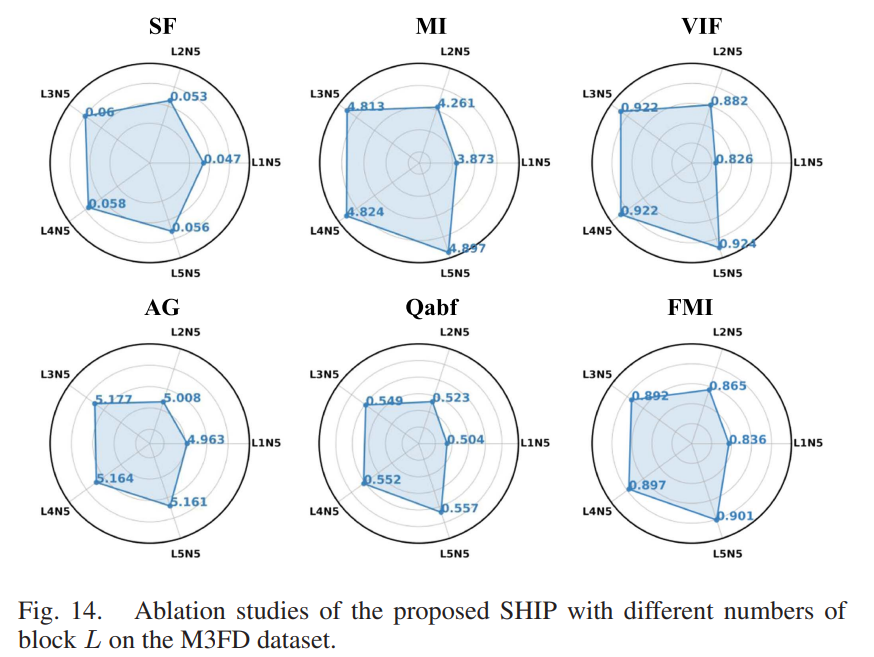

在M3FD数据集上开展消融实验,探究阶数N、迭代数L、空间-通道维度对模型性能的影响,确定最优超参数,并验证双维度交互的必要性。

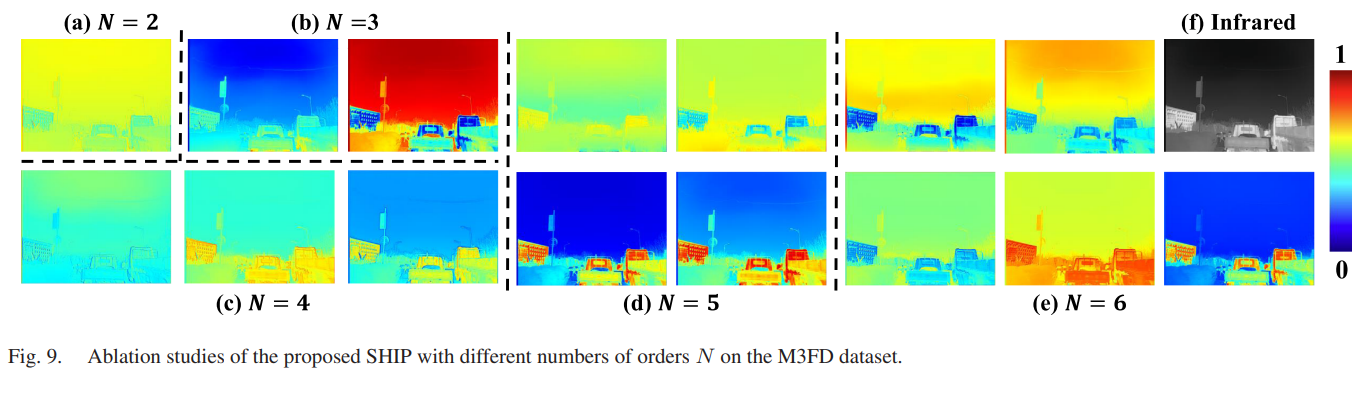

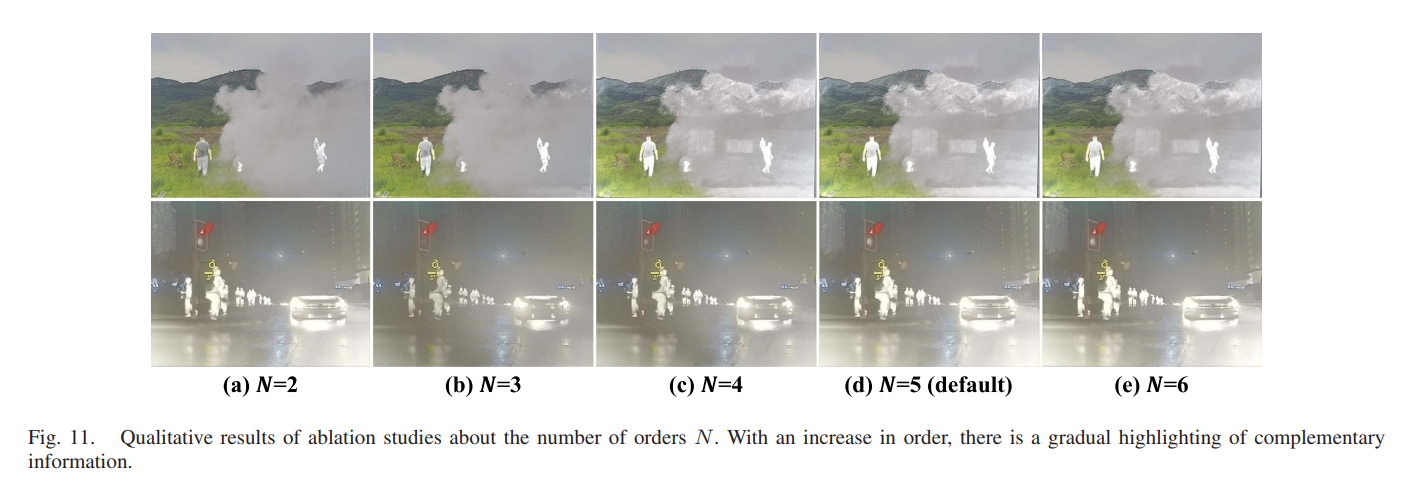

(1)阶数N与迭代数L的消融

-

阶数N:模型性能随N增加逐步提升,N=5时性能趋于稳定(继续增加N无明显提升,且增加计算成本);不同N的特征可视化显示,阶数越高,显著目标的特征响应越强。

-

迭代数L:性能随L增加先提升后下降,L=3为最优;L过大时,梯度传播困难,导致SF/AG等纹理指标下降;不同L的定性结果显示,L越多,显著目标的轮廓越精准。

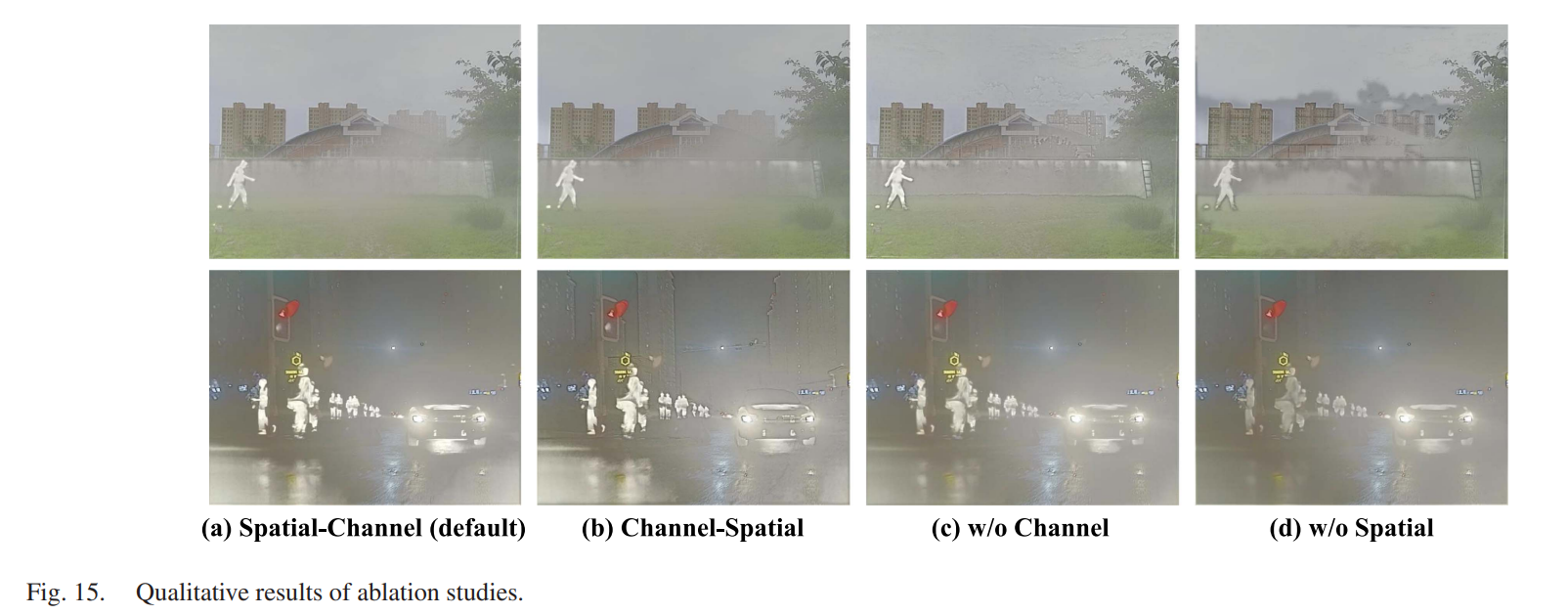

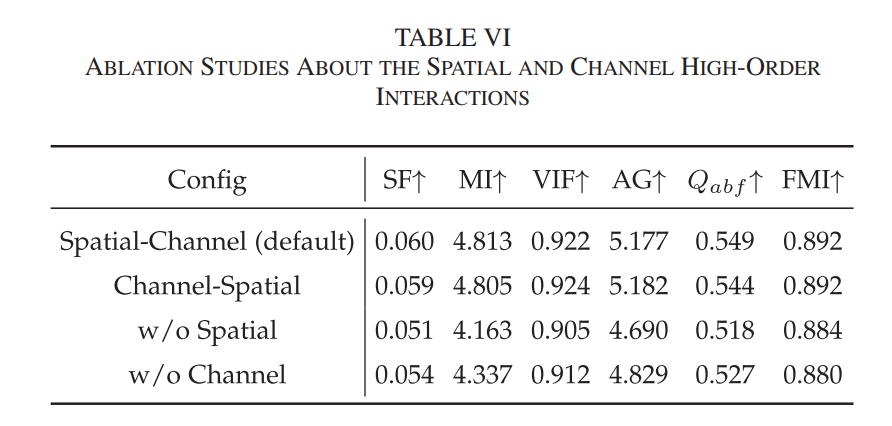

(2)空间-通道维度的消融

验证空间/通道高阶交互的必要性和执行顺序的鲁棒性,设置4种配置:①空间-通道(默认);②通道-空间;③无空间;④无通道,核心结论:

- 双维度交互缺一不可:移除空间/通道任一维度,模型性能显著下降(SF/MI/VIF等指标大幅降低),定性结果显示融合图像亮度失衡、细节丢失;

- 执行顺序鲁棒:空间-通道/通道-空间的执行顺序对性能影响极小,验证了SHIP高阶交互机制的鲁棒性。

5.2 全色锐化(pan-sharpening)实验

5.2.1 实验设置

- 数据集:Worldview-II、Worldview-III、高分2号(Gaofen2),包含全分辨率测试集(验证模型在真实高分辨率场景的泛化性);

- 评价指标:

- 越高越好:PSNR(峰值信噪比)、SSIM(结构相似性)、SCC(相关系数)、QNR(综合质量);

- 越低越好:SAM(光谱角映射)、ERGAS(相对无维全局误差)、 D λ D_\lambda Dλ(光谱失真)、 D S D_S DS(空间失真);

- 实现细节:

Adam优化器、1000轮训练、批次大小4、初始学习率 5 × 10 − 4 5×10^{-4} 5×10−4(200轮后衰减0.5);因无真实标签,采用Wald协议构建训练数据集(将高分辨率MS图像下采样为LRMS,作为模型输入);PAN补丁大小128×128,MS补丁大小32×32。

5.2.2 SOTA对比分析

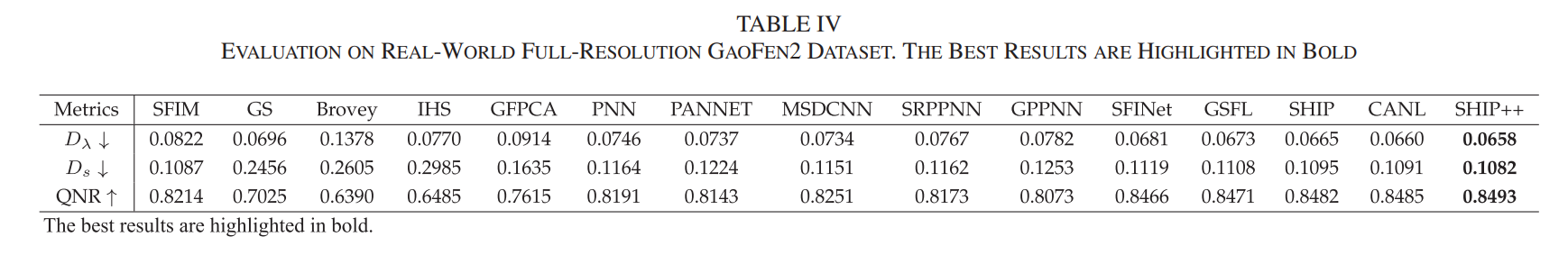

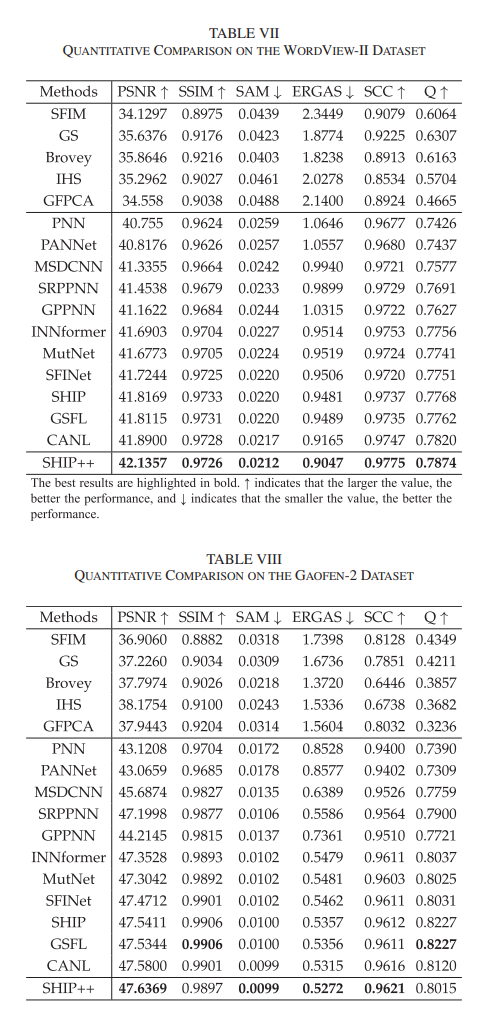

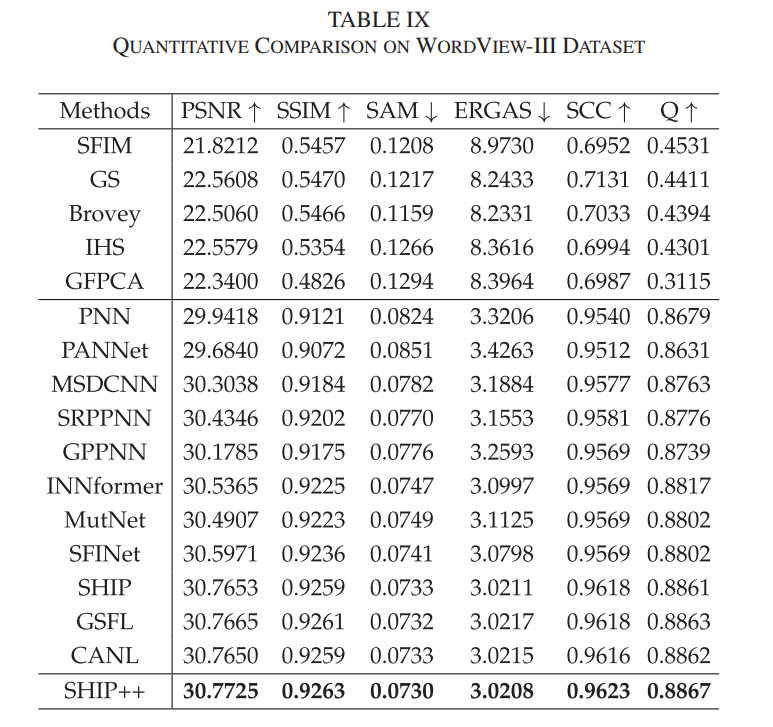

将SHIP/SHIP++与传统方法(SFIM、GS、Brovey、IHS、GFPCA)和深度学习SOTA方法(PNN、PANNet、MSDCNN、SRPPNN、GPPNN、INNformer、MutNet、SFINet、GSFL、CANL)对比,核心结论:

(1)定量结果

SHIP++在三个卫星数据集的所有评价指标上均实现最优,核心优势:

- PSNR/SSIM/SCC/QNR指标最高:说明SHIP++的融合图像空间分辨率高、结构相似性好,与真实标签的贴合度最高;

- SAM/ERGAS/ D λ D_\lambda Dλ/ D S D_S DS指标最低:证明SHIP++能有效降低光谱失真和空间失真,实现「高空间分辨率+高光谱保真度」的双重目标;

- 全分辨率场景(高分2号):QNR指标达0.8493,显著优于其他方法,验证了模型在真实高分辨率遥感场景的强泛化性。

(2)定性结果

SHIP++的全色锐化结果无光谱偏移、空间纹理清晰,与真实标签的MSE残差最小(残差图为浅蓝,代表误差低);而其他方法存在明显问题:

- 传统方法(GS/Brovey/IHS):光谱失真严重,存在颜色偏移;

- 深度学习方法(PNN/PANNet/SFINet):空间纹理模糊,MSE残差图为深黄/红,代表误差高。

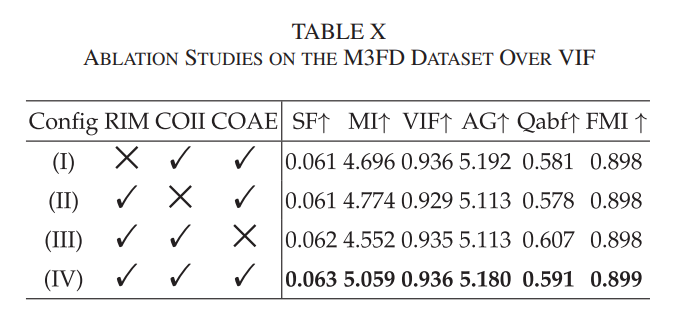

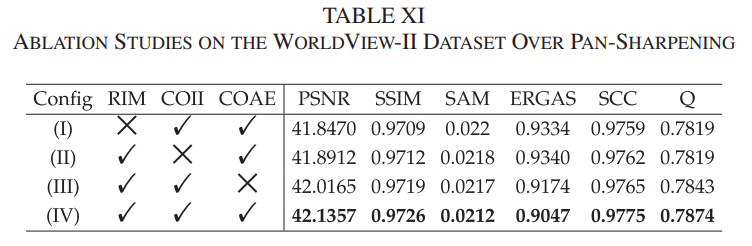

5.3 SHIP++模块消融实验

在VIF的M3FD数据集和全色锐化的Worldview-II数据集上,对SHIP++的RIM、COII、COAE三大模块开展消融实验,验证各模块的有效性,核心结论:

- 三大模块均为性能提升的关键:移除任一模块,模型性能均会显著下降,且三大模块的协同作用能实现性能的叠加提升;

- 残差信息记忆(RIM):移除后主模态关键信息丢失,融合图像细节模糊、亮度失衡;

- 跨阶信息整合(COII):移除后无法整合不同阶数的互补特征,特征表示能力下降,融合图像的信息丰富度降低;

- 跨阶注意力演化(COAE):移除后注意力图无知识共享,浅层无法引导深层,注意力图对关键特征的捕捉精度下降,显著目标/纹理细节丢失。

5.4 实验核心结论

- SHIP/SHIP++在VIF和全色锐化两大任务上均显著优于SOTA方法,证明了双维度高阶交互建模的有效性;

- 高阶交互能捕捉多样化的互补特征模式,提升融合特征的丰富度和表示能力;

- SHIP++的三大模块针对性解决了传统迭代的核心问题,是性能提升的关键,且模块间具有协同效应;

- 模型在跨数据集、全分辨率场景下均表现出强泛化性,具有实际应用价值。

06 个人声明

本文为作者对原论文的学习笔记与心得分享,严格遵循原文的公式、逻辑和实验结论,补充了公式符号解释和核心思路梳理,受个人学识与理解所限,文中对论文内容的解读或有不够周全之处,一切以原论文正式表述为准。本文仅用于学术交流与传播,内容均由作者独立整理完成,不代表本公众号立场。如文中所涉文字、图片等内容存在版权争议,请及时与作者联系,作者将在第一时间核实并妥善处理。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)