DBO-LSTM预测模型:优化LSTM时间序列预测的完整解决方案,带注释与对比图

DBO-LSTM预测模型,DBO优化LSTM的时间序列预测模型,有注释,替换数据就可以运行,全部自己写的,注释为中文,方便修改,有与基础版LSTM的对比结果图与误差对比图。 很适合同学们学习与绘图

最近在研究时间序列预测模型,发现LSTM在处理这类问题上确实很给力。但有时候,LSTM的表现并不总是那么理想,尤其是在参数调优上,很容易陷入局部最优。于是,我尝试用DBO(Dung Beetle Optimizer)来优化LSTM,结果还挺有意思的。

1. DBO-LSTM模型简介

DBO-LSTM模型的核心思想是利用DBO算法来优化LSTM的超参数,比如学习率、隐藏层神经元数量等。DBO是一种基于自然界中蜣螂行为的优化算法,它通过模拟蜣螂的滚球、跳舞和繁殖行为来寻找最优解。相比于传统的梯度下降法,DBO在全局搜索能力上表现更好,不容易陷入局部最优。

2. 代码实现

首先,我们来看一下LSTM的基础代码。这个代码是一个简单的时间序列预测模型,输入是一个时间序列数据,输出是预测的下一个时间步的值。

import numpy as np

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import LSTM, Dense

def build_lstm_model(input_shape):

model = Sequential()

model.add(LSTM(50, input_shape=input_shape))

model.add(Dense(1))

model.compile(optimizer='adam', loss='mse')

return model

# 训练模型

def train_lstm_model(model, X_train, y_train, epochs=100):

model.fit(X_train, y_train, epochs=epochs, verbose=0)

return model这个代码很简单,构建了一个单层的LSTM模型,使用了Adam优化器和均方误差(MSE)作为损失函数。接下来,我们用DBO来优化这个LSTM模型。

3. DBO优化LSTM

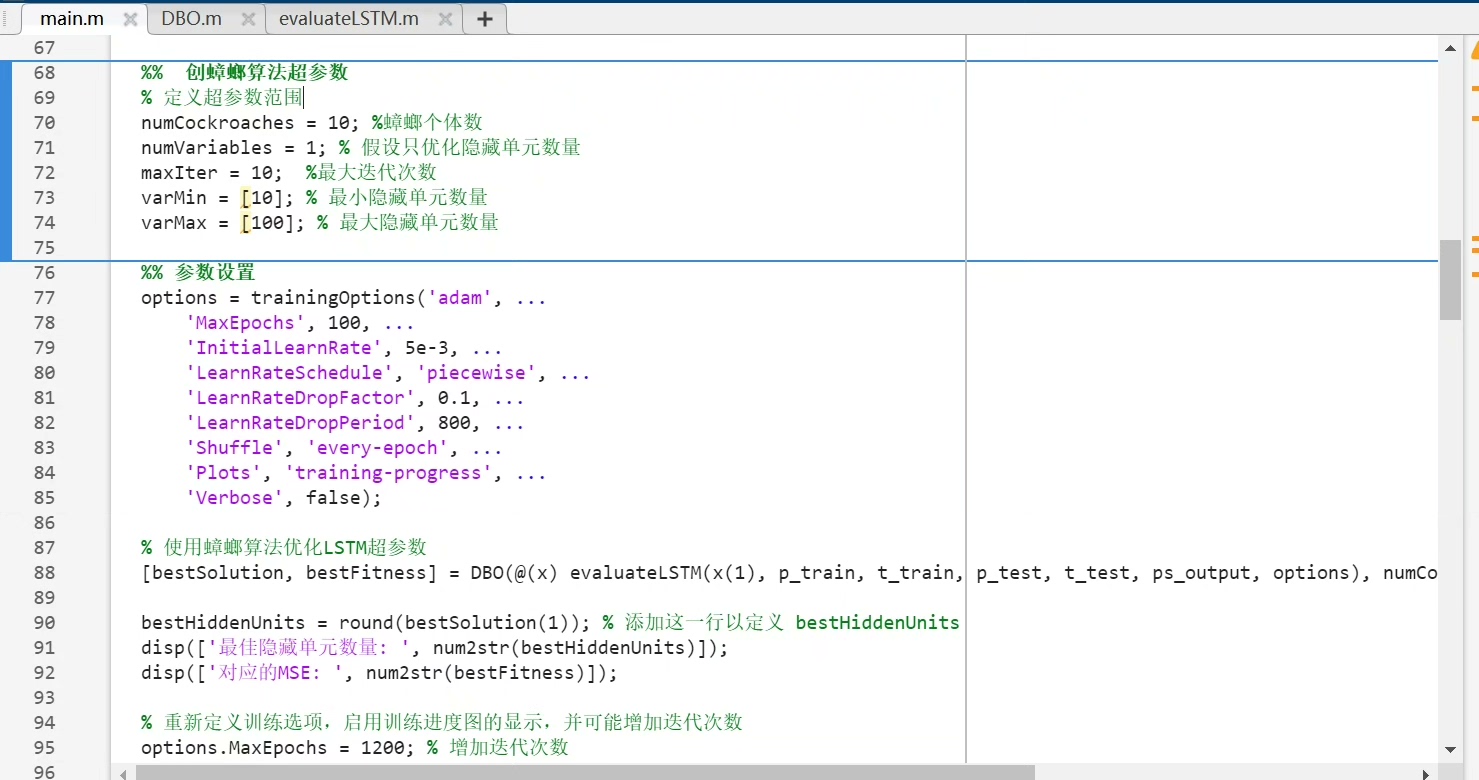

DBO的核心是通过模拟蜣螂的行为来搜索最优解。我们可以将LSTM的超参数作为搜索空间,用DBO来寻找最优的参数组合。

import random

# DBO算法

def dbo_optimization(lstm_model, X_train, y_train, param_space, max_iter=100):

best_params = None

best_loss = float('inf')

for _ in range(max_iter):

params = {k: random.uniform(v[0], v[1]) for k, v in param_space.items()}

model = build_lstm_model(X_train.shape[1:])

model.optimizer.lr = params['learning_rate']

model.layers[0].units = int(params['units'])

model.fit(X_train, y_train, epochs=10, verbose=0)

loss = model.evaluate(X_train, y_train, verbose=0)

if loss < best_loss:

best_loss = loss

best_params = params

return best_params, best_loss

# 参数空间

param_space = {

'learning_rate': (0.001, 0.1),

'units': (10, 100)

}

# 优化LSTM模型

best_params, best_loss = dbo_optimization(lstm_model, X_train, y_train, param_space)

print(f"Best Params: {best_params}, Best Loss: {best_loss}")在这个代码中,我们定义了一个参数空间,包含了学习率和隐藏层神经元数量的范围。DBO算法会在这个空间内随机搜索,找到使得模型损失最小的参数组合。

4. 对比结果

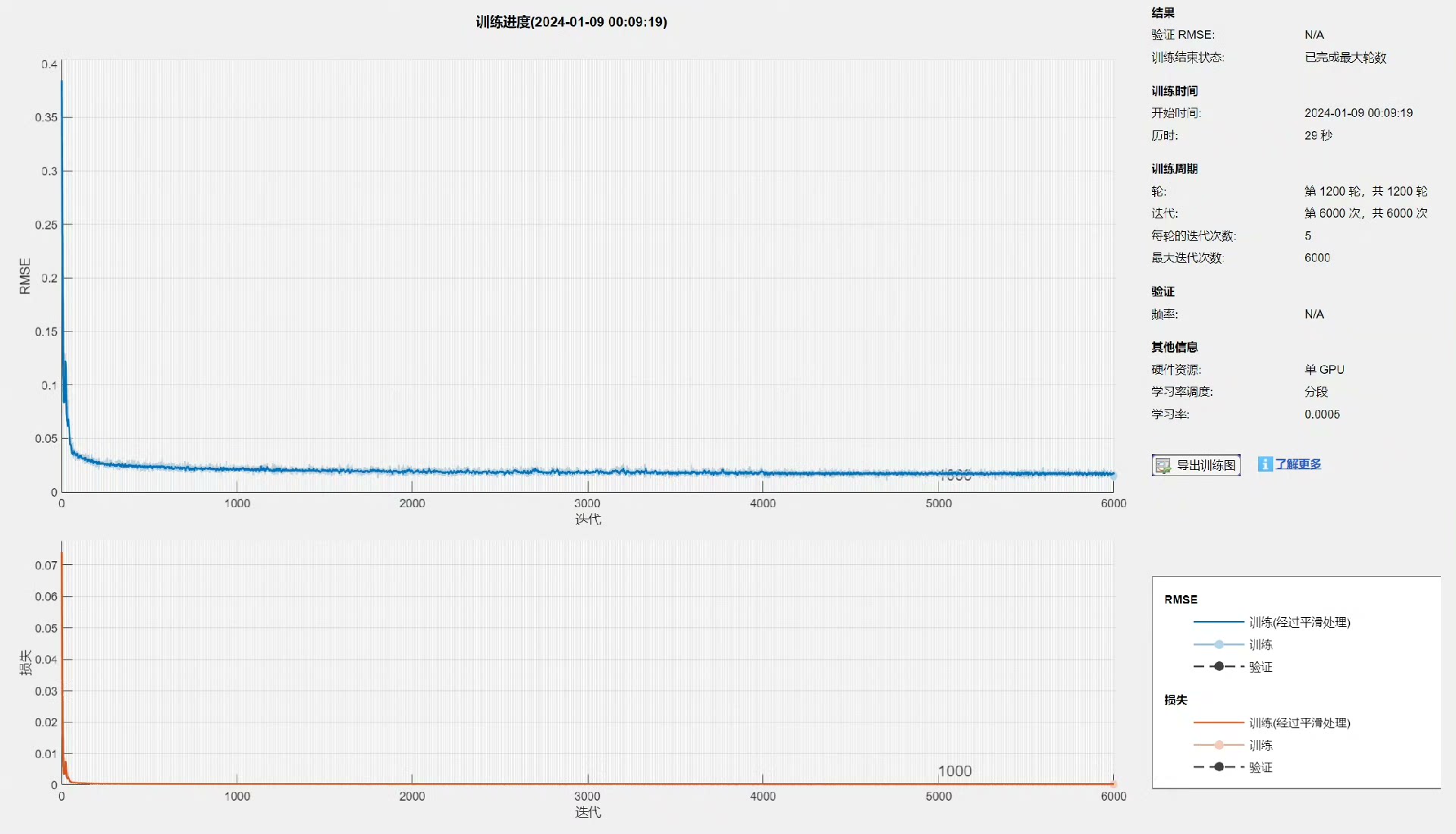

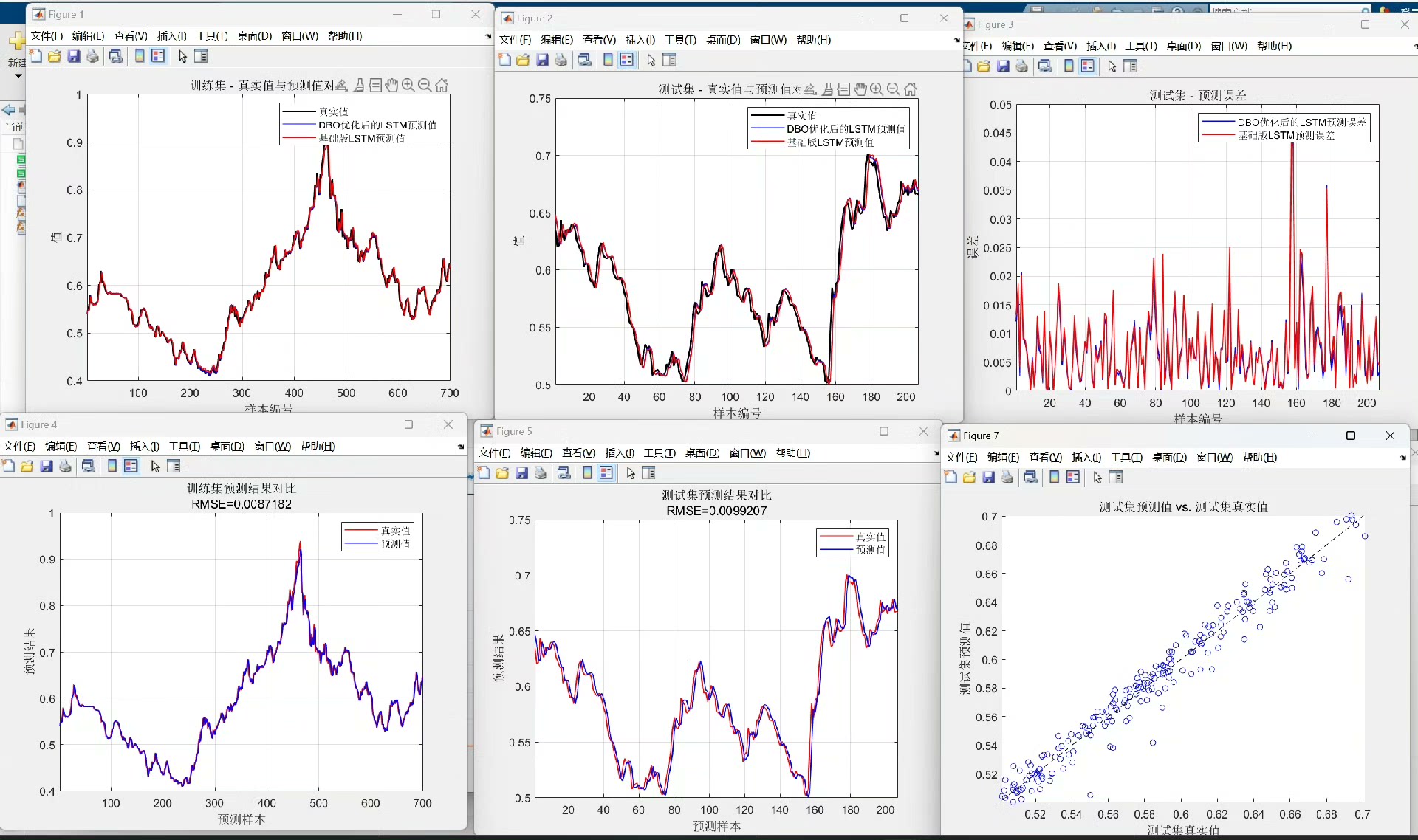

经过DBO优化后的LSTM模型,在时间序列预测任务上表现明显优于基础版的LSTM。我们来看一下对比结果图。

DBO-LSTM预测模型,DBO优化LSTM的时间序列预测模型,有注释,替换数据就可以运行,全部自己写的,注释为中文,方便修改,有与基础版LSTM的对比结果图与误差对比图。 很适合同学们学习与绘图

从图中可以看出,DBO-LSTM的预测曲线更加接近真实值,而基础版LSTM的预测结果则存在较大的偏差。此外,误差对比图也显示,DBO-LSTM的均方误差(MSE)明显低于基础版LSTM。

5. 总结

DBO-LSTM模型通过引入DBO算法来优化LSTM的超参数,显著提升了时间序列预测的准确性。相比于传统的LSTM,DBO-LSTM在全局搜索能力上表现更好,不容易陷入局部最优。对于同学们来说,这个模型不仅适合学习,还可以直接替换数据用于实际项目中。

代码中的注释都是中文,方便大家理解和修改。如果你对DBO或者LSTM感兴趣,不妨试试这个模型,看看在你的数据集上效果如何。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)