AI聚合神器:Cherry Studio一站式管理

一、先用一句话讲清楚:Cherry Studio 是什么?

Cherry Studio 可以把它理解成一个:

桌面端的 AI 聚合工作台 / 多模型统一客户端

它本身不是大模型,而是一个“AI 控制台”:

- 你可以在它里面接入多个模型平台

- 可以统一管理不同服务商的 API

- 也可以接入本地模型

- 用一个界面完成对话、写作、代码、文档分析等任务

如果你以前只用过网页版本的 ChatGPT、Claude、Gemini,那么 Cherry Studio 的价值在于:

把“到处切网页、切账号、切模型”的碎片化体验,变成一个集中、可管理、可扩展的桌面工作流。

二、为什么很多人会觉得 Cherry Studio 很强?

我不想只用“很强”“很好用”这种空话来形容,我直接从实际使用价值来讲。

1. 它最大的价值:统一管理多个 AI 模型

这是 Cherry Studio 最核心的优势。

很多人现在的 AI 使用状态是这样的:

- 写代码去一个平台

- 写文章去另一个平台

- 便宜模型用某个聚合站

- 高质量模型用另一个官网

- 本地模型又在 Ollama 里单独跑

这样很容易出现几个问题:

- 会话分散

- 提示词不好复用

- 模型切换成本高

- API Key 到处放

- 工作流很割裂

Cherry Studio 的意义,就是把这些东西整合起来:

- 一个界面切模型

- 一个地方管配置

- 一个地方保留会话

- 一个地方管理提示词/助手/角色

对于重度使用 AI 的人,这个价值非常大。

2. 同时兼顾“云端模型”和“本地模型”

这点非常关键。

你可以把 AI 的使用方式分成两类:

方案 A:云端模型

例如接入一些在线 API 平台:

- OpenAI

- Claude

- Gemini

- 各类兼容 OpenAI API 的平台

- 一些国内/第三方模型服务商

优点:

- 效果通常更强

- 上手快

- 不吃本地显卡

缺点:

- 有费用

- 网络与接口稳定性会影响体验

- 隐私要考虑

方案 B:本地模型

例如通过:

- Ollama

- LM Studio

- 其他本地推理后端

优点:

- 隐私更好

- 离线可用(视具体配置)

- 成本可控

- 适合内部文档、本地开发测试

缺点:

- 对电脑性能有要求

- 小模型能力可能不如顶级云模型

- 配置门槛稍高

Cherry Studio 的强大之处就在于:

它不是把你绑定在某一家模型厂商上,而是让你自己选择“云端 / 本地 / 混合模式”。

这就是为什么它非常适合 AI 时代长期使用。

3. 比纯网页更适合长期工作

很多初学者会觉得:

“我直接开网页用,不也一样吗?”

短期看差不多,长期差很多。

桌面客户端相比网页的优势通常在于:

- 会话组织更清晰

- 更像“工作软件”,不是临时网页

- 模型切换更方便

- 角色/提示词管理更集中

- 更容易形成自己的 AI 工作流

- 对开发者和重度使用者更友好

简单说:

网页像“临时聊天”,

Cherry Studio 更像“AI 操作系统里的控制中心”。

4. 适合“有模型选择意识”的人

真正用久了 AI,你会发现不同模型适合不同任务:

- 写代码:偏逻辑和结构化能力强的模型更好

- 写文案:创意、语言风格好的模型更合适

- 长文本总结:看上下文长度和稳定性

- 本地隐私文档:本地模型更放心

- 成本敏感:选择便宜的小模型

Cherry Studio 的价值在于:

你不再是“我只能用某一个 AI”

而是进入“我根据任务选择模型”的阶段。

这是一种更成熟的 AI 使用方式。

5. 对程序员、学生、办公人群都很友好

对程序员

- 代码解释

- Bug 分析

- SQL/脚本生成

- 正则表达式辅助

- 多模型对比回答

对学生

- 论文摘要

- 英文翻译

- 学习笔记整理

- 知识点提问

- 写作思路发散

对办公人群

- 邮件润色

- 会议纪要

- 方案草稿

- 文档总结

- 表达优化

所以它并不是“极客工具”而已,它其实是一个适合普通用户逐步进阶的 AI 平台。

6. 一般会有较好的“扩展性”和“兼容性”

Cherry Studio 这类客户端的一大优势是:

通常支持 OpenAI 兼容接口

这意味着什么?

意味着很多第三方平台、自建服务、企业网关、模型聚合平台,只要遵循兼容接口,你就能比较方便地接进去。

这比“某个只能连自己家模型的平台”自由度高得多。

7. 隐私、成本、性能可以自己平衡

AI 工具里最现实的三件事是:

- 效果

- 价格

- 隐私

没有一个方案永远三者都满分。

Cherry Studio 的真正价值不是“给你唯一答案”,而是:

给你选择权。

你可以这样分工:

- 私密内容 → 本地模型

- 日常轻任务 → 便宜云模型

- 高难度复杂任务 → 顶级云模型

这就比只会用一个网页工具要成熟很多。

三、最重要的一句话:Cherry Studio 不是模型,它是“模型工作台”

很多新手第一次会卡在这里。

你下载安装 Cherry Studio 后,可能会以为:

“装完就能直接像 ChatGPT 一样聊天了。”

其实不完全是。

你需要理解它的结构:

Cherry Studio 的使用,一般分成三层

第 1 层:客户端

就是 Cherry Studio 本身。

它负责:

- 界面

- 对话管理

- 模型切换

- 配置管理

- 文件交互

- 工作流体验

第 2 层:模型来源

你要告诉它“背后用谁来回答你”:

- 云端 API

- 本地模型服务

- 兼容接口平台

第 3 层:凭证或连接信息

例如:

- API Key

- Base URL

- 模型名称

- 本地地址(如

http://127.0.0.1:11434)

所以新手最容易犯的误区是:

装了客户端,但没有配置模型来源

结果就会觉得“怎么不能用”。

不是软件坏了,而是还没接入模型。

四、Cherry Studio 的优点,深度总结成一句话

如果让我用一句更本质的话来总结它:

Cherry Studio 的核心价值,不是某个单一功能,而是它把“AI 使用”从零散体验升级成了可管理、可选择、可扩展的长期工作流。

这才是它真正强的地方。

五、如何下载 Cherry Studio

下面我按最实用的方式讲。

1. 最稳妥的下载渠道

由于我现在不能实时联网核对链接,你可以优先通过这两种渠道找:

方式一:官方 GitHub Releases

搜索关键词:

Cherry Studio GitHubCherry Studio releases

通常你会在项目的发布页看到各平台安装包。

方式二:官方文档 / 官方网站

搜索关键词:

Cherry Studio 官网Cherry Studio 官方文档

一般官网会提供:

- 下载入口

- 安装说明

- 支持的模型平台

- 配置教程

2. 按系统选择安装包

Windows 用户

常见会看到:

.exe安装包.msi安装包- 有时也可能有便携版

.zip

如果你是普通用户,优先选:

.exe或.msi安装版

更省心。

macOS 用户

注意区分:

- Apple Silicon / ARM / M 系列芯片:选

arm64 - Intel Mac:选

x64

常见格式是:

.dmg.pkg

如果你选错架构,可能装不上或运行异常。

Linux 用户

常见可能有:

AppImage.deb.rpm

如果你是 Ubuntu / Debian 系:

优先选

.deb

如果是通用发行版:

可以选

AppImage

3. 安装时要注意的事

Windows

如果系统弹出 SmartScreen 提示:

- 先确认你下载的是官方发布页文件

- 再确认版本说明、文件名是否正常

- 核对有无校验信息(如官方提供 checksum)

不要从不明网盘随便下载。

macOS

如果提示“来自未知开发者”:

- 先确认来源绝对可靠

- 再去“系统设置 → 隐私与安全性”里允许打开

Linux

如果是 AppImage,通常需要先给执行权限:

chmod +x Cherry-Studio.AppImage

./Cherry-Studio.AppImage

六、安装完成后,第一次怎么用?

这里我用最适合初学者的讲法来讲:

你先不要急着研究所有功能,先把“能正常聊起来”这件事完成。

最常见的两种使用路线:

路线 1:接入云端模型 API

适合:

- 想快速上手

- 不想折腾本地环境

- 电脑配置一般

- 追求效果

路线 2:接入本地模型

适合:

- 重视隐私

- 想离线/本地推理

- 喜欢自己掌控

- 有一定电脑配置

七、最推荐新手先学:云端模型接入

这是上手最快的路线。

第一步:准备一个模型平台的 API Key

你需要先去某个模型服务商平台申请 API Key。

常见类型有两种:

类型 A:官方平台

例如某模型厂商自己的开发者平台。

类型 B:兼容 OpenAI API 的平台

这类平台非常常见,特点是:

- 接入方式类似

- 很多模型能统一调用

- 在 Cherry Studio 中往往更方便配置

第二步:打开 Cherry Studio 的设置页

安装打开后,一般你会看到类似这些入口:

- 设置

- 模型管理

- Provider / Providers

- API 设置

- 模型服务商

- 账户 / 密钥配置

不同版本命名可能略有差异,但思路一样。

第三步:添加一个模型提供商

通常你需要填这些信息:

1)API Key

你的密钥。

2)Base URL

接口地址。

如果是官方平台,就填官方接口地址;

如果是兼容平台,就填它要求的兼容地址。

3)Model Name

模型名称。注意这必须和平台支持的模型 ID 一致。

例如不同平台可能是:

gpt-4o-miniclaude-3-5-sonnetgemini-1.5-prodeepseek-chatqwen-plus

具体名字一定要以对应平台控制台为准。

第四步:测试连接

很多客户端会提供:

- 测试连接

- 拉取模型列表

- 保存并验证

这一步很重要。

如果这里失败,通常是以下原因:

- API Key 错了

- Base URL 写错

- 网络问题

- 模型名不对

- 账号没开通额度

第五步:新建对话,选择模型

连接成功后,一般就可以:

- 新建聊天

- 选择刚配置的模型

- 输入提示词

- 开始使用

比如你可以先测试一句:

“请用中文解释什么是二叉树,并举一个生活中的类比。”

如果能正常返回,就说明你的配置已经打通了。

八、给你一个最常见的云端接入思路模板

你可以把它理解成通用模板:

云端接入通用模板

你需要准备:

- API Key

- Base URL

- 模型名称

在 Cherry Studio 中填写:

- 服务商类型:OpenAI compatible / 官方 provider

- API Key:你的密钥

- Base URL:服务商提供的接口地址

- Model:服务商支持的模型名

完成后:

- 测试连接

- 新建会话

- 选择模型

- 开始对话

九、另一条很重要的路线:本地模型接入

如果你想更深入地使用 AI,特别是想要隐私、更低长期成本,建议你一定要了解这个模式。

最常见的本地方案之一是:

Cherry Studio + Ollama

为什么很多人会这样搭配?

因为 Ollama 很适合作为本地模型运行后端,而 Cherry Studio 负责前端体验。

你可以把它理解成:

- Ollama:负责把模型跑起来

- Cherry Studio:负责让你更舒服地使用模型

一个负责“发动机”,一个负责“驾驶舱”。

本地模型接入的大致步骤

第一步:安装 Ollama

你需要先去 Ollama 官方站下载安装。

第二步:拉取一个本地模型

例如在终端里执行:

ollama pull llama3:8b

或者拉一些适合中文/通用任务的小模型。

具体选择哪个模型,要看你的电脑性能和你的任务类型。

第三步:确认 Ollama 正在运行

默认本地服务地址常见是:

http://127.0.0.1:11434

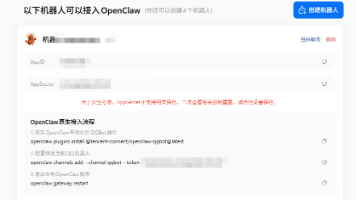

第四步:在 Cherry Studio 中添加本地提供商

如果版本支持直接选择 Ollama,那么非常方便。

如果是按兼容接口接入,也可能需要填:

- 本地地址

- 模型名

- 接口类型

第五步:刷新模型列表并开始对话

如果一切正常,你应该能在 Cherry Studio 中看到本地模型。

十、为什么“本地模型”值得你认真学?

因为它代表一种很重要的 AI 使用能力:

不是只能依赖别人家的网页,而是你自己有能力在本机控制模型。

这对于计算机相关专业、开发者、研究人员都很重要。

本地模型特别适合:

- 私密文档处理

- 本地代码分析

- 内部笔记整理

- 学习型实验

- 长期低成本使用

十一、Cherry Studio 的使用,不只是聊天

这是很多人低估它的地方。

一个成熟的 AI 客户端,真正的价值不只是“你问一句它答一句”,而是让你建立更稳定的工作方式。

下面我讲几个你应该重点关注的使用场景。

1. 提示词管理 / 助手角色

如果你每次都重复输入:

- “你现在是一个 C++ 老师……”

- “你现在是一个论文阅读助手……”

- “你现在是一个产品经理……”

会很低效。

Cherry Studio 这类工具通常会支持:

- 预设角色

- 常用提示词

- 助手模板

- 系统提示词管理

这意味着你可以把常见任务“产品化”。

例如你可以建立:

助手 1:代码讲解助手

提示词固定为:

- 解释代码

- 标出 bug

- 给出复杂度分析

- 用初学者语言表达

助手 2:学习笔记助手

提示词固定为:

- 总结重点

- 列出易错点

- 生成复习清单

助手 3:写作润色助手

提示词固定为:

- 优化表达

- 保持逻辑

- 调整语气

这样效率会比纯网页高很多。

2. 文档阅读 / 文件问答

很多桌面 AI 客户端会逐步支持:

- 上传文档

- 总结文件

- 对 PDF/Markdown/文本进行问答

- 以文档为基础回答问题

这类能力对于:

- 论文阅读

- 技术文档学习

- 合同摘要

- 项目资料整理

都很有用。

但要注意:

不是所有模型都支持所有文件能力,

也不是所有版本都支持相同的文档工作流。

你需要看当前版本功能。

3. 知识库 / 长期资料管理

一些版本或扩展功能中,可能会有知识库或类似能力。它的本质是:

把你常用资料变成 AI 可检索的上下文

适合:

- 公司制度

- 技术文档

- 课程资料

- 产品说明

- 个人知识库

如果你的版本支持这个功能,它会非常实用。

4. 多模型切换与对比

这是 Cherry Studio 这类工具特别值得重视的点。

比如你可以这样分工:

- 一个模型负责速度

- 一个模型负责质量

- 一个模型负责中文表达

- 一个模型负责代码能力

- 一个本地模型负责隐私数据

这就是“模型策略”。

真正的高效用户,不是只会问问题,而是懂得:

这个问题该给哪个模型做。

十二、下载后我建议你这样配置,最实用

如果你是第一次使用,我建议你不要一上来就折腾太复杂。

方案 A:最适合绝大多数新手

Cherry Studio + 一个便宜稳定的云端模型

适合:

- 先上手

- 少折腾

- 想体验完整流程

优点:

- 快

- 门槛低

- 成本可控

- 效果一般也比本地小模型更稳定

方案 B:想学得更深入

Cherry Studio + 云端模型 + Ollama 本地模型

这样你会同时拥有两套能力:

- 云端强模型:处理复杂任务

- 本地模型:处理隐私与轻量任务

这是非常成熟的一种 AI 使用体系。

十三、Cherry Studio 的“真正下载与使用门槛”在哪里?

不是安装,而是理解这三件事:

1. 模型来源

你到底用谁家的模型?

2. 接口配置

你能不能正确填:

- API Key

- Base URL

- 模型名

3. 任务匹配

你会不会根据任务选合适模型?

很多人觉得 AI 工具难,其实不是不会安装,而是这三点没搞清楚。

十四、使用中的几个核心参数,你要懂

如果 Cherry Studio 提供这些参数设置,建议你知道它们是干什么的。

1. Temperature

控制回答的“发散度”。

低温度(如 0.1~0.3)

更稳定、更严谨,适合:

- 代码

- 总结

- 问答

- 分析

高温度(如 0.7~1.0)

更有创造性,适合:

- 文案

- 头脑风暴

- 故事

- 标题创意

2. Max Tokens

控制输出长度上限。

如果太小,回答会被截断。

如果太大,可能更费钱或更慢。

3. System Prompt

这是很重要的高级功能。

它不是普通问题,而是:

你给模型设定“长期角色和行为规则”

比如:

- 你是一个严谨的算法老师

- 你要优先给出结构化答案

- 你回答要面向初学者

- 你输出时必须先总结,再分点展开

很多人 AI 用不好,不是模型不强,而是 System Prompt 没用好。

十五、常见问题与排查方法

这部分很实用。

问题 1:软件装好了,但没有模型可选

原因

通常是你还没有配置 provider。

解决

去设置里添加:

- API 平台

- 或本地模型后端

问题 2:提示 401 / 403

原因可能是

- API Key 错误

- Key 失效

- 账号没额度

- 权限不足

解决

- 重新复制 Key

- 去平台控制台检查额度和权限

- 确认接口地址和模型类型对应

问题 3:模型名称填了但请求失败

原因

模型 ID 写错很常见。

解决

去服务商文档中复制准确模型名。

问题 4:本地模型接不上

原因可能是

- Ollama 没启动

- 地址写错

- 模型没 pull

- 端口被占用

解决

先在终端测试:

ollama list

确认模型存在;

再确认本地接口地址是否正确。

问题 5:回答很慢

可能原因

- 网络问题

- 云端模型排队

- 本地模型过大

- 电脑性能不足

- 上下文太长

解决

- 先换轻量模型测试

- 缩短上下文

- 本地用更小模型

- 检查网络和代理

十六、安全与隐私建议,这个一定要看

Cherry Studio 很灵活,但灵活就意味着你要有安全意识。

1. API Key 不要乱放

- 尽量使用独立 Key

- 不要把主账号最高权限 Key 到处复制

- 如果平台支持,设置额度上限

2. 敏感资料优先本地模型

如果是:

- 公司内部文档

- 客户隐私资料

- 源代码仓库敏感内容

- 个人重要信息

建议优先使用本地方案,或者确认云端平台的合规和隐私政策。

3. 只从官方渠道下载

不要从不明网盘、论坛二次打包版下载。

十七、如果你问我:Cherry Studio 到底值不值得装?

我的判断是:

如果你只是偶尔问几个问题,用网页也行;

如果你准备长期、高频、系统化地使用 AI,Cherry Studio 这类工具非常值得装。

因为它解决的不是“能不能问”,而是:

- 能不能长期组织好你的 AI 工作流

- 能不能同时用多模型

- 能不能兼顾本地与云端

- 能不能更高效、更专业地使用 AI

十八、给不同人群的建议

如果你是普通用户

从云端模型开始。

先学会:

- 安装客户端

- 配 API Key

- 选模型

- 保存常用提示词

如果你是学生

重点用它做:

- 学习辅助

- 笔记整理

- 文档总结

- 翻译与写作辅助

同时建议你保留“自己思考”的习惯,不要完全依赖生成结果。

如果你是程序员或计算机专业学生

强烈建议你走这条路线:

Cherry Studio + 云端模型 + Ollama 本地模型

因为这套组合能帮你真正理解 AI 工具链,而不只是当普通聊天软件来用。

十九、最适合新手的“上手顺序”

我给你一个非常实用的顺序:

第 1 步:下载并安装 Cherry Studio

从官方发布页拿对应系统版本。

第 2 步:先接一个云端模型

优先追求“先能用起来”。

第 3 步:学会新建会话、切换模型、管理提示词

先形成基本工作流。

第 4 步:再尝试本地模型

安装 Ollama,跑一个小模型。

第 5 步:尝试做自己的 AI 助手模板

比如代码助手、学习助手、写作助手。

这条路线是最平滑的。

二十、最后给你一个最简版操作清单

如果你现在就想开始,可以按这个做:

Cherry Studio 快速上手清单

1. 下载

- 去官方 GitHub Releases / 官网

- 选你的系统版本

- 安装

2. 启动

- 打开软件

- 找到设置 / 模型服务商 / Provider 页面

3. 选择一种模型来源

- 云端 API

- 或本地 Ollama

4. 填写配置

- API Key

- Base URL

- 模型名

5. 测试连接

- 能成功返回就说明配置没问题

6. 新建会话

- 选择模型

- 输入问题

- 开始使用

7. 进阶

- 建立常用提示词

- 分类会话

- 尝试本地模型

- 尝试文档问答

二十一、总结

你可以把 Cherry Studio 理解成:

一个把“多个 AI 模型、多个服务平台、本地与云端能力”统一到一个桌面工作流里的 AI 控制中心。

它的真正优点不是某个炫技功能,而是:

- 统一

- 灵活

- 可扩展

- 适合长期使用

- 适合建立自己的 AI 工作流

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)