PyTorch张量API核心全解:夯实深度学习根基,一篇吃透核心操作

🔥 PyTorch张量API核心全解:夯实深度学习根基,一篇吃透核心操作

在深度学习的浩瀚星河中,PyTorch张量(Tensor) 是承载数据、驱动模型运算的核心基石✨。它如同神经网络的「血液」,贯穿于数据预处理、前向传播、反向求导的全流程,而张量API则是我们操控这份「血液」的关键密钥。

本文将结合实战学习心得,系统梳理PyTorch张量最核心的API操作——涵盖张量创建、线性/随机生成、常量构造、类型转换四大模块,拆解关键用法、标注性能要点,带你快速掌握张量操作的核心逻辑,告别API记忆混乱!

一、开篇:张量API,深度学习的基础必修课

张量是PyTorch中最基础的数据结构,对标NumPy的多维数组,但具备GPU加速、自动微分等核心优势,是深度学习模型的「数据载体」。

想要玩转PyTorch,张量API是必须攻克的第一关。无需死记硬背所有函数,只需掌握高频核心API,就能覆盖90%的实战场景。本次学习我们聚焦最实用的张量操作,从创建到转化,层层递进,夯实深度学习基础。

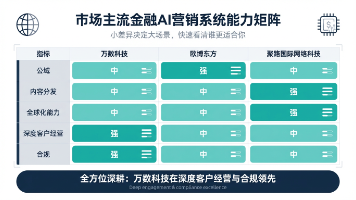

下面用一张架构图,清晰展示本次学习的核心模块:

图表说明:这张流程图清晰梳理了本次讲解的四大核心张量API模块,模块之间逻辑连贯、层层递进,张量创建是入门第一步,类型转换是实战避坑关键,线性与随机操作、常量张量创建则覆盖日常数据生成核心场景,四大模块联动起来,就能搞定深度学习里绝大多数张量基础操作,完全贴合实战学习路径。

二、张量创建:开启张量世界的大门

张量创建是所有操作的起点,PyTorch提供了灵活的创建方式,支持指定数据类型、指定维度形状两种核心思路,适配不同场景的需求。

1. 指定类型创建:精准控制数据类型

在深度学习中,数据类型直接影响模型的精度与运算速度。指定类型创建,允许我们在创建张量时,通过dtype参数直接定义张量的元素类型(如浮点型、整型),从源头把控数据格式。

✅ 核心优势:一步到位定义类型,避免后续类型转换的额外开销,提升代码简洁性。

✅ 关键示例:创建浮点型张量(深度学习最常用类型)

import torch

# 创建指定float32类型的张量

tensor_float = torch.tensor([1.1, 2.2, 3.3], dtype=torch.float32)

2. 基于维度创建:灵活定义张量形状

张量的维度(形状)决定了数据的结构(标量、一维向量、二维矩阵、高维张量)。PyTorch支持直接传入维度参数创建张量,也支持将NumPy数组转化为张量,适配多维数据处理需求。

✅核心特点:自由度极高,既能创建标量、一维序列,也能创建二维矩阵乃至更高维度张量,同时完美兼容NumPy生态,NumPy数组转张量无需复杂改造,数据迁移零成本、无损耗,适配各类多维数据处理场景。

三、线性与随机操作:数据生成的「万能工具」

在模型训练、数据模拟场景中,我们经常需要生成有序序列或随机数据,PyTorch提供了极简的API,一行代码即可完成高效生成。

1. 线性序列生成:有序数据的高效创建

线性操作核心用于生成有序、等差的张量序列,是数据预处理、索引构建的必备工具:

-

arange:指定数值范围生成序列(左闭右开),适配连续数值场景; -

linspace:标准等差序列生成,精准控制元素数量与区间范围。

✅ 核心价值:相比于手动循环编写有序数据,直接调用官方API不仅代码更简洁,而且底层基于优化后的C++逻辑实现,运算速度远超手动循环,大批量序列生成时效率优势格外明显,是数据预处理、构建索引的首选方法。

2. 随机张量生成:模型训练的核心依赖

深度学习的初始化、数据增强、噪声生成都离不开随机张量,PyTorch随机API覆盖了最常用的分布类型:

-

rand:生成0~1之间均匀分布的随机小数,适配归一化后的数据场景; -

randn:生成标准正态分布(均值0、标准差1)数据,适配权重初始化; -

randint:生成指定范围的随机整数,适配分类标签、索引场景; -

manual_seed:固定随机种子,保证实验结果可复现,是科研与工程必备!

✅ 性能要点:PyTorch随机张量生成API支持GPU硬件加速,即便生成大批量高维度随机数据,也不会出现性能瓶颈;而manual_seed固定随机种子更是科研和工程落地的关键,能保证每次运行代码生成的随机数据完全一致,让实验结果可复现、可调试,避免随机波动干扰模型效果。

四、常量张量创建:全0、全1张量的极简实现

在模型初始化、掩码构建、占位符定义场景中,全0、全1张量是高频使用的常量张量,PyTorch提供了极致简洁的API:

核心API速览

| API名称 | 功能 | 拓展用法 |

|---|---|---|

torch.zeros |

创建指定形状的全0张量 | 支持自定义数据类型、设备 |

torch.ones |

创建指定形状的全1张量 | 支持自定义数据类型、设备 |

ones_like |

基于现有张量形状,创建全1张量 | 无需重复定义维度,极简高效 |

| ✅ 实战价值:全0、全1张量属于深度学习里的“基础工具张量”,神经网络权重偏置初始化、数据掩码构建、占位变量定义等场景都会高频用到,PyTorch封装的极简API,一行代码就能完成创建,大幅简化代码逻辑,减少冗余编写步骤。 |

✅ 关键示例:

# 创建2x3的全0张量

zero_tensor = torch.zeros(2, 3)

# 基于现有张量形状创建全1张量

ones_like_tensor = torch.ones_like(zero_tensor)

五、元素类型转换:张量的「形态切换术」

在数据拼接、模型运算中,张量类型必须统一,否则会触发类型不匹配报错。因此,类型转换是张量实战中不可或缺的核心技能。

1. 核心转换函数:type()

PyTorch中最通用的类型转换方法是type()函数,无需复杂操作,直接指定目标类型即可完成转换,适配所有张量场景。

2. 高频类型对应关系(必记!)

为了方便记忆,我们整理了深度学习最常用的类型对应规则,告别混淆:

-

float16➡️half(半精度,节省显存) -

float32➡️float(单精度,默认标准类型) -

int16➡️short(短整型) -

int64➡️long(长整型,分类标签专用)

✅ 性能要点:张量类型转换属于轻量级内存操作,不会产生大额性能开销,也不会改变张量本身的数值和维度;日常模型训练中,优先选用float32单精度浮点型和int64长整型,既能保证模型运算精度,又能兼顾显存占用,适配绝大多数主流深度学习模型训练需求。

六、API优先级划分:高效学习,拒绝内卷

张量API数量繁多,无需全部死记!结合实战需求,我们划分核心掌握与次要了解两类,精准发力:

🌟 必须牢牢掌握(核心API)

arange、linspace、manual_seed、rand、randn、randint、zeros、ones、type

🌙 次要了解(非高频API)

scalar相关标量专属API,这类API仅适用于纯标量操作场景,日常深度学习开发中使用率极低,不需要花费大量时间重点记忆,了解概念即可。

七、总结:张量API,极简核心,无限可能

✨ 张量是PyTorch框架的核心数据载体,而熟练掌握核心API,就是操控张量的关键钥匙;

✨ 本次梳理的四大核心模块(基础创建、线性与随机生成、常量构造、类型转换),足以覆盖深度学习90%以上的基础实战场景;

✨ 学习过程中不用盲目死记所有API,聚焦高频核心函数,牢记固定随机种子、统一张量类型这两个关键细节,就能保证模型稳定运行;

✨ 结合实际场景理解API用法,而非单纯背诵函数参数,才能真正吃透张量操作,快速上手PyTorch深度学习实战。

掌握本文的张量API知识,你已经迈出了PyTorch深度学习的关键一步。后续我们将继续解锁张量的索引、运算、广播等高级操作,一步步搭建属于自己的深度学习模型~

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)