深度解析自动驾驶世界模型

本文约5,488字,建议收藏阅读

作者 | 北湾南巷

出品 | 汽车电子与软件

引 言

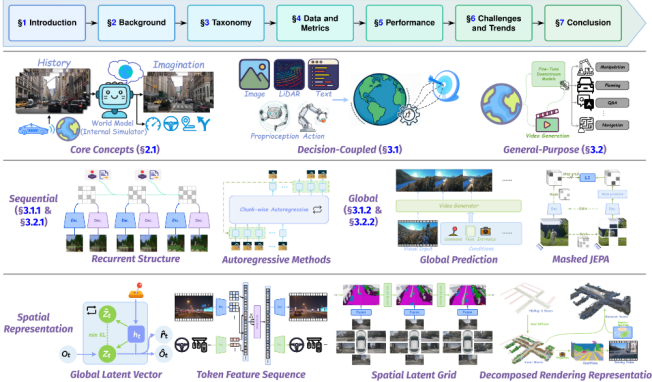

当自动驾驶从“看见障碍物就刹车”的反应式系统,走向“提前预判风险再行动”的预测式系统时,一个核心能力开始浮出水面——世界模型。它不是科幻电影里的数字意识,也不是某种神秘的赛博灵魂,而是一种让机器在行动之前,先在内部推演未来的能力。换句话说,真正高级的自动驾驶,不是在现实中边走边试,而是在大脑内部,先“活过”无数种可能,然后才选择最优路径。下面,我们将把这个听起来有些抽象、甚至略带“玄学”色彩的概念,一层层拆解清楚。

1

为什么它听起来“有点玄”?

世界模型,是一个在自动驾驶系统“大脑”内部构建的、可学习的、能够模拟现实世界动态变化的“虚拟现实”。系统不是在真实世界中直接做决策,而是在这个内部的、抽象的、运行速度极快的“元宇宙”里进行大量推演,然后才做出最优决策。“世界模型”这个词之所以容易让人产生误解,是因为它听起来像:

-

人工意识

-

数字灵魂

-

赛博大脑

-

科幻元宇宙

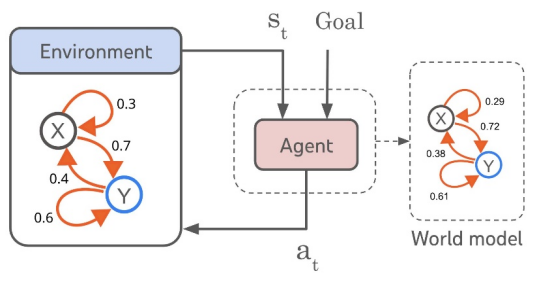

但实际上,它不是玄学,而是一个可计算、可训练、可验证的数学结构。世界模型(World Model)本质上是一种:对“世界状态”与“世界演化规律”的联合建模。它包含两个核心能力:

1. 表征世界当前状态

2. 预测世界未来如何变化

换句话说,它回答两个问题:

-

现在发生了什么?

-

接下来会发生什么?

如果我们把自动驾驶系统比作一个智能体(Agent),那世界模型就是这个智能体的“内在宇宙”。它不是摄像头看到的画面本身,而是:

-

对场景的结构化理解

-

对物体之间关系的抽象

-

对物理规律的隐式编码

-

对行为趋势的概率性预测

世界模型并不是一个简单模块,而是一个多层结构。

第一层:状态表征(State Representation)这是“我现在看到什么”。

系统通过多传感器融合(摄像头、激光雷达、毫米波雷达等)构建一个统一的世界状态表示。这一层通常包含:

-

道路拓扑结构(车道线、边界、路口)

-

动态目标(车辆、行人、自行车)

-

静态障碍物(路障、护栏、建筑)

-

交通规则(红绿灯状态、限速标志)

-

自车状态(速度、加速度、方向盘角度)

但关键在于:世界模型并不是保存“像素”,而是保存“语义”。

比如:

-

它不是保存一片红色像素。

-

它保存“前方50米有一辆减速中的卡车”。

这是从感知到语义抽象的跨越。

第二层:动力学建模(Dynamics Modeling)

这是世界模型真正的核心。它要回答:如果当前状态是 Sₜ,那么 Sₜ₊₁ 会是什么?

也就是说:世界模型必须学会“时间”。它必须理解:

-

车辆会沿着车道前进

-

行人可能突然横穿马路

-

红灯会变绿

-

前车刹车后,后车可能也会刹车

这里涉及两种动力学:

-

物理动力学:速度/加速度/转向/半径摩擦力

-

行为动力学:人类驾驶意图/行人过马路概率/车辆变道趋势/博弈关系

世界模型不仅预测“物体会移动”,还预测“物体为什么移动”。

第三层:可模拟性(Imaginative Simulation)

这才是它像“虚拟现实”的地方。一旦有了状态和动力学模型,系统就可以:

-

在内部构造一个完整场景

-

让时间加速推进

-

尝试不同动作

-

观察未来结果

例如:如果我现在向左变道,会发生什么?

-

是否会与后车发生冲突?

-

是否会影响前方车流?

-

是否违反交通规则?

系统可以在内部“模拟”几百种未来路径,然后选择风险最低、收益最高的一条。

现实世界只能经历一次。但世界模型允许系统经历成千上万次“假设未来”。

1.1 它是一个“内部模型”

什么叫“内部”?内部,意味着它存在于神经网络的参数空间中。它不是:

-

一个3D游戏画面

-

一个真实渲染的物理引擎

-

一个对世界的逐像素复制

而是:一个对“世界状态”的压缩表达。

1.2 它不是像素复制

现实世界是连续的、无限复杂的。摄像头看到的是:

-

数百万个像素

-

每秒几十帧

-

每帧包含大量噪声

如果系统要“逐像素理解世界”,那计算量将是爆炸级的。所以它必须做一件事:

抽象。举例:

1. 现实输入:一片灰色像素 + 两条白线 + 一个红色小方块

2. 内部世界模型理解为:当前车道 + 左侧车道线 + 前方50米一辆减速中的红色轿车

从视觉数据到结构化语义状态,这一步,就是世界模型的“入口”。

1.3 它存在于“潜在空间”

在技术上,这个内部世界通常被表示为:

-

一个低维向量空间(Latent Space)

-

或者一个结构化场景图(Scene Graph)

-

或一个BEV(Bird's Eye View)空间表示

它的特点:

-

抽象

-

可微分

-

可学习

-

可用于时间推演

所以它不是“一个虚拟3D世界”,而是“一个可计算的状态空间”。

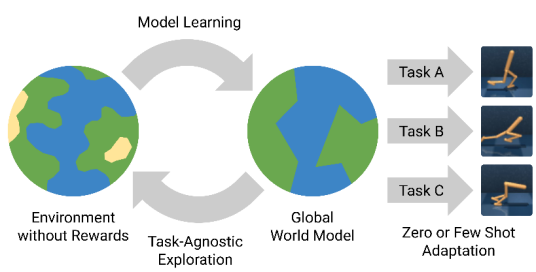

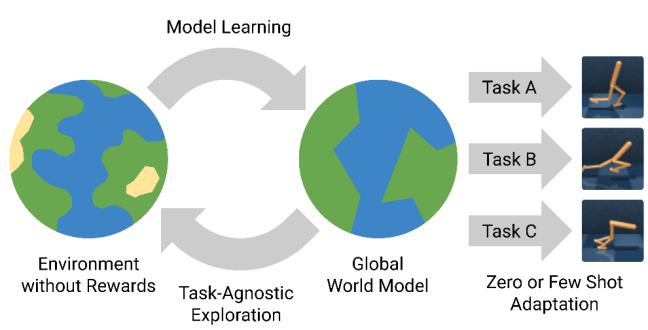

1.4 它是可学习的

这是关键。世界模型不是人类程序员手写规则构建的。它不是:

-

写死的牛顿公式

-

写死的驾驶规则

-

写死的碰撞模型

它是通过数据学习得到的统计规律集合。

1.5 它学到的不是“规则文本”,而是“分布”

比如你说:它会学到“物体不会瞬移”。系统并没有一个if语句写着:

if (object.teleport) -> error

而是它在数据中观察到:

-

连续帧之间,物体位置变化是连续的

-

速度变化是平滑的

-

运动满足一定惯性

于是神经网络参数自动编码了:P(下一帧状态 | 当前状态) 的分布

如果某个物体突然瞬移100米,那在它的概率模型里,这个状态的概率接近0。

这就是“学到物理规律”的本质。

1.6 它如何学到“下雨天路会滑”?

假设数据中包含:

-

雨天视频

-

车辆刹车距离变长

-

车辆打滑的轨迹

系统会自动捕捉到:

-

雨天像素特征

-

路面反光特征

-

轮胎滑移特征

并把这些模式与“动力学变化”关联起来。于是它形成了一个隐式映射:

湿滑路面 → 更大的制动距离。

这不是规则写进去的,是统计规律涌现出来的。

1.7 它学到的是“联合分布”

世界模型学的本质是:P(未来状态 | 当前状态, 当前动作)

这包含:

-

物理规律

-

行为规律

-

社会博弈规律

比如:

-

前车减速 → 后车更可能减速

-

行人朝马路方向移动 → 过街概率上升

-

高速路 → 变道行为概率更高

它学到的是“世界如何演化”的统计规律。

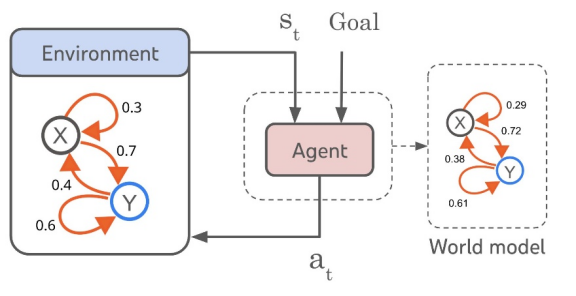

1.8 它的核心功能是预测

现在来到最核心的一点:世界模型的存在意义 = 预测未来,没有预测能力,就不需要世界模型。

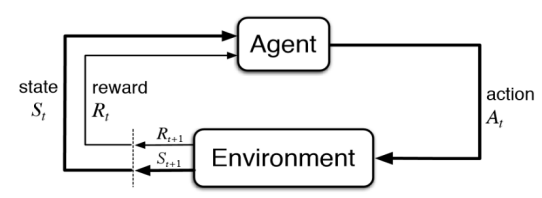

预测的数学形式,我们可以写成:Sₜ₊₁ = f(Sₜ, Aₜ)或者更准确地说:P(Sₜ₊₁ | Sₜ, Aₜ)这里:

-

Sₜ 是当前世界状态

-

Aₜ 是当前动作

-

Sₜ₊₁ 是下一时刻状态

这就是动力学模型。

1.9 它预测的不只是“物体移动”

它预测的是:

-

场景整体演化

-

多主体互动

-

交通规则变化

-

风险分布变化

例如:如果我加速:

-

我与前车距离缩小

-

后车可能被迫减速

-

进入路口时间提前

-

与横向车流冲突概率上升

这是一种“因果级联推演”。

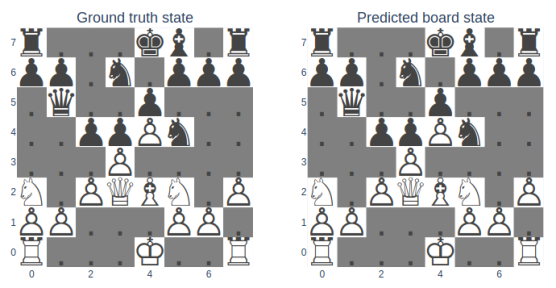

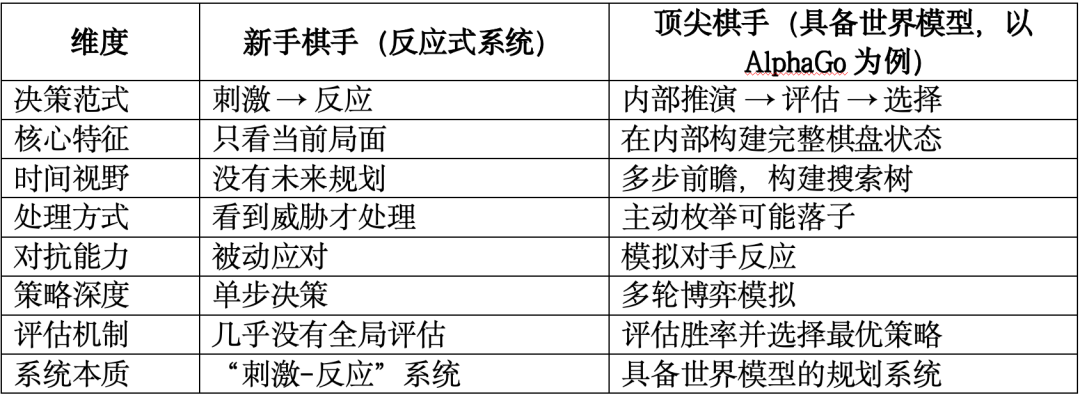

1.10 下棋类比——我们把它彻底讲透

这个类比非常好,我们现在升级它。

关键点:它不是“预测一个未来”,它是“预测很多可能的未来”。

1.11 驾驶中的等价过程

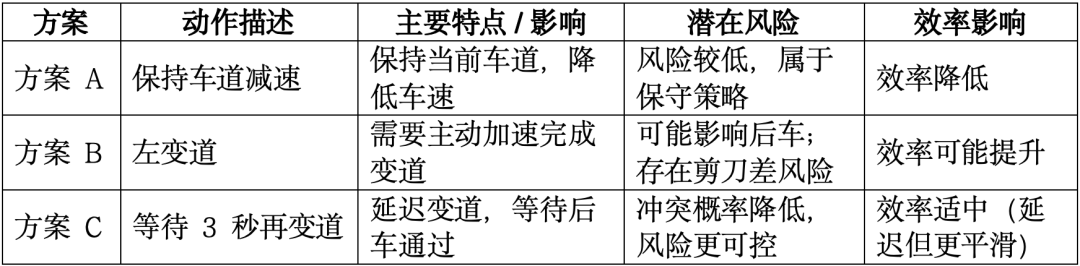

假设当前情况:

-

前方慢车

-

左侧车道畅通

-

后方有快速接近车辆

没有世界模型的系统:

-

看到慢车 → 刹车

有世界模型的系统会在脑内模拟:

系统在内部高速演算几百种微小变体,选择综合风险最小的一条轨迹。这就是“驾驶版AlphaGo”。从反应任务 → 前瞻规划任务这是整个范式转变的核心。

没有世界模型:

-

驾驶是一个“被动响应任务”

-

事件驱动

-

局部最优

有世界模型:

-

驾驶是一个“全局规划问题”

-

预测驱动

-

长期最优

时间维度的差异

反应式系统:现在 → 现在 → 现在

预测式系统:现在 → 未来1秒 → 未来3秒 → 未来5秒

这带来的本质改变是:决策开始具有“时间深度”。

1.12 更深一层理解:它让系统拥有“想象力”

现实世界:

-

不可回滚

-

不能试错

-

错误代价高

世界模型内部:

-

可以尝试

-

可以失败

-

可以反复推演

这使系统具备了:

-

风险前置识别

-

极端场景演算

-

罕见场景泛化能力

世界模型不是:一个虚拟3D引擎。它是:一个可学习的、内部抽象的、能够对世界未来演化进行高速概率推演的动力学模型。它让自动驾驶汽车:像顶尖棋手一样,在行动之前,已经“看过”未来。

2

世界模型的工作原理

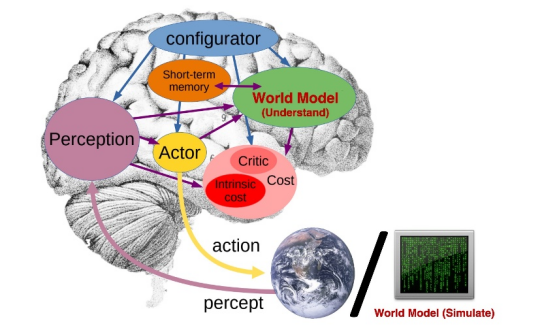

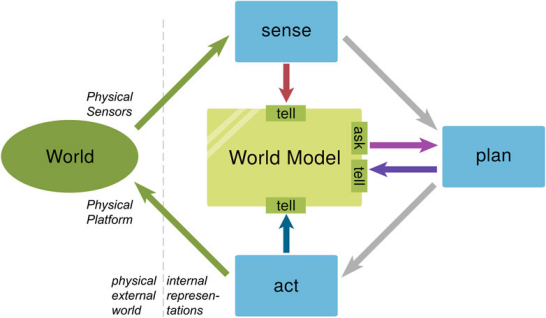

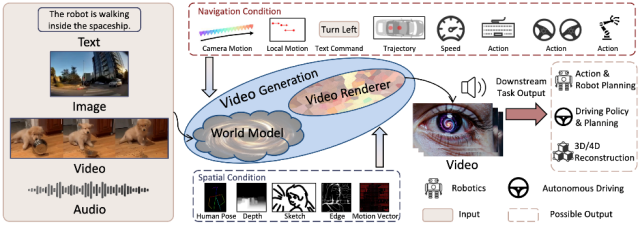

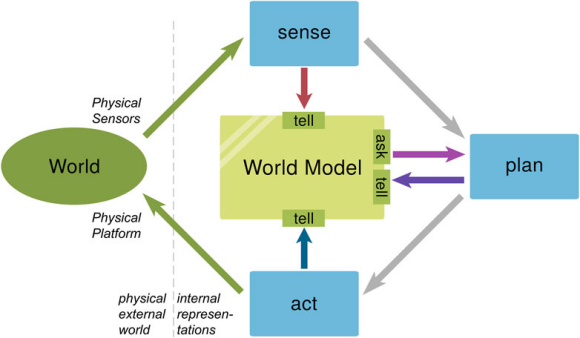

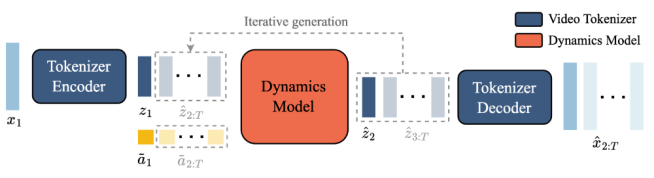

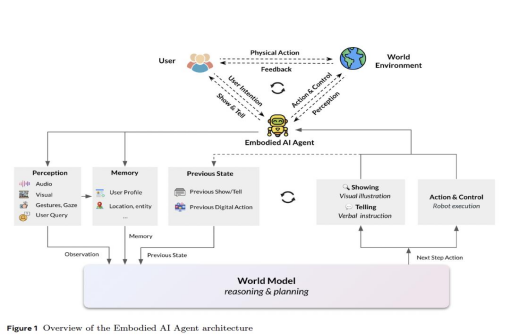

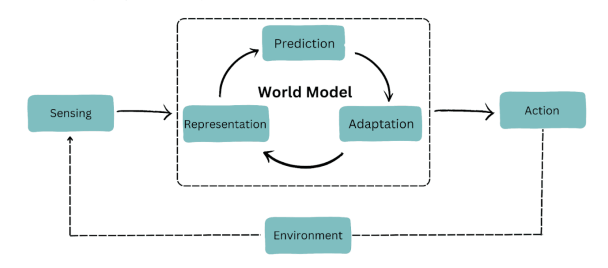

一个典型的基于世界模型的端到端系统,可以被理解为一个持续运行的“内在认知循环系统”。它不是线性流程,而是一个高速、闭环、可微分、可训练的认知机器。这个系统通常由三个核心模块构成:感知压缩 → 动态推演 → 规划优化 → 执行 → 再感知

2.1 视觉编码器(Encoder)——感知之眼

它真正做的事情:不是“看见”,而是“抽象”

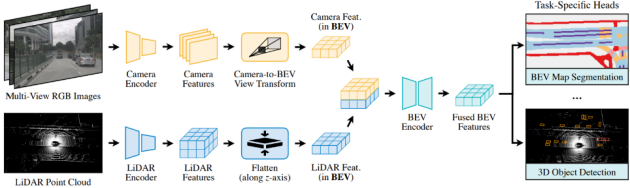

传感器输入本质上是:

-

摄像头图像(高维像素)

-

激光雷达点云(稀疏空间点)

-

雷达回波

-

GPS / IMU

这些数据:

-

维度极高

-

含有大量噪声

-

冗余信息极多

-

不直接适合做决策

所以编码器的核心任务不是“识别物体”,而是:将高维原始观测压缩为低维、结构化、可预测的状态表示。

2.2 什么是“隐状态向量”(Latent State)?

隐状态 Sₜ 不是:

-

一张图

-

一个3D场景

-

一个可视化界面

它是:一个包含环境核心信息的数学向量或张量结构。可以理解为:

Sₜ = f(原始传感器数据)

这个向量里编码了:

-

车道几何结构

-

动态物体位置和速度

-

交通灯状态

-

自车状态

-

潜在风险分布

-

环境语义特征

但它是高度压缩的。例如:

-

输入图像:1920×1080×3 ≈ 600万维

-

隐状态向量:512维 / 1024维

信息被浓缩了上万倍。

2.3 大白话理解:这是AI的“瞬时念头”

你可以把隐状态想象成:AI在这一瞬间对世界形成的一个“意识快照”。当人类开车时,你脑中不会浮现完整的像素图像。你会有一种抽象感受:

-

前方慢车

-

左侧可变道

-

右侧危险

-

天气良好

AI的隐状态,就是这种“意识压缩版”。

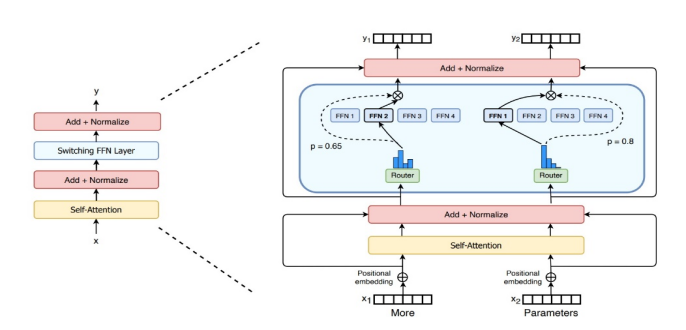

2.4 技术实现层

常见结构包括:

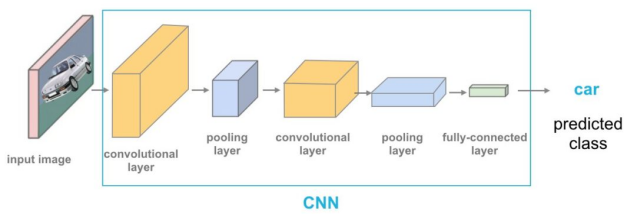

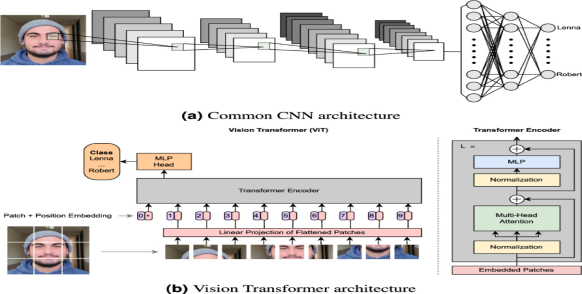

-

CNN(卷积神经网络)擅长提取空间结构特征。

-

Vision Transformer (ViT)通过自注意力机制建模长距离依赖关系。

-

BEV转换模块将多摄像头图像映射到鸟瞰图空间。

关键目标:

-

抽象

-

压缩

-

可预测

-

保留动力学信息

如果压缩得不好,后续世界模型将无法准确预测。

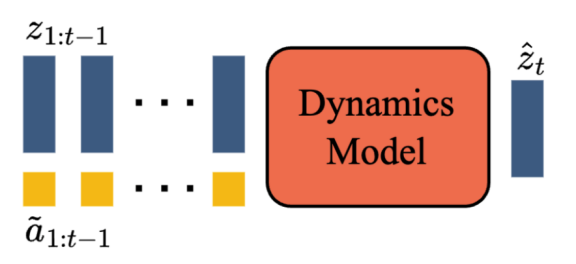

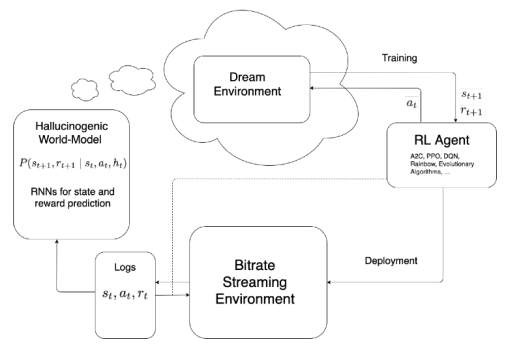

2.5 世界模型本体(World Model)—— 梦境引擎

这是系统的“时间机器”。如果说Encoder是“理解现在”,那World Model是“计算未来”。世界模型学习的是:Sₜ₊₁ = F(Sₜ, Aₜ)更准确是:P(Sₜ₊₁ | Sₜ, Aₜ)这是一个状态转移函数。它刻画了:如果在当前世界状态下执行某个动作,世界将如何变化。

2.6 它到底在预测什么?

它预测的不是:原始像素,而是:下一时刻的隐状态

也就是说,它在预测:“念头”如何变化。这点非常重要。因为预测隐空间比预测像素:

-

更稳定

-

更高效

-

更可泛化

2.7 “做梦”的真正含义

当你说它在做梦,本质是:

-

它断开真实传感器输入

-

仅依赖内部状态

-

进行闭环状态滚动预测

例如:S₀ → (A₀) → S₁ → (A₁) → S₂ → (A₂) → S₃ ...

这一整段演化:完全在神经网络内部发生,没有真实摄像头参与,这就是“内部梦境”。

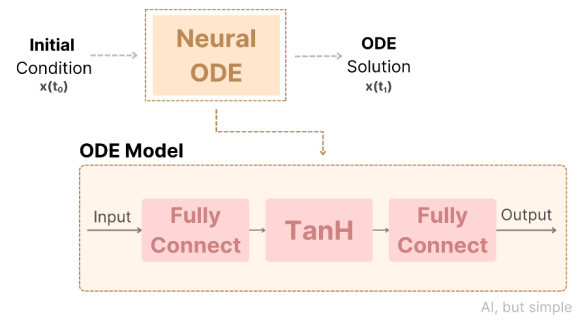

2.8 时间建模的技术实现

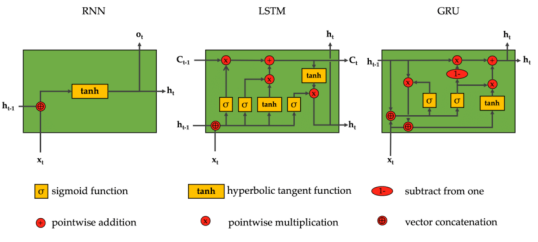

由于涉及时间序列,常见结构包括:

-

RNN / LSTM / GRU早期常用结构,擅长短期依赖。

-

时序Transformer能够建模长时间依赖,更适合复杂驾驶场景。

-

Diffusion Dynamics Model用生成模型预测未来分布。

-

Neural ODE建模连续时间动力学。

目标是:

-

稳定

-

可长时间滚动预测

-

不发散

-

不崩溃

2.9 关键挑战:误差累积

如果预测稍微有偏差:第1步误差 → 第2步放大 → 第3步失真 → 第10步完全崩溃

因此,世界模型必须:

-

学习长期稳定的动力学结构

-

具备一定的物理一致性

-

能容忍小误差

否则梦境会“跑飞”。

2.10 行动控制器(Controller)—— 决策之脑

这是策略优化器。如果世界模型是“模拟器”,控制器就是“策略搜索器”。

核心思想,控制器不直接问:现在该做什么?而是问:哪个未来最好?这是一种目标驱动型决策方式。

完整工作流程

Step 1:获取当前真实状态 Sₜ,来自编码器。

Step 2:生成候选动作序列,

动作不是单点,而是序列:[Aₜ, Aₜ₊₁, Aₜ₊₂, ..., Aₜ₊ₙ]

例如未来5秒内:

-

加速

-

轻微左转

-

保持直行

Step 3:内部虚拟推演把动作序列输入世界模型:

Sₜ → Sₜ₊₁ → Sₜ₊₂ → ... → Sₜ₊ₙ 得到一个“梦境结局”。

Step 4:评估梦境质量使用价值函数(Value Function)或奖励函数:

-

是否碰撞?

-

是否偏离路线?

-

是否舒适?

-

是否高效?

-

是否违反交通规则?

计算一个总评分。

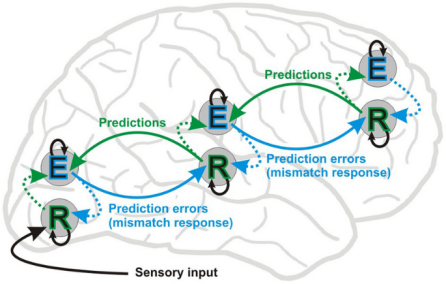

*error units (E) and representation units (R)

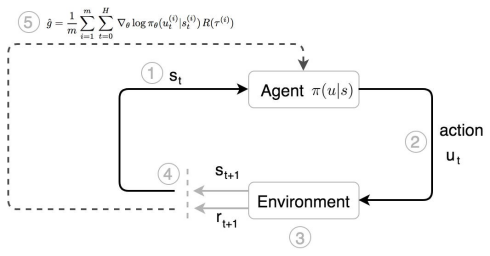

Step 5:优化动作序列控制器会:

-

尝试大量候选序列

-

使用优化算法

-

可能结合强化学习

常见方法包括:

-

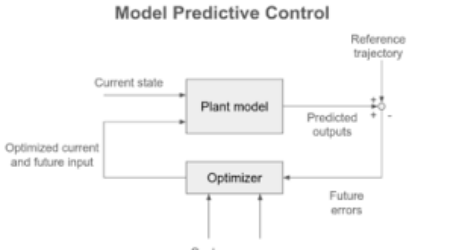

Model Predictive Control (MPC) 一种基于系统模型、在每个时刻优化未来控制序列的实时反馈控制方法。

-

Cross Entropy Method (CEM) 通过迭代采样和筛选高性能样本来求解优化或控制问题的概率优化方法。

-

Policy Gradient直接对策略参数进行梯度优化,以提升强化学习中累积奖励的方法。

-

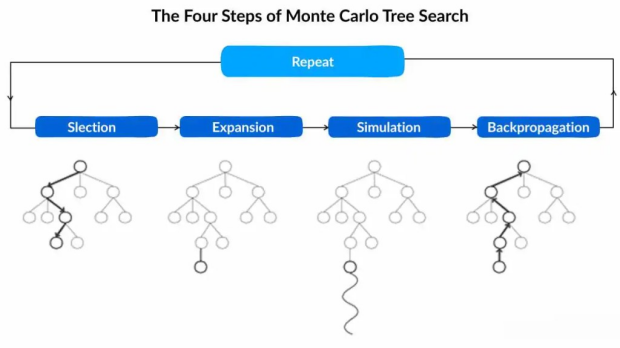

Monte Carlo Tree Search(类似 AlphaGo 使用的方法)通过随机模拟和树状搜索评估未来决策,类似 AlphaGo 用于博弈和规划的方法。

Step 6:执行第一个动作关键点:只执行第一个动作。然后:

-

等待新的真实观测

-

更新隐状态

-

重新规划

这叫做:滚动时域控制(Receding Horizon Control)

整个系统如何形成闭环?我们把它连起来看:

-

真实世界 → 传感器 → Encoder → Sₜ

-

Sₜ + Action → World Model → 未来S

-

未来S → Controller评估

-

Controller → 选择最优Actionₜ

-

Actionₜ → 作用于真实世界

-

世界变化 → 新观测 → 循环

这是一个:

-

持续自校正

-

实时更新

-

永不停歇的认知循环

这个循环带来的本质能力不是简单“更聪明”。而是:

-

时间前瞻性-决策具有时间深度。

-

风险预见性-在碰撞发生前就识别风险。

-

博弈推理能力-理解其他交通参与者的行为趋势。

-

极端场景泛化能力-通过内部模拟经历罕见情况。

这个“感知 → 做梦 → 决策”的循环,本质上是:把行动从“对现实的即时反射”,升级为“对未来的概率推演”。它让车辆具备:

-

在行动前体验未来

-

在风险发生前做出选择

-

在复杂环境中保持全局最优

现实世界只能经历一次。世界模型让系统在每一秒钟,已经“活过”未来的无数种可能。世界模型的意义,从来不在于让机器“更像人”,而在于让决策拥有时间维度。它让系统不再只是对当下刺激做出机械反应,而是能够在内部构建未来、评估风险、权衡博弈,并在行动前完成成百上千次假设推演。现实世界无法回滚,但内部模型可以反复试错;现实只能经历一次,但世界模型允许系统在每一秒都经历无数种未来。正是这种“在行动前已经看过未来”的能力,使自动驾驶从反射式控制,跃迁为真正具备前瞻规划能力的智能系统。这不仅是算法结构的升级,更是智能范式的转变。

参 考:

1. Simplified scheme of the hierarchical predictive coding framework... | Download Scientific Diagram

2. Computation-wise comparison of RNN, LSTM and GRU nodes | Download Scientific Diagram

3. [Literature Review] Enhancing End-to-End Autonomous Driving with Latent World Model

4. World-Models for Bitrate Streaming | MDPI

5. Vision Transformer: A New Era in Image Recognition

6. [Literature Review] A Comprehensive Survey on World Models for Embodied AI

7. Marble: A Multimodal World Model | World Labs

8. Chess-GPT’s Internal World Model | Adam Karvonen

9. Simulating the Visual World with Artificial Intelligence: A Roadmap

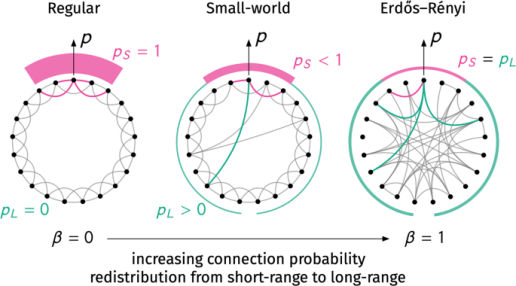

10. Generalization of the small-world effect on a model approaching the Erdős–Rényi random graph | Scientific Reports

11. World Models | Rohit Bandaru

12. Frontiers | Robotic world models—conceptualization, review, and engineering best practices

13. No World Model, No General AI | Richard Cornelius Suwandi

14. Entwicklung und Training eines World Models für die Pfadplanung gekoppelter Planarmover – FAPS – Lehrstuhl für Fertigungsautomatisierung und Produktionssystematik

15. Towards Video World Models

欢迎加入智能交通技术群!扫码进入。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)