【AI大模型前沿】Baichuan-M3-235B:国产开源医疗大模型登顶全球榜单,2350亿参数重构AI临床决策新标准

系列篇章💥

前言

2026年1月,医疗AI领域迎来里程碑式突破。由前搜狗CEO王小川创立的百川智能正式发布Baichuan-M3-235B——这是一款专为医疗场景深度优化的2350亿参数开源大模型。在全球权威医疗评测HealthBench及HealthBench-Hard榜单上,该模型不仅系统性超越OpenAI最新的GPT-5.2,更在多项核心指标上优于人类医生平均水平。这标志着国产大模型在专业垂直领域首次实现全球领跑,也为AI辅助临床决策树立了新的技术基准。

一、项目概述

Baichuan-M3-235B是百川智能推出的新一代医疗增强大语言模型,采用2350亿参数Dense架构(非MoE),以"临床决策过程建模"为核心训练目标。区别于传统医疗AI的静态问答模式,M3创新性提出"主动问诊-深度推理-可靠决策"的端到端能力闭环,通过Fact-Aware强化学习框架与分段流水线训练策略,在无外部工具辅助下实现行业最低的幻觉率,成为目前全球唯一在SCAN-bench临床全流程评测中夺冠的开源医疗模型。

二、核心功能

(一)、临床决策能力全面升级

1、主动式严肃问诊

Baichuan-M3突破传统对话模型"被动应答"的局限,具备原生端到端严肃问诊能力。模型能够模拟真实医生的诊疗思维,主动追问关键病史、挖掘潜在风险信号,逐步逼近问题本质。在SCAN-bench评测的病史采集维度,M3的表现显著超越GPT系列模型及人类医生基线水平。

2、精准疾病推理与鉴别诊断

融合全球80%医学文献、权威临床指南、真实脱敏病历及药品知识库,M3支持多轮深度推理,可处理复杂鉴别诊断场景。其推理过程透明可解释,为医生提供可靠的决策参考路径。

3、超低幻觉率保障

医疗场景对信息准确性要求极高。M3通过**Fact-Aware RL(事实感知强化学习)**框架,将幻觉率控制在行业最低水平,在无工具辅助情况下优于GPT-5.2,确保用药建议、检验解读等关键环节的可靠性。

(二)、多维度医疗知识融合

1、海量医学语料训练

- 文献层面:覆盖全球主流医学期刊、教科书及循证医学数据库

- 指南层面:整合各专科最新临床诊疗指南与专家共识

- 实践层面:基于真实世界病历数据训练临床思维模式

- 药学层面:构建完整药品知识图谱,支持相互作用分析

2、检验报告智能解读

支持血常规、生化指标、影像报告等多类型检验数据的智能解析,能够识别异常指标、关联临床意义并提供随访建议。

(三)、患者沟通与健康教育

模型具备** expertise-tailored communication**能力,可根据用户医学知识水平调整表达深度,既能为专业医生提供精准学术支持,也能为普通患者提供易懂的健康指导,实现医患沟通的高效桥梁作用。

三、技术揭秘

(一)、架构设计与训练范式

1、235B Dense架构选择

Baichuan-M3采用2350亿参数的Dense架构而非MoE(混合专家)架构,确保医疗推理的确定性与稳定性。Dense架构在单样本推理时激活全部参数,避免了MoE路由随机性可能带来的医疗风险。

2、三阶段分段流水线训练(Segmented Pipeline Reinforcement)

M3创新性地采用三阶段多专家融合训练范式:

-

阶段一:领域专项RL(Domain-specific RL)

针对医疗子领域(内科、外科、药学等)分别进行强化学习,培养专科推理能力 -

阶段二:离线蒸馏(Offline Distillation)

通过高质量医疗对话数据蒸馏,固化模型的事实准确性与表达规范性 -

阶段三:MOPD在线优化(Multi-Objective Policy Distillation)

多目标策略蒸馏,在准确性、安全性、沟通质量之间实现动态平衡

3、Fact-Aware RL框架

传统RLHF在医疗场景易产生"讨好型"回答,牺牲准确性换取用户满意度。M3的Fact-Aware RL引入医学知识图谱约束,将事实一致性纳入奖励函数,从根本上抑制幻觉生成。

(二)、推理加速与部署优化

1、W4量化技术

支持4-bit权重量化(W4),在保持模型精度的同时降低74%显存占用,使235B大模型可在单节点多卡环境部署,大幅降低硬件门槛。

2、Gated Eagle3投机解码

采用投机采样(Speculative Decoding)技术,通过 draft 模型预测多token并验证,实现96%的推理加速。在SGLang框架下,配合EAGLE3算法可显著提升吞吐量。

3、多后端推理支持

官方提供SGLang与vLLM两种高性能推理方案,均支持OpenAI兼容API格式:

# SGLang部署示例(8×H20 96G)

python -m sglang.launch_server \

--model-path baichuan-inc/Baichuan-M3-235B \

--tensor-parallel-size 8 \

--speculative-algorithm EAGLE3 \

--speculative-draft-model-path baichuan-inc/Baichuan-M3-235B/draft

(三)、数据安全与隐私保护

- 训练数据经严格脱敏处理,符合HIPAA及国内医疗数据安全规范

- 支持私有化部署,满足医院内网环境要求

- 开源协议允许商业应用,但禁止用于直接医疗诊断替代

四、基准评测

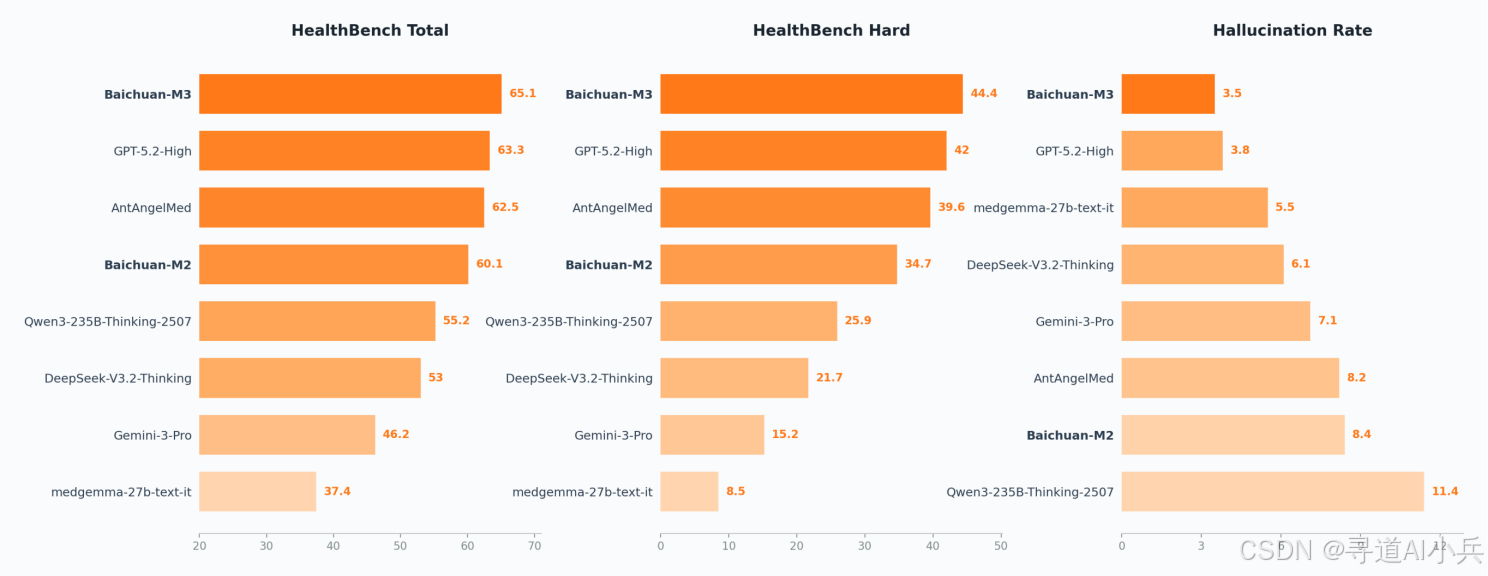

(一)、HealthBench权威评测

HealthBench是由OpenAI牵头、262名全球医生参与的权威医疗评测基准,包含5000个多轮临床对话场景,覆盖26个专科、49种语言,从准确性、完整性、情境感知、沟通质量等维度综合评估。Baichuan-M3在HealthBench主榜单取得全球最高综合得分,超越GPT-5.2及前代所有模型。这一成绩在OpenAI定义的医学能力标准体系下实现了国产模型的系统性超越。在强调复杂临床决策的Hard子集(1000个高难度案例)中,M3以44.4分夺冠,在高度不确定性与困难推理场景下展现出超越人类医生的稳定性与可靠性。

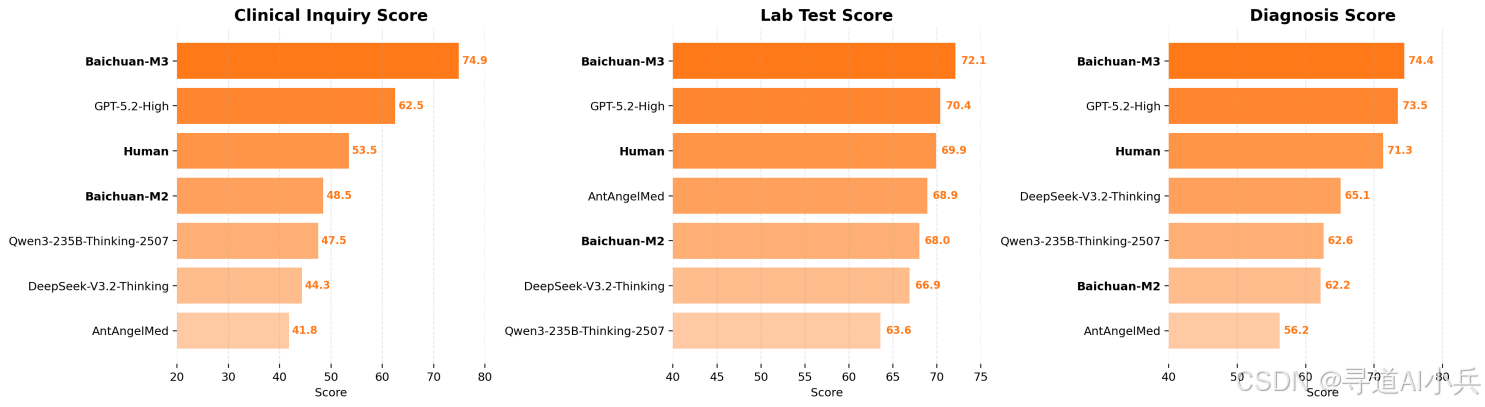

(二)、SCAN-bench临床全流程评测

SCAN-bench聚焦完整临床诊疗流程,评估模型在病史采集、辅助检查、疾病诊断三大核心维度的表现。M3是唯一在三大维度均位列榜首的模型,证明其已具备支撑完整诊疗流程的能力,而非仅停留在对话表层。

五、应用场景

(一)、基层医疗普惠

在医疗资源匮乏地区,M3可提供7×24小时智能导诊与辅助诊断服务,精准收集病史、推荐就诊科室,并为全科医生提供鉴别诊断建议与用药风险提示,有效缓解基层医生短缺压力,降低漏诊误诊率。同时支持高血压、糖尿病等慢性病长期管理,实现从"治病"到"防病"的转变,让基层患者享受专家级诊疗支持。

(二)、三甲医院提效

为大型医院提供病历文书自动生成、检验报告智能预解读及多学科会诊支持。自动提取问诊关键信息生成结构化病历,节省医生文书时间;智能标记异常指标并关联临床意义,加速诊疗决策;整合跨专科知识库为复杂病例提供循证医学证据,提升MDT协作效率,助力医生更专注于核心诊疗工作。

(三)、互联网医疗升级

为在线问诊平台提供底层AI能力,确保线上服务专业性与安全性,降低医疗纠纷风险。实时解析患者用药清单,识别潜在药物相互作用并生成风险评估报告;基于权威医学知识生成个性化健康科普内容,提升患者疾病认知与依从性,构建可信的数字化医疗服务体系。

(四)、医学教育科研

作为临床思维训练工具,帮助医学生通过与M3对话学习标准问诊流程与鉴别诊断思路,加速临床能力培养。同时利用模型广泛的知识覆盖,为罕见病诊疗提供文献综述与案例参考,助力医学科研突破,推动医疗AI从"技术验证"走向"临床价值"的转化。

六、快速使用

(一)、环境准备

硬件要求:

- 全精度推理:8×A100/H100(80GB显存)或8×H20(96GB显存)

- 量化推理:4×A100(通过W4量化可单卡部署)

- 内存:系统内存建议512GB以上

软件依赖:

pip install transformers>=4.36.0

pip install torch>=2.1.0

# 高性能推理二选一

pip install sglang>=0.4.6.post1

# 或

pip install vllm>=0.9.0

(二)、基础推理示例

使用HuggingFace Transformers进行基础推理:

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

# 加载模型与分词器

model_path = "baichuan-inc/Baichuan-M3-235B"

model = AutoModelForCausalLM.from_pretrained(

model_path,

trust_remote_code=True,

torch_dtype=torch.bfloat16,

device_map="auto"

)

tokenizer = AutoTokenizer.from_pretrained(model_path)

# 构建问诊对话

messages = [

{"role": "user", "content": "我最近总是头痛,尤其是下午更严重,伴随视力模糊,需要怎么处理?"}

]

# 应用对话模板(开启思考模式)

text = tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True,

thinking_mode='on' # 开启深度推理模式

)

# 生成回复

model_inputs = tokenizer([text], return_tensors="pt").to(model.device)

generated_ids = model.generate(

**model_inputs,

max_new_tokens=32768,

temperature=0.6,

top_p=0.9

)

response = tokenizer.decode(

generated_ids[0][len(model_inputs.input_ids[0]):],

skip_special_tokens=True

)

print(response)

(三)、生产环境部署(SGLang + 投机解码)

步骤1:准备draft模型

下载官方提供的draft模型用于投机采样加速。

步骤2:启动推理服务

python3 -m sglang.launch_server \

--model-path baichuan-inc/Baichuan-M3-235B \

--tensor-parallel-size 8 \

--trust-remote-code \

--mem-fraction-static 0.8 \

--host 0.0.0.0 \

--port 80 \

--speculative-algorithm EAGLE3 \

--speculative-draft-model-path baichuan-inc/Baichuan-M3-235B/draft \

--speculative-num-steps 5 \

--speculative-eagle-topk 8 \

--speculative-num-draft-tokens 32 \

--reasoning-parser qwen3

步骤3:API调用示例

import openai

client = openai.OpenAI(

base_url="http://localhost:80/v1",

api_key="none"

)

response = client.chat.completions.create(

model="baichuan-inc/Baichuan-M3-235B",

messages=[

{"role": "user", "content": "35岁男性,持续胸痛2小时,放射至左肩,伴大汗,既往高血压病史"}

],

temperature=0.6,

max_tokens=4096

)

print(response.choices[0].message.content)

七、结语

Baichuan-M3-235B以2350亿参数登顶全球医疗大模型榜单,标志着国产AI在专业领域实现从跟跑到领跑的跨越。其低幻觉、强推理、端到端问诊能力,为基层医疗赋能与临床提质增效提供了可靠路径。期待这一开源成果持续推动"Benchmark to Bedside"转化,让AI真正成为医患信赖的智能伙伴。

项目地址

- GitHub开源仓库:https://github.com/baichuan-inc/Baichuan-M3-235B

- HuggingFace模型页:https://huggingface.co/baichuan-inc/Baichuan-M3-235B

- 在线体验地址:https://ying.ai/

🎯🔖更多专栏系列文章:AI大模型提示工程完全指南、AI大模型探索之路(零基础入门)、AI大模型预训练微调进阶、AI大模型开源精选实践、AI大模型RAG应用探索实践🔥🔥🔥 其他专栏可以查看博客主页📑

😎 作者介绍:资深程序老猿,从业10年+、互联网系统架构师,目前专注于AIGC的探索(CSDN博客之星|AIGC领域优质创作者)

📖专属社群:欢迎关注【小兵的AI视界】公众号或扫描下方👇二维码,回复‘入群’ 即刻上车,获取邀请链接。

💘领取三大专属福利:1️⃣免费赠送AI+编程📚500本,2️⃣AI技术教程副业资料1套,3️⃣DeepSeek资料教程1套🔥(限前500人)

如果文章内容对您有所触动,别忘了点赞、⭐关注,收藏!加入我们,一起携手同行AI的探索之旅,开启智能时代的大门!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)