如果有无限算力,你想做什么?如果你有谷歌的一倍算力,10倍算力,甚至100倍算力,你会做什么?

如果有无限算力,你想做什么?

所谓无限算力,可能有些超乎我们的想象,我们先了解下当今地球上各大公司的算力,然后以地球上最大公司的算力为单位,如果你有谷歌的一倍算力,10倍算力,甚至100倍算力,你会做什么?

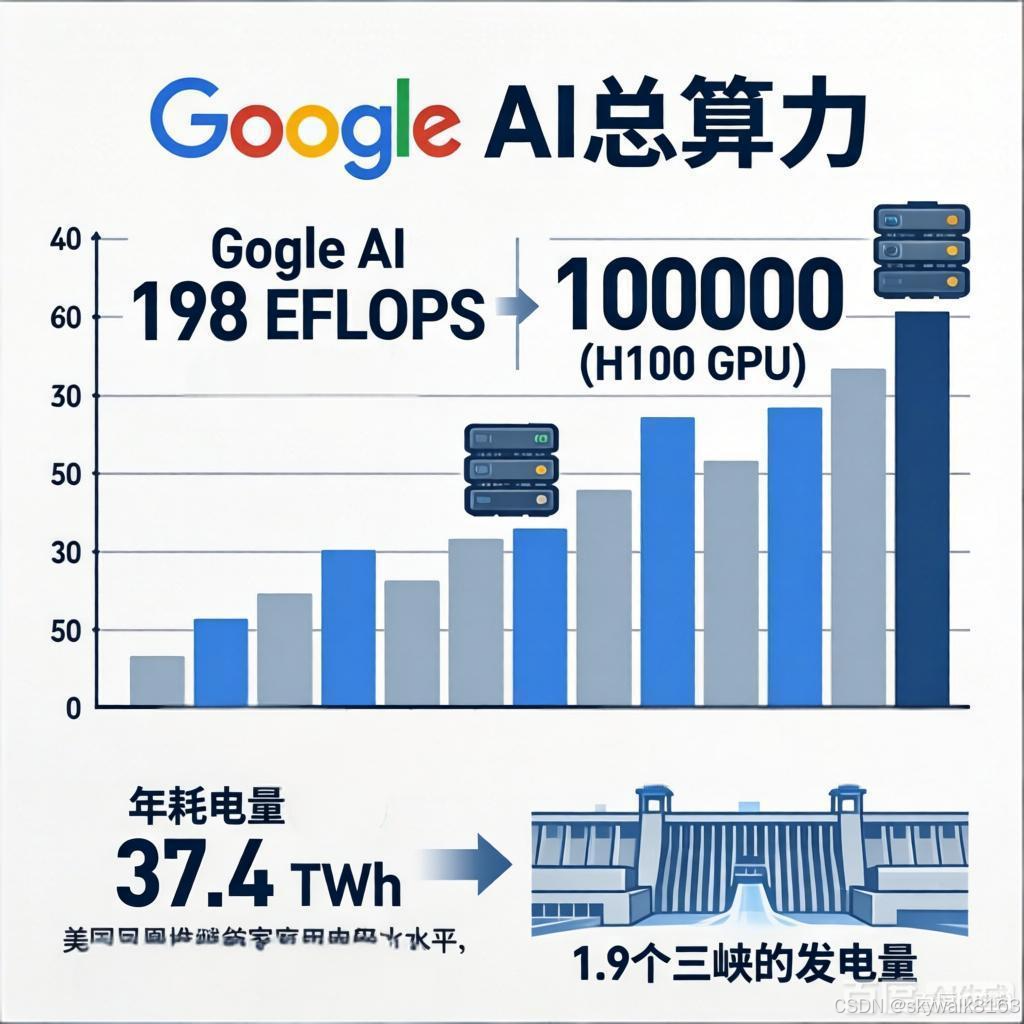

🌐 全球主要AI公司算力概览(以H100等效芯片为基准)

谷歌AI算力中相当于100万块H100 GPU的总算力约为198 EFLOPS(FP8精度)

100万块H100 GPU每年耗电量约为37.4亿千瓦时(37.4 TWh),相当于一个中型国家的年用电量,其功耗规模已接近美国凤凰城所有家庭的总用电水平,约等于 1.9 个三峡水电站的年发电量。

根据2024-2025年数据估算,全球领先科技公司拥有的AI算力大致如下:

Google(含Alphabet)

算力规模:相当于超过100万块NVIDIA H100 GPU

核心支撑:自研TPU(张量处理单元)集群,尤其是TPU v5e和v5p的大规模部署

应用场景:支撑Gemini大模型训练、搜索AI升级、YouTube推荐系统及医疗AI研究

特点:TPU在训练效率上优于通用GPU,尤其适合Google内部AI架构优化

Microsoft

算力规模:约50万块H100等效GPU

核心支撑:Azure云平台 + 与OpenAI深度合作

应用场景:为ChatGPT、GPT-4o等模型提供训练与推理服务,同时服务第三方企业客户

特点:是目前公开信息中最集中的NVIDIA GPU持有者之一,并持续扩建AI数据中心

Meta(Facebook母公司)

算力规模:已部署超35万块H100 GPU,计划2026年前达到60万块以上

核心支撑:自建AI超级集群(AI Foundry),采用Meta定制化硬件架构

应用场景:驱动Llama系列开源大模型、广告推荐、内容审核与元宇宙AI代理

特点:强调开放与规模化,推动Llama生态成为全球最活跃的开源AI社区之一

Amazon(AWS)

算力规模:AWS拥有数十万块H100及Trainium芯片,整体算力位居前列

核心支撑:EC2 Trn3实例(基于Trainium2芯片)、Graviton4处理器、自研Inferentia推理芯片

应用场景:为企业客户提供AI训练与推理服务,支持Anthropic、Hugging Face等AI公司

特点:Trainium3芯片能效比提升40%,Trn3 UltraServer性能较前代提升4倍以上

xAI(马斯克旗下)

算力规模:Colossus超算集群配备20万块AI芯片(主要为H100级别)

核心支撑:专为训练Grok大模型打造,未来将扩展至“Colossus 2”,功耗达1GW

特点:虽总量不及四大巨头,但单位算力利用率极高,聚焦单一超大规模模型训练

OpenAI

- 算力规模:无独立持有算力,但通过合作获得超 80万块H100等效GPU 的调度能力

- 核心支撑:与微软深度绑定初期,现转向多云架构,主要依赖 甲骨文OCI Zettascale10超级集群(80万GPU)及部分微软Azure资源

中国主要AI企业算力概览

整体算力水平:受限于先进AI芯片获取,目前合计算力约为40万H100等效水平

百度(Baidu)

- 算力规模:合计算力约 数万H100等效水平,受限于进口芯片数量

- 核心支撑:昆仑芯AI芯片 + 文心大模型4.5 + 百度云智算中心

阿里巴巴(Alibaba)

- 算力规模:相当于 约10万H100等效算力(含自研芯片折算)

- 核心支撑:通义千问大模型 + 阿里云PAI平台 + 含光800推理芯片

腾讯(Tencent)

- 算力规模:未公开具体数字,估计在 数万H100等效水平

- 核心支撑:混元大模型 + 腾讯云TI平台 + 星脉网络(自研高性能互联)

抖音(字节跳动)

- 算力规模:未公开,估计 数万级H100等效,集中用于推荐算法与AIGC

- 核心支撑:自研推荐引擎 + 豆包大模型 + 云雀大模型

智谱AI(Zhipu AI)

- 算力规模:较小,约 数千H100等效,依赖高校与政府算力平台支持

- 核心支撑:GLM系列大模型(如GLM-4)、清华背景技术积累

Openi启智社区总调动算力:5E FLOPS

华为出货算力:未知

DeepSeek算力:未知,不太多,但是够用

我国算力规模:962 EFlops

从计算设备侧看(全部已出货服务器),我国计算设备算力总规模达到962 EFlops 全球占比21% ,增速达73%,其中智能算力稳定高速增长,增速达96%,占全国总算力比重超过五分之四。

总结

当前世界主要AI公司的算力规模差异显著,美国科技巨头占据绝对主导地位,其中谷歌、微软、Meta和亚马逊合计掌控全球约75%的前沿AI算力,而中国企业在受限环境下仍积极布局,形成特色化发展路径。

问题:如果给你无限的算力,你会用这些算力做什么?

谷歌AI算力相当于100万块H100 GPU的总算力,算力约为198 EFLOPS(FP8精度)。每年耗电量约为37.4亿千瓦时(37.4 TWh),相当于一个中型国家的年用电量,其功耗规模已接近美国凤凰城所有家庭的总用电水平,约等于 1.9 个三峡水电站的年发电量。

现在的问题是,如果你有谷歌的一倍算力,10倍算力,甚至100倍算力,

- 1 倍算力(相当于当今世界单个最强公司:谷歌)

- 10 倍算力 (相当于全球40%的算力)

- 100 倍算力 (相当于全球4倍的算力)

你会用这些算力做什么?

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)