无需逐设备标定:Gelsight 助力视触觉传感器 迎来通用力模型新方案

引言

对于机器人触觉感知的研究者与开发者而言,传感器的标定工作一直是令人头疼的环节。最近,一项名为FeelAnyForce的研究提供了一种优雅的解决方案:一个模型,兼容多种视触觉传感器。本文将深入解读其技术细节与复现要点。

一、 模型架构:双任务驱动下的特征学习

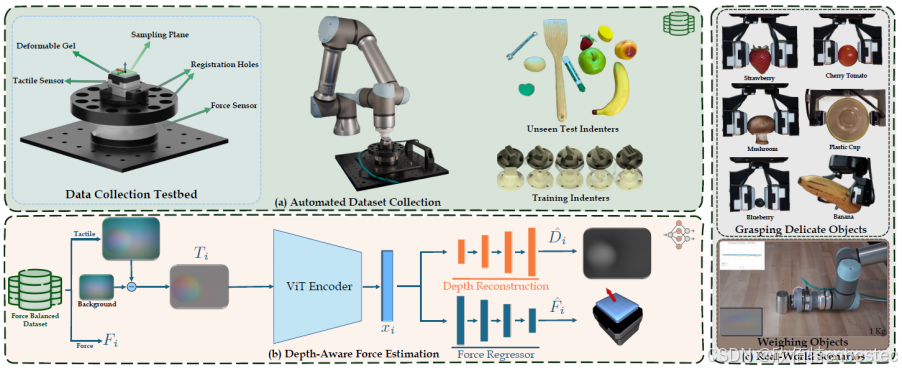

图 1:自动化采集平台(UR机械臂 + GelSight Mini + 六维力传感器)→ 网络架构(ViT 编码器 + 力 / 深度双解码头)→ 下游应用(称重、抓取)

研究采用DINOv2预训练的Vision Transformer(ViT)作为图像编码器主干。其关键设计在于双任务解码头:

> 力回归头(MLP):直接输出三维接触力向量(Fx, Fy, Fz),覆盖0-15N的力范围。

> 深度解码器:重建接触区域的深度图。

通过同时优化这两个任务,模型被强制学习与具体传感器光学特性解耦的、更具通用性的物理特征。消融实验表明,移除深度预测分支会导致跨传感器误差飙升,证明了该设计的有效性。

二、 训练策略:渐进式适应保障泛化能力

1、预训练:使用在大规模数据集上预训练的ViT,获得强大的通用视觉特征提取能力。

2、任务微调:在超过20万张GelSight Mini采集的真实接触图像-力数据对上,进行端到端微调,使模型专注于力估计任务,将误差降至4.2%。

3、快速适配:对于新的GelSight Mini传感器(如更换凝胶后),仅需约100张图像的校准数据,无需重新训练整个模型,即可恢复性能。

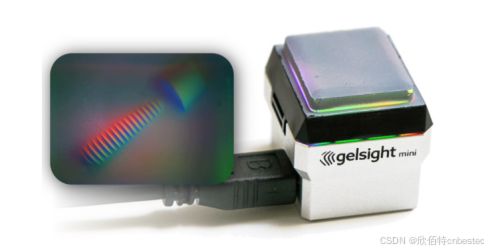

三、为什么选择 GelSight Mini 做基准?

|

优势 |

说明 |

|

MIT开创,视触觉行业领导者 |

Gelsight于2009年开创和商业化视触觉传感器 |

|

深度原生,迁移基石 |

独创光度立体法+透明凝胶体系,微米级精度且与材料无关——本研究"深度监督"设计的关键 |

|

机械一致,数据可靠 |

凝胶同心度<0.5mm,3×3交叉验证误差4.2%-6.3%,支撑200K样本采集与跨设备泛化 |

|

全球采用,学术认可 |

ROS/PyTouch原生支持,5分钟即插即用,全球顶尖实验室广泛采用 |

核心契合:深度可控 + 机械一致 + 学术权威 → 成为训练通用力模型、验证跨传感器迁移的 不二选择!

四、 实验验证:从静态测试到动态应用

研究进行了多维度验证:

- 静态力估计:对10种不同物体进行测试,平均误差仅4.2%。

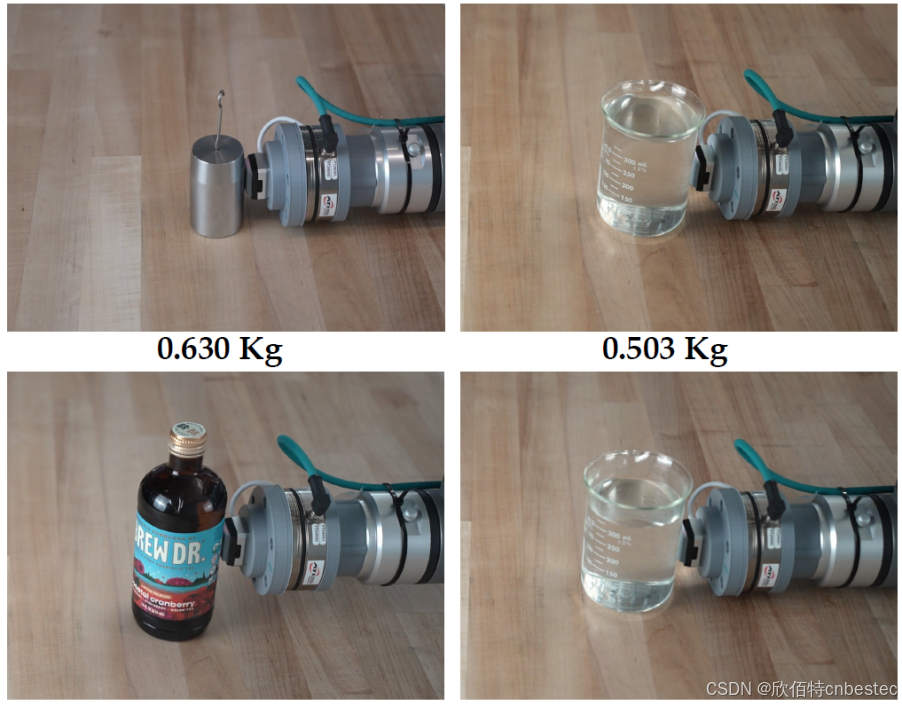

- 推物称重:利用估计的摩擦力反推物体重量,误差在6-10%之间,证明了亚牛顿级(0.06N)的精度。

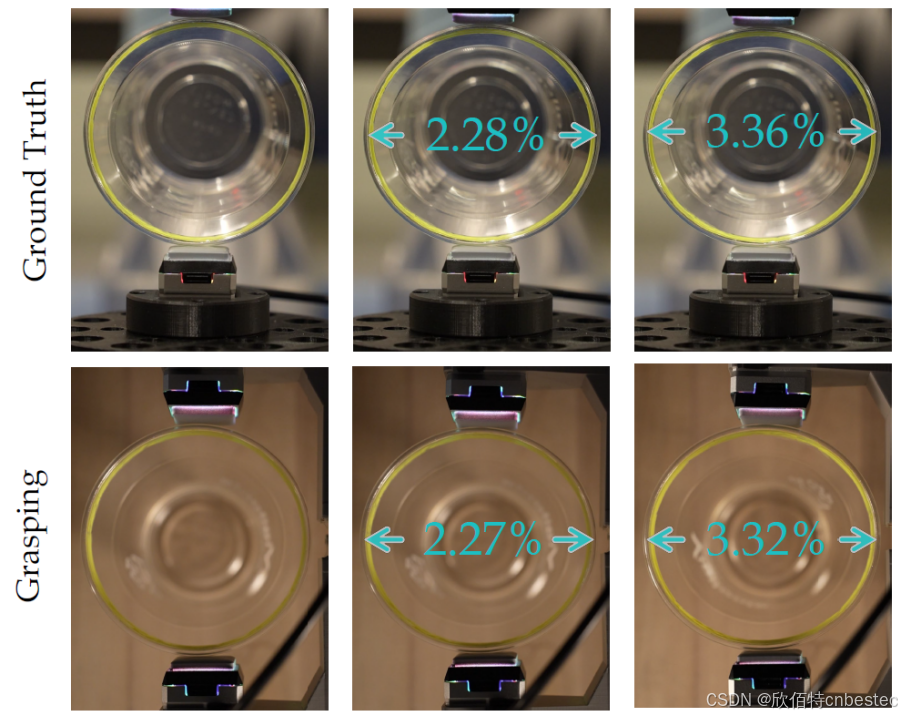

- 形变控制:在抓取易碎塑料杯的任务中,能精准控制杯沿形变量,误差小于0.05%,展示了在未见形状上的泛化能力。

图3:通过推动进行物体重量估计。测试对象包括1kg金属砝码、装水瓶子(0.559kg/0.503kg)、玻璃瓶(0.63kg),验证动态力估计精度

图4:塑料杯 rim 形变定量控制实验。目标形变2.28%(力1.74N)和3.36%(力2.1N),实际达到2.27%和3.32%,误差<0.05%

五、 复现实践指南

对于想复现或借鉴此工作的团队,研究给出了清晰路径:

1、硬件配置:核心是GelSight Mini传感器与UR机械臂组成的自动化数据采集平台。力真值采集推荐使用BOTA系列六维力传感器(如MiniONE Pro)。

复现参考:GelSight Mini和MiniONE安装 在Robotiq指尖,

SensONE安装在UR 机械臂末端实物图

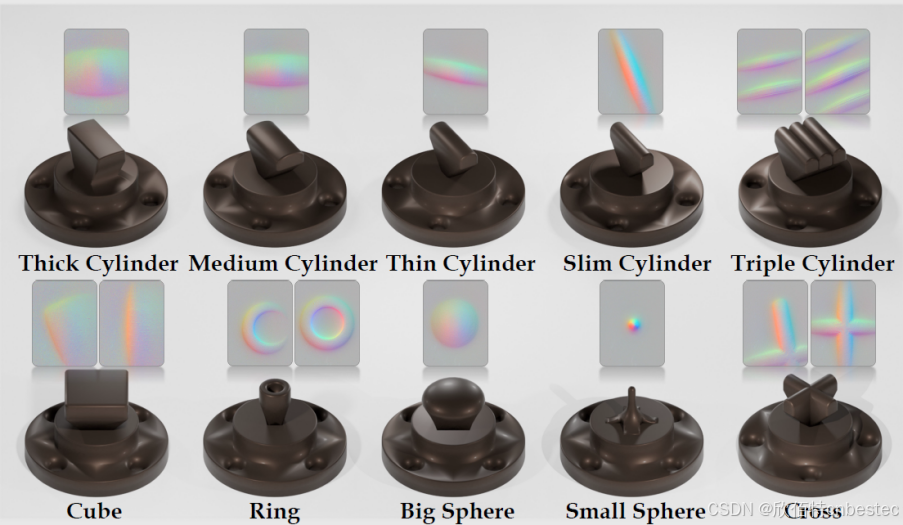

2、数据采集:可参考论文使用的10种3D打印压头,模拟多样接触场景。

3、迁移部署:训练好的模型可通过冻结ViT编码器、仅微调回归头的方式,快速适配到Digit等其他视触觉传感器上。

结语

这项研究为触觉感知模型提供了一种可泛化的设计思路,降低了GelSight Mini等先进传感器技术的应用门槛。其开源代码与详细方法,值得相关领域开发者深入研究。

论文链接

论文链接:https://arxiv.org/pdf/2410.02048.pdf

项目主页:http://prg.cs.umd.edu/FeelAnyForce

欢迎关注 “欣佰特科技” ,持续为大家带来 “具身智能领域”前沿技术及应用!详情可邮件咨询sales@cnbestec.com

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)