别让AI把你“烧了”,法律人正在经历的两种隐性风险

这段时间,一个词开始在职场里反复出现:

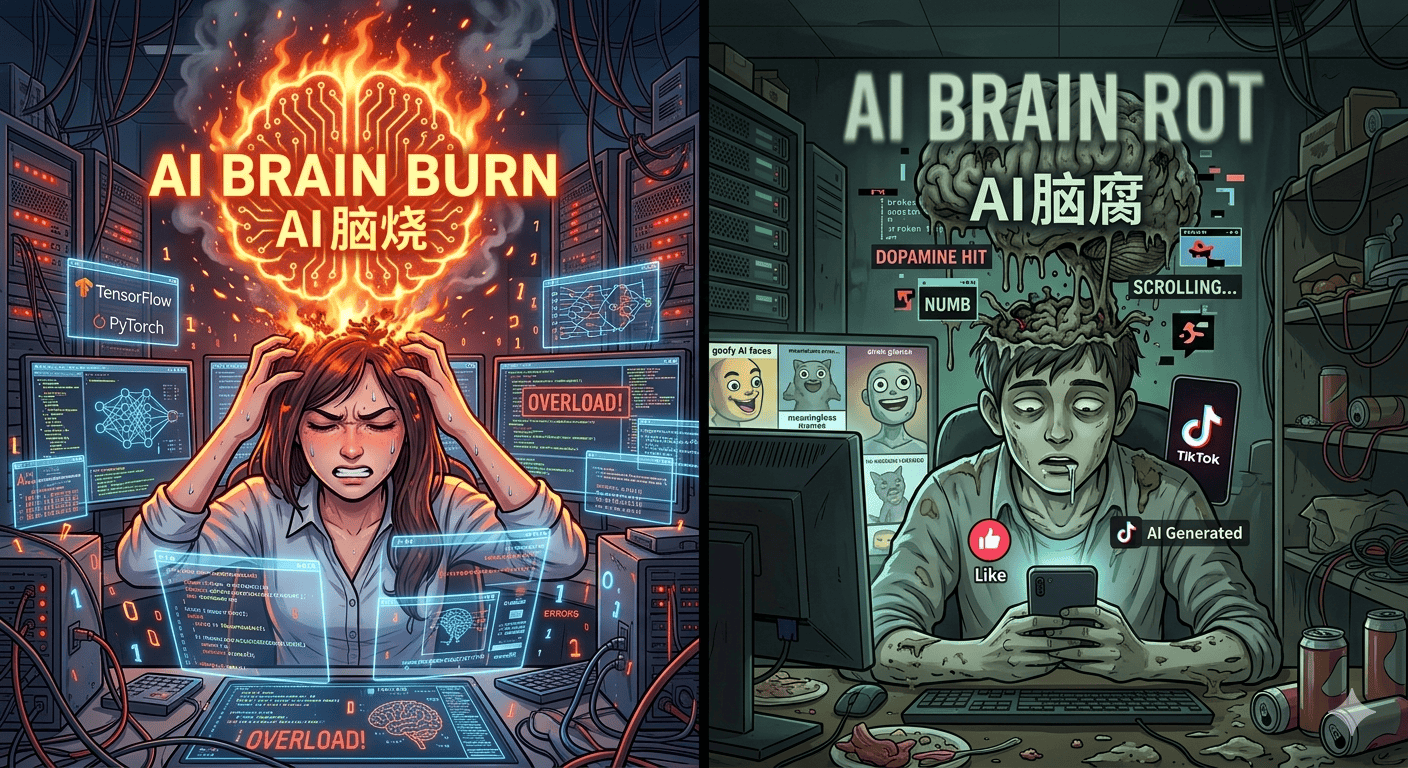

AI脑烧(AI Brain Fry)

Harvard Business Review 在2026年3月的一项研究里提到:

14%的职场人,在使用AI后出现明显的认知过载和精神疲惫。

有人形容得很直白:

- 脑子像开了20个标签页

- 一直在改prompt

- 明明用了AI,反而更累

很多人第一反应是:

是不是AI的问题?

但如果你是做法务的,可能已经隐约感觉到——

这件事没那么简单。

一、法律人,其实是最容易“脑烧”的一群人

有个细节很有意思:

研究里显示,法务是“AI脑烧”比例最低的群体之一(约6%)。

看起来像是“幸存者”。

但如果你真的在用AI做合同审查,你可能知道另一面:

👉 法务不是不烧,而是“还没全面用起来”。

一旦开始深度使用,比如:

- 用AI审合同

- 写法律意见

- 做条款修改

- 跟AI反复对话优化结果

很快就会进入一种状态:

不是你在工作,是你在“伺候AI”。

二、先分清:什么是“AI脑烧”,什么是“AI脑腐”?

AI生成

很多人把这两个概念混在一起,但其实完全不是一回事。

1.AI脑烧:短期过载(你现在就可能在经历)

典型表现:

- 一份合同改了5轮prompt还不满意

- AI给的建议要反复核验

- 信息太多,反而更难判断

- 一天下来,比纯人工还累

本质是:

认知负荷被放大,而不是被减轻

2.AI脑腐:长期退化(更危险,但不容易察觉)

典型表现:

- 不再自己判断条款是否有风险

- 习惯直接接受AI结论

- 写意见越来越依赖生成

- 审查逻辑开始变“模糊”

本质是:

思考能力被“外包”之后逐渐退化

可以用一句话区分:

- 脑烧:你太用力了

- 脑腐:你不用力了

而最危险的,是这两件事会连在一起发生:

反复脑烧 → 选择放弃思考 → 进入脑腐

三、问题不在AI,而在法律场景的“使用方式错了”

很多公司现在的做法,其实很熟悉:

- 给你一个大模型

- 或者接入一个AI工具

- 然后说:去用吧

听起来是不是很像当年的:

- Excel刚进公司

- 邮箱刚普及

结果是什么?

- Excel变成“公式研究工具”

- 邮箱变成“信息轰炸器

今天,AI正在重复同样的路径。

但法律场景有一个更致命的问题:

它不是一个“信息处理问题”,而是一个“判断系统问题”。

如果没有规则、标准、边界:

- AI给你10条建议

- 你要花时间判断哪条是对的

👉 这就是脑烧的根源。

四、法律人正确使用AI的关键:不是更会问,而是“少让自己判断”

很多人以为,AI用得好的人,是“prompt高手”。

但在法律场景里,真正高效的人,反而在做另一件事:

减少需要自己判断的次数。

五、5个实操方法:避免脑烧,也避免脑腐

下面这部分是最关键的,可以直接用👇

方法1:不要让AI“自由发挥”,先给它边界

错误用法:

- “帮我审一下这份合同”

正确用法:

- 明确审查范围(只看违约责任 / 付款条款等)

- 明确判断标准(超过多少比例算风险)

👉 本质:把你的判断标准前置

方法2:把“判断”变成“选择题”,而不是“问答题”

错误方式

- 让AI直接给结论

更优方式:

- 让AI列出风险等级 + 修改方案

- 你只做选择

👉 降低认知负担,而不是增加信息量

方法3:不要反复调prompt,改“流程”

很多人陷入一个误区:

结果不好 → 改prompt → 再试一次

但真正该改的是:

- 是否拆分任务(识别 / 判断 / 修改分开)

- 是否分步骤执行

👉 流程设计,比prompt更重要

方法4:建立“自己的审查标准”,而不是每次重来

如果每次你都在

- 重新判断什么是风

- 重新解释公司立场

那一定会脑烧。

更好的方式是:

- 固化审查标准

- 让AI基于这套标准工作

👉 这一步,才是从“工具使用”走向“系统使用”

方法5:刻意保留“必须自己思考的部分”(防脑腐)

建议保留三件事一定自己做:

- 最终风险判

- 关键条款决策

- 复杂场景分析

👉 AI可以帮你做80%,但20%必须自己守住

六、再说一个更现实的问题:AI发展太快,法务怎么跟上?

现在最大的问题,不是AI不好用,而是:

变化速度太快,使用方式跟不上

很多法务会有一种焦虑:

- 今天这个工具好用

- 明天又换一套

- 学不完

但真正需要跟上的,不是工具,而是三件事:

1. 学会“任务拆解”

任何复杂工作,都可以拆成:

- 识别

- 判断

- 输出

2. 学会“定义标准”

不是让AI更聪明,而是:

让AI按你的标准做事

3. 学会“设计流程”

AI不是一个点,而是一条链路。

七、一个真实场景:一条违约责任条款,是怎么被“AI+人”一起改出来的?

讲一个很多法务都遇到过的场景。

某公司在审一份采购合同,对方给了一条看起来“很正常”的违约责任条款:

“如一方违约,应承担因此给对方造成的全部损失,包括但不限于直接损失、间接损失及预期利益损失。”

业务同事的第一反应是:

“这条挺常规的吧?以前也见过。”

但法务看一眼,基本都会皱眉。

问题不在“有没有写违约责任”,而在:

- 责任范围无限扩大(包含间接损失、预期利益)

- 没有上限

- 对己方极其不利

1.传统做法:人工硬改(高耗能,容易“脑烧”)

过去的处理方式通常是:

- 法务自己改一版

- 写一句“建议修改为……”

- 来回邮件沟通3-5轮

中间会发生什么?

- 业务问:“为什么不能这样写?

- 对方问:“你们依据是什么?”

- 法务还要再补解释

👉 一条条款,来回折腾半天

2.引入AI后的“第一阶段”:更快,但更累

很多人现在会这么做:

- 把条款丢给AI

- 问:“这条有没有风险?”

AI通常会给出一段很长的分析:

- 指出风险 ✔

- 给出修改建议 ✔

- 甚至列一堆法律依据 ✔

看起来很好,但实际体验是:

👉 信息更多了,但判断压力也更大了

你还是要:

- 判断AI说得对不对

- 判断改法是否符合公司策略

- 再手动整理成对外话术

这一步,其实很容易进入“AI脑烧”:

看了很多,但更累了。

3.优化后的做法:让AI做“80%”,人只做“关键20%”

真正高效的方式,通常是把流程改掉,而不是多问几次。

✔ 第一步:限定AI的任务(不让它发散)

不是问:

“有没有风险?”

而是直接定义:

- 识别风险点

- 标注风险等级

- 给出2-3种可选修改方案(不同强度)

✔ 第二步:让AI输出“结构化结果”,而不是一大段话

例如输出变成:

风险识别:

- 风险类型:责任范围过宽

- 风险等级:高

修改方案:

- 方案A(强保护):不承担间接损失 + 责任上限=合同金额30%

- 方案B(平衡):不承担预期利益损失 + 上限=合同金额50%

- 方案C(弱保护):保留部分责任,但排除间接损失

✔ 第三步:法务只做一件事——选方案 + 微调

这时候,法务的工作就从:

- “从0写答案”

变成:

- “在已有方案中判断最合适的一种”

比如最终定稿为:

“违约方仅对因其违约行为给对方造成的直接损失承担赔偿责任,且赔偿总额不超过本合同项下已支付金额的30%。”

4.最关键的变化,不是快了,而是“不会再反复烧脑”

这个过程中,最重要的变化其实不是效率,而是:

✔ 不再反复思考同一个问题

- 什么算风险 → 已定义

- 怎么改 → 有模板

- 改到什么程度 → 有边界

✔ 审查逻辑开始“沉淀”

这次的修改,不只是解决了一份合同,而是:

👉 变成下一份合同的标准答案

✔ AI开始“越用越准”

当类似条款越来越多:

- 系统会知道你更倾向选哪种方案

- 风险判断会越来越贴近公司立场

5.这就是“避免脑烧”的核心方式

回到前面说的“AI脑烧”,你会发现:

问题从来不是:

AI给得不够多

而是:

你每次都在重新判断一切

真正有效的方式是:

- 把判断前置(规则化)

- 把输出结构化(减少理解成本)

- 把决策简化(选择而不是创造)

最后补一句

很多人以为:

用AI,是让自己更聪明

但在合同审查这种工作里,更重要的是:

让自己不用每次都重新聪明一遍。

结尾

很多人问:

AI到底是帮手,还是“脑力杀手”?

答案其实很简单:

它会放大你原本的工作方式。

如果你的方式是混乱的,它会让你更混乱;

如果你的方式是清晰的,它会让你更高效。

所以问题从来不是:

“AI会不会替代你?”

而是:

“你有没有能力,让AI不把你拖垮。”

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)