AI 安全测试(AIST)登 Gartner 技术曲线:覆盖 Vibe Coding 至 OpenClaw 全技术栈深度技术版

在2026年这个大模型(LLM)从规模化应用迈向智能体(Agent)深度介入业务的关键节点,安全治理的底层逻辑正在发生深刻跃迁 。当开发者沉浸在“Vibe Coding”带来的极致效率时,安全管理者正面临一个前所未有的“数字黑盒”:不仅代码逻辑在变,连攻击的边界都在意图交互中变得模糊 。

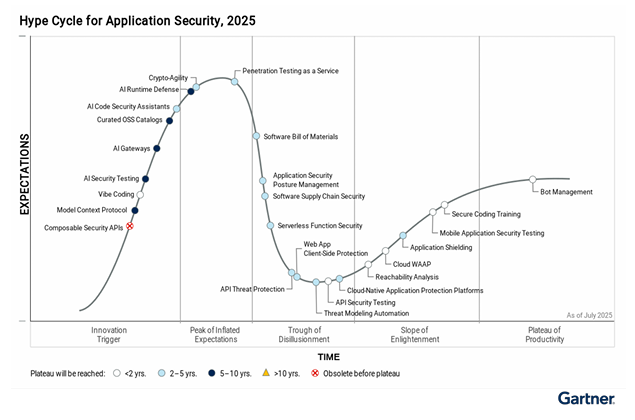

Gartner 在《Hype Cycle for Application Security, 2025》中明确指出,应用安全正持续受到应用架构、开发方式和攻击面的重大变化影响。报告给出了几组非常值得关注的判断:到 2027 年,至少 30% 的应用安全暴露将来自 Vibe Coding practices;到 2026 年,至少 40% 的组织将默认依赖其应用安全测试厂商提供基于 AI 的漏洞自动修复;到 2029 年,超过 50% 成功攻击 AI agents 的网络攻击将利用访问控制问题,并以直接或间接提示词注入作为攻击向量。报告同时将 AI Security Testing、Vibe Coding 、AI Code Security Assistants 等纳入 2025 年应用安全优先矩阵,说明这些方向已经成为应用安全演进中的关键变量。

这些判断共同指向一个趋势:AI 正在持续重塑应用安全的边界,而 AIST 也正在从单点测试能力,演进为面向 AI 应用全生命周期的安全治理能力。

1► 效率狂飙下的“质量暗角”:

破解Vibe Coding的安全悖论

Gartner报告中提出了一个极具警示性的数据:到2027年,至少30%的应用安全暴露将源于“Vibe Coding”实践 。这种由开发者作为“指挥家”,利用自然语言快速原型化复杂软件的模式,虽然让生产力进入了“心流”状态,却也导致了对生成代码质量、测试和安全性的群体性忽视 。

这种“忽略代码、只看结果”的范式,正成为企业安全最薄弱的环 。Gartner指出,虽然 AI 辅助工具可以帮助修复代码,但工具本身的提示词拼接不当、模型调用失控,正让开发阶段成为治理的最前线 。

在此背景下,安全治理必须“左移”至创作源头。问境AIST所构建的“代码安全护栏”,恰是对这一趋势的响应 。其依托大模型能力,针对系统提示词泄露、恶意指令诱导、不安全工具调用等AI特有风险进行实时监测与精准拦截,确保企业在享受效率红利的同时,不被隐形的安全债拖垮 。

2► 穿透深层组件的“隐身衣”:

从物料清单到模型全血缘追踪

Gartner 强调,随着企业对第三方模型和开源组件的依赖呈指数级增长,软件供应链安全(SSCS)与SBOM(软件物料清单)已成为数字化治理的技术底座 。然而,AI 时代的供应链已不再仅仅是库文件的堆砌,而是涵盖了模型间的微调、量化及继承等复杂的“血缘”关系 。

高度去中心化的开发环境中,大量“影子模型”悄然混入项目 。Gartner 指出,很多组织对本地下载的模型缺乏可见性,这极大限制了安全策略的规模化应用 。

为了穿透这一层“迷雾”,问境 AIST 引入了全要素资产指纹识别技术,能对 AI 应用进行深度“CT扫描” 。它不仅生成颗粒度更细的 AI-SBOM,更能通过模型血缘分析,自动化梳理出模型间的继承关系 。这种透明度让安全官能像审视账单一样掌控 AI 资产,即使在面对 ONNX 或 GGUF 等复杂模型格式的后门时,也能实现秒级定位与全路径追溯 。

3► 从拦截指令到治理“意图”:

构建 “AI数字员工”智能安全护栏

Gartner 预测,到 2029 年,超过 50% 针对 AI 智能体的成功攻击将利用访问控制问题,并以提示词注入为主要载体。面对自然语言驱动的动态逻辑,僵化的规则库已很难应对不断演化的诱导攻击面。

OpenClaw 这类工作流智能体作为“AI 数字员工”,正是这一变化最具代表性的落地形态。它不再停留在单轮问答或单点生成,而是进一步进入任务编排、工具调用、外部连接和执行链路协同的真实业务流程之中。也正因为如此,智能体所面临的安全问题,已经不再只是“输出是否越界”,而是“意图是否被劫持”“权限是否被滥用”“执行链路是否被操控”的系统性问题。

在攻防对等的新维度下,安全不应只是外挂在系统之外的一道“锁”,而需要成为嵌入智能体运行过程的内生防御能力。Gartner 报告提到,AI 安全性测试(AI-ST)和运行时防御(AI Runtime Defense)正处于创新高点,正在成为评估 AI 系统韧性的关键能力。

这也正是问境 AIST“以 AI 治理 AI”核心逻辑的落脚点。面向 OpenClaw 所代表的工作流智能体场景,平台可在上线前通过智能化红队实战验证,对提示词注入、越狱诱导等逻辑攻击进行压力测试,识别风险触发路径;在运行阶段,则通过轻量化探针嵌入执行环境,结合交互上下文识别恶意意图与异常调用。面向工作流智能体不断扩展的攻击面,问境 AIST 所构建的,正是一套更贴近真实业务链路的内生防御机制,使智能体能够在不牺牲迭代效率的前提下,运行在更可信、更可控的轨道上。

4► 在风险时差里抢回主动权:

AI 供应链安全情报构建响应闭环

“攻以守本,唯快不破”,在 AI 安全博弈中,真正拉开治理差距的,往往不是有没有发现风险,而是能否在风险扩散之前完成识别、关联与处置。Gartner 指出,AI 安全相关创新的演进速度远快于传统安全领域,这意味着企业不能再停留在“问题暴露后再补漏”的被动模式,而必须具备面向新型风险的快速感知与快速响应能力。

尤其在 AI 原生应用场景下,风险来源早已不再局限于单一漏洞,而是不断延伸至模型框架缺陷、组件依赖暴露、恶意投毒数据集以及围绕 AI 生态衍生出的各类新型攻击事件。很多时候,企业真正缺少的并不是漏洞信息本身,而是一种能够持续跟踪 AI 相关漏洞、投毒事件与攻击动态,并将外部风险变化快速映射到内部资产和使用链路中的 AI 供应链安全情报能力。

问境 AIST 将 AI 供应链安全情报纳入整体治理框架,持续关注 AI 相关漏洞、投毒样本、风险组件和攻击事件的变化。当外部出现针对特定 AI 框架、模型组件或数据链路的 0Day 攻击与投毒事件时,平台能够快速识别受影响范围,定位关联资产与代码链路,并为修复和处置提供更具针对性的依据,帮助企业构建起小时级的风险响应闭环。

面向AI原生:新一代 AI 数字供应链安全治理体系

“攻以守本,唯快不破!”当 AI 正在从根本上重构IT架构,安全不应是阻碍创新的“刹车”,而应进化为保障智能涌现的基石 。

Gartner 的趋势预判为我们划定了航线,而问境 AIST 的发布,则是悬镜安全在这条航线上交出的实战答卷:通过构建从传统供应链到 AI 原生供应链的全生命周期治理体系,让企业始终握有防御的先机 。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)