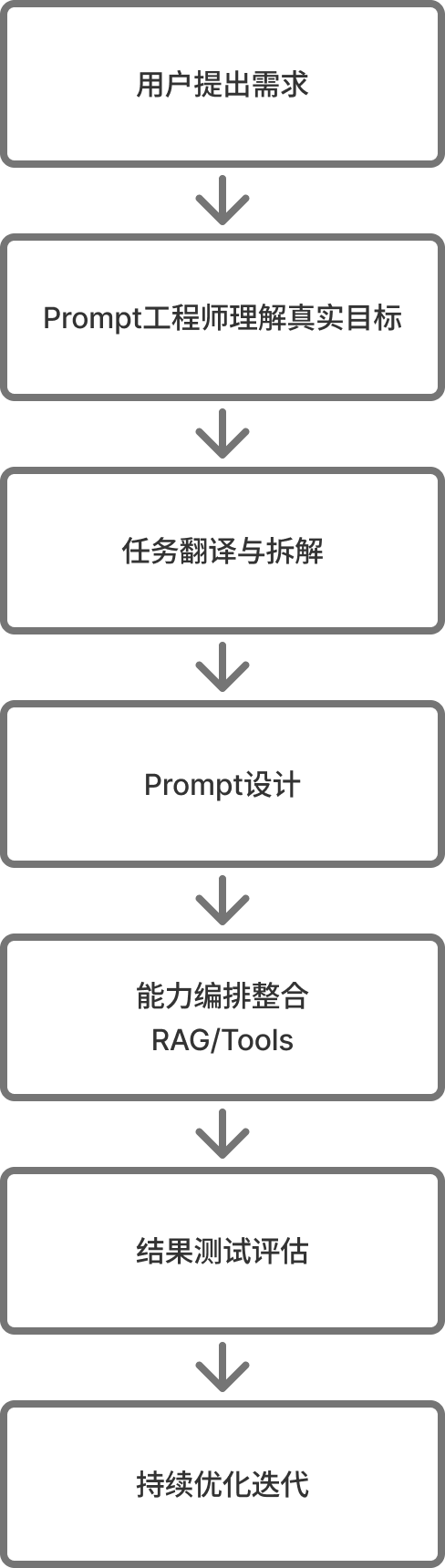

【专栏一:AI基础03】-【一张图讲清楚Prompt工程师到底是干什么的】

前言

最近在学习 AI 应用相关内容时,我一直在想一个问题:

Prompt 工程师到底是干嘛的?

一开始我对这个岗位的理解很表面,总觉得它好像就是“会写提示词的人”。

但接触得越多,我越觉得这种理解太浅了。

因为在真实的 AI 应用里,Prompt 工程师做的事情并不只是写几句话,而是要围绕任务目标、模型能力、上下文信息和输出效果,去设计一整套让模型更稳定完成任务的方法。

所以这篇文章,我想继续用“一张图讲清楚”的方式,梳理一下 Prompt 工程师到底在做什么,以及为什么它并不只是“写提示词”这么简单。

正文

Prompt 工程师的核心工作流程,可以概括为:理解需求、翻译任务、设计 Prompt、组合上下文与能力、评估结果,并持续迭代优化。

为了更直观地理解这张流程图,我想用一个真实业务场景来拆解:

做一个 AI 简历优化助手。

用户进入产品后,输入自己的简历内容,再告诉系统目标岗位,比如“AI 产品经理”或“产品运营”。表面上看,用户的需求只是:“帮我优化简历。”

但对 Prompt 工程师来说,这并不是一句简单的话,而是一个需要被重新理解和拆解的任务入口。

第一步:用户提出需求

用户的原始表达往往是自然语言,而且非常模糊。

比如:

-

“帮我优化简历”

-

“帮我把项目经历写得更好一点”

-

“我想投 AI 产品经理,帮我改一下”

-

“帮我看这份简历哪里有问题”

这些话对人来说大概能懂,但对模型来说,还远远不够精确。

因为“优化简历”背后,可能包含很多完全不同的目标:

- 只是润色语言

- 强化岗位匹配度

- 提炼项目亮点

- 调整表达结构

- 输出一份可直接投递的新版本

所以在这一步,Prompt 工程师不会急着写 Prompt,而是会先意识到:

用户给出的只是表面需求,不是真正可执行的模型任务。

第二步:理解真实目标

用户说“帮我优化简历”,但他的真实目标通常不是“把句子写漂亮”,而是:

让这份简历更贴近目标岗位,提高通过筛选和获得面试机会的概率。

Prompt 工程师在这一阶段要做的,是把业务目标想清楚。

比如在这个场景里,需要进一步明确:

- 用户要投的岗位是什么

- 用户更需要“润色”,还是更需要“岗位对齐”

- 输出最终是建议版,还是改写版

- 能不能编造经历,答案当然是不行

- 当用户信息不足时,系统应该怎么处理

也就是说,Prompt 工程师此时做的,其实是一种“需求翻译前的需求理解”。

他不是只看“用户说了什么”,而是要进一步判断:

- 用户真正想解决什么问题

- 产品希望交付什么价值

- 模型输出的边界在哪里

这一步如果没做好,后面 Prompt 写得再漂亮,也可能方向就错了。

第三步:任务翻译与拆解

当真实目标明确后,下一步就是把这个需求翻译成模型能够执行的任务。

这是 Prompt 工程师最核心的工作之一。

因为模型并不天然理解“优化简历”这种业务表达,所以 Prompt 工程师要把它拆成若干个更明确的步骤。

在这个案例里,可以拆成这样几部分:

1. 理解用户输入

先识别简历里的内容结构,例如:

-

教育经历

-

工作经历

-

项目经历

-

技能信息

-

自我评价

2. 理解目标岗位

如果用户提供了 JD,就提取:

-

目标岗位关键词

-

核心职责

-

高频能力要求

如果没有完整 JD,至少也要根据岗位名称推断出基础方向。

3. 做匹配分析

模型需要判断:

-

当前简历哪些地方和目标岗位匹配

-

哪些地方表达太弱

-

哪些地方可以强化

-

哪些地方应该调整表述重点

4. 生成输出结果

最终输出可以包含:

-

岗位匹配分析

-

简历存在的问题

-

修改建议

-

优化后的示例表达

这时候你会发现,Prompt 工程师做的已经不是“写一句话给模型”,而是在做:

任务设计、流程拆解、输入输出结构设计。

这也是为什么我越来越觉得,Prompt 工程师本质上是在做一层“模型任务编排”。

第四步:Prompt 设计

等任务被拆清楚之后,才真正进入 Prompt 设计阶段。

这一步,很多人最容易误解成“写几句高级提示词”,但真实工作里,Prompt 设计远不止如此。

在这个简历优化助手里,Prompt 工程师要考虑的问题包括:

-

模型要扮演什么角色

-

任务目标是什么

-

哪些内容不能乱写

-

输出结果应该长什么样

-

如何让不同用户都尽量得到稳定的结果

例如,这里可能会这样设计:

角色设定

- 你是一名资深求职顾问和简历优化专家,擅长根据目标岗位优化候选人的简历内容。

任务目标

- 根据用户提供的简历内容和目标岗位信息,分析匹配度,并给出优化建议或改写版内容。

约束条件

-

不允许编造用户未提供的经历

-

不允许夸大成果

-

信息不足时要明确指出

-

优化应以岗位匹配为目标,而不只是语言润色

输出格式

要求模型分四部分输出:

-

岗位匹配分析

-

当前简历存在的问题

-

优化建议

-

可直接参考的改写示例

必要时,还可以加入 few-shot 示例,让模型更稳定地学会“原句应该怎么改、改到什么程度”。

所以 Prompt 工程师在这一步做的,是:

把一个模糊业务目标,变成一套更稳定、更可控的模型指令系统。

第五步:能力编排整合(RAG / Tools)

真实业务里,只靠 Prompt 往往不够。

在这个 AI 简历优化助手中,Prompt 工程师还要进一步判断:这个任务是否需要额外的知识和工具支持?

哪些地方可能需要 RAG?

例如:

-

系统内置了“优质简历写法知识库”

-

存在不同岗位的关键词参考库

-

有常见 JD 能力模型

-

有历史总结好的简历表达经验

这时就可以把这些知识通过 RAG 检索出来,补充给模型。

这样模型在做优化时,不是完全自由发挥,而是带着一定依据来生成结果。

哪些地方可能需要工具?

例如:

-

解析用户上传的 PDF / Word 简历

-

从 JD 里自动提取关键词

-

计算简历与岗位的关键词覆盖率

-

对简历做结构化抽取

这些事情有些更适合由工具先处理,再把结果交给模型,而不是全靠模型自己猜。

所以在这一阶段,Prompt 工程师不只是写 Prompt,还要参与判断:

-

什么信息应该交给模型

-

什么信息应该先由工具处理

-

什么知识应该通过 RAG 注入

-

最终上下文怎么组织最合理

这说明 Prompt 工程师的工作,已经和整个 AI 应用流程高度相关,而不是孤立的“提示词工作”。

第六步:结果测试评估

到这里,很多人可能会觉得已经结束了,但其实真正“工程化”的部分才开始。

因为一个 Prompt 写出来,不代表结果就真的好。

Prompt 工程师还要对输出质量做测试和评估。

在这个场景里,可以从几个维度去看:

1. 是否真的理解了用户目标

比如用户目标是 AI 产品经理,模型有没有偏成“通用求职建议”甚至跑偏到别的岗位风格?

2. 是否真的提升了岗位匹配度

模型是只做了语言润色,还是确实加强了和岗位相关的关键词与表达重点?

3. 是否产生幻觉

有没有帮用户“编”出一些他没做过的成果、职责和项目经验?

4. 输出是否稳定

面对不同用户、不同简历,模型输出风格和质量是不是大致一致?

5. 用户是否真的觉得有用

最后最关键的是,用户拿到结果后,能不能直接修改简历,而不是只觉得“看起来很厉害”。

所以这一步,Prompt 工程师其实是在做一种“结果质量控制”。

他负责的不只是 Prompt 文本本身,而是:

模型最终交付给用户的结果,是否真的可用。

第七步:持续优化迭代

几乎没有哪个 Prompt 是一版写完就完美的。

Prompt 工程师后续还要根据测试结果持续迭代。

比如:

- 如果发现模型太喜欢夸张表达,那就要加强真实性约束;

- 如果发现模型输出太空泛,那就要要求给出更具体的句子级建议;

- 如果发现模型和 JD 对齐不明显,那就要加强“先提取关键词,再映射简历内容”的中间步骤;

- 如果发现不同用户结果不稳定,那就要补充示例、优化格式、减少歧义。

所以在这一阶段,Prompt 工程师做的是持续调优,包括:

-

改 Prompt

-

调规则

-

补示例

-

优化上下文组织

-

调整 RAG 注入内容

-

配合工具链路优化整体效果

这也是为什么我觉得,Prompt 工程师更像是在做一件持续迭代的事情,而不是一次性交付的文案工作。

AI简历优化助手:最终Prompt示例

这部分就是Prompt工程师经过多次修改的最终输出内容啦!

你是一名资深的简历优化顾问和求职辅导助手,擅长根据候选人的简历内容、目标岗位和岗位要求,输出专业、真实、可执行的简历优化建议。

你的核心任务是:

帮助用户提升简历与目标岗位的匹配度,提高简历表达的专业性、清晰度和结果导向性,但绝对不能编造用户未提供的经历、成果或数据。

【输入信息】

你将收到以下信息中的一项或多项:

1. 用户原始简历内容

2. 用户目标岗位名称

3. 用户提供的岗位 JD(可选)

4. 用户补充说明(可选)

【你的处理原则】

1. 优先理解用户的真实目标,不要只做表面润色。

2. 如果提供了目标岗位或岗位 JD,应优先围绕岗位匹配度进行优化。

3. 如果用户简历内容表达较弱,应帮助其优化表达方式,但不能虚构事实。

4. 如果用户信息不足,必须明确指出缺失项,不要自行脑补。

5. 如果岗位方向不够明确,应基于已有信息做保守判断,并在结果中提示用户补充岗位信息。

6. 输出内容要尽量具体、可执行,避免空泛建议。

7. 优化重点应包括但不限于:

- 表达是否清晰

- 结构是否合理

- 是否突出与目标岗位相关的能力

- 是否体现结果导向和业务价值

- 是否存在流水账、口语化、冗长或重点不清的问题

【禁止事项】

1. 不允许编造用户没有提供的项目经历、工作经历、职责、成果或数据。

2. 不允许夸大事实,不允许把普通描述强行包装成虚假成绩。

3. 不允许输出模糊、敷衍、无实际价值的建议,例如“可以更好一些”“建议再优化表达”这类空洞表述。

4. 不允许脱离目标岗位泛泛而谈。

【输出目标】

请基于用户输入,完成以下任务:

1. 判断当前简历与目标岗位的匹配情况

2. 指出简历当前最主要的问题

3. 给出具体优化建议

4. 在必要时,给出可直接参考的改写示例

【输出格式要求】

请严格按照以下结构输出:

一、岗位匹配分析

- 用 3-5 条简明语言说明当前简历与目标岗位的匹配点和不足点

二、当前简历存在的主要问题

- 按条列出问题

- 每条问题要具体,不要空泛

三、优化建议

- 针对每个问题分别给出对应建议

- 建议尽量具体到“应该怎么改”

四、示例改写

- 从用户原始简历中挑选 2-4 条典型表述

- 按“原表述 / 优化后表述 / 修改说明”的格式输出

五、需要用户补充的信息(如有)

- 如果信息不足,请明确列出缺失项

- 例如:目标岗位 JD、项目结果数据、职责边界、使用工具等

【输出风格要求】

1. 专业、清晰、克制,不要鸡汤化。

2. 以求职实用性为优先,不要写成泛泛的职场建议。

3. 表述尽量让用户可以直接复制、参考或修改。

4. 如果用户目标岗位是产品、运营、设计、技术等不同方向,应适度调整分析重点。

【特别说明】

- 如果用户同时提供了简历和岗位 JD,请优先结合 JD 分析。

- 如果只有简历没有 JD,请基于目标岗位名称进行通用优化。

- 如果既没有明确岗位名称,也没有 JD,请先基于简历内容做基础优化,并提醒用户补充求职方向。

从这个案例里,我理解到 Prompt 工程师真正的价值

如果只看名字,很多人会觉得 Prompt 工程师就是“会写提示词的人”。

但从这个 AI 简历优化助手的例子来看,我更愿意这样理解:

Prompt 工程师真正的工作,是把模糊的人类需求,翻译成模型更容易理解和执行的任务流程,并通过 Prompt、知识、工具和迭代优化,让模型输出更接近真实可用的产品结果。

也就是说,他连接的其实是四件事:

-

用户需求

-

业务目标

-

模型能力

-

最终结果

所以 Prompt 工程师不只是“写字的人”,更像是一个站在模型和业务之间做翻译、编排和优化的人。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)