PrimKD: Primary Modality Guided Multimodal Fusion for RGB-DSemantic Segmentation

Abstract

近年来,跨模态 Transformer 在 RGB-D 语义分割任务中取得了显著进展,能够有效融合 RGB 与深度两种模态的信息。然而,现有方法往往忽略了不同模态所包含信息量的差异,对两种模态一视同仁,并采用相同架构的模型进行处理。这种做法可能会限制分割性能,尤其考虑到 RGB 图像通常比深度图像包含更丰富的信息。为了解决这一问题,我们提出了 PrimKD,一种基于知识蒸馏的引导式多模态融合方法,重点突出主导模态 RGB 的作用。在该方法中,我们首先利用仅基于 RGB 模态训练的模型作为教师网络,用以指导融合 RGB 与深度两种模态的学生网络的学习过程。为了在利用深度模态信息的同时优先保留主导 RGB 模态的信息,我们进一步设计了主模态聚焦的特征重建机制和选择性对齐方案。这种设计增强了整体特征融合效果,从而提升了分割结果。我们在 NYU Depth V2 和 SUN-RGBD 数据集上对所提出的方法进行了评估。实验结果表明,PrimKD 具有良好的有效性。具体而言,我们的方法在这两个数据集上分别取得了 57.8 和 52.5 的 mIoU,分别比现有方法提高了 1.5 和 0.4 个百分点。代码已开源,地址为:https://github.com/xiaoshideta/PrimKD。

1 Introduction

语义分割作为计算机视觉领域的长期研究课题,因其在自动驾驶和智能交通系统中的广泛应用而备受关注。近年来模块化传感器技术的突破性进展为多模态数据采集创造了条件,为显著提升分割精度提供了重要机遇。以RGB-D数据为例,这种将RGB颜色通道信息与深度信息相结合的技术已在语义分割领域得到广泛应用。通过深度信息的整合,RGB-D分割技术在实例区分与上下文识别方面展现出显著提升效果。

虽然引入额外模态确实能提供更多信息,但如何有效利用这些附加信息仍面临重大挑战。由于不同模态数据对场景的呈现方式存在差异,无法像单一模态数据那样进行独立处理。因此,实现更优的多模态融合对于提升系统性能具有关键意义。

在当前多模态分割研究中,信息融合的主流范式大致可以分为两类:静态融合方法和交互式融合方法。在早期的静态融合方法中,通常先将多模态输入进行融合,然后使用单一网络从融合后的输入中提取特征 [3]。例如,Cao 等人 [2] 将深度特征分解为形状成分和基础成分,并通过可学习权重对二者的重要性进行平衡,随后对重加权后的组合进行卷积操作,以提升分割精度。另一类做法是,利用两个骨干网络分别从 RGB 和深度模态中独立提取特征,之后再将这些特征进行融合用于分割 [4]。例如,ACNet [16] 通过注意力互补模块和多分支架构对 RGB 与深度特征进行融合,从而能够在保留原始 RGB-D 特征的同时,有选择性地聚合并融合特征,进而提升语义分割性能。尽管这些静态融合方法已经取得了较为理想的性能,但由于其融合方式相对直接,往往缺乏模态间的充分交互,因此在某些情况下,其表现甚至可能不如单模态方法 [8, 28]。

为进一步提升多模态融合效果,研究者提出了交互式融合方法。这类方法通常在两个并行的预训练骨干网络所提取的 RGB 与深度特征之间引入交互融合模块,从而增强模态间的信息交换并提升性能。例如,TokenFusion [29] 和 HiDANet [31] 能够对 RGB 编码器和深度编码器的表示进行动态融合,并在解码器中对其进行聚合,从而推动了 RGB-D 场景解析任务的性能上限。Zhang 等人 [37] 还提出了一种用于 RGB-X 语义分割的统一融合框架 CMX。该框架引入了跨模态特征校正模块用于特征校准,以及特征融合模块用于长距离上下文交互和特征混合,从而取得了优异的分割性能。然而,大多数现有的交互式融合方法在分别提取 RGB 和深度特征时,通常采用相同的骨干网络结构,这忽视了两种模态之间潜在的差异。由于这两种模态所包含的信息量和信息价值并不相同,它们对最终预测结果的贡献也可能不同。采用相同的骨干网络,可能会削弱对分割贡献更大的主导模态的作用,同时放大次要模态的影响。因此,为了在 RGB 与深度信息之间实现更合理的参与平衡,并进一步提升分割效果,有必要针对两种模态设计更具针对性的结构。

为应对这一挑战,我们提出了 PrimKD,一种基于**知识蒸馏(KD)**的方法,旨在指导 RGB-D 语义分割中的多模态融合,并重点发挥主导模态的作用。在假设 RGB 与深度模态在分割任务中的重要性存在差异的前提下,我们使用一个仅基于主导模态数据训练得到的教师模型,来指导融合模型的学习过程。为了增强主导模态引导下的融合效果,我们同时采用了预测层面和特征层面的引导策略,以获得更优的结果。具体而言,除了对最终预测结果进行对齐之外,我们还探索了对中间特征的直接重建,并结合一种自适应引导机制进行优化。在实验分析中,我们实证发现,使用基于 RGB 数据训练的教师模型能够显著提升性能,从而验证了在 RGB-D 语义分割任务中,RGB 数据确实是主导模态。我们在两个被广泛认可的数据集 NYU Depth V2 [26] 和 SUN-RGBD [27] 上进行了大量实验,验证了所提方法的有效性。具体来说,PrimKD 在这两个数据集上分别取得了 57.8 和 52.5 的 mIoU,明显优于对比方法。

我们的贡献可以总结如下:

- 我们识别出 RGB 与深度模态在 RGB-D 分割任务中对结果贡献存在差异,并提出了一种基于知识蒸馏的多模态融合增强方法,在不改变推理阶段模型架构的前提下,以主导的 RGB 模态为引导提升融合效果。

- 我们同时考虑了预测层面和特征层面的主导模态引导机制,并验证了一种能够取得良好多模态融合效果的有效配置。

- 我们在两个具有代表性的 RGB-D 分割数据集上开展了大量实验,展示了所提方法的优越性,同时通过消融实验验证了框架中各个模块的有效性。

2 Related Works

2.1 RGB-D semantic segmentation.

语义分割是指将图像中的每一个像素划分到特定类别或目标中的任务。传统方法通常仅依赖 RGB 图像进行预测。然而,随着近年来深度传感器的普及,深度数据的可获取性显著提高。这一数据可用性的增长促使越来越多的研究人员和实践者尝试利用深度数据来增强 RGB 语义分割的效果,这一新兴研究方向被称为 RGB-D 语义分割。

RGB 图像主要捕获颜色与纹理细节,而深度图像则主要提供空间位置信息。将这两种模态进行融合,可以丰富原始 RGB 图像的语义信息,从而在一定程度上提升任务性能。然而,这两种模态在信息表达上的差异,也给有效融合带来了显著挑战。为缩小这一差距,研究者提出了多种方法,这些方法大致可以归纳为两个方向:一是为 RGB 图像和深度图像设计专门的特征提取架构 [1–4, 6, 24, 35];二是提出创新性的特征对齐与融合方法 [16, 25, 29, 30, 32, 38, 41, 42]。

第一类方法主要聚焦于设计新型网络架构,以更高效地从不同模态中提取特征信息。例如,Girdhar等人[6]提出了一种新型Transformer架构,能够跨图像、视频及单视图三维数据等多种模态联合预训练分类任务,从而实现跨模态语义特征提取。Zhang等人[35]则建议在预训练阶段引入深度图像数据,以提升微调阶段深度图像特征的提取效果。

第二类方法涉及设计创新性的特征融合方案,通过整合不同模态的特征来提升RGB模态的语义信息。例如,吴等人[32]提出基于Transformer的融合策略,能够在长距离信息依赖层面更有效地建模上下文关系。张等人[37]则开发了跨模态特征校准模块与特征融合模块,从空间维度和通道维度同步校准当前模态特征,并采用交叉注意力机制实现双模态特征的全局增强。尽管现有方法通过多模态融合已取得显著性能提升,但其通常采用相同架构处理不同模态信息,这种做法可能无意中抑制更具信息量的模态(我们称之为主模态),从而导致整体性能下降。

2.2 Knowledge Distillation.

知识蒸馏(KD)是一种将知识从一个或多个预训练教师模型迁移至更紧凑的学生模型的技术。根据迁移信息的类型,现有知识蒸馏方法可分为两大类:一类利用教师模型的最终预测结果,另一类则采用中间特征进行知识蒸馏。

Hinton等人[10,15]提出的经典KD方法,是首个将最终预测结果应用于知识迁移任务的研究。该方法要求学生分类器的输出分布通过最小化两分布间的KL散度来模拟教师分类器的分布特征。沿袭前人研究思路,学界已针对基于预测的知识迁移方法提出多项改进方案[7,11,17,39]。赵等人[39]创新性地将原始KL散度分解为两个独立分量,并通过超参数调整各分量的影响权重。黄等人[17]针对师生模型间存在显著容量差异的场景,设计了基于皮尔逊相关系数的损失函数。这些改进措施相较经典KD方法展现出显著的性能提升优势。

除了利用最终预测结果外,中间特征也可用于知识迁移[5,9,12,13,21,22,36]。Romero等人[22]提出了一种方法,通过额外的卷积层进行通道对齐,直接实现教师模型与学生模型特征的对齐。除这种直接设计外,学界还探索了多种特征蒸馏方法。例如注意力图[36]、解流[5]以及样本级特征流形表示[20,21]等方案均可作为有效知识载体。近年来,受掩码图像建模技术[14]成功经验的启发,将该理念引入知识迁移领域的研究方法也逐渐涌现[34]。此外,将中间特征与最终预测结果整合到知识蒸馏(KD)中,能够实现信息的更全面融合,从而提升模型性能。

现有众多知识蒸馏方法主要针对模型压缩设计,侧重于增强轻量级学生模型的性能表现。但本文创新性地采用教师模型作为外部正则化因子,通过优化学生模型的多模态融合过程,突破了传统方法的局限性。

3 Method

本节对现有RGB-D分割方法进行综述,发现多数方法采用相同架构处理两种模态数据,导致包含更多有效信息的主模态数据被无意中抑制。为解决这一局限性,我们提出基于知识蒸馏(KD)的方法。该方法利用主模态数据指导多模态融合过程,旨在提升分割性能。

3.1 Background

语义分割在计算机视觉领域具有关键作用,其核心任务是将图像中的每个像素分配到对应的语义类别。虽然基于RGB信息训练的模型在区分颜色和纹理方面表现优异,但往往难以捕捉几何信息,导致具有相似视觉特征的实例与场景难以区分[40]。为解决这一局限性,多项研究引入深度图像以提升模型性能[37,38]。

3.2 Overlooked Modality Diversity

研究表明,整合RGB模态与深度模态的表征信息可提升模型性能。如公式1所示,当前多数方法采用统一架构独立提取各模态特征,仅参数设置存在差异。

由于具有相同结构的模型拥有相同的表示能力,因此采用相同的骨干网络实际上意味着对 RGB 和深度两种模态进行同等对待。然而,鉴于不同模态之间可能存在信息密度差异,这种做法可能会在无意中削弱包含更丰富信息的主导模态,同时放大信息较少的次要模态的影响,从而导致次优的性能表现。

为了解决这种不均衡问题,有必要针对不同模态进行专门化设计。但如果为每一种模态单独定制模型架构,往往会增加方法设计与实现的复杂性。因此,我们希望探索一种更简单的方式,在不修改模型架构的前提下,对两种模态进行校准,从而保证该方法能够兼容现有的 RGB-D 语义分割框架。

3.3 Primary Modality Guided Fusion

研究证实,知识迁移(KD)通过将预训练教师模型的知识转移至学生模型,可有效提升模型性能。受其成功经验启发,我们旨在利用基于主模态训练的教师模型,指导融合模型(同时整合RGB与深度模态)的学习过程。该方法可实现校准型多模态融合。

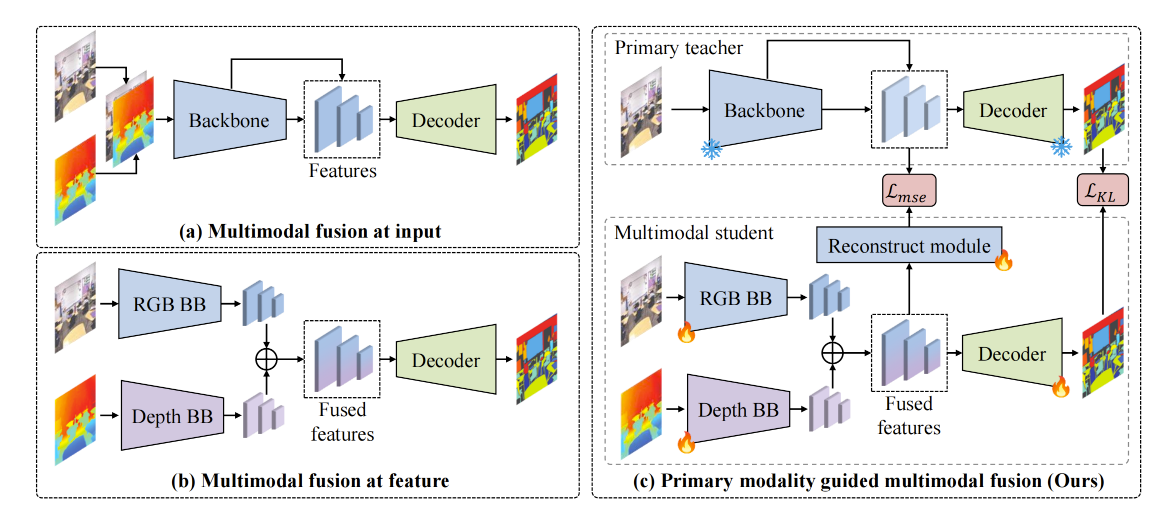

图2展示了我们提出的基于主模态引导的多模态融合框架PrimKD的总体架构。与现有仅通过RGB-D数据训练单一模型的多模态融合方法不同,PrimKD框架引入了基于主模态训练的教师模型——相较于其他模态,主模态本身蕴含着更丰富的分割任务相关信息。我们在现有特征级多模态信息融合方法基础上,通过教师模型引导的知识蒸馏技术进一步提升学生模型的学习效果。这一设计基于以下假设:融合后的模态应更贴近主模态特征,从而提升整体性能表现。实验结果表明,在RGB-D语义分割任务中,RGB数据可作为核心主模态进行有效融合。

3.3.1 Prediction-level guidance.

尽管教师模型与学生模型使用不同的训练数据,但二者共享相同的输出空间。因此,我们最初考虑在预测层面进行知识迁移(KD)。

教师模型在初级模态上进行训练,其预测过程可表述为:

3.3.2 Feature-level guidance

除了最终预测结果之外,中间特征也已被广泛应用于现有的知识蒸馏方法中。因此,我们进一步引入了特征层面的引导机制,以实现来自主导模态的信息传递。然而,与许多现有研究中教师模型和学生模型采用相同网络结构不同,在我们提出的 PrimKD 框架中,教师模型采用的是单流架构,而学生模型采用的是双流架构。考虑到我们的目标是让学生模型更多地学习与主导模态相关的知识,因此可以合理推断:主导模态特征可以从融合特征中恢复出来。基于这一考虑,我们使用教师模型的中间特征与学生模型的融合特征来进行知识蒸馏。具体来说,我们引入了一个轻量级模块,利用学生模型的融合特征去重建主导模态特征,并将重建误差作为损失函数。为了探索最合适的设计方式,我们进一步考虑了如下几种重建方案:

自适应引导机制。特征级引导涉及对教师模型与学生模型的中间特征进行对比分析。在语义分割任务中,骨干网络通常包含四个阶段,每个阶段都会生成特征图。这四个不同尺度的特征图随后会被输入解码器模块进行预测。通常情况下,重建与对比过程需要综合运用这四张特征图。但在我们的PrimKD场景中,由于教师模型与学生模型采用不同数据集进行训练,导致其特征图之间存在显著差异。因此,若直接将特征级引导策略应用于所有四张特征图,可能会面临技术挑战。

为促进知识迁移过程,我们探索了两种方案。第一种方案是在四个特征图中的某一个上持续进行特征层面的引导。第二种方案则涉及对重建和比较所需特征的自适应选择。总体而言,该过程可表述如下:

其中Lfeat,𝑖 表示与第 𝑖 个特征图相关的特征级引导损失。在实验中,我们将评估固定特征图选择方式的差异以及采用不同自适应选择规则(包括基于最大值和最小值的选择)的影响。

讨论(Discussion)。主导模态引导融合的主要目标,是将基于主导模态训练得到的教师模型作为一种外部正则化约束,以增强学生模型进行多模态融合学习的有效性。尤其是在特征层面的引导中,融合特征必须包含足够丰富的主导模态信息,才能实现准确的重建。此外,语义分割这一目标本身也会促使学生模型同时从次要模态中提取有用信息。最终,学生模型有望通过一种更加均衡的多模态融合方式获得更优的性能表现。

3.4 Training and inference

我们的 PrimKD 框架训练过程包含两个阶段。第一阶段,先在主导模态上训练一个单流架构的教师模型;在我们的实验中,主导模态被确定为 RGB 模态。随后,在第二阶段中,在冻结的教师模型指导下训练学生模型。训练阶段的总损失函数定义为:

其中,Lseg 表示原始的 RGB-D 语义分割损失,α和 β 是用于平衡两种蒸馏损失的超参数。

学生模型由此学习到一种在多模态融合过程中更多考虑主导模态信息的融合策略。在推理阶段,主导模态教师模型将不再需要,因此我们的方法不会带来额外的推理开销。

4 Experiment

4.1.2 模型设计。

鉴于我们主要目标是提升现有双流RGB-D语义分割架构的多模态融合能力,因此未采用创新性模型架构,而是沿用Zhang等人[37]提出的双流架构,该架构整合了两个MiT主干网络[33]。实验中评估了MiT-B2和MiT-B4两种预训练主干网络,二者均基于ImageNet-1K数据集[23]完成训练。

4.1.3 优化设置

我们的训练过程分为两个阶段。第一阶段,仅使用主导模态训练教师模型;第二阶段,则使用两种模态并结合知识蒸馏训练学生模型。这两个阶段采用相同的优化配置。

对于 NYU Depth V2 数据集,我们训练模型 500 个 epoch,批大小设为 8。初始学习率设为 6×10^{-5},并采用多项式衰减策略。优化器使用 AdamW [18],权重衰减设为 0.01。训练过程中采用了包括随机翻转和随机裁剪在内的数据增强方法。

对于 SUN-RGBD 数据集,实验设置与上述基本相同,唯一的区别在于训练轮数、批大小和初始学习率,分别设置为 300、128 和 8×10^{-5}。

超参数 (\alpha) 和 (\beta) 默认分别设为 1 和 0.05。所有实验均在 NVIDIA Tesla V100 GPU 上完成。对于 NYU Depth V2 数据集,我们使用了 2 张 GPU;而对于 SUN-RGBD 数据集,则使用了 8 张 GPU。

4.1.4 评估

在评估过程中,我们采用平均交并比(mIoU)作为评价指标。尽管许多现有工作通常报告的是多尺度测试条件下获得的结果,但我们仅在与这些工作进行对比时采用该技术;相较之下,我们的消融实验均在不使用多尺度测试的条件下进行。

4.2 Identification of the primary modality

在我们的分析中,我们假设 RGB 模态与深度模态在分割任务中的重要性存在差异,其中一种模态可能提供了更关键的信息,因此可被视为主导模态。为了确定哪一种是主导模态,我们分别使用仅基于某一种模态训练得到的教师模型来指导学生模型的学习,并将结果与**不使用知识蒸馏(non-KD)**的基线方法进行比较。

对比结果如表 1所示。在不引入任何教师模型的情况下,学生模型在 NYU Depth V2 数据集上的测试 mIoU 为 56.1。当采用仅在深度模态上预训练的模型作为教师时,学生模型的性能仅有轻微提升,mIoU 只增加了 0.1。相比之下,当采用 RGB 模态训练教师模型时,学生模型取得了 57.5 的 mIoU,显著优于其他对比方法。

这些结果表明,约束融合特征包含更多来自 RGB 数据的信息是有益的。因此,RGB 被确定为主导模态,并将在后续所有实验中作为主导模态使用。

4.3 主导模态引导分割

为评估所提方法的有效性,我们在NYU Depth V2和SUN- RGBD 数据集上将其与近期提出的多种方法进行对比。基线结果引自[35]。由于本方法主要聚焦于提升双流架构的多模态融合性能,故未纳入单流方法进行对比。表2展示了对比结果。在NYU Depth V2数据集上,采用MiT-B2骨干网络时PrimKD模型达到54.7的平均交并比(mIoU),采用MiT-B4骨干网络时达到57.8,分别较未采用主导模态引导多模态融合的基线 CMX [37]提升了0.3和1.5个mIoU点。在SUN- RGBD 数据集上也观察到类似性能提升,使用MiT-B2和MiT-B4骨干网络时分别增加0.9和0.4个mIoU点。为更直观展示这些改进效果,我们在图1中提供了柱状图。此外,本方法仅在训练阶段采用主导模态训练的教师模型,未对学生模型架构进行修改,表明性能提升未牺牲推理效率。可视化分析 为定性比较主导模态引导多模态融合方法与现有方法,图3展示了NYU Depth V2数据集的若干样本可视化结果。实验结果表明,采用本方法训练的模型能够获得更精确的分割结果,进一步验证了我们设计方案的有效性。

4.4 Ablation study

为深入评估PrimKD框架中各模块的有效性,我们开展了广泛的消融实验。所有消融实验均基于MiT-B4骨干网络在NYU Depth V2数据集上进行,结果报告时未采用多尺度测试方法。

预测层面引导与特征层面引导(Prediction-level guidance and feature-level guidance)。我们同时采用预测层面引导和特征层面引导来指导学生模型的多模态融合过程。为了评估每种引导方式的有效性,我们比较了所有可能的组合,并将相应结果展示在表 3中。

从结果可以看出,无论是引入预测层面引导还是特征层面引导,都能够提升模型性能,mIoU 分别提高了 0.5 和 0.4。进一步地,同时结合这两种引导方式时,模型取得了最高的 57.5 mIoU,表明这两种方法都是有效的。

自适应引导(Adaptive guidance)。在语义分割任务中,骨干网络通常会输出四种不同尺度的特征,分别记为 stage 1 到 stage 4 的特征。为了确定哪一个阶段最能从特征层面引导中受益,以及评估不同自适应阶段选择规则的有效性,我们开展了相关实验,并将结果展示在表 4中。

当仅使用某一个阶段的特征时,我们观察到:随着模型进入更深层阶段,性能呈现逐渐下降的趋势,其中使用 stage 1 的特征进行引导时性能最佳。相反,对四个阶段的损失值取平均并没有带来性能提升。此外,对于每个样本自适应地选择损失值最大的阶段,可以获得最佳性能,而且无需手动指定在哪一层施加引导。

对齐架构(Alignment architecture)。为了重建教师模型的特征,我们采用了轻量级的对齐模块。我们通过比较单层结构和多层结构来考察不同设计方案的效果。单层结构仅包含一个 (1\times1) 卷积层,而多层结构则在单层对齐器的基础上,进一步引入了带有 (3\times3) 卷积核的 Conv-ReLU-Conv 结构。结果如表 5所示,表明多层结构具有更优的性能表现。

4.5 Analysis of guided fusion

为深入探究我们提出的主模态引导融合方法的影响,我们对训练完成的融合模型特征进行了分析。具体而言,我们通过中心化核对齐(CKA)[19]比较特征相似性,并通过直方图分析和 CKA 分析评估特征值分布。为考察双模态训练模型与单模态训练模型之间的特征相似性,我们采用 CKA 作为度量指标。该算法以两个特征图作为输入,输出0到1范围内的相似度值,数值越大表示相似度越高。我们选用MiT-B4作为骨干模型,并使用NYU Depth V2测试集进行评估。表8展示了实验结果:当未采用引导融合时,基于 CMX 训练的模型特征相似度与基于RGB或深度模态训练的单流模型相当。此外,随着模型层级加深,相似度呈现递增趋势。引入主模态引导融合后,采用RGB模态训练的教师模型对子模型融合过程进行调控。尽管与RGB模态的相似度保持稳定,但训练模型的相似度相较于深度模型显著降低,尤其在模型早期阶段表现明显。这表明调控初始阶段的影响更为显著,与表4结果一致。特征值分布分析。我们进一步对比了中间特征值的分布情况,并在图4中展示了直方图。采用RGB模态训练的教师模型提取的特征值分布更为集中,而无指导训练的 CMX 模型则呈现特征值分散状态。通过应用我们提出的方法后,特征值分布逐渐趋近于教师模型的分布特征,这表明RGB模态提供的信息量得到了更充分的考量。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)