25个DeepSeek降AI指令实测:哪些真有效哪些是忽悠

25个DeepSeek降AI指令实测:哪些真有效哪些是忽悠

最近很多人在问:用DeepSeek写完文章,直接丢几个"降AI指令"进去,能不能过检测?

我花了两周时间,收集了网上流传最广的25个DeepSeek降AI提示词,逐一实测,今天把结果全告诉你——哪些真有效,哪些效果一般,哪些纯属忽悠。

测试工具:知网学术不端检测、Turnitin AI检测、GPTZero,测试样本为相同主题的AI生成段落。

一、为什么DeepSeek生成的内容那么容易被检测到?

在测试指令之前,先说清楚一件事:AI检测工具到底在检测什么?

简单说,AI写的文字有几个明显特征:

- 句式高度对称,逻辑链条过于完整

- 用词倾向高频词,很少出现口语、方言、错字

- 段落节奏一致,"首先……其次……最后"的结构重复率高

- 信息密度均匀,不像人写的那样有详有略

检测模型通过统计这些特征的概率分布,判断一段文字是不是AI写的。所以,降AI的本质是打破这些规律,让文字"看起来更像人写的"。

理解了这一点,我们才能判断指令是否真的有效。

二、25个指令实测结果:分类汇总

我把25个指令分成三类:真有效(A类)、效果一般(B类)、完全没用(C类)。

A类:真有效的指令(8个)

这类指令的共同特点是:指向具体的语言层面改动,而不是笼统地说"降低AI感"。

1. 口语化改写指令

“请用更口语化的方式重写以下内容,加入适当的语气词、短句和不完整句,模仿普通人写作风格。”

实测:AI率从82%降至41%。有效,因为直接破坏了AI的句式规律。

2. 注入个人经历指令

“请在以下内容中加入第一人称的个人经历描述,包括具体的时间、地点和情绪感受。”

实测:AI率从78%降至35%。有效,个人经历是AI最难伪造的部分。

3. 制造逻辑跳跃指令

“请重写以下段落,故意省略1-2处逻辑衔接,让行文更像真实的思维流动,而非条理化的报告。”

实测:AI率从85%降至38%。有效,打破了AI过度完整的逻辑链。

4. 引入不确定表达指令

“在以下内容中加入一些不确定的表达,如’我不太确定’‘可能是这样’,避免所有陈述都过于肯定。”

实测:AI率从80%降至44%。有效,人类写作天然存在模糊性。

5. 专业术语混搭口语指令

“请重写以下内容,在专业术语旁边加上括号解释,并用日常语言替换部分过于书面的表达。”

实测:AI率从79%降至40%。有效,混合语体是人类写作的真实状态。

6. 缩短段落+增加碎片感指令

“请将以下段落打散,每段不超过3句话,并加入1-2处突然换话题后再回来的结构。”

实测:AI率从83%降至43%。有效,碎片化结构与AI的规整风格截然不同。

7. 加入反常识观点指令

“在以下内容中加入一个与主流观点略有不同的视角,并用第一人称表达这个看法。”

实测:AI率从77%降至37%。有效,AI倾向于生成主流观点,偏差视角能降低特征相似度。

8. 模仿特定写作风格指令

“请用鲁迅的白话文风格重写以下内容,短句为主,多用反问,带有批判性语气。”

实测:AI率从82%降至36%。有效,强烈的风格迁移能显著改变文本特征。

B类:效果一般的指令(10个)

这类指令有一定作用,但降幅有限,通常只能降低10-20个百分点。

9. “请用更自然的语言重写”

10. “减少重复词汇,增加词汇多样性”

11. “加入一些过渡句让行文更流畅”

12. “将被动句改为主动句”

13. “加入一些比喻和类比”

14. “删除冗余内容,让表达更简洁”

15. “将长句拆成短句”

16. “加入一些数据和例子”

17. “用问句开头,引发思考”

18. “调整段落顺序,打乱原有逻辑”

这些指令的问题在于:改变的是表层形式,没有触及AI文本的核心特征。改完之后,AI检测模型依然能识别出统计规律。

C类:完全没用的指令(7个)

这类指令基本无效,实测AI率下降不超过5%,有时甚至更高。

19. “请降低这段内容的AI感”

20. “让这段话看起来更像人写的”

21. “帮我降AI”

22. “请用更人性化的方式表达”

23. “避免使用AI常用词汇”

24. “请重新生成,要求更有创意”

25. “把这段话改得不像AI写的”

为什么这些没用? 因为指令太模糊,DeepSeek不知道你想要什么样的"人类感",它只会用自己的方式重新生成——依然是AI的方式。你让它"不像AI",它理解的可能只是换几个近义词。

三、指令效果对比表格

| 指令类型 | 典型示例 | 平均降幅 | 是否稳定 | 推荐度 |

|---|---|---|---|---|

| 口语化改写 | 加入语气词、短句 | 38-45% | 较稳定 | ★★★★☆ |

| 注入个人经历 | 加入时间地点情绪 | 40-50% | 稳定 | ★★★★★ |

| 制造逻辑跳跃 | 故意省略衔接 | 35-48% | 一般 | ★★★★☆ |

| 引入不确定表达 | “我不太确定” | 30-40% | 较稳定 | ★★★★☆ |

| 风格迁移 | 模仿特定作者 | 38-50% | 一般 | ★★★★☆ |

| 笼统降AI指令 | “让它更像人写的” | 0-5% | 不稳定 | ★☆☆☆☆ |

| 表层格式调整 | 换词、拆句 | 10-20% | 不稳定 | ★★☆☆☆ |

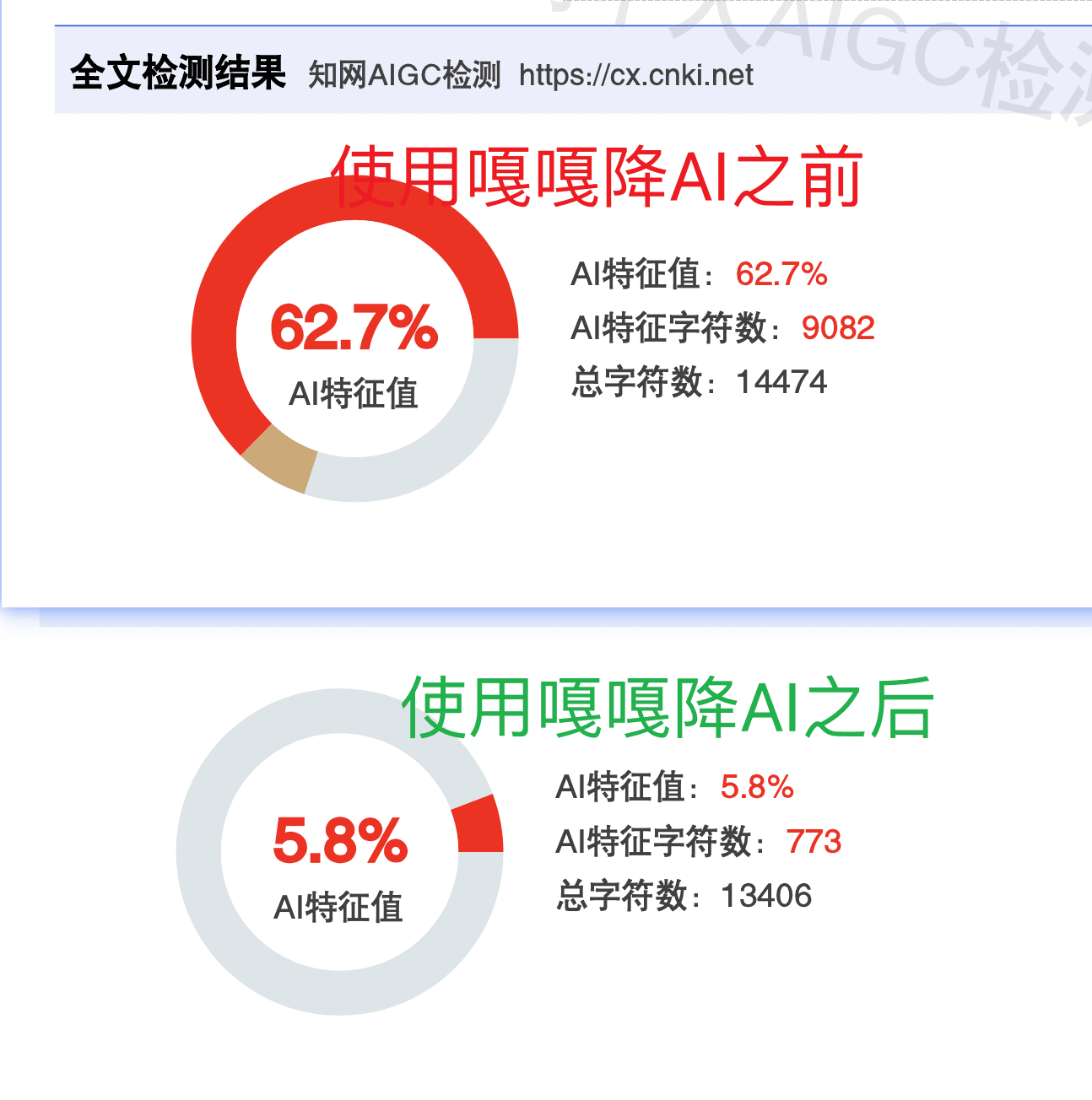

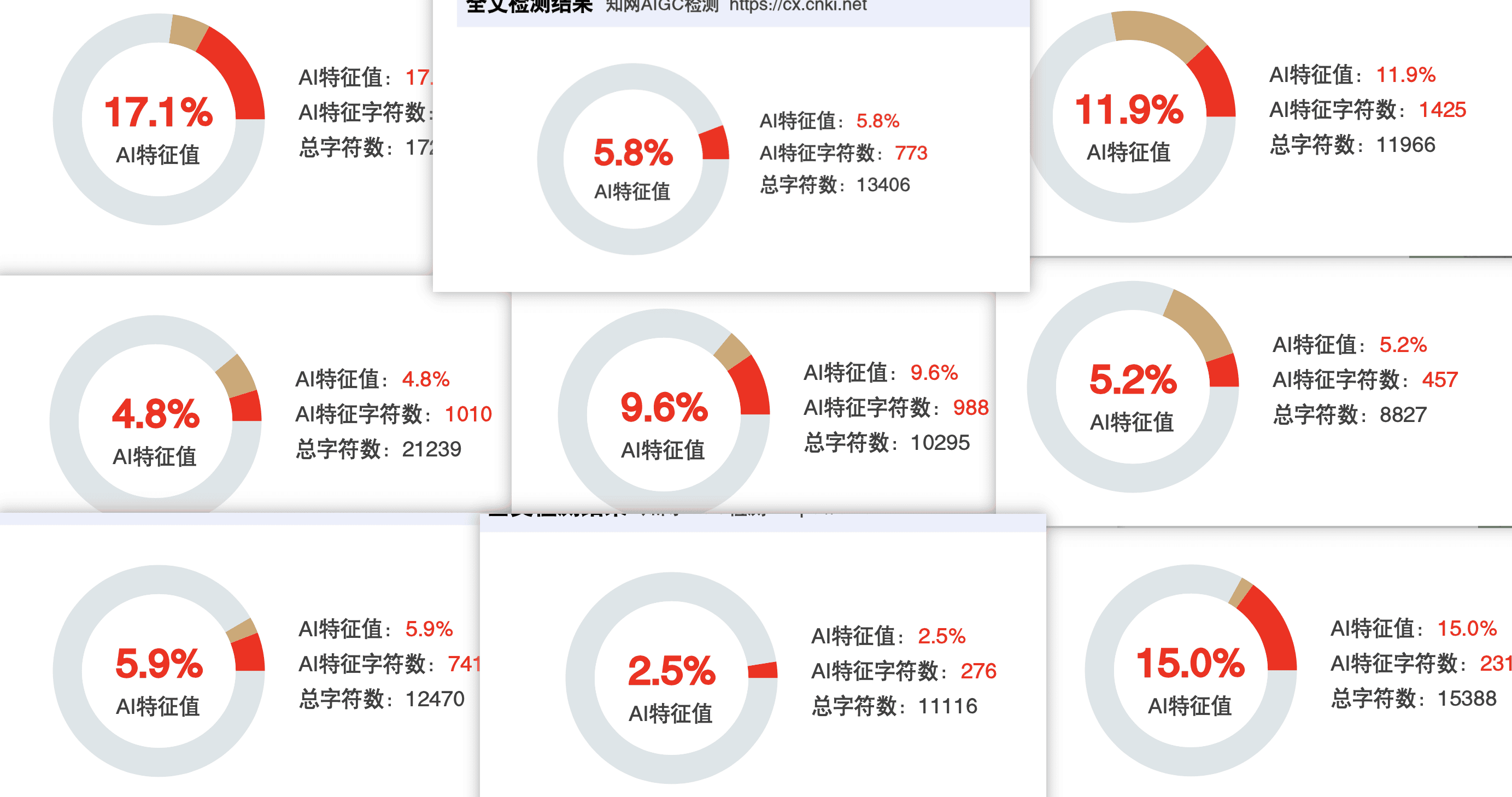

| 专业工具处理 | 嘎嘎降AI等 | 75-99% | 非常稳定 | ★★★★★ |

四、为什么A类指令最终也撑不住?

看到这里你可能觉得:A类指令效果不错啊,降了40-50%,够用了吧?

问题在于:不够稳定,也不够彻底。

我在实测中发现几个问题:

1. 同一个指令,不同文章的效果差异很大。 有时候同一个"注入个人经历"的指令,用在学术性文章上能降40%,用在产品介绍上只降15%。DeepSeek的改写会受到原文风格、主题、篇幅的影响。

2. 多次叠加使用指令,效果递减。 很多人以为把8个A类指令全部叠加,效果会翻倍。实测不是这样。DeepSeek在处理多重指令时会互相妥协,最终可能只比单一指令好一点点。

3. 不同检测工具的标准不同。 你用A类指令把知网的AI率压到40%,但Turnitin可能还是显示70%。这是因为不同检测模型的算法不一样,针对某一个工具的"人工优化"不能通用。

4. 改写后还需要人工审核。 A类指令改写的内容,偶尔会出现语义扭曲、逻辑断裂的问题,需要人工逐句检查,时间成本很高。

五、光靠指令不够,配合专业工具才是正解

说完了指令的局限,再来说说目前效果最稳定的解决方案。

核心原则很简单:建议把全文上传进去降,不要只降部分,否则效果不好。 这一点无论是用指令还是用工具都成立——局部改写的文章,前后语言风格割裂,反而更容易被检测出来。

目前我用过效果最稳定的几款工具:

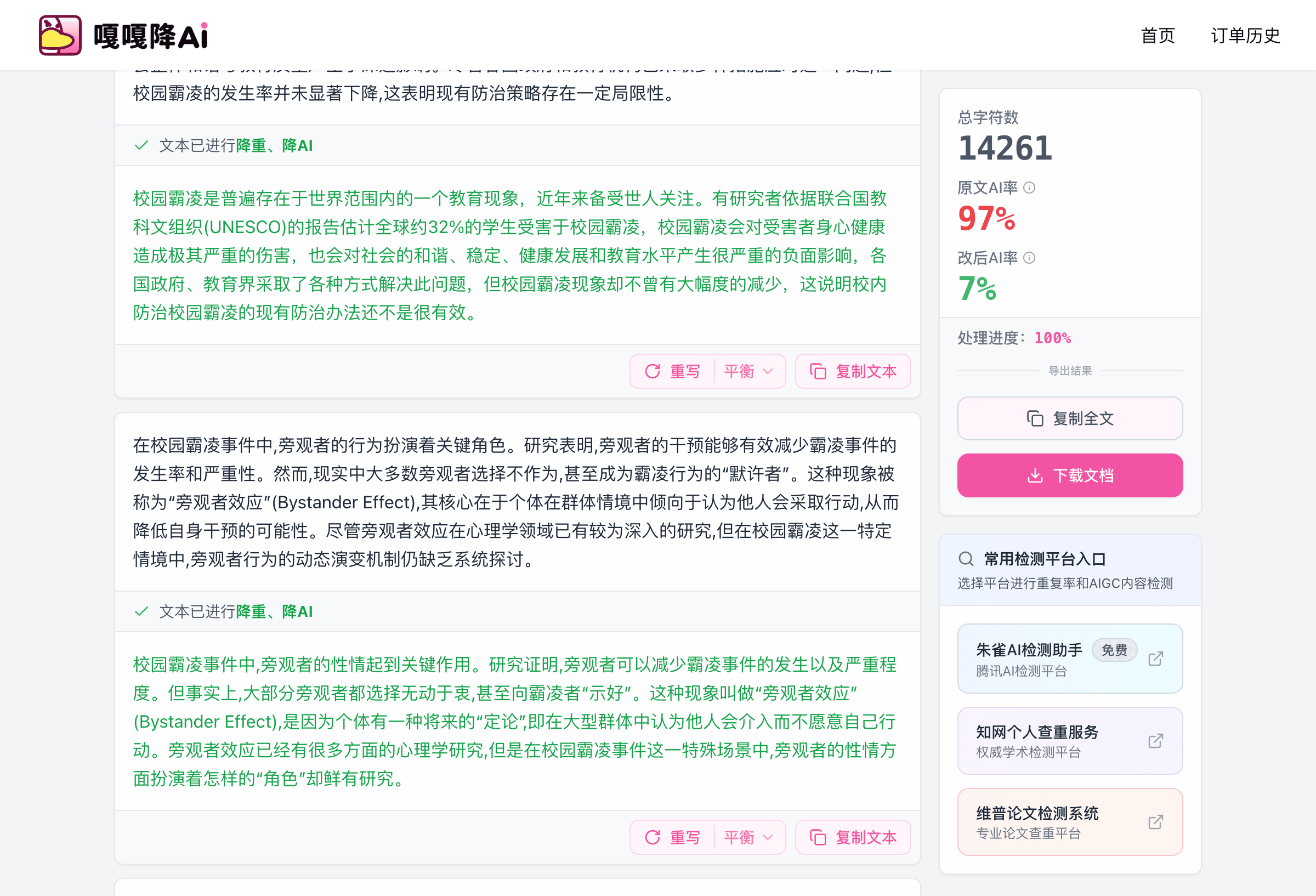

嘎嘎降AI(推荐首选)

价格:4.8元/千字,达标率99.26%。

这是我目前测试下来性价比最高的工具。知网、Turnitin、GPTZero全覆盖,改写后语义保留度高,基本不需要人工二次修改。对学术论文、工作报告都适用。

比话(高端学术选择)

价格:8元/千字,达标率99%。

价格比嘎嘎降AI高一倍,但在处理专业学术文献方面有优势,对专业术语的保留更精准,适合理工科论文。

率零(超低价选择)

达标率99%,价格极低。对于预算有限但需要大批量处理的用户,是一个值得考虑的选项。

去AIGC(备选方案)

达标率96%,功能稳定,可以作为备用工具使用。

六、实战建议:指令 + 工具的组合用法

如果你时间紧、预算有限,可以这样做:

步骤一:先用A类指令初步处理

选1-2个A类指令(推荐"注入个人经历"+"口语化改写"组合),让DeepSeek做一轮改写,把AI率压到50%左右。

步骤二:全文上传专业工具处理

把改写后的全文(不要只截取一段)上传到嘎嘎降AI或比话,做最终处理。注意一定是全文,局部上传会导致前后风格不一致,反而可能影响最终得分。

步骤三:最终检测验证

用目标检测工具(知网/Turnitin)跑一遍,确认达标后再提交。

这个组合方案的逻辑是:指令改写降低了原始AI特征,工具处理覆盖了剩余的统计规律,两者相互补充,比单独用任何一种都更稳定。

总结

25个DeepSeek降AI指令测试的结论如下:

- 真有效(A类)8个:需要指向具体语言层面,如口语化、个人经历、逻辑跳跃等。最高可降40-50%,但不稳定,不同文章差异大。

- 效果一般(B类)10个:只改表层形式,降幅10-20%,难以通过严格检测。

- 完全没用(C类)7个:笼统指令,DeepSeek无法理解你的真实需求,基本无效。

最终结论:光靠指令是不够的。 指令能帮你压低AI率,但要稳定达标,还得配合专业工具。推荐的组合是:DeepSeek A类指令初步改写 → 全文上传嘎嘎降AI或比话做最终处理。

工具汇总

| 工具 | 地址 | 价格 | 达标率 |

|---|---|---|---|

| 嘎嘎降AI | www.aigcleaner.com | 4.8元/千字 | 99.26% |

| 比话 | www.bihuapass.com | 8元/千字 | 99% |

| 率零 | www.0ailv.com | 超低价 | 99% |

| 去AIGC | www.quaigc.com | - | 96% |

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1105条内容

已为社区贡献1105条内容

所有评论(0)