超越RL:探索LoRA、进化策略等后训练新范式,解锁更高效、灵活的模型微调!

“超越RL”意味着后训练不再仅仅是单一的强化学习阶段。现代大语言模型的调优结合了多种方法:指令微调(SFT)、偏好对齐(RLHF/DPO/RLVR)、基于适配器的参数更新(LoRA系列),以及像进化策略(ES)这样的替代优化器。这种转变是从单一的循环到一个模块化技术栈的演进,这个技术栈更便宜、更稳定,且更易于针对具体任务进行调整。

本文核心术语(快速词汇表):

- 什么是SFT? 监督微调(Supervised Fine-Tuning),在提示-响应对上进行训练,以教导模型表现出助手行为。

- 什么是RLHF? 基于人类反馈的强化学习(Reinforcement Learning from Human Feedback),使用偏好数据和奖励优化。

- 什么是RLVR? 具有可验证奖励的强化学习(Reinforcement Learning with Verifiable Rewards),基于测试、执行检查、确切答案等。

- 什么是DPO? 直接偏好优化(Direct Preference Optimization),无需完整的强化学习循环,直接学习偏好响应优于拒绝响应。

- 什么是LoRA? 低秩自适应(Low-Rank Adaptation):冻结基础权重,训练小型低秩更新矩阵(W’ = W + BA)。

- 什么是文档到LoRA(Doc-to-LoRA)? 直接从文档生成LoRA适配器(上下文 -> 参数)。

- 什么是文本到LoRA(Text-to-LoRA)? 直接从任务描述生成LoRA适配器(文本 -> 参数)。

- 什么是LoRA压缩(LoRA-Squeeze)? 训练中/后对LoRA的秩进行压缩,以在最小化质量损失的前提下减小尺寸。

- 什么是Kron-LoRA? 结构化的克罗内克积(Kronecker)+低秩适配器,以实现更强的参数效率。

- 什么是MoA? 适配器混合(Mixture of Adapters):跨异构适配器类型路由词元。

- 什么是ES? 进化策略(Evolution Strategies):通过参数扰动+奖励评估实现的无梯度优化。

- 什么是LoRA + ES? 使用LoRA作为紧凑的搜索空间,使用ES作为优化器,实现可扩展的后训练。

当前训练非常侧重于强化学习, 强化学习的使用范围极其广泛:对齐训练,优化模型以匹配人类偏好、AI评估器或可验证结果;多步推理能力训练;智能体训练,教导模型规划行动、使用工具以及在多步环境中操作(编码智能体、GUI智能体);甚至包括预训练和系统级学习。

使用强化学习的动机在很大程度上是出于实用考虑,受到许多推理模型成功的启发。它允许将目标作为标准训练损失进行优化,并简单地训练模型以最大化定义的奖励信号。

但研究人员越来越质疑,强化学习是否应继续作为主导的后训练阶段。为什么?

- 首先,强化学习流程昂贵且不稳定,需要对奖励模型和策略更新进行仔细调优,并且通常提供稀疏的反馈,尤其是在处理长推理任务时。reward hacking也是一个令人头疼的问题。

- 只需回想一下 Andrej Karpathy 曾说过“强化学习很糟糕”,因为单一的最终奖励会将模糊的信用分配到许多不相关的步骤上,而不是识别出推理过程中真正重要的部分。

那么,模型中究竟哪些部分应该被修改?如何才能使后训练更高效? 对更好训练方法的探索尚未结束。强化学习的局限性促使探索优化和参数化空间中的替代后训练策略,包括参数高效方法,如LoRA(低秩自适应),以及无梯度优化方法,如进化方法。

本文将讨论哪些因素可以使后训练比基于强化学习的流程更便宜、更稳定、更动态、更模块化。关于新型LoRA——文档到LoRA(Doc-to-LoRA)、文本到LoRA(Text-to-LoRA)、LoRA压缩(LoRA-Squeeze)、Kron-LoRA 和 MoA(适配器混合)——以及一个非常有趣的方向——进化策略,以及它们如何协同工作,有很多值得学习的地方。

在本期内容中:

- 为什么强化学习仍然强大,但在后训练中可能代价高昂且脆弱

- 文档到LoRA和文本到LoRA如何将适配器从“训练产物”转变为“生成模块”

- LoRA压缩、Kron-LoRA和MoA如何提高适配器效率和组合能力

- 为什么进化策略(ES)作为一种严肃的无梯度优化路径正在重新崛起

- LoRA + ES的混合方法如何使后训练更便宜、更模块化、更具可扩展性

- 结论

模型训练基础

在探讨微调的新思路之前,需要明确目前使用的训练流程,以及新方案可能的位置。

当谈论大语言模型训练时,指的是分为两大阶段的生命周期:预训练和后训练。区别不在于时间上的先后,而在于正在优化的目标以及正在为模型添加的能力。

- 预训练构建模型的通用智能基础。 目标是正确预测序列中的下一个词元。结果是一个基础模型,它从海量数据集中学习了语言和知识的一般结构。大部分计算成本都集中在此。

- 后训练将这个基础塑造成一个可用的系统。 它教导模型如何表现,更加灵活多变,包含不同的阶段。尽管如此,它是训练中成本较低的部分。

通常,现代大语言模型的流程可以看作是以下组合:预训练 → 监督微调(SFT) → 对齐训练 → 后训练优化。

在监督微调中,模型在“提示-响应”示例上进行训练,以学习如何遵循指令并生成结构化的答案。这关乎如何像一个助手一样行动。

对齐训练阶段试图使模型的输出与人类偏好或特定任务目标保持一致。最常见的方法一直是 RLHF(基于人类反馈的强化学习),即人类对模型输出进行排序,一个奖励模型学习这些偏好,用奖励函数对模型的输出进行评分,然后强化学习使用基于梯度的优化来更新模型以最大化奖励。

越来越多的系统现在用自动评估信号取代人类反馈,例如数学解答、代码执行、数据库查询、程序化测试等,从而产生了 RLVR(具有可验证奖励的强化学习)。

在此之上,AI模型通常还包括额外的改进:检索增强生成(RAG)、产生多步推理轨迹的推理训练、工具使用和智能体行为训练、长上下文优化、安全性和校准训练等等。

而今天,低秩自适应(LoRA)方法演变成新的形态。像文档到LoRA、文本到LoRA、LoRA压缩等最新方法表明,后训练不再仅仅是在基础模型上运行强化学习。它正变成一个模块化的技术栈,其中一些行为通过奖励进行优化,而另一些则通过生成的适配器即时注入。微调开始看起来不像一个单一的、整体的训练阶段,而更像一个用于组合能力的动态系统。

基本上,LoRA改变了模型参数在后训练期间的更新方式。早期的LoRA方法纯粹将适配器视为微调机制。它们在数据集上进行训练,以使模型专门用于某项任务。

在标准的LoRA微调中,基础模型被冻结,只有小型低秩矩阵被训练:W’ = W + BA。这里,W 是原始权重矩阵,BA 是一个低秩更新,其秩通常在4到64之间。因此,训练过程修改的不是数十亿参数,而是几百万个参数。

在实践中,LoRA常用于领域专业化、指令微调、推理任务和对齐实验。所以典型的流程会是:预训练 → 指令微调 → 对齐/能力训练 → 参数高效微调(LoRA)。

现在分解最新的LoRA方法如何工作,以及它们揭示了后训练的哪些新角度。

文档到LoRA和文本到LoRA:改变LoRA的涵义

最近 Sakana AI 关于文档到LoRA和文本到LoRA的研究极大地扩展了生成式适配器的概念。它们的工作方式相似,但方向不同:

文档到LoRA专注于记忆,而文本到LoRA则旨在更好地适应新任务。系统不再通过梯度更新来训练适配器,而是直接从文本输入生成它们:将任务描述或文档转换成LoRA权重,进而修改基础模型。这改变了LoRA的角色,将其转变为一个更加模块化和动态的微调技术栈,使得模型可以按需获取新知识、技能和行为。

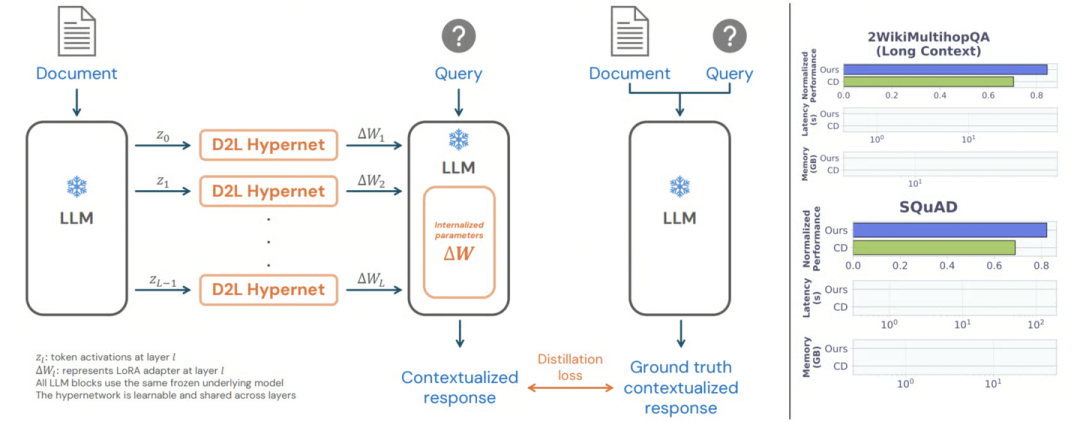

通过 文档到LoRA (D2L),文档本身变成了参数更新。它通过一次前向传播将文档转换为LoRA适配器。它使用一个经过元训练的超网络来近似上下文蒸馏。

[快速提醒一下,上下文蒸馏是一种方法:模型在上下文中一次性读取信息,然后学习后续回答相关问题,而无需原始文档,因为知识已被转移到其参数中。]

所以,你给超网络一个新上下文,它会为一个冻结的基础大语言模型生成一个特定于该上下文的LoRA适配器。之后,基础模型无需重新阅读原始文档就能回答后续问题。

添加图片注释,不超过 140 字(可选)

图片来源:Doc-to-LoRA原始论文

随着时间的推移,超网络学习从上下文到LoRA适配器的通用映射。这有效地将文档转变为可重用的参数模块,可以存储、共享并附加到不同的模型上。

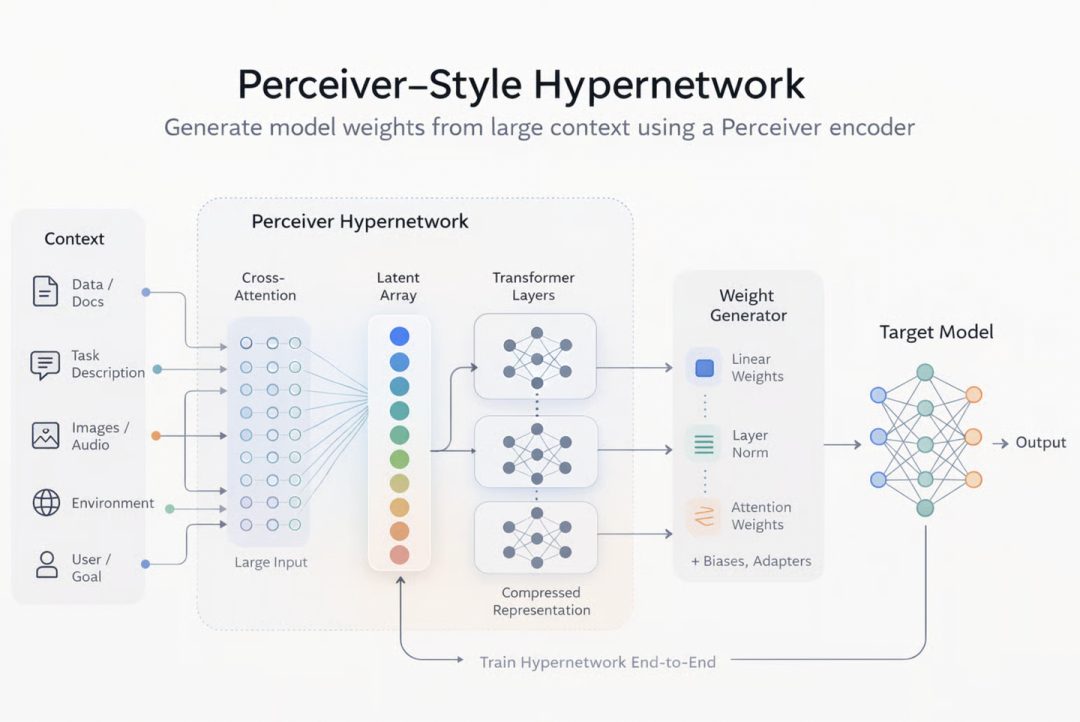

在架构上,D2L基于一个Perceiver风格的超网络。

添加图片注释,不超过 140 字(可选)

图片来源:Turing Post

它从冻结的大语言模型中获取隐藏层激活,并将可变长度的上下文映射到一个固定形状的适配器。这一点很重要,因为文档可短可长,对于更长的上下文,D2L会使用分块处理。

综上所述,这赋予了D2L以下优势:

- 它可以处理比基础模型原生上下文窗口长得多的上下文(超过4倍)。

- D2L工作更快,并减少了后续查询的延迟,因为内化发生在单次前向传播中,而不是多次梯度更新,并且模型不再需要反复消耗整个文档。

- 它在推理期间减少了KV缓存内存使用。

- 它支持更多动态用例,如频繁的知识更新或个性化行为。

当然,D2L并不能完美替代完整的长上下文建模。其质量仍然取决于超网络学习从上下文到适配器映射的好坏,并且与直接访问完整文档相比,可能存在信息损失。但作为快速上下文内化的一种实用机制,D2L是一个非常有趣的方向。知识变得可以挂载到模型上,而不是通过提示注入。

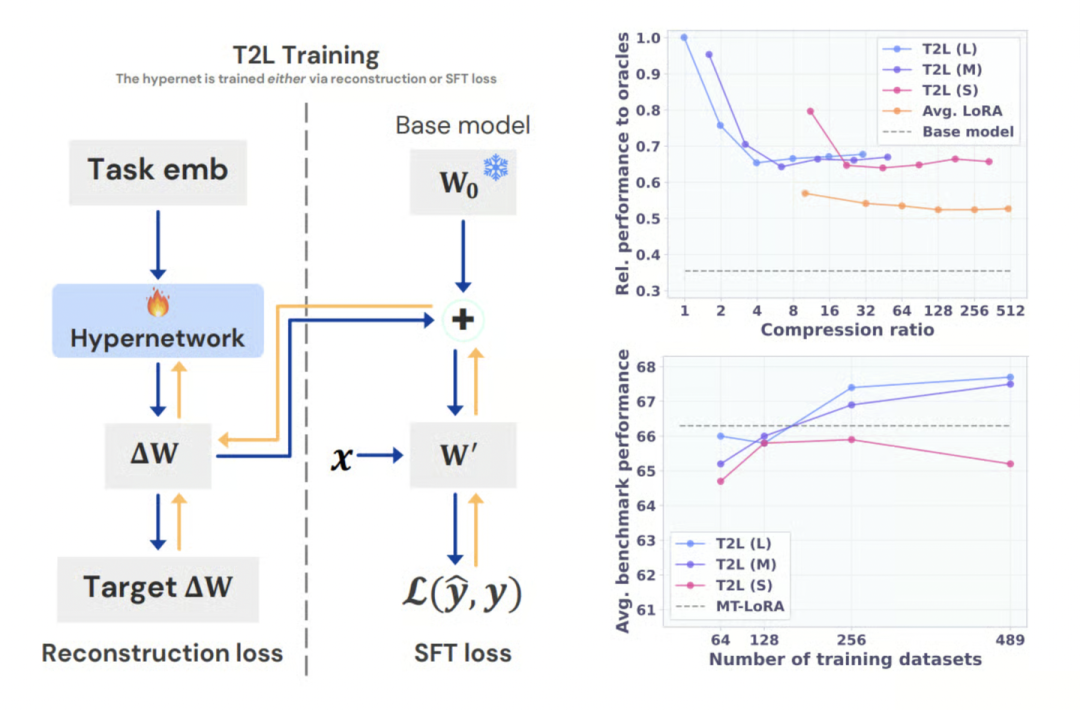

文本到LoRA (T2L) 遵循与文档到LoRA相同的总体方向,但针对的是任务:适配器不再需要为每个任务进行训练——它们可以直接从文本生成。

在T2L中,一个自然语言的任务描述被转换成LoRA权重,从而修改一个冻结的基础模型。该方法也使用超网络。它读取任务描述,将其编码为嵌入向量,并为Transformer的不同层生成低秩的LoRA矩阵。与D2L类似,适配器在单次前向传播中生成并附加到基础模型上。

添加图片注释,不超过 140 字(可选)

图片来源:Text-to-LoRA原始论文

在训练期间,T2L从大量任务分布中学习,它要么重建现有的任务特定LoRA,要么通过跨多个任务的监督微调进行端到端训练。随着时间的推移,超网络学习跨任务的共享自适应机制。

这种方法揭示了一些重要的实际意义:

- 适配器可以即时生成,无需运行训练循环。

- 由于输入是文本描述而非固定的任务ID,T2L可以为仅提供文本描述的未见过的任务生成LoRA。

- T2L也充当了一种压缩机制。许多LoRA可以被压缩到一个超网络中,该网络在需要时重新生成它们,从而在一个模型中存储多个任务适配。

实验中,通过这种方式生成的适配器在推理、问答、编码和知识基准测试上均提升了性能,通常接近完全训练的任务特定LoRA的性能。但同时,质量在很大程度上取决于任务描述。

从长远来看,D2L和T2L作为两个互补的更新生成器,带来了一系列好处——持续学习、快速个性化,以及无需重复训练整个模型即可获得可重用的参数模块。这使模型变成了更动态的学习者。

除此之外,其他几个有趣的LoRA进一步增强了基于适配器的后训练技术栈,超越了强化学习。

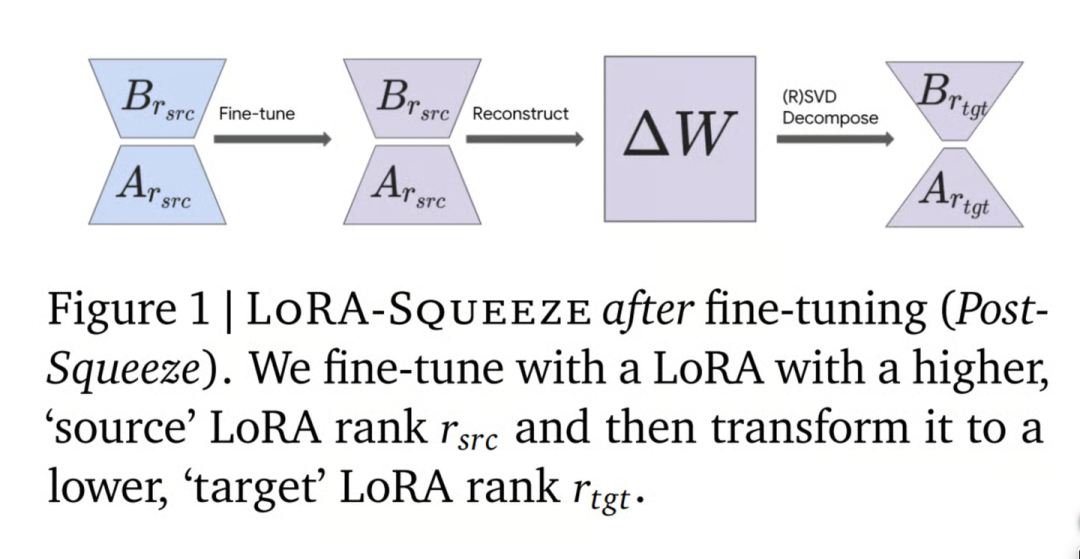

压缩:GDM的LoRA压缩(LoRA-Squeeze)

如果能让LoRA适配器变得更小,并且从一开始就无需选择适配器的秩,会怎样?正是为了这个目的,Google DeepMind 创建了 LoRA压缩(LoRA-Squeeze),它将参数模块压缩得更小,使其更易于重用和部署。而且你不需要预先选择秩——你可以先用较高的秩训练一个LoRA适配器,然后将其压缩到较低的秩。

在微调阶段之后,LoRA压缩重建完整的权重更新矩阵,并应用随机奇异值分解(RSVD)来生成一个保留了更新中最重要组件的低秩LoRA模块。这种压缩可以在训练后(后压缩)发生,也可以在训练期间逐步进行(训练中压缩),即秩在模型通过退火调度继续学习时逐渐减小,或者定期在训练期间发生(连续压缩)。

添加图片注释,不超过 140 字(可选)

图片来源:LoRA-Squeeze原始论文

应用LoRA压缩后,你可以看到一些有益的正面效果:

- 低秩适配器通常表现与直接训练的高秩适配器一样好,甚至更好。

- 需要的超参数调优更少,因为训练秩和部署秩是解耦的。

- 当然,由于LoRA模块更小、更统一,部署也更容易。

这确实是后训练中轻量级参数编辑的又一个层次。但别忘了:如果压缩得过于激进,性能可能会崩溃。

Kron-LoRA:带结构的压缩

另一种针对LoRA的压缩方法主要侧重于避免压缩过程中性能崩溃。康奈尔大学的 Kron-LoRA 仅使用LoRA参数的约25-30%(即最多减少4倍),同时在推理基准上仍能与LoRA持平或略胜一筹。

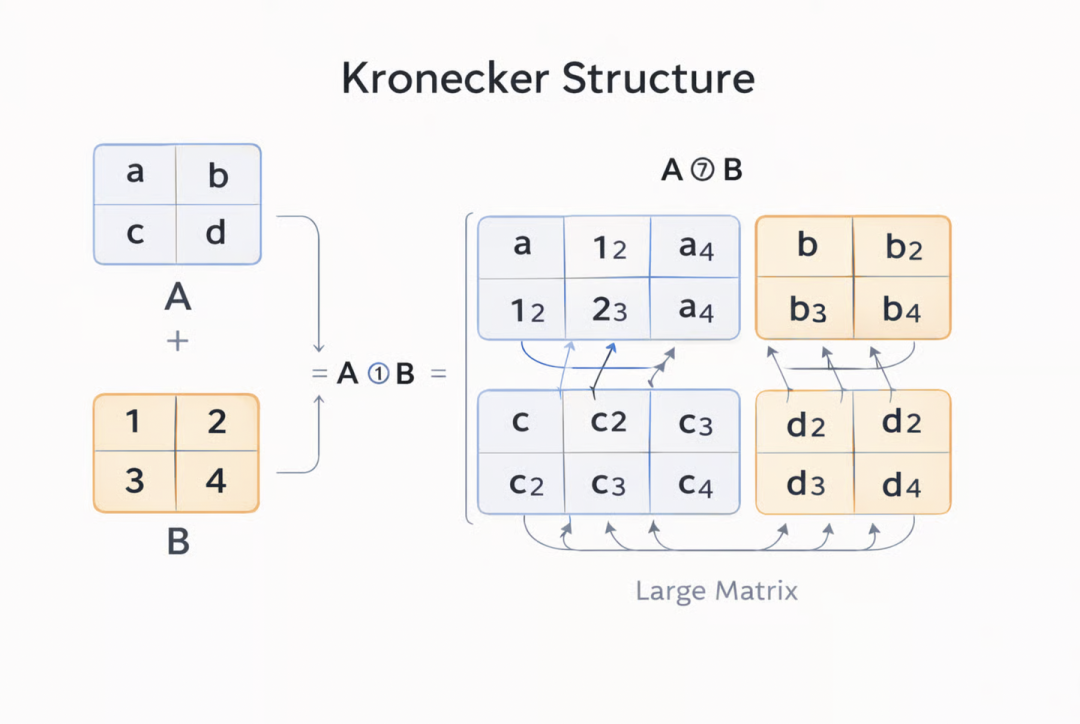

它通过添加Kronecker克罗内克积结构来实现这一点,将一个大矩阵表示为两个较小矩阵的克罗内克积。

添加图片注释,不超过 140 字(可选)

图片来源:Turing Post

这在大矩阵中创建了一种结构化的模式,可以更高效地存储和计算。然后Kron-LoRA将LoRA风格的低秩分解应用于其中一个因子。

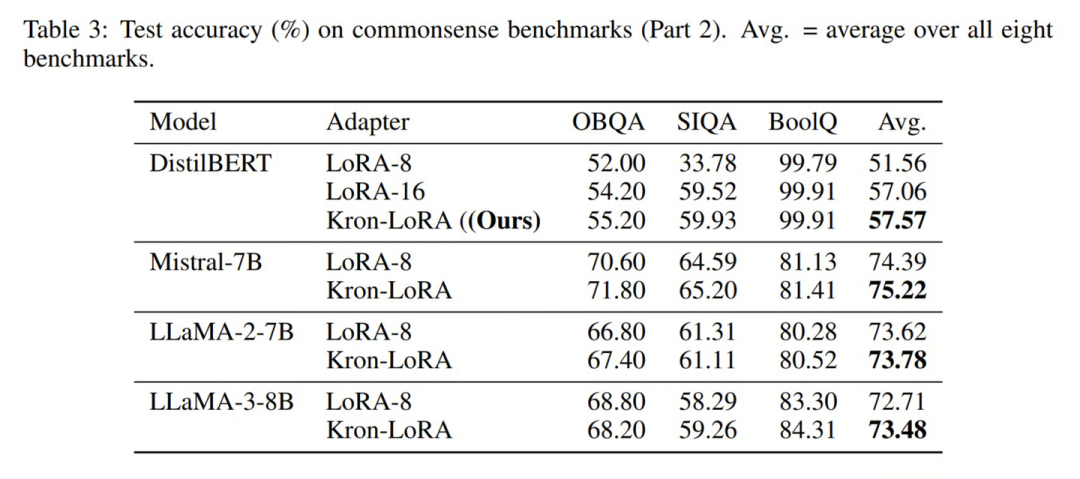

这样,适配器在权重更新中保持了结构化的、重复的模式,同时仍然受益于压缩。其结果是适配器尺寸大大减小,内存节省适中(仅带来5-8%的小幅速度开销),在多任务和顺序微调中具有更好的可扩展性,并且在某些持续学习设置中具有更强的鲁棒性。

添加图片注释,不超过 140 字(可选)

图片来源:Kron-LoRA原始论文

堆叠多种LoRA类型:适配器混合(MoA)

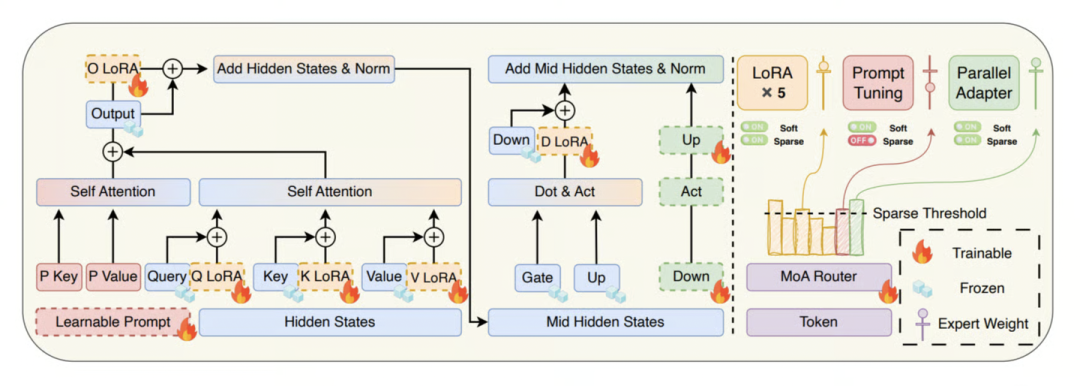

最后一种LoRA方法以不同的方式扩展了基于LoRA的微调思想,实际上是将更多适配器组合在一起。由浙江大学和腾讯开发的适配器混合(Mixture of Adapters, MoA),构建了一个异构的参数高效微调(PEFT)适配器的混合体,而不是依赖于许多相同的LoRA专家。关键点不仅在于添加更多专家,而在于添加具有互补能力的不同类型的专家。它的工作原理更精确地描述如下:

添加图片注释,不超过 140 字(可选)

图片来源:MoA原始论文

- MoA在每个Transformer层内部结合了不同的适配器类型,包括LoRA模块、并行适配器和提示调优。

- 然后,一个词元级别的路由器决定每个专家应贡献多少(类似于标准的混合专家(MoE)概念)。

- 在软MoA版本中,所有专家都通过学习的Sigmoid权重组合;而在稀疏MoA版本中,只有贡献超过阈值的专家才被激活,从而减少不必要的计算。

因此,不再是“处处使用一种适配器类型”,而是多种适配器类型动态协作,鼓励真正的专业化,并更好地利用冻结模型预训练的知识。这样做的好处也很重要:

- 更好的专业化意味着每个可训练参数带来更多的适应能力。

- MoA减少了专家冗余,这是同质化MoE-LoRA方法的一个常见弱点。

- 在稀疏版本中,效率提升,因为它只激活对给定词元重要的专家,从而削减了计算量。

实验中,软MoA取得了最佳的整体数学准确率,而稀疏MoA在活跃专家更少、内存更低的情况下,几乎保持了相同的性能。

MoA的重要性不仅仅在于它是又一个LoRA变体。 微调的未来不仅取决于更好的基于强化学习的优化器,还取决于如何设计众多的自适应模块本身。MoA暗示了一个后训练技术栈,它变得更加模块化、组合化、选择性和专业化,可以根据需要组合不同的适配器类型来处理不同的能力。

“超越RL”不仅仅是关于适配器。替代性的优化思路也是大语言模型微调方法广阔图景的一部分。

什么是进化策略(ES)?

进化策略(Evolution Strategies, ES) 源于进化优化,灵感来自自然选择。其思想不是通过反向传播计算梯度,而是从随机的参数扰动中估计优化方向。这种估计能够识别参数空间中哪个方向能最大程度地提高奖励。ES的过程如下所示:

- 从一个预训练的大语言模型开始。

- 通过对参数添加随机扰动,创建一个小的模型种群。

- 每个被扰动的模型为一项任务(例如推理或数学)生成答案。

- 使用奖励函数或验证器对输出进行评分。

- 模型参数朝着获得更高奖励的扰动方向更新。

- 这个过程重复多次迭代。

由于ES仅依赖于奖励评估而非梯度,它属于零阶优化方法的范畴。

与基于强化学习的微调相比,ES有几个优点:

- 首先,它是无梯度的。即使目标函数不可微(例如人类反馈、评估指标、外部工具),ES也能工作。

- 它在处理长时程或稀疏奖励时表现出色。

- 较少的奖励破解和对噪声奖励的鲁棒性:由于ES平均了大量样本,它优化的是一个模型种群而非单一策略,这使得利用奖励函数漏洞变得更加困难。

- 易于并行化,因为每个被扰动的模型可以在多个GPU上独立评估。

- 此外,它不需要反向传播,节省了GPU内存。

- 它也更稳定,因为其运行过程显示的方差远低于强化学习训练。

最后但同样重要的是,ES实际上可以扩展到数十亿参数的模型,这在以前被认为是不可行的。

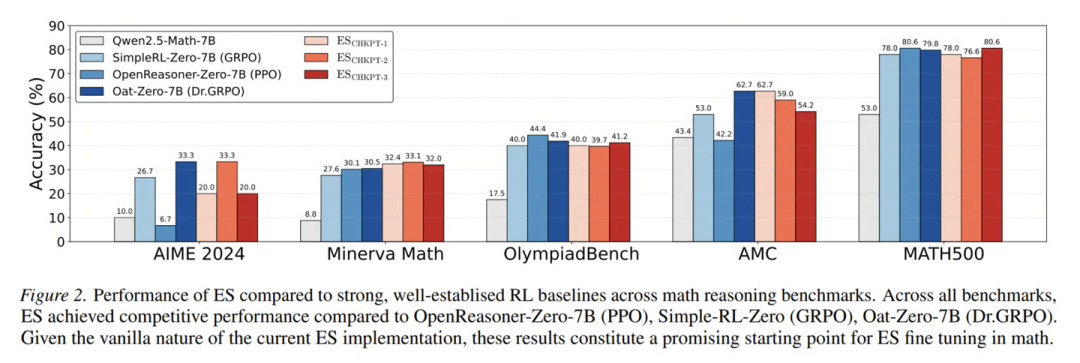

看看性能提升,在Countdown基准测试中,ES优于强化学习基线:Qwen-2.5-3B从10.0%提升到60.5%(ES),而GRPO为32.5%;Llama-3.1-8B从8.1%提升到61.2%,而强化学习约为51%。

ES在数学基准测试(AIME 2024, MATH500, AMC, OlympiadBench)上也显示出强劲的结果。它在像ARC-AGI(0.2% → 29.5%)和数独(2.5% → 69.5%)这样的谜题任务上带来了巨大的提升。

添加图片注释,不超过 140 字(可选)

图片来源:Evolution Strategies原始论文

然而,ES仍面临挑战,主要是需要大量前向评估,这在计算上可能很昂贵,并且其效果严重依赖于奖励信号的质量。

就训练周期而言,无梯度的ES位于后训练的优化步骤,在一个类似这样的流程中取代基于梯度的训练:预训练 → 定义后训练目标 → 优化方法(ES替代梯度下降)。

接下来就是有趣的地方了:如果混合LoRA和ES会怎样?

LoRA + ES – 一种替代性混合方法

LoRA和ES都属于后训练范畴,但它们在训练过程的不同层面运作:

- LoRA和生成的适配器负责参数化。

- 进化策略用于优化。

这里有趣的是,LoRA为ES优化提供了一个非常自然的操作场所。它们的联系相互加强,因为你可以简单地改变优化目标,只对LoRA参数应用ES,而忽略模型的其余部分。

新的工作流程变得直接明了:

- 从一个预训练模型开始。

- 冻结基础大语言模型权重。

- 将LoRA适配器附加到选定层。现在,ES可以直接在LoRA参数空间中搜索。

- 对LoRA应用ES,并对许多LoRA扰动进行采样。

- 评估模型在任务上的表现。

- 保留表现更好的变体,并相应地更新LoRA适配器。

ES的性能在很大程度上取决于参数空间的维度,而LoRA将其从完整大语言模型的约70亿到700亿参数缩小到约100万到2000万参数。微调的规模可以极大地扩展。这比单独使用ES或单独使用任何LoRA都更具吸引力和实用性。

LoRA展示了进化可以运作的另一个层面——系统可以进化出编码推理策略、领域知识或对齐策略的小型适配器模块。因为这些模块很小,许多变体可以快速测试,搜索过程变得高效得多。这正是像进化策略这样的零阶优化方法能够良好发挥作用的设置。有用的更新存在于一个低维子空间中,而LoRA明确地构建了这样一个子空间。

结论:为后训练准备了哪些方法?

总结一下,以下是在后训练阶段可以用来为模型提供正常运行所需指导的完整方法栈。

- 最简单且仍然极为常见的监督微调(SFT)。它在指令-响应数据集上训练模型,使用标准梯度下降进行优化。它确实简单稳定,但对齐能力有限。

- 目前最主流的范式——强化学习(RL),特别是RLHF和RLVR,采用不同的算法如PPO、GRPO、GSPO等。

- 直接偏好优化(DPO),它是RLHF的一种替代方案,直接优化偏好响应优于拒绝响应。它提供了更简单的训练,避免了不稳定的强化学习循环。

- 进化策略(ES)——Cognizant AI Lab的方法,通过随机扰动参数、评估性能、然后向表现更好的变体更新模型来改进模型,而不是使用基于梯度的优化。

- 采用先进LoRA方法的参数高效微调(PEFT),允许只更新模型中小的必要部分,而不是整个模型。今天探讨的方法表明,新型LoRA能更有效地降低成本,甚至增加新能力。

最后,开发将所有这些东西混合成混合形式,这也是实践中最常见的做法——例如,SFT → DPO → 加上RAG的智能体自我改进,或者新提出的LoRA + ES替代方案,其中LoRA定义了一个紧凑的参数子空间,而进化策略优化则无需梯度即可探索该空间,仅搜索最佳的适配器参数。

纵观全局,围绕LoRA和像ES这样的优化策略的新思路表明,语言模型的整体开发方式正在发生变化。以前,模型本身即是产品,训练产出一个完成的系统。现在可以看到,基础模型越来越多地扮演着平台的角色。能力通过模块化组件添加: 适配器、检索系统、工具集成和优化循环。一切都变成了围绕模型设计生态系统。

在那个生态系统中,例如,LoRA提供参数子空间,进化策略充当优化机制,而今天讨论的适配器生成引入了将知识转化为模块、将它们堆叠在一起并压缩到有效秩的新方法。这发展成一个系统,其中能力可以随时间进化和重组,而无需重新训练整个模型——这就是AI模型的新型微调技术栈。

学到的主要经验:有许多方法可以更有效地对模型进行后训练。

AI行业迎来前所未有的爆发式增长:从DeepSeek百万年薪招聘AI研究员,到百度、阿里、腾讯等大厂疯狂布局AI Agent,再到国家政策大力扶持数字经济和AI人才培养,所有信号都在告诉我们:AI的黄金十年,真的来了!

在行业火爆之下,AI人才争夺战也日趋白热化,其就业前景一片蓝海!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

人才缺口巨大

人力资源社会保障部有关报告显示,据测算,当前,****我国人工智能人才缺口超过500万,****供求比例达1∶10。脉脉最新数据也显示:AI新发岗位量较去年初暴增29倍,超1000家AI企业释放7.2万+岗位……

单拿今年的秋招来说,各互联网大厂释放出来的招聘信息中,我们就能感受到AI浪潮,比如百度90%的技术岗都与AI相关!

就业薪资超高

在旺盛的市场需求下,AI岗位不仅招聘量大,薪资待遇更是“一骑绝尘”。企业为抢AI核心人才,薪资给的非常慷慨,过去一年,懂AI的人才普遍涨薪40%+!

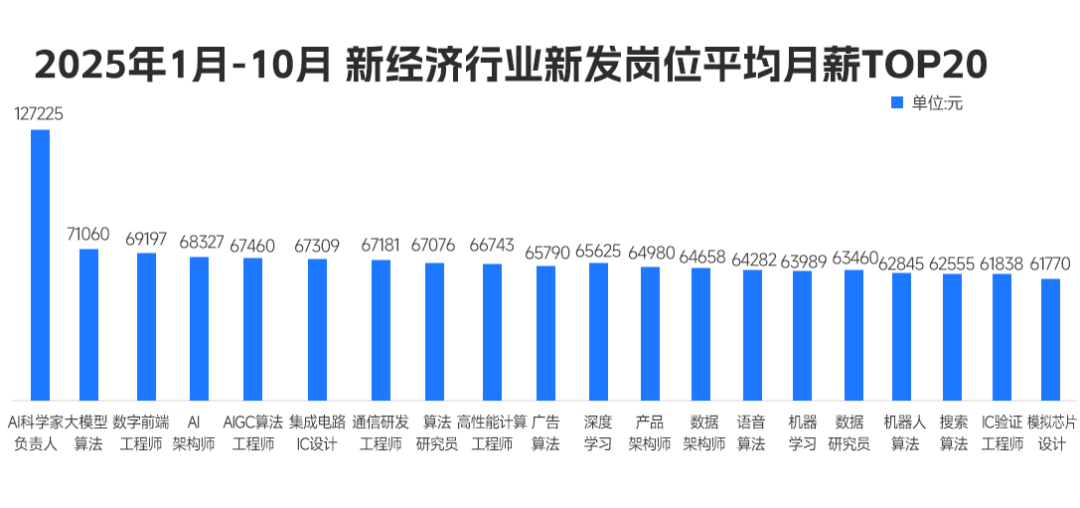

脉脉高聘发布的《2025年度人才迁徙报告》显示,在2025年1月-10月的高薪岗位Top20排行中,AI相关岗位占了绝大多数,并且平均薪资月薪都超过6w!

在去年的秋招中,小红书给算法相关岗位的薪资为50k起,字节开出228万元的超高年薪,据《2025年秋季校园招聘白皮书》,AI算法类平均年薪达36.9万,遥遥领先其他行业!

总结来说,当前人工智能岗位需求多,薪资高,前景好。在职场里,选对赛道就能赢在起跑线。抓住AI风口,轻松实现高薪就业!

但现实却是,仍有很多同学不知道如何抓住AI机遇,会遇到很多就业难题,比如:

❌ 技术过时:只会CRUD的开发者,在AI浪潮中沦为“职场裸奔者”;

❌ 薪资停滞:初级岗位内卷到白菜价,传统开发3年经验薪资涨幅不足15%;

❌ 转型无门:想学AI却找不到系统路径,83%自学党中途放弃。

他们的就业难题解决问题的关键在于:不仅要选对赛道,更要跟对老师!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献122条内容

已为社区贡献122条内容

所有评论(0)