ChatGPT秒回的秘密:揭秘LLM推理中的首Token延迟(TTFT)及其九大优化方案!

- 引言

当你在ChatGPT、Claude或其他大模型应用中输入一段长文本,按下发送键后,界面往往会陷入一段令人焦虑的"空白期"——光标闪烁、进度条转动,却迟迟不见任何字符输出。这种现象在处理长文档、RAG检索结果或复杂代码分析时尤为明显。从用户视角看,这就像是模型在"消化"你的输入,在真正"开口说话"之前需要漫长的思考时间。

这一现象在技术上被称为**首Token延迟(Time To First Token, TTFT)**过高,其根源在于大语言模型推理过程中一个关键却常被忽视的阶段——Prefill(预填充)阶段。理解Prefill阶段的计算特性、瓶颈成因及优化策略,对于AI基础设施工程师、推理框架开发者乃至应用层架构师而言,都是构建高性能LLM服务的必修课。

本文将从问题现象出发,深入剖析LLM推理的双相特征、KV Cache机制、注意力复杂度等底层原理,系统分析TTFT过高的根本原因,并详细介绍业界九大主流优化方案的原理、实现与性能数据,最后结合阿里云、华为、DeepSeek等工业实践案例,为不同场景提供选型建议。

- 问题现象深度描述

2.1 用户体验层面的感知

从终端用户的角度,Prompt Prefill慢的问题表现得非常直观:输入一段文字后,需要等待数百毫秒甚至数秒才能看到第一个输出字符。这段"空白等待期"严重影响交互体验,尤其在以下场景中更为突出:

- 长文档分析:上传一份50页的PDF并要求模型总结要点,首字输出可能需要等待5-10秒

- RAG应用:检索增强生成场景下,输入Prompt可能包含数千甚至数万字的检索结果

- 代码审查:提交大型代码文件进行审查时,模型需要长时间"预热"

2.2 技术指标异常表现

从技术监控角度,TTFT异常主要体现在以下指标上:

| 指标 | 正常范围 | 异常表现 |

|---|---|---|

| TTFT(首Token延迟) | 100-500ms | >2000ms |

| P99 TTFT | <1000ms | >5000ms |

| Prefill吞吐量 | >10K tokens/s | <3K tokens/s |

| GPU利用率(Prefill期间) | >80% | 波动剧烈 |

NVIDIA将TTFT定义为衡量用户体验的关键指标,它直接反映了模型从接收请求到开始生成响应的响应速度[9]。在生产环境中,TTFT的P99值往往是SLA的核心约束条件。

2.3 不同场景下的表现差异

Prefill延迟与输入Prompt长度呈强相关关系,但不同场景下的表现存在显著差异:

| 场景 | 典型Prompt长度 | TTFT表现 | 主要瓶颈 |

|---|---|---|---|

| 简单问答 | 50-200 tokens | 50-150ms | 网络延迟为主 |

| 多轮对话 | 500-2000 tokens | 200-800ms | 计算与带宽均衡 |

| RAG检索 | 5000-20000 tokens | 1-5s | 计算密集型 |

| 长文档处理 | 20000-100000 tokens | 5-30s | 显存带宽+计算 |

随着RAG应用的普及和上下文窗口的扩展(从4K到128K甚至更长),长Prompt场景已成为常态,TTFT优化的重要性日益凸显。

- 底层原理分析

3.1 LLM推理的双相特征

大语言模型的推理过程并非单一的计算流程,而是呈现出显著的双相(Two-Phase)特征,即预填充(Prefill)阶段与自回归解码(Decode)阶段。这两个阶段在计算模式、资源瓶颈及并行度上存在本质差异[15]。

Prefill阶段负责处理输入的Prompt,一次性并行计算所有输入token的隐藏状态,并生成首个输出token。由于该阶段需要对整个序列进行并行处理,其核心操作是大规模矩阵乘法(GEMM),属于典型的**计算密集型(Compute-bound)**任务。在Roofline模型分析中,Prefill的算术强度远高于硬件的算力带宽比,因此其性能主要受限于GPU的峰值算力(TFLOPS)[14]。

Decode阶段采用自回归方式,每步仅生成一个新token。尽管单步计算量较小,但每一步都需要将模型权重和不断增长的KV Cache从显存(HBM)加载到片上内存(SRAM)。这种频繁的IO操作使得Decode阶段成为典型的**访存密集型(Memory-bound)**任务,其性能瓶颈在于显存带宽而非算力[11]。

| 特性 | Prefill阶段 | Decode阶段 |

|---|---|---|

| 处理模式 | 并行处理所有输入tokens | 串行生成,每步一个token |

| 计算类型 | 计算密集型(Compute-bound) | 访存密集型(Memory-bound) |

| 核心瓶颈 | GPU峰值算力(TFLOPS) | 显存带宽(GB/s) |

| 并行度 | 高(序列级并行) | 低(依赖Batching提升) |

| GPU利用率 | 极高(可达90%+) | 较低(受限于IO) |

| 关键指标 | 首Token延迟(TTFT) | Token间延迟(TPOT/TBT) |

这种双相特征是理解TTFT问题的关键:当我们说"Prompt处理很慢"时,实际上指的是Prefill阶段的计算耗时过长。

3.2 KV Cache机制原理

KV Cache是LLM推理中空间换时间的核心技术,旨在消除自回归过程中的冗余计算[1]。

在Transformer的注意力机制中,计算当前token的注意力输出需要历史所有token的Key(K)和Value(V)向量。如果不使用缓存,每生成一个新token都需要重新计算所有历史token的K/V,导致大量重复计算。KV Cache的解决方案是:在Prefill阶段将所有输入token的K/V向量存储在显存中,后续Decode步只需计算当前新token的K/V并与缓存拼接[2]。

工作流程:

- Prefill阶段:Input Tokens → [Q, K, V 计算] → 存储 K, V 至 Cache → 输出第一个 Token

- Decode阶段:新 Token → [Q 计算] + [从 Cache 读取历史 K, V] → 拼接 → Attention → 下一个 Token

显存占用计算公式:

以Llama-3 70B模型为例,在64K上下文下,仅KV Cache就需占用约7.6GB显存(约1.5KB/token)[2]。

性能影响:使用KV Cache可将推理速度提升3-10倍,在100B以上模型中提升可达10倍以上。实测显示,响应时间可从1-2秒压缩至0.3-0.5秒[4]。然而,KV Cache的显存占用也成为了限制并发请求数的主要因素,在长文本场景下可能迅速耗尽GPU显存。

3.3 注意力计算复杂度与"内存墙"

标准Transformer的Self-Attention机制具有的时间和空间复杂度,这是长序列推理的主要瓶颈[7]。

在Prefill阶段,模型必须计算一个的注意力分数矩阵(其中为输入序列长度)。当达到数万级别时,中间矩阵的存储和计算开销将呈平方级爆炸。例如,处理32K tokens的输入时,仅注意力矩阵就需要存储约10亿个元素。

更关键的是,GPU内部存在严重的带宽层级差异:

| 存储层级 | 典型带宽 | 容量 |

|---|---|---|

| HBM(高带宽显存) | 1.5-2.0 TB/s | 40-80GB |

| L2 Cache | 约4 TB/s | 6MB |

| SRAM(片上内存) | 19+ TB/s | 20MB |

| 寄存器 | >30 TB/s | 极小 |

标准Attention实现中,中间结果(如矩阵)需要频繁在HBM与SRAM之间交换,而这些数据规模为。当HBM带宽成为瓶颈时,即使GPU算力充足,也无法被充分利用,这就是所谓的**"内存墙"问题**[10]。

3.4 Roofline模型分析

Roofline模型是分析计算任务性能瓶颈的有力工具。它将任务分为两类:当算术强度(FLOPs/Byte)低于硬件的算力带宽比时,任务为访存密集型;反之为计算密集型[14]。

对于Prefill阶段,由于大量并行的矩阵乘法操作,算术强度较高,通常位于Roofline的"计算密集区",性能受限于GPU算力。而Decode阶段由于每步仅处理一个token,算术强度极低,位于"带宽密集区",性能受限于HBM带宽。

这种特性差异直接导致了优化策略的分化:Prefill优化需要关注计算效率和并行度,而Decode优化则需要聚焦于减少显存访问和提高带宽利用率。

- 根本原因剖析

4.1 长Prompt导致的计算压力

随着RAG(检索增强生成)应用的普及和上下文窗口的扩展,输入Prompt长度大幅增加。由于Prefill阶段需要并行处理所有输入token,计算量随长度线性(或在注意力计算中呈平方级)增长,直接导致TTFT显著上升[9]。

一个典型的RAG应用可能将5-10个相关文档片段(每个500-2000 tokens)拼接到Prompt中,使得总输入长度达到10K-30K tokens。这种长度的Prefill计算可能需要数秒才能完成,远超用户的期望响应时间。

4.2 显存带宽瓶颈与IO延迟

即使在计算密集的Prefill阶段,显存带宽仍可能成为瓶颈。特别是当模型参数量巨大(如70B或更大)时,模型权重的加载本身就会消耗大量带宽。此外,标准Attention实现中规模的中间结果读写会进一步加剧带宽压力[10]。

4.3 高并发下的排队效应

在生产环境中,高并发请求会导致显著的排队延迟。如果系统采用静态批处理策略,短请求会被长请求"拖累",必须等待批次内最长的请求完成后才能返回结果。即使采用更先进的调度策略,大量同时到达的Prefill任务也会争抢GPU计算资源,造成TTFT的剧烈抖动[6]。

4.4 P-D混合调度的资源抢占

在现代推理框架(如vLLM)中,Prefill和Decode任务通常在同一GPU上混合执行。这种设计虽然提高了资源利用率,但也带来了新问题:当一个新请求的Prefill任务被调度执行时,它会抢占正在进行中的Decode任务的计算资源,导致两者相互干扰[11]。

具体表现为:Prefill任务的插入会导致正在生成中的响应出现"卡顿",而大量排队的Decode任务也会延迟新请求的Prefill启动。这种P-D混合调度带来的干扰效应是生产环境中TTFT不稳定的重要原因。

- 优化方案详解

5.1 PagedAttention:解决显存碎片化

原理:vLLM团队借鉴操作系统虚拟内存的分页机制,提出了PagedAttention。传统实现中,每个请求的KV Cache需要分配连续的显存空间,导致严重的内存碎片化(利用率仅约20%)。PagedAttention将KV Cache划分为固定大小的物理块(Block,通常为16 tokens),通过Block Table进行逻辑到物理的映射[11]。

实现方式:

# vLLM中的配置示例from vllm import LLMllm = LLM( model="meta-llama/Llama-3-70B", block_size=16, # 每个Block存储16个token的KV gpu_memory_utilization=0.95, # 显存利用率)

性能数据:PagedAttention将显存利用率从20%提升至90%以上,支持更大的Batch Size。在吞吐量测试中,vLLM较HuggingFace基线提升最高24倍[11]。虽然PagedAttention主要优化吞吐量而非直接降低TTFT,但更高的并发能力间接减少了请求排队时间。

5.2 Flash Attention:IO感知优化

原理:Flash Attention的核心思想是IO感知(IO-Awareness),通过减少HBM访问来突破内存瓶颈。它采用分块(Tiling)技术,将注意力计算分解为多个小块,在SRAM中完成计算后再写回HBM,避免了中间结果的频繁读写[10]。

版本演进:

| 版本 | 核心改进 | 性能提升 |

|---|---|---|

| Flash Attention v1 | Tiling + Online Softmax | 2-4x内存效率 |

| Flash Attention v2 | 优化多头并行策略 | 约1.7x提速 |

| Flash Attention v3 | H100异步计算优化 | 进一步提升 |

技术细节:传统Attention需要将完整的注意力矩阵存储在HBM中,Flash Attention通过在线计算(Online Softmax)技术,逐块计算并累积结果,将空间复杂度从降至[10]。

适用场景:Flash Attention对长序列场景效果显著,当输入长度超过2K tokens时,性能优势明显。几乎所有主流推理框架(vLLM、SGLang、TensorRT-LLM)都已集成Flash Attention。

5.3 Chunked Prefill:分块预填充

原理:Chunked Prefill(源自Sarathi系统)将超长Prompt拆分为多个固定大小的小块(Chunk),分步进行预填充。关键创新在于允许在Chunk之间插入其他请求的Decode任务,有效缓解了长Prefill导致的**首端阻塞(Head-of-Line Blocking)**现象[13]。

实现方式:

# 概念示例:将10000 tokens的Prompt分块处理chunk_size = 512total_tokens = 10000for i in range(0, total_tokens, chunk_size): chunk = prompt_tokens[i:i+chunk_size] prefill_chunk(chunk) # 在块之间可以调度其他请求的Decode任务 schedule_pending_decode_tasks()

性能数据:采用Chunked Prefill后,系统的P99 TTFT可降低30-50%,特别是在混合负载(长短请求混合)场景下效果显著。它使得短请求不再被长Prefill任务完全阻塞[13]。

5.4 Continuous Batching:动态批处理

原理:传统静态批处理(Static Batching)要求一个批次内所有请求同时开始、同时结束,导致已完成的短请求必须等待长请求。Continuous Batching(源自Orca系统)打破了这一限制,允许新请求在任何迭代时刻加入批处理[5]。

工作流程:

- 系统维护一个活跃请求池

- 每次迭代时,对池中所有请求执行一步Decode

- 完成的请求立即移出池并返回结果

- 新到达的请求经过Prefill后立即加入池

性能数据:Continuous Batching可将系统吞吐量提升2-5倍,同时显著降低平均TTFT。vLLM、SGLang等主流框架均采用此技术[5]。

5.5 Speculative Decoding:投机解码

原理:投机解码采用**“先草稿后验证”**的范式。由一个轻量级小模型(Drafter)快速生成多个候选token,再由大模型(Verifier)一次性并行验证。只要验证通过率足够高,即可大幅减少昂贵的自回归步数,突破访存带宽限制[8]。

工作流程:

1. Drafter快速生成K个候选token(如K=5)2. Verifier并行计算这K个位置的概率分布3. 从前向后验证,接受概率匹配的token4. 在首个拒绝位置重新采样,丢弃后续候选5. 重复上述过程

性能数据:在LLaMA-2-70B模型上,投机解码实现了2.8倍加速,TTFT从850ms降至210ms。关键在于选择合适的Drafter模型,验证通过率需达到70%以上才能获得明显收益[8]。

5.6 MQA/GQA/MLA:KV Cache压缩

原理:标准的多头注意力(MHA)为每个注意力头维护独立的K/V向量,导致KV Cache占用大量显存。业界提出了多种压缩方案来减少KV Cache的显存占用[1]:

| 方案 | 原理 | 显存占用比 | 代表模型 |

|---|---|---|---|

| MHA | 独立K/V头 | 100%(基准) | GPT-3 |

| MQA | 所有Query头共享一对K/V | 约6% | PaLM |

| GQA | Query头分组共享K/V | 12-25% | Llama-3 |

| MLA | 低秩潜空间压缩 | 5-10% | DeepSeek-V3 |

DeepSeek MLA详解:MLA(Multi-head Latent Attention)是DeepSeek提出的创新架构。它利用低秩矩阵分解,将高维的KV向量压缩到低维潜空间(如512维),大幅减少缓存占用的同时保持模型精度。MLA的KV Cache大小仅为标准MHA的5%-10%,在超长上下文场景下优势巨大[1]。

5.7 Prompt Caching:复用计算结果

原理:在多轮对话或使用固定系统提示词的场景下,Prompt中存在大量重复内容。Prompt Caching(又称Prefix Caching)通过哈希匹配或前缀树结构,自动检测并复用已计算的KV Cache[16]。

实现方案:

- SGLang RadixAttention:使用基数树(Radix Tree)索引已缓存的前缀,自动检测新请求与已有缓存的重叠部分

- vLLM Automatic Prefix Caching:通过哈希值匹配,实现跨请求的KV Cache共享

配置示例:

# vLLM启用Prefix Cachingllm = LLM( model="meta-llama/Llama-3-70B", enable_prefix_caching=True,)

性能数据:在命中缓存的情况下,Prefill阶段可被大幅缩短甚至完全跳过,TTFT最高可降低26.8倍[11]。对于使用固定系统提示词的应用(如客服机器人),Prefix Caching是最具性价比的优化手段。

5.8 P-D分离架构:计算与访存解耦

原理:针对P-D混合调度带来的资源抢占问题,业界提出了**P-D分离(Disaggregated Serving)**架构。核心思想是将计算密集的Prefill任务和访存密集的Decode任务部署在不同的GPU集群上,实现资源的专用化和隔离[11]。

架构设计:

┌─────────────────────────────────────────────────┐│ 请求路由层 │└───────────────┬───────────────┬─────────────────┘ │ │ ┌───────▼───────┐ ┌─────▼─────┐ │ Prefill集群 │ │ Decode集群 │ │ (计算优化配置) │ │(带宽优化配置)│ └───────┬───────┘ └─────▲─────┘ │ │ └───KV Transfer─┘

性能数据:阿里巴巴RTP-LLM的生产实践表明,采用P-D分离架构后,平均延迟下降48%,P99延迟下降78%[11]。该架构特别适合超大规模部署和对延迟稳定性要求极高的场景。

- 工业实践案例

6.1 阿里云 PolarKVCache

阿里云针对长文本场景推出了PolarKVCache方案,通过构建分布式内存池将KV Cache扩展至TB级容量。该方案将KV Cache从GPU显存卸载到高性能分布式存储系统,通过RDMA网络实现快速访问[11]。

核心优势:

- 支持百万级token的超长上下文

- TTFT在长文本场景下降低8.6倍

- 无需修改模型架构,对应用透明

6.2 华为 Ascend-vLLM

华为针对昇腾NPU推出了优化版推理框架Ascend-vLLM,深度集成了Prefix Caching、Chunked Prefill等技术,并针对昇腾硬件特性进行了算子融合优化。

关键特性:

- 原生支持昇腾910/910B系列NPU

- 集成FlashAttention昇腾版实现

- 支持多机多卡分布式推理

6.3 DeepSeek 基础设施

DeepSeek在其V3模型中采用了MLA架构,从模型设计层面解决KV Cache显存瓶颈。结合自研的高性能算子库和推理框架,实现了极具竞争力的推理性能[1]。

技术亮点:

- MLA架构使KV Cache占用降低90%以上

- 自研算子融合技术减少kernel调用开销

- 端到端优化的推理pipeline

- 优化方案选型建议

不同场景下的优化策略选择应基于实际需求和资源约束。以下是针对典型场景的推荐方案:

| 场景 | 首选方案 | 次选方案 | 备注 |

|---|---|---|---|

| 短Prompt在线服务 | Continuous Batching + Flash Attention | Speculative Decoding | 追求低延迟 |

| RAG长文本处理 | Chunked Prefill + Prefix Caching | P-D分离架构 | 平衡延迟与吞吐 |

| 多轮对话应用 | Prefix Caching(RadixAttention) | Continuous Batching | 复用率高时效果显著 |

| 超长上下文(>32K) | MLA/GQA架构 + PagedAttention | PolarKVCache | 显存是主要瓶颈 |

| 高并发生产环境 | P-D分离 + Continuous Batching | 全套优化组合 | 追求稳定性 |

| 资源受限部署 | Flash Attention + PagedAttention | 量化技术 | 性价比优先 |

组合优化建议:实践中,上述优化方案并非互斥,而是可以组合使用。一个典型的高性能推理服务通常会同时启用:Flash Attention(计算优化)+ PagedAttention(内存管理)+ Continuous Batching(调度优化)+ Prefix Caching(复用优化)。

- 总结与展望

大模型Prompt Prefill慢与首Token延迟高的问题,本质上源于LLM推理的双相计算特征与硬件资源瓶颈之间的矛盾。Prefill阶段的计算密集型特性、注意力机制的复杂度、KV Cache的显存占用压力,以及高并发下的调度冲突,共同构成了TTFT优化的核心挑战。

业界已经发展出一套完整的优化体系来应对这些挑战:从底层的Flash Attention(IO感知优化)和PagedAttention(内存管理),到调度层的Continuous Batching和Chunked Prefill,再到架构层的MQA/GQA/MLA和P-D分离,以及应用层的Prefix Caching。这些技术相互配合,已经能够在生产环境中实现数倍甚至数十倍的性能提升。

展望未来,随着上下文窗口向百万级token扩展,以及多模态大模型的普及,TTFT优化将面临更大挑战。可以预见的发展方向包括:更激进的稀疏注意力机制、硬件感知的端到端编译优化、以及新型存储架构(如CXL内存扩展)的应用。对于AI基础设施工程师而言,持续跟踪这些技术演进、建立系统化的性能优化能力,将是构建竞争力的关键。

AI行业迎来前所未有的爆发式增长:从DeepSeek百万年薪招聘AI研究员,到百度、阿里、腾讯等大厂疯狂布局AI Agent,再到国家政策大力扶持数字经济和AI人才培养,所有信号都在告诉我们:AI的黄金十年,真的来了!

在行业火爆之下,AI人才争夺战也日趋白热化,其就业前景一片蓝海!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

人才缺口巨大

人力资源社会保障部有关报告显示,据测算,当前,****我国人工智能人才缺口超过500万,****供求比例达1∶10。脉脉最新数据也显示:AI新发岗位量较去年初暴增29倍,超1000家AI企业释放7.2万+岗位……

单拿今年的秋招来说,各互联网大厂释放出来的招聘信息中,我们就能感受到AI浪潮,比如百度90%的技术岗都与AI相关!

就业薪资超高

在旺盛的市场需求下,AI岗位不仅招聘量大,薪资待遇更是“一骑绝尘”。企业为抢AI核心人才,薪资给的非常慷慨,过去一年,懂AI的人才普遍涨薪40%+!

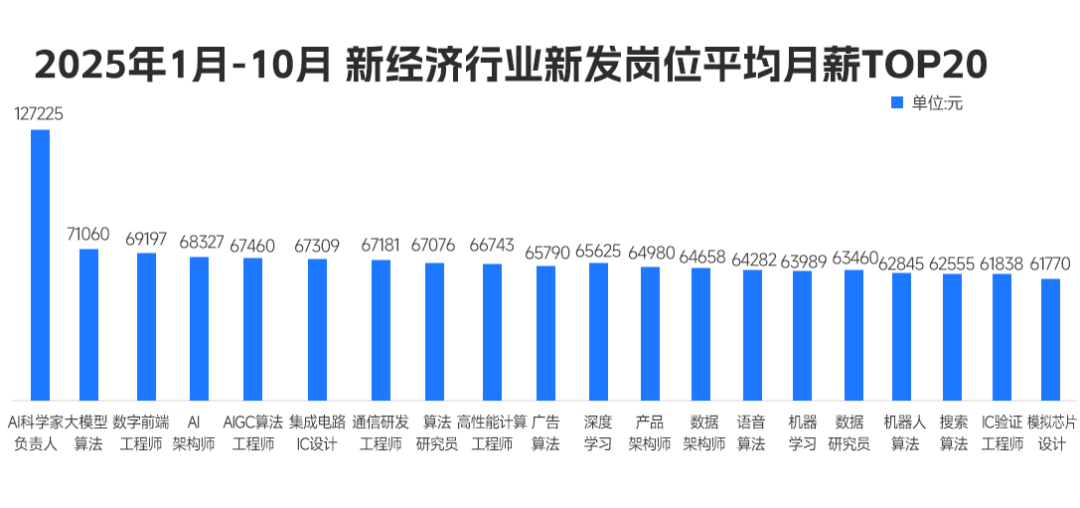

脉脉高聘发布的《2025年度人才迁徙报告》显示,在2025年1月-10月的高薪岗位Top20排行中,AI相关岗位占了绝大多数,并且平均薪资月薪都超过6w!

在去年的秋招中,小红书给算法相关岗位的薪资为50k起,字节开出228万元的超高年薪,据《2025年秋季校园招聘白皮书》,AI算法类平均年薪达36.9万,遥遥领先其他行业!

总结来说,当前人工智能岗位需求多,薪资高,前景好。在职场里,选对赛道就能赢在起跑线。抓住AI风口,轻松实现高薪就业!

但现实却是,仍有很多同学不知道如何抓住AI机遇,会遇到很多就业难题,比如:

❌ 技术过时:只会CRUD的开发者,在AI浪潮中沦为“职场裸奔者”;

❌ 薪资停滞:初级岗位内卷到白菜价,传统开发3年经验薪资涨幅不足15%;

❌ 转型无门:想学AI却找不到系统路径,83%自学党中途放弃。

他们的就业难题解决问题的关键在于:不仅要选对赛道,更要跟对老师!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献162条内容

已为社区贡献162条内容

所有评论(0)