一句话生成 UI 自动化脚本!Midscene.js 让测试“零编码”成为可能

一转眼,已经工作8年了,“回味”一下,这一年在做什么事情,做了哪些事情,成了哪些事情。

不仅团队在布局大模型、智能体领域,还需要对当前业界AI测试工具的探索和二次开发,以便更适应企业的业务。 这一忙就是小一年。

这时候你是不是就好奇的问到:那这一次,你会给我们聊哪些最新的测试工具呢,哪些测试方法,以及如何在场景中应用呢?

嗯,没错的,这次会分系列文章来聊,这次依然会聊AI:即AI测试工具, 智能体测试系列专栏等等。

所以,是不是很期待哦, 我也是蛮期待的。

好了,咱闲言少叙,书说简短,开启今天的AI工具探索之:Midscene.js 。

Midscene.js简介

2.1 什么是Midscene.js

提到Midscene.js,是不是很多小伙伴很陌生,它就仅仅是一个自动化 工具么? 它的神奇之处是什么?

别着急,跟着我的思路,咱逐层揭开Midscene.js的面纱。

Midscene.js 是由字节跳动 Web Infra 团队开源的一款基于 AI 的 UI 自动化工具,支持通过自然语言描述实现对网页、移动端、自动化测试和脚本编写等操作。

Midscene.js兼容 JavaScript SDK、YAML 脚本和 Chrome 插件,可深度集成 Playwright、Puppeteer 等主流框架,实现智能、高效、低门槛的自动化体验。

2.2 Midscene.js与其他工具差异

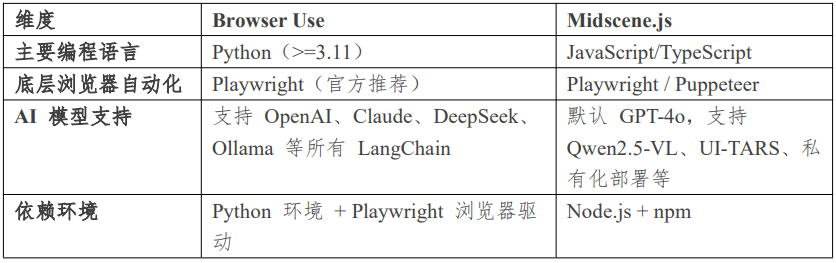

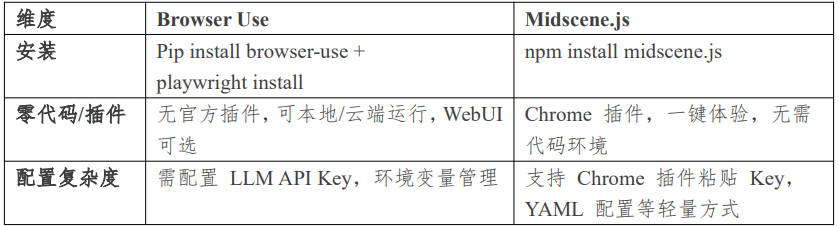

说到Midscene.js,就不得不提另一个工具Browser Use,这里,我通过技术栈与生态、核心功能与 API 设计、多模态与 AI 能力、使用门槛等来分别对比这两个工具的差异。

技术栈与生态

通过上述的对比,可以更直观地看到:

-

Browser Use 属于 Python 生态,AI 模型适配性极广,适合后端/算法团队;

-

Midscene.js 属于 JS/TS 生态,深度集成前端工程链,适合前端测试和自动化项目

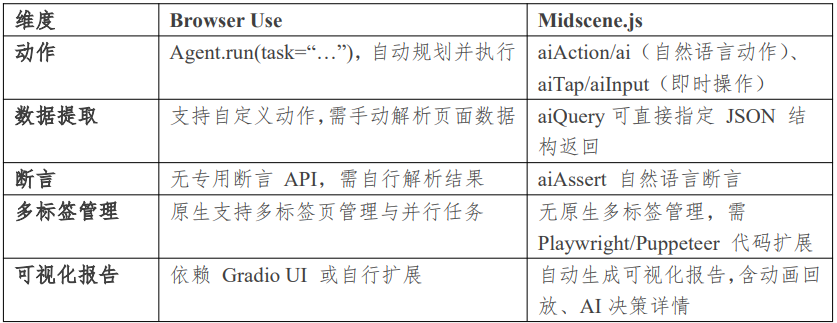

核心功能与 API 设计

同样,Midscene.js 的 aiQuery/aiAssert 等 API 设计更适合测试和自动化,Browser Use 适合灵活的任务规划和数据采集。

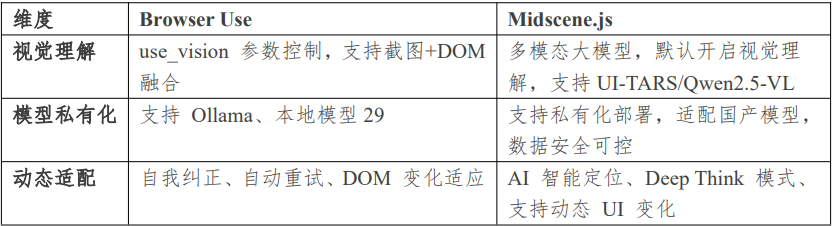

多模态与 AI 能力

两者均支持视觉理解和模型私有化:

-

Midscene.js 在多模态 UI 理解和动态适配上更突出

-

Browser Use 在模型生态和自定义能力上更强

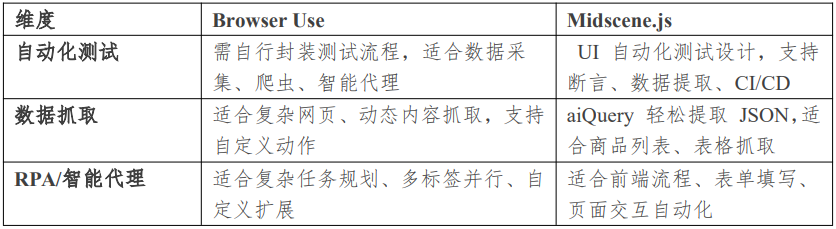

应用场景

在应用场景上, Browser Use 更适合爬虫、智能代理等复杂场景,Midscene.js 更适合前端测试、轻量自动化和 CI/CD 集成。

使用门槛

在使用门槛:

-

Midscene.js 的 Chrome 插件和 YAML 脚本大幅降低上手门槛

-

Browser Use 需 Python 环境和 LangChain 知识,但功能扩展更自由

所以,我相信除大部分测试团队在选择工具侧时候, 除了考察工具的应用能力,可拓展性,更重要的是看这个工具的使用门槛和上手速度。

综上所述,我相信,大家对Browser Use 和Midscen.js 这两款工具都有了一些初步的了解。

那是不是有同学会问了, 既然要聊Midscen.js,不会仅仅让我们了解这两款工具的差异点吧,还有其他的让我们了解的么?

那是当然,关于Midscen.js的安装、模型配置等,我们继续往下聊。

Midscene.js安装

3.1手动下载安装

1、在Github 下载release压缩包,路径:

https://github.com/web-infra-dev/midscene/releases

2、本地解压后,添加到chrome或edage浏览器的拓展里面

3.2在chrome浏览器下载插件安装

相对于通过Github下载安装包,这个方法更便捷, 直接在chrome应用商店搜索“Midscene.js”,找到后直接安装即可

3.3命令行安装

3.3.1 Npm 安装

如果要通过sdk安装,可以直接执行下面这个命令

npm install midscene.js一键获取完整项目代码

同样,没有什么难度, 这里就不过多赘述

3.3.2 源码安装

这种方式安装是最常见的,并且可以本地部署,也可以对源码进行二次优化,具体执行如下:

git clone https://github.com/web-infra-dev/midscene.gitcd midscene

一键获取完整项目代码

Midscene.js模型配置

上述方法选择其中一个安装完成后,我们就需要配置模型了,到现在,Midscene.js已经可以适配视觉语言模型和 LLM 模型 ,这对我们来说非常友好,这或许也是为啥迅速在测试领域“受宠”的原因吧。

4.1视觉语言模型配置

关于Midscene.js对视觉语言模型适配有:千问VL 、豆包系列视觉语言模型、Gemini-2.5-Pro 、UI-TARS 。

这里,我主要介绍豆包 系列视觉语言模型和千问模型的配置方法。

豆包系列视觉语言模型,配置如下:

OPENAI_BASE_URL="https://ark.cn-beijing.volces.com/api/v3" #模型urlOPENAI_API_KEY="...." #自己的API 秘钥,MIDSCENE_MODEL_NAME="ep-..." # 推理模型接入点 ID 或模型名称MIDSCENE_USE_DOUBAO_VISION=1

一键获取完整项目代码

使用 Qwen3-VL 模型的配置

OPENAI_BASE_URL="https://dashscope.aliyuncs.com/compatible-mode/v1"OPENAI_API_KEY="......"MIDSCENE_MODEL_NAME="qwen3-vl-plus"MIDSCENE_USE_QWEN3_VL=1 # 注意,这个参数与 MIDSCENE_USE_QWEN_VL 不能同时使用

一键获取完整项目代码

其他的模型配置跟千问模型和豆包视觉模型类似, 就不在这里一一展示了。

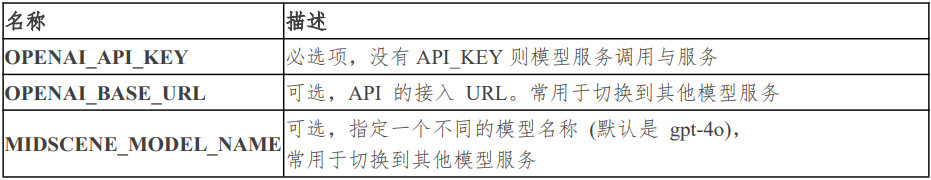

关于通用配置说明,如下:

4.2LLM配置

关于LLM, 我不会做过多介绍, 因为LLM 会在Midscene.js v1.05之后版本不再支持。

这里,就了解一下即可。

OPENAI_API_KEY="***"OPENAI_BASE_URL="***"MIDSCENE_MODEL_NAME="gpt-4o "

一键获取完整项目代码

到这里,关于Midscene.js的基础知识以及前期准备已经完成。接下来,会带着我们实战了,分别为WebUI ,Android、iOS、API等。

感谢每一个认真阅读我文章的人!!!

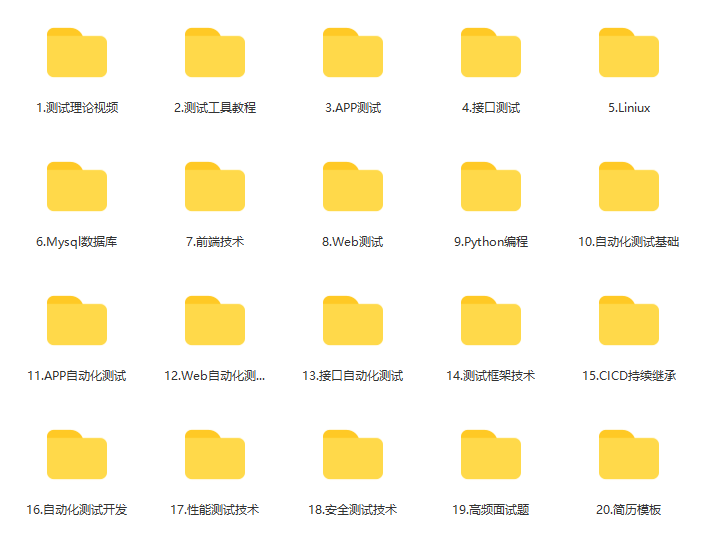

作为一位过来人也是希望大家少走一些弯路,如果你不想再体验一次学习时找不到资料,没人解答问题,坚持几天便放弃的感受的话,在这里我给大家分享一些自动化测试的学习资源,希望能给你前进的路上带来帮助。

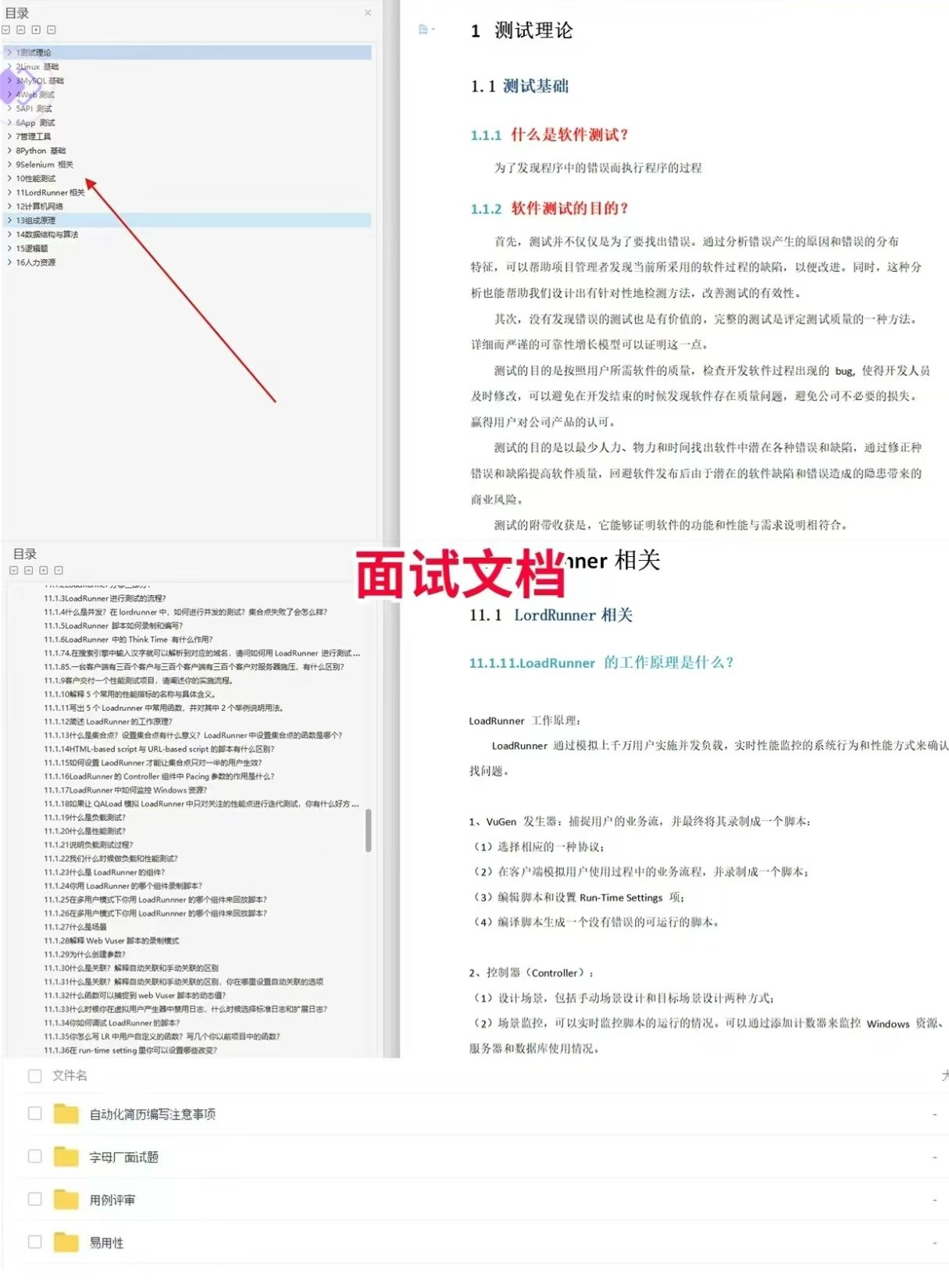

软件测试面试文档

我们学习必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有字节大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

视频文档获取方式:

这份文档和视频资料,对于想从事【软件测试】的朋友来说应该是最全面最完整的备战仓库,这个仓库也陪伴我走过了最艰难的路程,希望也能帮助到你!以上均可以分享,点下方小卡片即可自行领取。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)