OpenClaw 多 Agent 协作框架的并发限制与企业化规避方案痛点直击

OpenClaw 作为多步迭代的智能体协作框架,在规模化落地中面临两个致命瓶颈:高并发触发的速率限制(Rate Limit),以及违规调用导致的账号封禁(Account Ban)。这两个问题在千万级 Token 消耗的出海项目中尤为突出。

原生 OpenAI API 无法承载此类架构。

技术还原:为什么原生 API 难以支撑

TPM 与并发竞争

TPM(Tokens-Per-Minute)限制是横亘在 OpenClaw 面前的第一道墙。OpenAI API 对每个账户设置默认 TPM 上限,通常在 15 万到 90 万之间,具体取决于模型层级。OpenClaw 的一次任务拆解往往触发 5-10 个 Agent 并发调用,每个 Agent 的 Prompt 消耗 2 千到 1 万 Token 不等。

一次典型任务:分析财务报表 → 调用 3 个数据提取 Agent + 2 个分析 Agent + 1 个汇总 Agent。6 个 Agent 同时发起请求,总 Token 消耗可能在 3 万到 6 万之间。如果有 50 个用户同时提交任务,瞬间峰值 TPM 即刻达到 150 万到 300 万。超出阈值,立即触发 429 错误。

问题在于,原生 API 没有提供实时配额查询接口。开发者只能在错误发生后才知道触限,而此时整个任务链条已经断裂。

并发竞争的加剧

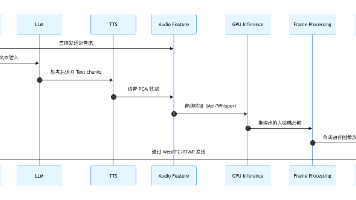

OpenClaw 的多 Agent 架构天然放大了并发问题。传统应用是"一个请求,一个响应",OpenClaw 是"一个请求,多个子任务,多个响应"。子任务之间存在依赖关系,任何一个 Agent 的调用失败都可能导致整个工作流停滞。

更糟的是,重试机制会进一步恶化竞争。当 Agent A 触限失败,系统自动重试,但重试请求可能正好与其他 Agent 的正常请求叠加,形成请求雪崩。

RPM 隐形限制

除 TPM 外,OpenAI API 还设置 RPM(Requests-Per-Minute)限制。对于 GPT-4 类模型,RPM 通常在 500 到 3500 之间。OpenClaw 的 Agent 拆解模式会产生大量细粒度请求,即使每个请求 Token 不多,也会轻易击穿 RPM 上限。

账号封禁风险

违规调用主要来自三个场景:

一是绕过验证使用未授权 API 端点。部分出海项目为降低成本,通过反向代理调用非官方接口,触发风控。

二是超出服务条款的并发调用。OpenAI 对每个账户的并发连接数有隐含限制,虽然文档未明确披露,但实测超过 30-50 个并发连接即可能触发暂时封禁。

三是触发滥用检测。高频相似请求、异常调用模式都会被判定为滥用,直接封禁。

Azure OpenAI 的企业级能力

资源隔离机制

Azure OpenAI 通过多层级隔离解决上述问题。最底层是订阅级隔离,每个 Azure 订阅获得独立的 TPM 配额,而非共享公共配额池。中层是部署级隔离,同一订阅下可创建多个模型部署,每个部署有独立的 RPM 限制。顶层是区域级隔离,全球 30+ 区域独立运营,配额互不影响。

这种隔离架构允许 OpenClaw 实现"分桶调用":将不同类型的 Agent 路由到不同的部署实例,避免单个 Agent 的激增波及整个系统。

专属 TPM 扩容

Azure OpenAI 支持白名单申请流程。通过微软合作伙伴渠道,可申请专属 TPM 扩容,最高可达数千万级别。扩容并非简单增加数字,而是分配专用算力资源,确保扩容后的配额真正可用。

扩容流程通常需要 5-10 个工作日,但一旦获批,OpenClaw 可获得稳定的高并发承载力。扩容后配额绑定到 Azure 订阅,不会因调用模式波动被回收。

微软官方 SLA 保障

Azure OpenAI 提供 99.9% 的月度可用性 SLA,高于 OpenAI API 的最佳承诺(无官方 SLA)。SLA 覆盖端到端服务:从 API 端点到模型推理,承诺在服务故障时提供 10% 到 100% 的服务时长抵扣。

SLA 的意义在于明确责任边界。当 OpenClaw 因服务故障导致调用失败,可依据 SLA 申请赔偿,降低业务风险。原生 OpenAI API 则无此类保障。

全球节点部署(Global Deployment)

Azure OpenAI 在全球 30+ 个区域部署,支持跨区域负载均衡。OpenClaw 可根据用户地理位置路由请求到最近的区域,减少延迟并分散负载。

更重要的是,全球部署提供故障隔离能力。当一个区域服务异常时,自动切换到邻近区域,保证业务连续性。出海项目可同时在多个区域部署服务,避免单点故障。

专业伙伴价值

白名单申请服务

作为 Azure OpenAI 认证合作伙伴,领驭科技提供白名单申请全流程服务。前期评估企业规模与需求,制定扩容方案;中期准备技术文档与业务说明,与微软技术团队对接;后期跟进审批进度,确保扩容按期交付。

白名单申请的核心价值在于"专属资源"。通过我们的渠道申请,可获得比标准流程更高的配额上限,以及优先的技术支持响应。

专属 TPM 扩容

扩容服务分三个阶段实施。第一阶段是配额评估,分析 OpenClaw 历史调用数据,预测未来 6-12 个月的需求峰值。第二阶段是资源分配,根据评估结果申请专属 TPM 配额,同时预留 30-50% 的缓冲空间。第三阶段是持续优化,监控实际使用情况,按需申请二次扩容。

扩容后的 TPM 配额绑定到客户 Azure 订阅,不与其他用户共享,确保高并发场景下的稳定输出。

技术迁移支持

从原生 OpenAI API 迁移到 Azure OpenAI 需要改造调用链路。我们提供端到端迁移支持:API 接口适配、认证方式切换、错误处理逻辑调整、监控指标迁移。迁移过程渐进式进行,先在测试环境验证,再分批次切换生产流量,确保零停机。

迁移完成后,OpenClaw 可立即享受 Azure OpenAI 的企业级能力,无需等待数月的审批周期。

结论

OpenClaw 的多 Agent 架构对并发能力有刚性需求,原生 OpenAI API 无法满足。Azure OpenAI 通过资源隔离、专属扩容、SLA 保障、全球部署,提供了企业级解决方案。作为专业伙伴,领驭科技的白名单申请与专属扩容服务可加速这一进程,让出海项目快速获得稳定的高并发承载力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)